融合改進韋伯特征的深度置信網絡表情識別

田 苗,郝曉麗

(太原理工大學 計算機科學與技術學院,山西 太原 030024)

0 引 言

在人臉表情識別系統中,表情的特征提取和分類是整個識別系統的關鍵[1-3]。機器學習專家Hinton提出了深度學習的概念[4,5]后,其已成功應用到圖像、語音、文本識別等各領域。研究表明了深度學習在學習和抽象圖像特征方面的天然優勢[6-8],但應用于表情的特征提取與識別時,仍存在局部結構特征表征不足等問題。

鑒于面部包含了豐富的紋理特征信息,并且紋理特征具有位移、角度、旋轉不變性的優點,本文擬將局部紋理特征引入DBN模型。近年來紋理特征的相關算法及改進研究成果很多:Guo等提出完全局部二值模式(CLBP)[9],以及基于Fisher準則的局部二值模式(FCL-CLBP)[10],均對紋理特征進行了優化;針對Gabor小波有Liu等提出的Gabor多方向特征融合規則[11],和Zhong等提出的基于局部Gabor特征的特征值提取法[12]等,均只部分解決了局部細微特征提取不足等問題,仍對圖片和噪音和強光不具備太強的魯棒性。本文基于韋伯特征(weber local descriptor,WLD)提出了雙值韋伯特征(BWLD),能篩選出更有鑒別力和魯棒性的紋理特征。

本文將局部紋理特征引入到深度置信網絡中,首先借助雙值韋伯局部描述子實現表情圖像的初次特征提;再次,將得到的初級特征引入深度置信網絡,做二次特征提取及分類,實現了二者的融合。經實驗驗證,該算法在識別率和魯棒性上表現出了良好的性能。

1 韋伯特征提取

韋伯局部描述子WLD是基于心理學Weber定律而提出的,該特征被陳杰等應用于描述圖像方面,在提取圖像紋理方面非常有效,在抑制噪音和光照方面也具有很好的魯棒性,實驗結果也表明其具有很高的區分度,同時在對噪聲和光照變化的人臉檢測中取得了較好的效果。本文針對傳統的WLD在局部紋理表征的局限性方面,提出了一種雙值韋伯局部描述子(binary weber local descriptor,BWLD),其特征通過新的梯度方向計算方法能更加有效地提取局部細節紋理信息,從而提高識別對噪音和光照的魯棒性。

1.1 韋伯局部特征(WLD)

陳杰等受Weber定律啟發,提出的韋伯局部描述子(WLD),使用鄰接強度差與當前像素強度比值作為圖像局部特征[13]。WLD特征由兩部分組成:差分激勵(differen-tial excitation)ξ,韋伯公式的比值,是鄰接像素變化與當前中心像素的比值,可以反映圖像中人眼可辨別的變化部分,用來描述圖像的顯著變化,如式(1)所示;梯度方向(orientation)θ,中心像素的特征提取方向,反映了像素在垂直和水平的空間方向上的灰度變化,用來描述局部特征在在空間結構分布上的方向信息,如式(2)所示。韋伯特征的ξ和θ計算過程如圖1所示,其中xc是中心像素,Xs包含Xc及其8個鄰接像素

(1)

(2)

圖1 WLD計算

1.2 雙值韋伯特種(BWLD)

由式(3)可知,原始WLD的方向算子僅僅使用了中心像素8個領接像素中的一半,僅反映了其紋理信息在空間分布上的水平方向和垂直方向上的梯度變化,無法深入反應其在空間分布上的其它灰度變化,即無法精確表征紋理信息更為本質的特征。例如在計算圖2中的3種不同紋理模式的WLD特征時,按照傳統WLD的計算方法,它們的ΔI都為0,即ξ=0,意味著,無法從差勵方面對它們進行區分,同時計算得到它們θ=0。這就表明對于傳統WLD,這3個紋理模式是無法區分的。這是因為韋伯特征中,計算梯度方向時,只考慮到了中心像素的4個鄰接像素,這導致了傳統方法在提取韋伯特征時,由于對一些強鑒別力的細節特征信息不具有精確表征能力,因此對噪音等的抗干擾能力弱。鑒于此,本文提出了新的WLD梯度方向計算方法,如式(3)所示。在此公式中,改進的WLD在計算方向算子時,中心像素的8個鄰接像素均使用了兩次,消除了鄰接像素在使用頻率上的不同對方向梯度產生的誤差,所以也基于此稱改進的韋伯局部特征為雙值韋伯特征(BWLD)。本文采用改進的BWLD方法,使用了中心像素的8個領接像素,準確反映了紋理特征的方向信息,強有效地抑制了噪音的影響。

圖2 局部紋理圖示例

BWLD梯度方向計算如圖3所示,公式則如下

(3)

圖3 BWLD梯度方向計算

從實驗結果來看,BWLD的梯度方向算子比傳統WLD具有更豐富的局部紋理信息,實驗對比如圖4所示,我們可以更加清晰看到圖中人臉的輪廓,且圖像中包含了更豐富的圖像細節信息。

圖4 傳統WLD和BWLD方向算子實驗結果對比

2 基于深度置信網絡的人臉表情識別

深度置信網絡(deepbeliefnet,DBN)是由多個限制玻爾茲曼機(restrictedBoltzmannmachine,RBM)層堆疊組成的多層神經網絡模型,是一種概率生成模型,每一層的輸出作為下一層的輸入,從而獲得更高級的抽象特征[4]。這種機制能減少處理數據量,更為充分儲存和利用有用的信息。與傳統神經網絡相比,DBN通過逐層訓練的方式有效避免了對所有層同時訓練的時間復雜度問題,同時對于

每層的限制玻爾茲曼機(RBM)內部的輸入進行逐一重構,其權值偏置也會不斷調優。這一貪心算法模式,大大提高了無監督學習的效率。

典型的DBN模型如圖5所示,這些網絡結構分為可視層和隱層,層與層間存在連接,但每層內的單元與單元間是相互獨立的。假設DBN有l個隱藏層,則可視單層v和l個隱藏層hk的聯合分布可用式(4)表示

(4)

其中,v=h0表示DBN的可視單元,hk(k=1,2,…,l)是第k層隱藏單元,P(hk|hk+1)是指第k層隱藏層獲得可視單元值的條件分布,滿足

P(hik|hk+1)=∏iP(hik|hk+1)

(5)

在第k層中,隱藏單元被激活的概率為

(6)

圖5 DBN網絡模型

3 融合雙值韋伯特征的深度置信網絡表情識別算法

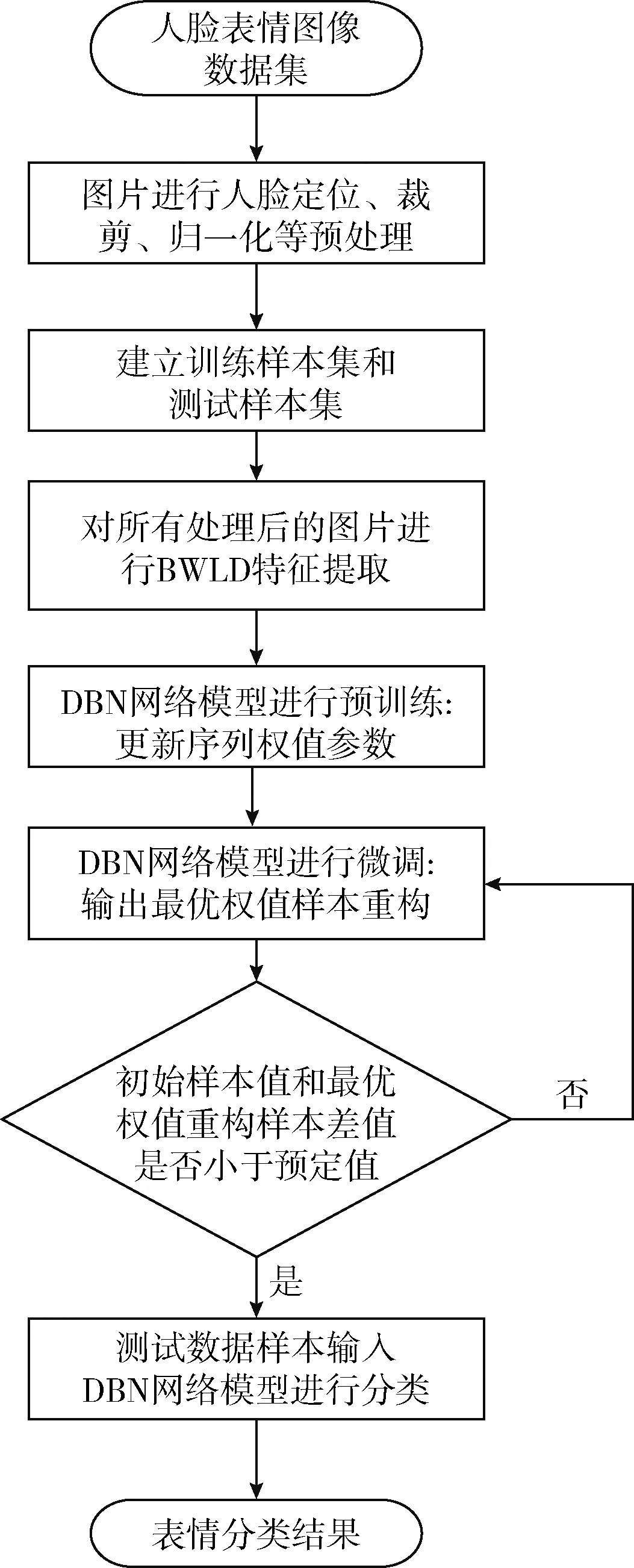

一般來說圖像檢索方法中基于局部特征方法要優于基于全局特征,但僅用局部特征表示圖像,又會丟失其全局結構信息,由于BWLD在提取局部紋理時的有效性,使得它得到廣泛的應用,同樣也有效應用于人臉表情識別的特征提取,但是它同樣無法有效表示其整體結構信息。而對深度學習來說,它具有很好的學習功能,但深度置信網絡(DBN)忽略了圖像的二維結構,難以學習到面部圖像的局部特征,所以當人臉表情圖像以向量形式的輸入,它雖然能學習到圖像的高級抽象特征,但對于人臉表情的局部結構信息特征有不足之處,因此,將BWLD和DBN相結合,即將人臉表情圖像提取到的BWLD紋理特征作為DBN的輸入,既能結合兩者之間的優勢,彌補兩者之間的不足,更能減少深度學習在學習、訓練過程中計算量低的問題,同時由于BWLD紋理特征具有灰度不變性和旋轉不變性等優點,所以其作為DBN的輸入時,其特征兼具局部性和全局性。本文的人臉表情識別流程如圖6所示。

圖6 人臉表情識別流程

4 實驗結果與分析

4.1 實驗設置

為了驗證本文所提出的改進WLD結合深度置信網絡算法的表情識別率,并進一步該評估算法的性能,實驗設置與已有的監督算法進行對比,實驗樣本使用了JAFFE數據庫作為樣本。JAFFE數據庫中有總計213幅圖片,分辨率為256×256,包含10個日本女性,每人做7種表情,分別是sad,happy,angry,disgust,surprise,fear,neutral。每種表情2-4幅圖像,部分原始圖像如圖7(a)所示,所有圖像經過歸一化處理后,圖像大小為64×64,部分預處理后的圖像如圖7(b)所示,我們將處理后全部圖像中其中9個個體數據作為訓練集,剩余一人的數據作為測試集。

圖7 JAFFE部分人臉表情

4.2 實驗步驟

步驟1 提取面部表情數據庫中圖像并進行面部定位、裁剪、歸一化等預處理;

步驟2 對DBN模型進行預訓練:初始化參數,通過采用自上而下逐層無監督的貪婪學習算法,更新序列權值參數;

步驟3 對預處理后的圖像分為訓練樣本集和測試數據樣本集,并分別進行BWLD特征提取;

步驟4 對DBN模型進行微調:根據輸入數據和重構數據的損失函數,利用BP算法重新調整網絡的參數;

步驟5 判斷初始樣本向量值和最優權值的重構向量值得差值是否小于預定值,是則進行步驟6,否則返回步驟4;

步驟6 將測試數據樣本輸入DBN網絡模型進行分類,并輸出結果。

4.3 實驗結果及分析

為了測試本改進的BWLD特征提取方法對識別結果的影響,實驗首先單獨使用DBN對人臉表情進行識別,再將DBN與WLD結合進行實驗,然后融合改進的BWLD與DBN對人臉表情進行識別,由于DBN本身并無識別功能,所以在DBN頂層設置BP神經網絡,用于微調整個網絡,DBN參數中,隱藏節點數為1時,隱藏層數為別為1、2、3。隱藏層數為1時,隱藏層的節點數分別為50、100、300、500,實驗結果分別見表1、表2。

表1 DBN、DBN+WLD與DBN+BWLD

表2 DBN、DBN+WLD與DBN+BWLD

由表1和表2 的實驗結果可以看到,當隱藏層數是1時,以及隱藏節點數為300時,識別效果最好,事實上,DBN的學習能力非常好,尤其是隱藏層時和隱藏節點數越多時,學習效果越強,但是由于JAFFE數據總樣本比較小,所以當隱藏層為1時,正確率最高。

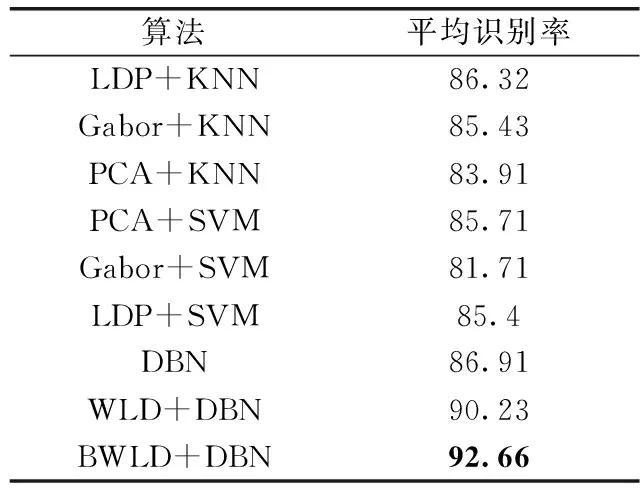

將本文的所提出的方法的實驗結果與人臉表情識別常用的改進局部二值模式(LDP)、Gabor變換、PCA的特征提取法,以及支持向量機(support vector machine,SVM)、K鄰近算法(K-nearest neighbor,KNN)識別方法相比較,其中DBN的參數設置為,隱藏層為1層,隱藏節點數為300,其中JAFFE數據庫中第6個個體作為測試樣本,其余9人作為訓練樣本,實驗結果見表3。

表3 不同算法在JAFFE數據庫正確識別率

5 結束語

本文采用先對表情圖像進行改進韋伯特征提取,再將其引入到深度置信網絡進行二次學習和識別的表情識別算法。實驗結果顯示,雙值韋伯特征相比傳統韋伯特征在紋理細節處更具表征能力,也對噪音和光照的魯棒性,有助于提高表情的識別率。將雙值韋伯特征引入到深度置信網絡中的算法,通過結合兩種特征提取的互補優勢,改善了韋伯局部和深度學習分別在圖像特征提取時的缺陷,同時雙值韋伯特征作為深度置信網絡的輸入減少其對冗余信息的學習和聯系,使得深度學習的學習速度也得到顯提高。最終在BP分類器下得到了良好的分類效果。但是在現實生活中,這種方法在表情識別的速率仍有不足,這將是我們以后繼續努力的方向。

[1]Jiang B,JIAKe-bin.A local discriminative component analysis algorithm for facial expression recognition[J].Acta Electronica Sinica,2014,42(1):155-159.

[2]Lenz I,Lee H,Saxena A.Deep learning for detecting robotic grasps[J].International Journal of Robotics Research,2013,34(4-5):705-724.

[3]Zhu Z,Luo P,Wang X,et al.Deep learning identity-preserving face space[C]//IEEE International Conference on Computer Vision.IEEE,2013:113-120.

[4]SUN Zhijun,XUE Lei, XU Yangming,et al.Overview of deep learning[J].Application Research of Computers,2012,29(8):2806-2810(in Chinese).[孫志軍,薛磊,許陽明,等.深度學習研究綜述[J].計算機應用研究,2012,29(8):2806-2810.]

[5]Lecun Y,Bengio Y,Hinton G.Deep learning[J].Nature,2015,521(7553):436-444.

[6]Liu Ping,Han Shizhong,Meng Zibo,et al.Facial expression recognition via a boosted deep belief network[C]//IEEE Conference on Computer Vision and Pattern Recognition.IEEE Computer Society,2014:1805-1812.

[7]Jung H,Lee S,Park S,et al.Development of deep learning-based facial expression recognition system[C]//The Workshop on Frontiers of Computer Vision.IEEE,2015:1-4.

[8]Gan Q,Wu C,Wang S,et al.Posed and spontaneous facial expression differentiation using deep Boltzmann machines[C]//International Conference on Affective Computing and Intelligent Interaction,2015:643-648.

[9]Guo Z,Zhang L,Zhang D.A completed modeling of local binary pattern operator for texture classification[J].IEEE Transactions on Image Processing,2010,19(6):1657.

[10]Guo Y,Zhao G,Pietik,et al.Discriminative features for texture description[J].Pattern Recognition,2012,45(10):3834-3843.

[11]LIU Shuaishi,TIAN Yantao,WAN Chuan.Facial expression recognition method based on Gabor multi-orientation features fusion and block histogram[J].Acta Automatica Sinica,2011,37(12):1455-1463(in Chinese).[劉帥師,田彥濤,萬川.基于Gabor多方向特征融合與分塊直方圖的人臉表情識別方法[J].自動化學報,2011,37(12):1455-1463.]

[12]ZHONG Sizhi.Research on facial expression recognition[D].Shanghai:East China Normal University,2015(in Chinese).[鐘思志.人臉面部表情識別算法研究[D].上海:華東師范大學,2015.]

[13]JIN Chao.Study of facial expression recognition method based on weber local descriptor[D].Hefei:Hefei University of Technology,2015(in Chinese).[金超.基于韋伯局部特征的人臉表情識別方法研究[D].合肥:合肥工業大學,2015.]