基于改進Faster R-CNN的Logo目標檢測方法①

黃明珠,黃文清

(浙江理工大學 信息學院,杭州 310018)

隨著計算機視覺技術的發展,該領域中的目標檢測技術越來越多地應用于實際生活中.Logo作為一種識別和傳達信息的視覺圖形,是人們在長期生活和實踐中形成的視覺化表達方式.不管是商品還是企業或是政府部門等,都有專屬的標志Logo.Logo的檢測有巨大的應用前景,是計算機視覺中的重要任務.目前對于Logo檢測的研究已有不少[1],例如文獻[2]中基于SIFT特征進行匹配的方法來檢索帶有特定Logo的圖像.文獻[3]首次提出了基于全局不變特征的Logo檢測與識別算法.以及基于前面的成果,文獻[4]嘗試利用一些約束條件,如圓和點或是圓和線的關系等,并且利用其中的文字信息進行更為精確的識別.以及文獻[5]所做的主要針對文本圖片中Logo目標的檢測研究.

Logo檢測任務可看成是具一般性的目標檢測任務.在卷積神經網絡(CNN)廣泛應用于物體檢測以前,以往的方法通常是通過人工選定特征描述符的傳統檢測手段,這些方法有很多的局限性,在實際中得不到很好的應用.并且這類傳統的檢測方法已達到了瓶頸.然而隨著卷積網絡在目標檢測技術方面的發展,各類研究成果被不斷提出.如文獻[6]中的R-CNN采用選擇性搜索來查找包含高概率對象的預測框,使用卷積層提取每個預測框的高維特征,由支持向量機(SVM)確定目標類別.但R-CNN中因為每個預測框都有一些重疊,存在大量重復計算的缺點.為了緩解這個問題,文獻[7]提出Fast R-CNN網絡,通過引入一個感興趣區域池化層(ROI Pooling)來共享特征的計算.該網絡使用整個圖像作為輸入來提取全局特征圖,然后感興趣區域池化層從它們中提取每個預測框的固定長度特征.然而,Fast R-CNN因采用選擇性搜索導致過程分離,限制了檢測速度進一步提升.因此,文獻[8]提出了區域提名網絡(RPN)以進一步提高檢測速度,相應的方法稱為Faster R-CNN.雖然RPN依賴于幾百個預測框就能達到和Fast R-CNN上千個預測框相同的檢測效果.但是在分辨率低的目標的檢測效果上,Faster R-CNN相較于Fast R-CNN是有所下降的.但是Faster R-CNN在檢測精度和檢測速度上取得了一個很好的平衡.此外,在上述的檢測方法中都應用了邊框回歸方法以提高檢測精度[6-8].

除了上面提到的方法之外,還有一類目標檢測方法不采用區域提名方法尋找預測框.如文獻[9]中提到的YOLO網絡,它們的特點是直接從整個特征圖上選取預測框和預測概率.并且它在檢測時加入全局上下文信息,很少在背景類的分類中出錯,并具有良好的泛化能力.但是,YOLO對物體的比例非常敏感.它通過在每個單元格上滑動來預測目標框.如果單元格太小,則無法提高速度;如果單元格太大,則難以檢測到物體.為了解決這些弱點,文獻[10]中提到的SSD網絡在每層卷積之后添加了池化操作,逐層遞減特征尺度以形成特征圖金字塔.然后,在每層特征圖上的單元格滑窗提取預測框.這不僅改善了YOLO在預測框選擇上的限制,還保證了速度.

目前,已提出的各類方法基本上都偏適用于中大型目標的檢測,小目標的檢測效果并不理想,這里提到的小目標指的是分辨率低的目標.小目標在圖像中往往占據很小的一部分,通過卷積之后它的特征會變得更小,特征的分辨率也就更低.這樣的目標特征不明顯而難以正確檢測,而相比之下中大型的目標卷積后的高分辨率的特征更加明顯所以好檢測.雖然不少學者針對小目標檢測性能的改善要求,已提出相應的解決辦法[11-13].但這些方法基本上都是通過獲取多尺度特征來改善小物體的檢測性能.這類方法不僅大大降低了檢測速度,而且不能保證提取的特征足以有效檢測小物體.

說完,他拿開手,繼續往前走。我傻傻地站在那里,還沒回過神來,甚至還能感受到他的手掌貼在我腹部的感覺。這感覺好奇怪,我不得不停下來喘l21氣,才能繼續練習。

為此,我們提出一種設想: 如果能基于現有的對中大型目標已達到良好檢測效果的網絡框架,通過改進,使其能將小目標的特征映射成具有相似特征分布的高分辨率的大目標的特征,那么就能提升Logo的檢測性能.基于這一考慮,本文針對現有的各類方法的分析結果和Logo目標的特點,選取Faster R-CNN作為改進框架.Faster R-CNN對中大型的目標具有良好的檢測效果,但對小目標的檢測效果不佳[14,15].我們將生成對抗模型應用到Faster R-CNN的網絡架構中,通過對抗訓練方式,使網絡具備將低分辨率的特征圖映射到高分辨率的特征圖的能力,從而提高整個網絡的檢測性能.

富集技術與便攜式鎢絲電熱原子吸收光譜儀聯用研究………………………溫曉東,陳路瓊,雷自榮,楊盛春(43)

1 改進的Faster R-CNN網絡結構

1.1 經典的Faster R-CNN的網絡模型

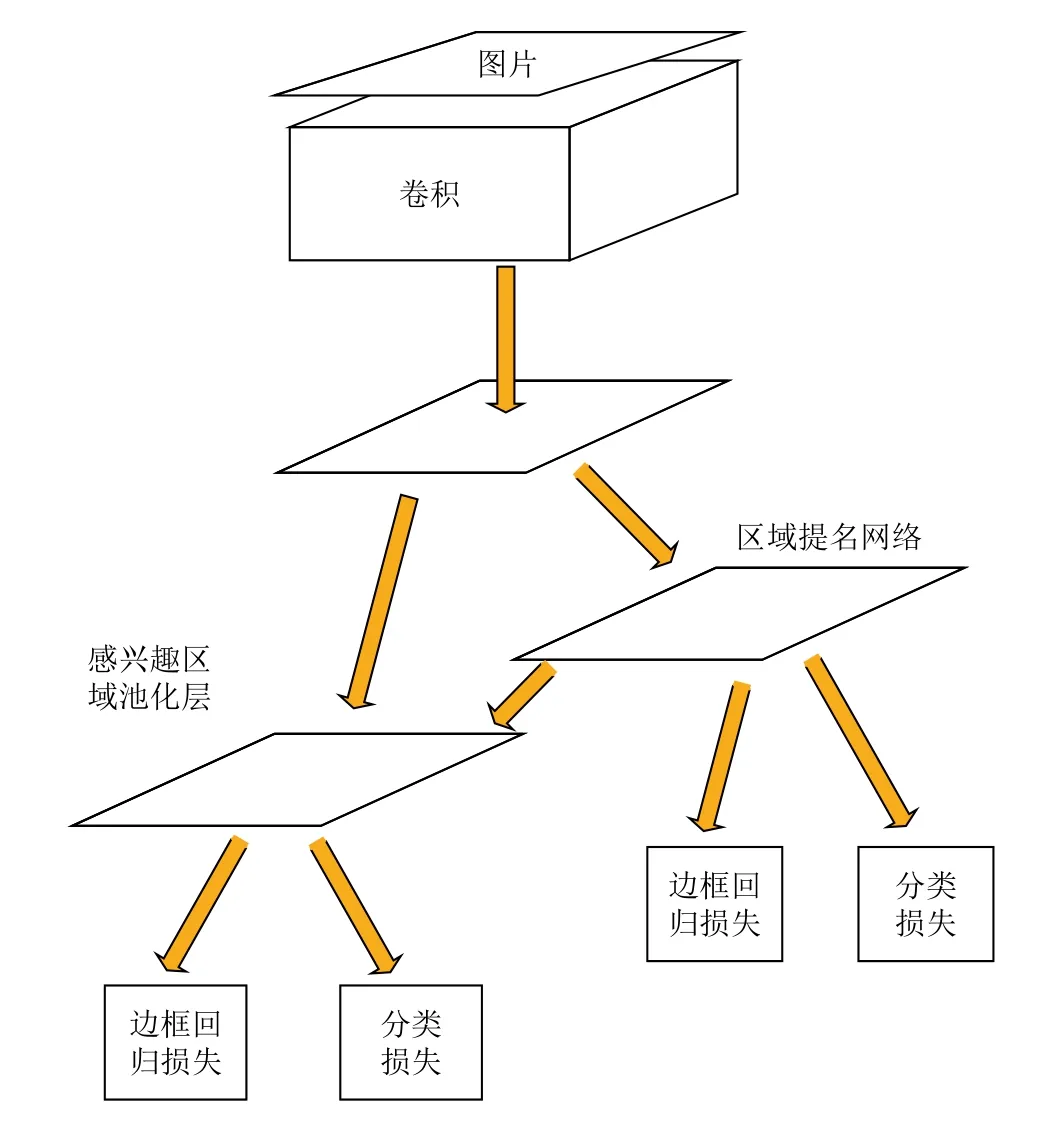

Faster R-CNN是經過R-CNN和Fast R-CNN的積淀,由Ross B.Girshick在2016年提出的.它在Fast RCNN的基礎上引入區域提名網絡(RPN)來提取預測框,解決了采用選擇性搜索導致的過程分離問題,并通過交替訓練使RPN和Fast R-CNN網絡共享參數.因此在結構上,Faster R-CNN已經將特征提取、預測框提取、邊框回歸(bounding box regression)、分類都整合在了一個網絡中,使得綜合性能有較大提高,尤其在檢測速度方面.Faster R-CNN網絡流程圖如圖1所示.

Faster R-CNN的結構主要包含卷積/池化、RPN網絡、感興趣區域池化層和分類器.首先由卷積/池化部分提取圖片的特征圖,接著由RPN網絡提取候選框,然后將候選框和特征圖輸入感興趣區域池化層提取各侯選框的特征,最后由分類器實現目標識別與定位.

圖1 經典的Faster R-CNN的檢測流程圖

為了盡可能保證使用大數據量的原始圖片進行訓練,本文的原始圖像來源于Flickrlogos-32和BelgaLogos數據集,它們都是互聯網上公開的數據集資源.

RPN網絡的提出雖然幫助Faster R-CNN加快了速度,但是由于RPN只依賴幾百個預測框選取目標位置,在目標的召回率上必定有所下降.并且RPN網絡的窗口類型有限難以滿足多種尺度目標的檢測需求.鑒于目前大部分數據集中的目標尺度適中,小型目標偏少,所以Faster R-CNN在窗口的設置上偏于適應中大型目標的檢測,對于小目標的檢測效果并不理想.

1.2 對抗生成網絡模型(GANs)

生成對抗網絡(GANs)[16]是用于學習生成模型的框架,由Ian Goodfellow于2014年首次提出.它并不一定要以卷積網絡構成,但已提出的各種用途的生成對抗網絡基本上都是卷積網絡.Mathieu等人[17]和Dentonet等人[18]采用了GANs實現圖像生成.在文獻[19]和文獻[20]中,GANs是分別用于學習從一個流形到另一個流形的風格轉移和修復的映射.除此之外,使用GANs進行無監督表征學習在文獻[21]中被提出.文獻[22]中提出將GANs應用到超分辨圖像.

一對戀人去登記結婚。“做過婚前檢查嗎?”“查過了,他房子、車子都全了。”“我是說去醫院。”女青年臉紅了,小聲回答:“查了,是個男孩。”

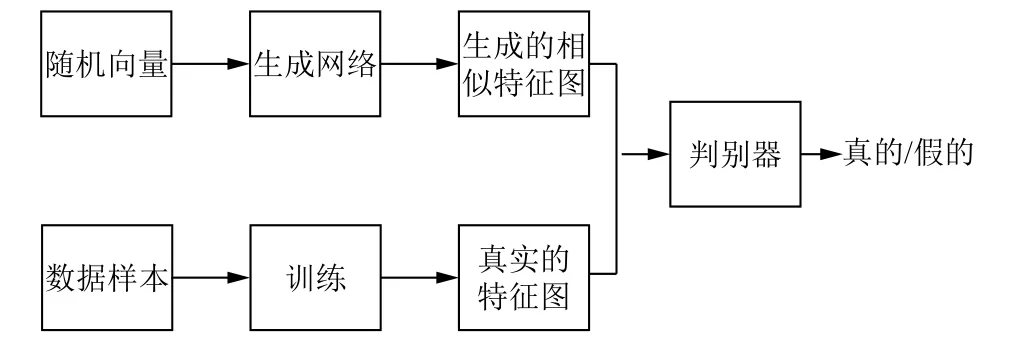

圖2 生成對抗網絡流程圖

1.3 改進的Faster R-CNN

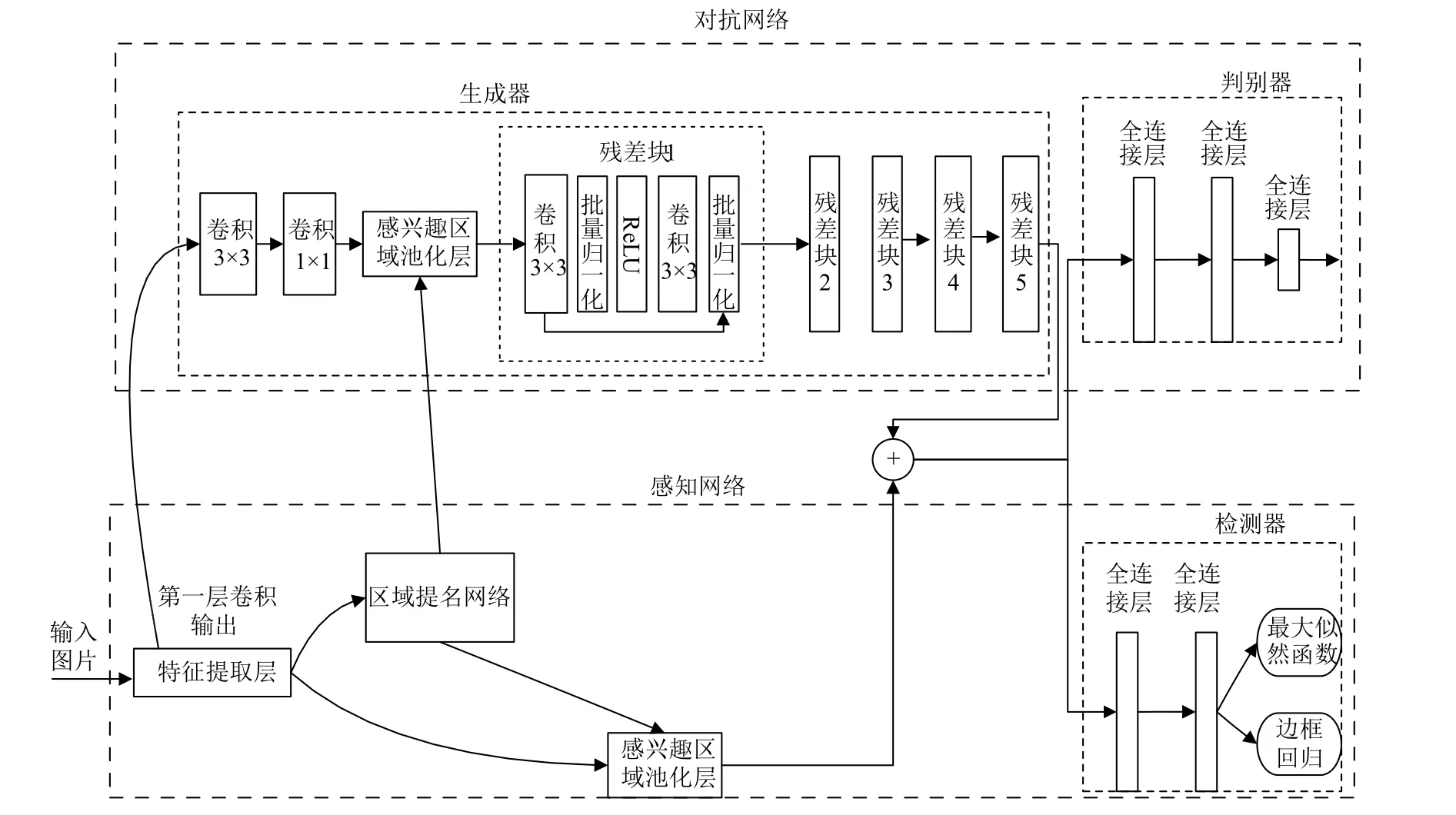

對抗網絡中,生成器以Faster R-CNN的第一層卷積輸出的特征作為輸入,然后進行3×3的卷積和1×1的卷積處理.這兩次卷積處理的主要目的是為了與感知網絡五層3×3的卷積的最終輸出的256個特征通道保持一致.五個殘差塊依次連接作為生成器的主干部分,用于學習低分辨目標特征和高分辨目標率特征的的特征偏差,再與下層的Faster R-CNN中的五層卷積得到的特征按像素相加得到高分辨率的特征.每個殘差塊都是由3×3的卷積層,批量規范化層以及ReLU激活函數層組成.判別器的輸入包括生成的高分辨目標特征和真實的高分辨目標特征兩類,生成的高分辨目標特征作為負樣本,真實的高分辨率目標特征作為正樣本,通過為兩種樣本安排不同的標記幫助判別器學習區分真偽數據.

本文基于Faster R-CNN網絡對中大型目標已有良好的檢測效果而對小目標的檢測效果不佳的情況,根據生成對抗網絡可生成高分辨率圖像的特性,提出了一種新的檢測器.網絡的具體結構如圖3所示,整個網絡可以分成兩個子網絡.上層子網絡是由生成器和判別器組成的對抗網絡,用于為低分辨率目標生成適當的特征偏差.下層子網絡是由Faster R-CNN框架構成的感知網絡,用于目標分類和回歸.

圖3 改進的Faster R-CNN網絡框架圖

感知網絡結構采用的是Faster R-CNN的檢測框架,以五層卷積進行特征提取.RPN網絡在特征圖上選取預測框后會送入檢測器做進一步的分類和回歸.

2 改進的Faster R-CNN的訓練過程

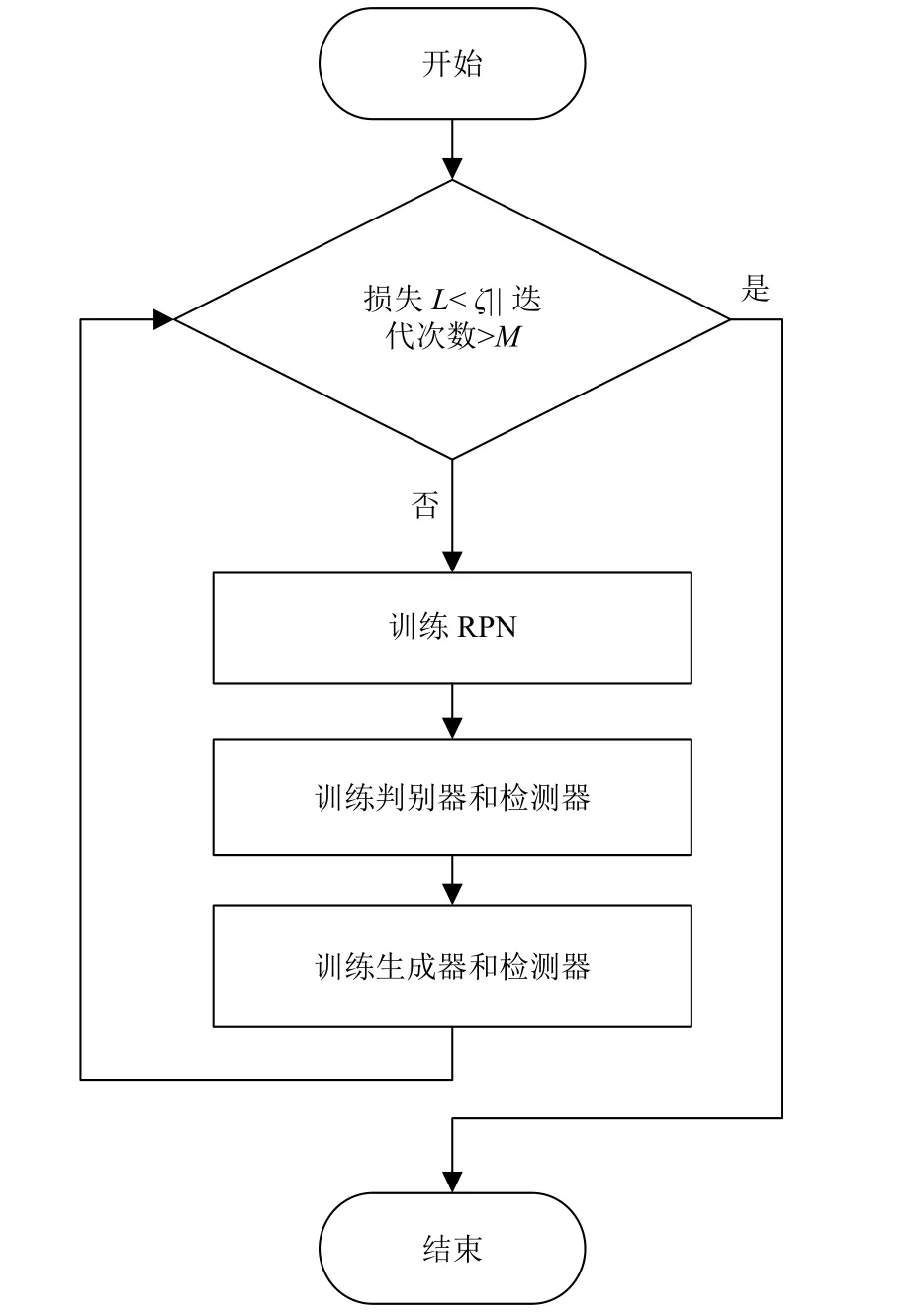

整個網絡的訓練過程是不斷交替的迭代過程.每次迭代的訓練過程如圖4所示,可分為如下三步:

1)訓練RPN網絡提取目標預測框.

2)訓練判別器和檢測器: 用高分辨的圖像訓練感知網絡和判別器,判別器利用判別損失Ldis反向調參判別網絡,感知網絡利用感知損失Lp反向調參感知網絡,相應的損失表達式將在下面具體介紹.

3)判別器參數保持不變,訓練生成器和檢測器: 用低分辨率的圖像一起訓練生成器和感知網絡,生成器會為低分辨率的目標生成合適的特征偏差,與感知網絡卷積后的目標特征按像素級相加得到生成的高分辨率的目標特征,送入判別器和檢測器.此時因為生成器和判別器的訓練過程是相互對抗的,為了提高生成器的生成能力,判別網絡不做反向調參.我們利用生成損失Lg和感知損失Lp一起監督整個高分辨率特征生成過程,相應的損失函數為L=w1Lg+w2Lc.其中,w1,w2是兩個權重.在這里我們將它們設置為1.

在使用數據集訓練網絡前,為了順利訓練生成對抗網絡,本文先對數據集進行了相應的預處理.預處理的步驟為: 首先,選取兩個數據集中目標尺寸大于64×64的圖片作為高分辨訓練樣本;接著,通過下采樣使其尺寸小于32×32,作為低分辨訓練樣本.測試樣本從兩個數據集中隨機選取并不做預處理.

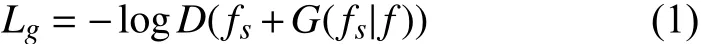

2.1 對抗損失

對于生成器,我們的目標是訓練一個生成函數G將fs轉換成fl來欺騙判別器D.這里fl和fs分別表示高分辨率的目標特征和相對應的低分辨率的目標特征.然而,生成器可能很難從fs中包含的有限信息中學習直接生成高分辨率的特征.因此,從感知網絡的低層卷積中引入特征f到生成網絡中來學習高分辨率特征和相對應的低分辨特征之間的特征偏差,通過和Faster R-CNN卷積后的特征做像素級的疊加生成最終的高分辨特征.在本文的設計中,我們的目標是改善小目標的檢測性能,所以只需為低分辨率的目標特征做高分辨率特征映射.對于高分辨率目標我們需要生成器生成的特征偏差為零.因此,相應的生成損失函數定義如下:

“昆北”陰平聲字“家”的唱調(《紫釵記·折柳》【寄生草】“可笑自家”,761),該單字唱調的過腔是。其中的即第一節級音性過腔,即第二節主調性過腔,由此構成的也是“級音+主調”兩節型過腔。

(3)所有收集的網絡與訪談資料均轉換成文本,對其進行詳細閱讀、提煉與分析,最終分類和歸納為4個方面:管理體制變革、行業規范推進、產品創新與產業融合,并且從這4個方面進行對比與探討。

圖4 改進的Faster R-CNN的訓練流程圖

訓練結束時,每個訓練預測框都被標記一個真值類別和真值框的目標位置.

當對抗訓練達到平衡時,即判別網絡無法區分輸入是真實特征圖還是生成特征圖時,此時的生成器已經可以為低分辨率的小目標生成以假亂真的高分辨特征,生成器的訓練可以停止.

2.2 感知損失

在感知網絡訓練過程中,從特征圖提取的每個預測框被送入檢測器,得到兩類輸出.第一個輸出層由softmax回歸計算n+1個類中每個預測框的概率p=(p0,p1,…,pn).第二個輸出層計算預測框坐標rn=(rnx,rny,rnw,rnh).然后,使用公式(3)定義的多任務損失函數Lp對預測框的類型和坐標進行回歸計算,同時計算得到預測框的坐標偏移.

生成對抗網絡是由競爭的兩個神經網絡模型組成.一個將噪聲作為輸入并生成樣本,所以稱為生成器,用G來表示.另一個模型稱為判別器,用D來表示.它的輸入有兩種,一種是生成器生成的樣本,另一種是訓練數據中的真實樣本.生成器的目的是生成能欺騙判別器的樣本,判別器的目的的是能夠區分樣本是生成的還是真實的樣本.這兩個網絡的訓練過程是對抗學習,并且兩個網絡同時訓練,最后當生成器和判別器的損失函數達到一個平衡(納什平衡)時,即G可以生成足以“以假亂真”的樣本G(z).對于D來說,它難以判定G生成的圖片究竟是不是真實的,因此D(G(z))=0.5.生成對抗網絡模型的流程圖如圖2所示.

其中,Lcls(p,g)=-logpg是真實類別g的對數損失.Lloc是邊界回歸損失函數,定義如下:

其中,SL1是平滑損失函數,定義如下.

對于判別器,對于輸入的真實的高分辨率特征和生成的高分辨率特征,需要通過判別損失來反向調參,使判別器通過訓練對于輸入的真偽數據學習區分.顯然當Ldis足夠小時,判別器將能夠區分所生成的特征與真實的特征之間的差異.最后,判別損失可以描述為:

⑤建立防患于未然思想 。從醫療機構和衛生行業來看,公眾輿論事件具有較大的影響,甚至會嚴重影響醫院的未來生存和發展。由此可見,醫院的高層領導需高度關注負面輿情和輿論危機,建立監測和處理輿情的機制流程,對潛在的輿論隱患進行有效防控。認真落實新聞發言人制度,從制度層面上防止發生輿論引導的失誤。通常事件發生后需在最短時間內進行處理,同時啟動我院的新聞發言人制度,多方面考慮輿論情關注焦點和方向,公布事件真相,避免負面效應擴散。在全院建立輿情無小事理念,把傳統媒體和自媒體并重利用,根據不同需要綜合利用。

3 實驗結果分析

3.1 數據集

RPN網絡是Faster R-CNN的核心部分,類似于以往目標檢測中的選擇性搜索的作用,通過卷積神經網絡來選取候選框.由于圖片中的目標的尺度和寬高比不一,需要多種類型的窗口.因此,RPN采用anchor機制,即設定一個基準窗口大小,按照(8,16,32)三種倍數和(0.5,1,2)三種比例得到9種尺度的窗口.通過在輸入的特征圖上滑動窗口,即可得到關于這張圖片的目標預測框.RPN網絡的輸出是一個包含二類分類和邊框回歸的多任務模型.二類分類通過Softmax輸出預測框屬于前景類還是背景類,邊框回歸則是用于計算預測框的偏移量,以便獲得更加準確的定位.最后,綜合預測框的概率和偏移量,運用非極大值抑制(NMS)去除太小和超出邊界的預測框,然后將預測框送入完全連接層做進一步的分類和邊框回歸.

第二階段為依賴階段,企業己建立較完整的安全條件和紀律約束,員工需要遵守安全規范要求,安全管理不只是安全管理人員的職責,其它員工也有義務參與。

交替訓練過程中,生成器不斷學習為低分辨的目標特征生成合適的特征偏差,判別器不斷學習區分生成的高分辨率特征和真實的高分辨率特征.通過迭代訓練會不斷加強生成器和判別器的能力,從而提高低分辨率的小目標的檢測準確率.

本研究采用綜合心理護理方法,在以人為本護理理念指導下,充分了解患者需求和存在的問題,為其提供心理護理,干預人員與患者建立互信平等的朋友關系,為實施心理護理奠定基礎。

1.2.2 水資源供給 河套灌區水資源的供給渠道主要有引黃河水、地表水、地下水和中水回用。2016年河套灌區供水總量為44.871億m3,其中引黃水量為39.374億m3,占供水總量的87.75%;本地地表水、地下水、中水回用分別為0.148,5.185,0.164億m3(圖2)。

按照上述步驟,獲得訓練樣本7532張,測試集4000張.然后,按照Pascal VOC 2007的數據格式對獲取的訓練樣本數據集和測試集進行相應的轉換工作.

因為Logo的種類眾多,并且獲取的每種類別擁有的圖片量不一,有的數量太少不足以用來進行更進一步的細化分類訓練.因此,所有本文的Logo目標檢測只做兩類分類和定位,并不對Logo再細致分類.

3.2 網絡參數設置

對于Logo檢測,先采用ImageNet大型分類數據集對基礎網絡做預訓練,獲得五層卷積的參數初始化.除此之外,網絡中添加其它結構均采用“Xavier”[23]進行參數初始化.

整個網絡使用隨機梯度下降(SGD)訓練,動量為0.9,權重衰減量為0.0005;殘差塊的數量設置為5.在訓練期間,25%的樣本是前景,剩下的是背景.預測框與真值框的交并比(IOU)至少0.5.

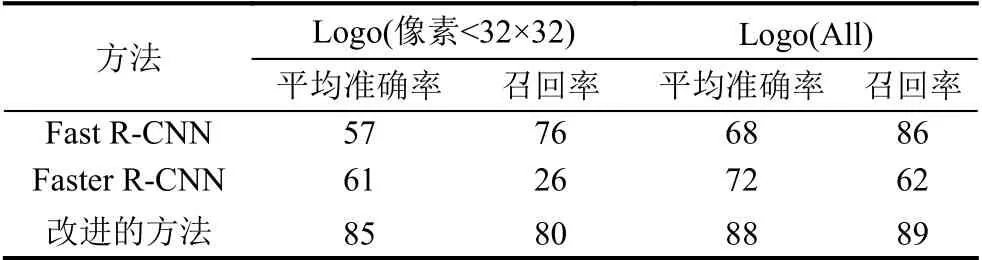

3.3 方法比較

本文方法的測試是在NVIDIA GeForce GTX 1070 GPU和Caffe平臺上實現的.表1顯示了本文的方法與其他方法在Logo檢測上的平均準確率和召回率的比較.從數據中,我們可以明顯看出,改進的方法在檢測性能方面優于Faster R-CNN,說明了我們的改進發揮了作用,并且因為Fast R-CNN在候選框選取數量遠遠多于Faster R-CNN,所以在小物體的檢測方面召回率要優于Faster R-CNN.然而,在Logo的檢測上,我們的方法依賴于更少的預測框在小物體的檢測效果上已經超過了Fast R-CNN,說明了本文提出的方法在小目標的檢測上有優勢.

表1 本文方法與Fast R-CNN和Faster R-CNN在Logo測試集上的檢測性能比較(%)

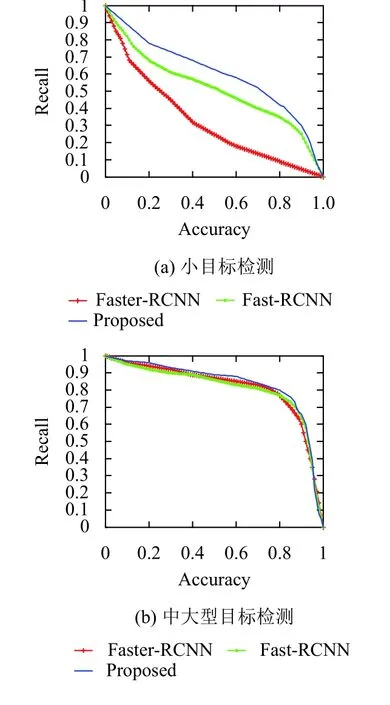

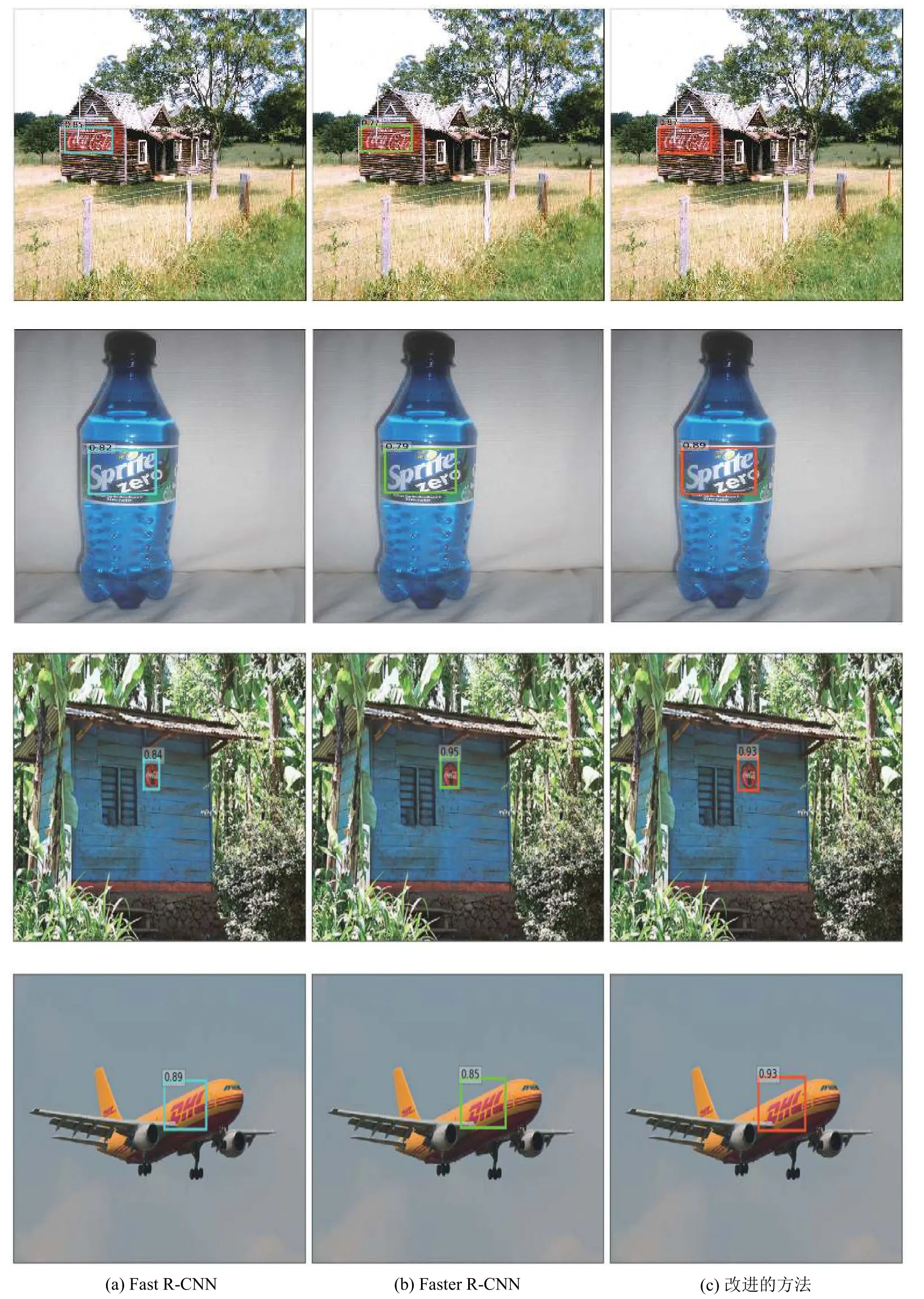

為了分析不同尺度下三種方法的性能,我們將目標劃分為兩種類型的尺度: 像素小于32×32小目標和像素大于32×32的中大型目標.通過Accuracy-Recall曲線比較它們在Logo數據集上的檢測性能,如圖5所示.總的來說,我們的方法優于其他方法,特別是在小物體的檢測中,證明了我們方法的有效性.如圖5(a)所示,Fast R-CNN在小目標檢測中優于Faster R-CNN.然而,當將GAN引入Faster R-CNN時,改進的Faster R-CNN比Fast R-CNN方法獲得更好的性能.它證明了生成器為小目標創造了適當的偏差,使小目標的特征與大目標的特征相似,從而獲得了良好的性能.對于大中型物體檢測,圖5中所示的三種方法略有不同.客觀地說,Fast R-CNN的性能比其他兩種方法弱.在測試中型和大型物體時,Faster R-CNN稍微弱于我們的改進方法.為了更直觀顯示我們的檢測效果,我們隨機選取了幾張三種方法在Logo數據集上的檢測效果圖,如圖6所示.圖6中子圖(a)、(b)、(c)分別代表的是Fast R-CNN、Faster R-CNN和改進的方法的檢測效果圖.從圖中可以看出,相比于前兩種方法,改進的方法在定位和分類概率上都更加準確.

圖5 改進方法與Fast R-CNN和Faster R-CNN的Accuracy-Recall曲線圖

4 結語

本文將GAN引入Faster R-CNN框架.我們使用生成網絡生成一個特征偏差,使小目標的特征類似于大目標的特征,從而欺騙了判別器.通過這種策略,與Faster R-CNN相比,我們的方法有效地提高了小目標的檢測性能.盡管我們的方法使用Logo數據集進行訓練和測試,但是該方法的應用不只限于Logo的檢測,而且還可以用于其他情況下的小目標檢測.當然,我們需要改進的地方還有很多.兩種模型的組合使網絡結構更加復雜,訓練還需要分兩個階段完成,訓練時間和計算量的增加是不可避免的.

圖6 改進的方法與Fast R-CNN和Faster R-CNN在測試集的檢測效果圖