改進(jìn)Camshift算法的多行人目標(biāo)跟蹤方法

陳 藝

改進(jìn)Camshift算法的多行人目標(biāo)跟蹤方法

陳 藝

(四川文理學(xué)院,四川 達(dá)州 635000)

針對(duì)基于顏色特征的目標(biāo)跟蹤方法在跟蹤多個(gè)行人目標(biāo)時(shí),易受衣服顏色相近的行人影響,造成行人目標(biāo)跟蹤發(fā)生錯(cuò)誤的問(wèn)題,提出一種改進(jìn)Camshift算法的多行人目標(biāo)跟蹤方法:為克服單一顏色特征作為目標(biāo)模型易造成目標(biāo)丟失的不足,按一定的權(quán)值系數(shù)融合目標(biāo)的顏色特征和HOG特征來(lái)建立目標(biāo)模型;并分別對(duì)多個(gè)行人目標(biāo)建立目標(biāo)模型,將傳統(tǒng)的Camshift算法的單目標(biāo)跟蹤擴(kuò)展成多目標(biāo)跟蹤。實(shí)驗(yàn)結(jié)果表明,該方法相比于傳統(tǒng)Camshift算法更具魯棒性,跟蹤準(zhǔn)確率可提升5.3 %,相比于粒子濾波算法,實(shí)時(shí)性能夠提升30.23 %。

Camshift算法;顏色特征;多目標(biāo)跟蹤:融合系數(shù)

0 引言

隨著社會(huì)的不斷發(fā)展和科技的不斷進(jìn)步,視頻幀序列中目標(biāo)的跟蹤問(wèn)題[1-2]已經(jīng)成為計(jì)算機(jī)視覺(jué)研究領(lǐng)域的熱點(diǎn)之一。在智能交通、電子監(jiān)控系統(tǒng)、流量監(jiān)控等領(lǐng)域有著重要的實(shí)用價(jià)值與廣闊的應(yīng)用前景。

目標(biāo)跟蹤[3]指的是在視頻幀序列的每一幀圖像中找到感興趣目標(biāo)的位置。實(shí)用的目標(biāo)跟蹤算法不僅要求能夠準(zhǔn)確實(shí)時(shí)地跟蹤目標(biāo),而且要求在光照變化、目標(biāo)相似等復(fù)雜的背景下也能有較強(qiáng)的抗干擾能力。

目標(biāo)跟蹤算法一般分確定性和隨機(jī)性目標(biāo)跟蹤算法2種[4-6]。前者是通過(guò)重復(fù)反饋來(lái)逼近所需的目標(biāo),此目標(biāo)作為下一幀的初始值,如連續(xù)的自適應(yīng)均值漂移(continuously adaptive mean-shift, Camshift)算法[7]具有跟蹤速度快、自適應(yīng)目標(biāo)旋轉(zhuǎn)和尺寸的變化等優(yōu)勢(shì);后者是通過(guò)計(jì)算離散樣本的狀態(tài)與目標(biāo)數(shù)學(xué)模型的相似度來(lái)找到候選目標(biāo),如粒子濾波[8-10](partice filter, PF)算法,其利用高斯分布的粒子群對(duì)圖像中每一個(gè)粒子所處區(qū)域計(jì)算概率密度函數(shù)進(jìn)行近似,再計(jì)算與目標(biāo)數(shù)學(xué)模型的匹配度,最終確定候選目標(biāo)。文獻(xiàn)[11]采用Camshift算法進(jìn)行目標(biāo)跟蹤,對(duì)跟蹤目標(biāo)的旋轉(zhuǎn)與形狀變化有著較強(qiáng)的魯棒性。但由于單一顏色特征易受到環(huán)境的影響,因此在光照變化及相似目標(biāo)的復(fù)雜背景中容易發(fā)生目標(biāo)丟失的情況,跟蹤效果不理想。文獻(xiàn)[12]提出基于混合高斯和稀疏光流的多目標(biāo)跟蹤算法,實(shí)時(shí)性好,對(duì)光照和噪聲有較強(qiáng)的魯棒性;但目標(biāo)個(gè)數(shù)過(guò)多和目標(biāo)較為相似的情況下,跟蹤效果不理想。文獻(xiàn)[13]提出將目標(biāo)的顏色直方圖作為粒子濾波的狀態(tài)量,實(shí)現(xiàn)了復(fù)雜背景下的彩色圖像的單目標(biāo)跟蹤,魯棒性較強(qiáng);但由于粒子數(shù)多,計(jì)算量大,實(shí)時(shí)性較差,且無(wú)法跟蹤多個(gè)目標(biāo)。文獻(xiàn)[14]基于卡爾曼(Kalman)濾波的行人跟蹤可通過(guò)狀態(tài)方程預(yù)測(cè)行人目標(biāo)下一刻大概率所處的位置,加快對(duì)行人目標(biāo)的定位;但是卡爾曼濾波適用于線性系統(tǒng),局限性較大。

針對(duì)上述問(wèn)題,尤其是背景中出現(xiàn)衣服顏色相近的行人干擾以及光照強(qiáng)度變化等問(wèn)題,本文提出一種改進(jìn)Camshift算法的多行人目標(biāo)跟蹤方法。首先,按一定的權(quán)值系數(shù)融合目標(biāo)的顏色特征和方向梯度直方圖(histogram of oriented gradient, HOG)特征來(lái)建立目標(biāo)模型,以保障算法實(shí)時(shí)性同時(shí)提高算法的魯棒性;其次,分別對(duì)多個(gè)行人目標(biāo)建立目標(biāo)模型,將傳統(tǒng)的Camshift算法的單目標(biāo)跟蹤擴(kuò)展成多目標(biāo)跟蹤,實(shí)現(xiàn)對(duì)多行人目標(biāo)的有效跟蹤。

1 傳統(tǒng)Camshift算法

Camshift利用目標(biāo)的顏色直方圖模型將圖像轉(zhuǎn)換為顏色概率分布圖,初始化一個(gè)搜索窗的大小和位置,并根據(jù)上一幀得到的結(jié)果自適應(yīng)調(diào)整搜索窗口的位置和大小,從而定位出當(dāng)前圖像中目標(biāo)的中心位置。算法主要分為3部分:

1)色彩投影圖。將紅(red, R)、綠(green, G)及藍(lán)(blue, B)顏色空間變換到色調(diào)(hue, H)、飽和度(saturation, S)及明度(value, V)顏色空間,減少光照度對(duì)跟蹤效果的影響;對(duì)目標(biāo)區(qū)域作H分量的顏色直方圖;將每個(gè)像素的值用顏色出現(xiàn)的概率表示,得到顏色概率分布圖。

2)漂移(Menshift)算法。對(duì)一幀圖像進(jìn)行迭代尋找到最優(yōu)的概率分布來(lái)尋找目標(biāo)的位置信息,其位置信息通過(guò)計(jì)算目標(biāo)區(qū)域的零階矩陣和一階矩陣得到質(zhì)心坐標(biāo)并確定搜索窗的大小。

3)Camshift算法。將Meanshift算法擴(kuò)展到整個(gè)視頻幀序列則為Camshift算法。其將上一幀的迭代結(jié)果作為下一幀的初始值,如此反復(fù)迭代實(shí)現(xiàn)對(duì)目標(biāo)的跟蹤。

2 改進(jìn)多行人目標(biāo)跟蹤算法

由于基于顏色特征的Camshift算法在跟蹤衣服顏色相近的行人時(shí)會(huì)發(fā)生行人目標(biāo)跟蹤發(fā)生錯(cuò)誤的問(wèn)題,且傳統(tǒng)Camshit算法只能跟蹤一個(gè)目標(biāo),無(wú)法滿足復(fù)雜的場(chǎng)景需求。針對(duì)以上問(wèn)題,提出改進(jìn)的Camshift的多行人目標(biāo)跟蹤算法,優(yōu)勢(shì)表現(xiàn)在能夠?qū)崿F(xiàn)多行人目標(biāo)的跟蹤,并在出現(xiàn)衣服顏色相似的行人干擾時(shí),通過(guò)融合行人的顏色特征和方向梯度直方圖(histogram of oriented gradient, HOG)特征的目標(biāo)跟蹤算法來(lái)準(zhǔn)確跟蹤行人目標(biāo)。圖像處理流程如圖1所示。

圖1 圖像處理流程

2.1 行人目標(biāo)模型

由于行人一般會(huì)穿著帶有顏色的服裝,顏色信息對(duì)于圖片的旋轉(zhuǎn)、尺寸的變化不敏感;HOG特征是局部區(qū)域描述符,能夠很好地描述行人特征;因此,本算法通過(guò)融合行人衣著的顏色特征和HOG特征來(lái)建立行人目標(biāo)模型。

1)顏色特征提取。RGB顏色空間[15]相較于HSV顏色空間對(duì)光照的變化較更為敏感,因此使用HSV顏色空間來(lái)建立目標(biāo)的數(shù)學(xué)模型。HSV顏色空間中,色度、亮度、飽和度相互獨(dú)立,其中亮度容易受到光照變化的影響;所以只根據(jù)行人目標(biāo)的色度(H)和飽和度(S)建立數(shù)學(xué)模型,并生成反向投影圖,利用Bhattacharyya系數(shù)[16]衡量目標(biāo)與候選目標(biāo)的相似性。

將H-S子空間量化成16和16個(gè)相等的空間,構(gòu)成空間特征值的個(gè)數(shù)=16×16的直方圖空間。行人H-S空間的概率密度為

式中:為目標(biāo)區(qū)域各像素到區(qū)域中心的長(zhǎng)度;像素的權(quán)重與的大小成負(fù)相關(guān),所以中心區(qū)域附近的像素對(duì)模型影響更大。

候選行人目標(biāo)位于的概率密度為

3)HOG特征提取。行人特征可用邊緣[17]、SIFT特征[18]、Haar特征[19]來(lái)描述。因?yàn)镠OG特征是對(duì)目標(biāo)的局部區(qū)域描述符,對(duì)光照變化、小角度旋轉(zhuǎn)有較強(qiáng)的抗干擾能力,本文利用HOG特征[20]來(lái)描述行人。對(duì)輸入圖像的各像素求梯度大小及方向?yàn)?/p>

視頻幀大小為64×128,并將其均分為8×8個(gè)像素的單元(cell),計(jì)算單元內(nèi)每個(gè)像素的梯度幅值和方向,把[-90°, 90°]的梯度方向平均劃分為9個(gè)區(qū)間(bin)。將2×2個(gè)cell作為一個(gè)塊(block),掃描步長(zhǎng)為單個(gè)cell,遍歷整個(gè)圖像,共有105塊(block),每個(gè)block有36個(gè)特征描述子,整張圖片共有3780個(gè)HOG特征描述子。

根據(jù)式(9)對(duì)HOG特征描述子進(jìn)行歸一化作為行人特征描述子為

式中:為未進(jìn)行歸一化的描述子;為常數(shù)。

4)行人模型建立。上述的顏色特征提取與HOG特征提取分別建立了行人的顏色特征模型和HOG特征模型,再分別計(jì)算它們的反向投影,按照一定的權(quán)值融合顏色特征模型和HOG特征模型,建立行人目標(biāo)[21]的模型為

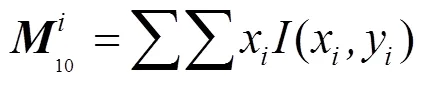

2.2 行人圖像坐標(biāo)計(jì)算

傳統(tǒng)的Camshift[21-22]單目標(biāo)跟蹤算法只提取目標(biāo)的顏色特征作為目標(biāo)的模型,易受顏色相似目標(biāo)的影響,造成目標(biāo)的丟失。本文針對(duì)此問(wèn)題,融合行人的衣著顏色和HOG特征分別對(duì)每個(gè)行人目標(biāo)建立目標(biāo)模型,實(shí)現(xiàn)多行人目標(biāo)的跟蹤;優(yōu)勢(shì)在于能夠提高算法的魯棒性,且能保持Camshift算法自適應(yīng)目標(biāo)尺寸和旋轉(zhuǎn)的變化。改進(jìn)的Camshift多行人目標(biāo)跟蹤算法主要分為3個(gè)部分:顏色特征和HOG特征的反向投影計(jì)算、Meanshift算法、Camshift算法,算法流程如圖2所示。

圖2 改進(jìn)Camshift的多行人目標(biāo)跟蹤算法(注:虛線框?yàn)镸eanshift算法)

Meanshift算法(圖1虛線框部分)是Camshift算法的核心環(huán)節(jié),提取了行人目標(biāo)的顏色特征和HOG特征,并計(jì)算其反向投影,按一定的權(quán)值融合顏色特征和HOG特征的反向投影。Meanshift算法利用其反向投影和初始化坐標(biāo),通過(guò)重復(fù)反饋的方式計(jì)算行人目標(biāo)的質(zhì)心,一旦搜索窗中心到目標(biāo)質(zhì)心的距離小于給定的閾值,就將搜索窗作為目標(biāo)區(qū)域。

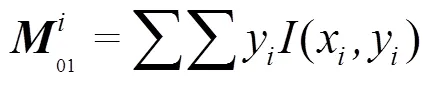

分別計(jì)算每個(gè)行人目標(biāo)搜索窗口的零階矩陣為

的一階矩為

的一階矩為

式中()為反向投影的圖中()處的像素值。

由零階矩以及在、方向的一階矩計(jì)算出待搜索區(qū)域的質(zhì)心為

通過(guò)零階矩來(lái)確定跟蹤窗口的尺度因子S為

式中為第個(gè)行人目標(biāo)。

3 實(shí)驗(yàn)與結(jié)果分析

為了驗(yàn)證改進(jìn)Camshift的多行人目標(biāo)跟蹤算法的魯棒性與實(shí)時(shí)性,利用改進(jìn)Camshift的多行人跟蹤算法與傳統(tǒng)的Camshift算法進(jìn)行多行人目標(biāo)的跟蹤實(shí)驗(yàn),測(cè)試本文算法的魯棒性;利用改進(jìn)Camshift的多行人跟蹤算法與粒子濾波算法進(jìn)行多行人目標(biāo)的跟蹤實(shí)驗(yàn),測(cè)試本文算法的實(shí)時(shí)性。

3.1 魯棒性驗(yàn)證實(shí)驗(yàn)

本實(shí)驗(yàn)主要驗(yàn)證融合顏色特征和HOG特征的Camshift多行人目標(biāo)跟蹤算法的魯棒性。實(shí)驗(yàn)分析對(duì)比了傳統(tǒng)Camshift算法與改進(jìn)Camshit算法在行人目標(biāo)顏色相似以及光照強(qiáng)度變化的復(fù)雜場(chǎng)景中行人目標(biāo)的跟蹤效果。其中行人衣服顏色相似的跟蹤結(jié)果對(duì)比實(shí)驗(yàn)如圖3和圖4所示。

從圖3可以看出,傳統(tǒng)的Camshift算法對(duì)多行人目標(biāo)進(jìn)行跟蹤,由于背景中存在與目標(biāo)行人相似衣服顏色的行人,出現(xiàn)了行人目標(biāo)跟蹤發(fā)生錯(cuò)誤的情況。由圖3中間那幅圖可以看出,編號(hào)為2的行人目標(biāo)旁邊出現(xiàn)與其衣服顏色相似的行人,當(dāng)編號(hào)為2的行人目標(biāo)經(jīng)過(guò)此行人時(shí),傳統(tǒng)的Camshift跟蹤算法發(fā)生了跟蹤錯(cuò)誤,跟蹤到了錯(cuò)誤目標(biāo)。由圖4可以看出,由融合顏色特征和HOG特征的Camshift算法行進(jìn)多行人目標(biāo)跟蹤時(shí),編號(hào)為2的行人目標(biāo)經(jīng)過(guò)與其衣服顏色形式的行人,仍能進(jìn)行準(zhǔn)確的跟蹤行人目標(biāo)。由表1可以看出,改進(jìn)的Camshift算法相比于傳統(tǒng)的Camshift算法的跟蹤準(zhǔn)確率提升了5.3 %。由表2可以看出,2種算法的實(shí)時(shí)性幾乎相當(dāng)。

表1 跟蹤準(zhǔn)確率對(duì)比

圖4是籃球運(yùn)動(dòng)員籃球比賽的復(fù)雜場(chǎng)景,利用傳統(tǒng)Camshift算法對(duì)多個(gè)籃球運(yùn)動(dòng)員進(jìn)行跟蹤時(shí),當(dāng)2個(gè)穿著白色衣服的運(yùn)動(dòng)員出現(xiàn)部分交叉時(shí),跟蹤發(fā)生錯(cuò)誤;而使用融合HOG特征和衣服顏色特征的改進(jìn)Camshit算法仍可以進(jìn)行準(zhǔn)確跟蹤。

圖3 衣服顏色相似的跟蹤結(jié)果1

圖4 衣服顏色相似的跟蹤結(jié)果2

圖5是在光照強(qiáng)度變化的場(chǎng)景中進(jìn)行的實(shí)驗(yàn)。

圖5 光照強(qiáng)度變化的跟蹤結(jié)果

首先,在初始幀選定目標(biāo),之后應(yīng)用本文方法和傳統(tǒng)的Camshift對(duì)目標(biāo)進(jìn)行跟蹤。從圖中可以看出:只利用顏色信息描述目標(biāo)的傳統(tǒng)Camshift方法在光照很弱的場(chǎng)景下,搜索框?qū)?huì)產(chǎn)生漂移,無(wú)法準(zhǔn)確跟蹤目標(biāo),如圖中的2號(hào)框所示;而本文方法能夠?qū)崟r(shí)準(zhǔn)確地跟蹤目標(biāo),如圖中的1號(hào)矩形框所示。

表2 3種跟蹤算法的時(shí)間對(duì)比

3.2 實(shí)時(shí)性驗(yàn)證實(shí)驗(yàn)

本實(shí)驗(yàn)主要驗(yàn)證融合顏色特征和HOG特征的Camshift多行人目標(biāo)跟蹤算法在魯棒性良好的情況下算法的實(shí)時(shí)性。實(shí)驗(yàn)分析對(duì)比了在行人目標(biāo)顏色相似的復(fù)雜場(chǎng)景中粒子濾波算法與改進(jìn)Camshift算法的跟蹤效果。對(duì)比實(shí)驗(yàn)如圖6所示。

圖6 粒子濾波算法與改進(jìn)Camshift算法多行人跟蹤的比較結(jié)果

從圖6可以看出,粒子濾波算法和改進(jìn)的Camshift算法對(duì)于背景中存在與目標(biāo)行人具有相似顏色衣服的行人,都能夠準(zhǔn)確地跟蹤多行人目標(biāo);由此可以看出粒子濾波算法與改進(jìn)的Camshift都具有較好的魯棒性。由表2可以看出,相對(duì)于粒子濾波算法,本文算法的實(shí)時(shí)性提高了30.23%。

4 結(jié)束語(yǔ)

本文針對(duì)復(fù)雜背景環(huán)境下視頻幀序列中多行人目標(biāo)跟蹤易出現(xiàn)目標(biāo)丟失的問(wèn)題,提出一種改進(jìn)的Camshift多行人目標(biāo)跟蹤算法。本方法通過(guò)融合目標(biāo)的顏色特征和HOG特征建立行人目標(biāo)的數(shù)學(xué)模型:相對(duì)于傳統(tǒng)的Camshift算法,在實(shí)時(shí)性幾乎相當(dāng)?shù)那闆r下,多行人目標(biāo)跟蹤的準(zhǔn)確率提升了5.3 %;相對(duì)于粒子濾波算法,本文算法能夠準(zhǔn)確跟蹤多行人目標(biāo)的情況下,算法的實(shí)時(shí)性提高了30.23%。實(shí)驗(yàn)結(jié)果表明,本文提出的改進(jìn)Camshift的多行人目標(biāo)跟蹤算法能夠在提升了魯棒性的同時(shí),準(zhǔn)確實(shí)時(shí)地跟蹤多個(gè)行人目標(biāo)。

目前該算法還需要手動(dòng)選定多個(gè)行人目標(biāo);加入檢測(cè)算法實(shí)現(xiàn)自動(dòng)選定行人目標(biāo)是下一步研究的重點(diǎn)。

[1] 劉錦濤, 高麗, 吳文海, 等. 垂直起降無(wú)人機(jī)基于圖像的目標(biāo)跟蹤控制[J]. 控制理論與應(yīng)用, 2017, 34(6):723-731.

[2] 燕必希, 朱立夫, 董明利, 等. 卡爾曼濾波單目相機(jī)運(yùn)動(dòng)目標(biāo)定位研究[J]. 儀器儀表學(xué)報(bào), 2018, 39(8): 220-229.

[3] 王耀南, 羅瓊?cè)A, 陳彥杰, 等. 旋翼飛行機(jī)器人多機(jī)視覺(jué)跟蹤定位系統(tǒng)及方法[J]. 儀器儀表學(xué)報(bào), 2018, 39(2): 1-10.

[4] 田丹, 張國(guó)山, 謝英紅. 具有融合罰約束的低秩結(jié)構(gòu)化稀疏表示目標(biāo)跟蹤算法[J/OL]. [EB/OL]. (2018-09-25)[2019-01-28].http://kns.cnki.net/kcms/detail/21.1124.TP.20180925.0709.001.html.

[5] 苑晶, 李陽(yáng), 董星亮, 等. 基于運(yùn)動(dòng)模式在線分類的移動(dòng)機(jī)器人目標(biāo)跟蹤[J]. 儀器儀表學(xué)報(bào), 2017, 38(3): 568-577.

[6] AIAZZI B, ALPARONEl L, BARONTI S, et al. Nonparametric change detection in multitemporal SAR images based on mean-shift clustering[J]. IEEE Transactions on Geoscience & Remote Sensing, 2013, 51(4): 2022-2031.

[7] UBEDA-MEDINA L, GARCíA-FERNáNDEZ á F, GRAJAL J. Adaptive auxiliary particle filter for track-before-detect with multiple targets[J]. IEEE Transactions on Aerospace & Electronic Systems, 2017, 53(5): 2317-2330.

[8] 陳龍, 郭寶龍, 孫偉. 基于FCM聚類的粒子濾波多目標(biāo)跟蹤算法[J]. 儀器儀表學(xué)報(bào), 2011, 32(11) : 2536-2542.

[9] 董春利, 董育寧, 劉杰. 基于粒子濾波和GVF-Snake的目標(biāo)跟蹤算法[J]. 儀器儀表報(bào), 2009, 30(4): 828-833.

[10] EXNER D, BRUNS E, KURZ D, et al. Fast and robust CAMShift tracking[C]//The Institute of Electrical and Electronic Engineers(IEEE). Proceedings of 2010 IEEE Computer Society Conference on Computer Vision and Pattern Recognition. San Francisco: IEEE, 2010: 916-920. DOI: 10. 1109/CVPRW. 2010. 5543787.

[11] 隋修武, 田松, 余保付, 等. 交通場(chǎng)景中的實(shí)時(shí)多目標(biāo)自動(dòng)跟蹤算法[J]. 電子技術(shù)應(yīng)用, 2015, 41(10): 139-142, 146.

[12] 王健, 張桂林. 復(fù)雜背景下運(yùn)動(dòng)目標(biāo)的實(shí)時(shí)跟蹤[J]. 計(jì)算機(jī)與數(shù)字工程, 2005, 33( 11): 18-21.

[13] 李娟, 邵春福, 楊勵(lì)雅, 等. 基于Kalman濾波的行人跟蹤方法研究[J]. 交通運(yùn)輸系統(tǒng)工程與信息, 2009, 9(6): 148-153.

[14] 胡敏, 陳紅波, 許良鳳, 等. 基于顏色和紋理特征的黃瓜病害識(shí)別算法[J]. 電子測(cè)量與儀器學(xué)報(bào), 2015, 29(7): 970-977.

[15] 金銘, 汪友生, 邊航. 一種多特征融合的圖像檢索新方法[J]. 電子測(cè)量技術(shù), 2016, 39(8): 85-89.

[16] 陳肖蒙, 王瑜, 肖洪兵. 基于可變局部邊緣模式的綠色植物物種識(shí)別[J]. 智能系統(tǒng)學(xué)報(bào), 2018, 13(4): 571-576.

[17] 蘇麗穎, 李小鵬, 么立雙. 一種改進(jìn)的SIFT特征提取新算法[J]. 華中科技大學(xué)學(xué)報(bào)(自然科學(xué)版), 2013, 41(增刊1): 396-398.

[18] 寧紀(jì)鋒, 趙耀博, 石武禎. 多通道Haar-like特征多示例學(xué)習(xí)目標(biāo)跟蹤[J]. 中國(guó)圖象圖形學(xué)報(bào), 2014, 19(7): 1038-1045.

[19] 孫煒, 薛敏, 孫天宇, 等. 基于支持向量機(jī)優(yōu)化的行人跟蹤學(xué)習(xí)檢測(cè)方法[J]. 湖南大學(xué)學(xué)報(bào)(自然科學(xué)版), 2016, 43(10): 102-109.

[20] 李永波, 李柏林, 熊鷹. 基于HOG特征的鐵路扣件狀態(tài)檢測(cè)[J]. 傳感器與微系統(tǒng), 2013, 32(10): 110-113.

[21] 曲巨寶. 利用自適應(yīng)組合模型實(shí)現(xiàn)車輛跟蹤[J]. 華東交通大學(xué)學(xué)報(bào), 2010, 27(4): 39-43.

[22] 公衍宇. OpenCV在人臉門禁系統(tǒng)的研究與應(yīng)用[D]. 天津: 河北工業(yè)大學(xué), 2012.

Multi-pedestrian target tracking method based on improved Camshift algorithm

CHENYi

(Sichuan University of Arts and Sciences, DaZhou, SiChuan 635000, China)

Aiming at the problem that it is susceptible to multi-pedestrian targets with similar clothing colors for the color-based target tracking method, which results in the error in tracking targets, the paper proposed a multi-pedestrian target tracking method with the improved Camshift algorithm: in order to overcome the shortcoming that the target is easily lost with single color feature as target model, the target model was established by integrating a certain weight coefficients with the color and HOG features of the target; and the models for multiple pedestrian targets were built for extending the single target tracking of traditional Camshift algorithm to multi-target tracking. Experimental result showed that the proposed method would be more robust, and the tracking accuracy could be improved by 5.3 % compared with traditional Camshift algorithm; meawhile, the real-time performance could be improved by 30.23 % compared with particle filter algorithm.

Camshift algorithm; color features; multi-target tracking; fusion coefficient

P228

A

2095-4999(2019)04-0030-07

陳藝.改進(jìn)Camshift算法的多行人目標(biāo)跟蹤方法[J].導(dǎo)航定位學(xué)報(bào),2019,7(4):30-36.(CHEN Yi.Multi-pedestrian target tracking method based on improved Camshift algorithm[J].Journal of Navigation and Positioning,2019,7(4): 30-36.)

10.16547/j.cnki.10-1096.20190406.

2019-03-17

四川省教育廳科研項(xiàng)目(17ZB0376)。

陳藝(1980—),女,四川平昌人,碩士,副教授,研究方向?yàn)榫W(wǎng)絡(luò)數(shù)據(jù)庫(kù)、計(jì)算機(jī)應(yīng)用技術(shù)。