混合階通道注意力網(wǎng)絡(luò)的單圖像超分辨率重建

姚 魯,宋慧慧,張開華

(1.江蘇省大數(shù)據(jù)分析技術(shù)重點實驗室(南京信息工程大學(xué)),南京 210044;2.南京信息工程大學(xué)大氣環(huán)境與裝備技術(shù)協(xié)同創(chuàng)新中心,南京 210044)

(*通信作者電子郵箱songhuihui@nuist.edu.cn)

0 引言

近年來,隨著深度學(xué)習(xí)的重大發(fā)展,圖像超分辨率重建領(lǐng)域得到廣泛關(guān)注。單幅圖像超分辨率(Single Image Super-Resolution,SISR)任務(wù)是個不適定的(ill-posed)逆問題,旨在從低分辨率(Low-Resolution,LR)圖像中恢復(fù)出高分辨率(High-Resolution,HR)圖像。目前主要算法是基于學(xué)習(xí)的將LR 圖像經(jīng)過非線性映射得到HR 圖像[1]。以下簡要回顧與本文相關(guān)的基于卷積神經(jīng)網(wǎng)絡(luò)的(Convolution Neural Network,CNN)超分辨率算法和通道注意力機制。

Dong 等[2]首先將CNN 引入圖像超分辨率重建領(lǐng)域,提出基于卷積神經(jīng)網(wǎng)絡(luò)的超分辨率(Super-Resolution using CNN,SRCNN)。殘差網(wǎng)絡(luò)[3]解決了網(wǎng)絡(luò)深度和模型退化之間的矛盾,使超分辨率網(wǎng)絡(luò)逐漸往更深更寬方向發(fā)展。Kim等[4]提出了使用非常深的卷積網(wǎng)絡(luò)構(gòu)建準(zhǔn)確的圖像超分辨率(accurate image Super-Resolution using Very Deep convolutional networks,VDSR)。此網(wǎng)絡(luò)深度達20層,采用殘差網(wǎng)絡(luò)和梯度裁剪解決梯度爆炸問題。Zhang 等[5]提出了非常深的殘差通道注意力超分辨率(image super-resolution using very deep Residual Channel Attention Network,RCAN)算法。此算法以殘差網(wǎng)絡(luò)為基礎(chǔ)構(gòu)建了深度達400層的網(wǎng)絡(luò)。

人類感知的關(guān)注通常指人類視覺系統(tǒng)能自適應(yīng)處理視覺信息關(guān)注于顯著區(qū)域[6]。近年來,學(xué)者已提出將多種注意力處理算法嵌入CNN 用于各種任務(wù)。Hu 等[7]提出壓縮和擴張網(wǎng)絡(luò)(Squeeze-and-Excitation Network,SENet)利用通道間相互關(guān)系提升分類性能;Zhang 等[5]提出全局平均池化(Global Average Pooling,GAP)構(gòu)建的一階通道注意力以自適應(yīng)縮放通道間特征;Dai等[8]提出采用二階通道注意力網(wǎng)絡(luò)的圖像超分辨率(Second-order Attention Network single image superresolution,SAN),采用二階通道注意力模塊解決之前超分辨率算法忽視對于CNN 內(nèi)部層特征相互關(guān)系的研究,主要利用二階統(tǒng)計特征構(gòu)成的全局協(xié)方差池化(Global Covariance Pooling,GCP)自適應(yīng)縮放通道間特征進行特征表達和特征相互性學(xué)習(xí)。

深度網(wǎng)絡(luò)在圖像超分辨率性能上取得重大提升,而現(xiàn)有SISR 算法對于通道間特征的研究算法只考慮一階通道信息(RCAN)或二階通道統(tǒng)計信息(SAN),并沒有將一、二階通道信息進行優(yōu)勢互補。此外,已有通道注意力算法采用升降維破壞了每個通道和其權(quán)重的直接對應(yīng)關(guān)系,不利于通道間特征相互性學(xué)習(xí),影響網(wǎng)絡(luò)性能的提高。

因此,本文提出一種混合階通道注意力網(wǎng)絡(luò)的單幅圖像超分辨率重建(Mixed-order Channel Attention Network for single image super-resolution reconstruction,MCAN)進行更強大的特征表達和相互性學(xué)習(xí)。本文的工作總結(jié)如下:

1)針對先前不同階通道注意力破壞權(quán)重預(yù)測與通道不對應(yīng)問題,本文首先改進先前一、二階通道注意力模型,提出有效一階通道注意力(Efficient First-order Channel Attention,EFCA)模型和有效二階通道注意力(Efficient Second-order Channel Attention,ESCA)模型,這樣能對應(yīng)預(yù)測通道權(quán)重,使得特征加權(quán)更合理,具體可見1.2.1節(jié)和1.2.2節(jié)。

2)針對之前一、二階通道注意力模型沒有綜合考慮將不同階通道注意力優(yōu)勢互補的問題,本文將改進后的一、二階模型融入殘差網(wǎng)絡(luò)構(gòu)成基本組件混合階殘差通道注意力組(Mixed-order Residual Attention Group,MRAG),具體可見1.3節(jié)。

在一系列測試數(shù)據(jù)集上結(jié)果表明,與SRCNN[2]、RCAN[5]、SAN[8]等相比,本文算法無論在客觀評價標(biāo)準(zhǔn)還是主觀視覺效果上結(jié)果都更好,具體可見2.2.2節(jié)。

1 本文算法MCAN

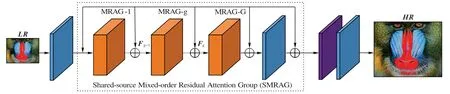

本文算法采用生成對抗網(wǎng)絡(luò),生成器如圖1~2 所示,包括4 個部分:1)淺層特征提取網(wǎng)絡(luò);2)共享資源的混合階殘差注意力網(wǎng)絡(luò)(Shared-resource Mixed-order Residual Attention Group,SMRAG);3)上采樣模塊;4)重建模塊。判別器結(jié)構(gòu)如圖3。

1.1 生成器

本文算法首先使用一個卷積從輸入的低分辨率圖像ILR提取淺層特征,可表示為:

其中:F0表示卷積后的淺層特征;HSF()表示卷積操作。再將淺層特征輸入SMRAG網(wǎng)絡(luò)以提取深層特征,增強網(wǎng)絡(luò)非線性表達能力,可表示為:

其中:FDF表示深層特征;HSMRAG()表示提取深度特征模塊SMRAG,由G個混合階殘差注意力組MRAG 組成。再將提取到的深層特征進行上采樣,可表示為:

其中:H↑()是上采樣操作;F↑是上采樣后特征。本文上采樣算法采用亞像素卷積[9]。最后上采樣后特征經(jīng)過一個卷積映射到放大4倍的重建后圖像,此過程可表示為:

其中:HR()表示重建模塊;ISR表示重建后圖像。

1.2 共享資源的混合階殘差注意力網(wǎng)絡(luò)SMRAG

如圖1 虛線部分即為所提出的共享資源的混合階殘差注意力網(wǎng)絡(luò)SMRAG,由G個混合階殘差通道注意力組MRAG(圖2(a))和一個最長范圍共享資源的跳躍連接(Shared-Source skip Connection,SSC)結(jié)構(gòu)組成。每個MRAG 包括M個有效一階殘差注意力模型(EFCA)、一個中等長度的跳躍連接結(jié)構(gòu)以及一個二階通道注意力模型(ESCA)。此二階模型使得網(wǎng)絡(luò)更關(guān)注于信息量大的特征,增強了網(wǎng)絡(luò)判別能力[8],提升了圖像恢復(fù)質(zhì)量。

簡單重復(fù)堆疊殘差網(wǎng)絡(luò)雖然能構(gòu)建非常深的網(wǎng)絡(luò),但由于梯度消失和爆炸問題導(dǎo)致訓(xùn)練困難和性能瓶頸,因此本文使用MRAG模塊作為基本單元。而重復(fù)堆疊MRAG網(wǎng)絡(luò)不能取得更好的性能,本文又引入最長范圍共享資源的跳躍連接結(jié)構(gòu)(SSC)。這樣不僅能促進深層網(wǎng)絡(luò)的訓(xùn)練,還能將LR 圖像信息逐層向后傳遞大量低頻信息,減少信息丟失。SMRAG網(wǎng)絡(luò)中的第g個MRAG可表示為:

對每個MRAG 模型,首先將改進后的一階模型EFCA 模型嵌入殘差塊,構(gòu)建改進后一階殘差注意力(Efficient Firstorder Residual Attention,EFRA)模塊,多個(M個)EFRA 級聯(lián)和最后的二階通道注意力模型(ESCA)構(gòu)成MRAG。最后以MRAG 為基本單元構(gòu)成SMARG 模型。SMRAG 模型利用改進后的一、二階通道模型EFCA 和ESCA 使得通道權(quán)重預(yù)測與每個通道直接對應(yīng),權(quán)重預(yù)測更準(zhǔn)確合理,網(wǎng)絡(luò)判別能力得以提高;同時混合使用不同階通道注意力以進行優(yōu)勢互補,這樣使得重建后圖像紋理細(xì)節(jié)得到更好的恢復(fù)。

1.2.1 有效一階通道注意力模型(EFCA)

如圖2(b),對于每個EFCA 模型,前一層輸出特征z首先經(jīng)過全局平均池化HGAP(),再經(jīng)大小為k的一維卷積WC,最后再將sigmoid 函數(shù)所產(chǎn)生的權(quán)重向量和此模塊輸入的每個特征通道做點乘。和RCAN 中的通道注意力所不同的是,這里的通道特征在經(jīng)過全局平均池化后,直接經(jīng)過參數(shù)為k的一維卷積[10],而不是原來的二維卷積升降維,這避免了權(quán)重向量與通道特征不直接對應(yīng)問題,使得通道注意力預(yù)測更準(zhǔn)確。權(quán)重可表示為:

其中:σ()是sigmoid函數(shù);WC是一維卷積。

圖1 生成器框架Fig.1 Framework of generator

圖2 生成器的子圖Fig.2 Submodules of generator

1.2.2 二階通道注意力模型(ESCA)

如圖2(d),與以上EFCA 相比,本文二階模型采用全局協(xié)方差池化HGCP()而非全局平均池化HGAP(),其余均相同。受Dai等[8]啟發(fā),本文采用全局協(xié)方差池化以增強網(wǎng)絡(luò)判別能力的學(xué)習(xí)。以下闡明此模型如何利用二階信息。

協(xié)方差歸一化:

對于H×W×C特征圖F=[f1,f2,…,fC],首先改變其維度,得到S=W×H,C維特征。則樣本協(xié)方差矩陣可表示為:

其中:I、1 分別是S×S的單位矩陣和數(shù)字1 的矩陣。之后再對協(xié)方差矩陣進行歸一化。由于協(xié)方差矩陣Σ是半正定矩陣,有如下特征值分解:

其中:U是正定矩陣;Λ=diag(λ1,λ2,…,λC)是對角陣。則協(xié)方差歸一化可轉(zhuǎn)化為特征值的冪運算,即

其中:α是正實數(shù),本文中α取1/2。則

全局協(xié)方差之后是核為k的快速一維卷積WC。之前的一階模型采用升降維操作,本文改為一維卷積實現(xiàn)。原本的升降維破壞了每個通道與其對應(yīng)權(quán)重之間的直接對應(yīng)關(guān)系,且利用這種方式的通道注意力也不高效。因此本文采用局部跨通道交互作用策略預(yù)測通道權(quán)重,即改為核為k一維卷積。這不僅讓通道注意力預(yù)測更直接,且是局部作用,計算也更高效。具體來說此二階模型對于每個通道考慮其相鄰的k個通道以捕捉局部跨通道的相互作用。k即局部跨通道的范圍,即有多少相鄰?fù)ǖ绤⑴c一個通道注意力預(yù)測,顯然k會影響模型效率。由于相互作用范圍與通道數(shù)有關(guān),本文設(shè)計核大小由自適應(yīng)通道函數(shù)φ()決定,即

其中:|y|odd是最接近y的奇數(shù)。這種改變避免升降維,使得通道注意力預(yù)測更高效合理

最后,將sigmoid()函數(shù)產(chǎn)生的權(quán)重向量和原始輸入特征做點乘。通過2.2.1 節(jié)消融實驗部分可以看出,改進后的直接對應(yīng)式權(quán)重預(yù)測方式比之前升降維方式對于感知效果提升確實有一定效果。

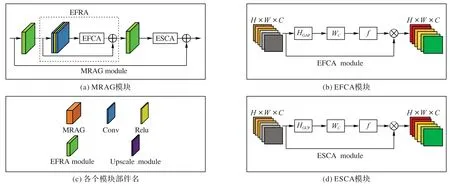

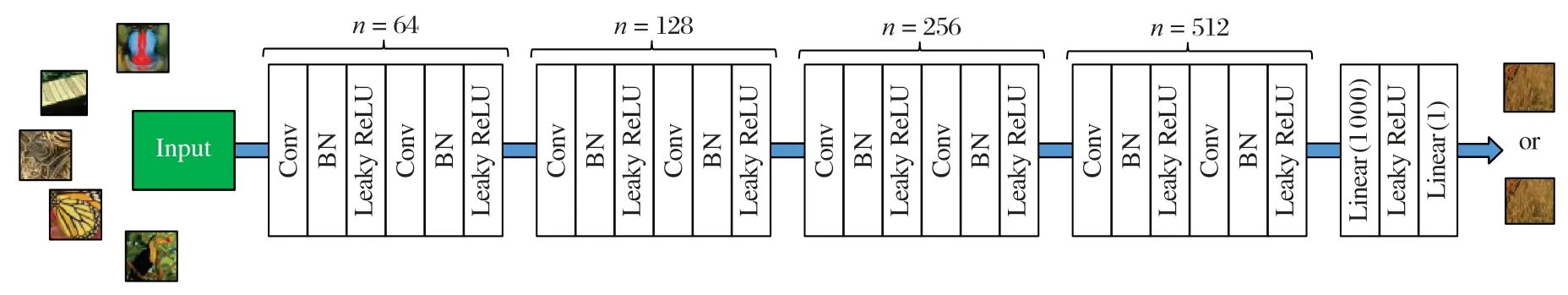

1.3 判別器網(wǎng)絡(luò)結(jié)構(gòu)

訓(xùn)練判別器以區(qū)分真實圖像GT(Ground Truth)和生成的超分辨率(Super-Resolution,SR)圖像。如圖3,首先,將GT或SR送入4 個基本模塊構(gòu)成的判別器。每個模塊包含兩組卷積、批歸一化和Leady ReLU 激活函數(shù)。這4 個模塊通道數(shù)逐級遞增,分別是64、128、256 和512。最后利用兩個全連接層構(gòu)成的二分類器判斷網(wǎng)絡(luò)輸入圖像的真假。

圖3 判別器框架Fig.3 Framework of discriminator

1.4 損失函數(shù)

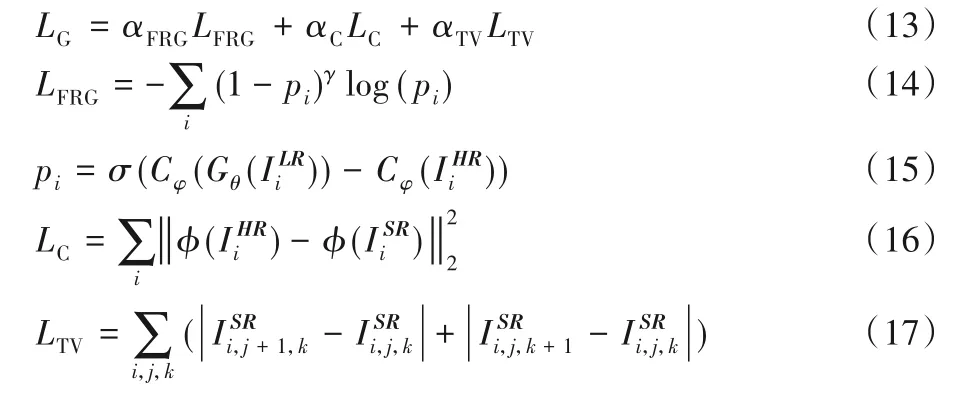

按照Vu等[11]設(shè)計,生成器和判別器分別以各自目標(biāo)函數(shù)LG、LD進行迭代更新訓(xùn)練。

其中:LFRG是結(jié)合焦點損失(focal loss)的相對生成對抗網(wǎng)絡(luò)(Generative Adversarial Network,GAN)損失;LC是內(nèi)容損失;LTV是總方差損失;αFRG、αC、αTV是每個子函數(shù)對應(yīng)權(quán)重。

2 實驗與分析

2.1 數(shù)據(jù)集

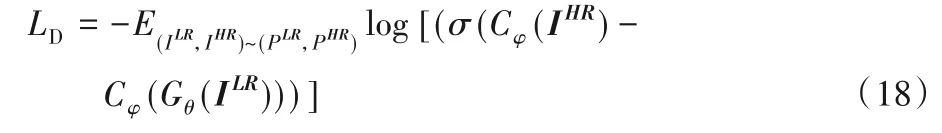

本文算法在DIV2K[12]數(shù)據(jù)集上訓(xùn)練。此數(shù)據(jù)集包括800個訓(xùn)練圖像、100 個驗證圖像和100 個測試圖像。測試采用6個基準(zhǔn)測試集Set5、Set14、BSD100(Berkeley Segmentation Dataset)、Urban100、DIV2K 驗證集(DIVerse 2K resolution image dataset)和PIRM(Perceptual Image Restoration and Manipulation)自驗證集。定量評估模型采用Blau 等[13]提出的感知質(zhì)量評估標(biāo)準(zhǔn)。

其中:NRQM是非參考質(zhì)量評估方法(Non-Reference Quality assessment Method)[14]的評估指標(biāo);NIQE是自然圖像質(zhì)量評估器(Natural Image Quality Evaluator)[15]的評估指標(biāo)。

1)數(shù)據(jù)集和預(yù)處理。

實驗首先對真實圖像雙三次下采樣4 倍,再減去DIV2K的RGB 均值預(yù)處理所有圖像。最后對訓(xùn)練集進行隨機旋轉(zhuǎn)90°、180°、270°和水平翻轉(zhuǎn)的數(shù)據(jù)增強。本模型也用于放大2倍、3 倍情形,需調(diào)整卷積核個數(shù),本文只針對更具有挑戰(zhàn)性的4倍情景。

2)訓(xùn)練設(shè)置。

實驗時,為提高計算效率,每個小批中將16 個低、高分辨圖像分別裁剪為48× 48和196 × 196的小塊。為控制變量以便和相對生成對抗網(wǎng)絡(luò)的感知增強圖像超分辨(Perception-Enhanced image Super-Resolution via relativistic generative adversarial networks,PESR)算法[11]公平比較,設(shè)置MRAG 數(shù)量G=4,M=8。EFCA、ESCA 模型之外卷積和通道數(shù)設(shè)置為3× 3和256。

2.2 實驗設(shè)置

本文算法采用Adam 優(yōu)化器,設(shè)置動量β1=0.9,β2=0.999。批量大小為16。L1 損失初始化生成器迭代2 × 105次,再用全損失函數(shù)式(13)、(18)交替優(yōu)化生成器和判別器2 × 105次。損失函數(shù)權(quán)重參數(shù)設(shè)置為αFRG=1,αC=50,αTV=10-6。

預(yù)訓(xùn)練學(xué)習(xí)率初始化為10-4;GAN 訓(xùn)練學(xué)習(xí)率初始化為5×10-5,每1.2×105次批更新后減半,采用Pytorch 框架,使用一塊Nvidia 2080 Ti訓(xùn)練30 h左右,少于RCAN和SAN所需約7 d訓(xùn)練時間。

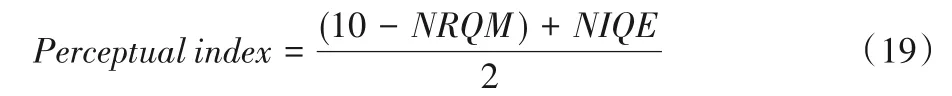

2.2.1 消融實驗

為探究將通道注意力升降維改為一維卷積以及混合不同階通道注意力對MCAN 影響,以下采用升降維一階通道注意力模型(RCAN)、二階模型(SAN)與本文快速一維卷積實現(xiàn)的一階模型(EFCA)、二階模型(ESCA)分別在BSD100 數(shù)據(jù)集上做對比實驗。為保持參數(shù)一致,設(shè)置G=4,M=8,結(jié)果如表1所示,評價指標(biāo)為感知指數(shù)(Perceptual Index,PI),PI 值越小越好。①和②是訓(xùn)練時分別采用升降維的一、二階模型,③和④是分別采用改進后一、二階模型EFCA、ESCA。①和③,②和④對比表明,將一階或二階通道注意力由升降維改為一維卷積,通道預(yù)測權(quán)重和每個通道特征一一對應(yīng),注意力預(yù)測更準(zhǔn)確;⑤和⑥對比表明,改進后一階(EFCA)二階(ESCA)通道模型融入殘差塊混合使用相比單獨采用一階或二階模型性能更好。這表明采用改進的通道注意力模型不僅權(quán)重預(yù)測更準(zhǔn)確合理,更關(guān)注于信息量大的特征,還提高了網(wǎng)絡(luò)判別性學(xué)習(xí)能力,故比其他算法結(jié)果更優(yōu)。

表1 BSD100數(shù)據(jù)集上不同通道注意力模型的對比實驗Tab.1 Comparative experiments of different channel attention models on BSD100 dataset

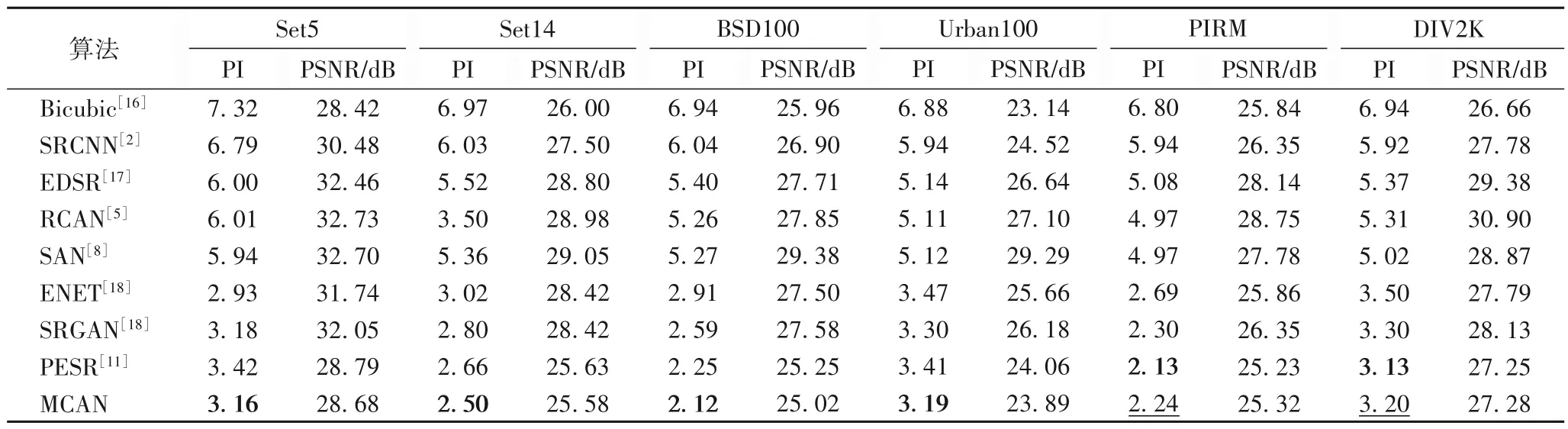

2.2.2 和其他算法相比

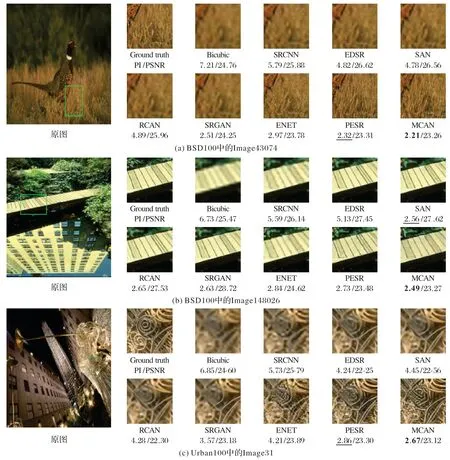

本文算法MCAN 與現(xiàn)有超分辨率算法Bicucic[16]、SRCNN[2]、增強深度殘差網(wǎng)絡(luò)的單幅圖像超分辨(Enhanced Deep residual networks for single image Super-Resolution,EDSR)[17]、RCAN[5]、SAN[8]、生成對抗網(wǎng)絡(luò)的單幅逼真圖像超分辨率(photo-realistic single image Super-Resolution using a GAN,SRGAN)[18]算法、自動紋理合成實現(xiàn)的單幅圖像超分辨率(Enhancenet: single image super-resolution through automated texture synthesis,ENET)[19]以及PESR[11]相比,利用峰值信噪比(Peak Signal-to-Noise Ratio,PSNR)和感知指數(shù)PI對放大4 倍重建結(jié)果進行評估,結(jié)果如表2 和圖4。從表2 可以看出,MCAN 在Set5、Set14 等數(shù)據(jù)集上PI 均超過其他超分辨率算法;且從圖4(j)可以看出,相較于圖4(i)等其他算法,本文算法恢復(fù)出的圖像總體效果如雜草和木橋紋理更清晰直觀。這表明直接進行通道注意力預(yù)測以及二階統(tǒng)計信息的利用能增強網(wǎng)絡(luò)判別性能力的學(xué)習(xí),提升網(wǎng)絡(luò)性能。

表2 放大4倍時不同算法在基準(zhǔn)測試集上的比較Tab.2 Comparison of different methods on benchmark test sets at 4x magnification

圖4 不同算法定性比較(PI/PSNR)Fig.4 Qualitative comparison of different methods(PI/PSNR)

3 結(jié)語

本文提出混合階通道注意力網(wǎng)絡(luò)的單幅圖像超分辨率算法以增強網(wǎng)絡(luò)判別能力恢復(fù)出高分辨率圖像。首先網(wǎng)絡(luò)去除先前一、二階通道注意力模型升降維改為一維卷積,使得通道注意力預(yù)測更直接準(zhǔn)確且簡單;再結(jié)合一、二階通道注意力特別是二階統(tǒng)計信息,以增強網(wǎng)絡(luò)判別性學(xué)習(xí)能力使得重建后圖像具有更多紋理細(xì)節(jié)。與其他算法相比,本文算法不論是客觀評價標(biāo)準(zhǔn)還是主觀感覺都有所提高,重建出圖像具有更高的質(zhì)量且能顯示更精細(xì)的紋理。下一步打算添加一些符合原圖的先驗信息,使得恢復(fù)出的圖像更接近真實圖像。