結(jié)合卷積平滑耳蝸譜和深度網(wǎng)絡(luò)的語音增強技術(shù)

柏梁澤,高 勇

(四川大學 電子信息學院,四川 成都 610065)

0 引言

語音增強可以從帶噪語音中分離出語音,它有著廣泛的應(yīng)用,如穩(wěn)健的自動語音識別(Automatic Speech Recognition,ASR)[1]、助聽器的設(shè)計和移動通信等。其中,單通道語音增強與多通道語音增強相比更有應(yīng)用市場,因為不需要較多的空間配置資源[2]。語音增強在傳統(tǒng)的數(shù)字信號處理領(lǐng)域已經(jīng)得到廣泛的研究,其中譜減法[3]是一種經(jīng)典的降噪方法,主要是通過從帶噪語音譜中減去估計的噪聲,但是容易引來音樂噪聲。隨后,維納濾波和均方誤差估計方法[4]在語音增強領(lǐng)域也得到了廣泛應(yīng)用,這類方法對于噪聲和語音之間的統(tǒng)計特性假設(shè)至關(guān)重要,因此難以滿足非平穩(wěn)噪聲的真實環(huán)境。

與以往的數(shù)字信號處理方法相比,基于模型的方法使用預(yù)先混合信號建立關(guān)于語音和噪聲的模型已經(jīng)取得顯著的成果。例如文獻[5]中的技術(shù)通過學習先驗知識在不同源之間建立了概率干擾模型,在低信噪比條件下可以顯著提高性能。類似的非負矩陣分解語音增強利用不同的信號基,從混合信號中分離出噪聲和語音信號,從而達到語音增強。但是,這類方法不能很好地推廣到?jīng)]有訓練過的噪聲條件下,此外需要復(fù)雜的計算,使得很難在實際環(huán)境中得到應(yīng)用。

近年來,有監(jiān)督的語音增強受到較多關(guān)注,最簡單的形式是通過向訓練的分類器——通常是深度神經(jīng)網(wǎng)絡(luò)(Deep Neural Network,DNN)輸入混合語音的特征來估計混合語音的理想時頻掩蔽從而達到語音增強的效果。理想時頻掩蔽表示每個時頻單元是否、或在多大程度上是目標語音主導(dǎo)。其中常用掩蔽碼有基于二元決策的二元掩蔽(IBM)[6]和基于比率決策的比率掩蔽(IRM)[7]。與傳統(tǒng)的語音增強不同,有監(jiān)督分離并沒有對潛在的語音或噪聲信號做出明確的統(tǒng)計假設(shè),而是從訓練集中學習數(shù)據(jù)分布,并且基于DNN的IBM和IRM估計器已經(jīng)被證明能夠提高增強后語音的可懂度[8]。

有監(jiān)督的語音增強的2個關(guān)鍵組成部分是從帶噪語音中提取的聲學特征和用于監(jiān)督學習的分類器。本文在多分辨率耳蝸譜[9]的基礎(chǔ)上,引入聲學特征卷積平滑耳蝸譜(Convolution Smoothing Cochleagram,CSCG),該特征將3個不同平滑度的耳蝸譜結(jié)合起來,充分提取出語音的局部和前后信息。選取一系列已經(jīng)在語音增強方面被證明有效果的特征進行對比,例如,對數(shù)能量譜(LPS)、梅爾倒譜系數(shù)(MFCC)、冪歸一化倒譜系數(shù)(PNCC)和聽覺濾波器頻率倒譜系數(shù)(GFCC)。實驗表明,CSCG特征參數(shù)取得了較好的效果。為了提高分類器的學習能力,采用深度雙向長短時記憶網(wǎng)絡(luò)(Deep Bidirectional Long Term Short Memory Networks,DBLSTM)進行分類。DNN只能從輸入到輸出一個方向進行學習,然而DBLSTM可充分利用上下文信息進行學習并且對分類任務(wù)有較大的適應(yīng)能力[10],能有效提高分類器的準確性。最后,為了進一步提高語音增強效果,研究了利用差分平均濾波作為一種后處理技術(shù)來增強特征的魯棒性。

1 基于有監(jiān)督語音增強系統(tǒng)

語音增強可以解釋為將帶噪信號映射到可懂度和清晰度有提高的目標信號的過程,其中,基于有監(jiān)督的語音增強,通過從帶噪語音中提取聲學特征,并將其與期望目標值一起輸入到分類器中進行訓練,從數(shù)據(jù)中顯式學習映射。最后,通過將估計的輸出和混合語音送入合成器中,產(chǎn)生增強后的語音。系統(tǒng)基本結(jié)構(gòu)分為特征提取、時頻估計和合成語音三部分。

1.1 特征的選取

(1) 對數(shù)能量譜

計算對數(shù)能量譜,首先將語音信號進行分幀,其中采用幀長為32 ms、幀移為16 ms、相鄰幀的重疊率50%以有效保證恢復(fù)的信號比較平滑。其次,對數(shù)能量譜是對離散傅里葉變換(DFT)后的各個系數(shù)取模的平方后取對數(shù),取對數(shù)可以模擬人耳對聲強的非線性感知。因為對數(shù)能量譜上的信息比較完整,因此將以對數(shù)能量譜為基礎(chǔ),結(jié)合其他特征進行語音增強。

(2)梅爾倒譜系數(shù)

計算梅爾倒譜系數(shù),首先將輸入語音信號進行分幀處理,并使用DFT導(dǎo)出功率譜,然后將功率譜轉(zhuǎn)換成Mel尺度。最后,利用對數(shù)壓縮和離散余弦變換(DCT)計算MFCC。

(3)聽覺濾波器頻率倒譜系數(shù)

計算聽覺濾波器頻率倒譜系數(shù),首先將輸入信號通過64通道的Gammatone濾波器輸出子帶信號,進行分幀處理,然后使用3次根式壓縮每個子帶信號的能量,最后采用DCT形成GFCC。

(4)冪歸一化倒譜系數(shù)

冪歸一化倒譜系數(shù)是一種語音識別中新的特征,它利用平滑幀間信號能量技術(shù)處理來減少噪聲破壞,并且采用冪率壓縮取代了傳統(tǒng)的對數(shù)壓縮。首先用Gammatone頻率積分法對輸入信號的功率譜進行積分,然后再進行非對稱濾波和時間掩蔽除去背景噪聲,最后利用冪律非線性和DCT得到PNCC。

(5)聽覺濾波器系數(shù)

計算聽覺濾波器系數(shù),只需要在計算GFCC的過程中省略掉DCT就可以得到GF。

1.2 訓練目標和合成

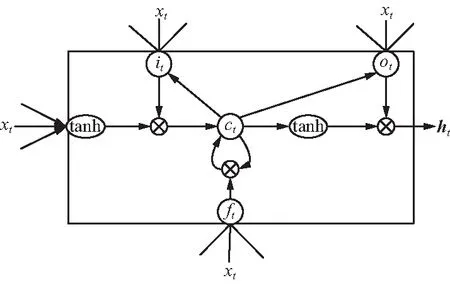

(1)理想IBM

理想IBM是計算聽覺場景分析(CASA)常用的特征。IBM是一個由預(yù)混信號構(gòu)成的時頻掩蔽。對于每個時頻單元,如果局部SNR大于局部準則(表示為LC),則將對應(yīng)的掩蔽值設(shè)置為1,否則設(shè)置為0。IBM被定義為:

(1)

式中,SNR(t,f)為時間t和頻率f的局部信噪比。

(2)理想IRM

理想IRM定義如下:

(2)

式中,S2(t,f)和N2(t,f)以時頻單元的形式,分別表示語音和噪聲的能量;β為調(diào)整掩蔽碼的參數(shù)。可以看出,IRM很接近于假設(shè)語音和噪聲不相關(guān)的維納濾波器。實驗研究表明,當β值為0.5時,可以得到好的語音增強效果,此時的IRM相似于能量譜最優(yōu)估計的均方根維納濾波器。

選取理想IRM作為訓練目標,文獻[11]表明,IRM在提高語音的質(zhì)量和清晰度上比理想IBM獲得效果更好。

通過將估計出的理想IRM與帶噪語音的幅度相乘,得到增強后的語音幅度譜,并利用帶噪語音的相位,再通過重疊相加法,生成增強后的語音。

2 語音特征

在耳蝸譜的基礎(chǔ)上,引入特征CSCG,包含多種能量分布的信號的時頻單元。通過使用2維卷積產(chǎn)生3個不同平滑度的耳蝸譜,不同平滑度的耳蝸譜在不同尺度下捕捉語音的信息。

2.1 CSCG的組成

CSCG主要是由語音增強領(lǐng)域中廣泛使用的耳蝸譜來構(gòu)成,為了計算耳蝸譜,首先將輸入語音信號送入Gammatone濾波器組,其中特定Gammatone濾波器組的脈沖響應(yīng)為:

gfc(t)=tN-1exp[-2πtb(fc)]cos(2πfct)u(t),

(3)

式中,fc為中心頻率;N為濾波器的階數(shù);u(t)為階躍函數(shù)。函數(shù)b(fc)通過fc來決定帶寬。為了模擬人耳的聽覺系統(tǒng),中心頻率fc在等效矩形帶寬(ERB)度量上均勻分布。b(fc)和fc的函數(shù)關(guān)系如下:

b(fc)=1.019×ERB(fc)=

1.019×24.7×(4.37×fc/1 000+1),

(4)

可以看出,b(fc)隨著fc的增加而增加,因此低頻具有高的分辨率,高頻具有較低的分辨率。得到Gammatone濾波器組的響應(yīng)信號后,在每一通道進行分幀,其中幀長為32 ms、幀移為16 ms。然后,在每一通道計算每一幀的能量得到耳蝸譜。耳蝸譜中的時頻單元僅包含局部信息,估計的目標掩蔽效果不佳。為了彌補這一缺點,CSCG采用二維卷積對耳蝸譜進行處理,可更好地提供每個時頻單元相鄰的能量分布信息。計算CSCG基本步驟如下:

① 在給定的輸入語音信號基礎(chǔ)上,計算第一個64通道的耳蝸譜CG1,然后對每一個時頻單元進行非線性的對數(shù)操作,提高低頻的能量信息。

② 在給定耳蝸CG1的基礎(chǔ)上,以給定時頻單元為中心,用一個長度為11通道、寬度為11幀的窗,對周圍的時頻單元進行二維卷積操作,取平均賦值給該時頻單元。如果窗口超出耳蝸譜大小,采用零值進行填充,通過以上操作獲得耳蝸譜CG2。

③ 產(chǎn)生耳蝸譜CG3和產(chǎn)生耳蝸譜CG2一樣,需將窗口大小調(diào)整為23通道、23幀來改變平滑度。

④ 最后,將CG1、CG2、CG3拼接起來形成64×4維的CSCG。

2.2 CSCG的分析

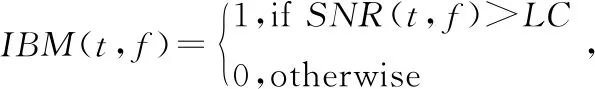

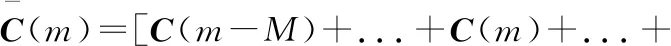

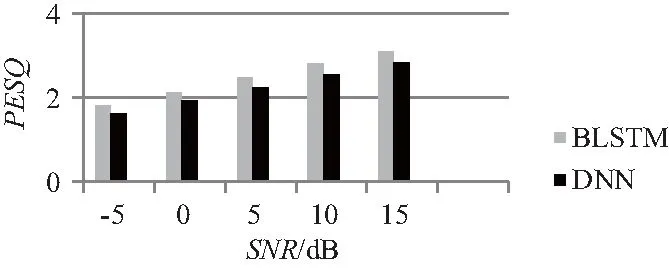

在CSCG特征中,可以看出CG1主要包含了自身時頻單元所具有的局部語音信息,而CG2和CG3通過不同平滑度的卷積操作,可以給時頻單元提供不同程度的相鄰時頻單元的信息。CSCG的構(gòu)成方法,主要是通過固定耳蝸譜CG1,逐步拼接不同平滑度耳蝸譜CG2和CG3,然后觀察實驗結(jié)果,到實驗效果不再上升為止。在5 dB多種噪聲下增強后語音的客觀語音質(zhì)量評估(PESQ)如圖1所示。當在CG1、CG2和CG3的情況下繼續(xù)拼接平滑度更高的耳蝸譜CG4時,PESQ有所下降,因此拼接不宜過多。

圖1 不同平滑度耳蝸譜增強語音效果Fig.1 Speech enhancement effect of cochleagramwith different smoothness

CSCG特征的可視化圖如圖2所示,右邊是純凈信號的耳蝸譜特征,左邊是信噪比5 dB、噪聲為Babble的帶噪語音耳蝸譜特征。可以看出,CG1是正常的耳蝸譜,CG2、CG3是不同平滑度的耳蝸譜。CSCG如果判斷該時頻單元是語音主導(dǎo),那么它相鄰的時頻單元也有很大可能是語音主導(dǎo),即語音主導(dǎo)的時頻單元很少單獨出現(xiàn),從而有利于分類器對目標掩蔽的估計。

圖2 CSCG特征圖Fig.2 CSCG feature map

3 分類器DBLSTM網(wǎng)絡(luò)

引入DBLSTM網(wǎng)絡(luò)做分類器進行語音增強,DNN只能學習當前幀的語音信息,不能利用語音上下文信息所具有的關(guān)聯(lián)性,因此采用DBLSTM網(wǎng)絡(luò)能取得更好的效果。

循環(huán)神經(jīng)網(wǎng)絡(luò)(Recurrent Neural Networks,RNN)在處理序列數(shù)據(jù)時,能得到很好的效果。在給定輸入序列x=(x1,x2,...,xT)的條件下,RNN在時間t為1~T計算隱藏序列h=(h1,h2,...,hT)和輸出序列y=(y1,y2,...,y2)。顯式連接相鄰序列中的多個輸入向量,以提高網(wǎng)絡(luò)學習上下文的能力。

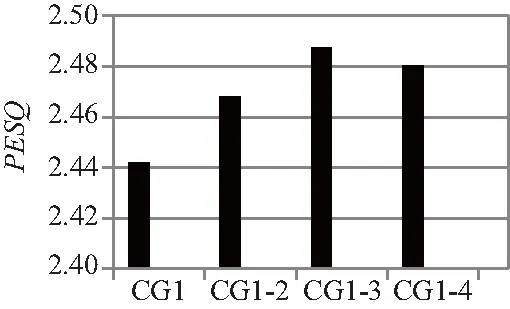

傳統(tǒng)的RNN的缺點就是只能利用以前的語音信息,語音信息的前后具有較強的相關(guān)性,所以有必要采用雙向循環(huán)神經(jīng)網(wǎng)絡(luò)(BRNN)來進行增強。BRNN通過使用2個單獨的隱藏層在2個方向上處理數(shù)據(jù),然后將其轉(zhuǎn)發(fā)到同一輸出層來實現(xiàn),結(jié)構(gòu)如圖3所示。

圖3 雙向循環(huán)神經(jīng)網(wǎng)絡(luò)Fig.3 Bidirectional recurrent neural network

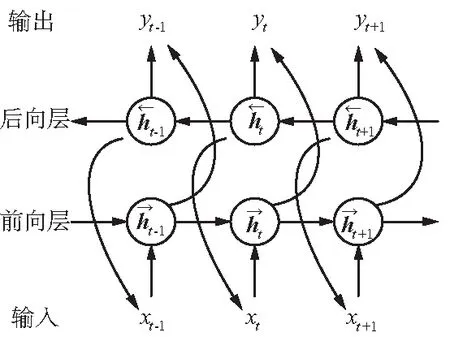

但是,在進行后向傳播中很容易出現(xiàn)“梯度消失和爆炸”的問題,很難讓RNN得到良好的訓練結(jié)果,LSTM很好地緩解了以上問題,通過引入存儲單元和一系列門來動態(tài)地控制信息流。單個LSTM存儲單元如圖4所示。

圖4 長短時記憶細胞Fig.4 Long and short term memory cells

LSTM的實現(xiàn)公式:

it=σ(Wxixt+Whiht-1+bi),

(5)

ft=σ(Wxfxt+Whfht-1+bf),

(6)

ct=ft?ct-1+it?tanh(Wxcxt+Whcht-1+bc),

(7)

ot=σ(Wxoxt+Whoht-1+Wcoct+bo),

(8)

ht=ot?tanh(ct),

(9)

式中,t為幀索引;σ為Sigmod激活函數(shù);i,f,o,c分別為輸入門、遺忘門、輸出門和細胞激活向量,它們的大小都和隱藏向量ht相同;?表示元素相乘;W,b分別表示從序列向量到各個門的權(quán)重矩陣(例如Wxi表示xt到輸入門i)和偏移向量。

(10)

(11)

(12)

使用深層結(jié)構(gòu),能夠獲得更深入的信息,可以通過將多個RNN隱藏層堆疊起來形成深度循環(huán)網(wǎng)絡(luò)D-RNNs,其結(jié)構(gòu)如圖5所示。

圖5 深度循環(huán)神經(jīng)網(wǎng)絡(luò)Fig.5 Deep recurrent neural network

本文將在后面討論使用多少隱藏層取得較好效果。假設(shè)D-RNNs中的所有N層都使用相同的隱藏層函數(shù),則隱藏序列hn從n=1到N和t=1到T迭代計算如下:

(13)

式中,H()為隱藏層激活函數(shù);其中W,b分別表示權(quán)重矩陣(例如Whn-1hn代表第n-1~n層隱藏層)和偏移向量,定義h0=x,網(wǎng)絡(luò)的輸出yt如下:

yt=WhNyhNt+by。

(14)

圖6 深度雙向長短時記憶網(wǎng)絡(luò)Fig.6 Deep bidirectional long short term memory network

通過DBLSTM網(wǎng)絡(luò),既可以避免“梯度爆炸和消失”帶來的問題,又可以從輸入和輸出2個方向同時取得語音的背景信息,可以提高語音增強中語音的質(zhì)量和可懂度。

4 實驗結(jié)果和分析

4.1 實驗準備和評估指標

實驗主要分為訓練和測試2個階段,其中訓練階段采用的純凈語音來自TMIT數(shù)據(jù)庫[12],使用的噪聲語音是來自O(shè)SU Perception and Neurodynamic Laboratory[13]采集的100種環(huán)境噪聲,多種噪聲的選取可以有效地提高模型在面對沒有訓練過的噪聲時的泛化能力。將4 620條TIMIT庫語音和各種噪聲進行混合,產(chǎn)生多種信噪比的帶噪語音,構(gòu)成了10 h訓練集。然后提取帶噪語音的聲學特征:LPS、MFCC、GFCC、PNCC、CSCG。最后以LPS為基礎(chǔ),因為它保留了語音比較完整的信息,分別單獨結(jié)合其他幾種特征送入分類器進行訓練,目標時頻單元選取的是效果良好的IRM。

測試階段,純凈語音是來自TMIT語音庫的192條語音,測試的噪聲來自Noisex92噪聲庫包含F(xiàn)actory、Buccaneer、Babble、Desroty、Hfchannel、Destroyerops等非平穩(wěn)噪聲和Pink、White等平穩(wěn)噪聲。提取出帶噪語音的相應(yīng)聲學特征后送入網(wǎng)絡(luò)得到估計出的時頻單元,然后利用帶噪語音的幅度和相位,結(jié)合估計的時頻單元產(chǎn)生增強后的語音。

為了評價各種方法下的語音增強性能,將采用多種評價標準對增強后的語音進行評估,其中包括PESQ[14]來評估增強語音的質(zhì)量、STOI[15]來評價語音的可懂度、分段信噪比segSNR來評價增強語音的信噪比。

4.2 差分平均濾波(DAF)技術(shù)及其效果

在語音信號處理中,差分和二階差分被廣泛用于捕捉短暫的動態(tài)信息,比如在語音識別領(lǐng)域,級聯(lián)MFCC參數(shù)的差分和二階差分可以有效提高識別率。差分濾波技術(shù)計算公式為:

C(m+M)]/(2M+1),

(15)

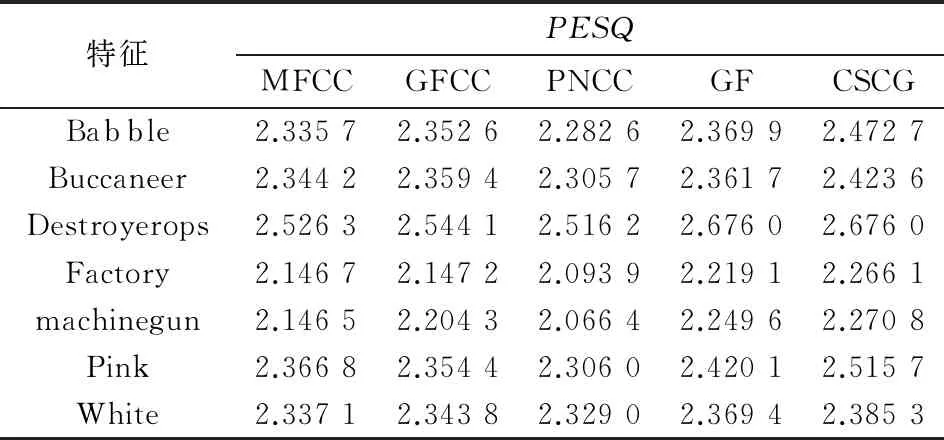

圖7 5 dB情況下差分平均濾波PESQFig.7 Differential average filtering PESQ at 5 dB

圖8 5 dB情況下差分平均濾波STOI效果Fig.8 Differential average filtering STOI at 5 dB

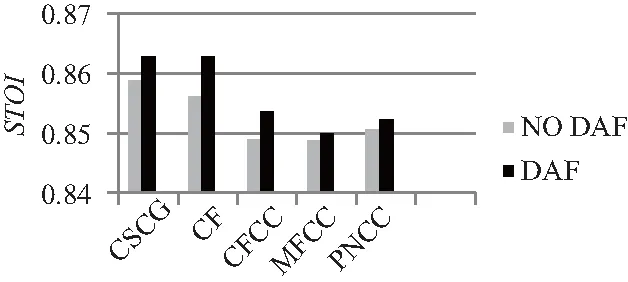

4.3 特征參數(shù)效果對比

為了對比各特征參數(shù)對語音增強效果的影響,先采用4.2節(jié)所使用的DAF,然后送入統(tǒng)一的分類器DNN,得到增強語音,然后分別測試在不同噪聲下,各種信噪比條件下的平均PESQ和平均segSNR,如表1和表2所示。可以看出,GF、GFCC、CSCG采用Gammatone濾波器的效果明顯比PNCC和MFCC好。其次,由于MFCC、GFCC、PNCC采用了離散余弦變換壓縮了語音信息,導(dǎo)致增強效果不好。廣泛使用在語音識別中的MFCC參數(shù)對比PNCC參數(shù)也有效果上的提升。本文提出的CSCG通過不同的平滑程度的耳蝸譜,可獲得多個層次語音信息,從而不管是PESQ,還是segSNR都比其他特征效果好。

表1 各聲學特征在不同噪聲下的PESQTab.1 PESQ of speech features under different noises

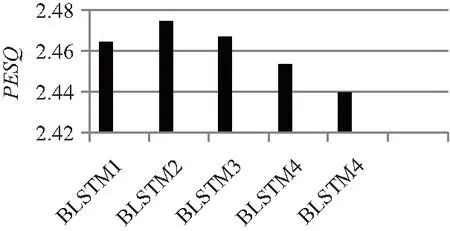

4.4 雙向長短時記憶網(wǎng)絡(luò)深度與效果

首先探索網(wǎng)絡(luò)深度對增強性能的影響,分別選取各種數(shù)量的隱藏層數(shù),如圖9所示,比較各種噪聲類型上的平均PESQ,BLSTML中的L代表了雙向長短時網(wǎng)絡(luò)(BLSTM)的層數(shù)。網(wǎng)絡(luò)結(jié)構(gòu)參數(shù)是L層BLSTM作為隱藏層,每層包含1 024個神經(jīng)元,激活函數(shù)選取tanh。最后一層采用全連接層,作為輸出層,包含257個神經(jīng)元,激活函數(shù)選取Sigmod。其中可以看出2層BLSTM取得效果最好,隨著層數(shù)的增加,語音的質(zhì)量效果反而下降,說明層數(shù)的增加導(dǎo)致語音信息的丟失。

圖9 5 dB噪聲下網(wǎng)絡(luò)層數(shù)的PESQFig.9 PESQ of network layers under 5 dB noise

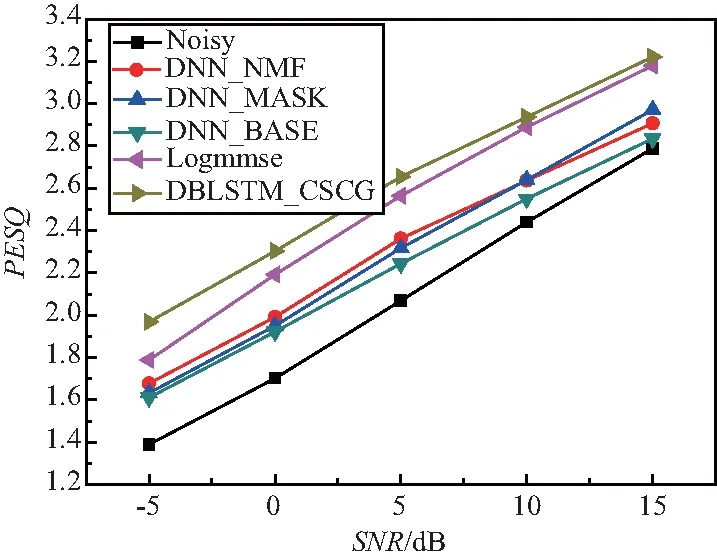

接下來,選取2層BLSTM作為本文的基礎(chǔ)網(wǎng)絡(luò),保持輸入的聲學特征一樣,和DNN進行實驗對比,如圖10所示,其中DNN網(wǎng)絡(luò)結(jié)構(gòu)參數(shù)是4層全連接層,前3層包含1 024個神經(jīng)元,激活函數(shù)是Relu,最后一層包含257個神經(jīng)元,激活函數(shù)是Sigmod。可以看出,本文使用的DBLSTM網(wǎng)絡(luò)結(jié)構(gòu),充分使用語音的上下文信息,不管是何種信噪比情況下,都獲得了比DNN獲得更好的語音效果。

圖10 DNN和BLSTM分類器PESQFig.10 PESQ of DNN and BLSTM classifiers

4.5 方法對比

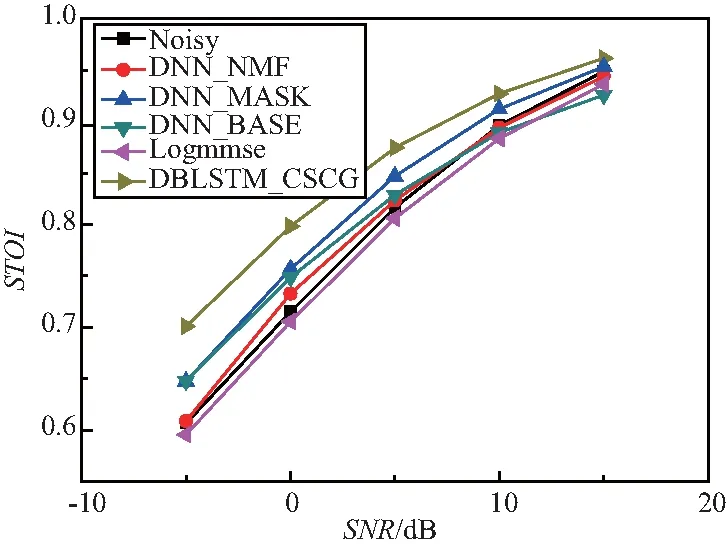

采用PESQ、segSNR、STOI三種客觀評價指標對各類方法效果進行評估。其中對比方法有時頻掩蔽估計DNN_MASK[16]、回歸模型語音增強DNN_BASE[17]、深度神經(jīng)網(wǎng)絡(luò)的非負矩陣分解DNN_NMF[18]、傳統(tǒng)語音增強算法Logmmse[4]和本文提出的DBLSTM_CSCG,用于實驗測試的噪聲都是未經(jīng)訓練過的,可以充分說明模型的泛化能力。各信噪比下、各種噪聲條件下包括平穩(wěn)和非平穩(wěn)噪聲,不同方法語音增強的平均效果如圖11~圖13所示。

圖11 各種方法的PESQ對比Fig.11 PESQ comparison of various methods

圖12 不同方法下的segSNRFig.12 SegSNR comparison of various methods

圖13 不同方法下的STOIFig.13 STOI comparison of various methods

可以看出,本文提出的方法DBLSTM_CSCG不管是在分段信噪比segSNR、語音的質(zhì)量清晰度PESQ和語音的可懂性STOI都比其他幾種方法取得更好的效果,并且隨著信噪比的降低效果明顯更好,因此更適用于噪聲惡劣的環(huán)境。盡管傳統(tǒng)方法Logmmse在PESQ和segSNR都比其他幾種方法要好,但是短時可懂性STOI效果明顯不好,破壞了語音的完整信息。可以看出,DNN_NMF、DNN_BASE、DNN_ MASK這3種方法對各評價指標差別不大,提升性能較小,并且從圖12可以看出,DNN_BASE在高信噪比下,分段信噪比反而降低,充分說明了DBLSTM給語音增強效果帶來的益處。

5 結(jié)論

本文主要從有監(jiān)督的語音增強系統(tǒng)的聲學特征和網(wǎng)絡(luò)結(jié)構(gòu)進行改進,引入了CSCG,有效利用語音的多個維度的信息,并且在此基礎(chǔ)上,將原有的DNN作分類器,改成DBLSTM網(wǎng)絡(luò),充分利用語音的前后信息的相關(guān)性,提高了網(wǎng)絡(luò)的學習能力。通過多組對比實驗證明,本文提出的方法不管在語音的可懂性、清晰度質(zhì)量,還是分段信噪比上都有較大的提升,并且在低信噪比下可以帶來更多益處。