基于GAN的無監督域自適應行人重識別

鄭聲晟,殷海兵,黃曉峰,章天杰

研究與開發

基于GAN的無監督域自適應行人重識別

鄭聲晟,殷海兵,黃曉峰,章天杰

(杭州電子科技大學通信工程學院,浙江 杭州 310018)

針對無監督域自適應行人重識別中存在的聚類不準確導致網絡識別準確率低的問題,提出一種基于生成對抗網絡的無監督域自適應行人重識別方法。首先通過在池化層后使用批量歸一化層、刪除一層全連接層和使用Adam優化器等方法優化CNN模型;然后基于最小錯誤率貝葉斯決策理論分析聚類錯誤率和選擇聚類關鍵參數;最后利用生成對抗網絡調整聚類,有效提升了無監督域自適應行人重識別的識別準確率。在源域Market-1501和目標域DukeMTMC-reID下進行實驗,mAP和Rank-1分別達到了53.7%和71.6%。

無監督域自適應;行人重識別;生成對抗網絡

1 引言

隨著城市人口的不斷增長和視頻監控系統的大量普及,社會公共安全問題越來越受到人們的重視。為了增強攝像頭網絡的安防水平,行人重識別(person re-identification,reID)技術得到了廣泛關注。行人重識別,也稱行人再識別,被視為圖像檢索問題的一個分支,其目的在于利用計算機技術在一些大型區域內從非重疊多個攝像頭中檢索特定行人圖片[1-4]。行人重識別技術有效地解決了人工檢索的低效性問題,具有巨大的應用價值和發展前景。目前的行人重識別技術在智能安防領域、無人超市、智能機器人等領域有廣泛的實際應用。但同時行人重識別也面臨著許多困難,諸如服裝、光照、姿勢變換、遮擋物、攝像頭視角轉換和分辨率低等。

傳統的行人重識別主要通過基于特定場景下大量帶標簽的視頻圖像數據訓練出一個穩定可靠的模型[1-4]。但是這類監督學習方法忽略了在實際應用中系統對新場景的適應性,并且依賴大量帶標簽的行人數據,而標注工作往往需要耗費大量的人力和物力,不利于系統的部署。在許多實際情況下,面臨的問題是訓練數據和測試數據來自于不同的領域。無監督域自適應指將給定標注的源數據集上學習好的模型應用在未標注的目標數據集上,比如將在給定的數據集上訓練好的模型投入機場、火車站、汽車站等公共場所中使用,可省去在新場景下行人數據采集標注和模型訓練的時間與精力,極具有實用性。

生成對抗網絡(generative adversarial network,GAN)自2014年被提出以來發展迅速,極大地推動了行人重識別技術的發展[5-8]。眾所周知,行人重識別數據集構建需要消耗大量的時間和精力,但生成對抗網絡可以通過生成圖片解決數據集內每類樣本數量較少的問題,從而有效彌補了這一缺陷。目前的生成對抗網絡在行人重識別方面的作用主要是為傳統的行人重識別技術擴充其訓練所需的數據集,而本文提出了利用生成對抗網絡調整無監督域自適應行人重識別自訓練框架中的聚類,有效地提高了識別準確率。

2 相關工作

2.1 無監督域自適應的行人重識別

早期的reID學者嘗試尋找在域之間共享的潛在特征空間來解決在目標域上適應的問題。Pan等[9]和Chen等[10]嘗試著找到一個特征空間,在特征空間中源域和目標域的分布是相似的,并且采用了統計最大平均差(maximum mean discrepancy,MMD),為無監督域自適應reID發展奠定了基礎。

目前為了解決reID域自適應問題,學者提出了很多方法。Nigam等[11]提出了自訓練框架,指在目標域上進行迭代猜測,并且與期望最大化(expectation maximization,EM)算法密切相關,該自訓練框架的提出有效地提高了reID的性能,具有劃時代的意義。Deng等[12]和Wei等[13]將生成模型應用于域自適應中。Wang等[14]設計了一個學習屬性語義和身份識別特征表示的網絡。Li等[15]利用數據集之間的信息,并通過域自適應和reID網絡得出域不變的特征。Song等[16]首先在源域上訓練模型,然后對目標域數據執行聚類適應模型,該聚類再訓練的方法較為新穎,但是仍存在諸如聚類準確性不高等問題。

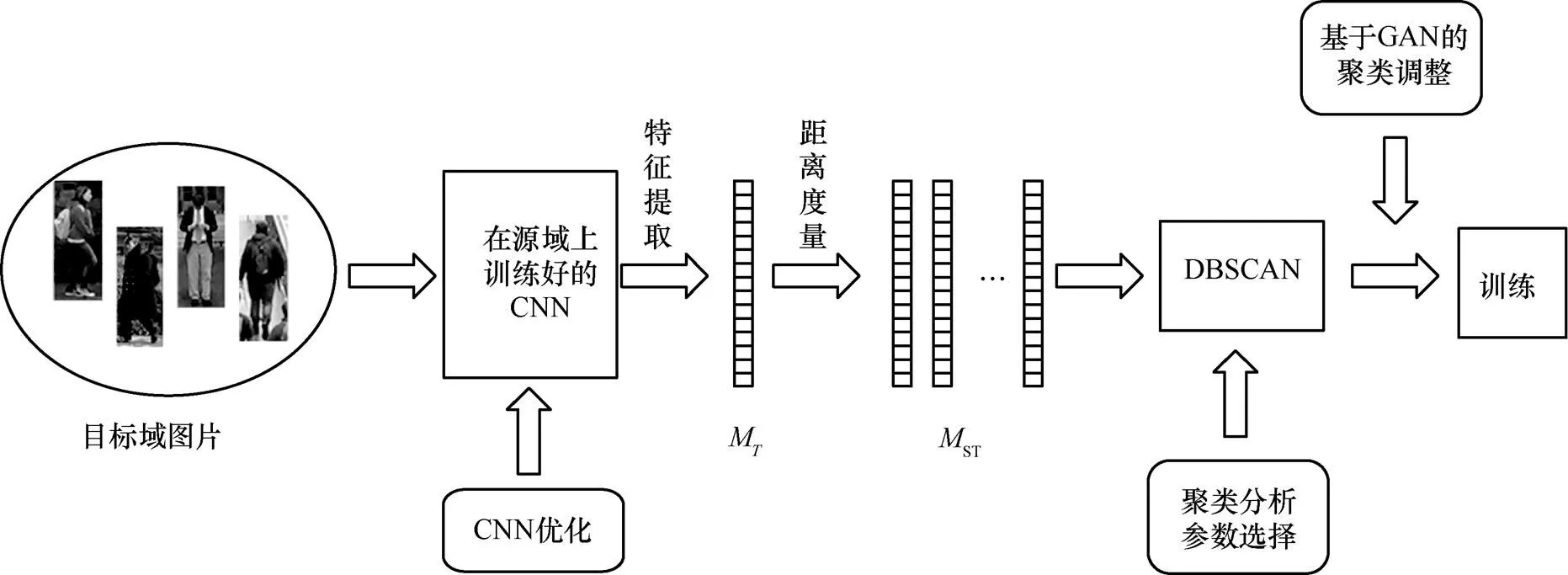

本文基于Song等[16]的自訓練框架進行優化,自訓練框架如圖1所示。在該框架中,首先利用在源域上訓練好的CNN模型提取無標簽目標數據集的特征獲得矩陣T,接著通過距離度量獲得源域數據集與目標數據集之間的距離矩陣ST,然后采用DBSCAN聚類算法對其進行聚類,以賦予無標簽目標數據集標簽數據。

其中,τ為半徑,其取值為MST內前P%元素的平均值,Song等[16]通過實驗獲得最佳P值為1.610?3,n為密度閾值。最后將聚類的結果作為目標數據集的標簽來訓練CNN模型,實現無監督域自適應達到reID較高的mAP和Rank-1。

2.2 生成對抗網絡

Goodfellow等[4]在2014年提出GAN,采用對抗策略訓練模型。GAN由生成器和判別器組成,訓練時極小化生成器損失,極大化判別器損失,交替進行訓練,這樣就形成了互相博弈對抗的過程。Ma等[17]首次解決人體姿勢轉換問題,根據給定的參考圖像,以目標姿勢生成人體圖像。根據18個關鍵點組成18通道的關鍵點熱圖,然后將其與參考圖像連接起來,并輸入CNN中進行對抗訓練。

目前GAN在行人重識別方面的作用主要是為傳統的行人重識別技術擴充其訓練所需的源域數據集,通過生成圖片解決數據集內每類樣本數量較少的問題。而本文提出一種GAN在無監督域自適應reID上應用的新思路,在圖1的自訓練框架中使用GAN,而非直接擴充源域訓練所需的數據集。創新步驟體現在以下兩點:第一步進行聚類分析,基于最小錯誤率貝葉斯決策理論來分析聚類錯誤率和選擇聚類關鍵參數;第二步利用GAN調整聚類,首先根據目標域數據集聚類結果訓練GAN,然后通過GAN生成不同姿勢的行人圖片來調整目標域數據集聚類,最后按照調整后的聚類結果標簽數據訓練CNN,從而提高無監督域自適應reID的性能,整體優化流程如圖2所示。

3 優化方法

3.1 CNN優化

本文在CNN優化部分基于Xiong等[18]的方法。第一步優化是在池化(pooling)層之后直接使用批量歸一化(batch normalization,BN)層,BN層可以提供更穩定的梯度,實現更快的收斂速度和更好的性能。第二步優化是刪除一層全連接(fully connected,FC)層,以減少對最終效果的影響。第一步優化是使用Adam優化器代替SGD優化器,防止過擬合。CNN模型優化如圖3所示。

3.2 聚類分析及參數選擇

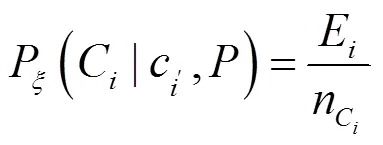

由上文可知,聚類結果的好壞會直接影響最后的自訓練結果,而參數值的選擇又是影響聚類的關鍵之一。Song等[16]沒有解釋如何有效地選擇值,同時由于已對CNN優化,當前的值未必是最佳的值,因此本文提出一種基于最小錯誤率貝葉斯決策的理論分析,以找到聚類錯誤率最低的值。

圖2 優化流程

圖3 CNN模型優化

因此對于源類ci,判定有nimax張圖片為聚類準確,把這nimax張圖片所在的類認為是源類ci的對應正確類,稱之為目標類Ci,該類包含的所有圖片數量為。而其他沒有被聚到目標類Ci的源類ci圖片被聚到其他ID的目標類Cj中,共有ei張,。其中,eij是源類ci的圖片被聚到其他ID的目標類Cj中的圖片數量。所以,源類ci的圖片樣本數量,其組成如圖4所示。目標類Ci不僅包含源類ci的部分圖片,可能還包含其他目標類cj的圖片,共有Ei張,其中。其中,eji為源類cj的圖片被聚到目標類Ci的數量。所以目標類Ci的圖片樣本數量,其組成如圖5所示。

圖5 目標類Ci的圖片樣本數量組成

獲得每個ID的聚類錯誤概率后,可求出在該值下的錯誤聚類概率密度函數。其中,由于每個ID的行人圖片數量都不相同,所以求和時要考慮各個ID圖片數量在總圖片數量的權重。因此在某個值下,兩種錯誤聚類概率密度函數和合計錯誤概率分別為:

3.3 基于GAN的聚類調整

該自訓練框架中存在的不足就是在聚類時由于行人姿勢不同,常常將同一ID的行人圖片錯分為多個類。如圖6所示,類1和類2中的行人圖片均屬于目標域數據集中的同一ID,卻沒有被聚到一起。如果能將同一ID不同姿勢的圖片聚在一起,那么reID的性能將會得到提升。因此本文提出一種利用GAN調整聚類的方法,其流程圖如圖7所示,算法流程如算法1所示。

圖6 聚類錯誤

算法1 基于GAN的無監督域自適應行人重識別算法

輸入源域數據集,目標域數據集,半徑,密度閾值

輸出對于目標域的特征提取器

在源域上訓練特征提取器;

對目標域進行特征提取,計算距離矩陣1;

聚類獲得標簽數據1= DBSCAN(1,,);

根據標簽數據訓練GAN;

利用GAN生成相應的規范姿勢圖片;

對目標域和生成圖片進行特征提取,計算距離矩陣2;

聚類獲得標簽數據2= DBSCAN(2,,);

針對2聚類結果進行類別調整;

針對2中任意兩個類A、B:

if A中存在由B生成的圖片 then 合并AB;

else if B中存在由A生成的圖片 then 合并AB;

根據調整后的標簽數據訓練特征提取器;

因為在無監督域自適應reID中不能使用目標域數據集的真實標簽信息,所以從自訓練中獲取聚類結果,對每一個類給定相應的偽標簽作為該類的ID,而不是直接使用真實的行人ID,利用偽標簽訓練GAN。

訓練好GAN后選定一組規范姿勢,可選取前后左右4個方向差異較大的姿勢作為規范姿勢。將目標域的每張圖片根據這組規范姿勢通過GAN生成其相應的姿勢圖片,生成圖片可以按原目標域圖片名稱加上姿勢名稱命名,方便后面調整聚類尋找。由生成姿勢圖片和目標域圖片合成新的數據集,稱之為混合數據集,將其放入DBSCAN聚類中。得到混合數據集聚類結果后進行調整,生成的姿勢圖片的作用是調整的依據。對于兩類A和B,首先在A中尋找是否存在由B中原目標域圖片生成的姿勢圖片,尋找方式可由圖片名稱尋找,判斷A中生成圖片名稱所包含的原目標域圖片是否存在B中,若存在則直接合并A和B;若不存在則在B中尋找是否存在由A中原目標域圖片生成的姿勢圖片,若存在則合并A和B;若不存在則不合并,繼續尋找下兩個類。調整好聚類后將目標域數據集按照調整后的標簽進行訓練。

圖7 基于GAN的聚類調整算法流程

4 實驗與分析

4.1 數據集準備

實驗使用數據集為Market-1501和DukeMTMC-reID,見表1。Market-1501數據集是清華大學于2015年公開的數據集,共有6個攝像頭、1 501個行人和32 668個已標注的行人矩形框。其中訓練集采集了751人的數據,共12 936張圖像;測試集采集了750人的數據,共19 732張圖像。DukeMTMC-reID數據集是杜克大學于2016年公開的數據集,共有8個攝像頭、1 404個行人和36 411個已標注的行人矩形框。其中訓練集采集了702人的數據,共16 522張圖像;測試集采集了702人的數據,共19 889張圖像。

表1 數據集細節

4.2 CNN優化及參數分析選擇

圖8 兩種錯誤概率密度

圖9 合計錯誤概率密度

根據實驗結果可以看出取1.5×10?3時合計錯誤概率最低,同時標記對應的半徑值0,以便后面使用。同時獲取了對應的值下Market- 1501→DukeMTMC-reID的自訓練結果,見表2。可見在=1.5×10?3時Market-1501→ DukeMTMC- reID的mAP、Rank-1、Rank-5和Rank-10最好,分別為52.2%、70.2%、81.8%和85.5%,與合計錯概率結果吻合。

4.3 基于GAN的聚類調整

在將混合數據集放入自訓練聚類中時使用第4.2節中提到的半徑值0,以減少生成姿勢圖片對目標域圖片的聚類影響。通過調整聚類有效解決了圖6的情況,將目標域DukeMTMCT-reID的聚類類數從852個減少到736個,同時其自訓練結果mAP、Rank-1、Rank-5和Rank-10分別在第4.2節的基礎上提升了1.5%、1.4%、1.5%和2.7%。表3為各個無監督域自適應reID方法在Market- 1501→DukeMTMC-reID的比較。實驗表明通過優化CNN模型、聚類錯誤分析和參數選擇可使reID性能顯著提升;通過調整聚類可改善由于姿勢不同導致的聚類錯誤問題,從而進一步提升reID性能。

表2 不同P值Market-1501→DukeMTMC-reID比較

表3 無監督域自適應reID方法Market-1501→DukeMTMC-reID比較

5 結束語

本文提出一種基于生成對抗網絡的無監督域自適應行人重識別方法,為生成對抗網絡在無監督域自適應行人重識別上的應用提供了新思路,有效提升了無監督域自適應行人重識別的識別準確率。該方法主要注重行人姿勢問題,將有助于促進行人重識別在實際場景的應用。但是行人重識別還存在著行人換衣、步態等難點亟待解決,相信隨著對抗生成網絡和其他科學技術的發展,越來越多的學者將在這些方向上開展更深的研究。

[1]ZHENG L, YANG Y, HAUPTMANN A G, et al. Person re-identification: past, present and future[J]. arXiv: 1610. 02984, 2016.

[2]王志宏, 楊震. 人工智能技術研究及未來智能化信息服務體系的思考[J]. 電信科學, 2017, 33(5): 1-11.

WANG Z H, YANG Z. Research on artificial intelligence technology and the future intelligent information service architecture[J]. Telecommunications Science, 2017, 33(5): 1-11.

[3]楊鋒, 許玉, 尹夢曉, 等. 基于深度學習的行人重識別綜述[J]. 計算機應用, 2020, 40(5): 1243-1252.

YANG F, XU Y, YIN M X, et al. Review on deep learning-based pedestrian re-identification[J]. Journal of Computer Applications, 2020, 40(5): 1243-1252.

[4]羅浩. 深度學習時代的行人重識別技術[J]. 人工智能, 2019(2): 40-49.

LUO H. Person re-identification technology in the era of deep learning[J]. Artificial Intelligence, 2019(2): 40-49.

[5]GOODFELLOW I, POUGETABADIE J, MIRZA M, et al. Generative adversarial nets[C]//Proceedings of the 27th International Conference on Neural Information Processing Systems-Volume 2. New York: ACM Press, 2014: 2672-2680.

[6]賈川民, 趙政輝, 王苫社. 基于神經網絡的圖像視頻編碼[J]. 電信科學, 2019, 35(5): 32-42.

JIA C M, ZHAO Z H, WANG S S. Neural network based image and video coding technologies[J]. Telecommunications Science, 2019, 35(5): 32-42.

[7]王萬良, 李卓蓉. 生成式對抗網絡研究進展[J]. 通信學報, 2018, 39(2): 135-148.

WANG W L, LI Z R. Advances in generative adversarial network[J]. Journal on Communications, 2018, 39(2): 135-148.

[8]陳亮, 吳攀, 劉韻婷, 等. 生成對抗網絡GAN的發展與最新應用[J]. 電子測量與儀器學報, 2020, 34(6): 70-78.

CHEN L, WU P, LIU Y T, et al. Development and application of the latest generation against the network of GAN[J]. Journal of Electronic Measurement and Instrumentation, 2020, 34(6): 70-78.

[9]PAN S J, TSANG I W, KWOK J T, et al. Domain adaptation via transfer component analysis[J]. IEEE Transactions on Neural Networks, 2011, 22(2): 199-210.

[10]CHEN B, LAM W, TSANG I W, et al. Extracting discriminative concepts for domain adaptation in text mining[C]//Proceedings of the 15th ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. New York: ACM Press, 2009: 179-188.

[11]Nigam K, Mccallum A, Mitchell T. Semi-supervised text classification using EM[M]//Semi-supervised learning. Cambridge: MIT Press, 2006: 33-38

[12]DENG W, ZHENG L, YE Q, et al. Image-image domain adaptation with preserved self-similarity and domain-dissimilarity for person re-identification[J]. arXiv: 1711. 07027, 2018.

[13]WEI L, ZHANG S, GAO W, et al. Person transfer GAN to bridge domain gap for person re-identification[C]//Proceedings of 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE Press, 2018: 79-88.

[14]WANG J, ZHU X, GONG S, et al. Transferable joint attribute-identity deep learning for unsupervised person re-identification[C]//Proceedings of 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE Press, 2018: 2275-2284.

[15]LI Y, YANG F, LIU Y, et al. Adaptation and re-identification network: an unsupervised deep transfer learning approach to person re-identification[C]//Proceedings of 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE Press, 2018: 172-178.

[16]SONG L, WANG C, ZHANG L, et al. Unsupervised domain adaptive re-identification: theory and practice[J]. arXiv: 1807. 11334, 2018.

[17]MA L, JIA X, SUN Q, et al. Pose guided person image generation[C]//Proceedings of the 31st International Conference on Neural Information Processing Systems. New York: ACM Press, 2017: 406-416.

[18]XIONG F, XIAO Y, CAO Z, et al. Towards good practices on building effective CNN baseline model for person re-identification[J]. arXiv: 1807.11042, 2018.

GAN-based unsupervised domain adaptive person re-identification

ZHENG Shengsheng, YIN Haibing, HUANG Xiaofeng, ZHANG Tianjie

College of Communication Engineering, Hangzhou Dianzi University, Hangzhou 310018, China

Aiming at the problem that the inaccurate clustering in the unsupervised domain adaptive pedestrian re-recognition results in low network recognition accuracy, an unsupervised domain adaptive pedestrian re-recognition method based on generative confrontation network was proposed. Firstly, the CNN model was optimized by using the batch normalization layer after the pooling layer, deleting a fully connected layer and adopting the Adam optimizer. Secondly, the cluster error was analyzed and the important parameter in the cluster was decided based on minimum error rate Bayesian decision theory. Finally, the generative adversarial network was utilized to adjust the cluster. These steps effectively improved the recognition accuracy of unsupervised domain adaptive person re-identification. In the case of the source domain Market-1501 and the target domain DukeMTMC-reID, experimental results show that mAP and Rank-1 can reach 53.7% and 71.6%, respectively.

unsupervised domain adaptive, person re-identification, generative adversarial network

TP391

A

10.11959/j.issn.1000?0801.2021016

2020?07?19;

2020?09?02

鄭聲晟(1996? ),男,杭州電子科技大學通信工程學院碩士生,主要研究方向為行人重識別。

殷海兵(1974? ),男,博士,杭州電子科技大學通信工程學院教授,主要研究方向為數字視頻編解碼、多媒體信號處理、芯片結構設計驗證。

黃曉峰(1988? ),男,博士,杭州電子科技大學通信工程學院講師,主要研究方向為數字視頻編解碼與芯片架構設計。

章天杰(2000? ),男,杭州電子科技大學通信工程學院在讀,主要研究方向為行人重識別。