一種基于圖卷積網絡的文本多標簽學習方法

劉曉玲,劉柏嵩,王洋洋

(寧波大學 信息科學與工程學院,浙江 寧波 315211)

1 引 言

多標簽學習[1]是處理現實世界中具有多語義對象的主要學習框架之一.一篇文本可能同時屬于政治、經濟、文化等多個主題,針對這類數據需要預測實例可能具有的多個標簽.標簽關聯關系會為多標簽學習提供有用的信息,例如當標簽“政治”存在時,出現“娛樂”的概率相對較小,如何充分挖掘和利用標簽之間的關系是目前研究者普遍認可和關注的一個關鍵問題[2].

根據多標簽學習算法中考慮的標簽關聯關系,將現有方法分為3類[3]:一階策略、二階策略和高階策略.一階策略是將每個標簽看成獨立不相關,不考慮標簽之間的相關性;二階策略利用了標簽成對的關聯信息,但在實際應用中標簽之間的相關性可能會超過二階;高階策略考慮每個標簽對其他標簽的影響.BR算法[4]假設標簽相互獨立,將多標簽學習任務轉換為單標簽分類問題.分類器鏈CC[5]將樣本特征與第1個分類器預測出來的標簽聯合作為新的特征,并將新特征通過第2個分類器,以此類推來模擬標簽之間的高階關系.基于信息熵[6]提出的CC算法[7]利用條件熵使標簽間相關性最大化.LIFT[8]基于標簽類屬性為每個標簽生成專屬的特征進行多標簽學習.近年來,一些基于神經網絡的模型應用于多標簽學習任務并取得重要進展.CNN-RNN[9]采用提取全局與局部語義信息的方式進行多標簽學習,考慮標簽之間的二階關系.SGM[10]將多標簽學習任務當成序列生成問題.MLILDSA[11]采用深度監督自動編碼器來計算后驗條件概率以建模標簽關系.大部分多標簽算法假設訓練數據的標簽是完整的,但實際中不完備數據普遍存在,NNADOmega[12]為提升模型效果在神經網絡損失函數中刻畫標簽依賴關系.大多數方法將實例文本作為獨立學習分類器參數的載體,未充分挖掘高階標簽之間的關系.

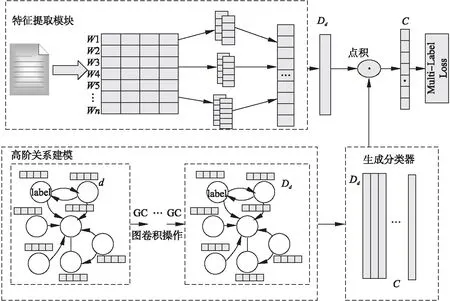

圖1 TMLLGCN框架Fig.1 Framework of TMLLGCN

圖卷積網絡是一種對圖數據進行操作的神經網絡,眾多學者對圖卷積網絡進行了研究和應用.Wang等人[13]將圖卷積網絡應用于推薦社交網絡建模;Si等人[14]提出了基于圖卷積網絡的人體動作識別方法;Yu等人[15]將圖卷積網絡應用于交通流量預測問題.基于圖卷積學習理論,本文提出利用標簽圖結構來捕獲和探索標簽的高階關系.具體來說,GCN在標簽圖之間傳播信息,從而學習具有每個文本標簽的高階關系分類器.這些分類器從標簽圖中匯聚信息,并將這些信息進一步應用于文本特征表示,從而實現最終的標簽預測,這是一種明確建模標簽高階關系的方法.本文的主要貢獻有:

1)提出一種新的基于GCN進行文本多標簽學習的端到端學習模型,充分挖掘利用標簽高階關系.

2)考慮到未標記標簽集對已知標簽集的影響,充分挖掘有價值信息進行標簽補全,提高模型的適應性.

3)在真實多標簽數據集上驗證了TMLLGCN的有效性.

2 相關定義

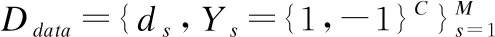

D={(ds,Ys)|1≤s≤Mum,Ys={1,-1}C,Ys?L}

對于測試樣本Ti,學習模型需輸出與其相關的標簽集合Yi=[y1,y2,yi,…yC],yi取值“1”或“-1”.

定義2.集合M={a1,a2…am},集合N={b1,b2…bn},ai的概率為p(ai),則M集合的信息熵:

(1)

則在M條件下N的條件熵:

(2)

I(bj|ai)=-p(aibj)log2p((bj|ai))

(3)

定義3.圖G=(V,E),V和E分別表示節點和邊.矩陣X∈Rn×d,其包含n個帶有特征的節點,d表示節點特征維數,節點v的特征向量為:xv∈Rd,對應的邊關系矩陣A∈Rn×n.GCN通過一層卷積捕獲鄰居信息,當GCN堆疊可以獲得較大鄰域信息[16].對一層GCN,k維節點矩陣H(1)∈Rn×k的形式化表示即:

(4)

(5)

l表示層數,并且H(0)=X.

3 基于圖卷積網絡的文本多標簽學習

本文提出一種TMLLGCN模型,其架構如圖1所示.首先,進行文本特征表示,其中w1,w2,…,wn表示文本輸入的詞向量表示,經過不同的卷積窗口尺寸得到3種不同的特征表示,進而融合形成Dd維文本特征.其次,進行標簽補全建模,最后進行GCN建模高階關系的分類器學習,其中d表示初始標簽向量的維度,經過圖卷積操作形成Dd維的標簽表示,C表示標簽數量,將文本特征和生成分類器以點積的方式結合,并對預測分數進行歸一化產生C個標簽概率,然后據損失函數迭代訓練.

3.1 文本特征表示

深度學習方法在特征提取方面效果優異,遵循AGCNN[17]提取文本特征,特征為x:

x=fAGCNN(T,θAGCNN)∈RD

(6)

其中θAGCNN表示模型參數,Dd表示維度.

3.2 非對稱標簽補全建模

現實文本數據的標簽并非總是完整的,探究標簽高階依賴關系有助于在標簽缺失時提高模型的效果[18].此外大多數多標簽學習方法采用預定義的關系矩陣,但預定義的關系并非總可得.此外,據簡單共現概率建立相關矩陣的方法通常具有對稱假設.GCN基于相關矩陣在節點之間傳播信息,相關矩陣的設計至關重要,本文考慮到未標注標簽集對已知標簽集的影響,設計非對稱性參數充分挖掘標簽信息.基于上述原因,通過數據驅動方式獲得基礎置信度矩陣,由相關定義1和公式(3)得到:

pij=-μaij+(1-μ)bij

(7)

其中μ是非對稱參數,通過增加基礎關系矩陣bij的權重和減少aij的權重進行學習.將實例訓練數據的標簽矩陣Y更新為:

(8)

非對稱標簽補全建模的具體流程如下:

算法1.非對稱實例標簽補全

輸入:標簽矩陣Y,非對稱參數μ

1.Y={Yi|i=1,…,C},Y∈RMum×C

2.For eachyi,yj,利用公式(3)計算:

ifi=j

aij=bij=1

3.由式(7)得到非對稱化矩陣:

pij=-μaij+(1-μ)bij

3.3 基于GCN建模高階關系的分類器學習

(9)

gθ×Gx=gθ(L)x=gθ(UΛUT)x=Ugθ(Λ)UTx

采用切比雪夫多項式簡化為:

(10)

θ0x+θ1(-D-1/2AD-1/2)x

(11)

進一步擴展到高維特征向量x∈RC×d,有式(12):

其中Θ∈Rd×F是卷積核參數,對輸入數據x執行一次圖卷積,得到gθ×Gx∈RC×F,標簽節點被0~K-1階鄰居標簽信息更新.

3.4 基于圖卷積網絡的文本多標簽學習

基于圖卷積網絡的多標簽學習流程如下:

算法2.基于圖卷積網絡的多標簽學習

非對稱性參數μ,

ρ=LeakyRelu,σ=softmax

輸出:預測標簽Yout

1.重構訓練集:

通過AGCNN對ds提取文本特征xD

2.GCN建模高階關系的分類器學習:

根據式(7)得到第一層輸入關系矩陣pij;

A←pij,H0←x∈RC×d

3.標簽圖卷積:由式(10)-式(12)得:

forl←0toLdo:

yc=WxD

由公式(9)得目標函數:minLt

更新權重W←W+ΔW

直到滿足迭代停止條件

4.預測新數據:

對Ti提取文本特征TD

TD應用到標簽空間對象分類器:Yout=σ(WTD)

5.returnYout

4 實 驗

4.1 實驗數據集

為檢驗TMLLGCN模型的性能,在真實數據集上進行了對比實驗,數據劃分詳情見表1.

Zhihu(1)http://tcci.ccf.org.cn/conference/2018/taskdata.php:短文本數據集,其包含知乎問題標題、相關描述和話題標簽,選取標簽數量為260.

表1 多標簽數據集描述Table 1 Multi-label data description

AAPD(2)https://drive.google.com/file/d/18JOCIj9v5bZCrn9CIsk23W4wyhroCp_/view.:該數據集為計算機科學領域的學術論文,包含摘要和對應的標簽,標簽總量為54.

4.2 實驗方法

為防止數據周期性影響,首先對實驗樣本隨機shuffle之后按8:2的比例劃分訓練集和測試集,其次,對于詞向量矩陣中未出現的詞,采用-0.25~0.25值初始化,對問題(題目)和描述(摘要)分別取其2倍的平均長度,進行補齊或截斷至一致長度.通過實驗選定合適的非對稱性參數μ.本文使用基于實例和基于標簽的兩類評估指標[20]:Precision(P)、Recall(R)、F1-Measure(F1)、One-error(OE)、Coverage(CV)、Ranking Loss(RL)以及Macro-F1、Micro-F1.他們可以從各個方面評估多標簽學習方法的性能.其中OE、CV和RL的值越低,則表示模型效果越好.同時TMLLGCN與基于BR[21]、CC[22]、LP[23]的方法以及CNN-RNN[9]、SGM[10]多標簽學習算法進行對比.

4.3 實驗結果與分析

4.3.1 TMLLGCN和各基準方法的整體性能比較

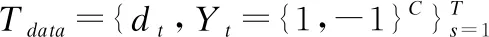

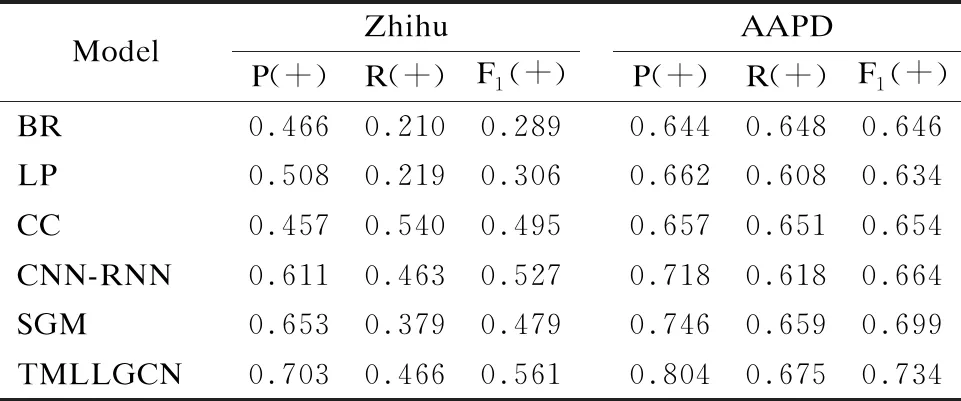

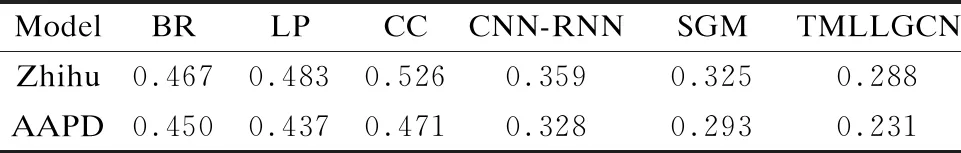

各方法在數據集上的比較結果如表2-表5所示.

表2 不同方法在指標P、R、F1上的比較Table 2 Comparison of different methods on P,R,F1

表3 不同方法在One-error上的比較Table 3 Comparison of different methods on OE

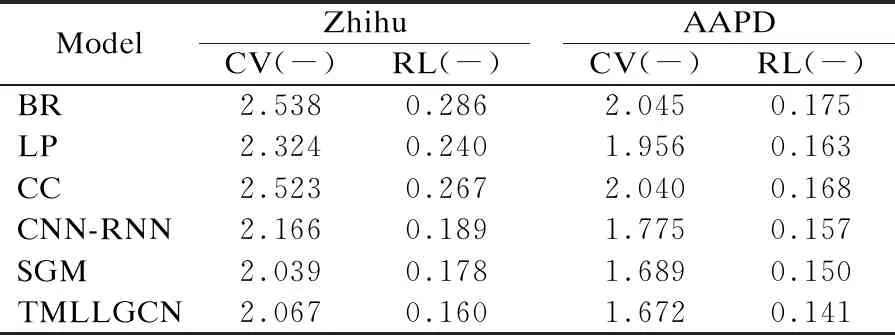

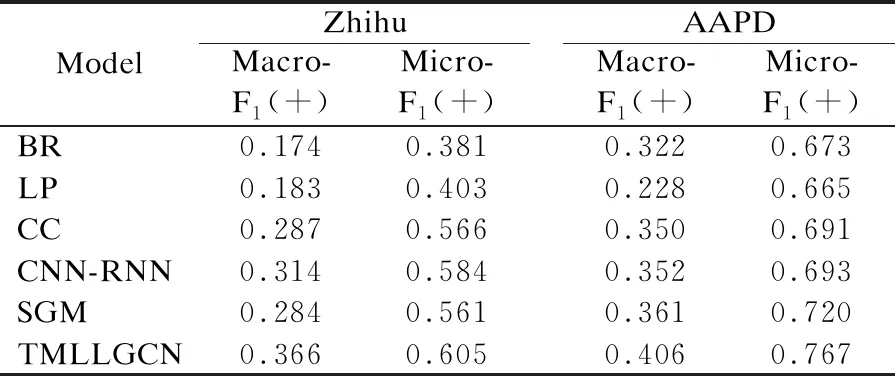

從表2實驗結果可以看出TMLLGCN模型在P、R和F1的評估上比其他方法表現更好.基于BR的算法在精確度指標上比其他算法低,主要原因是其對標簽關系進行獨立性假設,標簽關聯信息較弱.傳統基于CC和LP的方法由于建模標簽關系性能有限,預測結果并不理想.深度學習方法CNN-RNN和SGM在精確度指標上較BR、CC和LP有明顯提升,基于圖卷積的TMLLGCN在充分挖掘標簽高階關系的同時考慮了未標記量對標簽集的影響,所以預測標簽結果要優于上述模型.從表3的6種算法在One-error指標上的結果可以看出,本文方法TMLLGCN在數據集Zhihu上比深度學習方法CNN-RNN、SGM分別降低了7.1%、3.7%,在數據集AAPD上分別降低9.7%、6.2%.從表4實驗結果可以看出,CNN-RNN、SGM和TMLLGCN在覆蓋率和排序損失上表現明顯優于BR、CC和LP方法,其中在指標Ranking Loss上,TMLLGCN比其他方法的值更低,在數據集AAPD上的排序損失降低到0.141.由表5實驗分析可得TMLLGCN在基于標簽的評價指標上獲得優異表現,其Macro-F1、Micro-F1指標值比深度學習方法CNN-RNN均有提升,且顯著優于傳統方法,這也進一步說明了本文方法在挖掘標簽高階關系方面取得效果.綜合以上各方面實驗評估結果,驗證了TMLLGCN多標簽學習方法的有效性和優異性.

表4 不同方法在Coverage和Ranking Loss上的比較Table 4 Comparison of different methods on CV,RL

表5 不同方法在Macro-F1、Micro-F1上的比較Table 5 Comparison of different methods on Macro-F1 and Micro-F1

4.3.2 非對稱性參數μ的影響

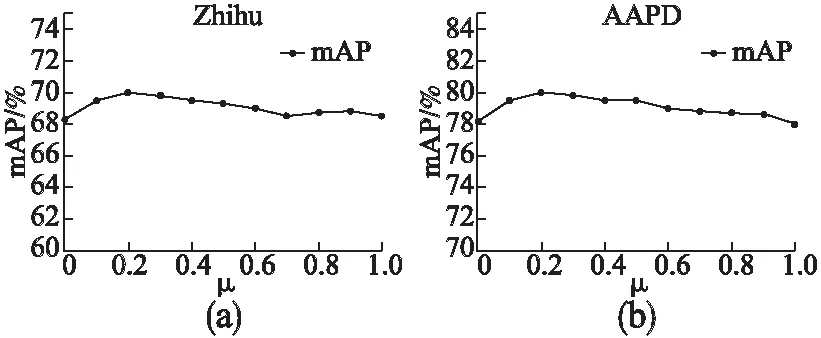

為了觀察式(7)中不同μ值的影響,將μ設在[0,1]之間,平均準確度在不同數據集上的實驗效果如圖2所示.

圖2 在Zhihu(a)和AAPD(b)數據集上值的影響Fig.2 Effect of μ on Zhihu(a)and AAPD(b)

由圖2可得,μ取值范圍在區間[0.1,0.3]上效果較好,非平衡參數μ=0.2時,模型效果最好,這表明合理增加未知相關標簽的學習權重有利于標簽信息在節點上的傳播.

4.3.3 不同詞向量表示對TMLLGCN的影響

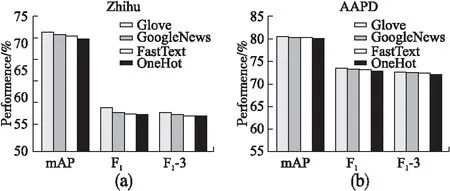

為探究不同詞向量表示對本文提出模型的影響,對標簽進行GloVe[24],GoogleNews[25],FastText[26]和one-hot詞向量表示.在數據集Zhihu和AAPD上的實驗效果如圖3所示.

圖3 在Zhihu(a)和AAPD(b)上詞向量對TMLLGCN的影響Fig.3 Effect of word vector on TMLLGCN on Zhihu(a)and AAPD(b)

由圖3可發現,不同詞向量作為TMLLGCN的輸入時,多標簽學習準確度不會受到顯著影響.one-hot結果也表明模型準確度的提升并非絕對地來自詞向量的語義,但使用強大的詞向量可帶來更好的結果.大量文本語料庫中學習的詞向量保持了一些語義拓撲,即語義相關的概念在詞向量空間中是接近的,同時TMLLGCN可以使用這些依賴關系更好的進行文本多標簽學習.此外,GCN層數并非越多越好,由圖3中F1-3指標可知,當圖卷積層數增加到3時,數據集上的F1指標降低,可能的原因是:在增加GCN層數時,節點傳播積聚導致過度平滑.

5 結束語

捕獲標簽依賴性是文本多標簽學習的一個關鍵問題.為了對這些重要信息進行建模和探索,本文提出通過GCN的映射函數從數據驅動的標簽表示中學習對象分類器挖掘標簽高階關系.為更好地建模高階關系以及提高標簽缺失時的預測效果,在得到的基礎標簽關聯矩陣上考慮了未標記標簽集對已有標簽集的影響進行標簽補全,定量和定性的實驗結果均證實了TMLLGCN模型的優勢.在進一步研究工作中,我們將致力于通過注意力機制和更好的初始關系策略來優化網絡結構,以提升模型的多標簽學習能力.