基于深度學習的實例分割研究進展

李曉筱,胡曉光,王梓強,杜卓群

1.中國人民公安大學 信息網絡安全學院,北京100038

2.中國人民公安大學 偵查學院,北京100038

深度學習誕生前,實現圖像中目標檢測任務主要依賴于人工設計局部特征描述子,概括性強、抽象表達概括全局信息從而區分圖像的不同區域,經典算法有HOG[1](Histogram of Oriented Gradient)、SIFT[2](Scale-Invariant Feature Transform)及LBP[3](Local Binary Patterns)等,但局部特征描述符的設計需要極強的領域專業知識且耗費人力。在深度學習的發展之下,借用深層次卷積神經網絡可以從圖像中學習具有不同層次的特征表示方法,如何設計具有更好局部特征描述子的問題轉化為如何設計輕量網絡結構和簡化訓練過程,以實現精細任務。在計算機視覺的飛速發展之下,細化分類的計算機視覺技術可以分為分類、目標檢測、語義分割、實例分割多個類別[4]。分類指的是預測目標圖像中對象類別,目標檢測在由粗至細的過程中不僅確定圖像中目標的類別,同時以邊界框或者圖中心的形式標明目標所在圖像中具體位置。語義分割在此基礎上對目標每個像素點標簽預測,使每個像素按照其所在區域或對象分類標記,得到更精細分割結果。實例分割的概念最早由Hariharan等人[5]提出,旨在對同類對象組不同個體提供不同標簽,整個過程中相同含義像素被賦予相同標簽,在實現目標檢測任務時解決語義分割問題。

隨著深度學習[6]及卷積神經網絡[7]的出現,許多實例分割框架被提出。實例分割廣泛應用于無人駕駛、醫學影像分析、安全防控、工業分揀等領域,可靠、迅速提取圖像關鍵信息,準確、精細分割的結果為后續視覺處理提供便利。分割精度體現在精確定位及識別框架,在內外條件變化的實際場景中保持較高魯棒性;保持較高精度的同時降低算法計算量是實例分割的開發思想。目標分割根據階段分類可分為基于候選區域的雙階段檢測及基于一體化卷積網絡的單階段檢測器,前者的準確率高、檢測精度高,但后者檢測運行速度快。受單雙階段目標檢測啟發,實例分割也存在單階段實例分割及雙階段實例分割。兩類實例分割方法適用于不同的場景,近期實例分割取得很大進展,基于Faster R-CNN發展而來的Mask R-CNN實例分割網絡使用掩碼分割、包圍框回歸、對象分類三支線并行,是一種直接有效的實例分割方法,以其網絡的高精度和穩定性成為雙階段實例分割網絡的標桿;單階段實例分割網絡YOLACT 的出現標志實時性實例分割的開端,以較小的精度損失獲取高效的處理能力。但目前而言實例分割方法缺乏相關綜述性文章。本文將以近兩年計算機視覺會議為主,闡述主流實例分割網絡結構及應用,并介紹常用評價指標及數據庫,對未來可能發展進行展望。

圖1 FCIS網絡結構

1 雙階段實例分割網絡

1.1 FCIS

傳統語義分割網絡使用采用交叉熵并結合標簽進行端到端訓練,無法實現同一像素在不同區域具有不同語義的實例分割任務。FCIS[8]提出一種端到端完全卷積的實例分割方法,它沿用了實例感知全卷積網絡[9](Instance-sensitive fully convolutional networks)中位置感知特征圖(Position-sensitive Score Map)概念,在輸入圖片中卷積生成k×k組位置感知特征圖;特征感知特征圖表示像素在不同感興趣區域(Regions of Interest,RoI)的位置特征表示,綜合像素在每個感興趣區域的得分衡量像素屬于對象實例的可能性。

為了增加分割、檢測子任務的聯系性,FCIS在位置感知特征圖基礎上提出內部分數和外部分數。在分割任務中,直接使用Softmax 判別函數對像素分類,感興趣區域對每個像素分數集合;在檢測任務中,先對每類位置特征感知特征圖逐像素使用Max 函數分類,匯集所有像素可能性后使用Softmax 判別函數獲得整個區域預測分數。兩類位置特征感知圖的提出將分割和檢測的子任務緊密結合,使用較簡潔、直觀的網絡結構實現任務。

對于整個FCIS框架(如圖1),圖像輸入只保留卷積層的ResNet 進行卷積操作獲得初步特征,特征經過區域建議網絡得到感興趣區域同時經過卷積層生成特征圖。結合位置特征感受的過程實現分割和檢測的子任務。FCIS 建立了一個完全拋棄全連接層的輕量級網絡,設計的位置特征感知圖架構使圖像分割和圖像分類可以共享特征圖,整個網絡計算量小、更加輕量。

FCIS 作為實例分割早期模型,提供了一種實例分割任務的解決方案,但就結果來看,在重疊的實例上FCIS 出現系統性的檢測錯誤,并產生了虛假邊緣[10],如圖2所示。

圖2 實例重疊時FCIS檢測產生虛假邊緣

1.2 Mask R-CNN

Mask R-CNN[10]是目標檢測網絡Fast R-CNN[11]、Faster R-CNN[12]發展而來的實例分割網絡,通過在邊界框識別分支的基礎上增加預測目標掩碼的分支,有效檢測目標對象的同時,對每個實例生成高質量的分割掩模。

傳統特征提取操作中,系列卷積獲得的特征圖經過上采樣尺寸過大,無法實現對小目標的檢測。主干網絡部分,Mask R-CNN 采用特征金字塔網絡[13](Feature Pyramid Networks,FPN)和ResNet101 網絡結合,在原始特征金字塔網絡自上而下特征中加入3×3 卷積進一步提取特征。抽象但語義更強的特征圖上采樣并橫向連接至分辨率更高的底層特征圖,保證空間尺寸相同的情況下,融合后特征圖更好的定位,主干網絡的選擇實現信息豐富、特征加強。

Mask R-CNN 使用輕量的區域建議網絡(Region Proposal Network,RPN)獲取感興趣區域,對每塊掃描獲得的瞄(anchor-box)輸出前景或背景的類別,并同時評估輸出精細調整前景瞄框與目標中心位置關系;在多個瞄框重疊的情況下使用非極大值抑制(Non-Maximum Suppression,NMS)選擇前景分數最高瞄框,最終輸出圖片內最佳的區域建議。

Mask R-CNN提出RoIAlign操作,使用雙線性插值的方法計算每個感興趣區域采樣點輸入特征值,避免邊界量化的同屬保證提取特征與輸入對齊。訓練中Mask R-CNN提出多任務損失函數L:

式(1)中Lbox衡量目標分類損失值,Lcls衡量目標檢測損失,Lmask衡量實例分割損失。

由于Mask R-CNN 具有較強的分割精度,Zimmermann 等[14]受人工設計分割算子的啟發,提出在原有Mask R-CNN 基礎上增加邊緣分支以增強網絡對邊緣檢測的精度,在速度基本不變的情況下網絡精度提升1.8%;Huang[15]等將金字塔注意力網絡(PAN)作為Mask R-CNN 的骨干網絡,以統一的方式從自然場景圖像中檢測出多方向和彎曲的文本,該方法能有效地抑制文本類背景引起的誤報警,在多項文本檢測基準任務上取得了優異的性能。

1.3 Mask Scoring R-CNN

Mask R-CNN中,掩碼分支最終輸出由分類分支最高置信度決定,但分類分支置信度與掩碼的相關度很低,依據分類分支確定的掩碼并不是最佳選擇,導致衡量算法掩碼部分分值降低。針對此問題,Mask Scoring R-CNN[16]設計一種掩碼評價策略Mask IoU衡量真實掩碼與預測掩碼差異,同時引入網絡分支Mask IoU Head對評價進行訓練。掩碼評價策略用Smask表示:

其中,Scls表示目標分類分數,SIoU表示交并比分數。Mask Scoring R-CNN提出的掩碼評價策略相比之前的評價對目標分類及掩碼分割更敏感,從而校準了掩碼質量和掩碼得分之間的偏差,提升分割性能;且網絡穩定性能高,為后續實例分割評價工作的進一步發展提供可能方向。

1.4 BlendMask

較高級別的特征對應于較大的感受野,并且可以更好地捕捉關于姿勢等實例的整體信息,而較低級別的特征保存更好的位置信息,并且可以提供更精細的細節。BlendMask[17]提出一種基于提議的實例掩碼預測的方法,稱為blender,它結合了豐富的實例級信息和精確的密集像素特征,在與目標檢測框架結合的過程中,以較小的計算提高檢測準確性。

網絡結構方面,BlendMask由一個檢測器網絡和一個掩碼分支組成。掩碼分支有三個部分,其中底部模塊用于預測評分圖,模塊的輸入可以是語義分割網絡的主干特征,或特征金字塔;頂層模塊attention map 獲取粗略的實例信息,包括對象形狀及位置;Blender module模塊用于合并評分和關注度,它根據關注度結合位置感知生成最終預測。與典型分辨率為28×28 的掩碼版相比,混合掩碼具有靈活性,提供了詳細的實例級信息,獲取位置感知信息并抑制外部區域。在輸出高分辨率掩膜的同時可以適用于實時性任務。

2 單階段實例分割

2.1 YOLACT

在YOLACT[18]誕生前,精度較高的實例分割網絡是基于雙階段目標檢測提出的,但雙階段方式掩碼的生成依賴于目標定位,例如Mask R-CNN使用RoIAlign從邊界框中獲取特征,并將局部化特征輸入到掩碼生成模塊,這樣依序處理的方式使得雙階段實例分割方式雖然精度高,但處理速度慢。受單階段目標檢測算法SSD[19]、YOLO[20]等實時性強的啟發,YOLACT將實例分割分解為兩個并行的任務:生成整個輸入圖像的掩碼組合、預測每個實例掩碼系數并將相應預測系數與全圖組合;在不需要依序處理(repooling)的情況下,YOLACT網絡速度達到30 frame/s(每秒幀數)以上,產生高精度掩碼的同時可以實現實時性的實例分割。

主干網絡部分,YOLACT 沿用單階段目標檢測網絡RetinaNet 結構,使用RestNet101 與特征金字塔網絡結合,其中,特征金字塔網絡部分由P3至P7構成,P3至P5層由ResNet對應C3至C5層計算獲取。P3層保留更深層次圖像特征輸入全圖掩碼分支(Protonet),通過全卷積神經網絡將最后一層保留k個通道,處理后變為原圖1/4 大小,獲取全圖預測的k個掩碼組合。全圖掩碼分支監督來自最終掩碼損失,在獲得高質量掩碼的情況下對小目標分割體現更好的分割效果,如圖3。

掩碼系數部分,YOLACT在基于錨點(anchor)目標檢測基礎上,對應全局掩碼分支增加第三個分支預測k個掩碼系數;共包含預測分類置信度分支、預測邊框分支、掩碼系數預測分支,對每個瞄點產生4+c+k個系數。全圖掩碼和掩碼系數采用線性組合的方式:

其中,P表示全圖掩碼矩陣h×w×k,C表示經非極大值抑制和得分閾值篩選后的掩碼系數矩陣n×k。

在提升網絡速度方面,YOLACT 提出一種快速非極大值抑制方法(Fast NMS)。傳統目標檢測網絡中,在為每個錨點產生邊界回歸和類別置信度后使用非極大值抑制降低重復檢測,但按順序執行的方法受速度限制,快速非極大值抑制方法并行排序矩陣計算,并保留確定剔除的檢測框對其他框的影響。在Mask R-CNN中僅替換非極大值抑制方法,就提速15.0 ms,且性能損失僅為0.3 mAP,快速非極大值抑制方法在網絡性能損失較小的情況下,實現了網絡提速的飛躍。

YOLACT 雖然在測試過程中也存在目標場景復雜時無法準確定位、相距較遠兩個實例間掩碼重疊的問題,但輕量且精度較高的網絡為實時實例分割網絡提供了參考。改進方面,Lee 等[21]提出了一種將混合精度量化技術應用于YOLACT 網絡的方法,根據YOLACT 中的參數大小和對模塊精度的影響自適應量化,在盡可能保持精度的同時顯著地減小網絡規模,在精度損失小于0.1%的情況下整個網絡的參數尺寸減小75.4%;Liu等[22]提出一種實時實例分割YolactEdge。對基于圖像的實時方法YOLACT 進行了兩個改進:(1)TensorRT 優化,同時考慮了速度和精度;(2)提出新的特征扭曲模塊。實驗表明,YolactEdge 在保證掩碼精度同時,速度提升3~5倍。

圖3 YOLACT網絡結構

2.2 YOLACT++

針對YOLACT 實時性強但精度稍差的問題,YOLACT++[23]被提出;它沿用YOLACT 生成整個輸入圖像的掩碼組合、預測每個實例掩碼系數并將相應預測系數與全圖組合的設計,保持原有網絡架構的大部分結構,從主干網絡、瞄框選擇、掩碼評估改進等方面對原有結構進行優化。主干網絡方面,YOLACT++加入可變性空間卷積(Deformable Convolution with Intervals),提升對長寬比、尺度、角度不同目標的處理能力,衡量精度和處理速度的可變性空間卷積使網絡耗時增加2.8 ms的情況下,mAP 提升1.6。瞄框選擇方面,YOLACT++嘗試兩種變形方法:保持尺度不變增加長寬比以及保持長寬比不變增加每層尺寸的比例;掩碼評估方面,YOLACT++參考Mask Scoring R-CNN的評價思想,加入快速掩碼重評分分支(Fast Mask Re-Scoring Network),截取全局掩碼預測結果輸入卷積層提取特征,并將全局池化輸出的交并比與目標分類分數相乘作為最終評分。快速掩碼重評分分支校準了掩碼質量和掩碼得分之間的偏差,且保持了網絡速度,如圖4。

圖4 快速掩碼重評分分支

2.3 PolarMask

PolarMask[24]是一種全卷積、無錨框的單階段實例分割算法,它將實例分割問題轉化為極坐標下選取實例中心并進行分類及密集回歸預測目標實例輪廓的問題:輸入整幅圖像后,PolarMask 通過預測每個角度上采樣的正位置確定目標實例中心,并預測目標實例中心到實例輪廓的距離,組裝后輸出掩碼。圖5表示了不同掩碼表示方法,(b)表示了像素到像素預測網絡的掩碼表示方法,例如Mask R-CNN,雖然精確度高但耗時較長;(c)表示笛卡爾坐標系的掩碼表示方法,坐標原點表示目標實例中心,輪廓線由距離和角度決定;(d)表示極坐標系下掩碼表示方法,在兼備笛卡爾坐標系以目標中心為原點、距離角度確定輪廓線的基礎上,角度具有很強方向性,對于確定外輪廓來說較為方便。

圖5 不同掩碼表示方法

為了獲得更簡潔的網絡結構,PolarMask 嵌入單階段目標檢測方法FCOS[25]。主干網絡部分,PolarMask保持了與FCOS一樣的主干+特征金字塔網絡結構用于提取不同層次豐富特征;分支部分,PolarMask引入掩碼回歸分支替代FCOS中檢測框分支,以圖片輸入網絡確定的實例中心為原點,間隔△θ角度均勻發射n條射線,輪廓與中心的距離決定射線長短,其中△θ為10°,n為36;由于角度預設定,只需預測射線長度。

在實例中心選擇上,PolarMask以目標質心為基礎,將質心周圍9~16 個像素作為實例候選中心的正樣本,引入極軸中心度(Polar Centerness)分支選擇目標極坐標中心,降低正負樣本的不平衡性。定義每個實例中n條射線長度分別為{d1,d2,…,dn} ,則有:

極軸中心度分支與分類分支并行,在對極軸中心加權過程中,依據式(4),射線長度均衡的中心會被賦予更高權重。

在交并比損失方面,PolarMask 引入極坐標下交并比損失計算方法(Polar IoU Loss),預測掩模與真實值之間的交互面積與加和面積之比。交并比公式定義為式(5),其中d表示回歸目標射線長度,d*表示預測射線長度,夾角為θ;式(5)經離散化和簡化操作,最終定義交并比損失函數為式(6):

PolarMask提出一種將掩碼表示轉化為掩碼輪廓表示的方法,使用極坐標和射線的方式模擬輪廓,雖然最終精度稍差于主流實例分割算法,但對于掩碼輪廓的設計提供了全新的思路。改進方面,對于PolarMask掩膜分割邊緣模糊的問題,張緒義等[26]通過對輪廓點角度的偏置及距離預測,并加入語義分割子網絡精細邊緣,測試分割結果比原方法提升2.1%。

2.4 CenterMask

CenterMask[27]是一種單階段無瞄框實例分割方法,在單階段目標檢測方法FCOS的基礎上,提出新的空間注意力引導掩碼分支(SAG-Mask)。SAG-Mask 分支從FCOS 檢測中獲取目標預測框,以預測每個感興趣區域上的分割掩碼;同時空間注意力模塊(SAM)有助于分支聚焦于有意義的像素并抑制無意義的像素。

針對Mask R-CNN 中RoIAlign 不考慮輸入尺度比例的缺陷,CenterMask 引入尺度自適應區域分配函數(Scale-adaptive RoI assignment function),在為掩碼預測提取感興趣區域的特征時,考慮感興趣區域比例。

主干網絡方面,CenterMask 在VoVNet[28]的基礎上改進,提出高效的主干網絡VoVNetV2,以進一步提高中心掩碼的性能。由于單次聚合(OSA)模塊有效捕捉不同的感受野的特性,原有的VoVNet 網絡可以有效進行多樣化特征表示;但在網絡深度增加的情況下,由于conv 等變換函數的增加,堆疊OSA 模塊使得梯度的反向傳播逐漸困難。因此CenterMask在VoVNet中增加了殘差連接和eSE 模塊。殘差連接中,輸入路徑連接到OSA 模塊的末端,OSA 模塊能夠以端到端的方式在每個級上反向傳播模塊梯度,擴大主干網絡深度;針對SE模塊降維導致的信道信息丟失問題,eSE使用一個具有C 通道的全連接層(fully-connected layer)保持信道信息,從而提高了性能。

3 對比分析

3.1 實例分割數據集

實例分割解決不同實例個體像素分割的問題,為了提高網絡對復雜場景的理解能力,需要高清晰度、數量規模龐大的數據庫作為支撐。在實例分割網絡飛速發展的同時,一些為網絡性能提供訓練驗證的公開數據集出現,為網絡模型的測試結果提供基準。

Cityscapes[29]數據集著重于對城市街道場景的理解,主要包含城市街道場景圖像,按照與城市場景相關性(車輛、天空、地面等)將30 個目標類別分為8 類數據集。數據集包含約5 000 張帶有精細注釋的圖像和20 000 張帶有粗略注釋的圖像,提供語義、實例注釋。Cityscapes 在天氣情況穩定良好的時間內采集了50 個城市圖像;但由于視頻記錄的形式,在使用數據集前需要人工選擇視頻幀數,獲取所需不同場景下具有較多目標類別的標注圖像。

MS COCO[30](Microsoft Common Objects in Context)數據集是微軟公司于2014 年公布的數據集,主要包含日常復雜生活場景照片,超過328 000 張照片中包括91 種常見物體類型(80 個可分類別)及250 萬個標注實例,其中82種每種有超過5 000個標注實例。基于龐大、可靠的數據量,以COCO 數據集為基準的檢測挑戰賽是目前目標檢測、實例分割領域的標桿。檢測挑戰賽包含超過80 個可分通用場景物體,訓練圖像及測試圖像超過80 000張、驗證圖像超過40 000張。測試圖像包括用于驗證及調試的測試圖像集test-dev、用于不同比賽和最新技術的測試圖像集test-standard、提交服務器的測試挑戰圖像集test-challenge 及避免過擬合的預留測試圖像集test-reserve。

Mapillary Vistas[31]數據集著重于大規模街道圖像,主要針對語義分割和實例分割任務。數據集包含25 000 幅高分辨率圖像和66 個目標類別,其中37 個類別使用多邊形細致標注單個實例,細致標注總量是Cityscapes 的5 倍,可用于實例分割。圖像由不同經驗的攝影師使用多種成像設備(手機、平板電腦、動作相機、專業拍攝平臺)拍攝,拍攝場景來自多變天氣、季節的世界各地,保證了數據集圖像細節和地理范圍的多樣性,豐富數據集為視覺道路場景理解提供了發展基礎。LVIS[32](Large Vocabulary Instance Segmentation)是Facebook AI research于2019年公布的數據集。目前實例分割訓練建立在目標類別少、單類樣本充分的數據集中,但實際應用場景下存在大量單類樣本不足的目標類別,針對小樣本訓練,LVIS 收集164 000 張圖像,對1 000 多個對象類別標注獲得220 萬個高質量的實例分割掩碼,構建大型詞匯實例分割數據集。相比于COCO數據集,LVIS 人工標注掩碼具有更大的重疊面積和更好的邊界連續性,更加精確的掩碼保證有較長的分類尾的情況下依然保持很好的訓練效果。

3.2 常用評價指標

公開大型數據集的產生為實例分割提供了網絡性能評價的標準,依賴于網絡適用場景的不同,指標常從網絡執行時間、運行內存占用、算法精度等多個方面考慮。其中執行時間的提出針對于近年來發展迅速的實時性網絡,算法精度因為客觀性和準確性依然是實例分割主流的評價指標。目前算法精度評價指標主要有PA[33](Pixel Accuracy)、mPA[33](Mean Pixel Accuracy)、IoU[33](Intersection over Union)及mIoU[33](Mean Intersection over Union)。其中,PA表示總像素與預測正確像素之比,mPA表示每類預測正確的像素總數與每類別總數之比求和的均值,IoU表示預測圖像掩碼和真實掩碼交集與兩部分和的比率,mIoU 表示每個類別IoU 求和的均值。

在實例分割過程中總計k+1 個分類,表示為{L0,L1,…,LK},且包含背景類別1。則評價指標公式如下:

Pii表示實際類別與像素預測類別都為i的數目,Pij表示實際類別為i的像素預測類別為j的數目,Pji表示實際類別為j預測類別為i的數目。

3.3 分析

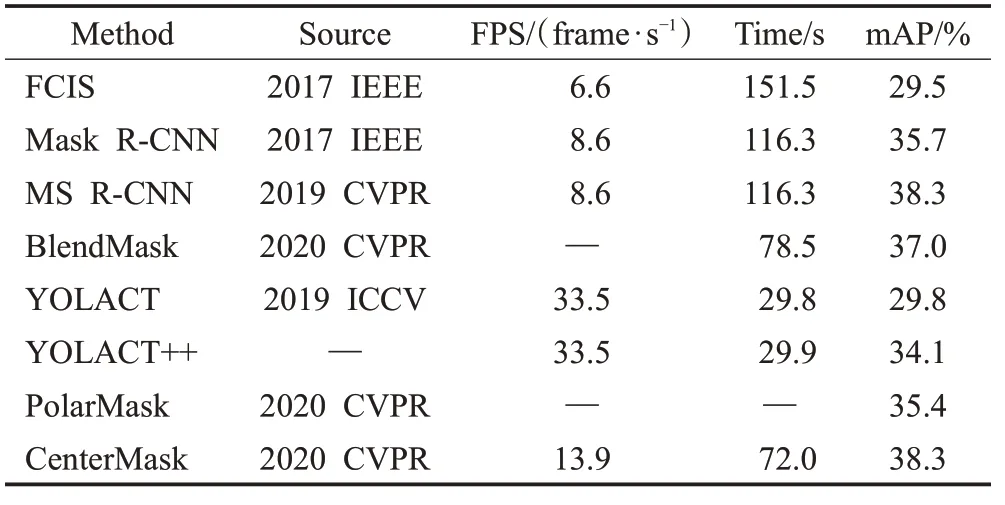

本文所述主要實例分割網絡在MS COCO 數據集上測試性能如表1 所示,其中FPS 指每秒幀數(frames per second)。

表1 網絡性能比較

由表1 可知,在現有的龐大數據集支撐下,為增加精度,以Mask R-CNN為代表的雙階段網絡增加全卷積分支、使用特征金字塔網絡增加主干網絡不同層次信息融合,利用不同卷積層特性增加網絡分辨率加強小目標檢測效果;以Mask Scoring R-CNN 為代表的網絡增加掩碼質量評價分支,通過對掩碼質量和分類結果的綜合評價實現精度提升;以BlendMask為代表的網絡結合了豐富實例信息和密集像素特征,以較小的計算保證實時性的同時提高檢測準確性。

以YOLACT為代表的單階段網絡參考單階段目標檢測網絡,使用主干網絡構建特征金字塔網絡獲取不同卷積層網絡信息,融合全局掩碼與掩碼系數分支并改進非極大值抑制方法,實現網絡實時性;以YOLACT++為代表的單階段網絡加入可變性空間卷積以適應不同尺度物體分割檢測任務,并加入掩碼評分分支校準掩碼得分實現網絡精度的提升;以PolarMask 為代表的單階段網絡將實例分割問題轉化為極坐標下選取實例中心并進行分類及密集回歸預測目標實例輪廓的問題,為掩碼表示方法提供新的思路。

基于以上分析可知,單雙階段實例分割網絡選用輕量高效網絡并追求特征表達穩定,但同時又具有不同的特性。雙階段實例分割網絡比單階段實例分割網絡具有更高的精度,主流的雙階段網絡框架靈活,在小目標檢測效果上體現出優勢;但同時由于分類和分割任務的時序性,雙階段網絡在實時任務上表現稍差。單階段實例分割網絡較少使用全卷積網絡分支,且去掉基于區域的時序步驟,整個網絡呈現輕量化的狀態,網絡實時性強可用于實時場景實例分割檢測任務;但同時對于小目標的檢測效果稍差。目前實例分割網絡改進主要從以下幾方面展開:(1)主干網絡的選擇更換。主干網絡實現圖像特征提取,是實例分割網絡的重要組成部分;以ResNet 為代表的網絡解決了網絡深度增加帶來的梯度爆炸問題,目前ResNet V2[34]、ResNeXt[35]等也可以應用到實例分割主干網絡部分,實現較小計算量下的網絡特征提取。(2)目標特征穩定表達。實例分割網絡引入特征金字塔網絡結構,將不同卷積層信息融合,解決同張圖像中不同尺寸目標處理問題,獲取不同分辨率以提高小目標的處理能力;加入可變性空間卷積解決角度變換、圖像長寬比變換的問題。(3)掩碼評分分支引入。在網絡結構中增加掩碼評價分支,校準預測掩碼質量和得分偏差,提升網絡精度。

4 總結與展望

基于深度學習的實例分割是計算機視覺領域的重要發展方向,快速處理數據并主動學習使得不斷更新的網絡朝著輕量、實時、精度高的方向邁進,在保持精度和運行速度的同時付出最小訓練代價、實現端到端處理并落地于實際應用。在目標檢測和語義分割發展促進下,實例分割作為計算機視覺領域的新任務取得一定成果,但仍然存在許多挑戰:

(1)小樣本任務。日常生活場景中存在大量單類樣本不足的目標,在樣本量不足的情況下難以獲得較好的訓練效果;小樣本學習旨在樣本不足的情況下對新樣本進行有效分割。最早的距離度量學習模型是孿生網絡,直接匹配學習樣本相似;更新的方法指利用元學習思路,學習結束的元分類器在新任務上僅微調參數即可實現分類任務。但目前小樣本目標檢測存在樣本類增多識別精度迅速下降等問題,實例分割領域的小樣本任務仍然存在空白。

(2)實時性場景任務。在無人駕駛、生物識別等實用場景下,保證實時性的同時要求網絡達到良好精度。YOLACT及YOLACT++標志著實時實例分割任務成為可能,多分支網絡及輕量化的網絡結構提升網絡速度,但相對于其他主流實例分割網絡精度有所下降。

(3)三維實例分割。相比于二維圖像實例分割,三維實例分割是解決端到端的分割問題,直接將點云作為輸入。PointNet[36]保持輸入點排列不變性,實現對三維點云的直接處理,為對象分類、部分分割到場景語義解析的應用提供了統一的體系結構。