基于融合像素點Gabor-Tetrolet的指關節紋識別

林 森, 王 媛

(1. 沈陽理工大學 自動化與電氣工程學院,遼寧 沈陽 110159;2. 遼寧工程技術大學 電子與信息工程學院,遼寧 葫蘆島 125105)

1 引 言

隨著社會信息化程度的不斷發展,信息安全對人類生活的影響愈發深入,如何準確識別一個人的身份,已成為模式識別領域的關注焦點。指關節紋識別是一種比較新穎的身份認證方式。與人臉識別[1-2]相比,指關節紋識別不受表情變化[3]等外部因素影響,其特征穩定性強;與指紋識別[4]相比,采集指關節紋特征的環境具有非侵犯性;與掌紋識別[5]相比,指關節紋接觸剛性物體少且特征不易被磨損;與指靜脈識別[6]相比,指關節紋的采集設備更簡易。因此,指關節紋逐漸成為生物特征識別技術研究中的前沿熱點,具有廣闊的發展空間[7]。

目前,基于指關節紋圖像的身份識別方法一般分為以下幾類:

(1)基于結構特征的方法。這種方法提取指關節紋的空間結構特征進行匹配識別。如文獻[8]利用細節點特征對指關節紋圖像進行恢復和匹配,有效地利用細節質量來提高指關節模式匹配的性能,但點特征數量較多,導致算法復雜度上升,線特征提取復雜,識別能力有限。

(2)基于子空間學習的方法。這種方法將指關節紋圖像通過投影或變換,轉化為低維向量或矩陣,并對指關節紋進行匹配識別。如文獻[9]利用復數局部保持投影(Complex Locality Preserving Projections, CLPP)來提取指關節紋圖像的低維特征,并利用正交復局部保持投影(Orthogonal Complex Locality Preserving Projections, OCLPP)的方法消除特征之間的冗余信息,但該方法受光照、噪聲等外部信息影響較大,應用范圍相對有限。

(3)基于深度學習的方法。這種方法用指關節紋圖片訓練卷積神經網絡模型,并對圖像進行分類、匹配。如文獻[10]通過主成分分析網絡(PCANet)提取指關節紋特征,采用線性多類支持向量機方法進行分類,建立分數級融合的多模態生物識別系統,該方法可取得較好分類效果,但目前指關節紋樣本量較小,難以支撐卷積神經網絡從參數隨機初始化開始訓練。

(4)基于紋理特征的方法。這種方法通過提取指關節紋的紋理特征參數對指關節紋進行分析。如文獻[11]將Log-Gabor濾波器應用于不同的灰度圖像,以此來減小特征向量的維數達到縮短計算時間的效果。紋理分析方法可以較好地描述指關節紋特征,符合指關節紋識別特性。因此,基于紋理特征的方法適用于指關節紋的識別。

綜上分析,本文利用指關節紋紋理信息豐富的特點,提出一種基于改進Gabor-Tetrolet的指關節紋特征提取方法,利用某點鄰域內的融合幅值特征代表該中心像素點的幅值特征,增強像素點之間的關聯性。綜合運用具有方向選擇性的Gabor小波濾波器和能夠較好表達圖像高維紋理特征的Tetrolet變換算法,獲取圖像的最優稀疏表示。根據指關節紋圖像的互功率譜計算識別準確率。結果顯示,所提方法準確性和魯棒性較好,在指關節紋識別領域具有優勢。

2 相關原理

2.1 改進的Gabor小波變換

指關節紋紋理的方向特征明顯,而Gabor小波變換能夠很好地提取圖像的局部空間信息,并且符合人類的視覺特性,故選取Gabor小波變換提取指關節紋的局部細微變化[12]。輸入指關節紋圖像,與Gabor核函數做卷積運算:

Fu,v(z)=I(z)*Gu,v(z),

(1)

其中:z為指關節紋圖像的像素點坐標,Fu,v(z)為所得特征圖像,u、v分別代表Gabor核的方向和尺度,Gu,v(z)為二維Gabor小波核函數[13],如式(2)所示:

(2)

Gabor核函數的實部與虛部響應表達式如式(3)、(4)所示:

(3)

(4)

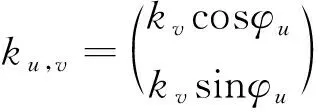

(5)

其中:Re(Fu,v(z))為Gabor特征Fu,v(z)的實部,Im(Fu,v(z))為Fu,v(z)的虛部。

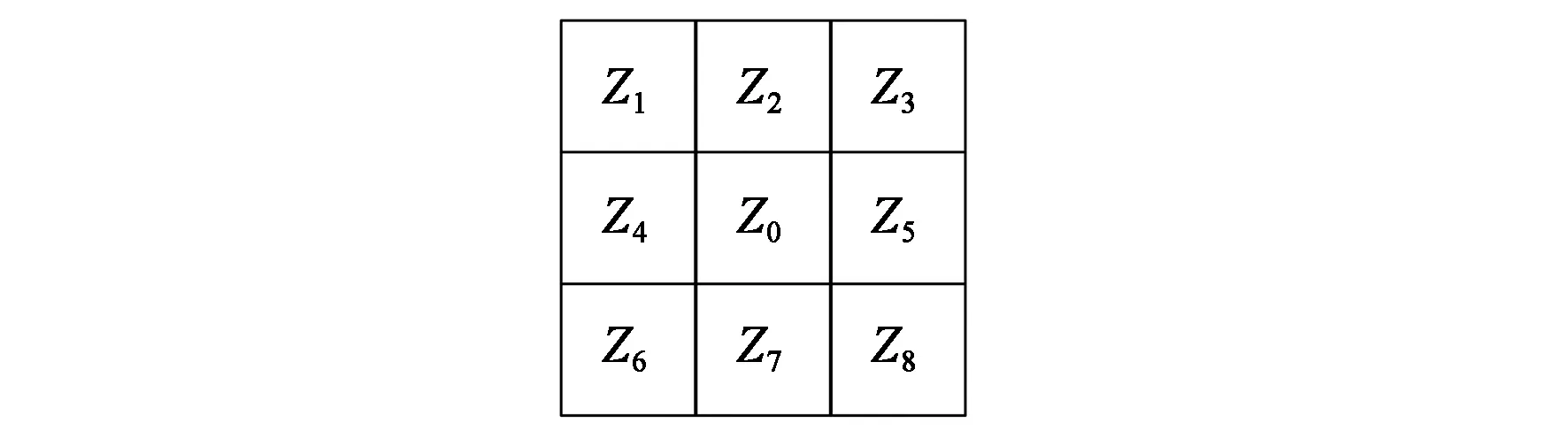

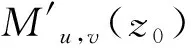

傳統的Gabor小波變換在獲取像素點的幅值特征時,忽略了像素點之間的關聯性,導致每個像素點的幅值特征相互獨立,不能較好地提取指關節紋的圖像特征。作為一種改進的Gabor小波變換,本文提出融合每個點的鄰域像素作為該點的幅值特征,構成相互之間具有緊密關聯性的新幅值特征。像素點z0及其3×3鄰域內像素分布如圖1所示。

圖1 z0鄰域像素點分布Fig.1 Neighborhood distribution of pixels z0

首先計算像素點z0周圍3×3鄰域內幅值特征的均值,并求取鄰域內8個像素點的均值;其次,將求得的均值特征與z0的幅值特征相加取平均,作為z0最終的幅值特征,計算公式如下:

(6)

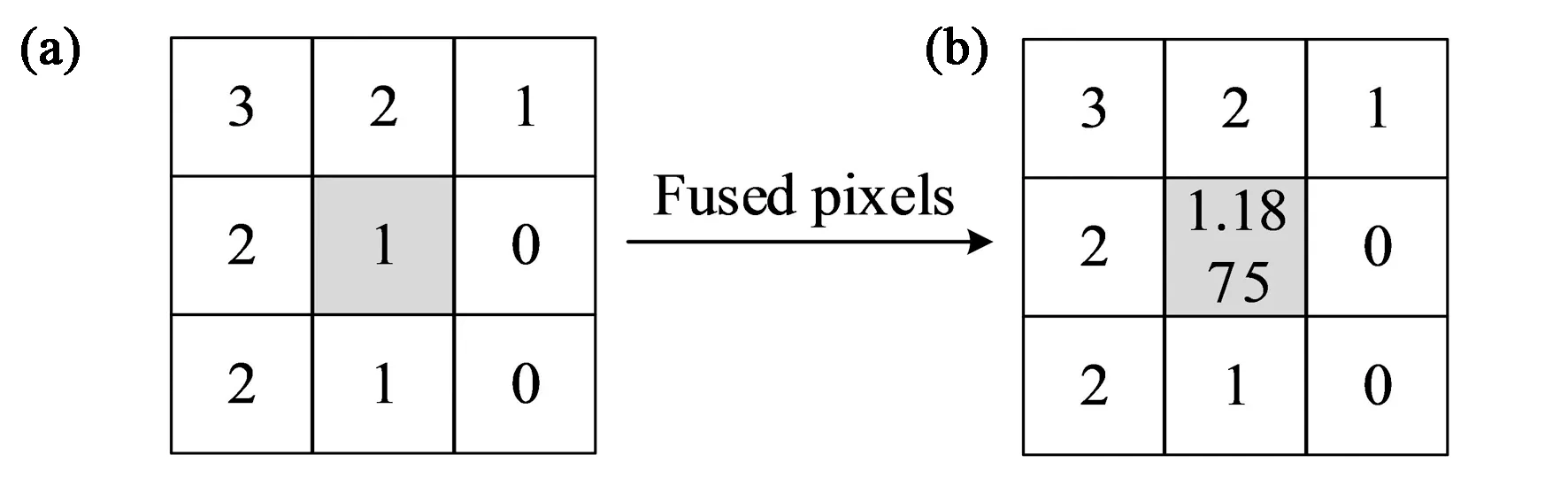

計算經融合像素點變換后的某點特征值時,為直觀顯示計算結果,假設任一點z0及其周圍鄰域像素點經原始Gabor小波變換后的幅值特征分布如圖2(a)所示。由式(6)計算出z0的幅值特征為1.187 5,變換后的z0點幅值特征如圖2(b)所示。經過融合像素點變換后,得到包含周圍鄰域像素點信息的幅值特征,增強了該點與周圍鄰域像素點的關聯性,便于經過下一步的Tetrolet稀疏變換。

圖2 像素點特征值。(a)變化前的特征值分布;(b)變化后的特征值分布。Fig.2 Pixel eigenvalue. (a) Distribution of eigenvalues before change; (b) Distribution of eigenvalues after change.

2.2 Tetrolet變換

Tetrolet變換是一種新的自適應Haar小波變換,對指關節紋的高維特征有較好的稀疏表示效果[14]。該變換將指關節紋圖像分塊,并對每個圖像塊進行拼版劃分。通過對劃分好的區域進行Haar小波變換獲取圖像的稀疏表示。具體變換步驟如下:

Step1:將輸入的指關節紋圖像分解成N個4×4大小的圖像塊Qi,j,i,j=0,...,N/4J-1,J∈Z。

(7)

(8)

Step3:根據式(9)選出最佳排列方式:

(9)

其中:c*為最佳排列方式,argmin為取最小值操作。每個圖像塊Qi,j中具有最佳排列方式的子帶為:

(10)

(11)

(12)

Step5:存儲重排后的低通子帶和高通子帶,并進行下一級變換。分解結束后,得到原圖像的最優稀疏表示圖像。

2.3 帶限相位相關

匹配時,采用計算量少、識別精度高的帶限相位相關算法進行圖像特征之間相似性的度量[15],設兩個指關節紋圖像c(m,n)和d(m,n),大小為M×N,C(u,v)和D(u,v)表示兩幅圖像的2D DFT:

(13)

(14)

其中:m=-M0,...,M0,n=-N0,...,N0(M0、N0>0),M=2M0+1,N=2N0+1,u=-M0,...,M0,v=-N0,...,N0,AC(u,v)和AD(u,v)是振幅分量,φC(u,v)和φD(u,v)是相位分量,D(u,v)和C(u,v)之間的交叉相位光譜RDC(u,v)為:

(15)

設指關節紋紋理的固有頻帶范圍是u=-U0,...,U0和v=-V0,...,V0,其中0≤U0≤M0,0≤V0≤N0。因此,有效光譜尺寸為L1=2U0+1和L2=2V0+1。BLPOC函數為:

(16)

其中:m=-U0,...,U0和n=-V0,...,V0。利用指關節紋圖像的帶限相位相關函數互功率譜作為相似性的度量。

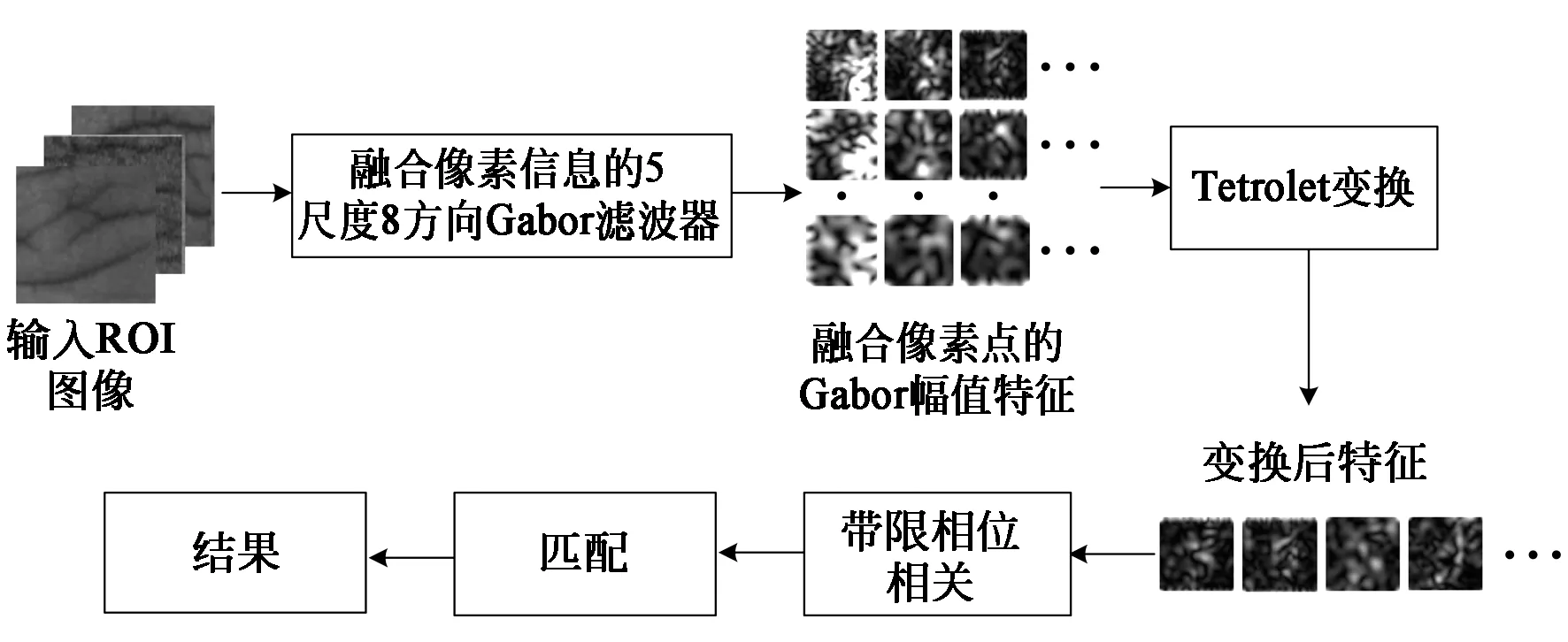

3 改進Gabor-Tetrolet的指關節紋識別

本文提出基于融合像素點信息的改進型Gabor-Tetrolet指關節紋識別方法。首先,將指關節紋圖像與融合像素點的5尺度8方向Gabor小波濾波器進行卷積運算,得到包含鄰域像素點信息的幅值特征,該幅值特征與周圍像素點具有關聯性,提升了特征提取的準確性;其次,將所得的多特征經Tetrolet變換獲取具有高稀疏性的特征圖像;最后根據帶限相位相關算法處理之后的互功率譜圖像進行識別率的計算。識別流程圖如圖3所示。

圖3 改進型Gabor-Tetrolet指關節紋識別流程圖Fig.3 Flow chart of improved Gador-Tetrolet finger-knuckle-print recognition

改進的Gabor-Tetrolet特征提取算法偽代碼為:

1 第一個像素點z0的坐標;

2 fori←1 tom×n;

3Fu,v(z)←I(z)*Gu,v(z);

5 forj←1 to 8;

7 end for;//計算每個像素點的幅值特征

8 forJ←1 to 2;

12 end for;//存儲2層Tetrolet變換后的低 通圖像特征。

4 實驗結果及分析

4.1 評價指標及實驗環境

實驗評價指標為識別率、識別時間及等誤率。識別率計算公式如下:

(17)

其中:WCRR代表識別率,VC為正確識別的樣本個數,VS為被測試樣本總數。WCRR值越大表明所求識別率越高,識別效果越好;反之,方法的性能較差。WFRR為錯誤拒絕率,WFAR為錯誤接受率,等誤率(Equal error rate, EER)為WFRR與WFAR的交點,根據交點設定閾值,當兩幅圖像之間的距離小于該閾值時判定為匹配。WEER的值越小代表方法性能越好。WFRR和WFAR的計算公式為:

(18)

(19)

其中:VNFR為錯誤拒絕次數,VNEA為類內測試總次數,VNFA為錯誤接受次數,VNIA為類間測試總次數。

實驗環境:CPU為Intel(R)Core(TM)i5-7300HQ CPU @2.50 GHz;內存為12.00 GB;Windows10,64位操作系統。實驗采用標準指關節紋數據集包括香港理工大學接觸式(PolyU-FK)[16]、非接觸式圖庫(PolyU-CFK)[17],印度理工學院圖庫(IITD)[18]及3個噪聲圖庫作樣本,圖庫示例如圖4、5、6所示。

圖4 PolyU-FK及其噪聲圖庫Fig.4 PolyU-FK and noise database

圖5 IITD及其噪聲圖庫Fig.5 IITD and noise database

圖6 PolyU-CFK及其噪聲圖庫Fig.6 PolyU-CFK and noise database

4.2 各數據庫上實驗結果及分析

4.2.1 香港理工大學接觸式圖庫實驗

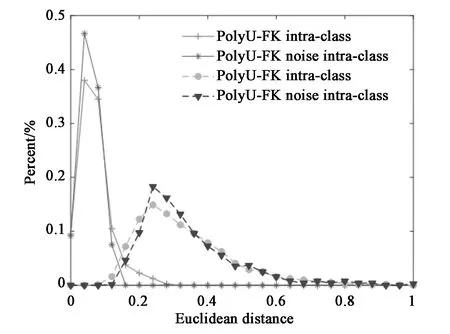

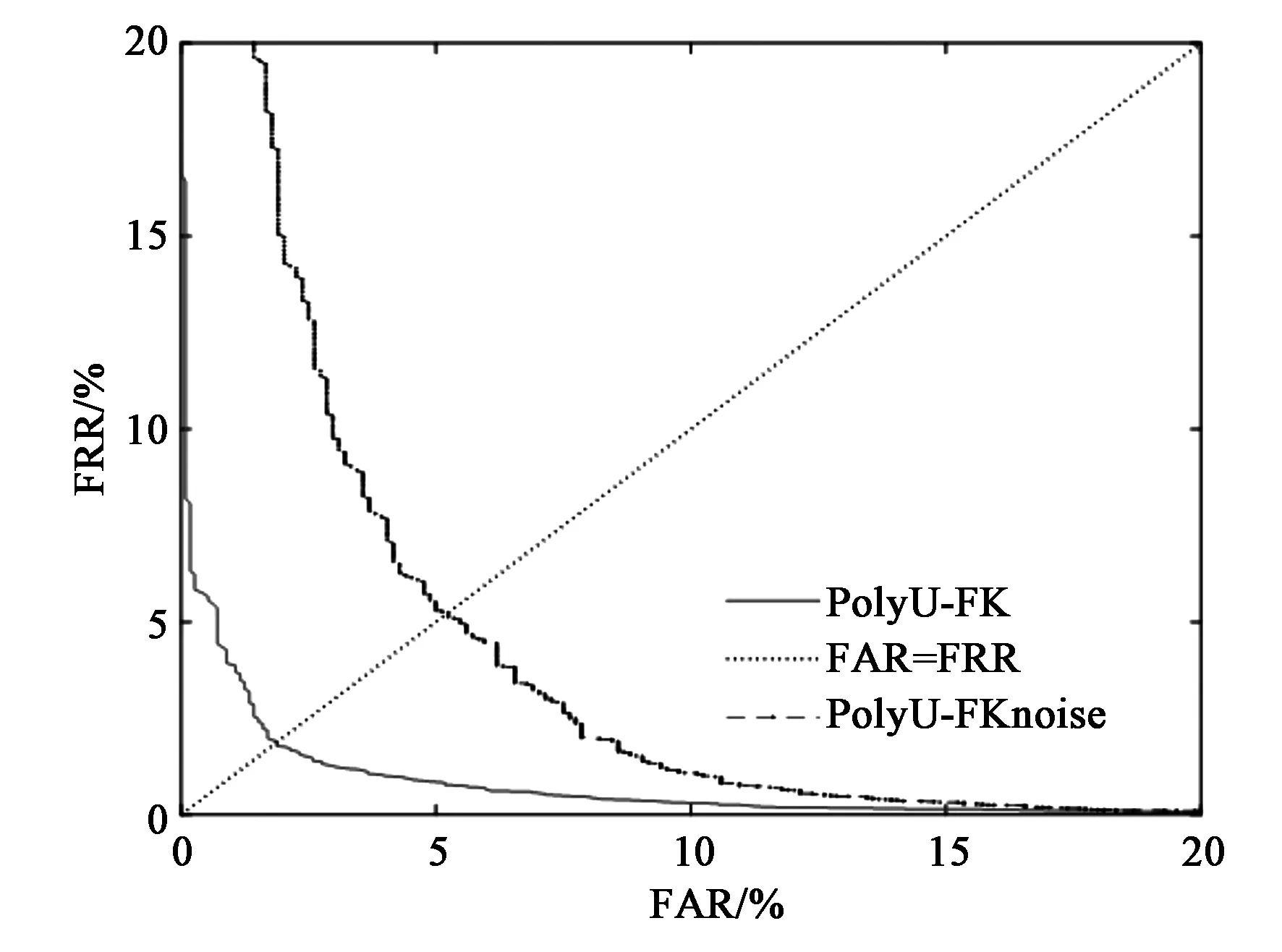

在PolyU-FK圖庫中選取前100個志愿者,每人6張指關節紋圖像,圖像噪聲選用高斯噪聲,以測試方法的抗噪性能。獲取等誤率的實驗中進行類內匹配3 000次,類間匹配359 400次,所得類內類間匹配曲線及受試者工作特征曲線(Receiver Operating Characteristic, ROC)如圖7、8所示。觀察類內類間匹配曲線可以看出,該方法可較好區分類內類間距離,在原圖庫及噪聲圖庫所得EER分別為1.8236%和5.0621%。

圖7 PolyU-FK及噪聲圖庫的匹配曲線Fig.7 Matching curves of PolyU-FK and noise database

圖8 PolyU-FK及噪聲圖庫的ROC曲線Fig.8 ROC curves of PolyU-FK and noise database

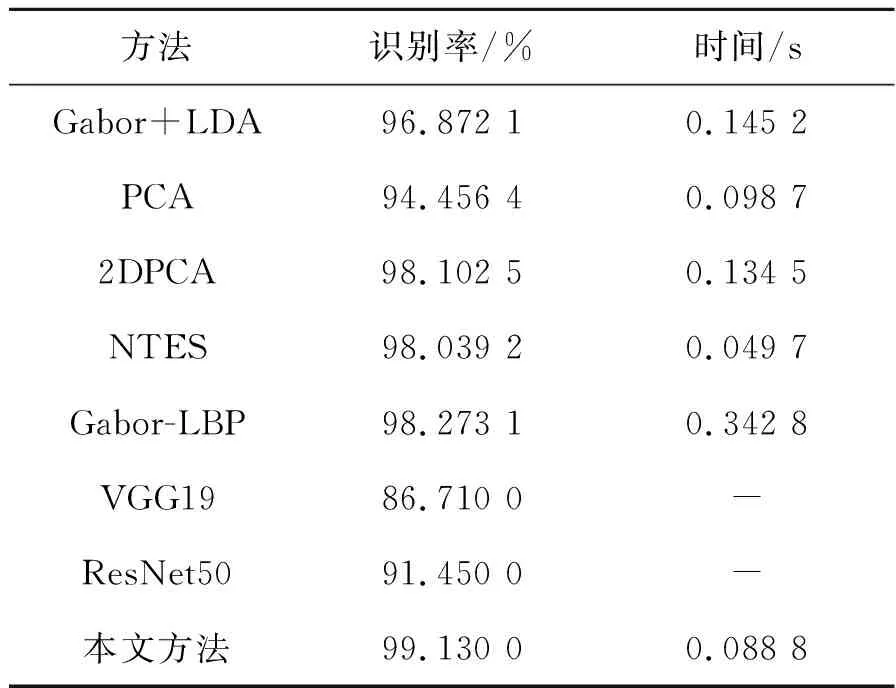

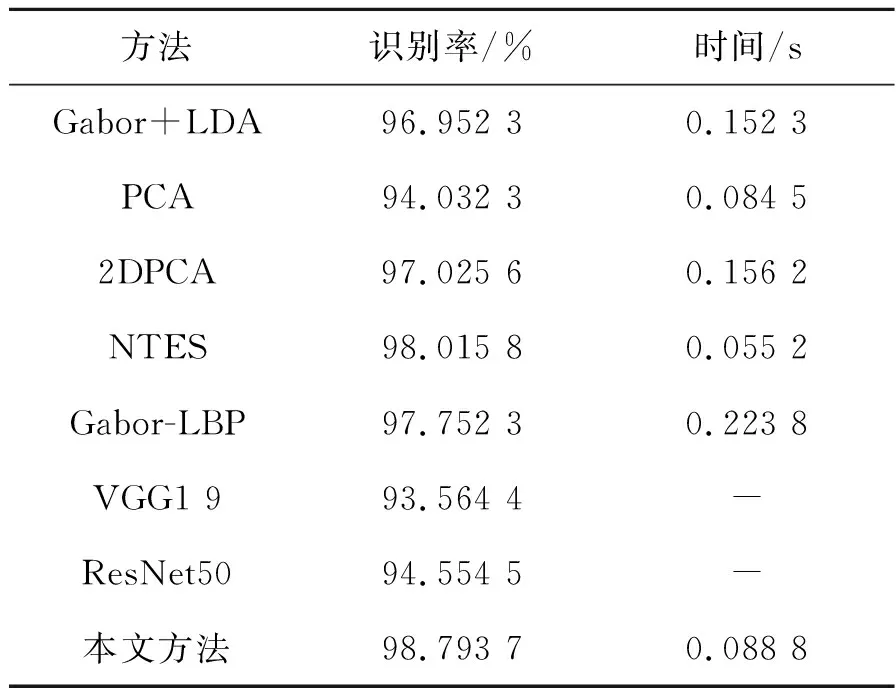

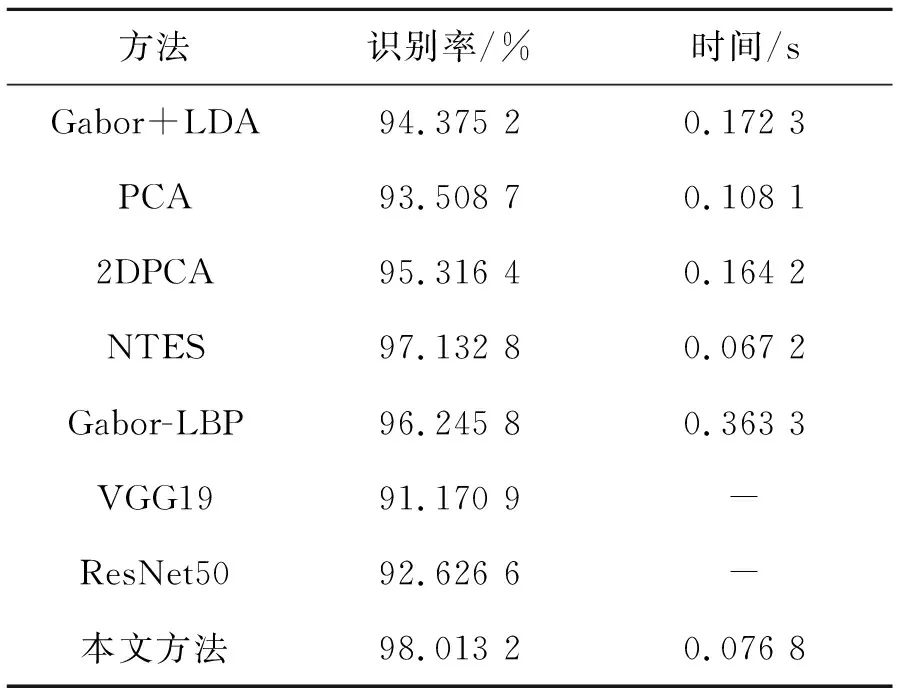

為檢驗所提算法的有效性,與其他方法進行對比,識別率、識別時間對比如表1、2所示。

表1 識別率與識別時間(PolyU-FK原圖庫)

表2 識別率與識別時間(PolyU-FK噪聲圖庫)

其中表1為在PolyU-FK原圖庫中的結果對比,表2為在PolyU-FK噪聲圖庫中的結果對比。對比方法包括Gabor+線性判別分析法(Gabor+Linear Discriminant Analysis, Gabor+LDA)、主成分分析法(Principal Component Analysis, PCA)、二維主成分分析法(Two-Dimensional Principal Component Analysis, 2DPCA)、基于NSST和Tetrolet的能量曲面方法(NSST and Tetrolet Energy Surface, NTES)、Gabor-局部二值模式(Gabor-Local Binary Patterns, Gabor-LBP)、基于VGG19、ResNet50網絡模型的方法。

4.2.2 印度理工學院圖庫實驗

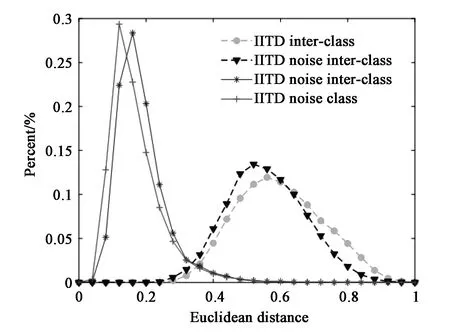

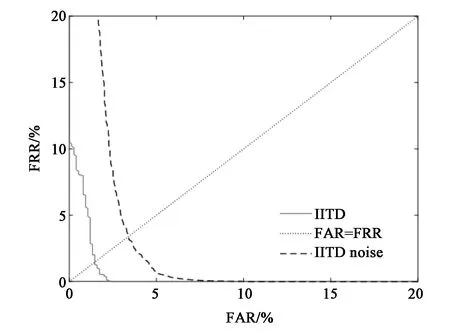

IITD指關節紋圖庫包含158個人,每人5張指關節紋圖像,實驗共進行類內匹配3 160次,類間匹配623 310次,所得類內類間匹配曲線及ROC曲線如圖9、10所示。

圖9 IITD及噪聲圖庫的匹配曲線Fig.9 Matching curves of IITD and noise database

圖10 IITD及噪聲圖庫的ROC曲線Fig.10 ROC curves of IITD and noise database

觀察匹配曲線可以看出該方法有效區分類內類間距離,在原圖庫及噪聲圖庫求得EER分別為1.4601%和3.5731%。

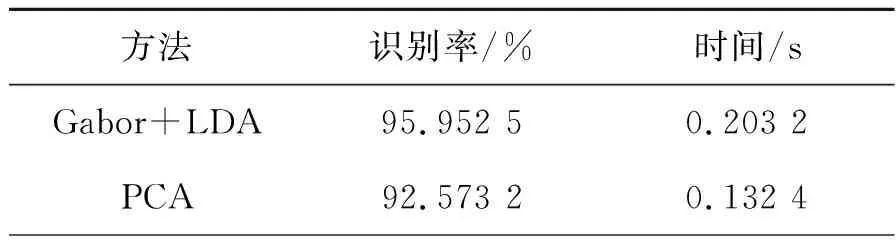

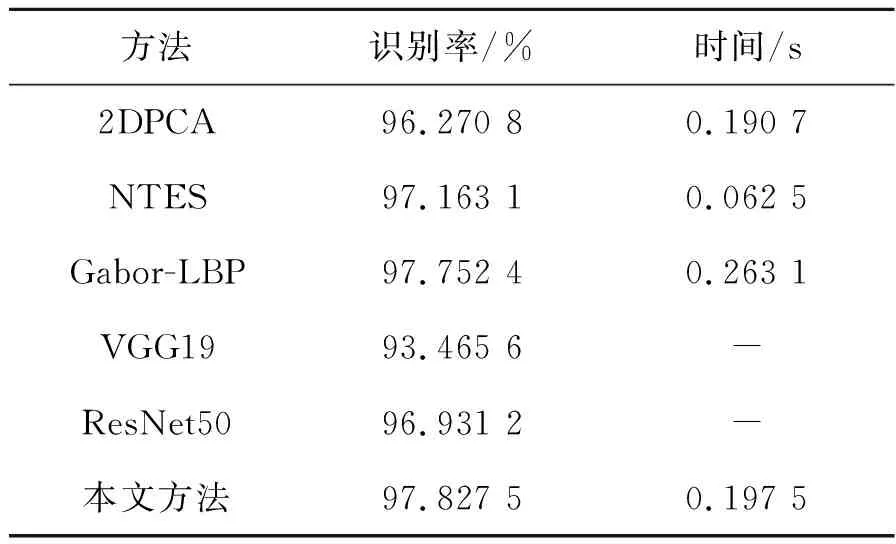

表3、表4為與其他方法在IITD圖庫及其噪聲圖庫上的正確識別率及識別時間。

表3 識別率與識別時間(IITD原圖庫)

表4 識別率與識別時間(IITD噪聲圖庫)

4.2.3 香港理工大學非接觸式圖庫實驗

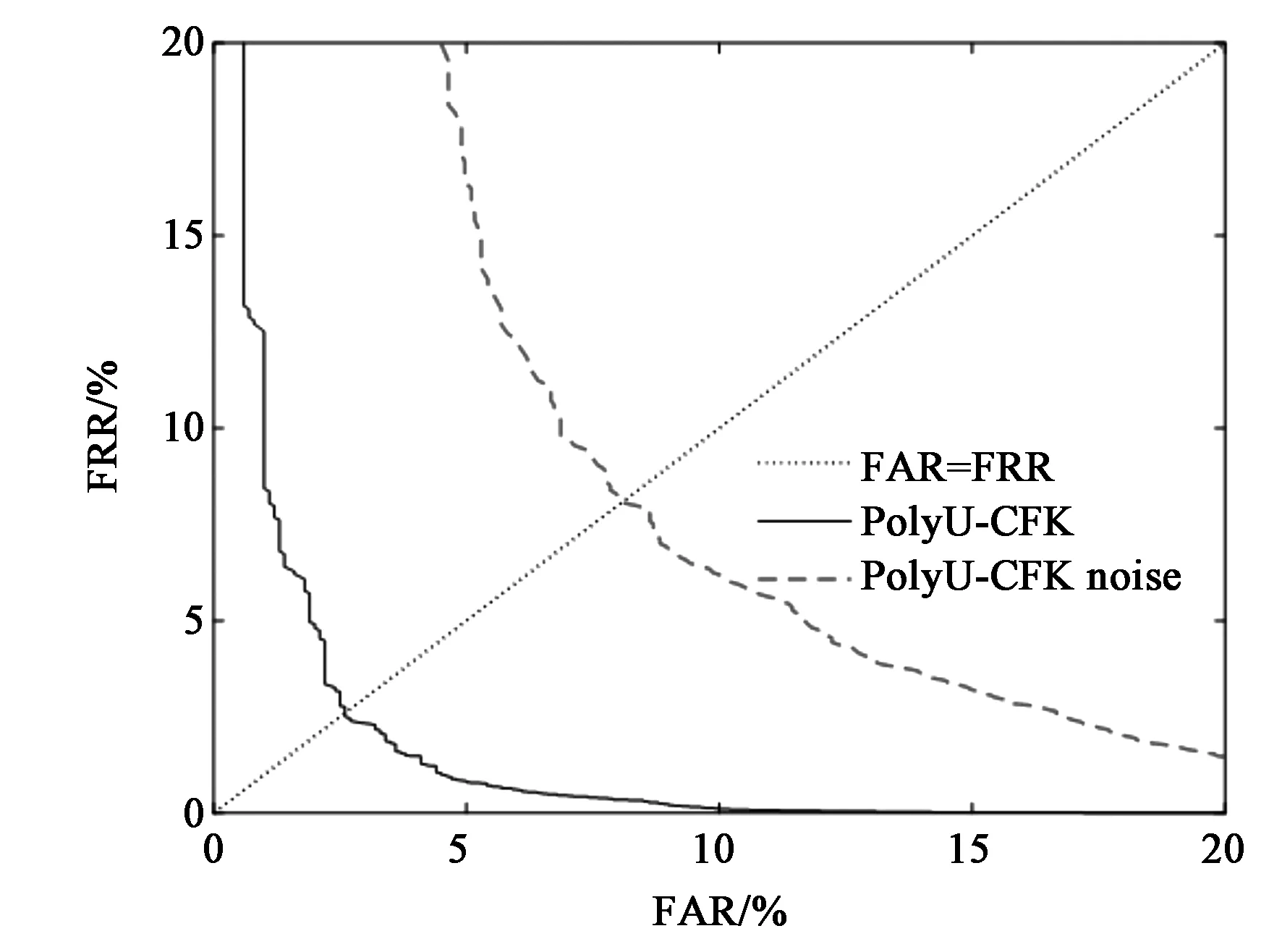

在PolyU-CFK指關節紋圖庫中進行類內匹配2 000次,類間匹配249 500次,所得類內類間匹配曲線及ROC曲線如圖11、12所示。

圖11 PolyU-CFK及噪聲圖庫的匹配曲線Fig.11 Matching curves of PolyU-CFK and noise database

圖12 PolyU-CFK及噪聲圖庫的ROC曲線Fig.12 ROC curves of PolyU-CFK and noise database

實驗表明,在原圖庫及噪聲圖庫所得EER分別為2.4169%和7.3124%。該方法與其他方法在PolyU-CFK原圖庫和噪聲圖庫中的正確識別率及識別時間如表5、表6所示。

表5 識別率與識別時間(PolyU-CFK原圖庫)

表6 識別率與識別時間(PolyU-CFK噪聲圖庫)

續 表

4.2.4 實驗分析

通過以上實驗可得,本文方法在原圖庫及噪聲圖庫中的識別率最高分別可達99.1300%和98.0327%,識別時間最短分別為0.043 2 s和0.076 8 s,等誤率最低分別為1.4601%和3.5731%,相較于其他傳統方法,所提方法在識別精確度方面明顯提升且識別時間較快。

其中,PCA、2DPCA等方法由于進行降維等操作,在特征提取時占用時間較長;Gabor+LDA、Gabor-LBP等方法忽略了各鄰近像素之間的關聯性,導致識別準確性不理想,而Gabor-Tetrolet變換綜合運用具有方向選擇性的Gabor小波濾波器和Tetrolet變換算法,根據指關節紋圖像的互功率譜進行匹配,識別效率優于Gabor+LDA/LBP方法;NTES雖然具有最短識別時間,但在進行圖像的去噪及稀疏處理時,圖像邊緣不能夠完全被表示,因此識別率的提高相對有限;標準卷積神經網絡(CNN)框架下的VGG19網絡結構為5個卷積組、5個最大池化層、3個全連接層和1個soft-max層,基于VGG19、ResNet50等網絡的識別方法由于對指關節紋的特征提取不充分以及計算參數量較大的問題,導致在分類效果方面不具優勢。而利用融合像素點的方法,可以獲取更為準確的指關節紋圖像特征,并將濾波后的指關節紋圖像特征經過具有高稀疏性的Tetrolet變換以獲取圖像的最優稀疏表示。匹配時,利用帶限相位相關算法提取指關節紋圖像的相位特征,根據兩幅圖像的互功率譜峰值進行匹配。實驗表明,所提算法有效提高了指關節紋識別精度,減少了運算時間,取得了較好的等誤率效果。

5 結 論

針對指關節紋紋理信息豐富的特點,考慮到指關節紋結構中紋線褶皺深淺與延伸方向不同,提出基于融合像素點Gabor-Tetrolet的指關節紋特征提取方法。運用具有方向選擇性的Gabor小波濾波器和能夠較好地表達圖像高維紋理特征的Tetrolet變換算法,獲取圖像的最優特征表示,并利用區分度較高的帶限相位相關算法計算識別準確率。在PolyU-FK、PolyU-CFK、IITD圖庫得到的識別準確率分別為99.1300%,98.8324%,98.7937%,最低等誤率為1.4601%,最短識別時間為0.043 2 s,識別率較其他算法有較大提升,準確性較高,在指關節紋識別領域具有優勢。