基于輕量級特征融合卷積網絡的圖像分類算法

陳鑫華,錢雪忠,宋 威

(1.江南大學人工智能與計算機學院,江蘇無錫 214122;2.江南大學物聯網技術應用教育部工程研究中心,江蘇 無錫 214122;3.江南大學 江蘇省模式識別與計算智能工程實驗室,江蘇無錫 214122)

0 概述

深度學習是機器學習領域的研究熱點之一,卷積神經網絡(Convolutional Neural Network,CNN)作為深度學習的代表算法,廣泛應用于計算機視覺、自然語言處理、信息檢索、圖像識別和分類等領域[1]。隨著網絡規模擴大,網絡結構越來越復雜,因此,需要設計更輕量級的網絡模型應用于深度學習的各個領域。

卷積網絡模型的輕量化改進主要有淺層壓縮和深層壓縮兩個方向。淺層壓縮通過網絡剪枝、量化、編碼等方式對模型進行壓縮。文獻[2]提出一種通道裁剪方法,通過判斷每層通道的靈敏度以逐層裁剪網絡模型,在VGG 網絡上參數壓縮了約80%,但通道裁剪是細粒度裁剪,能刪除大量通道并降低網絡性能。文獻[3]提出一種混合裁剪方法,結合核裁剪以及權重裁剪,通過對卷積核低秩分解,增加稀疏性以降低計算消耗,在精度降低很小的情況下,獲得較好的壓縮倍率,但稀疏網絡還沒有成熟的框架或硬件來支持,所以只能有限地提升速度。深層壓縮通過設計新的網絡模塊和改變網絡模型結構來達到輕量化的效果。IANDOLA 等[4]提出SqueezeNet,利用Fire module 對輸入通道進行壓縮和擴張,減少了整個模型的參數量。文獻[5]提出ShuffleNet,將輸入通道進行分組,并且為了加強各組間信息流通,提出混洗操作,將來自不同組的特征進行重新排列。MEHTA 等[6]提出EspNet,將標準卷積分解為1×1 逐點卷積和空間金字塔空洞卷積,不僅增大了感受野還減少了計算量。但是過多增加分組卷積會增大內存訪問成本,使得網絡結構更復雜,導致研究成本和時間成本增大,從而限制輕量級卷積網絡應用于移動設備。

本文提出輕量級特征融合卷積神經網絡MS-FNet。利用不同大小的卷積核對輸入特征圖進行處理,加入空洞卷積和瓶頸結構提取不同的特征,同時使用卷積層代替全連接層,以減少參數量并降低計算資源的消耗,提高網絡的分類精度和學習能力。

1 相關工作

傳統CNN 結構通過簡單的堆疊卷積層和池化層來實現,然后不斷加深網絡層數來達到較高的精度。但這樣的網絡參數量十分龐大,易產生過擬合現象,不利于應用,并且隨著網絡層數的加深,會發生梯度消失現象,網絡結構的優化也變得越來越困難。

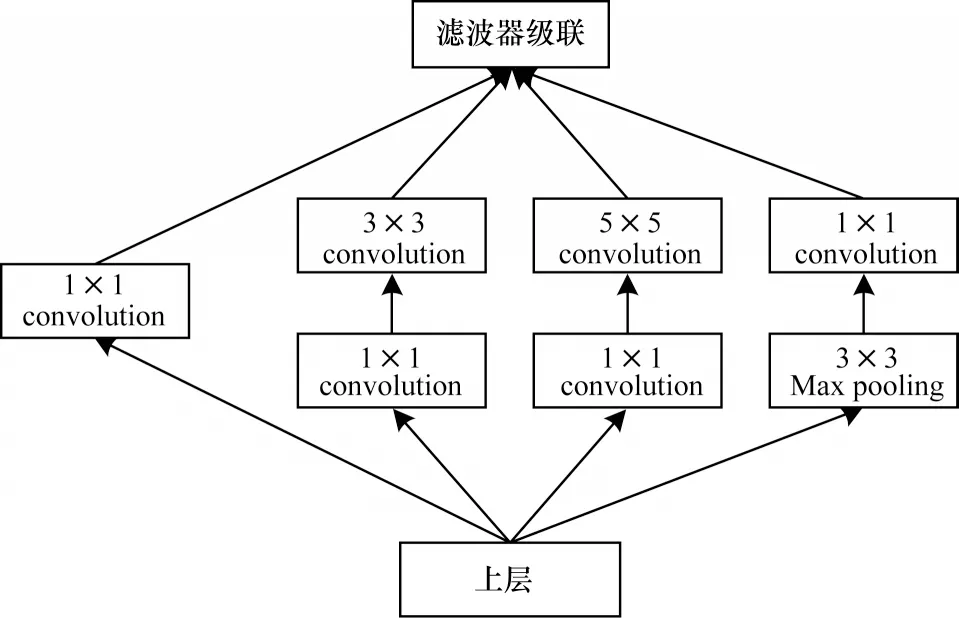

Inception 模塊結構[7]是GoogleMind 提出的一類高性能CNN,其特點是將傳統的卷積分解,使用不同尺度的卷積核來代替,將同一個輸入使用多種不同尺度卷積核來卷積運算,再將運算完成的結果進行合并輸出,利用特征融合獲得比單一卷積核更豐富的特征,在有限的計算資源下使網絡的深度和寬度得到擴充,也使網絡模型的分類結果更精確。Inception 模塊結構如圖1 所示。

圖1 Inception 模塊結構Fig.1 Structure of Inception module

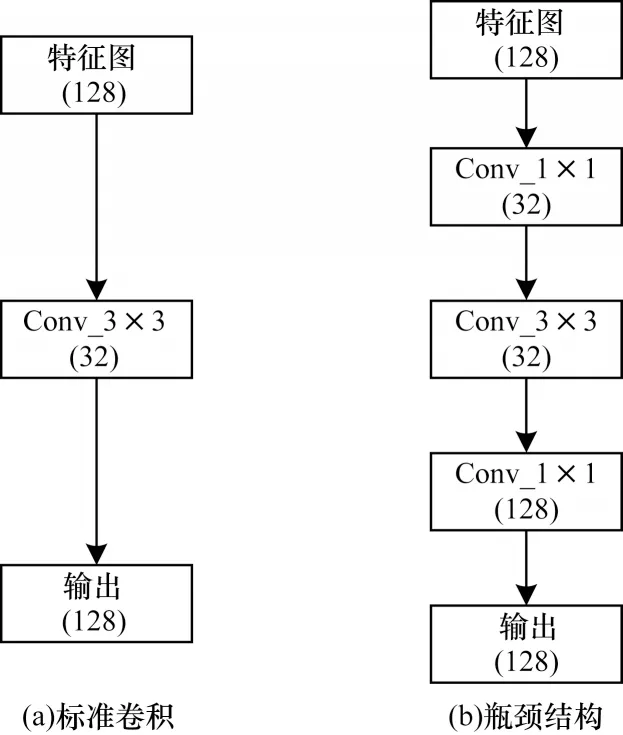

HE、HUANG[8-9]等提出在網絡模塊中引入1×1卷積層形成瓶頸結構,不僅能降低網絡參數量,還能提升網絡的計算效率。標準卷積層和瓶頸結構卷積層結構如圖2 所示。假設輸入輸出特征圖的數量N均為128,從圖2(a)可以看出,標準卷積層參數量P=128×3×3×128=147 456。從圖2(b)可以看出,瓶頸結構卷積層的參數量P=128×1×1×32+32×3×3×32+32×1×1×128=17 408。

圖2 標準卷積與瓶頸結構Fig.2 Standard convolution and bottleneck structure

通過計算可以看出,使用瓶頸結構計算的參數量約為標準卷積層參數量的1/8。由于瓶頸結構比標準卷積結構更深,網絡的非線性表達能力也更強,因此通過瓶頸結構既減少了網絡參數,又增加了網絡深度,提高了網絡的運行效率。

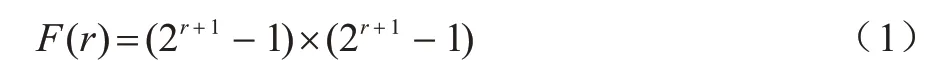

在CNN 中卷積層之后一般會對特征圖進行下采樣,導致信息丟失。針對這一問題,在網絡結構中加入空洞卷積[10],使得網絡模型參數和計算量不變的同時擴大感受野,提高網絡性能。空洞卷積patch尺寸如式(1)所示:

其中:超參數r為每個像素之間填充r-1 個空格。假設卷積核尺寸為k×k,空洞卷積步長為r,則相當于用于計算卷積的k2個數值分別從特征圖中相隔r-1的位置獲取,使得感受野從k×k變為k+(r-1)×(k-1)。空洞卷積其實是一種特殊的數據采樣方式,使數據采樣由密集變為稀疏,并不會改變網絡參數,而是改變了輸入數據的采樣方式。因此,空洞卷積可以在網絡模型中無縫使用,不需要改變網絡模型的結構,而且也不會增加額外的參數和計算量。

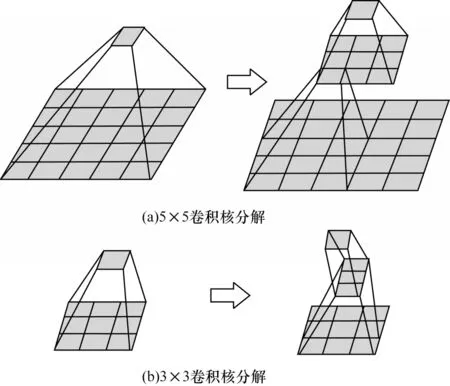

為加深網絡深度,SZEGEDY 等[11]提出卷積核分解思想,例如,將5×5 等大卷積核分解為2 個3×3卷積核,將n×n卷積核非對稱分解為1×n和n×1 的2 個連續卷積核。通過卷積核分解不僅能提升網絡的深度和寬度,而且有效降低了網絡的參數量和計算量。卷積核分解示意圖如圖3 所示。從圖3(a)可以看出,將5×5 卷積核分解為2 個連續的3×3 卷積核,由于5×5 卷積核有25 個參數,而2 個3×3 卷積核只有18 個參數,在達到相同卷積效果的同時,參數量降低了28%。從圖3(b)可以看出,將3×3 卷積核分解為1×3 卷積核和3×1 卷積核,3×3 卷積核有9 個參數,而分解后卷積核有6 個參數,在達到相同卷積效果的同時,參數量降低了33%。

圖3 卷積核分解示意圖Fig.3 Schematic diagram of convolutional kernel factorization

2 圖像分類方法改進

2.1 融合模塊結構

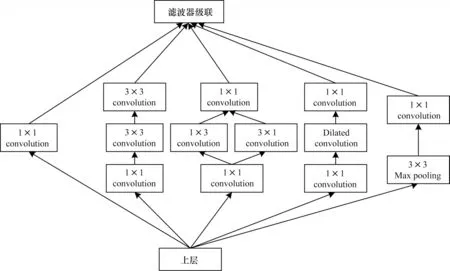

基于上述網絡模型結構,本文網絡基于Inception 架構的設計思路,采用模塊化設計,通過調整網絡模塊組件來增加卷積分支通道數以形成集成結構。因此,本文提出MS-FNet 網絡模型,解決了CNN 單個卷積核提取特征不豐富、網絡結構復雜、參數冗余的問題。融合模塊結構如圖4 所示。

圖4 融合模塊結構Fig.4 Structure of fusion module

在網絡設計中,網絡尺寸越大,參數越多,容易導致過擬合現象。文獻[12]提出如果把CNN 看作數據集的概率分布,那么將具有高度相關的輸出進行聚類可以構建最優的網絡結構。從圖4 可以看出,本文網絡融合模塊利用不同像素的特征來代表提取到不同的細節,然后將這些相關性較高的節點聚類連接到一起,相當于在多個尺度上同時進行卷積,搭建符合上述理論的多分支結構。在本文融合模塊中,一部分選取了2 個3×3 卷積核代替原來的5×5 卷積核;另一部分選取了3×3 卷積核,并分別用1×3 和3×1 卷積核進行替代,在每個卷積核前和池化操作后分別加入1×1 卷積核降低特征圖厚度。改進后模塊的每個分支選用不同卷積核進行處理,使提取的圖像特征更豐富,同時替代的卷積核在保證性能的同時能有效減少網絡參數。由于使用的卷積核尺寸較小,獲得感受野也小,因此通過引入空洞卷積來擴大感受野且不增加額外的參數。

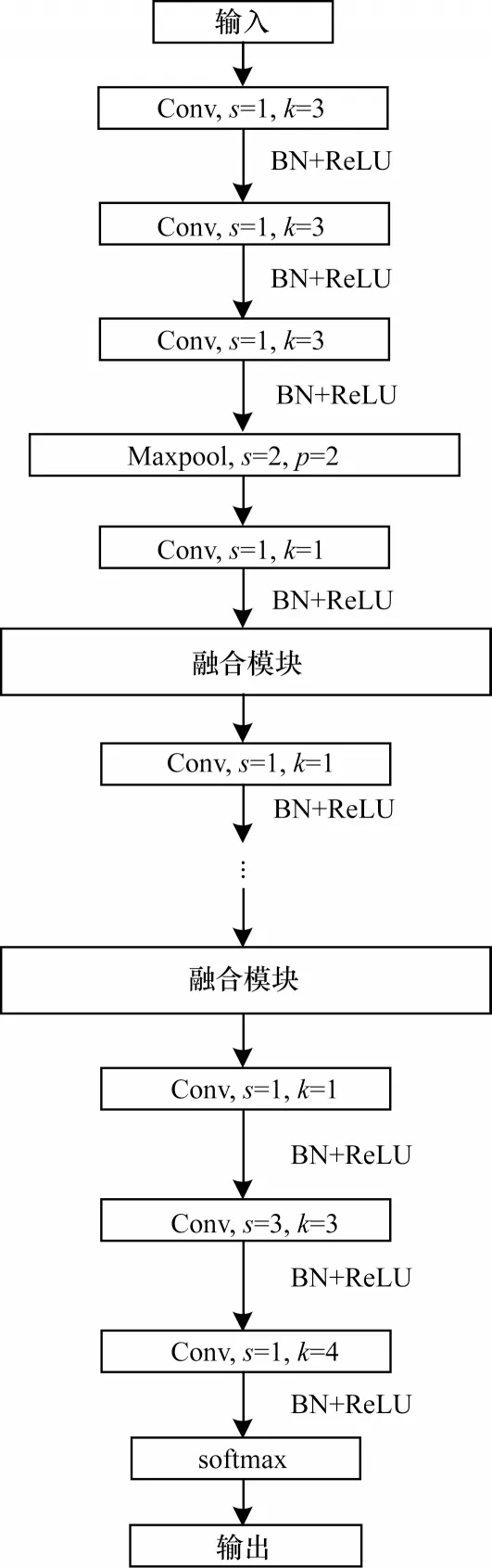

本文融合模塊的參數量F(i,n)和計算量Fl(i,n)如式(2)、式(3)所示:

其中:i為當前卷積核序號;n為卷積核個數;k×k為當前卷積核尺寸;Cin為輸入通道數;Cout為輸出通道數;Hi和Wi分別為輸出特征圖的高度和寬度。

2.2 全連接層處理

全連接層一般連接在CNN 的最后一個單層卷積層末端,這層的神經元與前一層所有神經元全部連接,其作用是整合網絡學習到的特征表達,然后全部輸入到分類器中,但會加大網絡參數使得網絡結構變得冗余,占據網絡中絕大多數的計算開銷。例如,VGG-16[13]網絡模型中全部參數約1.4 億,而全連接層中的參數有1.24 億左右,約占網絡所有參數90%,使得網絡模型參數冗余,易造成過擬合現象且效率低。

為解決這個問題,研究人員提出利用全局平均池化或卷積操作的方式來代替全連接層。全局平均池 化(Global Average Pooling,GAP)由LIN 等[14]提出,其原理是對于輸出每個通道的特征圖中所有像素計算一個平均值,經過GAP 后得到一個維度等于輸出類別數的特征向量,可以更好地將分類類別與最后一個卷積層的特征圖對應起來。雖然通過GAP降低了參數量,緩解了過擬合現象,但是將網絡訓練的壓力轉移到了前面的卷積層[15],減緩了網絡整體的收斂速度。另一種方法是使用語義分割任務中的全卷積網絡[16],該方法使用卷積層取代最后的全連接層,輸出一個特征圖,將特征圖轉換為原始輸入大小,通過上采樣實現分類。如果網絡最后是全連接層,輸入神經元個數是固定的,可以反推出上層卷積層輸出也是固定的,繼續反推可知網絡的輸入分辨率是固定的;如果使用卷積層代替全連接層,網絡中只有卷積層,則網絡的輸出分辨率隨著輸入分辨率而得出,輸出特征圖中每個像素點都對應輸入圖片的一個區域,保留了更多特征。由于卷積是局部連接,需要計算局部信息,全連接是計算全局信息,這樣可以減少計算量,使得網絡訓練更加高效。

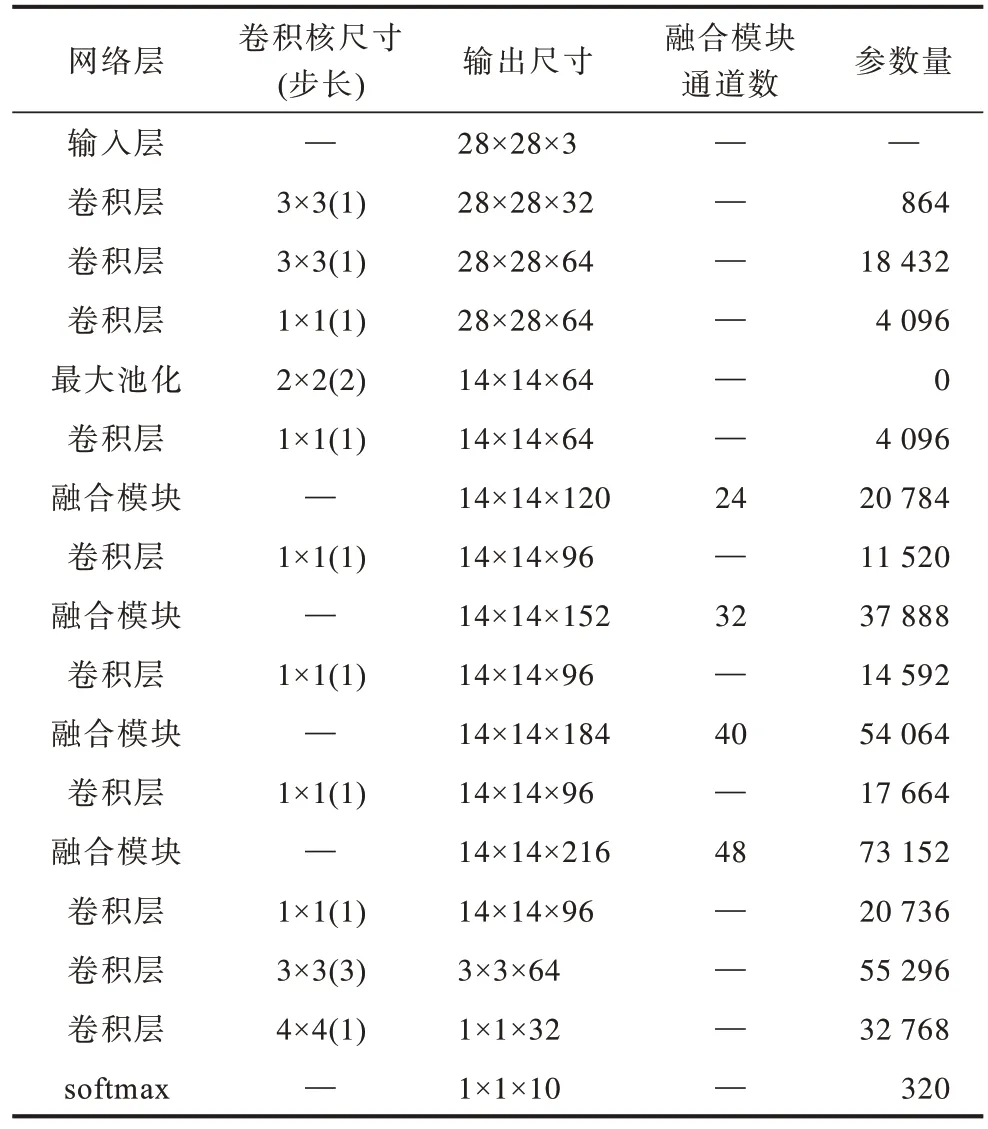

經初步實驗,網絡最后卷積層輸出特征圖尺寸為14×14×96,假設全連接層隱藏層節點為1 000,則使用全連接層的參數量約為1.8×107;當直接使用14×14 的大卷積核對輸入特征圖進行卷積操作后,參數量約為3.6×106,是全連接層的1/5,分類精度與全連接層相比提高1%左右;若將14×14 的大卷積核進行分解,使用3×3 和4×4 的小卷積核代替,則參數量約為8.8×104,是全連接層的1/200,分類精度與使用14×14 卷積核相比只損失0.3%左右,且收斂速度更快,網絡模型泛化能力更強。

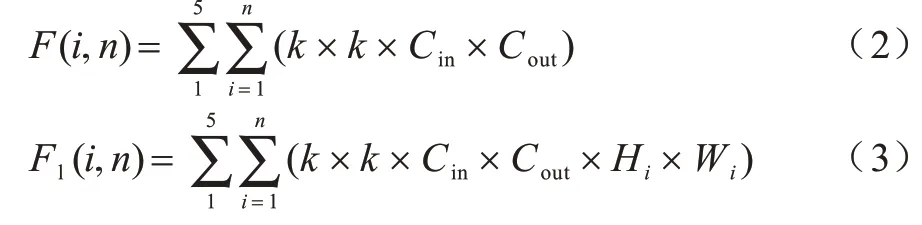

2.3 MS-FNet 網絡模型結構

MS-FNet 網絡模型結構如圖5 所示,采用模塊化設計方式將各模塊按照拓撲結構進行有序連接,最終形成整體結構。從圖5 可以看出,s表示步長,k表示卷積核尺寸,p表示池化窗口尺寸。首先,對網絡輸入進行卷積池化操作,將提取到的特征進行組合,從而增加下一層的輸出通道;然后,在每個融合模塊前后都使用1×1 卷積操作,對特征圖進行降維或者升維操作,同時使用很小的計算量增加了一層非線性層,增強了級聯操作后特征圖的空間信息交流,實現不同感受野特征通道之間的特征融合;最后,使用逐層卷積代替全連接層進行分類輸出。

圖5 MS-FNet 網絡模型結構Fig.5 Structure of MS-FNet network model

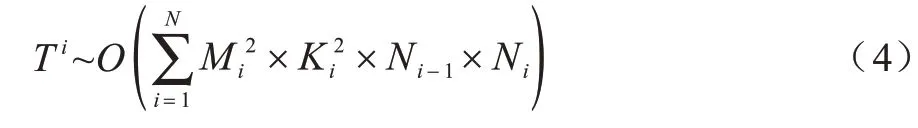

評價算法時間性能的主要指標是算法時間復雜度,假設本文MS-FNet 網絡模型輸入特征圖維數為n,則MS-FNet 模型整體的時間復雜度如式(4)所示:

其中:N為網絡的深度;i為第i層卷積層;M為輸出特征圖的尺寸;K為卷積核尺寸;Ni-1為前一層特征圖的維數;Ni為下一層特征圖的維數。

2.4 網絡收斂性分析

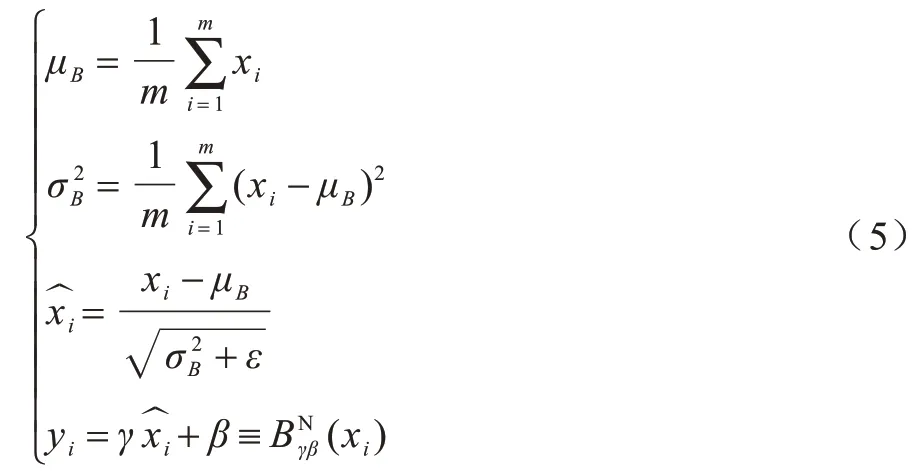

在每次卷積后都對特征圖進行批歸一化[16](Batch Normalization,BN)處理,經過BN 層的數據均值為0,標準差為1,降低了特征間相關性,使網絡輸出規范到正態分布,防止出現梯度爆炸或梯度消失現象,加快網絡收斂,緩解了網絡過擬合現象。批歸一化處理如式(5)所示:

其中:μB和分別為輸出特征圖的均值和方差;xi為特征圖的序號;yi為經過批歸一化處理后的輸出;γ和β分別為學習參數。

采用ReLU 激活函數來激活卷積層,使網絡收斂更快,防止梯度消失,增強特征稀疏性和非線性表達能力,其函數表示如式(6)所示:

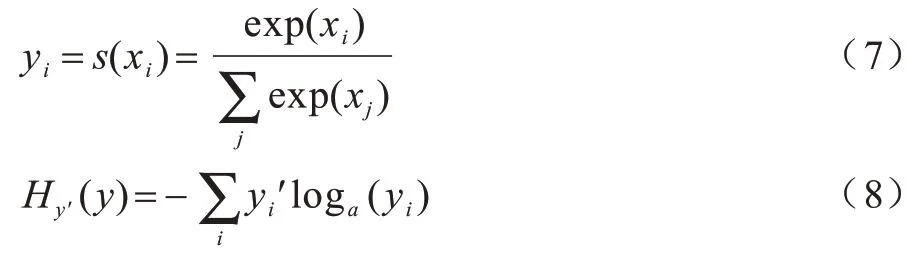

本文網絡模型使用交叉熵損失函數衡量預測值與真實值的誤差,首先對網絡最后一層輸出通過softmax 求出屬于某類的概率yi,然后將yi和樣本的實際標簽yi'做一個交叉熵,如式(7)、式(8)所示:

3 實驗與分析

本文實驗平臺為GTX1080Ti GPU,使用的深度學習框架為TensorFlow[17],分別在MNIST、CIFAR-10和CIFAR-100 數據集上進行測試,通過網絡的參數量和錯誤率來驗證本文MS-FNet 網絡模型的性能。

3.1 CIFAR-10 數據集實驗

CIFAR-10 數據集共60 000 張RGB 三通道圖像,尺寸為32 像素×32 像素,其中50 000 張圖像用于訓練,10 000 張圖像用于測試,數據集由10 類組成,每類均有5 000 張訓練圖像和1 000 張測試圖像。在模型訓練前,先對樣本進行預處理,對每張圖像進行隨機翻轉,設置隨機亮度變化和對比度變化,并且將圖像裁剪成28 像素×28 像素的尺寸,以提高樣本的利用率,使得樣本圖像既有隨機噪聲,還有數據增廣作用。在CIFAR-10 數據集上,采用batch 大小為128,使用Adam 優化器,學習率設置為0.001。

在CIFAR-10 數據集,本文MS-FNet 網絡模型參數設置如表1 所示。MS-FNet 網絡模型每層操作產生的總參數量約為370 000。

表1 MS-FNet 網絡模型參數設置Table 1 Parameters setting of MS-FNet network model

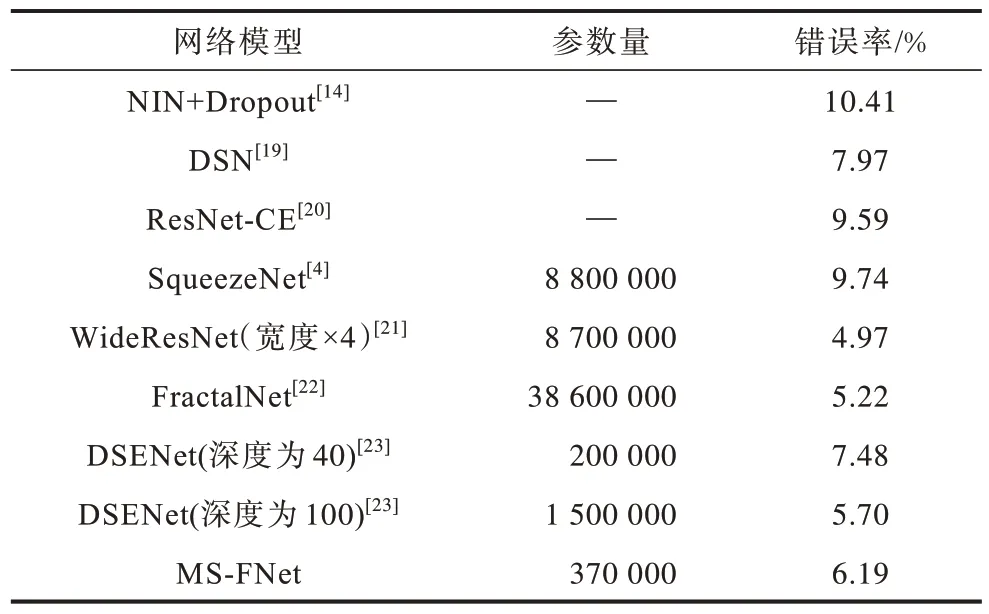

在CIFAR-10 數據集上MS-FNet 網絡模型與其他網絡模型的實驗結果對比如表2 所示。從表2 可以看出,在CIFAR-10 數據集上MS-FNet 網絡模型參數量僅 有 370 000,是 WideResNet 的 1/23,是SqueezeNet 的1/23,是FractalNet 的1/100。本 文MS-FNet 網絡模型的參數量遠低于傳統CNN 模型,而MS-FNet 網絡模型錯誤率只有6.19%。相對較低于其他模型,雖然WideResNet(寬度×4)和FractalNet的錯誤率更低,但是它們的參數量大于MS-FNet 網絡模型。與DSENet(深度為40)和DSENet(深度為100)相比,在錯誤率相對較低的情況下,MS-FNet 網絡模型大幅減少了網絡深度,簡化了網絡的復雜度。與經典網絡模型和一些最新網絡模型相比,MS-FNet 模型具有更好的分類精度和泛化能力。

表2 在CIFAR-10數據集上不同網絡模型的實驗結果對比Table 2 Experimental results comparison among different network models on CIFAR-10 data set

3.2 CIFAR-100 數據集實驗

CIFAR-100 數據集包含60 000 張RGB 三通道圖像,尺寸為32 像素×32 像素,包含100 類,這100 類由20 個超類擴展而成。每類分別包含500 張訓練圖像和100 張測試圖像。

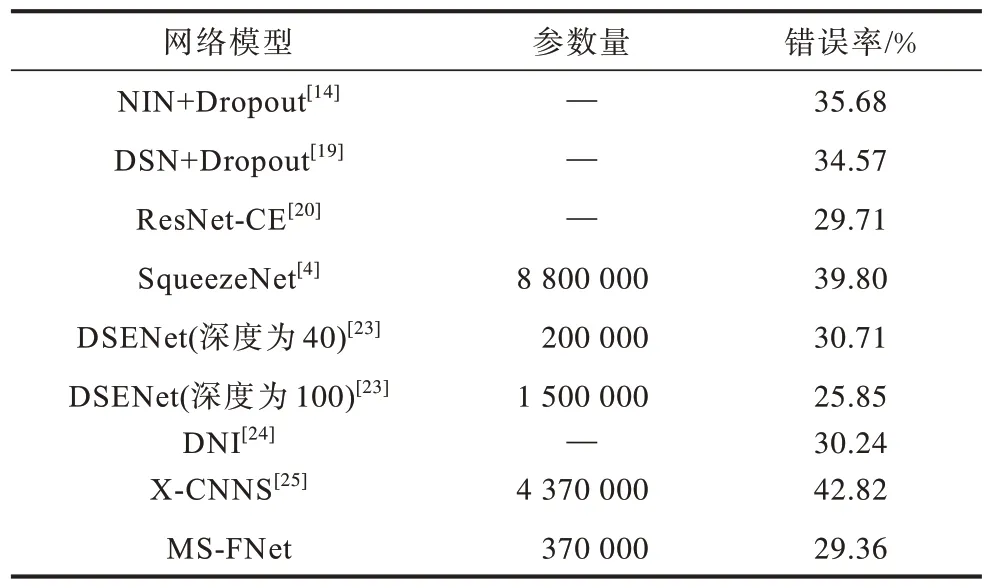

在CIFAR-100 數據集上網絡結構參數設置與CIFAR-10 數據集一致。采用的batch 大小為128,使用Adam 優化器,學習率設置為0.001。CIFAR-100數據集上MS-FNet 網絡模型與其他網絡模型的實驗結果對比如表3 所示。從表3 可以看出,MS-FNet 網絡模型的參數量是X-CNNS 的1/12,是DSENet(深度為100)的1/4,表明MS-FNet 網絡模型在達到相對較低錯誤率的情況下,減少了網絡的參數量。

表3 CIFAR-100 數據集上不同網絡模型的實驗結果對比Table 3 Experimental results comparison among different models on CIFAR-100 data set

3.3 MNIST 數據集實驗

MNIST 數據集是手寫數據庫NIST 的子集,數據集中包含手寫數字0~9,其中每類數字均有6 000 張訓練圖像和1 000 張測試圖像,每張圖像均為28 像素×28 像素的單通道圖像,共70 000 張圖像。由于MNIST 數據集較簡單,所以在MS-FNet 網絡模型的網絡參數設置上,減少了卷積層和融合模塊的數量,并且將特征圖通道數減小為單通道。采用的batch大小為50,使用Adam 優化器,學習率設置為0.0001。

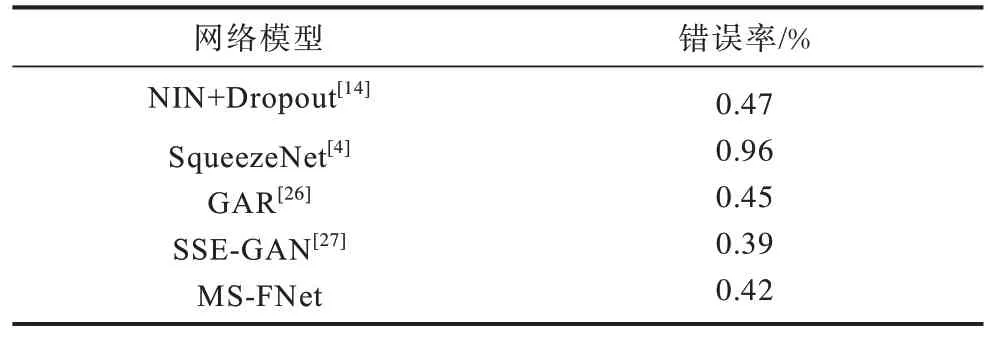

MNIST 數據集上本文MS-FNet 網絡模型與其他網絡模型的實驗結果對比如表4 所示。從表4 可以看出,本文MS-FNet 網絡模型的錯誤率僅0.42%,與其他網絡模型相比有所降低,說明本文MS-FNet網絡模型具有更好的分類能力。

表4 MNIST 數據集不同網絡模型的錯誤率對比Table 4 Error rate comparison among different network models on MNIST data set

3.4 消融實驗

本文MS-FNet 網絡模型的核心是瓶頸結構和空洞卷積,在MNIST 數據集上進行兩組消融實驗分別對它們進行比較并驗證。第一組驗證空洞卷積對MS-FNet 網絡模型性能的提升,第二組驗證瓶頸結構對MS-FNet 網絡模型性能的提升。

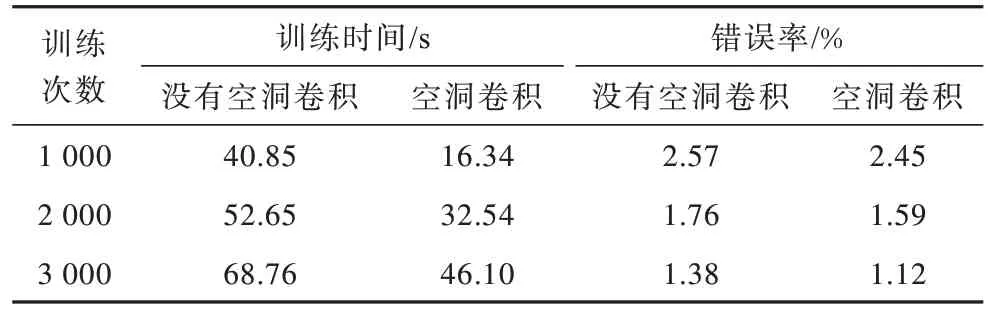

有空洞卷積和沒有空洞卷積結果對比如表5 所示。從表5 可以看出,在相同的實驗環境和迭代次數下,使用空洞卷積比不使用空洞卷積的訓練時間少,隨著訓練迭代次數增多,使用空洞卷積和不使用空洞卷積網絡模型的訓練時間都有所增加,錯誤率均下降,但是使用空洞卷積比不使用空洞卷積網絡模型的錯誤率略微下降。因此,在網絡模型中適當添加空洞卷積可以加快網絡模型的訓練速度,使網絡模型收斂快,從而提升網絡性能。

表5 有空洞卷積和沒有空洞卷積的實驗結果對比Table 5 Experimental results comparison of dilated convolution and without dilated convolution

使用瓶頸結構和不使用瓶頸結構的實驗結果如表6 所示。從表6 可以看出,在相同的實驗環境和迭代次數下,隨著訓練次數增多,使用瓶頸結構和不使用瓶頸結構網絡模型的訓練時間都有所增加,而錯誤率均下降,但是使用瓶頸結構網絡模型的訓練時間比未使用瓶頸結構略微減少,錯誤率也有所下降。因此,在網絡模型中適當添加瓶頸結構可以提升網絡模型訓練速度,并且降低網絡模型錯誤率。

表6 使用瓶頸結構和不使用瓶頸結構的實驗結果對比Table 6 Experimental results comparison of bottleneck structure and without bottleneck structure

3.5 網絡性能分析

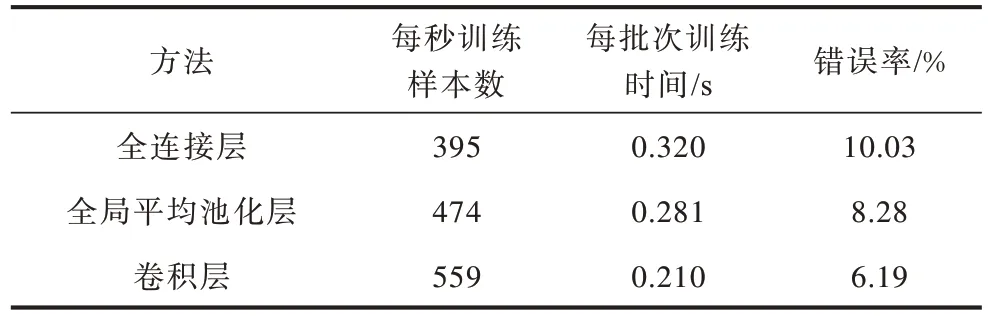

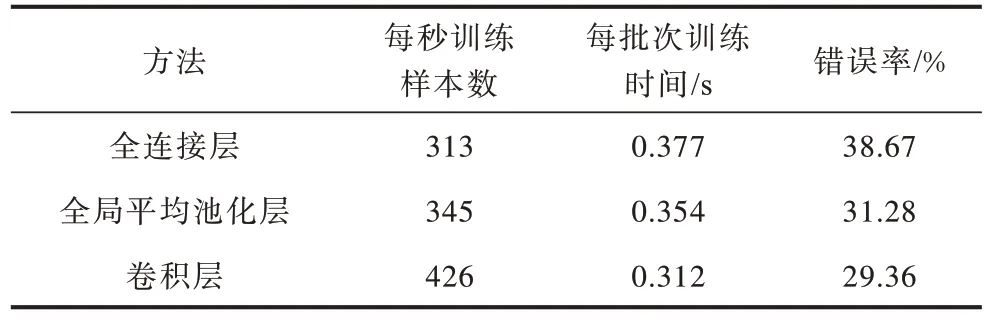

在CIFAR-10 數據集上不同方法的運行效率如表7 所示。在CIFAR-100 數據集上不同方法的運行效率如表8 所示。從表7 和表8 可以看出,在網絡最后采用卷積層的網絡模型每秒訓練的樣本數量最多,每批次的訓練時間最短,同時達到的錯誤率也最低。說明采用卷積層代替全連接層網絡模型的表現能力和學習能力更強。

表7 在CIFAR-10 數據集上不同方法的運行效率對比Table 7 Running efficiency comparison among different methods on CIFAR-10 data set

表8 在CIFAR-100 數據集上不同方法的運行效率對比Table 8 Running efficiency comparison among different methods on CIFAR-100 data set

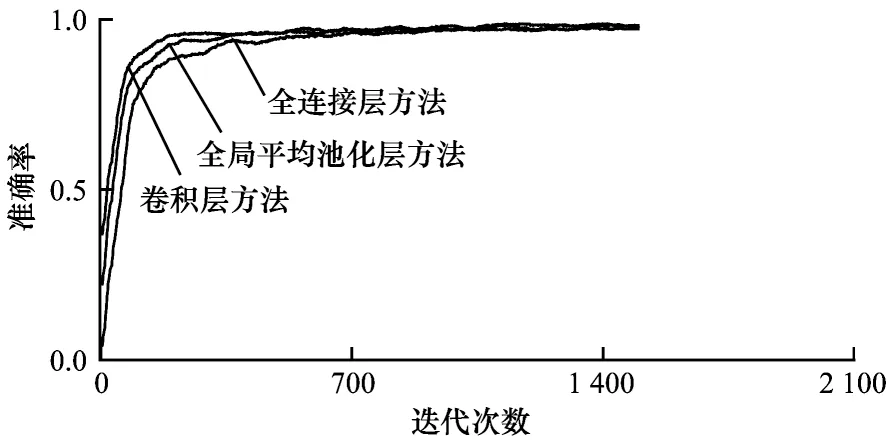

為了更直觀分析本文MS-FNet 網絡模型的網絡性能,在MNIST 數據集上全連接層、全局平均池化層和卷積層方法的準確率曲線如圖6 所示。從圖6 可以看出,隨著迭代次數增加,3 種方法的準確率都呈上升趨勢,但使用卷積層的準確率上升最快,最終達到的準確率也最高。全局平均池化層曲線比卷積層上升稍慢,但最終的準確率與卷積層接近。全連接層曲線上升最緩慢,且最終準確率值也最低。因此,使用卷積層代替全連接層的網絡模型能加快網絡的訓練速度,有效提升其準確率。

圖6 在MNIST 數據集上不同方法的準確率曲線Fig.6 Accuracy curves of different methods on MNIST data set

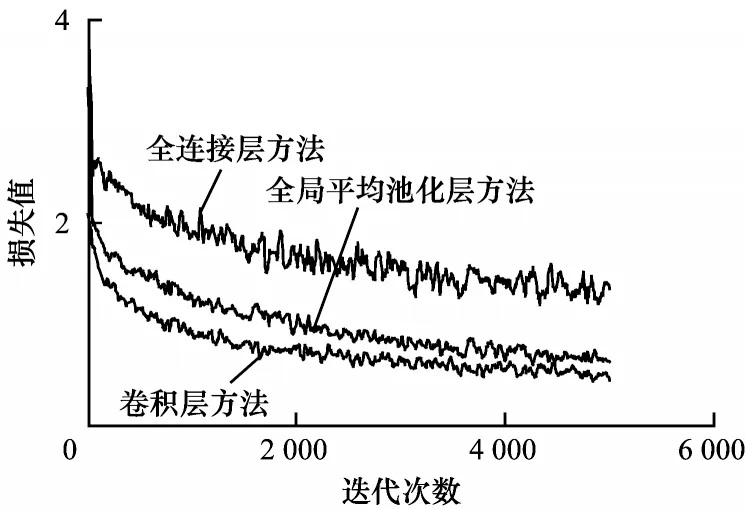

在CIFAR-10 數據集上用不同方法處理的MSFNet 網絡模型交叉熵損失函數曲線如圖7 所示。在網絡模型的最后分別使用全連接層、全局平均池化層和卷積層3 種不同方法。通過這3 種方法的損失函數曲線分析MS-FNet 網絡模型的收斂能力。從圖7 可以看出,隨著迭代次數的增加,3 種方法的損失函數曲線都趨于收斂,然而全連接層曲線收斂于較高位置,而且下降最慢,全局平均池化層曲線比全連接層曲線下降快,收斂數值也更小,卷積層曲線下降最快,比全局平均池化層曲線收斂更小的數值。因此,使用卷積層代替全連接層使MS-FNet 網絡模型收斂更快,效果更好。

圖7 在CIFAR-10 數據集上不同方法的交叉熵損失曲線Fig.7 Cross entropy loss curves of different methods on CIFAR-10 data set

4 結束語

針對CNN 參數多和網絡結構復雜的特點,本文設計輕量級特征融合卷積神經網絡MS-FNet。通過多個分支不同大小的卷積核提取不同尺度的特征,以增加網絡寬度并提高魯棒性,同時使用卷積層代替傳統的全連接層,減少網絡模型的參數量。實驗結果表明,MS-FNet 網絡模型結構合理,收斂速度快,在參數量遠小于對比CNN 模型的情況下,錯誤率較低且具有較強的泛化能力。后續將優化MS-FNet 網絡模型的參數設置,進一步提升網絡模型的學習能力。