基于卷積神經網絡的縱隔淋巴結良惡性分類研究*

程龍,秦航,余晶,蔣紅兵 ,宋寧寧△

(1.南京醫科大學附屬南京醫院(南京市第一醫院) 臨床醫學工程處,南京 210006;2.南京市急救中心,南京 210003)

引言

肺癌是發病率和致死率最高的癌癥之一[1-3],在我國,肺癌的5年生存率低于20%[4-5]。臨床治療時,醫生會依據患者當前的癌癥分期,制定不同的治療方案,并對療效進行評估。

縱膈淋巴結是否轉移與肺癌分期具有重要聯系,是臨床診斷中最受關注的一個方面。當排除遠處轉移的情況之后,確定是否合并有縱膈淋巴結轉移,對確定治療方案起到決定性作用。因此,縱膈淋巴結良惡性分類對于肺癌治療具有重大意義。

超聲彈性成像技術配合超聲內鏡引導下的經支氣管鏡針吸活檢術[6-8](endobronchial ultrasound-guided transbronchial needle aspiration,EBUS-TBNA)對肺門及縱膈腫大淋巴結診斷、肺癌分期等方面都具有提高診斷效率的作用。相關研究表明,傳統方法利用超聲彈性成像對縱膈淋巴結性質進行診斷時,計算超聲彈性圖像中藍色部分面積更具有診斷價值[9-10]。然而該方法需要手動勾畫縱膈淋巴結,然后計算目標淋巴結中藍色部分面積比例,來確定縱膈淋巴結的性質,工作量大,且準確率及效率依賴于臨床醫生的經驗。

目前,國內外采用深度學習的方法對縱膈淋巴結超聲彈性圖像進行分類的研究較少。國內上,王洪凱等[11]采用機器學習算法對PET/CT縱膈淋巴結性質進行了判定;徐少偉等[12]提出基于卷積神經網絡和注意力機制的兩步級聯的胸部CT縱膈淋巴結分割算法,通過引入醫學先驗和增強通道、空間多級特征來提高縱膈淋巴結分割性能。國外,Wang等[13]采用機器學習和深度學習算法對非小細胞肺癌的PET/CT縱膈淋巴結性質進行了分類;Wallis等[14]使用深度學習中的CNN網絡對PET/CT圖像的病理性縱膈淋巴結進行了識別;Choi等[15]使用生成對抗網絡對胸部CT圖像的縱膈淋巴結進行了分析;Wang等[16]比較了深度學習方法和四種機器學習方法對PET/CT圖像中的非小細胞肺癌(NSCLC)縱隔淋巴結轉移進行分類。

為提高準確率及效率,本研究提出一種深度學習方法,對縱膈淋巴結超聲彈性圖像進行自動分類。與傳統方法相比,該方法無需手動勾畫目標淋巴結和計算藍色部分面積,有效提高了診斷效率和診斷準確率,可作為臨床輔助診斷的重要工具。

1 數據預處理

1.1 圖像采集

本研究樣本均來自南京市第一醫院,共收集了2016年6月至2020年8月呼吸科提供的294例患者的369張縱膈淋巴結圖像,其中男性208人,女性86人,年齡從27歲到83歲。淋巴結通過EBUS-TBNA穿刺組織方法進行了良惡性標記。

1.2 圖像預處理

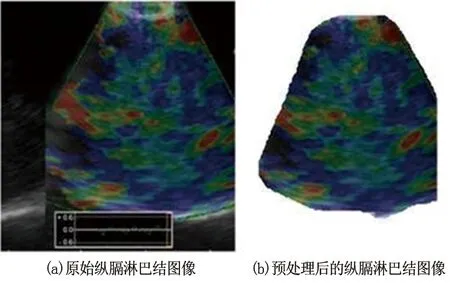

由EBUS-TBNA技術得到縱膈淋巴結圖像,經臨床醫師進行勾畫,得到感興趣區域(region of interest,ROI)。采用隨機裁剪的方式將圖像裁剪為224×224像素。圖1為圖像預處理前后的縱膈淋巴結圖像。將裁剪好的369張縱膈淋巴結圖像按照8∶2的比例劃分為訓練集與測試集,訓練集用來訓練深度學習網絡模型,測試集用來測試模型性能。

圖1 圖像預處理

2 算法設計

2.1 實驗設置

本研究采用PyTorch作為深度學習框架,使用Python3.8作為編程語言,在CPU為Intel(R) Core(TM)i5-7300HQ 環境下訓練,利用NVIDIA CUDA與cuDNN進一步加速運算。將算法學習率設置為0.0001,批量大小為4,Iteration為1 000。在每次訓練結束后將損失率與準確率記錄在CSV文件中,創建折線圖反映結果變化,根據該變化在訓練過程中調整超參數,以防止過擬合現象。

2.2 訓練模型

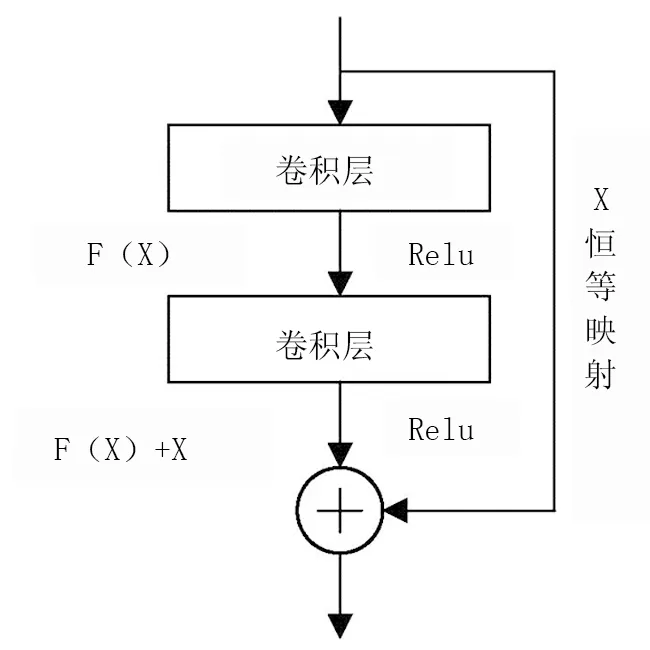

為解決卷積神經網絡中的退化問題,本研究采用的模型為殘差網絡(ResNet),運用殘差學習理論對卷積神經網絡進行改良,通過加入恒等映射與連續卷積結構形成殘差模塊以提取高維特征。圖2為殘差學習原理圖。

圖2 殘差學習原理Fig.2 Residual learning principle

因本研究數據較少,所以采用遷移學習方法,以防止過擬合。遷移學習采用的網絡模型為ResNet34模型,由一個7*7的卷積層、池化層,以及一系列3*3的卷積層搭成殘差網絡,最后由一個平均池化層與全連接層得到分類結果。

3 結果

3.1 訓練集損失

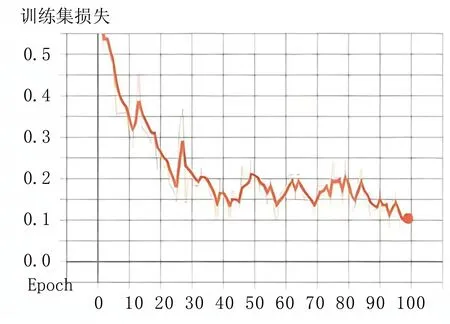

訓練集損失能夠反映出該分類模型在訓練集上的擬合能力,用于表示訓練集在模型中的預測結果與真實結果的誤差。使用ResNet模型進行訓練,得到最終的訓練集損失結果,見圖3。

圖3 訓練集損失Fig.3 Train loss

由圖3可知,訓練集損失呈逐漸下降趨勢,隨訓練次數的增加,下降趨勢逐漸變緩,最終在100個epoch左右波動。

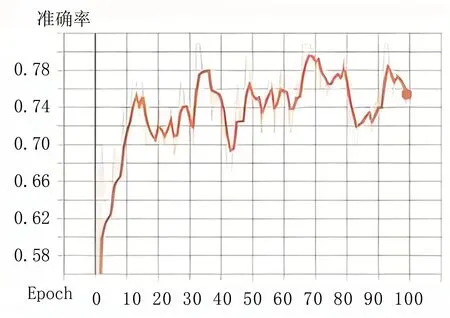

3.2 測試集準確率

測試集準確率可驗證測試集的準確性,是評價網絡效果的主要標準。使用ResNet網絡進行訓練,得到最終的測試集準確率結果,見圖4。

圖4 測試集準確率Fig.4 Test accuracy

由圖4可知,測試集準確率呈增加趨勢,在實驗初期準確率有顯著提高,當準確率增至60%時增幅減緩,隨后逐漸提高到75%左右開始小幅波動。

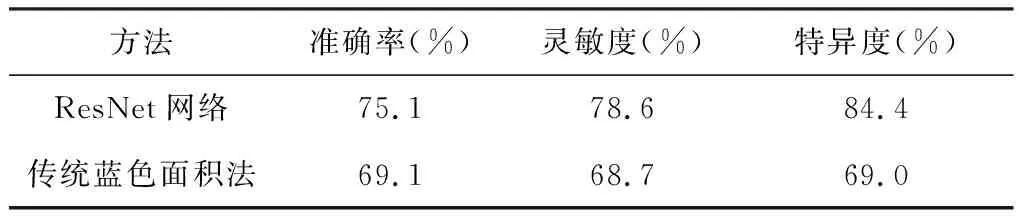

3.3 與傳統方法結果比較

傳統方法和深度學習方法均以EBUS-TBNA 穿刺病理結果作為縱膈淋巴結良惡性的診斷標準;若EBUS-TBNA 穿刺病理結果無法確定淋巴結的性質,后續手術病理、經驗治療和影像學隨訪需至少3個月,方可確定淋巴結的性質。

傳統方法通過計算圖像的藍色區域面積,利用SPSS Statics23軟件構建受試者工作曲線(ROC),尋找最佳截斷值,通過比較圖像藍色部分面積與最大約登指數,得出其準確度、靈敏度、特異度分別為69.1%、68.7%、69.0%。

本研究使用ResNet網絡對縱膈淋巴結圖像進行訓練,將369張圖片按照8∶2劃分為訓練集與測試集,以保證分類結果的客觀性,得到測試集準確度、靈敏度、特異度分別為83.3%、78.6%、84.4%。兩種方法對比結果見表1。

表1 兩種方法結果比較Table 1 Comparison of the results of the two methods

由表1可知,本研究準確率比傳統方法提高6%左右,可作為臨床輔助診斷的重要工具。而且深度學習分類模型能夠實現實時診斷,在做支氣管鏡檢查時可為醫生取樣提供重要參考。今后可通過擴大樣本量、提高圖像質量、優化深度學習算法等,以進一步提高分類的準確率。

4 結論

本研究利用ResNet網絡設計分類算法,相對于傳統計算藍色部分面積比例法,可得到最高87.7%,平均75.1%的準確率,高于傳統藍色部分面積法的69.1%,體現了深度學習在縱膈淋巴結的良惡性識別方面的優勢。然而,在使用卷積神經網絡對縱膈淋巴結進行分類時,還存在以下問題:

(1)樣本尺寸不統一。超聲彈性圖像樣本大小不一致,導致在選取裁剪框時,可能會出現關鍵信息丟失。

(2)樣本分辨率較低。樣本圖像整體清晰度較低、存在噪聲,圖像有效信息較原始超聲圖像低,在后期訓練時會產生較大誤差。

(3)樣本數量少。本研究共收集縱膈淋巴結圖像369幅,可能導致訓練的過擬合,致使訓練效果下降。

(4)網絡模型分類準確率不高。本研究所使用到的卷積神經網絡模型為ResNet34模型,可能存在冗余問題,影響網絡的訓練效果。

(5)訓練結果波動較大。ResNet網絡可以在測試集上實現最高為87.7%的準確率,而平均準確率卻只有75.1%,結果波動較大。

在后續工作中,考慮從以下幾個方面改進,以提高分類準確率:(1)進一步擴大樣本量。在患者進行超聲檢查時,多角度、多層次地對病患部位進行拍攝,以達到增加樣本量的目的;或與其他醫院進行合作,收集更多樣本,以達到更好的訓練效果。(2)直接從超聲系統中導出原始高清的超聲彈性圖像,再進行訓練,以提高分類效果。(3)重新規劃網絡結構,提高其特征提取能力,提升訓練效果。目前的研究主要是基于ResNet網絡的遷移學習方法,對于網絡本身架構并未進行太多改動,后續可通過加入其他卷積模塊,構建具有針對性、特異性的卷積神經網絡,以達到更理想的效果。