基于顯著性的多波段圖像同步融合方法

余 東,藺素珍,祿曉飛,李大威,王彥博

基于顯著性的多波段圖像同步融合方法

余 東1,藺素珍1,祿曉飛2,李大威3,王彥博1

(1. 中北大學 大數據學院,山西 太原 030051;2. 酒泉衛星發射中心,甘肅 酒泉 735305;3. 中北大學 電氣與控制工程學院,山西 太原 030051)

針對多波段融合圖像存在對比度低、顯著目標不突出的問題,本文提出了一種基于顯著性的多波段圖像同步融合方法。首先,近紅外圖像被用來作為數據保真項,紅外圖像和可見光圖像分別為融合結果提供紅外顯著信息和細節信息;其次,基于視覺顯著的紅外顯著區域提取方法被用來構造權重圖,以克服融合結果顯著區域不突出和邊緣模糊問題;最后,采用交替方向乘子法(alternating direction method of multipliers, ADMM)來求解模型,得到融合結果。研究結果表明,較于代表性圖像融合算法,所提算法能在保留紅外圖像熱輻射信息的同時,保有較好的清晰細節,并在多項客觀評價指標上優于代表性算法。

圖像融合;多波段圖像;顯著性;全變分

0 引言

鑒于單個傳感器提供信息的有限性,多個不同類型的傳感器被用于同一場景同一時刻的數據采集,以獲得全面、準確的場景信息。然而,傳感器的增加卻導致了“信息過載”。圖像融合技術在整合互補信息和減少冗余方面發揮著重要作用。其大致可分為:基于空間域方法[1]、變換域方法[2]、深度學習方法[3-4]。空間域方法通常是利用平均或最大權重策略產生融合結果,但是會丟失許多細節。基于變換域的方法通常是將源圖像分解,然后手動設計不同的融合規則以分別融合不同層信息,最后重建得到融合結果。常用的多尺度變換的方法包括基于金字塔的算法[5]、基于小波的算法[6]、曲波變換[7]和非下采樣輪廓波變換[8]。但是如何選取合適的分解方法和融合規則仍然是一個棘手的問題。近年深度學習被廣泛應用于圖像融合領域[9-11],但其計算復雜度高,需要大規模數據和強大的硬件支持,可解釋性弱,不確定性強,這嚴重減緩了深度學習方法在圖像融合中的進展。

近十年來,基于優化模型的方法被廣泛用于圖像領域。這些方法不需要大量樣本來訓練或學習,并且可以在低性能硬件上運行。盡管基于優化模型的方法在圖像融合方面取得了進展[12-13],但仍有一些方面需要改進。文獻[14-15]中,數據保真項只和紅外圖像相關,因此融合結果背景更加近似于紅外圖像。盡管它使用了正則項來盡可能多地保留可見光圖像的細節信息,但可能會丟失可見光圖像中的顯著信息和對比度信息。在文獻[16]中,雖然已經針對顯著目標的提取的能量函數進行了改進,但是僅僅只是選擇紅外圖像和可見光圖像像素高的作為顯著區域,所起到的作用有限。

為了解決這些問題,本文提出一種基于全變分的多波段圖像同步融合模型。首先,采用近紅外圖像作為數據保真項,紅外圖像和可見光圖像來分別為融合結果提供細節信息和顯著信息,以此建立多波段圖像同步融合模型;其次,用基于視覺顯著的紅外顯著區域提取方法來構造權重圖,以克服融合結果顯著區域不突出和邊緣模糊問題。最后,采用ADMM求解模型得到融合圖像。

1 基于顯著性的多波段圖像同步融合方法

1.1 多波段同步融合模型的建立

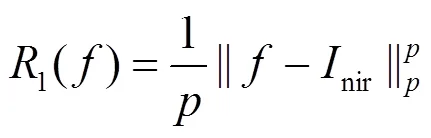

考慮到紅外圖像的成像原理與熱輻射有關,而可見光圖像成像原理則與光的反射有關。近紅外圖像的成像波段介于兩者之間,所以成像結果包含熱輻射和光反射的元素。故本文將近紅外圖像作為數據保真項,并依靠紅外圖像為其提供顯著信息,通過可見光圖像為其提供更加豐富的細節信息。則所建立的保真項可表示為:

式中:為融合結果;nir為近紅外圖像;表示采用的范數類型。

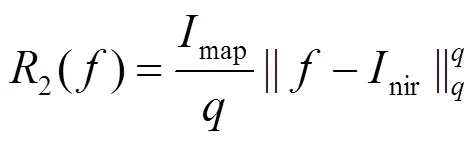

所建立的顯著區域保真項可表示為:

式中:map為顯著區域權重;ir為紅外圖像;表示采用的范數類型。

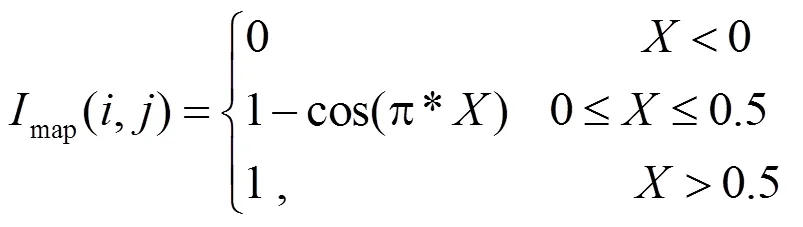

通過顯著區域權重可以更好地保留紅外圖像的熱目標,并且所保留的紅外目標邊緣清晰,不會出現文獻[14-15]中模糊問題,顯著區域權重構建方法為:

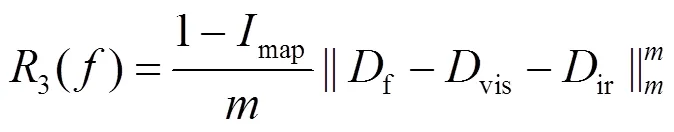

對于背景區域,我們目的是讓紅外圖像和可見光圖像中的細節信息能夠更加充分地融入到融合圖像中,而圖像細節信息可以通過梯度進行表征,因此本文所提出的背景保真項為:

式中:表示梯度操作;f,vis和ir分別表示融合圖像梯度,可見光圖像梯度和紅外圖像梯度;表示采用的范數類型。

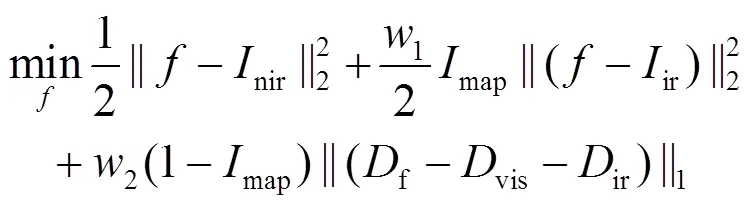

L2范數可以用來描述兩幅圖像之間的能量相似性,當融合結果與輸入的能量差為高斯分布時,通常采用L2范數。因此對于保真項1和2我們采用L2范數即==2。由于圖像的梯度在平坦區域通常是不變的或者是變化緩慢的,而在邊緣或紋理區域則變化劇烈。因此,其梯度矩陣趨于稀疏,即存在大量的0值。故對于3我們采用更加鼓勵稀疏的L1范數。最后,結合公式(1)、(2)、(4),將多波段圖同步像融合任務建模為:

式中:1和2是權衡參數。

1.2 求解多波段同步融合模型

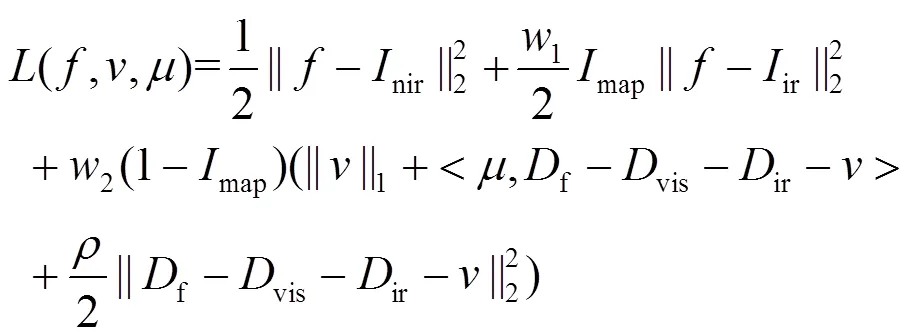

由于L1范數是一個不能直接求解的非凸函數。我們利用ADMM算法,通過變量分離求解無約束公式。首先,引入輔助變量并且讓=f-vis-ir來把無約束問題轉為受約束問題,并且定義受約束問題的增廣拉格朗日函數為:

式中:是拉格朗日乘子;>0為與約束相關的參數。

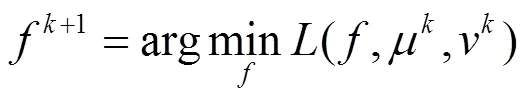

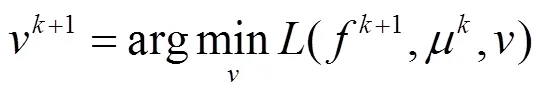

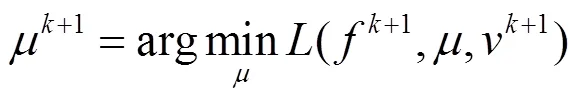

通過變量分離我們可以得到關于、和的3個子問題,它們以如下的ADMM迭代形式編寫:

式中:代表迭代的次數。

接下來,我們需要根據每個子優化問題的具體情況分別找到它們的最優解。公式(7)的等價形式如下:

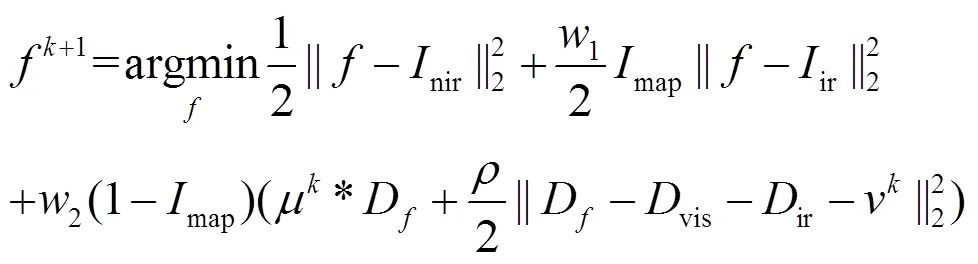

對于子問題,基于一階最優性條件[17],該解應該滿足以下方程式的要求:

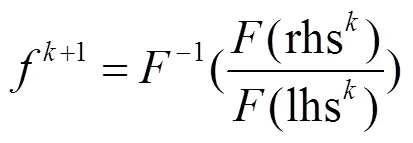

線性方程可以使用快速傅里葉變換求解如下:

式中:rhs=nir+(1map)ir+2(map-1)(Tk-Tk-Tvis-Tir);lhs=(1+1(map+2(1-(map)T);(×)代表快速傅里葉變換;-1(×)代表快速傅里葉逆變換。

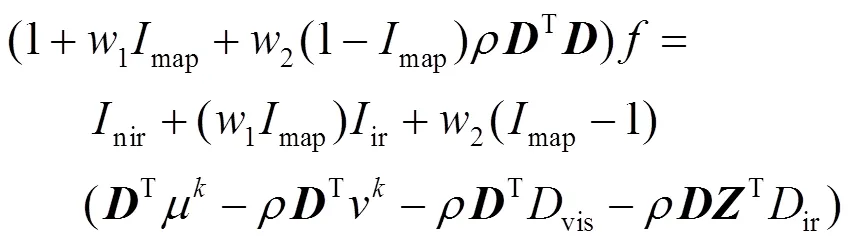

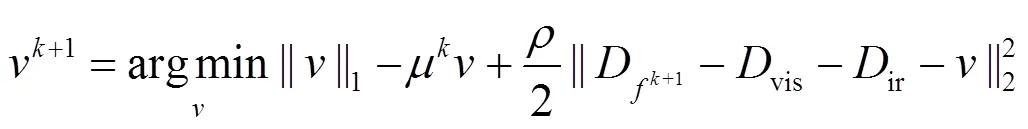

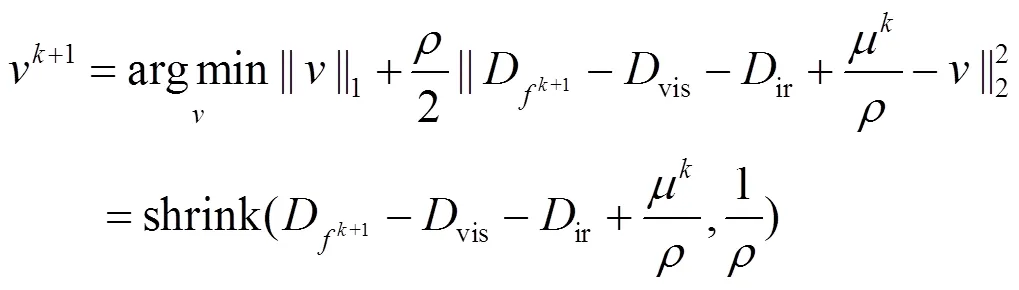

公式(8)中的子問題可以寫成如下等價形式:

子問題的解是一個封閉解,可以通過應用軟收縮算子得到解,即:

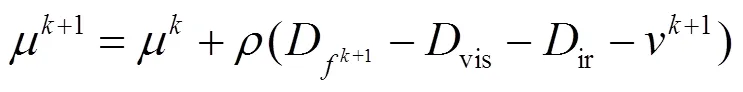

而對于拉格朗日乘子,則可以通過下式獲得其更新值:

模型求解的優化算法呈現在算法1中:

輸入:多波段圖像細節層(ir,nir,vis)

1)初始化=0.01,tol=1e-4;

3)用公式(7)更新f+1;

4)用公式(8)更新v+1;

5)用公式(9)更新+1;

6)end while

輸出:圖像融合結果。

2 實驗和結果分析

2.1 數據集和參數設置

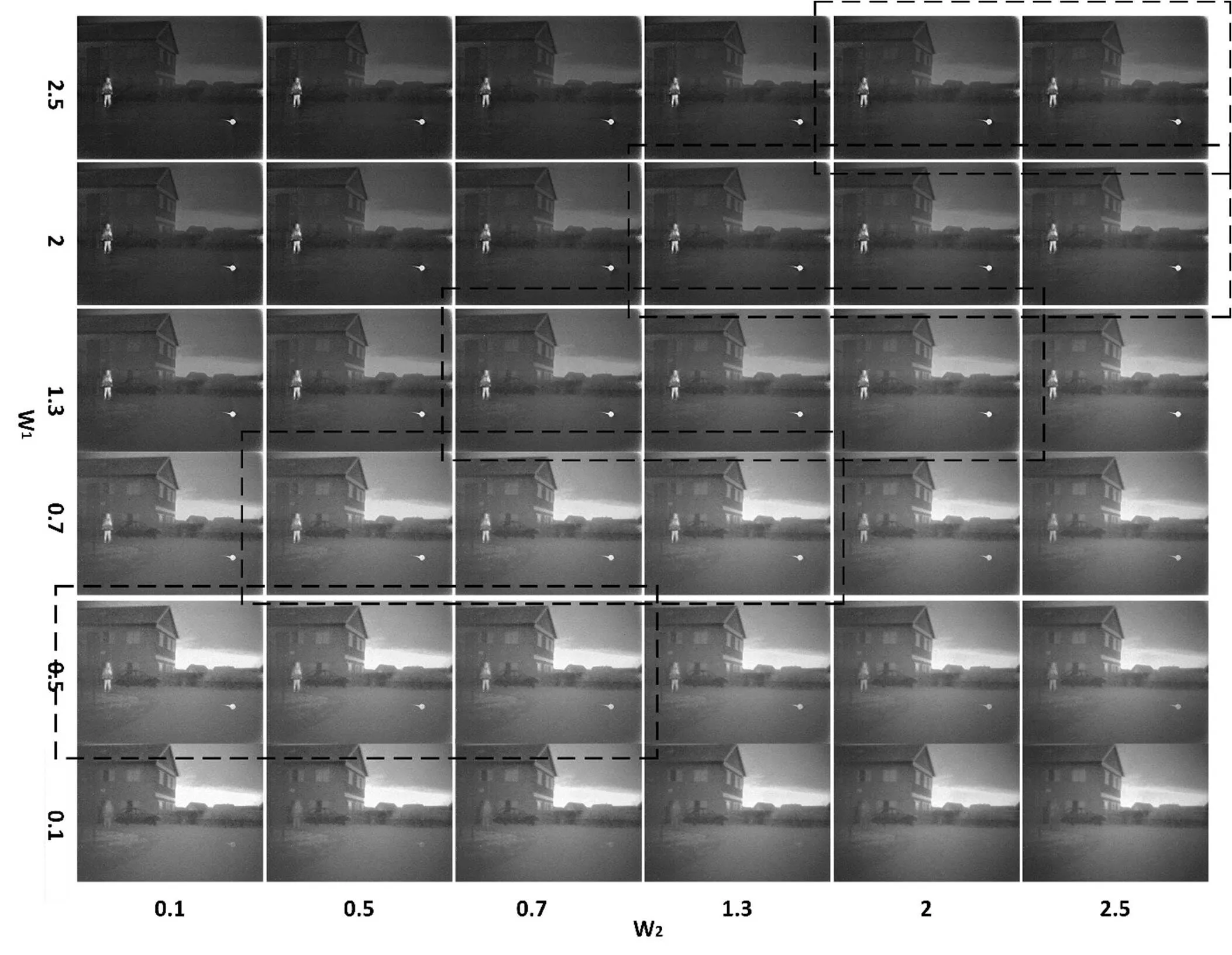

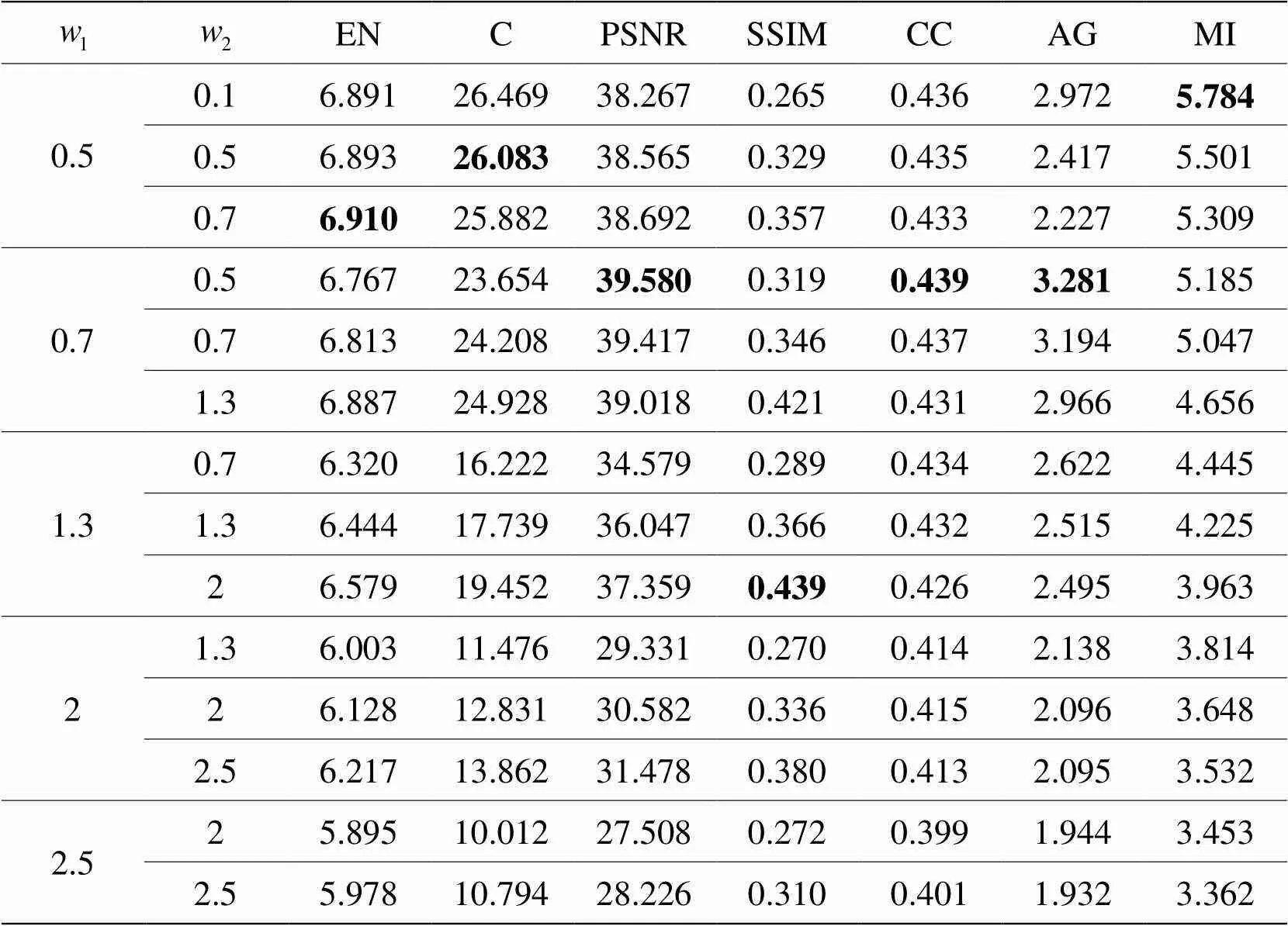

在本節中,我們通過對TNO數據集(包括紅外長波、紅外短波和可見光3個波段)進行實驗,重點驗證了所提算法的有效性。在公式(5)中1和2兩個參數的取值對實驗結果有影響,本文做了對比實驗,結果如圖2所示。從圖可以看出1不變的情況下,2越大,則融合結果越趨近于可見光圖像。當2不變的情況下,1越大,則融合結果越趨近于紅外圖像。故我們對主觀評價較好的黃色框內圖像進行客觀指標評價如表1所示,可以看出當1=0.7,2=0.5時在比較多的指標上取得好的結果。基于這個結果,在接下來的實驗中,我們將1設置為0.7,2設置為0.5。

2.2 結果分析

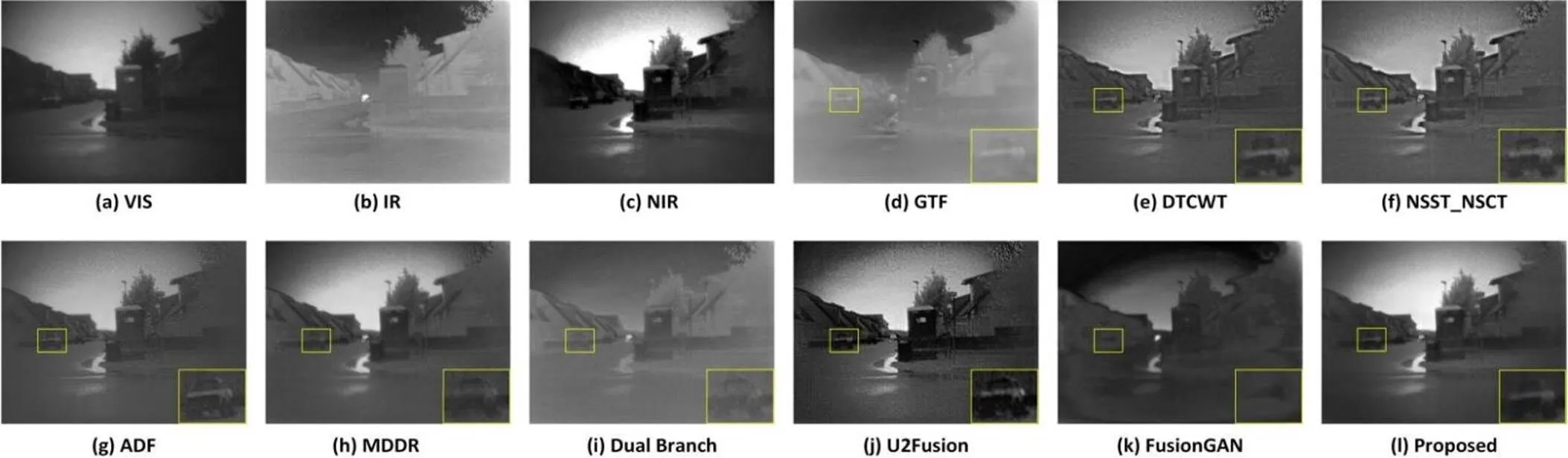

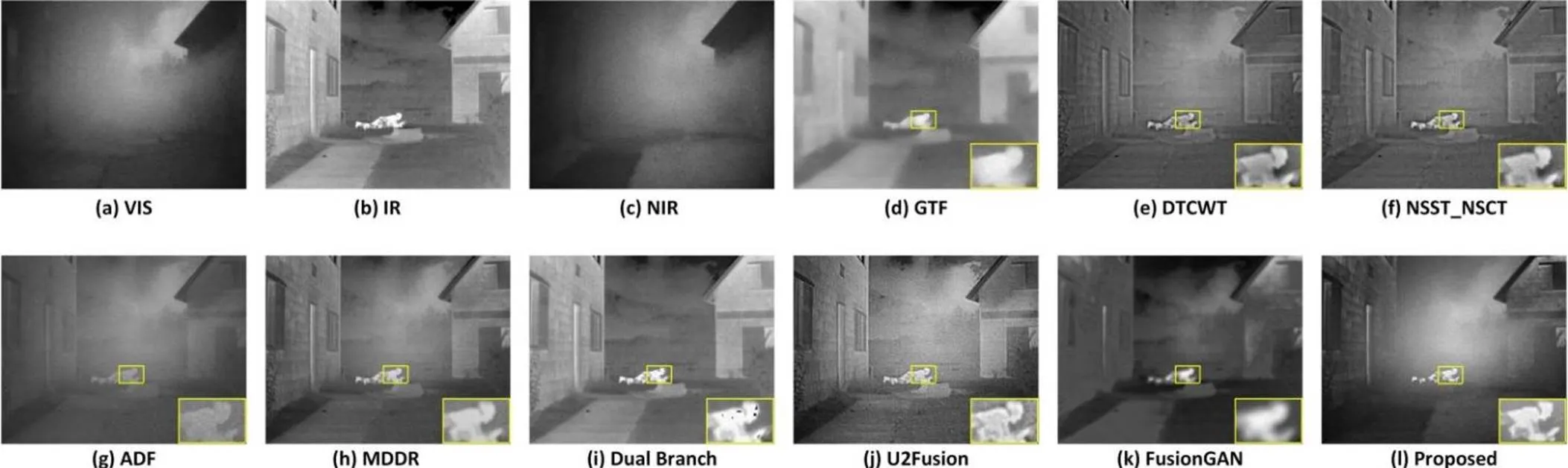

我們將本文方法與8種具有代表性的方法進行定性和定量比較。其中包括4種傳統方法和4種基于深度學習的方法。傳統方法有(gradient transfer fusion, GTF)[14],(dual tree-complex wavelet transform, DTCWT)[6],(nonsubsampled shearlet transform _ nonsubsampled contourlet transform, NSST_NSCT)[18],(anisotropic diffusion fusion, ADF)[19]。深度學習方法包括(model and data-driven, MDDR)[3],Dual Branch[20],U2Fusion[21],FusionGAN[22]。除了NSST_NSCT和MDDR其他方法都是適用于兩個波段圖像融合,這里通過兩兩序貫相融的方式轉換為三波段圖像融合。考慮到序貫式調用融合模型時,源圖像輸入順序不同會有不同融合結果,這里統一選用最好的融合結果進行討論。

2.2.1 定性比較

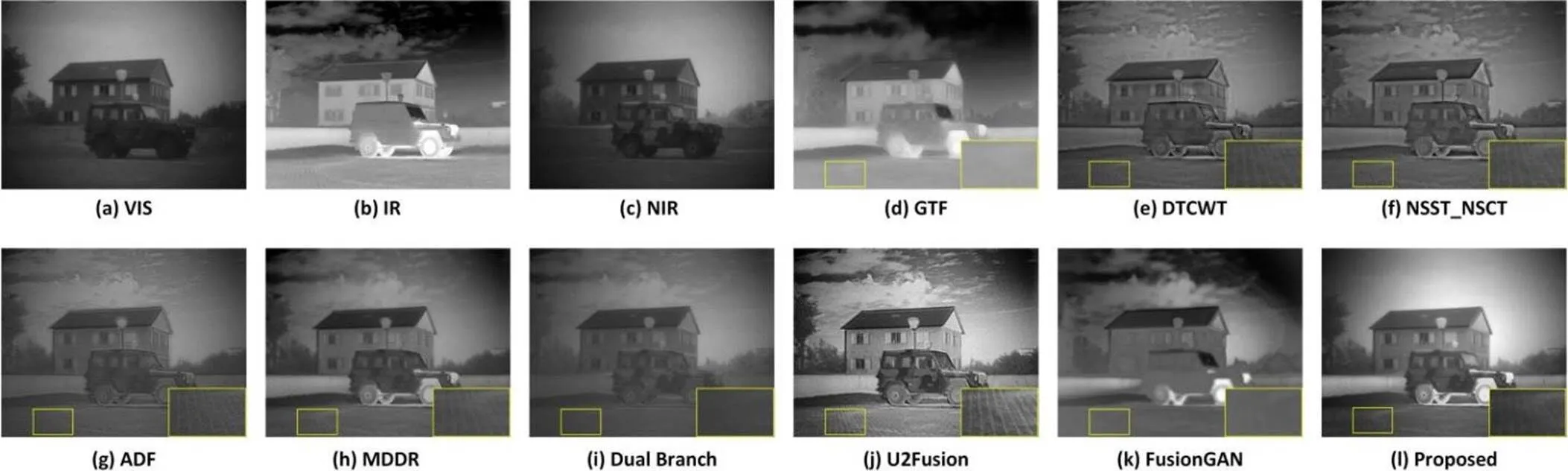

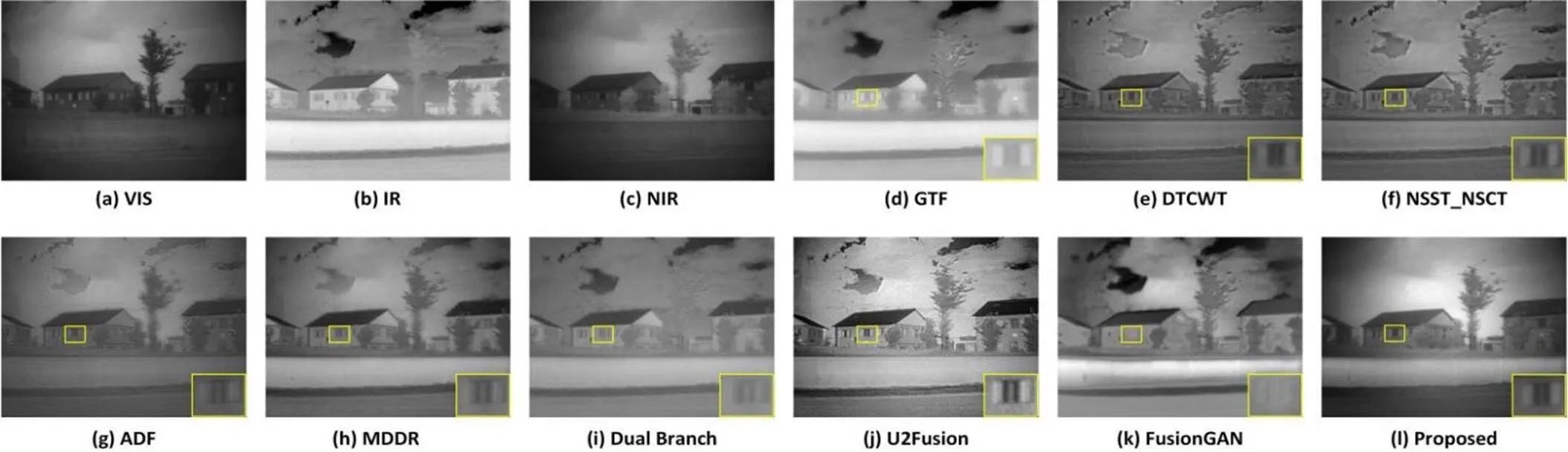

首先進行定性實驗。如下顯示了5個典型圖像對的直觀結果。與現有的方法相比,本文方法有3個明顯的優勢。第一,我們的結果可以清楚地保留和突出紅外圖像中的顯著目標,如圖3、圖4和圖5所示,人物與環境的對比度高,這有利于目標的檢測。第二,我們的結果可以很大程度保留原始圖像的細節紋理信息,如圖6所示,這有利于后續的目標識別和提高識別的精度。第三,我們的結果能夠很好地突顯圖像的對比度,如圖7所示,這更加符合人的視覺感受。

圖2 不同w1和w2取值融合結果

表1 圖2中虛線區域客觀評價指標

圖4 “Movie_01” 圖像融合結果

圖5 “soldier_behind_smoke” 圖像融合結果

圖6 “Marne_04” 圖像融合結果

圖7 “Marne_06”圖像融合結果

FusionGAN和GTF雖然可以很好地突出顯著目標,但是從圖3和圖5可以看出其存在顯著目標邊緣模糊問題,并且GTF不能很好保留細節信息。U2Fusion雖然能夠突出顯著區域,并且細節信息也能很好保留,但是融合結果中會引入許多噪聲。DTCWT和NSST_NSCT雖然能夠很好地保留細節信息但是不能很好突出顯著目標。ADF和Dual Branch圖像整體對比度低,不夠明顯。MDDR雖然達到了較好的融合結果,但是清晰度低。相比之下本文提出的方法在突出紅外顯著目標和保留微小的細節信息上有強的競爭力。

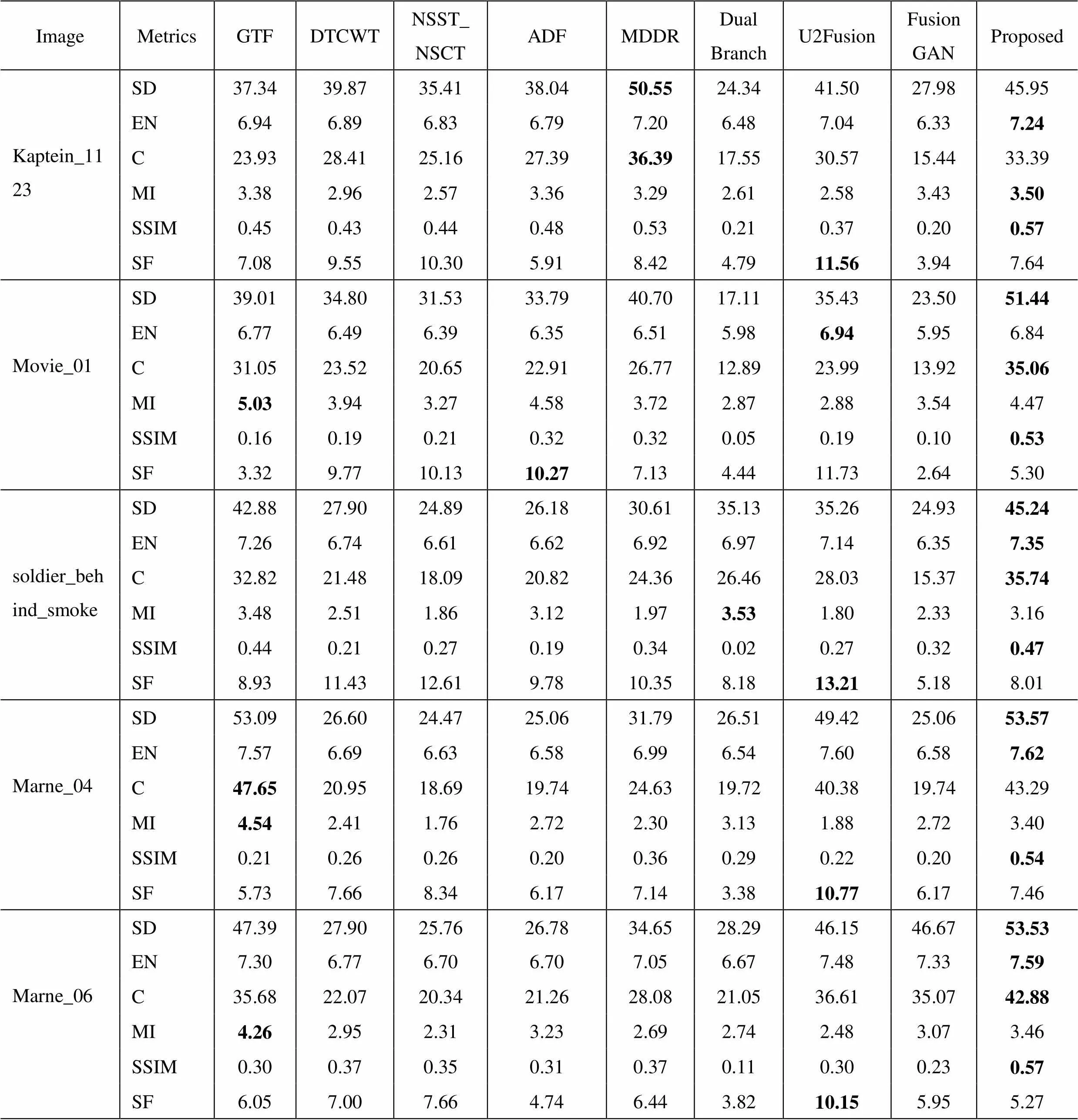

2.2.2 定量比較

為了評價所提方法的有效性,我們比較了所有方法和所提方法在標準差(SD)、熵(EN)、對比度(C)、互信息(MI)、結構相似度(SSIM)和空間頻率(SF)這6個指標上的表現。結果如表2所示,其中最佳值為粗體顯示。U2fusion在SF指標上都是取得最佳值,但是從圖像可以看出U2Fusion的結果噪聲比較大,這對SF指標有很大的影響。本文提出的方法在各指標上表現出色,其中SD和EN指標表現好,說明本文方法包含更多的信息,C指標比較高說明我們方法對比度高,SSIM指標表現好說明有更多的源圖像信息被傳輸到融合結果中。這些客觀評價都與主觀評價相符,說明本文所提出的方法能夠很好地保留源圖像顯著信息和細節信息,并且對比度高,圖像更加符合人眼視覺特性。

3 結論

本文提出了一種基于顯著性的多波段圖像同步融合模型,通過基于視覺顯著的紅外顯著區域提取來構造權重圖,對模型進行約束,以克服融合結果顯著區域不突出和邊緣模糊問題。根據模型特點采用ADMM算法進行模型求解。實驗證明了該算法的可行性和有效性。這些實驗表明,融合結果能夠突出紅外顯著目標,并且具有豐富的細節,同時保證不會出現偽影或模糊,是一種行之有效的方法。

表2 各算法評價指標

[1] LIU Y, LIU S, WANG Z. A general framework for image fusion based on multi-scale transform and sparse representation[J]., 2015, 24: 147-164.

[2] YU B, JIA B, DING L, et al. Hybrid dual-tree complex wavelet transform and support vector machine for digital multi-focus image fusion[J]., 2016, 182: 1-9.

[3] LIN S, HAN Z, LI D, et al. Integrating model-and data-driven methods for synchronous adaptive multi-band image fusion[J]., 2020, 54: 145-160.

[4] ZHANG H, LE Z, SHAO Z, et al. MFF-GAN: an unsupervised generative adversarial network with adaptive and gradient joint constraints for multi-focus image fusion[J]., 2021, 66: 40-53.

[5] Toet A. Image fusion by a ratio of low-pass pyramid[J]., 1989, 9(4): 245-253.

[6] Lewis J J, O’Callaghan R J, Nikolov S G, et al. Pixel-and region-based image fusion with complex wavelets[J]., 2007, 8(2): 119-130.

[7] Nencini F, Garzelli A, Baronti S, et al. Remote sensing image fusion using the curvelet transform[J]., 2007, 8(2): 143-156.

[8] Vishwakarma A, Bhuyan M K. Image fusion using adjustable non-subsampled shearlet transform[J]., 2018, 68(9): 3367-3378.

[9] LI H, CEN Y, LIU Y, et al. Different input resolutions and arbitrary output resolution: a meta learning-based deep framework for infrared and visible image fusion[J]., 2021, 30: 4070-4083.

[10] ZHANG H, LE Z, SHAO Z, et al. MFF-GAN: an unsupervised generative adversarial network with adaptive and gradient joint constraints for multi-focus image fusion[J]., 2021, 66: 40-53.

[11] MA J, LE Z, TIAN X, et al. SMFuse: multi-focus image fusion via self-supervised mask-optimization[J]., 2021, 7: 309-320.

[12] WANG B, ZHAO Q, BAI G, et al. LIALFP: multi-band images synchronous fusion model based on latent information association and local feature preserving[J]., 2022, 120: 103975.

[13] NIE R, MA C, CAO J, et al. A total variation with joint norms for infrared and visible image fusion[J]., 2021, 24: 1460-1472.

[14] MA J, CHEN C, LI C, et al. Infrared and visible image fusion via gradient transfer and total variation minimization[J]., 2016, 31: 100-109.

[15] MA Y, CHEN J, CHEN C, et al. Infrared and visible image fusion using total variation model[J]., 2016, 202: 12-19.

[16] WANG B, BAI G, LIN S, et al. A novel synchronized fusion model for multi-band images[J]., 2019, 7: 139196-139211.

[17] Ng M K, WANG F, YUAN X, et al. Inexact alternating direction methods for image recovery[J]., 2011, 33(4): 1643-1668.

[18] Moonon A U, HU J. Multi-focus image fusion based on NSCT and NSST[J]., 2015, 16(1): 1-16.

[19] Bavirisetti D P, Dhuli R. Fusion of infrared and visible sensor images based on anisotropic diffusion and Karhunen-Loeve transform[J]., 2015, 16(1): 203-209.

[20] FU Y, WU X J. A dual-branch network for infrared and visible image fusion[C]//25t(ICPR), 2021: 10675-10680.

[21] XU H, MA J, JIANG J, et al. U2Fusion: A unified unsupervised image fusion network[J]., 2020, 44(1): 502-518.

[22] MA J, YU W, LIANG P, et al. FusionGAN: a generative adversarial network for infrared and visible image fusion[J]., 2019, 48: 11-26.

Saliency-based Multiband Image Synchronization Fusion Method

YU Dong1,LIN Suzhen1,LU Xiaofei2,LI Dawei3,WANG Yanbo1

(1.,,030051,; 2.,735305,; 3.,,030051,)

To address the problem of low contrast and inconspicuous salient objects in multi-band image fusion, this paper presents a saliency-based multiband image synchronous fusion method. First, a near-infrared image was used as a data fidelity item, and infrared and visible light images provided salient and detailed information on the results of fusion, respectively. Second, a visual saliency-based infrared salient region extraction method was used to construct a weight map to overcome unsalient regions and blurred edges in the results of fusion. Finally, the alternating direction method of multipliers (ADMM) was used to solve the model and obtain the results of fusion. The research results showed that, compared with a representative image fusion algorithm, the proposed algorithm retained the thermal radiation information of the infrared image while retaining clearer details, and was better in many objective evaluation indicators.

image fusion, multi-band images, saliency, total variation

TP391.41

A

1001-8891(2022)10-1095-08

2022-03-16;

2022-04-25.

余東(1995-),男,碩士研究生,研究方向為圖像融合,E-mail:844913898@qq.com。

藺素珍(1966-),女,教授,博士,碩士生導師,研究方向為紅外弱小目標檢測,圖像融合,E-mail:lsz@nuc.edu.cn。