基于多重注意力機制的電機磁瓦表面缺陷檢測

丁龍飛,曾水玲

(吉首大學 信息科學與工程學院,湖南 吉首 416000)

0 引 言

電機磁瓦又稱為永磁鐵氧體磁瓦(簡稱磁瓦),是汽車、家電行業廣泛應用的電動機的重要組成部分。電機磁瓦生產過程中因工藝制作技術和碰撞的影響不可避免會產生磁瓦缺陷,因此對磁瓦質量的檢測成為工業檢測中的必需流程。近年來基于數字圖像處理的視覺檢測方法因其速度快、準度高、成本低等優勢,逐漸成為缺陷檢測的主要檢測方法,并廣泛應用于工業生產的各個領域[1-5]。從深度卷積神經網絡(Convolutional Neural Networks,CNNS)提出后,積極促進了計算機視覺方向的發展,讓缺陷檢測的方式有了新的可能。國內外對基于深度學習[6]的缺陷提取技術進行了不同程度的研究。ImageNet競賽中,許多優秀的網絡模型已經被發現和突破,自AlexNet[7]的提出,網絡不斷加深,為獲得更多的特征表現,VGGNet[8]表明了在堆疊形狀相同的卷積塊,通過增加網絡深度來獲得更多的特征細節,對目標檢測識別和實例分割會產生相對較好的效果。ResNet[9]將相同的殘差塊疊加起來,以構建極深的網絡體系結構,極大提高了CNNs性能。GoogLeNet[10]的提出表明除了深度外,影響網絡模型性能的另一個關鍵因素是寬度,在CIFAR數據集測試中,寬度甚至可以擁有超過1001層的極深的ResNet網絡,在網絡寬度上進行改變使網絡性能確實得到一定的提升。其中較為典型的網絡為VGG19[8]、ResNet34、ResNet50、ResNet101等不同寬度的網絡。而VGG、Inception[11]系列和ResNet系列這三個網絡模型在眾多神經網絡中脫穎而出,并在不同的任務領域都有著優異的表現。對這三個神經網絡模型進行篩選時,可以看出VGG模型網絡結構簡單,因此層次較淺,同樣對于Inception系列模型網絡來說,又顯得相對復雜,而ResNet系列模型相對于Inception網絡來說結構簡單,且當殘差結構的引入,能夠使得在網絡深度較大時不容易產生梯度爆炸和梯度消失等現象,ResNet網絡模型性能強大,在許多圖像特征提取過程中有著出色的表現,因此也被多次作為眾多神經網絡模型的骨干網絡,更有研究意義。由于在對缺陷檢測中對缺陷圖像進行圖像分類時也要考慮到模型的速度以及精度,該文研究使用ResNe系列網絡模型中的最流行的ResNet50網絡模型。

磁瓦缺陷目前的一些算法[12]都是基于Mask-RCNN[13]的2-step模型,通過選取檢測候選框后再識別,這樣兩階段訓練時間長,識別時間慢,不適合在實際生產中應用。從實際看電機磁瓦缺陷檢測最主要是為了篩選殘次品,以及區分殘次品的類型,因此端到端模型更適合磁瓦缺陷檢測任務。

為防止ResNet50網絡模型在訓練時產生過擬合現象,在網絡模型的最后一個卷積層加入Dropout[14]層,通過網格搜索方法尋找最優的超參數組合確定失活率(Dropout Rate)以及隱藏層新增的神經元個數。為了使網絡能夠自動學習需要注意的每個特征通道和空間的重要程度,引入注意力模塊(Convolution Block Attention Module,CBAM)[15],將CBAM模塊加進ResNet50網絡中,對每個塊中的卷積輸出引入CBAM模塊。實現了對無關特征的弱化,強調重要特征,提高了對磁瓦缺陷分類的準確率,減少了缺陷檢測分類的漏檢率和誤檢率。

主要貢獻如下:

(1)提出一個端到端的目標檢測模型來代替目前常見的兩階段目標檢測網絡,簡化檢測流程。

(2)在ResNet50網絡結構中引入CBAM模塊,突出重要特征提高對磁瓦檢測的準確性。

(3)引入網格搜索方法來尋找最合適網絡模型的超參數,提升系統的性能。

1 殘差神經網絡模型ResNet50

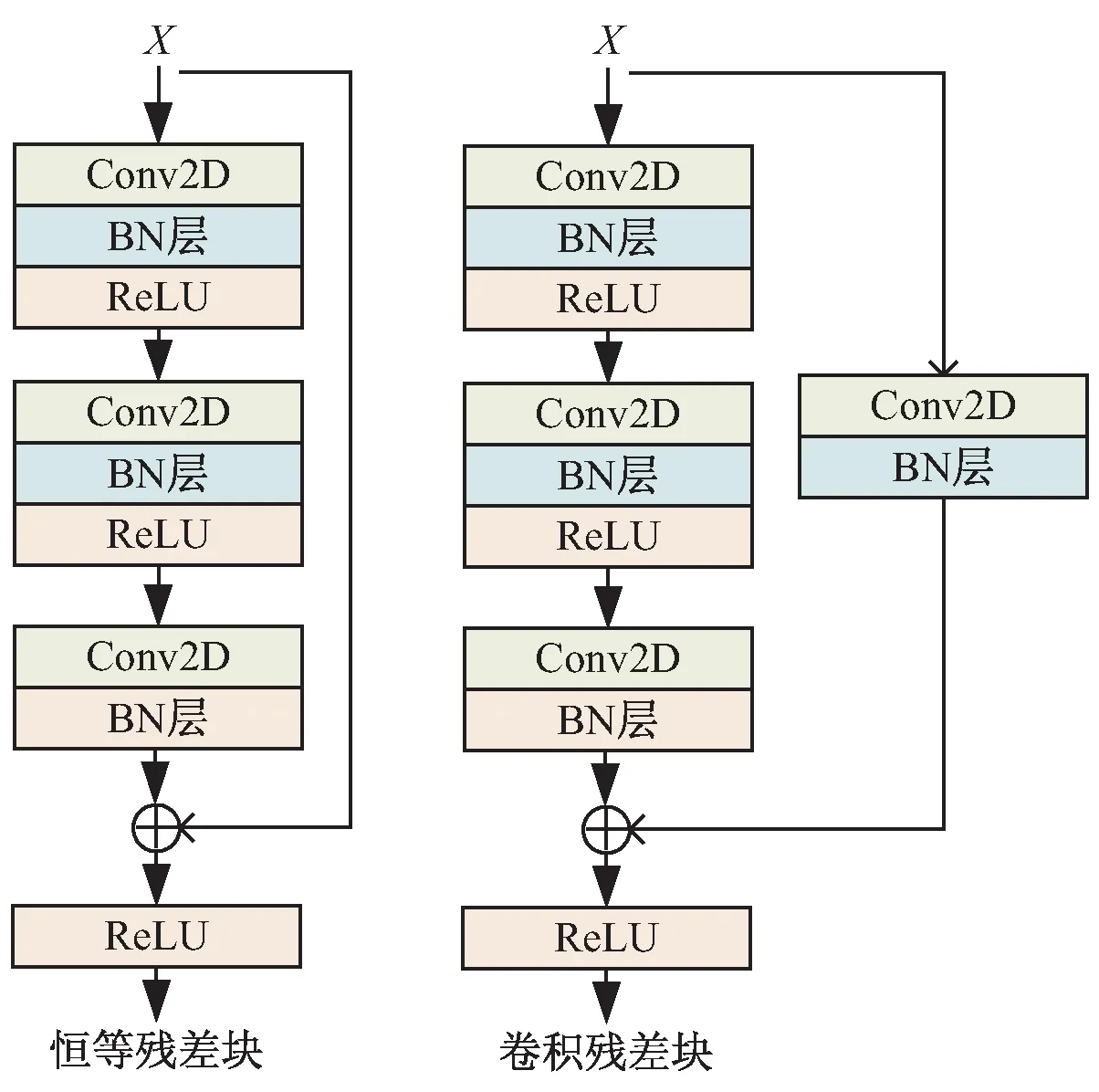

殘差網絡ResNet系列結構是目前深度學習中最為典型的網絡結構。所有的殘差網絡都由殘差塊組成,殘差塊有兩條路徑分支,一種是連接常規卷積塊路徑,另一種為skip connection捷徑連接路徑,根據網絡的捷徑連接路線是否進行卷積運算分為兩種不同的殘差塊結構,如圖1所示。

圖1 殘差塊網絡結構

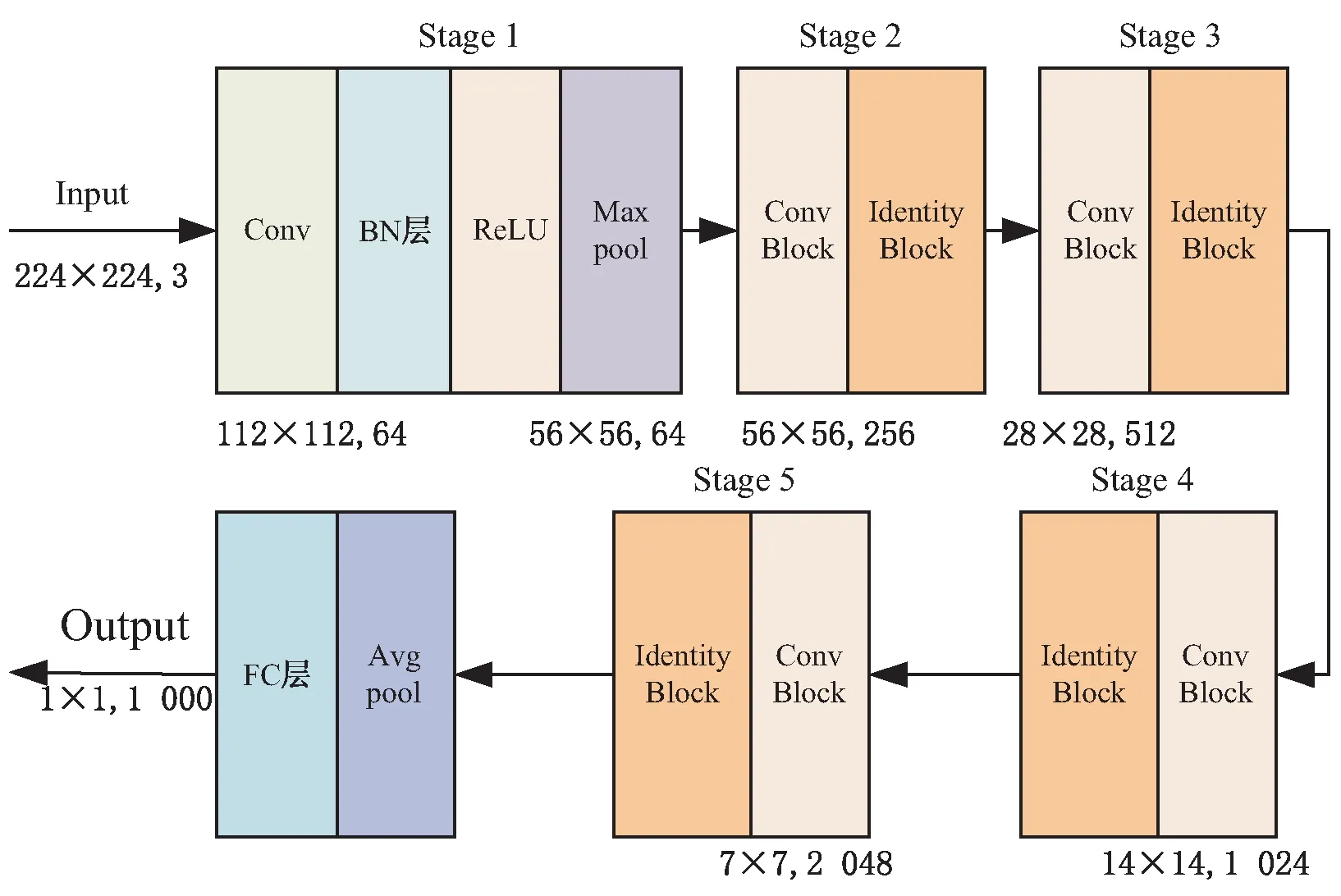

通過圖1的恒等殘差塊(Identity Block)以及卷積殘差塊(Conv Block),堆疊組成了ResNet50的網絡結構中第二階段到第五階段的卷積層。ResNet50等殘差網絡模型的第一個階段都是首先將112×112的圖像進行一次7×7的卷積以及一次步長為2的3×3的最大池化下采樣操作,使圖像從112×112變為56×56,第二個階段到第五個階段,每個卷積階段分別對應L=[3,4,6,3]個“1×Conv Block+(L-1)×Identity Block ”的殘差塊組合[16]。除此之外整體網絡的最后一層為一個全連接層,因此得到整體網絡的層數為:

1+(3+4+6+3)×3+1=50,因此得名ResNet50。ResNet50網絡模型如圖2所示。

圖2 ResNet50的網絡結構

2 改進的ResNet50網絡模型

2.1 基于ResNet50的結構改進

在ResNet50模型結構中,參數的微調對訓練結果影響較大。電機磁瓦缺陷檢測分類任務不同于一般的圖像處理分類任務,在磁瓦缺陷檢測分類中,檢測場景較為單一,雖然缺陷類型多但是各類別的缺陷易被識別,在分類任務訓練中容易對局部特征產生依賴,導致過擬合現象發生。為防止此現象發生,引入隨機失活(Dropout)網絡層來加強局部神經元的表達能力,有效解決過擬合問題,提高網絡的分類精度以及泛化能力。Dropout層的原理是在訓練中將一部分隱藏層中的神經元按照設定的丟棄概率(Rate)暫時失活,以此來降低全連接層中神經元之間的密切依賴,減少過擬合現象的發生。

通過Bernoulli函數來設置神經元i的隨機失活向量rj,其中Bernoulli函數是為了隨機生成一個0-1向量,當向量為0時,神經元失活;當向量為1時,不對神經元進行操作。以此來表示Dropout層中神經元i的失活情況,p為存活概率。由r(s)來表示所有神經元的失活向量矩陣:

(1)

(2)

(3)

(4)

式(1)和式(2)為神經元的隨機失活處理,式(3)和式(4)為未經失活處理的神經元的前向傳播計算公式。

在ResNet50隱藏層中引入Dropout層,隱藏層的神經元個數和設定的失活概率會影響網絡模型性能,采用網格搜索方法來最終確定對于Dropout網絡層最合適的參數組合。網格搜索法是通過不同的參數搭配,統計出每個參數組合后的網絡模型的精準率和召回率,取訓練效果最好的一個參數組合作為網絡的參數組合,得到最終改進的網絡模型。在網格搜索中,首先根據訓練經驗來設置參數,該文根據一般網絡設置了新增卷積層神經元設置為可供選擇的[0,64,128,256,512,1 024]以及設置可選擇的失活的概率[0,0.1,0.2,0.3,0.4,0.5,0.6,0.7,0.8,0.9]。當失活概率為0時,即不進行失活處理,當選擇的新增神經元為0時,即不添加任何新增神經元。當不為0時即為簡單的遷移學習網絡模型。對于電機磁瓦缺陷圖像設置為正樣本,無缺陷圖像設置為負樣本。F1-score為分類問題的一個重要衡量指標,它是精確率(precision)和召回率(recall)的調和平均數,數值集中在區間[0,1]之間,即:

(5)

選用F1-score來評價各組合的模型。選取前五個最優的模型輸出組合,如表1所示。

表1 前五個最優組合的模型輸出結果

由表1可知,對于該文使用的磁瓦缺陷圖像數據,最佳的網絡組合為Dropout Rate為0.3,隱藏層Dense神經元的數目為256。改進后的ResNet50網絡在最后一層全連接層中加入Dropout層,將最后一層分類變成5類,分別對應電機磁瓦的五種缺陷類型。改進后的ResNet50的網絡結構見圖3。

圖3 改進后的ResNet50網絡結構

2.2 在ResNet50模型中增加注意力機制模塊

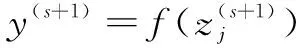

增強卷積神經網絡性能的方式有許多,前些年,許多神經網絡通過增加神經網絡的層數來強化性能,也有使用更大的卷積核來增加感受野獲得更多的圖像細節,以此來提高網絡性能。目前最為普遍和實用的提高網絡性能的方式為注意力機制。SE-Net[16]首次提出了通道注意力,其有效機制可以建立不同特征之間的空間相關性,提高了神經網絡模型性能。隨后,基于SE-Net模型,注意力機制CBAM被提出,CBAM與SE-Net的區別在于CBAM增加了空間注意力模塊,用包含通道注意力和空間注意力兩個模塊的網絡來提高網絡的性能。CBAM的結構如圖4所示。

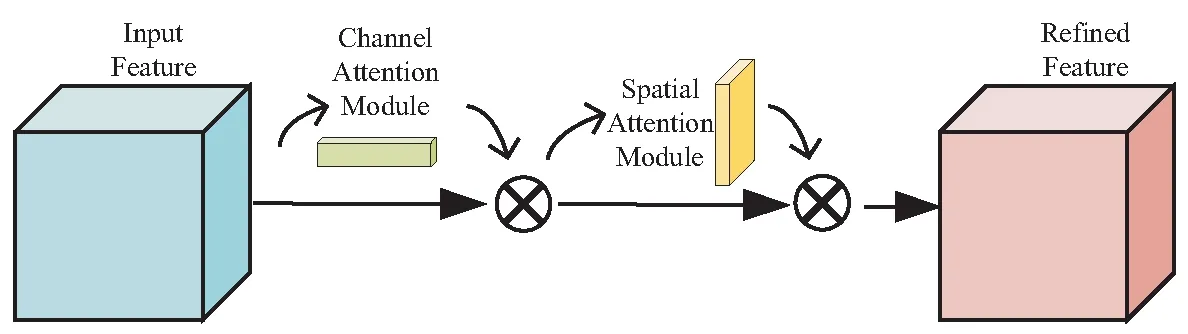

CBAM模塊首先將輸入的特征圖通過一個通道注意力模塊,得到加權結果之后,再經過空間注意力模塊,通過加權得到最終的特征圖。在磁瓦缺陷檢測中無關重要的背景不是需要關注的目標,只需要把更大的權重分配給缺陷特征,將注意力集中在缺陷特征,因此通過CBAM模塊來提升提取缺陷特征的能力。而對于CBAM模型中的通道注意力模塊,需要經過兩個全連接層來構成通道間的相關性,再經過Sigmoid非線性激活函數產生每個通道的權重,雖然這個做法會有效降低維度但卻會導致局部信息丟失,使精度下降。分析后決定將兩個全連接層用1×1的卷積層代替,增強通道間的相關性,減少局部信息丟失現象。改進后的注意力機制網絡[17]如圖5所示。

圖4 CBAM結構

圖5 改進后的注意力機制結構

改進的注意力機制具體表示為:

M1=Mc(F)?F

(6)

M2=Ms(Mc(F)?F)

(7)

F′=M1?M2

(8)

式中,F∈C×H×W為輸入特征圖,C、H、W分別表示特征圖的通道數、高和寬;Mc∈C×1×1和Ms∈1×H×W分別表示通道注意力模塊和空間注意力模塊;?σ表示逐元素乘法;M1表示特征圖F與MC進行矩陣乘法運算,M2表示特征圖F與Ms進行矩陣乘法運算。F′∈C×H×W為最終輸出。

對于通道注意力Mc∈C×1×1,經過全局最大池化和平均池化,分別記為和隨后經過卷積計算得到權重C1Dk,并對C1Dk的兩個輸出進行權重計算,最后經過一層Sigmoid激活函數得到最終的通道注意力特征圖,用數學方式表示為:

(9)

對于空間注意力Ms∈1×H×W,第一步本模塊的輸入特征圖使用的是經過通道注意力模塊后得到的特征圖,再經過兩個池化操作得到的結果分別記為1×H×W和第二步將和合并,變成一個含有雙通道的特征;第三步使用了7×7的卷積核將含有兩個通道的特征圖降維,變成了單通道。這樣做的目的是為了使得維度前后一樣,方便特征的融合;最后經過Sigmoid激活后輸出最終的空間注意力特征權值[18]。可簡單描述為:

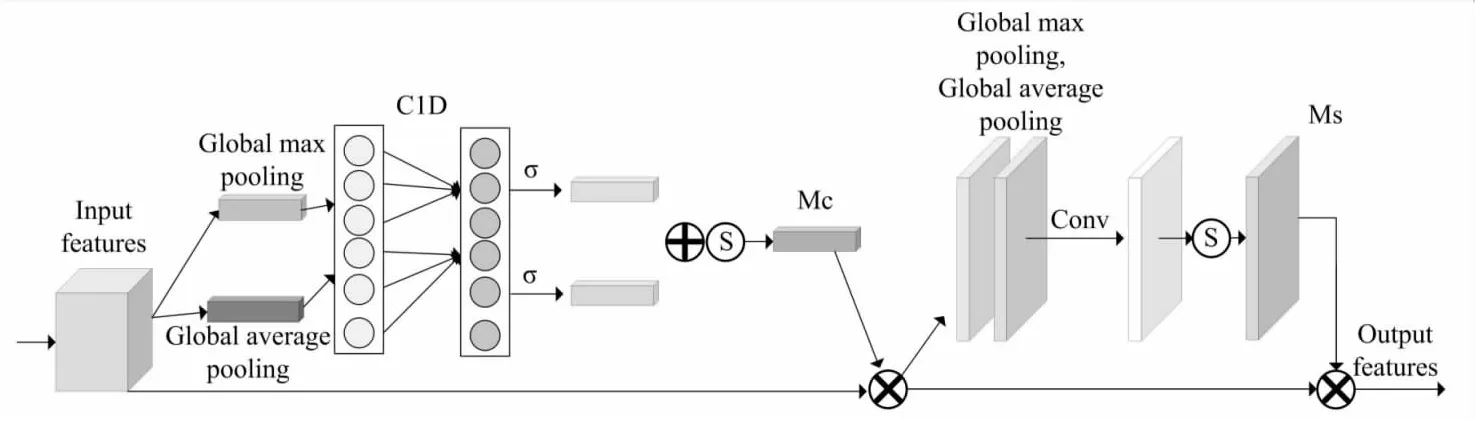

通過改進的ResNet50和增加的CBAM模塊得到整個融合注意力機制的殘差網絡結構,整體的電機磁瓦缺陷檢測網絡模型如圖6所示。

圖6 融合注意力機制的殘差網絡結構

3 實驗及分析

3.1 實驗環境

實驗環境:Win10系統,Inter i5-9300H處理器,NVIDIA GeForce RTX 2060顯卡兩張, Python 3.6,Pytorch環境,CUDA10.1。在訓練過程中,選擇能夠高效計算的Adam優化器,學習率設置為1e-4,選擇交叉熵損失函數(Cross-entropy)作為損失定義函數,批大小為16,迭代次數為100次。

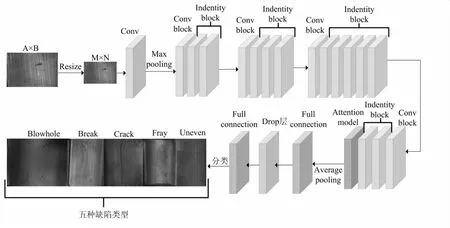

3.2 數據集

采用的開源數據集來自文獻[19],在整個數據集中,共有五種磁瓦缺陷圖像以及無缺陷的樣本1 335張,其中有氣孔缺陷115張,破損缺陷85張,裂紋57張,磨損32張,無缺陷952張,起層94張。在數據集中的正負樣本比例為2∶5。訓練集與測試集比為7∶3。

3.3 評價指標

常見的評價指標主要有精準率(precision)、召回率(recall)、平均精確率(average precision,AP) 以及平均精確率均值(mean average precision,mAP)。

在缺陷檢測中進行分類任務時,需要對圖像進行不同的分類,因此使用mAP更符合需要。mAP的值越大,表示該模型的定位與識別的準確率越高。其定義如公式(11)所示:

(11)

使用全類平均準確率(mAP)作為評價指標,對所有種類求其平均精準度能夠合理地反映網絡的性能。

3.4 結果分析

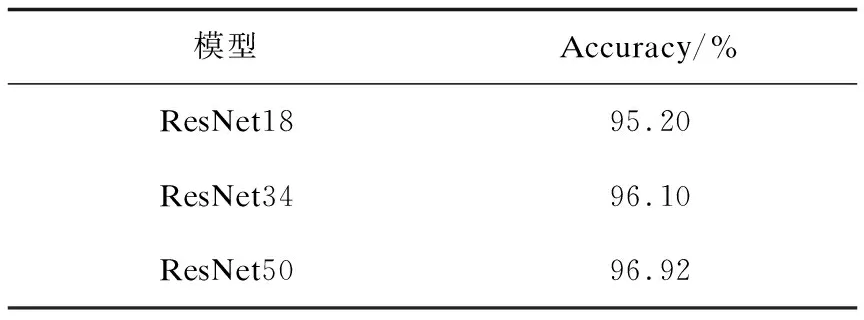

為選取最優的ResNet結構,將不同層數的ResNet網絡在磁瓦缺陷檢測數據集上進行訓練,選取其中訓練表現最好的ResNet系列網絡。使用ResNet18、ResNet34、ResNet50在磁瓦缺陷數據集中進行訓練,實驗對比如表2所示。

表2 前五個最優組合的模型輸出結果

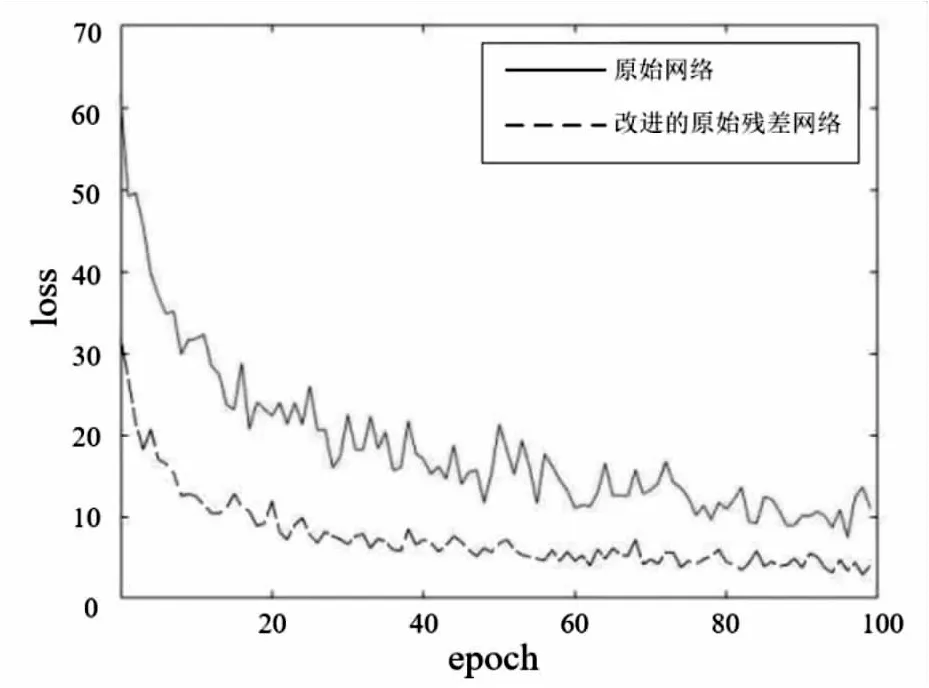

由表2可知,ResNet50在磁瓦缺陷檢測分類任務中的表現最好,在沒有改進的情況下缺陷類別檢測準確度達到了96.92%,高于其他層數的ResNet模型,決定選取ResNet50模型作為整個網絡模型的骨干網絡,并在其基礎上進行改進和實驗。首先在ResNet50模型中加入CBAM模塊,通過增加通道注意力模塊和空間注意力模塊,增強了缺陷特征提取能力, 提高原網絡模型的性能,將此ResNet50-CBAM模型訓練后觀察訓練效果,ResNet50-CBAM模型的訓練收斂效果如圖7所示,經過100個epoch,網絡模型收斂程度明顯好于原ResNet50網絡。

圖7 改進的ResNet50與原網絡損失下降曲線

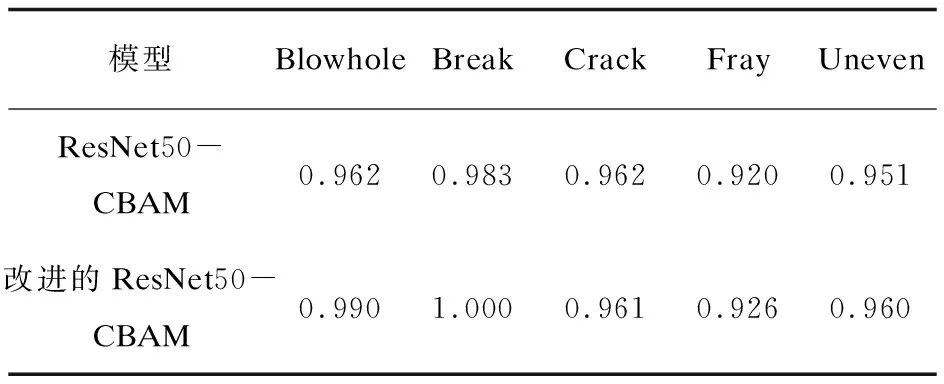

在ResNet50-CBAM模型的基礎上,將Dropout層加入ResNet50-CBAM的最后一層中的全連接層,防止訓練過程中過擬合現象的發生,在訓練中各類缺陷檢測的精準度如表3所示。

表3 同網絡模型在各類缺陷的精準度對比

由表3可知,在訓練過程中,模型在氣孔(Blowhole)和破損(Break)兩類缺陷分類中的識別準確度達到了非常高的水平,而在磨損(Fray)中的檢測精準度較低。結合圖7和表4,對實驗進行對比分析。實驗中對ResNet50模型,分別引入了CBAM模塊和Dropout層,改進后的ResNet50模型相比較原網絡mAP值提升了1.3%,在一定程度上提升了識別精準度。

實驗證明,在加入CBAM模塊后,網絡模型收斂能力得到了明顯提升。CBAM模塊主要作用是增強網絡對缺陷類型的特征提取能力,降低漏檢率和誤檢率,提升網絡的性能。最后增加Dropout層,在ResNet50-CBAM模塊中增加了Dropout層。由表3可知,在網絡中加入Dropout層后,整體網絡對各個類別的精準度有不同程度的提升。通過pytorch內置的計時工具和同步工具profile的percall函數,測試了在每個epoch中,改進的ResNet50-CBAM所使用時間比原模型平均多了78 ms,相較于性能的提升可以忽略不計。

原ResNet50-CBAM網絡在各類缺陷檢測中的mAP為0.955 6,改進的ResNet50-CBAM的mAP達到0.969 2,比原網絡提高了1.3%。

在訓練過程中的精準度對比見圖8。可以較為清楚地看到,改進的網絡有效提高了網絡性能,但還是存在一定的誤檢。綜合看來,改進的網絡相對于原網絡在性能上取得了一定的提升。

圖8 ResNet50-CBAM改進前后準確度對比

4 結束語

提出一個端到端的目標檢測模型來代替目前常見的兩階段目標檢測網絡,簡化檢測流程。采用ResNet50網絡模型作為backbone,針對訓練中耗時長且較為依賴局部特征容易發生網絡模型過擬合導致分類精度下降的問題,提出在全連接層中加入Dropout層防止過擬合現象的發生,并通過網格搜索法來尋找最優的超參數組合,確定增加的隱藏層神經元個數和失活率(Dropout Rate)。為了讓網絡學習重點放在缺陷特征上,增加注意力模塊CBAM來加強網絡性能。CBAM模塊是一個輕量級的模塊,帶來的計算復雜度基本上可以忽略不計,通過空間注意力模塊和通道注意力模塊來強調重要特征,提高了對磁瓦缺陷分類的準確率,減少了缺陷檢測分類的漏檢率和誤檢率,簡化了以往的二階段模型。實驗表明在磁瓦缺陷檢測中,改進的ResNet50模型比原模型mAP值高了1.3% ,在實際應用中也能夠在工業流程中有效去除有缺陷的電機磁瓦。后續可以將模型反應速度做得更快,并且能精準地對不同的缺陷進行識別分類,之后也能在此基礎上對模型進行更多的改善。