基于智能教育領域的多模態數據融合應用研究

劉沛然

(西安工業大學,陜西西安 710021)

大數據、物聯網以及人工智能技術的興起,推動了智能教育的發展。多模態數據融合逐漸受到智能教育領域相關人員的重視,作為一種新型數據融合技術,不僅有效還原了教學過程全貌,還可以深層次探究教育發展規律。

1 多模態數據類型與策略

1.1 多模態數據類型

外在行為表征數據主要包括行為個體的話語、表情、身體姿態、慣性動作等。在實際研究中,常見的外在行為表征數據主要有兩種:一種是文本、語言和視頻的多模態數據;另一種是基于面部標簽和身體姿態的多模態數據。通過對各類數據的融合分析,可以有效識別個體的行為表現以及心理活動[1-2]。

內在神經生理信息數據主要源自多模態生物識別技術的應用,通過各種外部的智能傳感設備,研究相關主體的身體健康指標、行為指標等,如腦電波、激素分泌水平、心率、呼吸等。通過對此類生理信息的采集,完成對行為主體的情緒特征和心理波動情況判別。

人機交互數據主要是行為主體與系統、線上平臺、移動端等界面完成交互操作后形成的行為數據,如文本輸入、慣性瀏覽、壓感、電觸反饋等等[3]。利用多模態人機交互數據,可以實現對主體活動的有效推測。

情境感知數據主要是對個體在特定時空情境下單一特征的表述,可以利用多源異構數據,實現對情境的刻畫,構成人、機、物、環境要素的精準測評[4]。

1.2 多模態數據融合策略

多模態數據主要利用信號傳輸中的數據判別以及計算機處理單元的深度學習功能,實現不同模態數據的綜合分析,利用不同模態數據的互補機制提取有效信息。現階段,多模態數據融合的策略主要包括以下三種。

(1)數據級融合策略。將多模態數據融合成為單一特征矩陣,并輸入到分類器當中,進行模擬訓練,實現對個體特征的精準識別。一般來說,數據級融合要求多個傳感器是同質的(傳感器觀測的是同一物理量),否則需要進行尺度校準。數據級融合不存在數據丟失的問題,得到的結果也較為準確,但對系統通信的穩定性要求較高。

(2)特征級融合策略。將不同的模態數據進行有效轉化,使數據成為高維特征表達,利用不同模態數據在高維空間的共性特征,選擇合理位置,對數據完成融合。特征級融合可大致為兩類:目標狀態融合、目標特性融合。

前者主要應用于多傳感器的目標跟蹤領域,后者是特征層聯合識別,即特征模式識別。

(3)決策級融合策略,根據模態數據的類型,選擇合適的分類器,進行有效數據邏輯判定,然后將每種模態分類器輸出的標簽值,進行打分,最終融合。常用的方式包括貝葉斯規則融合、平均值融合等[5]。

決策層融合在信息處理方面具有較高的靈活性,系統對信息傳輸穩定性要求較低,能夠有效地融合環境特征并做出反應,可以有效處理不同類型信息和非同步信息。

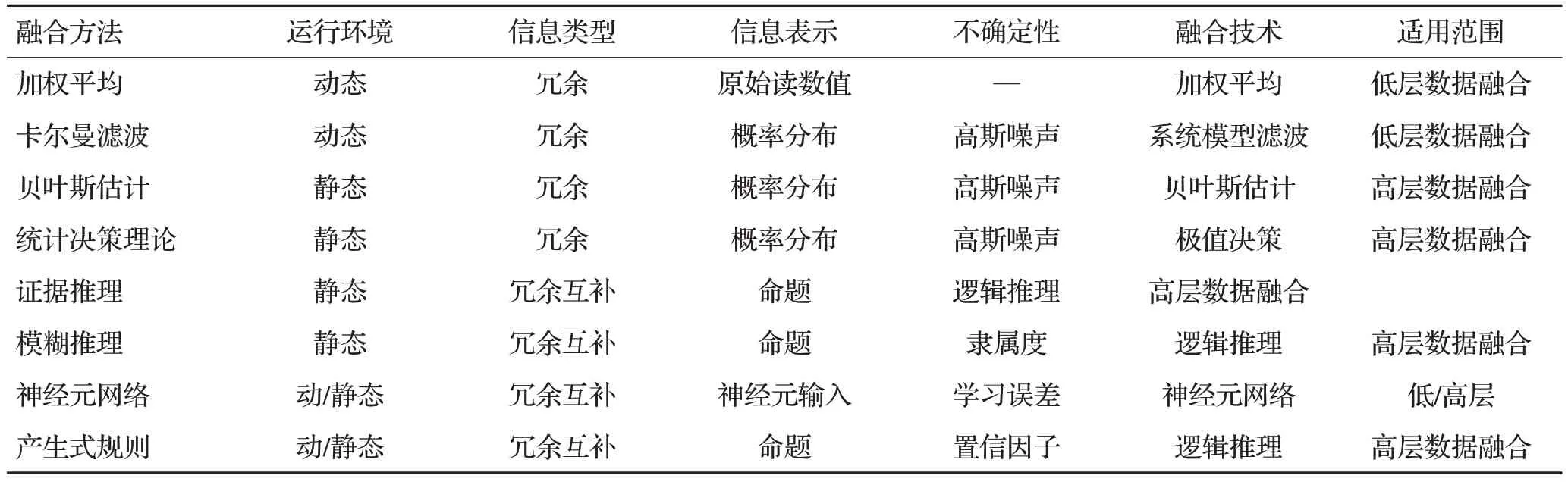

常用的數據融合方法及特征如表1所示。通常使用的方法確定,將依照應用環境的不同,完成選擇。由于各種技術之間的互補性,實際上常用兩種或多種方法組合的形式,完成多傳感器數據融合。

表1 常用數據融合方法

2 多模態數據融合在智能教育領域的應用策略

2.1 通過多模態數據,實現人機交互分析

隨著智能導學系統、教育機器人等智能教育產品的推廣和應用,學習過程中人機交互動作也越發頻繁,使可獲取的交互數據呈指數級增長。多模態人機交互分析能夠實現對學習者的學習行為分析判定以及心理狀態的分析,進而充分了解行為人的實際意圖,以提供更為精準的個性化服務。傳統的導學系統主要基于計算機外部設備實現交互動作,而在多模態交互當中,可以將外部設備的敲擊、搖動等動作輸入數據庫基礎處理反饋單元,結合指壓、電觸等完成信息獲取,并在數據分析單元完成融合,經判定后形成有效的模擬數據,從而輔助分析行為人的學習過程、學習效果等[6-7]。通過對學習過程中的身體姿態、表情、腦電以及人體神經元的弱點反饋等數據進行匯總“觀察”,還可實現多模態交互。而人工錄入系統的統計數據(如自我認知、心理測評等內容)經在多模態框架融合后,可構建面向學習者的情緒測評與認知分析系統,輔助進行定向思維引導。結合血壓監測儀、腦電圖、眼動儀等,識別學習者的生物信息,以此為學習者提供符合“慣性”行為的學習方式。對傳統的教育機器人,可以結合智能數據應用,構建人臉識別、語義識別以及語言組織與學習系統,在完成交互動作的同時,提升“動態”興趣。采集學習者的語音、動作、特征標簽等,使學習者在與“學習型”機器人的交流互動當中,形成語言能力和邏輯能力提升的良性循環。

2.2 通過多模態數據,實現學習中情緒識別

在多模態數據融合當中,通過自然語言處理、生物信息識別、語音識別、計算機視覺等,可詳細記錄“學習行為”過程中的心跳、眼動、語言、表情以及肢體動作等,并將此類數據進行整合,判定學習情緒,深入挖掘“學習行為”的動機、興趣點及投入情況等[8-9]。通過獲取學習中的血壓、心率、腦電信號等多模態情感數據,可以判別出好奇、無聊、期待、困惑等情緒。基于系統的識別判定結果,及時地發現問題,并給予改正。此外,通過多模態數據,也可以對學生的學習興趣自動監測,隨時了解在學習過程中出現的不同程度的情緒變化,完成數據統計,并進行對比分析,輸出判定結果數據,再根據數據對教學方法進行調整。與傳統教學過程中的情緒疏導與心理健康評測相比,這一模式更具有客觀性和精準性。

2.3 通過多模態數據,實現學習投入與監測識別

學習過程中,“投入程度”作為重要的人為測評指標,現階段仍無法實現有效量化,但是借助多模態數據融合,經人工測評錄入以及模擬分析能夠對“投入程度”完成基礎量化分析,結合參考標準對數據結果給予評定。可以將面部表情數據、紅外圖像數據、鼠標點擊數據等,整合為多模態數據集,通過CNN方法,對學習過程當中的具體參與情況,進行檢測,借助融合分析,得出學生的學習投入情況[10]。在多模態數據當中,還可以對完整學習過程的行為投入、認知投入以及情感投入進行綜合測評,以頻譜分析或顏色(深淺)圖像將判定成果以不同形式展示,能夠更直觀地獲取“投入程度”的數據分布,實現外部特征信息和生理特征信息的充分融合。

此外,在多模態數據融合下,可以根據學習過程中內在生理信息和外顯行為的結合,了解學習表現情況。如通過設定不同的游戲環節,構建面部表情、眼動、點擊流等相關的多模態數據集,通過Lasso回歸模型等方式,實現對學習過程中技能發展情況以及任務處理能力的判定。利用學生在不同類型場合的出席次數、座位排布、注意力集中情況、課業時長等行為表現和交互數據,構建多模態數據集,結合計算機系統的學習與分析能力,充分了解學生在混合課堂模式下可能出現的各類表現,因材施教。

3 結語

隨著社會的發展,多模態數據融合逐漸成為大數據分析和人工智能領域研究的重要內容。文章在闡述的多模態數據融合的基本特征和內容的同時,引入教育領域的數字化建設以及交互數據融合,對發展和研究方向進行簡要闡述,對研究多模態數據融合的應用及發展理念具有一定的現實意義。