細(xì)胞病理圖像質(zhì)量評價(jià)方法

彭晨輝 劉皓晨 高瑋寧 何勇軍

摘? 要:智能病理輔助診斷系統(tǒng)可以輔助醫(yī)生診斷宮頸癌,篩除低質(zhì)量的樣本圖像能夠有效減少智能病理輔助診斷系統(tǒng)的漏診和誤診,提高診斷的效率和準(zhǔn)確率。目前智能輔助診斷領(lǐng)域沒有完整的細(xì)胞病理圖像質(zhì)量評價(jià)的方法,因此提出一種細(xì)胞病理圖像質(zhì)量評價(jià)方法。利用病理診斷知識和醫(yī)生經(jīng)驗(yàn),歸納總結(jié)出圖像質(zhì)量評價(jià)指標(biāo),包括圖像有效視野、柵格樣成像、清晰度、染色標(biāo)準(zhǔn)、鱗狀上皮細(xì)胞數(shù)量、細(xì)胞團(tuán)面積和臟污面積占比等。首先針對圖像有效視野和柵格樣成像利用圖像分割和圖像紋理特征提取的方法進(jìn)行評價(jià);再采用引入通道注意力的ResNet-34模型對清晰度進(jìn)行評價(jià);然后對圖像進(jìn)行顏色反卷積處理,獲得染色劑通道灰度值,用于判斷細(xì)胞的染色是否標(biāo)準(zhǔn);再通過目標(biāo)檢測模型Yolov5s,對鱗狀上皮細(xì)胞、細(xì)胞團(tuán)和臟污進(jìn)行檢測;最后利用回歸模型為細(xì)胞圖像質(zhì)量評分,并將結(jié)果應(yīng)用到智能輔助診斷項(xiàng)目中。實(shí)驗(yàn)表明,方法規(guī)范了細(xì)胞病理圖像質(zhì)量評價(jià)的流程,避免由于主觀評價(jià)帶來的差異,提高了病理診斷效率和準(zhǔn)確率。

關(guān)鍵詞:智能病理輔助診斷系統(tǒng);圖像質(zhì)量評價(jià);金字塔圖像;圖像特征

DOI:10.15938/j.jhust.2023.05.010

中圖分類號: TP315.69

文獻(xiàn)標(biāo)志碼: A

文章編號: 1007-2683(2023)05-0075-10

收稿日期: 2022-05-02

基金項(xiàng)目: 黑龍江省自然科學(xué)基金杰出青年項(xiàng)目(JJ2019JQ0013).

作者簡介:

彭晨輝(1978—),男,高級工程師;

劉皓晨(1996—),女,碩士研究生.

通信作者:

何勇軍(1980—),男,博士,博士研究生導(dǎo)師,E-mail:holywit@163.com.

Quality Evaluation Methods for Cytopathological Cell Image

PENG Chenhui1,? LIU Haochen2,? GAO Weining2,? HE Yongjun3

(1.Information Center, The Sixth Affiliated Hospital of Harbin Medical University, Harbin 150080, China;

2.School of Computer Science and Technology, Harbin University of Science and Technology, Harbin 150080,China;

3.School of Computer Science and Technology, Harbin Institute of Technology, Harbin 150080,China)

Abstract:The intelligent pathological auxiliary diagnosis system can assist doctors in diagnosing cervical cancer, and screening out low-quality sample images can effectively reduce the missed diagnosis and misdiagnosis of the intelligent auxiliary diagnosis system, and improve the efficiency and accuracy of diagnosis. At present, there is no complete cytopathological image quality evaluation method in the field of intelligent auxiliary diagnosis, so we propose a cytopathological image quality evaluation method. Using the knowledge of pathological diagnosis and the experience of doctors, the image quality evaluation indicators were summarized, including the effective field of view, grid-like imaging, sharpness, staining standard, the number of squamous epithelial cells, the area of cell clusters and the proportion of dirty areas. First, the effective field of view and grid-like imaging are evaluated by image segmentation and image texture feature extraction; the ResNet-34 model with channel attention is used to evaluate the sharpness; then the color deconvolution is performed on the image. The gray value of the dye channel is obtained, which is used to judge whether the staining of cells is standard. Then, the target detection model Yolov5s is used to detect squamous epithelial cells, cell clusters and dirt. Finally, the regression model is used to score the cell image quality, and the results are applied to the intelligent auxiliary diagnosis project. Experiments show that the method in this paper standardizes the process of cytopathological image quality evaluation, avoids differences caused by subjective evaluation, and improves the efficiency and accuracy of pathological diagnosis.

Keywords:intelligent pathology assistant diagnosis system; image quality evaluation; pyramid image; object detection; image features

0? 引? 言

病理切片數(shù)字化積累了大量的數(shù)據(jù),是人工智能輔助診斷的重要前提。圖像質(zhì)量不合格會(huì)嚴(yán)重影響人工智能診斷系統(tǒng)的效率和準(zhǔn)確率,甚至出現(xiàn)漏診和誤診[1]。因此急需細(xì)胞病理數(shù)字圖像質(zhì)量評價(jià)方法。

圖像質(zhì)量的客觀評價(jià)方法是由計(jì)算機(jī)按照算法計(jì)算出的圖像質(zhì)量評價(jià)指標(biāo),客觀評價(jià)使用數(shù)學(xué)模型給出量化值,使用圖像處理技術(shù)評價(jià)失真圖像,操作簡單,已經(jīng)成為圖像質(zhì)量評價(jià)研究的重點(diǎn)。由于深度學(xué)習(xí)在許多計(jì)算機(jī)視覺任務(wù)中取得成功,基于深度學(xué)習(xí)的圖像質(zhì)量評價(jià)方法蓬勃發(fā)展[2]。Hosu等人通過對多種基線網(wǎng)絡(luò)進(jìn)行測試,證實(shí)了語義特征在圖像質(zhì)量評價(jià)領(lǐng)域的有效性[3]。Zhang等[4]提出了一種雙流網(wǎng)絡(luò)結(jié)構(gòu)來預(yù)測合成圖像和真實(shí)圖像的失真,其中真實(shí)圖像預(yù)測流采用VGG-16進(jìn)行特征提取。Li等[5]提出使多批次ResNet-50提取特征的統(tǒng)計(jì)數(shù)據(jù)進(jìn)行質(zhì)量預(yù)測。姚旺等[6]將多通道網(wǎng)絡(luò)引入到FR-IQA算法中,獲取理想?yún)⒖紙D像和失真圖像的梯度差異圖,將梯度差異圖和失真圖像同時(shí)輸入到多通道網(wǎng)絡(luò)中學(xué)習(xí)質(zhì)量分?jǐn)?shù)。王同罕等[7]提取失真圖像的梯度特征,用于全參考圖像質(zhì)量評價(jià)。也有一些學(xué)者基于醫(yī)學(xué)領(lǐng)域提出一些質(zhì)量評價(jià)方法,Senaras等[8]就組織病理學(xué)圖像評價(jià)提出一種質(zhì)量評價(jià)方法流程,綜合評價(jià)了噪聲,清晰度,偽影等指標(biāo),可以在各個(gè)方面評價(jià)組織病理圖像的質(zhì)量,并且開源了算法代碼。Shakhawat H M等[9]對組織病理圖像進(jìn)行手工特征提取,將提取到的特征輸入到支持向量機(jī)(support vector machine,SVM)分類器,用以檢測組織病理圖像中的偽影。

現(xiàn)有圖像評價(jià)方法的研究大多都是基于自然圖像,在醫(yī)學(xué)領(lǐng)域沒有完整的圖像質(zhì)量評價(jià)方法,且清晰度評價(jià)函數(shù)只能采用有參考的方式判斷,在細(xì)胞病理圖像領(lǐng)域適應(yīng)性差[2],因此我們通過研讀《宮頸液基細(xì)胞學(xué)的數(shù)字病理圖像采集與圖像質(zhì)量控制中國專家共識》(簡稱,《共識》)和TBS(The Bethesda system)系統(tǒng)[10],總結(jié)細(xì)胞病理圖像評價(jià)的關(guān)鍵因素,參考自然圖像的評價(jià)方法,提出針對細(xì)胞病理圖像評價(jià)的方法,從圖像有效視野、柵格樣成像、清晰度、染色標(biāo)準(zhǔn)、鱗狀上皮細(xì)胞數(shù)量、細(xì)胞團(tuán)面積和臟污面積占比七個(gè)指標(biāo)對全視野數(shù)字圖像(whole slide images,WSI)整體質(zhì)量可靠性進(jìn)行評價(jià)。

針對圖像有效視野和柵格樣成像本文選擇使用圖像分割和圖像紋理特征提取的方法進(jìn)行評價(jià);采用引入注意力通道的ResNet-34模型對清晰度進(jìn)行評價(jià);對圖像進(jìn)行顏色反卷積處理,獲得染色劑通道灰度值,用于判斷細(xì)胞染色是否標(biāo)準(zhǔn);最后,通過目標(biāo)檢測模型Yolov5s,對鱗狀上皮細(xì)胞、細(xì)胞團(tuán)和臟污進(jìn)行檢測。根據(jù)提取出來的圖像特征指標(biāo),對細(xì)胞病理圖像的質(zhì)量進(jìn)行綜合評分,為智能病理輔助診斷系統(tǒng)提供標(biāo)本的滿意度評價(jià)。本方法旨在減少需要醫(yī)生或使用人員對圖像質(zhì)量進(jìn)行主觀評分的工作量,幫助規(guī)范病理診斷流程,為智能病理輔助診斷系統(tǒng)提供有力支持,提高病理診斷效率和準(zhǔn)確率。

1? 方法介紹

根據(jù)TBS診斷標(biāo)準(zhǔn)和《共識》,本文通過以下7個(gè)指標(biāo)對圖像質(zhì)量進(jìn)行評價(jià):

1)有效視野是否完整;

2)圖像是否存在柵格樣成像;

3)染色是否標(biāo)準(zhǔn);

4)圖像清晰度;

5)鱗狀上皮細(xì)胞數(shù)目;

6)臟污面積占比;

7)細(xì)胞團(tuán)遮擋面積。

細(xì)胞圖像質(zhì)量評價(jià)方法的關(guān)鍵在于圖像特征的提取,WSI圖像的數(shù)據(jù)量非常大,通常WSI圖像包含上億數(shù)量級的像素。WSI圖像系統(tǒng)采用多分辨率金字塔模型,高放大率可獲得高分辨率圖像,低放大率可獲得低分辨率圖像。高分辨率圖像包含更精細(xì)的圖像細(xì)節(jié),有助觀察細(xì)胞結(jié)構(gòu)與形態(tài),便于分析和診斷。用金字塔分割的方式,獲得金字塔不同層的圖像[11]。對不同特征的計(jì)算需求選擇合適的分辨率,能有效提高運(yùn)算的速度,減少計(jì)算資源浪費(fèi)。圖像的有效視野是否完整、圖像是否存在柵格樣成像的判別在低分辨率金字塔圖像中即可完成判別,故上述兩個(gè)特征在金字塔第六層圖像中完成評價(jià);在金字塔圖像的第五層,完成染色標(biāo)準(zhǔn)、圖像清晰度的評價(jià);高分辨率圖像包含更精細(xì)的圖像細(xì)節(jié),有助于觀察細(xì)胞結(jié)構(gòu)與形態(tài),因此在金字塔圖像的第二層完成臟污面積占比、鱗狀上皮細(xì)胞數(shù)量和細(xì)胞團(tuán)數(shù)量的評價(jià)。將以上7個(gè)圖像特征指標(biāo)輸入XGBoost模型中[12],獲得細(xì)胞病理圖像的質(zhì)量分?jǐn)?shù),依據(jù)分?jǐn)?shù)給出圖像在智能病理輔助診斷系統(tǒng)中的應(yīng)用。上述細(xì)胞病理圖像質(zhì)量評價(jià)流程如圖1所示。

1.1? 圖像有效視野及柵格樣成像判定方法

在掃描成像過程中,掃描鏡頭不潔凈會(huì)造成圖像有效視野被遮擋,成像不清等。此外,還會(huì)出現(xiàn)白平衡失調(diào)、掃描對準(zhǔn)不精確等,圖像呈現(xiàn)柵格樣成像等問題,導(dǎo)致細(xì)胞不可辨認(rèn),影響細(xì)胞判讀閱片診斷。利用圖像標(biāo)本區(qū)域與背景區(qū)域有較大的差異的特點(diǎn)采用圖像分割方法,獲得有效視野的位置,判斷其是否完整;根據(jù)柵格樣成像的圖像與正常圖像紋理特征的差異,對圖像是否存在柵格樣成像進(jìn)行判斷。

圖像金字塔是指在同一的空間參照下,根據(jù)用戶的需求以不同的分辨率進(jìn)行存儲(chǔ)與顯示,形成分辨率由粗到細(xì)、數(shù)據(jù)量從大到小的金字塔結(jié)構(gòu),金字塔中的每一級都是一幅圖像。按需求選擇合適的分辨率能夠有效減少運(yùn)算的數(shù)據(jù)量。觀察圖像有效視野是否完整以及是否存在柵格樣成像,在金字塔圖像的第6層可以完成判定,同時(shí)運(yùn)算數(shù)據(jù)量最小,因此在提取圖像有效視野時(shí),選擇提取圖像金字塔的第6層,獲得一張完整視野圖像I,利用圖像分割方法分割圖像I,獲得二值圖像T,對二值圖像T做預(yù)處理將圖像中所有輪廓連成一個(gè)大輪廓,得到樣本的有效視野。然后根據(jù)有效視野輪廓坐標(biāo),獲得其外接矩形,判斷其外接矩形在整張圖像中的位置,確定有效視野是否完整,若完整則記為f1=1,若不完整則記為f1=0。根據(jù)獲得的大輪廓,提取輪廓以外區(qū)域的紋理特征值T,然后對特征值做聚類分析,獲得標(biāo)準(zhǔn)圖像的紋理特征值范圍,判斷紋理特征值T是否在標(biāo)準(zhǔn)圖像的紋理特征值范圍內(nèi),若在標(biāo)準(zhǔn)圖像的紋理特征值范圍內(nèi)則不存在柵格樣成像,判定為合格記為f2=1,若存在柵格樣成像則記為f2=0。

1.2? 無參考評價(jià)的圖像清晰度判定方法

傳統(tǒng)的圖像清晰度評價(jià)函數(shù)都是采用有參考評價(jià)的評價(jià)思路,對于不同視野下的圖像無法統(tǒng)一評價(jià),也缺乏對WSI圖像的清晰度評價(jià)的方法,因此本文提出一種針對WSI圖像無參考評價(jià)的清晰度評價(jià)方法。首先獲取不同焦平面的掃描圖像,不同焦平面與聚焦平面相差的距離作為評價(jià)標(biāo)簽,并對獲得的圖像進(jìn)行增廣處理,以此制作數(shù)據(jù)集對分類模型進(jìn)行訓(xùn)練,使其對不同焦平面的圖像進(jìn)行準(zhǔn)確地分類,從而用于WSI圖像質(zhì)量的評價(jià)。

1)判別模型的訓(xùn)練

本方法利用ResNet-34神經(jīng)網(wǎng)絡(luò)進(jìn)行特征提取,并且為了進(jìn)一步提高模型分類準(zhǔn)確率在Res-Net34網(wǎng)絡(luò)中添加通道注意力機(jī)制模塊[13]和最大值最小值池化,然后輸入全連接層進(jìn)行分類[14],利用反向傳播對網(wǎng)絡(luò)參數(shù)進(jìn)行更新和微調(diào),最后進(jìn)行分類,模型如圖2所示。

通過ResNet-34提取圖像特征,并根據(jù)特征向量對圖像進(jìn)行清晰度分類。與傳統(tǒng)的清晰度評價(jià)函數(shù)相比,不僅可以提取到更多的圖像特征,而且可以無參考地評價(jià)圖像是否清晰。通過深度學(xué)習(xí)端到端的優(yōu)勢,不需要提前手動(dòng)進(jìn)行特征提取。將本模型作為圖像清晰度判斷模型,可以有效地對清晰圖像和模糊圖像進(jìn)行分類。

2)數(shù)據(jù)預(yù)處理與增廣

為了提高模型的泛化能力,避免分類模型受光照、顏色等外在環(huán)境影響,在模型訓(xùn)練測試之前對訓(xùn)練數(shù)據(jù)進(jìn)行數(shù)據(jù)預(yù)處理操作。為了加快訓(xùn)練梯度下降的求解速度,進(jìn)而加快網(wǎng)絡(luò)模型收斂。對圖像數(shù)據(jù)進(jìn)行通道維度的歸一化操作。

為了使數(shù)據(jù)的分布更均勻,減少模型學(xué)習(xí)到數(shù)據(jù)分布的可能行,提高模型的模型精度,對圖像數(shù)據(jù)進(jìn)行標(biāo)準(zhǔn)化操作。模型訓(xùn)練過程中,在數(shù)據(jù)量小網(wǎng)絡(luò)模型復(fù)雜的情況下容易出現(xiàn)過擬合現(xiàn)象,導(dǎo)致模型在實(shí)際訓(xùn)練數(shù)據(jù)上效果不好。因此對數(shù)據(jù)進(jìn)行數(shù)據(jù)增強(qiáng)以增加數(shù)據(jù)量。

由于不同醫(yī)院的細(xì)胞病理圖像的染色效果可能不同,為了降低模型對顏色的敏感性,提升模型的魯棒性,采用交換原始數(shù)據(jù)顏色通道的數(shù)據(jù)增廣策略。該操作只改變離焦圖像的顏色表現(xiàn),不會(huì)影響圖像中蘊(yùn)含的離焦信息。數(shù)據(jù)增強(qiáng)結(jié)果如圖3所示。

圖像清晰度評價(jià)中,若符合要求,則指標(biāo)f3=1,不符合則f3=0。

1.3? 基于顏色反卷積的染色標(biāo)準(zhǔn)評價(jià)

臨床上對組織圖像的細(xì)胞核和基質(zhì)進(jìn)行染色最常規(guī)染色方法是蘇木精和伊紅染色(H&E染色),蘇木精(Hematoxylin)將細(xì)胞核染成深藍(lán)紫色;伊紅(Eosin)將細(xì)胞質(zhì)染成粉紅色。在顯微鏡下,使用這兩種染料可以明確區(qū)分細(xì)胞核和基質(zhì)。在H&E癌癥組織病理學(xué)圖像中,醫(yī)生可以通過分析癌癥組織病理學(xué)圖像中細(xì)胞核的信息,完成臨床診斷。但是細(xì)胞病理圖像中常常會(huì)出現(xiàn)染色模糊,染色程度不均等,都影響著醫(yī)生的診斷結(jié)果。

為了評價(jià)樣本的染色情況是否符合標(biāo)準(zhǔn),本文使用顏色反卷積的方式對圖像進(jìn)行染色分離[15],對分離后的通道圖像進(jìn)行閾值分割獲得蘇木精通道和伊紅通道的圖像掩膜,圖像掩模與原圖像進(jìn)行圖像與運(yùn)算就可以獲取到蘇木精和伊紅染色像素所在位置,然后計(jì)算蘇木精和伊紅像素的平均灰度值。染色分離及灰度計(jì)算流程圖如圖4所示。

本文中使用自適應(yīng)顏色反卷積對原始圖像進(jìn)行染色分離后,再通過大津法閾值分割對分離后的通道圖像進(jìn)行閾值分割,獲得蘇木精通道和伊紅通道的圖像掩膜。大津法是一種圖像灰度自適應(yīng)的閾值分割算法[16],按照圖像上灰度值的分布,將圖像分成背景和前景兩部分看待,前景就是我們要按照閾值分割出來的部分。圖像掩模與原圖像進(jìn)行圖像與運(yùn)算就可以獲取到蘇木精和伊紅染色像素所在位置,然后計(jì)算蘇木精和伊紅像素的平均灰度值。

為了確定蘇木精和伊紅染色的染色標(biāo)準(zhǔn),本文對醫(yī)生提供的標(biāo)準(zhǔn)樣片進(jìn)行聚類分析,確定最佳的染色強(qiáng)度。在病理專家的幫助下,選取了200張醫(yī)生認(rèn)為蘇木精和伊紅染色良好的樣本。因?yàn)槿旧珮颖咎卣骶哂姓龖B(tài)分布的概率分布特性,進(jìn)行聚類分析后確定出伊紅通道平均灰度值位于185~190之間為伊紅染色標(biāo)準(zhǔn)范圍,蘇木精通道平均灰度值位于180~200為蘇木精染色標(biāo)準(zhǔn)范圍,均在范圍內(nèi)記染色特征f4=1,反之f4=0。

1.4? 基于YOLOv5s的圖像特征提取

為了實(shí)現(xiàn)對鱗狀上皮細(xì)胞計(jì)數(shù)、細(xì)胞團(tuán)遮擋面積和臟污面積占比的計(jì)算,首先要采用要對鱗狀上皮細(xì)胞、細(xì)胞團(tuán)和臟污區(qū)域進(jìn)行目標(biāo)檢測。本方法采用YOLOv5s模型對鱗狀上皮細(xì)胞和細(xì)胞團(tuán)進(jìn)行目標(biāo)檢測[17]。YOLOv5s網(wǎng)絡(luò)結(jié)構(gòu)圖如圖5所示。

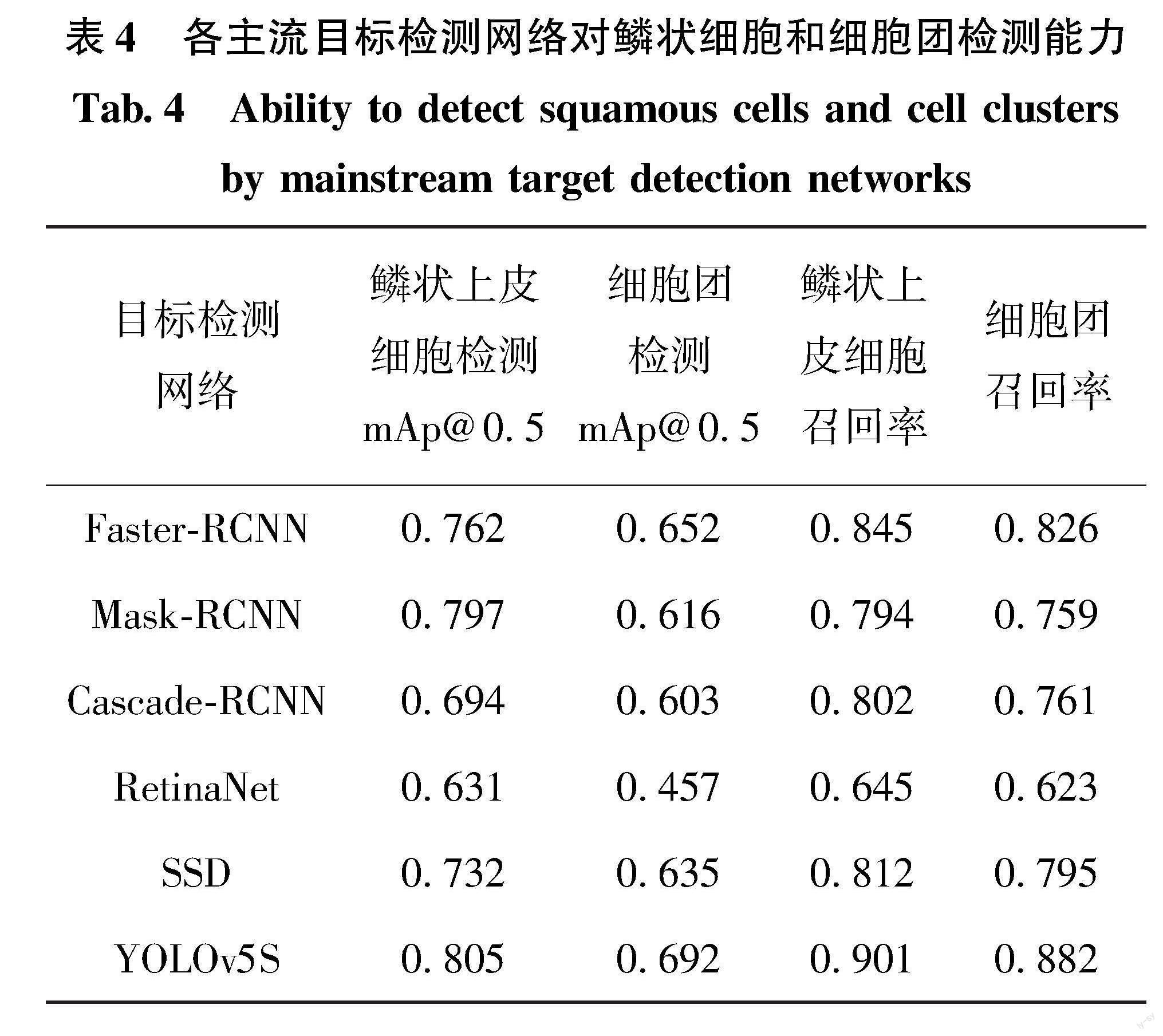

使用YOLOv5s完成對鱗狀上皮細(xì)胞、細(xì)胞團(tuán)和臟污區(qū)域的目標(biāo)檢測后,根據(jù)目標(biāo)檢測結(jié)果,通過統(tǒng)計(jì)圖像中被檢測為鱗狀上皮細(xì)胞的標(biāo)簽數(shù)量完成鱗狀上皮細(xì)胞的計(jì)數(shù)[18-19];通過對檢測為細(xì)胞團(tuán)和臟污的區(qū)域進(jìn)行閾值分割,可以得出細(xì)胞團(tuán)和臟污區(qū)域的面積占比。

根據(jù)TBS診斷標(biāo)準(zhǔn),鱗狀上皮細(xì)胞數(shù)量應(yīng)該在5000~8000范圍內(nèi)、細(xì)胞團(tuán)數(shù)量在50以下及臟污面積占比小于25%,因此可按公式計(jì)算得到圖像特征f5-f7的值,f5-f7的計(jì)算公式分別為式(1),式(3),式(4):

f5=0x≤3000,x>10000

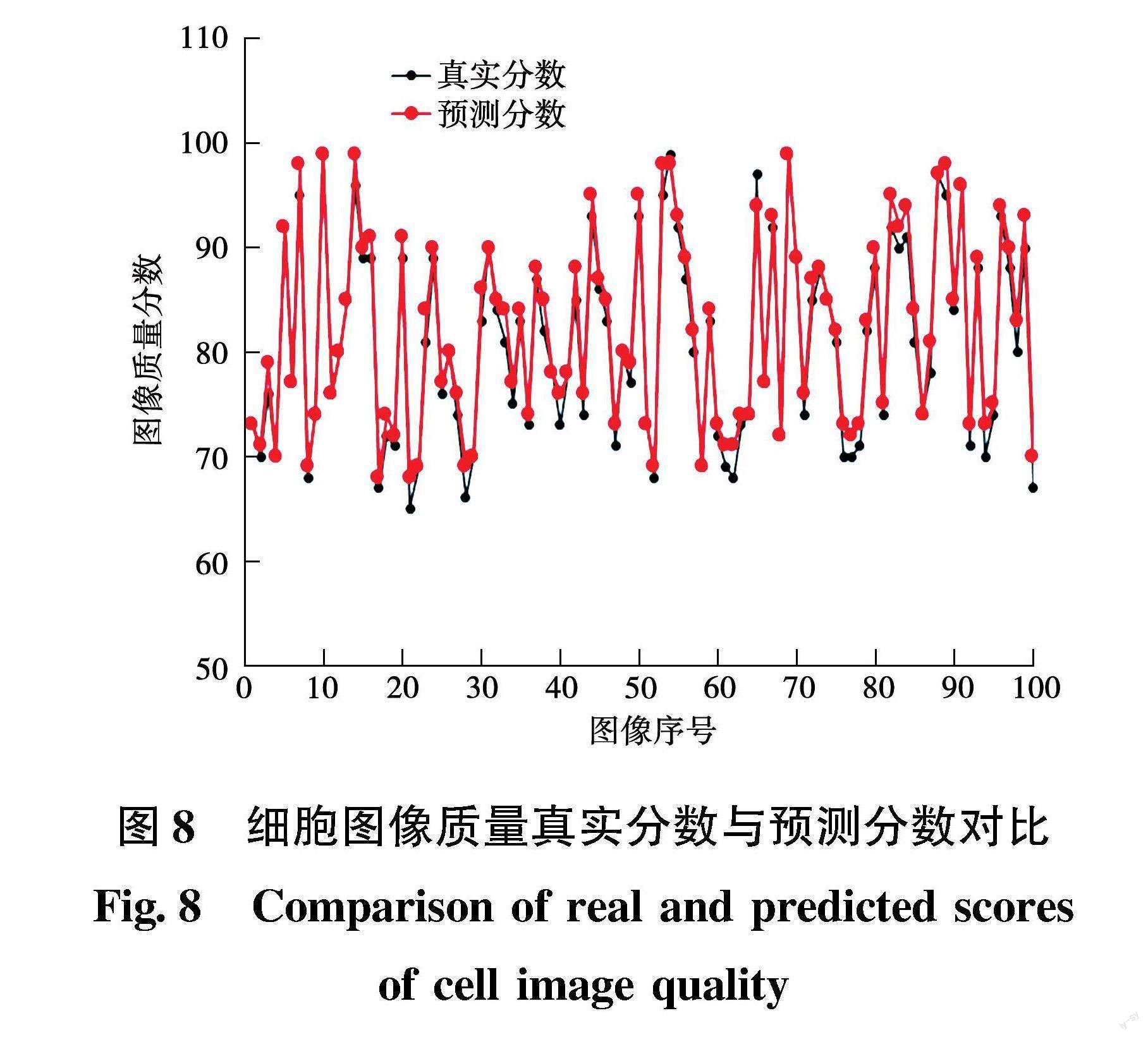

x/50003000 15000 1-(x-8000)/80008000 S=Scell+Scell_mass+Sdirty (2) f6=1-Scell_mass/S(3) f7=1-Sdirty/S(4) 其中:x為鱗狀上皮細(xì)胞的數(shù)量;Scell為鱗狀上皮細(xì)胞面積;Scell_mass為細(xì)胞團(tuán)面積;Sdirty為臟污部分的面積。 1.5? 圖像質(zhì)量評分方法 XGBoost高效地實(shí)現(xiàn)梯度提升決策樹(grandient boosting decision tree,GBDT),有較高的計(jì)算效率。在本次任務(wù)中將細(xì)胞病理圖像的7個(gè)指標(biāo)輸入XGBoost,完成特征指標(biāo)與圖像質(zhì)量分?jǐn)?shù)的映射。選取100張細(xì)胞病理圖像,由經(jīng)驗(yàn)豐富的病理醫(yī)生依照TBS診斷標(biāo)準(zhǔn)對細(xì)胞病理圖像進(jìn)行打分,打分結(jié)果作為細(xì)胞病理圖像的真實(shí)分?jǐn)?shù),與XGBoost模型輸出的細(xì)胞病理圖像質(zhì)量分?jǐn)?shù)進(jìn)行對比,驗(yàn)證XGBoost回歸模型的預(yù)測性能。 XGBoost是由k個(gè)決策樹組成的一個(gè)加法運(yùn)算式,在給出n個(gè)實(shí)例,m維特征的情況下,XGBoost可以表示為 D={(xi,yi)}(|D|=n,xi∈Rm,yi∈R)(5) i=∑kt=1ft(xi),ft∈F(6) 其中:fk為第k個(gè)決策樹;i為第i個(gè)樣本的預(yù)測值;F是由K個(gè)基函數(shù)組成的函數(shù)空間。根據(jù)TBS診斷標(biāo)準(zhǔn)和細(xì)胞形態(tài)學(xué)特征,提取7個(gè)特征對XGBoost進(jìn)行訓(xùn)練,Rm代表第m個(gè)特征。 上述方法中提取到的圖像特征f1~f7輸入XGBoost模型,輸出最終的細(xì)胞圖像質(zhì)量評價(jià)分?jǐn)?shù)。 根據(jù)得到的細(xì)胞圖像質(zhì)量分?jǐn)?shù),對宮頸液基細(xì)胞WSI的整體質(zhì)量進(jìn)行可信度評估。細(xì)胞圖像質(zhì)量分?jǐn)?shù)在5分以及上評定為整體“可信度好”,5分以下評定為“可信度差”。在智能病理輔助診斷系統(tǒng)中,對于可信度好的圖像,可用于輔助醫(yī)生判讀項(xiàng)目的研究測試或應(yīng)用,并予以存儲(chǔ)。對于可信度差的圖像,無法提供可靠的判讀結(jié)果,建議重新掃描、存儲(chǔ)。 2? 實(shí)驗(yàn)分析 2.1? 無參考評價(jià)的圖像清晰度判定方法實(shí)驗(yàn) 本次使用的訓(xùn)練數(shù)據(jù)包含16張不同的H&E染色的全視野數(shù)字切片。對于每一張幻燈片,我們用全視野數(shù)字切片掃描儀在20倍放大倍數(shù)下掃描一個(gè)約為6毫米面積的感興趣區(qū)域(region of interest, ROI),像素大小約為0.98μm×0.98μm 。對于每個(gè)ROI,由熟練的操作員手動(dòng)選取25個(gè)聚焦點(diǎn),并根據(jù)所選聚焦點(diǎn)進(jìn)行聚焦,以確保焦平面與樣本高度對齊良好。然后在[-2.5μm,+2.5μm]之間對聚焦平臺(tái)加入固定擾動(dòng),以獲得相同的ROI以及相同ROI的不同焦平面圖像,距離準(zhǔn)焦平面越遠(yuǎn)的圖像模糊程度越高,反之模糊程度越低。最后,將所有感興趣區(qū)域圖像劃分為512×512像素大小的瓦片圖,共18萬張瓦片圖。將偏移量在[-0.5,+0.5]之間的瓦片圖,標(biāo)記為清晰圖片,其余圖像標(biāo)記為模糊。由于模糊的瓦片圖的數(shù)量(12萬)大于聚焦瓦片數(shù)量(6萬),因此隨機(jī)模糊瓦片圖隨機(jī)抽取10.8萬個(gè)樣本進(jìn)行數(shù)據(jù)集構(gòu)造,以防止分類訓(xùn)練集的不平衡,最后10%的瓦片圖被選為驗(yàn)證集。數(shù)據(jù)集中的所有樣本是完全匿名的。 首先,為了驗(yàn)證ResNet-34模型分類的高效性,分別選用ResNet-34,ResNet-18,VGG-16進(jìn)行訓(xùn)練,將特征提取結(jié)果直接輸入到SVM進(jìn)行分類。各種網(wǎng)絡(luò)的分類準(zhǔn)確率如表1所示。從表1中可以看出,與準(zhǔn)焦平面相鄰的焦平面分類準(zhǔn)確率低,與準(zhǔn)焦平面相距越遠(yuǎn)的分類準(zhǔn)確率越高。因?yàn)樵竭h(yuǎn)離準(zhǔn)焦平面,圖片越模糊,分類也就越容易。然而上述模型中其他3個(gè)分類模型在焦點(diǎn)附近的分類準(zhǔn)確率較低,ResNet-34在焦點(diǎn)附近的準(zhǔn)確率遠(yuǎn)高于其他方法,并且平均分類準(zhǔn)確率最高。為了更加清晰地看出各網(wǎng)絡(luò)分類準(zhǔn)確率之間的關(guān)系繪制分類準(zhǔn)確率點(diǎn)線圖,從圖6可以看出,ResNet-34對各個(gè)焦平面都有較高的分類準(zhǔn)確率。 為了驗(yàn)證注意力機(jī)制的有效性進(jìn)行消融實(shí)驗(yàn),選取ResNet-34與加入通道注意力機(jī)制的ResNet-34在3個(gè)測試集上進(jìn)行測試,平均分類準(zhǔn)確率如表2所示,在3個(gè)測試集上,本文提出的方法均高于原本ResNet-34,這表明引入注意力機(jī)制模塊可以有效地提升原ResNet-34的分類準(zhǔn)確率。 ResNet-34網(wǎng)絡(luò)結(jié)構(gòu)中使用最大值池化和平均池化,最大池化和平均池化可以有效地對數(shù)據(jù)進(jìn)行降維度。但是在清晰度判斷的應(yīng)用場景下,平均池化和最大池化導(dǎo)致圖像高頻和低頻信息模糊,造成特征信息缺失,進(jìn)而影響清晰模糊分類準(zhǔn)確率。為了解決此問題,將ResNet-34網(wǎng)絡(luò)中的池化層改成最大最小值池化,具體操作如下:將特征向量同時(shí)做最大值和最小值池化,然后將池化后的特征向量進(jìn)行連接,輸入到全連接層。為了驗(yàn)證最大值+最小值池化的有效性進(jìn)行消融實(shí)驗(yàn),在ResNet-34+通道注意力機(jī)制的網(wǎng)絡(luò)結(jié)構(gòu)基礎(chǔ)上,最后一層的池化操作中分別使用最大值池化,最小值池化,平均池化和最大值+最小值池化進(jìn)行驗(yàn)證。在3個(gè)數(shù)據(jù)集中,進(jìn)行分類準(zhǔn)確率驗(yàn)證,實(shí)驗(yàn)結(jié)果如表3所示,其中,最小值池化在3個(gè)測試集上的分類準(zhǔn)確高于平均池化和最大值池化,最大池化在3個(gè)測試集的平均分類準(zhǔn)確率較低,最大值+最小值池化的在3個(gè)測試集上的平均準(zhǔn)確率更高,平均準(zhǔn)確率提高約2%。 為了驗(yàn)證網(wǎng)絡(luò)的計(jì)算效率,本節(jié)中提出的方法與多種清晰度評價(jià)與Yu′s CNN[20]、Brenner、Sobel、SMD、Roberts、CPBD、JNB、EMBM[21]清晰度評價(jià)方法進(jìn)行對比,各方法運(yùn)行平均時(shí)間如圖7所示。從上述實(shí)驗(yàn)可以看出,本節(jié)提出的基于深度學(xué)習(xí)的清晰度判定方法,不僅有著優(yōu)秀的判定準(zhǔn)確率,而且計(jì)算效率也由于多數(shù)的評價(jià)方法。 2.2? 基于YOLOv5s的圖像特征提取實(shí)驗(yàn) 對比了多種目標(biāo)檢測網(wǎng)絡(luò)對于鱗狀上皮細(xì)胞和細(xì)胞團(tuán)的檢測能力,對比目前主流目標(biāo)檢測的檢測能力,目前主流目標(biāo)檢測模型對于鱗狀上皮細(xì)胞和細(xì)胞團(tuán)檢測的召回率和mAp@0.5如表4所示。目標(biāo)檢測中使用mAP(Mean Average Precision,平均精度均值)來評估檢測準(zhǔn)確度,mAP值越大目標(biāo)檢測效果越好。 從上表可以看出,YOLOv5s在細(xì)胞團(tuán)和鱗狀上皮細(xì)胞的mAp@0.5和召回率效果都很好,可以用于鱗狀上皮細(xì)胞計(jì)數(shù)和細(xì)胞團(tuán)檢測。 2.3? 圖像質(zhì)量評分方法驗(yàn)證 為了驗(yàn)證XGBoost回歸模型的預(yù)測性能,選取100張細(xì)胞病理圖像,由經(jīng)驗(yàn)豐富的病理醫(yī)生依照TBS診斷標(biāo)準(zhǔn)對圖像質(zhì)量進(jìn)行打分,打分結(jié)果作為細(xì)胞病理圖像質(zhì)量的真實(shí)分?jǐn)?shù)。XGBoost的參數(shù)設(shè)置為:學(xué)習(xí)率范圍設(shè)置為0.01~0.9,迭代次數(shù)范圍設(shè)置為100~10000,隨機(jī)采樣比例范圍設(shè)置為0~0.9。通過搜索遍歷,最終確定本文所使用的XGBoost模型樹的最佳參數(shù)設(shè)置。其中選擇提升器選用gbtree,學(xué)習(xí)率設(shè)置為0.05,樹的最大高度設(shè)置為3,葉子最小權(quán)重和設(shè)置為1,樣本采樣比率設(shè)置為0.2,迭代次數(shù)設(shè)置為1000,評估指標(biāo)選用MAPE,任務(wù)函數(shù)選擇Gamma。實(shí)際分?jǐn)?shù)與預(yù)測分?jǐn)?shù)的對比圖如圖8所示。 實(shí)驗(yàn)表明XGBoost可以準(zhǔn)確地評價(jià)細(xì)胞病理圖像質(zhì)量,并且符合TBS診斷標(biāo)準(zhǔn)。 2.4? 評價(jià)性能實(shí)驗(yàn) 為了評價(jià)基于TBS的細(xì)胞病理圖像質(zhì)量評價(jià)方法的運(yùn)算性能,選取5個(gè)不同分辨率的WSI圖像,每個(gè)樣本的分辨率如表5所示。本實(shí)驗(yàn)的計(jì)算機(jī)環(huán)境為Ubuntu64位操作系統(tǒng),CPU為Intel(R) Xeon(R) CPU E5-2678,GPU為NVIDIA 2080Ti,編程語言為python實(shí)現(xiàn)。 細(xì)胞病理圖像質(zhì)量評價(jià)所耗時(shí)間如表6所示,從表6可以看出,質(zhì)量評估過程主要包括清晰度評價(jià)時(shí)間、目標(biāo)檢測時(shí)間、染色判斷時(shí)間和磁盤讀寫時(shí)間;分辨率越高的細(xì)胞病理圖像評估時(shí)間越長;其中清晰度判斷和目標(biāo)檢測時(shí)間比較耗時(shí),這兩個(gè)階段占用了質(zhì)量評估的大部分時(shí)間,在整體評估時(shí)間中占總體的90%以上。 3? 結(jié)? 論 本文針對WSI圖像質(zhì)量評估方面缺乏病理醫(yī)學(xué)知識的問題,提出了一種基于TBS診斷標(biāo)準(zhǔn)和圖像質(zhì)量共識的細(xì)胞病理圖像評價(jià)方法。該方法融合了傳統(tǒng)圖像評價(jià)指標(biāo)和TBS診斷標(biāo)準(zhǔn)。為了完成基于TBS的細(xì)胞病理圖像評價(jià)方法,首先提出了基于殘差網(wǎng)絡(luò)的清晰度判定方法,采用Resnet-34提取圖像特征,并在原有的網(wǎng)絡(luò)基礎(chǔ)上添加通道注意力機(jī)制模塊和最大值最小值池化,將圖像特征輸入到全連接層中,進(jìn)行圖像清晰模糊分類,可以高效快速地檢測WSI圖像中的模糊區(qū)域,解決了傳統(tǒng)清晰度評價(jià)函數(shù)難以直接評價(jià)圖像是否清晰這一問題。然后根據(jù)顏色反卷積,成功地分離出蘇木精和伊紅染色通道,并且計(jì)算出兩個(gè)通道的平均灰度值,可以用于評價(jià)細(xì)胞病理圖像的染色標(biāo)準(zhǔn)。通過yolov5s目標(biāo)檢測網(wǎng)絡(luò),對圖像中鱗狀上皮細(xì)胞、細(xì)胞團(tuán)和臟污區(qū)域進(jìn)行檢測和評價(jià)。最后將提取出來的特征指標(biāo)輸入到XGBoost回歸模型中完成細(xì)胞圖像質(zhì)量評價(jià)。根據(jù)圖像質(zhì)量的可靠性將其應(yīng)用在智能病理輔助診斷系統(tǒng)中。實(shí)驗(yàn)表明,本文提出的質(zhì)量評價(jià)方法適用于H&E染色的細(xì)胞病理圖像質(zhì)量評價(jià),并且將TBS病理知識融合到評價(jià)流程,解決了臨床圖像質(zhì)量評價(jià)難的問題。 參 考 文 獻(xiàn): [1]? 中國病理醫(yī)師協(xié)會(huì)數(shù)字病理與人工智能病理學(xué)組, 中華醫(yī)學(xué)會(huì)病理學(xué)分會(huì)數(shù)字病理與人工智能工作委員會(huì), 中華醫(yī)學(xué)會(huì)病理學(xué)分會(huì)細(xì)胞病理學(xué)組. 宮頸液基細(xì)胞學(xué)的數(shù)字病理圖像采集與圖像質(zhì)量控制中國專家共識[J]. 中華病理學(xué)雜志, 2021, 50(4): 4. Expert Group of Digital Pathology and Artificial Intelligence Pathology of Chinese Association of Pathologists; Expert Group of Digital Pathology and Artificial Intelligence Pathology of Chinese Society of Pathology; Expert Group of Cytopathology of Chinese Society of Pathology. Chinese Exports′ Consensus on Digital Pathological Image Acquisition and Quality Control of Cervical Liquid Based Cytology[J]. Chin J Pathol, April 2021, 50(4): 4. [2]? 王紫旋,謝怡寧,何勇軍.病理輔助診斷系統(tǒng)中數(shù)字濾光片的實(shí)現(xiàn)方法[J]. 哈爾濱理工大學(xué)學(xué)報(bào), 2022, 27(1): 40. WANG Zixuan, XIE Yining, HE Yongjun. Realization Method of Digital Filter in Pathological Assistant Diagnosis System.[J]. Journal of Harbin University of Science and Technology, 2022, 27(1): 40. [3]? HOSU V, LIN H, SZIRANYI T, et al. KonIQ-10k: An Ecologically Valid Database for Deep Learning of Blind Image Quality Assessment[J]. IEEE Transactions on Image Processing, 2020, 29: 4041. [4]? ZHANG W, MA K, YAN J, et al. Blind Image Quality Assessment Using a Deep Bilinear Convolutional Neural Network[J]. IEEE Transactions on Circuits and Systems for Video Technology, 2018, 30(1): 36. [5]? LI D, JIANG T, LIN W, et al. Which Has Better Visual Quality: The Clear Blue Sky or a Blurry Animal?[J]. IEEE Transactions on Multimedia, 2018, 21(5): 1221. [6]? 姚旺,劉云鵬,朱昌波.基于人眼視覺特性的深度學(xué)習(xí)全參考圖像質(zhì)量評價(jià)方法[J] .紅外與激光工程, 2018, 47(7): 39. YAO Wang, LIU Yunpeng, ZHU Changbo. Deep Learning of Full-reference Image Quality Assessment Based on Human Visual Properties[J]. Infrared and Laser Engineering, 2018, 47(7): 39. [7]? 王同罕,賈惠珍,舒華忠.基于梯度幅度和梯度方向直方圖的全參考圖像質(zhì)量評價(jià)算法[J] .東南大學(xué)學(xué)報(bào)(自然科學(xué)版), 2018, 48(2): 276. WANG Tonghan, JIA Huizhen, SHU Huazhong. Full-reference Image Quality Assessment Algorithm Based on Gradient Magnitude and Histogram of Oriented Gradient[J]. Journal of Southeast University (Natural Science Edition) , 2018, 48(2): 276. [8]? SENARAS C, NIAZI M K K, LOZANSKI G, et al. Deep Focus: Detection of Out-of-focus Regions in Whole Slide Digital Images Using Deep Learning[J]. PloS One, 2018, 13(10): e0205387. [9]? SHAKHAWAT H M, NAKAMURA T, KIMURA F, et al. Automatic Quality Evaluation of Whole Slide Images for the Practical Use of Whole Slide Imaging Scanner[J]. ITE Transactions on Media Technology and Applications, 2020, 8(4): 252. [10]CIBAS E S, ALI S Z. The Bethesda System for Reporting Thyroid Cytopathology[J]. Thyroid, 2009, 19(11): 1159. [11]劉佳甲.基于特征金字塔網(wǎng)絡(luò)的目標(biāo)檢測算法研究[D].秦皇島:燕山大學(xué),2020. [12]ABDU-ALJABAR R D, AWAD O A. A Comparative Analysis Study of Lung Cancer Detection and Relapse Prediction Using XGBoost Classifier[J]. IOP Conference Series Materials Science and Engineering, 2021, 1076(1):012048. [13]JIE H, LI S, GANG S, et al. Squeeze-and-Excitation Networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017(1): 99. [14]HE K, ZHANG X, REN S, et al. Deep Residual Learning for Image Recognition[C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2016: 770. [15]S·楚卡, 藍(lán)舟. 輔助組織樣本分析的載玻片圖像顏色反卷積系統(tǒng)及方法[P]. CN111095358A, 2020. [16]劉巍, 張彥澤, 于斌超,等. 基于大津法與K均值聚類算法聯(lián)合優(yōu)化的圖像二值化方法[P]. 中國:CN112037233A, 2020-12-04. [17]REDMON J,DIVVALA S, GIRSHICK R, et al. You Only Look Once: Unified, Real-time Object Detection[C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2016: 779. [18]梁義欽, 趙司琦, 王海濤, 等. 兩階段分析的異常簇團(tuán)宮頸細(xì)胞檢測方法[J]. 哈爾濱理工大學(xué)學(xué)報(bào), 2022, 27(2): 76. LIANG Yiqin, ZHAO Siqi, WANG Haitao, et al. Two-stage Detection Method for Abnormal Cluster Cervical Cells[J]. Journal of Harbin University of Science and Technology, 2022, 27(2): 76. [19]趙司琦. 基于深度學(xué)習(xí)的宮頸異常細(xì)胞檢測方法[D]. 哈爾濱:哈爾濱理工大學(xué), 2022. [20]YU S, WU S, WANG L, et al. A Shallow Convolutional Neural Network for Blind Image Sharpness Assessment[J]. PloS one, 2017, 12(5): e0176632. [21]GUAN J, ZHANG W, GU J, et al. No-reference Blur Assessment Based on Edge Modeling[J]. Journal of Visual Communication and Image Representation, 2015, 29: 1. (編輯:溫澤宇)