基于改進灰狼優化的文本聚類多階段特征選擇算法

劉泓鑠 王詩瑤 周靈鴿 張建鋒

(西北農林科技大學信息工程學院 陜西 楊凌 712100)

0 引 言

文本聚類是大數據分析的重要手段,廣泛應用于主題劃分、網絡輿情分析、經濟預測和情感分析等領域[1]。文本聚類的效果與文本特征選擇結果密切相關。而通常預處理后的初始文本特征集合具有高維度和稀疏性特點,因此,如何對文本進行特征選擇和特征提取,降低特征維度和移除冗余特征,得到最優特征子集成為直接關系文本聚類效果的關鍵問題[2]。

目前,文本特征選擇主要有三類方法:過濾法、封裝法和混合法。過濾法是一種統計分析方法,與具體分類算法無關,主要根據某一種數據特性對所選特征進行排序,判斷特征優劣,篩選特征子集。常用過濾法包括:文檔頻率法DF[3]、卡方檢測法CHI[4]、信息增益法IG[5]和互信息法MI[6]。過濾法簡單易行,計算效率也較高,但經過文本聚類后其特征選擇精度較差,特征冗余較多,直接影響了聚類效果。主要體現在:DF可能刪除信息量較大但出現頻率較低的詞,CHI僅關注詞條是否出現但忽略了詞頻,IG僅考慮詞條在文本集中的影響,而忽略是否具有分類信息,MI則較多關注頻詞。總體而言,過濾法綜合性能欠佳。比較過濾法,封裝法將特征空間與分類算法密切關聯,考慮了特征相互關聯,能有效剔除冗余特征,提高聚類準確度。不足在于計算效率低于過濾法。該類方法通常借用智能群體算法提高特征選取時的搜索效率,如:遺傳算法[7-8]、粒子群算法[9-10]、和聲搜索算法[11-12]、差分進化算法[13]、蛙跳算法[14]、螢火蟲算法[15]、蟻群算法[16]和貓群算法[17]等。文獻[7]首先利用詞頻/逆文檔頻計算詞條權重,然后利用傳統遺傳算法進行文本特征選擇,不僅保證了文本分類準確度,還降低了特征維度。文獻[8]根據詞條權重性因子設計了基于遺傳算法的特征選擇算法GAFS,以計算時間最小、性能最大為目標優化特征子集選擇,并用郵件文本測試了性能。文獻[9]通過小生境改進了傳統粒子群算法,以增強的粒子搜索性能對文本特征選擇進行進化求解,獲得的文本分類效率得到有效提升。文獻[10]提出一種新的基于粒子群優化的特征選擇算法PSO-TC。算法利用新的動態慣性權重策略對粒子進化操作進行改進,而最終的三類文本數據集的測試也證明在新的特征選擇策略下生成的聚類在準確度和效率上均有一定改進。文獻[11]通過改進和聲搜索過程設計了一種自適應特征選擇算法,算法利用三種動態策略,包括音調調整、限制特征域和內存合并率改善傳統和聲搜索過程。最后在多維度數據集的測試下驗證算法在選擇最優特征子集上的有效性。文獻[12]利用傳統過濾法對特征進行初選,然后輸入至二進制和聲搜索算法中對特征優選,證實分類準確率得到了提高。文獻[13]首先聯合平均中位值和詞條方差建立相關特征子集,然后在該特征子集上利用改進差分進化算法對特征進行二次精選,增強了特征子集的擾動性和收斂速度。文獻[14]通過信息增益和卡方檢測對初始特征初選,然后引入改進蛙跳算法建立二次特征優選模型,有效排除了噪聲特征干擾。文獻[15]首先根據文本特征的信息增益值對所有特征降序排列,然后優選排序前列的特征作為螢火蟲算法的初始種群,并利用螢火蟲的捕食過程對特征做進一步選擇,效果明顯好于單純信息增益法和螢火蟲算法。文獻[16]設計了基于蟻群算法的文本特征選擇算法,有效實現了特征降維。文獻[17]通過修正的貓群算法設計了文本分類下的特征選擇算法。實驗結果也證實利用貓群算法后的聚類明顯優于僅使用詞條頻率下的聚類效果。顯然,傳統的特征選擇更多依賴于特征對于后續分類的貢獻度,貢獻度越大,越有可能被選擇為有用特征。然而,特征詞之間的聯系是相對復雜的,這樣得到的特征詞的聚類效果肯定存在很多偏差。而在過濾生成特征子集初始解后,再引入智能群體算法對特征子集做進一步評估和提取,將可以提高聚類效率和降低特征維度。灰狼優化算法GWO[18]是一種新型的智能群體算法,其模型更為簡單、參數依賴較少且尋優性能好,研究表明它的尋優性能要明顯優于以上遺傳算法、粒子群算法、差分進化算法和蟻群算法等,近年來得到廣泛研究認可。本文將設計一種多階段的特征選擇與特征提取算法,在融合不同相關性特征分值計算方式的基礎上,先對文本特征進行初選;然后基于余弦相似度對特征進行冗余剔除;在此基礎上,引入改進二進制灰狼優化算法對上一步的特征子集作特征精煉,得到最優特征子集。在多個文本數據集的測試下,驗證了本文算法的性能優勢。

1 文本特征模型

令集合D包含m個文檔,表示為D={d1,d2,…,di,…,dm},di表示D中的第i個文檔,m表示集合中的文檔總量。將預處理后的文檔i表示為向量di={wi,1,wi,2,…,wi,j,…,wi,n},n表示特征數量。利用詞頻逆文本頻率指數TF-IDF計算文本特征權重,wi,j表示文檔i中特征j的權重,且:

wi,j=TF(i,j)×IDF(i,j)

(1)

其中:

(2)

式中:TF(i,j)表示文檔i中特征j的頻率;z(i,j)表示特征j在文檔i中出現的次數,分母表示文檔i中所有特征的出現次數總和;IDF(i,j)為文檔頻率倒數;m表示文檔集合中的文檔總量;DF(j)表示出現特征j的文檔數量,加1可確保分母不為0。

計算特征權重后,文本文檔集合D中的每個文檔di(i=1,2,…,m)可表示為其所有特征的向量di={wi,1,wi,2,…,wi,j,…,wi,n}。而含有n個特征的文本集合D則可表達以下的向量空間模型:

2 特征選擇與特征融合

獲取初始特征集合后,需要對特征過濾,得到相關度高的特征子集。引用兩種方法計算特征相關性分值:平均絕對差MAD和平均中位數MM。MAD可以較準確地表征特征對文檔的類別區分能力,所選擇的特征具有更好的類別信息。MM則相對可以選擇具有相關性的特征。結合兩種特征選擇方法計算特征相關性分值,可以實現特征選擇的優勢互補,更準確地得到相關特征子集。

MAD是詞條方差TV的簡化形式,通過計算樣本與均值之差為特征分配相關性分值。特征j的平均絕對值定義為:

(6)

MM是傾斜率的簡化形式,通過計算均值與中位數間的絕對差為特征分配相關性分值。特征j的平均絕對值定義為:

式中:median(xj)表示特征j的權重值的中位數。

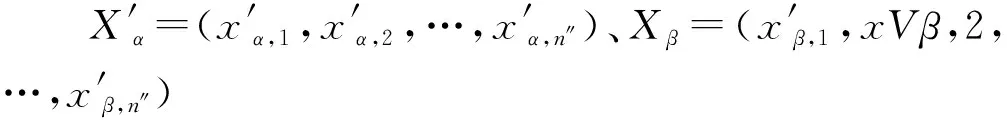

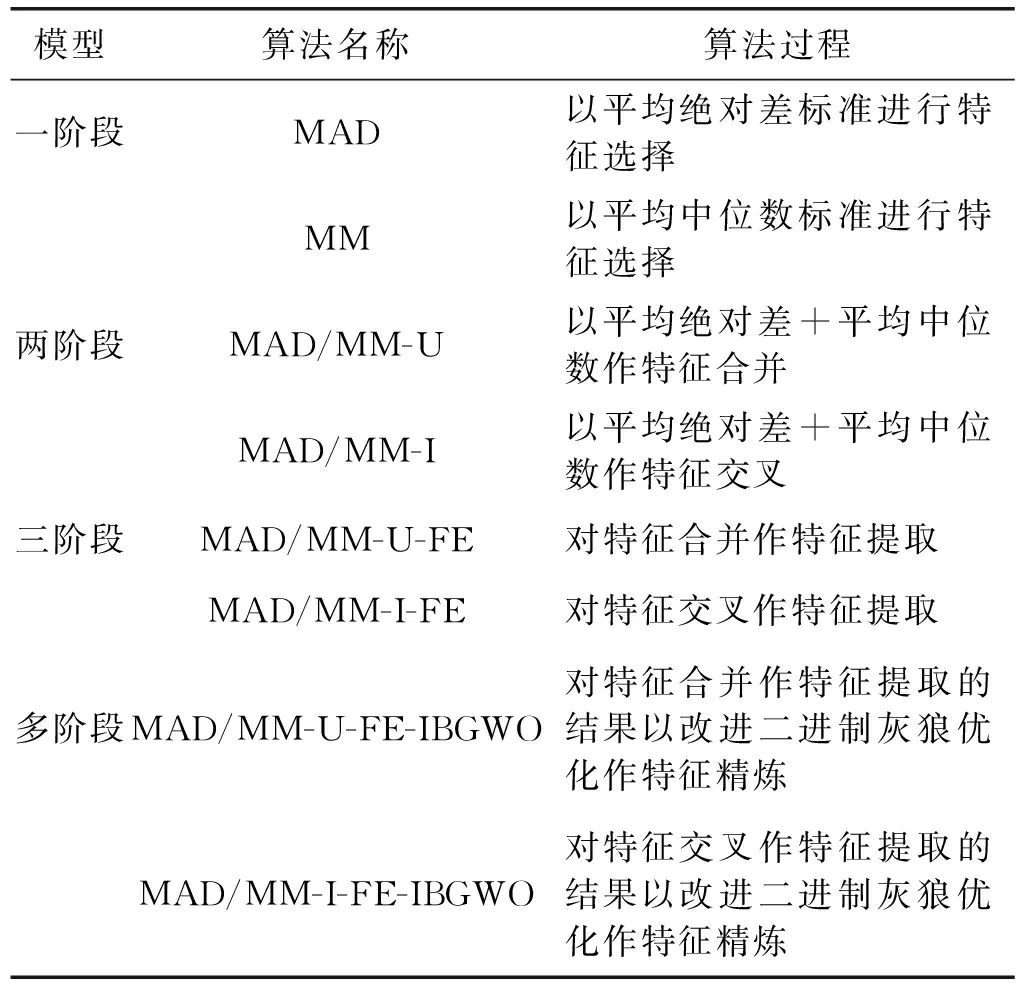

為了實現MAD和MM兩種特征相關性分值計算方法的優勢,提出將兩種方法的特征選擇子集進行融合。D為文本文檔集合,經過預處理步驟后,得到特征集合T,令T={t1,t2,…,tn}代表預處理后的特征集合。利用MAD計算集合T中每個特征的相關性分值,并對特征按照相關性分值作降序排列,選擇前q個為MAD生成的特征候選子集,表示為FSMAD={t11,t12,…,tq},顯然,q< 利用特征合并U建立新特征子集FSU,即合并特征子集FSMAD和FSMM,表示為: FSU=FSMAD∪FSMM (8) 令特征子集FSU包含U個特征,則U≥q和p。 利用特征交叉I建立新的特征子集FSI,即交叉特征子集FSMAD和FSMM,表示為: FSI=FSMAD∩FSMM (9) 令特征子集FSI包含I個特征,則I≤q和p。 令n′表示特征選擇后的特征子集長度。 算法1說明:步驟1首先根據MAD或MM(式(5)或式(7))計算每個特征的相關性分值,然后在步驟2根據相關性分值對特征作降序排列。步驟3將兩個參數初始為0,CR用于記錄特征相關性分值的累計值,sum用于記錄所有特征的相關性分值之和。步驟4-步驟6計算當前所有特征的相關性分值之和。步驟7-步驟14則用于依次判斷是否每個特征會被選入特征子集中,其中:步驟8計算更新CR,步驟9判斷CR是否小于等于閾值,若滿足,則在步驟10將該特征加入最后的所選特征子集中;否則,在步驟12退出。遍歷完所有排序后的特征后,步驟15可以根據兩種不同的特征相關性分值計算方法進行特征子集的合并和交叉。最終,步驟16返回維度為n′的不同方式生成的相關性特征子集。 算法1特征選擇與特征融合 輸入:文檔數量m,初始特征數量n,閾值Threshold1。 輸出:FSMAD,FSMM,FSU,FSI,特征子集(特征數為n′)。 1.計算每個特征的相關性分值Relj; 2.按相關分值對特征作降序排列; 3.CR=0,sum=0; 4.forj=1 tondo 6.endfor 7.forj=1 tondo 8.CR=CR+Relj/sum; 9.ifCR≤Threshold1then 10.FSMAD/MM=FSMAD/MM+FRElj; 11.else 12.break; 13.endif 14.endfor 15.FSU=FSMAD∪FSMM,FSI=FSMAD∩FSMM; 16.returnFSMAD,FSMM,FSU,FSI,特征量n′ 由于特征之間可能存在相似性,因此,特征選擇階段可能存在冗余特征。特征提取FE用于對特征選擇階段的特征子集進行冗余特征移除。通過兩個特征向量間角度的余弦值度量特征間的相似性,定義為: 式中:wα和wβ表示兩個特征向量,〈·〉表示點乘;‖·‖表示歐氏距離。該值度量了兩個特征度量間的角度,取值范圍為[0,1]。若余弦值為0,表明特征間是正交的;若余弦值為1,表明特征是共線的。 令n″表示特征提取后的特征子集長度。 算法2說明:算法的主要過程是按序依次遍歷所有特征(步驟1-步驟9),根據式(10)計算相鄰兩個特征間的相似性(步驟2),并判斷是否小于等于預定義的閾值,若滿足,則將前一特征提取至最后的特征子集中(步驟3-步驟4);若當前特征是子集中的最后一個特征,則直接提取至最后的特征子集中(步驟6-步驟7)。最后,步驟10輸出維度為n″的特征子集,作為下一階段的特征精煉基礎。 算法2基于余弦相似性的特征提取FE 輸入:特征子集(特征數為n′),閾值Threshold2。 輸出:特征子集(特征數為n″)。 1.forj=1 ton′do 2.s=cossim(Fj,Fj+1) ; 3.if(s≤Threshold2)then 4.FSFE=FSFE∪Fj; 5.endif 6.if((j+1)=n′)then 7.FSFE=FSFE∪Fj+1; 8.endif 9.endfor 10.return特征子集FSFE(特征數為n″) 經過特征選擇和特征提取的特征過濾步驟后,可以生成初選的文本特征子集。為了進一步降低特征維度空間,本文引入IBGWO,在特征提取得到的特征子集基礎上進行特征精煉,該步驟屬于封裝。GWO是一種新型的群體智能算法,模擬了自然界中灰狼的等級制度和捕食行為,通過灰狼群體搜索、包圍及追捕攻擊獵物等過程實現目標搜索。研究表明,GWO在求解問題精度和穩定性上優于傳統的PSO、GA和DE,已在調度和規劃優化問題上做了一系列應用。 利用GWO進行特征精煉,即一頭灰狼在搜索空間中的位置信息可視為一種可行解。傳統灰狼優化算法是連續灰狼算法,灰狼位置在搜索空間內可任意移動。由特征選擇模型可知,特征精煉解將離散分布在二進制數0和1之間,所以,表達特征精煉可行解的灰狼優化算法需轉換成二進制形式。將一頭狼的位置編碼為表1的二進制形式。編碼中上層向量代表特征序號(維度),下層向量代表灰狼在各維度上的二進制位置,搜索空間維度n″對應特征提取后的文本特征數量,二進制向量Xh=(xh,1,xh,2,…,xh,n″),若xh,j=1,則表明灰狼h位置所代表的特征精煉候選解中,特征j選擇為信息化特征;若xh,j=0,則表明灰狼h位置所代表的特征精煉候選解中,特征j不被選擇定信息化特征,不包括在最優特征子集中。 表1 特征精煉解編碼結構 傳統灰狼優化算法隨機進行種群初始化,然后通過優良個體保存策略逐步迭代,接近全局最優,改善種群個體,其搜索過程在滿足預定義終止條件時結束。由于對全局最優沒有任何先驗知識,初始種群應盡可能均勻分布于搜索空間。算法的收斂速度與初始種群與最優解間的距離直接相關。若隨機初始種群本身離全局最優距離較遠,灰狼尋優可能無法完成。研究表明,接近一半的隨機初始種群個體比較其反向解距離最優解更遠。反向學習機制[19]可以通過同步考慮當前解及其反向解改善候選解的質量,并加快算法的收斂速度。因此,可將隨機初始解及其反向解均考慮在初始種群中。以下對反向學習機制的概念作說明。 定義1反向數。令x為區間[l,u]內的實數,x∈[l,u],其對立數x′為: x′=u+l-x (11) 基于反向學習的灰狼種群初始化步驟如算法3所示。 算法3反向學習機制的種群初始化 輸入:種群規模S。 輸出:規模為S的灰狼種群X。 1.初始化規模為S的隨機灰狼種群X 2.fori=1 toSdo 3.forj=1 toddo 4.endfor 5.endfor 6.X″=X∪X′ 7.計算灰狼適應度; 8.根據適應度對種群X″作降序排列; 9.X=top({X″}/2); 10.returnX 算法3說明:步驟1首先隨機生成規模為S的灰狼個體位置,步驟2-步驟5在所有灰狼個體的所有位置維度上計算其反向點,然后在步驟6融合原始初始種群和由反向點組成的種群,形成規模為2S的灰狼種群結構X″。步驟7根據式(12)計算當前種群所有個體的適應度,然后在步驟8根據適應度對X″中的灰狼個體位置作降序排列,并在步驟9選取排序前S的灰狼種群X作為最終初始種群,最后在步驟10返回新生成的初始種群。 適應度函數用于評估灰狼位置代表的特征精煉解的質量。特征精煉應盡可能選取適應度更優的灰狼個體保留至下一種群世代中。對于文本特征而言,其重要程度不僅與其在文檔中出現的次數相關,還與特征在文檔中出現的頻率相關。因此,將特征的累計詞頻與文檔頻率作加權計算特征精煉解的適應度[13],灰狼個體h的適應度計算為: 式中:σ和γ表示權重因子,分別用于表示特征的累計詞頻和文檔頻率對特征精煉解的偏好程度,σ、γ∈[0,1],且σ+γ=1;DFj表示特征j的文檔頻率;∑TF(i,j)表示特征j的累積詞頻。同時: DFj=DF(j)/m (14) 隨著灰狼個體在搜索空間內的捕獵行為的進行,會導致灰狼位置發生變化,即代表相應的特征精煉解會更新。對于二進制灰狼優化算法而言,利用S型函數可將連續位置映射為二進制位置,具體轉換函數為: 式中:x1,j、x2,j和x3,j分別代表灰狼個體h與當前的α狼、β狼和δ狼之間的距離;xh,j(t+1)表示迭代t+1時灰狼個體h的位置向量中第j維的二進制位置更新,代表灰狼個體h是否選擇特征j為信息化特征;rand表示[0,1]內的隨機生成數。函數sigmoid(x)定義為: x1,j、x2,j、x3,j計算方式如下: x1,j=|xα,j-A1·Dα| (17) x2,j=|xβ,j-A2·Dβ| (18) x3,j=|xδ,j-A3·Dδ| (19) 式中:xα,j、xβ,j和xδ,j分別表示當前灰狼種群中適應度最優的三頭狼α狼、β狼和δ狼所代表的特征精煉解中,特征j是否選擇為信息化特征。 系數A計算方式如下: A=2a·r1-a (20) 式中:r1表示[0,1]內的隨機生成值;a表示收斂系數。a定義為: 式中:Tmax表示最大迭代次數。 Dα、Dβ和Dδ分別代表灰狼個體與α狼、β狼和δ狼之間的距離,計算方式為: Dα=|C1·Xα-X| (22) Dβ=|C2·Xβ-X| (23) Dδ=|C3·Xδ-X| (24) 式中:Xα、Xβ和Xδ分別代表α狼、β狼和δ狼的當前位置;X表示灰狼個體的當前位置。系數C的計算方式為: C=2r2 (25) 式中:r2表示[0,1]內的隨機生成值。 由灰狼優化模型可知,灰狼對獵物的包圍由收斂系數a決定,該系數決定灰狼的尋優能力,即局部開發與全局勘探能力。由收斂系數a的計算公式可知,a值變化呈線性遞減趨勢。對于灰狼優化算法而言,迭代初期,較大a值可以增大灰狼搜索步長,提高全局勘探能力,避免尋優過程過快收斂和早熟;迭代后期,較小a值可以減小灰狼搜索步長,提高局部開發能力,加快算法收斂。然而,兩種搜索類型并不是完全線性切換的,收斂系數的線性遞減并不能實際體現灰狼的復雜搜索過程,尤其出現多峰值情形時,易于陷入局部最優。本文將收斂系數a的變化改進為非線性遞減形式,表示為: 式中:aini為收斂系數初值,通常為2;Tmax為最大迭代數,t為當前迭代數。式(26)表明,收斂系數a呈非線性衰減。迭代初期,衰減速率較慢,可以有效進行全局勘探;迭代末期衰減速率加快,可以更好進行局部開發。非線性衰減的收斂系數也因此更好地均衡了灰狼種群的全局勘探和局部開發能力。 由灰狼優化過程可知,搜索過程由當前灰狼種群中適應度最優的三頭灰狼α狼、β狼和δ狼引領。在搜索過程末期,所有灰狼向決策層的三個頭狼附近區域逼近,此時缺失群體多樣性,收斂速度明顯變慢或停滯,最終會陷入局部最優。算法繼續引入反向學習機制,在α狼、β狼和δ狼的選取上同步引入其精英反向點,擴大灰狼的搜索范圍,勘探新搜索區域。 利用MATLAB平臺編寫測試程序,硬件環境為Windows 10操作系統,Core i7處理器以及4 GB內存容量。所有文本特征選擇算法以Java平臺編寫程序,最后的文本聚類測試則以K均值算法在MATLAB平臺進行。 引入三種不同的經典基準數據集進行性能測試:Reuters- 21578[20]、Classic4[21]和WebKB[22]。三種數據集預定義劃分為若干分類,分類信息在聚類過程中是未知的。Reuters- 21578數據集是路透社新聞專線發布的新聞集,包括21 578個文檔,非均勻地分布于135個主題間。本文隨機選取屬于8個不同分類中的1 339個文檔進行聚類分析。Classic4數據集包括7 095個文檔,每個文檔屬于CACM、CRAM、CISI和MED四種分類中的一種。本文隨機選取2 000個文檔(一種分類500個文檔)進行聚類分析。WebKB數據集即全球知識庫,包括來自于四個學術領域內的8 282個Web頁面,初始擁有7種分類,最后只有課程、學院、學生和項目四個分類被有效利用。本文從中隨機選取2 803個文檔進行聚類分析。從初始特征空間中隨機抽取文檔子集并不會轉變數據集的屬性,也不會影響算法的計算需求。三種數據集的詳細統計如表2所示,可見,所有數據集擁有完全不同的文檔數量、特征、偏斜度和稀疏性。 為了驗證特征選擇算法的性能,利用K均值算法根據特征選擇算法求解的最優特征子集進行文本聚類,并以聚類性能分析特征選擇性能。引入以下三個性能度量指標: 準確率P表明文本聚類結果的準確性,衡量查準率。P越大,聚類準確性越高,定義為: 式中:TP表示聚類解中被正確聚類的文檔數量;FP表示錯誤聚類的文檔數量。 召回率R表明文本聚類結果的完整性,即查全率。R越大,完整性越好,定義為: 式中:FN表示不該分開的文檔被錯誤分開的文檔數量。 F1度量:綜合評定準確率和召回率。F1值越大,聚類性能越優,定義為: 本文設計的最優文本特征子集生成分成四個階段:特征選擇-特征合并/交叉-特征提取-特征精煉。令預處理后的文本特征規模為n。首先,特征選擇階段中,根據MAD或MM生成相關性特征子集,再對兩類特征子集進行合并U或交叉I,得到規模為n′的特征子集,n′ 表3 測試算法 除表3的算法外,性能對比算法選擇基于遺傳算法的特征選擇算法GAFS[8]、基于二進制粒子群算法的特征選擇算法BPSOFS[10]和基于改進差分進化的特征選擇算法IDEFS[13]進行對比分析。對于三種智能群體算法,種群規模設置為400,算法最大迭代次數設置為500,遺傳交叉概率設為0.8,遺傳變異概率設為0.2,粒子慣性權重最小值為0.4,最大值設為0.9,兩個學習因子均設置為0.5。灰狼算法中的收斂系數初值設為2,系數A、C均隨機生成,因此無須提前配置。 實驗1確定IBGWO中適應度函數的權重因子σ和γ。由于σ+γ=1,可以僅以σ為參考,確定其參數取值。圖1為改變σ取值時利用Reuters- 21578數據集進行聚類測試得到的準確率均值情況。σ調節步長為0.1,當增加σ取值時,則γ相應遞減。從結果可知,聚類準確性整體是隨著σ取值先上升后下降的,這說明適應度函數中的特征累計詞頻與文檔頻率兩種要素會對聚類準確率產生影響,并且兩個因素是相互制約的。在σ取值為0.4時,聚類準確率最佳。因此,后續實驗測試中,將σ取值0.4、γ取值0.6進行實驗分析。進一步需要說明的是,0.4/0.6的權重因子取值不一定是聚類準確率達到最高的取值組合,由于兩個權重因子取值是可以在區間[0,1]內任意取值的,所以并不能確定其聚類準確率最大時的取值組合,但這并不會對后續實驗分析產生不利影響。 圖1 適應度函數權重因子的選取 實驗2確定IBGWO在原始二進制灰狼優化算法BGWO基礎上改進措施的有效性。圖2為改進二進制灰狼優化算法與傳統二進制灰狼優化算法在適應度方面的比較。可以看到,改進二進制灰狼優化算法可以有效提高灰狼個體所表征的特征精煉解的適應度值,這說明IBGWO中基于反向學習機制的初始種群生成方法可以優化初始種群結構,提升種群多樣性。而非線性收斂系數衰減和精英反向學習機制,則可以有效提升灰狼算法的尋優性能,更加有助于灰狼個體的尋優收斂性,并最終得到最優文本特征子集。 圖2 IBGWO的性能 實驗3觀察算法在特征降維方面的有效性。圖3為所有算法在三種測試數據集中得到的最優特征子集維度,圖4相應給出了算法在數據集原始特征規模下生成最優特征子集的降維比例情況。綜合結果可以看到,傳統過濾式特征選擇方法MM和MAD對于特征空間維度的降低還是比較有限的,基本僅能降低全部初始特征空間的一半左右。融合特征合并和合并機制后,得到的特征規模并沒有呈現大幅度增加或降低的趨勢,這說明兩種計算特征相關性分值的特征選擇方法會產生很多交集,所選擇的特征具有很大的相似性。而在引入余弦相似性的特征提取機制后,對相似性較高的冗余特征作了剔除,較大程度降低了特征規模。而引入改進二進制灰狼優化的多階段特征精煉后,特征子集維度進一步有所減小,這說明本文所設計的特征選擇-特征提取-特征精煉的多階段降維機制是有效可行的,在降低相似性特征比例、提取信息化特征方面具有很好的優勢。相比較GAFS、BPSOFS和IDEFS三種對比特征選擇算法,本文的IBGWO同樣具有進一步特征降維的優勢,其中原因除了灰狼優化算法模型更為簡單、參數依賴較少且尋優性能好之外,還在于本文灰狼優化中引入反向學習機制對灰狼種群的隨機初始化作了改進,以及非線性收斂系數衰減模式和精英反向學習機制,最大限度地有效提升了灰狼算法的尋優性能,得到最優文本特征子集。 圖3 最優特征子集規模 圖4 特征降維比例 實驗4進行系統的文本聚類性能分析。表4為11種算法在三個測試數據集上得到的聚類精確率、召回率和F1度量指標上的性能表現。綜合結果可以看到,傳統的過濾式特征選擇方法MM和MAD對于特征空間維度降低比較有限,導致其冗余特征過多、噪聲太大、信息化特征子集的提煉準確度過低,進而導致其聚類準確性較差。其他智能群體算法在進一步改進特征選擇策略后,可以明顯地提升聚類性能。相比較遺傳GAFS、二進制粒子群BPSOFS、改進差分進化IDEFS三種對比特征選擇算法,本文的改進二進制灰狼優化算法的多階段特征選擇機制在多數測試數據集均可以進一步改善聚類效果,說明引入的余弦相似性的冗余剔除機制可以有效分離出非信息化特征。而在二進制灰狼優化算法上進一步設計的反向學習機制對灰狼種群的隨機初始化所作改進,以及非線性的收斂系數衰減模式和精英反向學習機制,最大程度地提升了灰狼算法的尋優性能,得到最優文本特征子集,不僅有效降低了特征維度,而且極大改善了文本聚類準確性。 表4 聚類性能對比 為了降低特征空間維度,提高文本聚類準確度,設計一種多階段的特征選擇與特征提取算法,在融合不同相關性特征分值計算方式的基礎上,先對特征進行初選;然后基于余弦相似度對特征進行冗余剔除,在此基礎上,引入改進二進制灰狼優化算法對上一步的特征子集作特征精煉,得到最優特征子集。在多個文本數據集的測試下,驗證了本文算法的性能優勢。進一步的研究可集中于嘗試利用其他過濾式特征初選方式,并將其初選特征子集作為智能群體算法的初始種群結構,再進行特征提取和特征精煉,實現準確度更高的特征選擇以及性能更優的文本聚類。3 特征提取

4 基于改進二進制灰狼優化的特征精煉

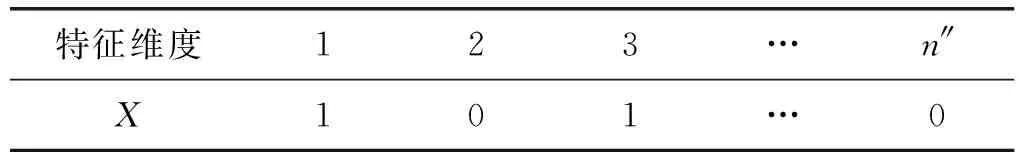

4.1 特征精煉解編碼

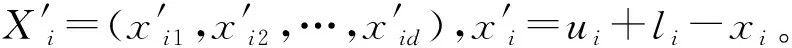

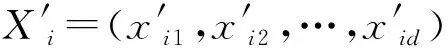

4.2 基于反向學習機制的種群初始化

4.3 適應度函數

4.4 解的更新

4.5 非線性收斂系數更新機制

4.6 精英反向學習機制

5 實驗與結果分析

5.1 測試數據集

5.2 性能指標

5.3 測試算法及參數

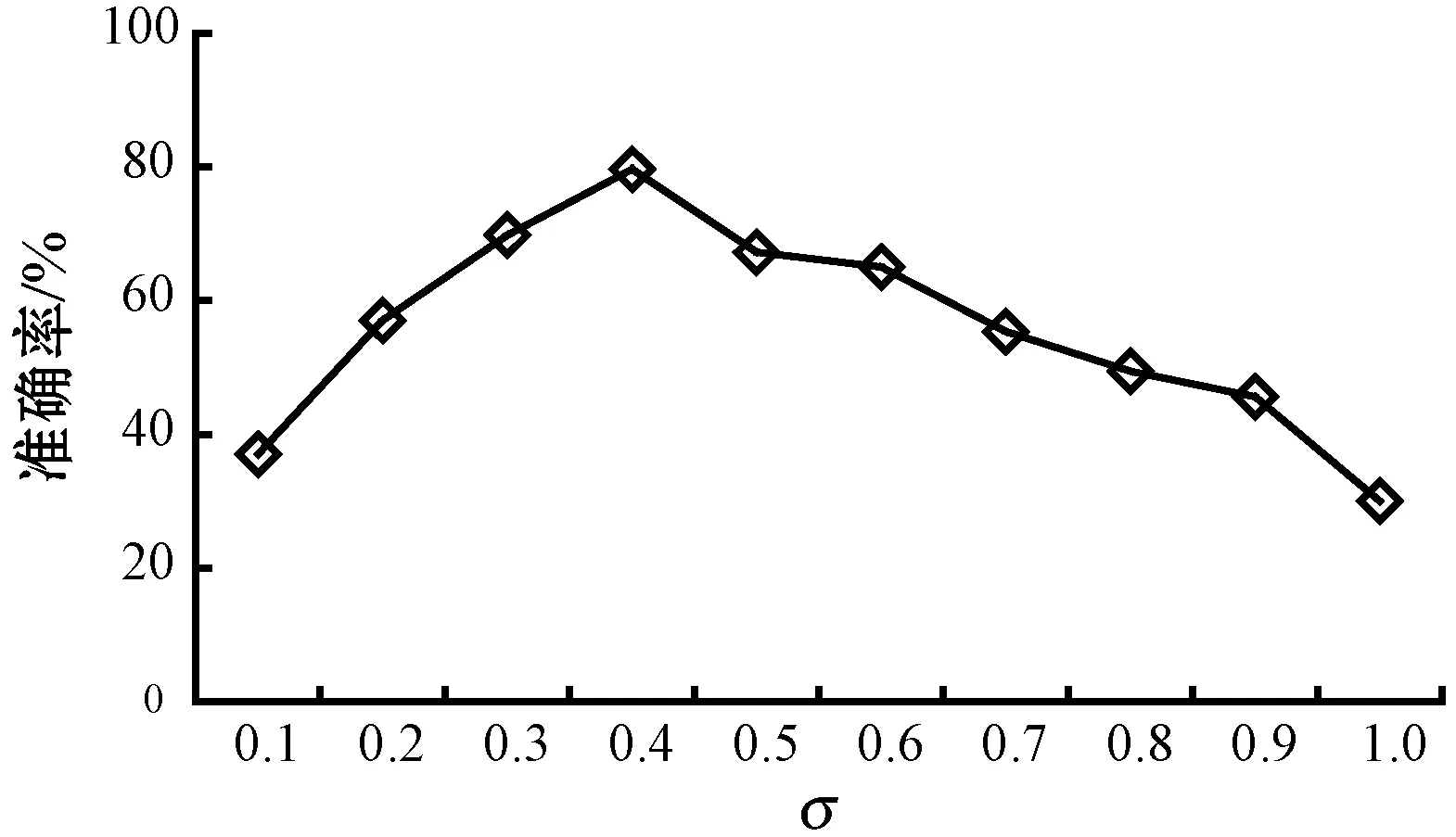

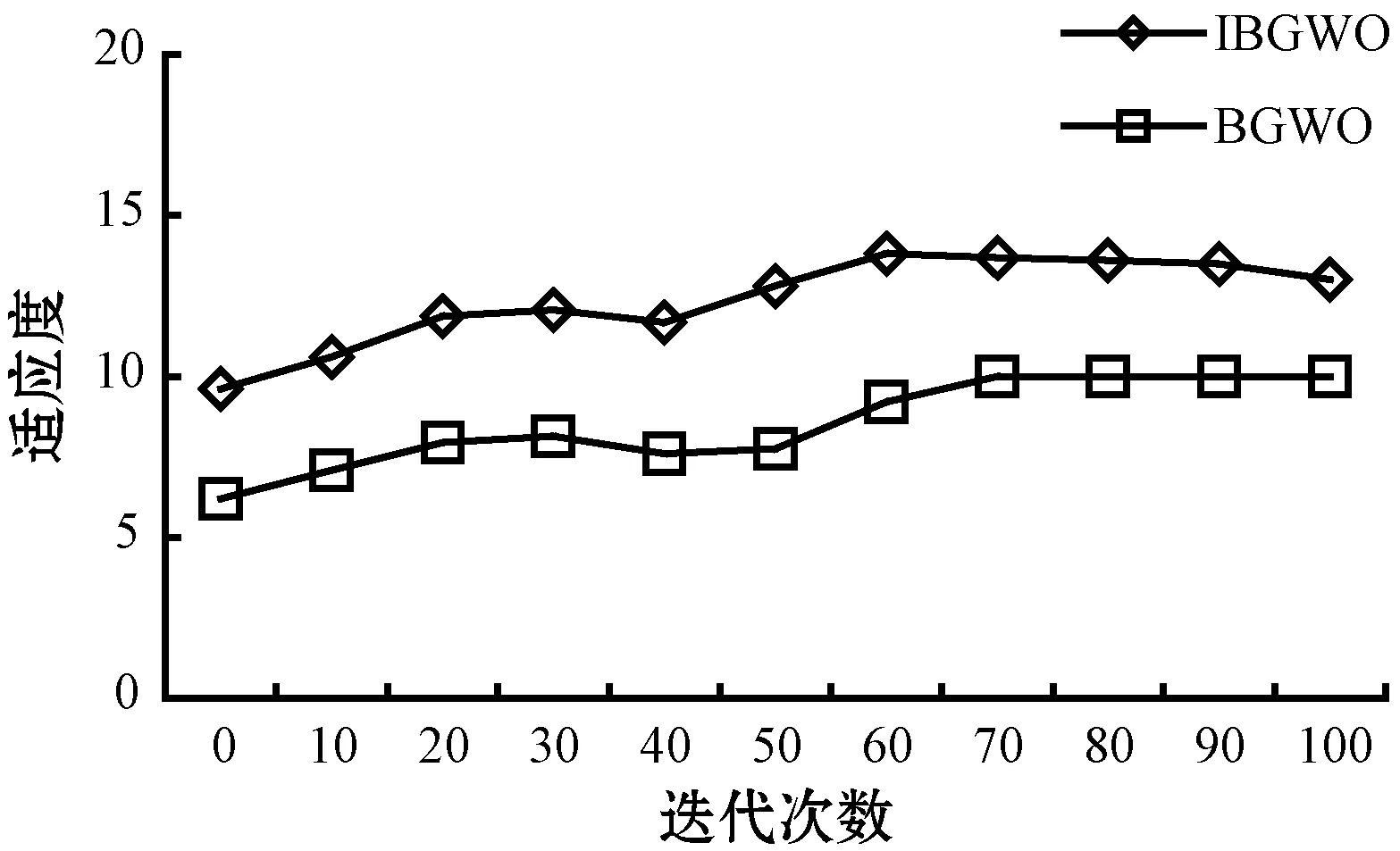

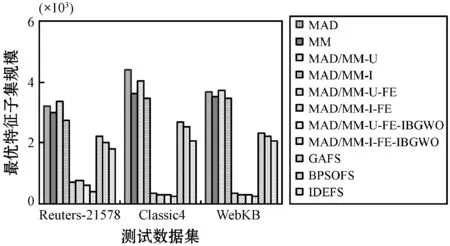

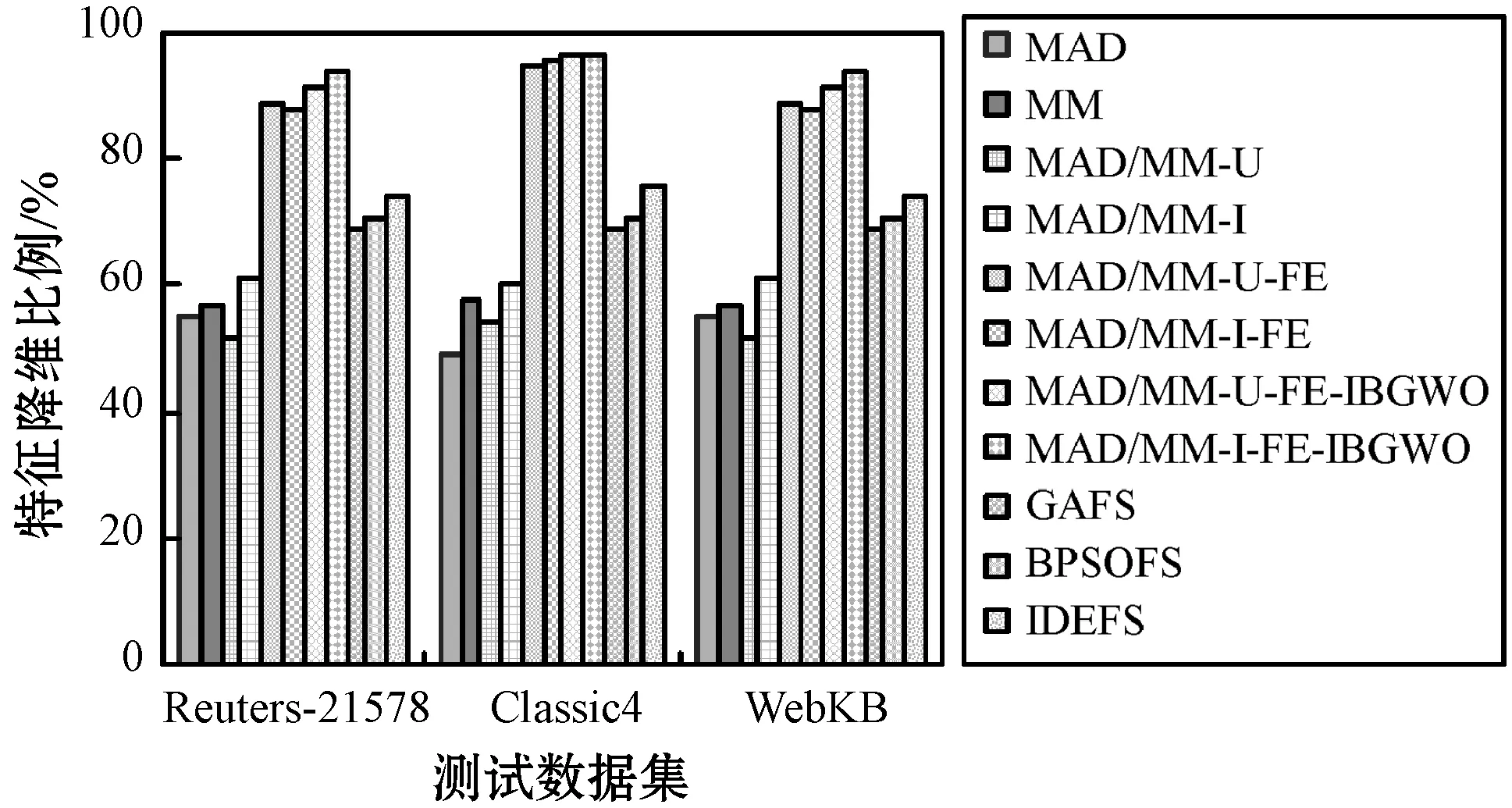

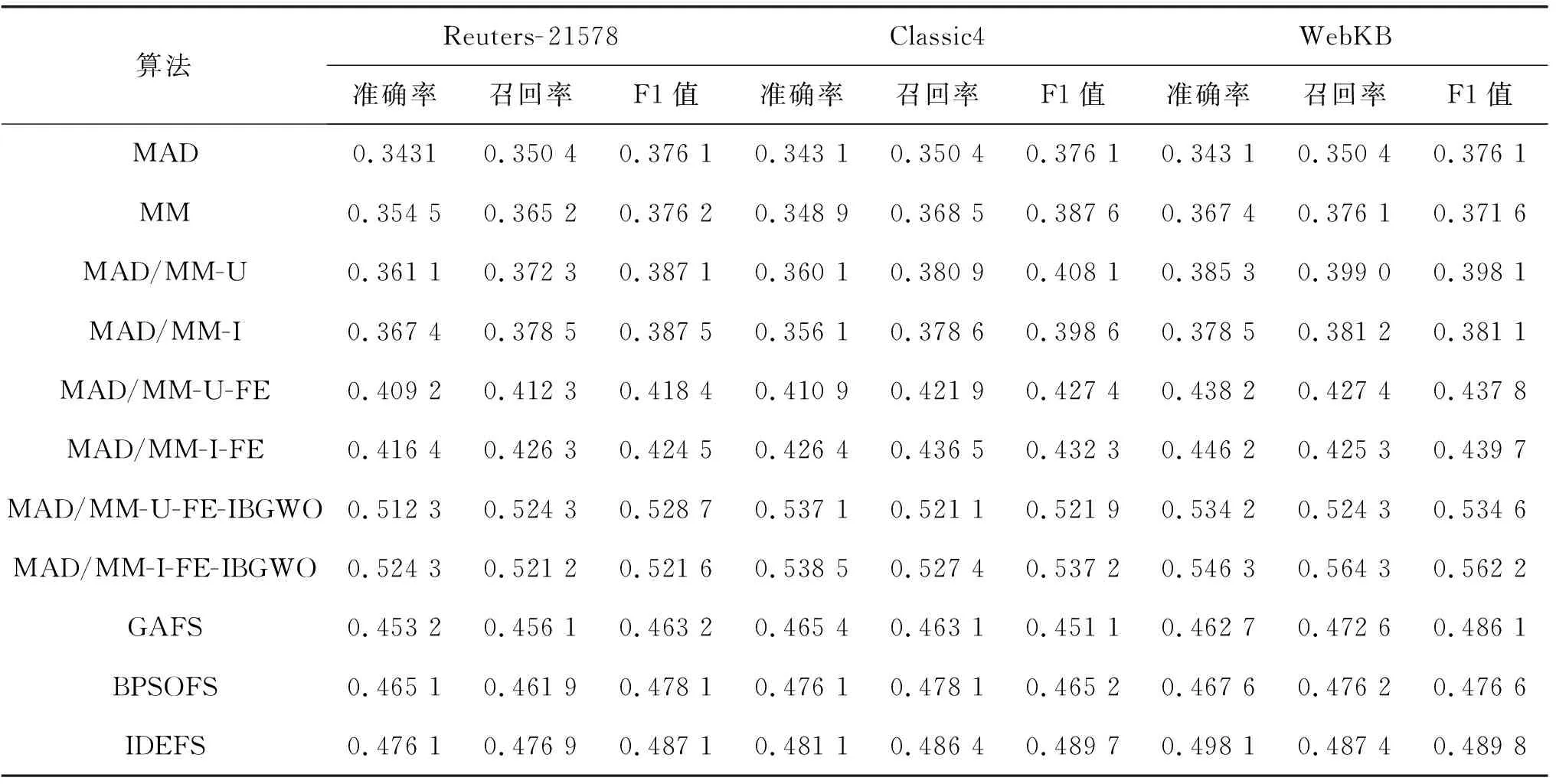

5.4 實驗結果分析

6 結 語