基于改進ShuffleNet的板栗分級方法

李志臣,凌秀軍,李鴻秋,李志軍

基于改進ShuffleNet的板栗分級方法

李志臣1,凌秀軍1,李鴻秋1,李志軍2

1. 金陵科技學院機電工程學院, 江蘇 南京 211169 2. 五蓮縣松柏鎮農業綜合服務中心, 山東 五蓮 262302

傳統的板栗分級方法主要依靠人工或機械的多級振動篩,不僅分級準確率低而且容易把壞的板栗分成好的板栗。針對傳統板栗分級存在的問題,構建輕量級的卷積神經網絡實現高精度的板栗的自動分級。在自然光條件下用小米Note9手機拍攝獲取包含優等品、一等品、合格品、蟲蛀品和霉爛品板栗的5481幅圖像應用于卷積網絡模型的訓練、驗證和測試。在學習的基礎上構建了一個淺層卷積神經網絡Shnet-1,Shnet-1由2個卷積模塊和4個構成的板栗圖像特征提取網絡。特征提取網絡連接板栗分類器,分類器由全局平均池化層、隱含層和輸出層組成的多層感知器。為了實現板栗分類的最大精度和最小計算量,對Shnet-1模型的超參數進行了優化。將Shnet-1的分類性能與各種深度學習模型如AlexNet、Mnet-1、ResNet18進行了比較分析。淺層卷積神經網絡Shnet-1網絡模型應用于板栗分級的準確率達到98.90%,壞的板栗被分為好板栗的比例小于0.5%。Shnet-1的計算量小,板栗圖像分類時間為26 ms,其權重僅占488KB的物理存儲容量。改進ShuffleNet的卷積神經網絡模型Shnet-1模型能夠快速和準確地完成對板栗的分級,為板栗的自動化分級提供了智能決策支持。

板栗分級;Net

對板栗進行分級(分類)可增加板栗的附加值,傳統的板栗分級方法主要是人工或機械式的多級振動篩,勞動效率低、勞動強度大,不能區分蟲蛀和霉爛的壞板栗。結合圖像處理技術的機器視覺自動農產品分級或者作物病害識別可以克服人工容易誤判、依賴經驗等缺點。馮斌設計的基于機器視覺的水果自動分級系統能智能輸出分類結果[1]。戴建民通過對圖像進行中值濾波提取煙葉的長度、長寬比、圓形度、紋理等幾何特征,再加上煙葉的顏色特征,利用多特征模糊識別方法對煙葉分類的正確率可達到煙葉分級標準[2]。人工神經網絡和卷積神經網絡(Convolutional Neural Networks, CNN)能夠自動進行圖像特征提取,在農業檢測領域受到廣泛應用。馬本學設計了基于殘差卷積神經網絡結合圖像處理的干制哈密大棗外部品質檢測系統,外部品質檢測準確率為93.13%,滿足干制哈密大棗品質在線檢測裝備的生產需求[3]。彭文等以水稻田雜草為主要研究對象,利用多種結構的深度卷積神經網絡提取雜草特征和識別分類,結果顯示VGG16模型的精度最高[4]。彭旭等將標準化后以極坐標表示的農情數據編碼通過滑動窗口機制劃分子集,利用寬度卷積神經網絡模型將每個子集數據重構后矩陣進行異常檢測,異常檢測準確率均超過97.5%[5]。鄧向武提出了一種基于CNN與遷移學習相結合的稻田苗期雜草識別方法,該方法對稻田苗期雜草識別切實可行[6]。陸健強等提出一種基于Mixup算法和卷積神經網絡的柑橘黃龍病果實識別模型進行柑橘黃龍病果實圖像識別,模型識別準確率可以達到91.38%[7]。樊湘鵬等在卷積層加入批標準化處理層,引入中心代價函數,對Faster R-CNN進行改進,采用隨機梯度下降算法優化訓練改進后的網絡模型,實驗結果表明將改進后的Faster R-CNN算法用于田間復雜條件下的玉米病害智能診斷是可行的,具有較高的準確率和較快的檢測速度[8]。王璨將卷積神經網絡用于提取田間圖像的多尺度分層特征,將這些特征用于識別玉米苗與雜草的精確度較高[9]。李強改進經典CNN模型LeNet-5,獲得蔗芽平面位置識別的CNN模型,識別的準確率達到92%[10]。謝圣橋設計了基于FasterR-CNN的毛桃目標識別方法,能有效識別出疏果前期的毛桃目標,模型具有較好的魯棒性和泛化能力[11]。朱德利用MobileNet提取多層特征并融合特征建立的MF-SSD卷積神經網絡模型應用于玉米穗絲的檢測,模型獲得很好的檢測效果[12]。

國內針對板栗自動分級的研究開展的較早,在2005年,劉仕良應用機器視覺技術與機電一體化技術,對板栗實時條件下的視覺信息快速獲取與處理技術進行了研究,設計了基于機器視覺的板栗精細分級裝置[13]。展慧在2010年研究了基于BP神經網絡與板栗圖像特征的板栗分級方法,預測識別率達到了91.67%,還通過提取蟲眼邊緣特征向量,提出基于圖像處理技術識別蟲眼板栗的方法,方法的識別正確率可達88.9%[14-16]。Jiang通過圖像處理提取板栗的形狀特征參數,提出了一種基于決策融合的方法并利用神經網絡進行板栗自動分類的策略,提高了分類精度[17]。

上述板栗自動分級的研究的思路往往是根據圖像的顏色、紋理結構采用邊緣檢測等方法,這些方法不能滿足自然條件下獲取的所有復雜背景圖像,最終的板栗分級精度不高。在研究中利用自然光源獲取板栗圖像,經過圖像預處理后分為訓練、驗證和測試三組數據集,學習ShuffleNet的網絡架構理念,設計了一個淺層卷積神經網絡模型(Shnet-1)進行板栗的分級,提高了板栗分級的準確率。

1 材料與方法

1.1 板栗分級標準

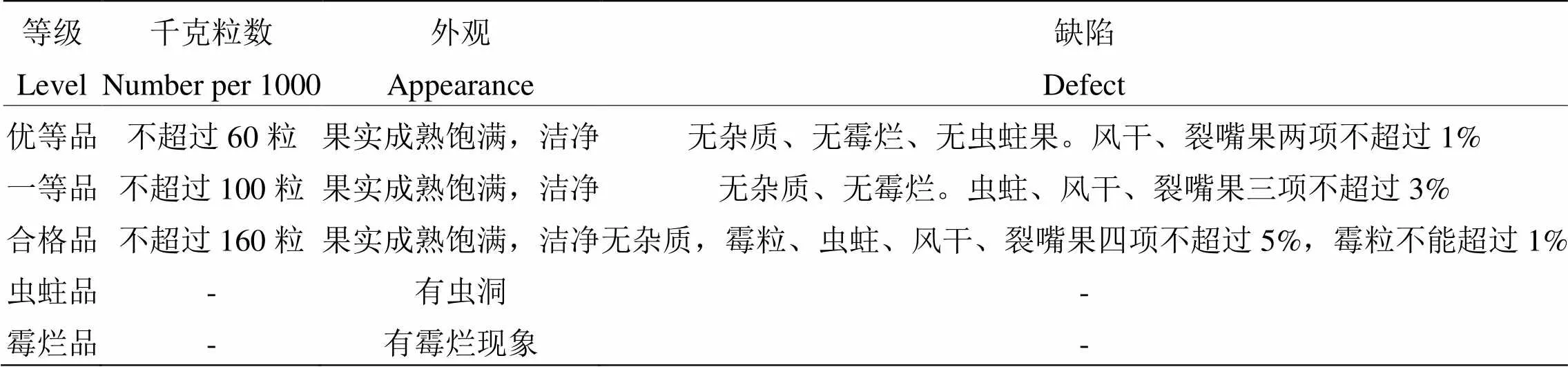

根據中華人民共和國供銷社行業標準GH/T1029-2002的規定,板栗共分為優等品、一等品和合格品三類,實際上板栗加工企業更關注霉爛和蟲蛀的板栗,這兩類板栗務必在加工前分揀出來而不能進入加工環節,因此在標準GH/T1029-2002的基礎上,添加霉爛品和蟲蛀品,采集的板栗來自山東省五蓮縣的板栗果,分類標準見表1。

表 1 板栗分級標準

1.2 板栗圖像的獲取與預處理

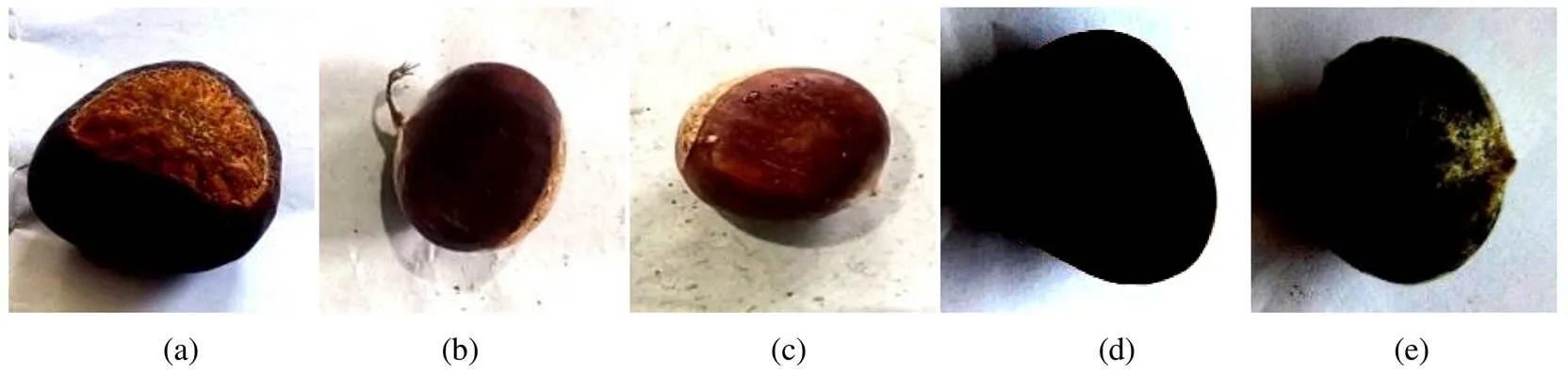

從板栗加工企業選擇分級后的板栗成品5481粒,其中優等品板栗1200粒、一等品板栗940粒、合格品板栗1162粒、蟲蛀品板栗1076粒,霉爛品板栗1103粒。用小米Note 9手機的攝像功能對這些板栗按級拍照,拍照時固定手機位置并且將板栗放置到一張白紙上,圖像分辨率為640像素(寬)*480像素(高),圖1所示的就是所拍攝的板栗的優等品(a)、一等品(b)、合格品(c)、蟲蛀品板栗(d)和霉爛品板栗(e)的原始圖像。

圖 1 板栗原始圖像

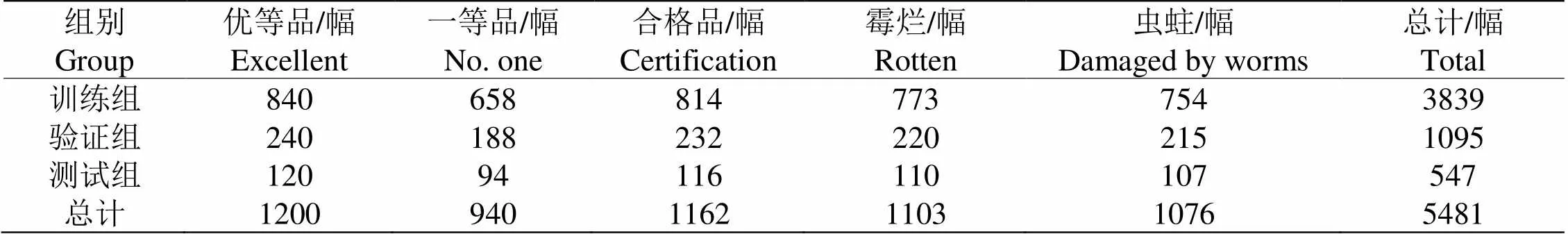

原始圖像的分辨率比較高,如果把全部像素的數據作為神經網絡的輸入,可能導致計算機顯存崩潰,輸入網絡時將圖像的分辨率縮減為224像素(寬)*224像素(高)。按照接近7:2:1的比例將5481幅圖像分成三組,一組為訓練數據組,有圖像3839幅。第二組為驗證數據組,有1095幅圖像,第三組為測試數據組,有547幅圖像。每一組的圖像分布如表2所示。

表 2 圖像數量分布

1.3 對比網絡模型

選擇AlexNet、ResNet、Mnet-1三個網絡模型進行板栗的分級試驗,將分級結果與改進的ShuffleNet的卷積神經網絡的板栗分級結果對比分析,從而選出最優的用于板栗分級的卷積神經網絡模型。

AlexNet使用ReLU作為CNN的激活函數,在全連接層使用了Dropout,使用最大池化,對局部神經元的活動創建了競爭機制。AlexNet有5 797 317個參數,占用22 MB存儲空間。汪小旵運用改進AlexNet卷積網絡模型對基于葉綠素熒光成像技術的番茄苗熱害脅迫進行智能識別,模型的平均識別精度達98.8%[18]。金守峰運用改進的AlexNet模型對抓毛織物質量進行檢測,模型能夠提取抓毛織物表面特征并且模型的識別率高[19]。

ResNet是一個批歸一化的152層卷積的深層卷積神經網絡模型,有11 252 036個參數。謝州益等學者針對傳統模型參數龐大的問題,提出一種基于ResNet18特征編碼器的圖像描述算法,對作物患病類型進行識別并生成描述,模型算法描述細致準確、魯棒性強[20]。張垚鑫以ResNet18為基礎構建了一種用于識別不同部位羊肉的改進ResNet18網絡模型,將ResNet18網絡殘差結構中的傳統卷積用深度可分離卷積替換后減少了參數量,改進的網絡模型對羊肉部位識別的準確率高達97.92%[21]。

Mnet-1是作者設計的一個改進的MobileNet用于板栗分級淺層卷積神經網絡,網絡結構采用中間大兩頭小的倒殘差結構,采用了ReLU6激活函數,倒殘差結構的最后一層的卷積采用了線性的激活函數,Mnet-1的最大優點是占用資源少,可用于嵌入式設備。

1.4 基于改進ShuffleNet的卷積神經網絡設計

ShuffIeNet是一個作為輕量級卷積神經網絡模型,模型復雜度低,適用場景廣,為了在保證精度的情況下減少網絡參數量,ShuffIeNet采用分組卷積。假設特征圖有個,分成個組,每個組的/個特征圖分別卷積處理后再進行合并,這種操作就是分組卷積。無論ShuffIeNet的V1版還是V2版,卷積層還是很多,容易過擬合[22,23],反而使板栗分級的精度降低,所以正確使用ShuffIeNet的方法就是在其基礎上改進以適應板栗分級的需求。

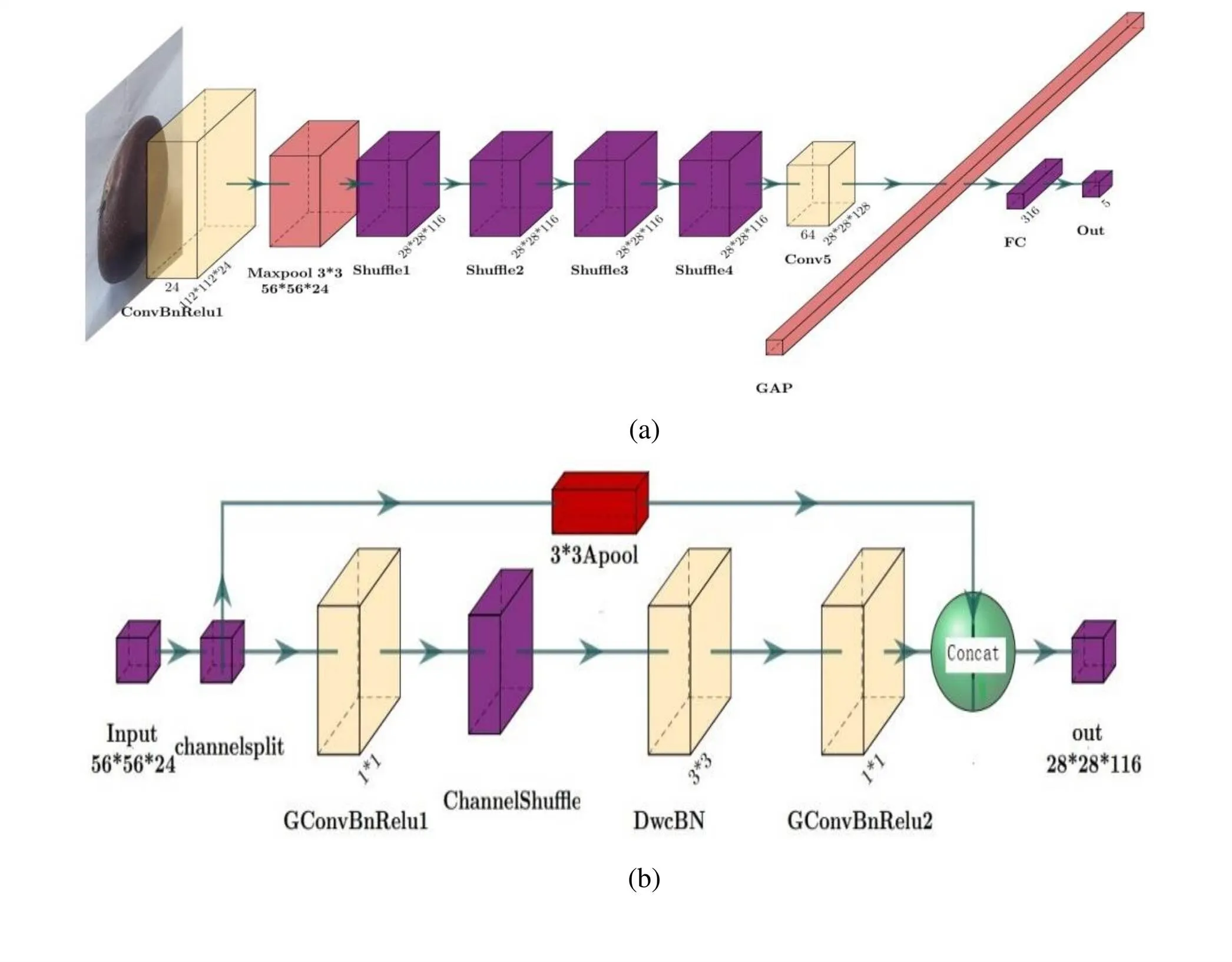

綜合考慮板栗分類準確率、分類速度以及網絡模型所占物理存儲的大小,在學習的基礎上設計了一個淺層CNN(Shnet-1,圖2(a)),網絡Shnet-1的輸入圖像的分辨率是224*224像素,有R、G、B三個通道,圖像首先進行卷積,卷積核大小為3*3,步距為2,有24個卷積核,輸出為112*112*24,卷積后經過批歸一化和Relu函數激活后輸入Maxpool作3*3、步距=2的最大池化處理,經池化處理后輸出的特征矩陣形狀是56*56*24。

批歸一化(Batch Normalization,BN)的目的使一批特征矩陣的每一個特征圖滿足均值為0、方差為1的分布規律,通過批歸一化,能夠加速網絡的訓練和提升網絡的收斂速度以及提升板栗分類準確率。

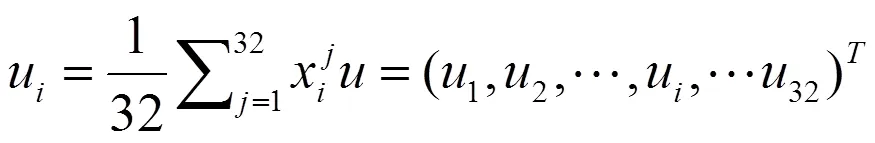

1.4.1 求均值

u第個批特征圖均值。

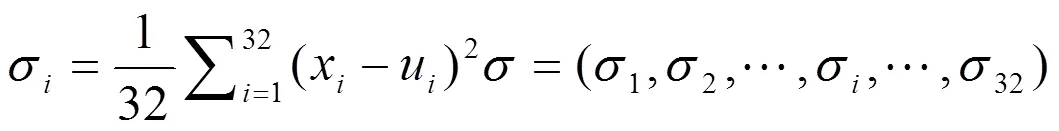

1.4.2 求方差

u第個批特征圖方差。

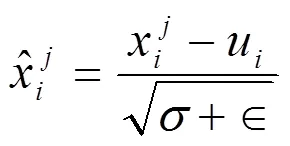

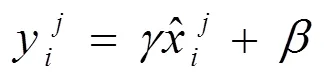

1.43 歸一化

56*56*24的特征圖輸入Shuffle1,Shuffle1的結構如圖2(b)所示,輸入的特征圖首先經過shufflesplit分組,分組的目的是為了采用不同的卷積核再對各個組進行卷積,從而降低卷積的計算量,減少權重占用空間。分組后的主線先經過第一次組卷積(group convolution,GConv),組卷積后批歸一化,用的激活函數為Relu函數(GConvBnRelu),見公式5。GConv層后不同組之間的特征圖是不通信的,各組之間是獨立的,沒有信息交流。為了解決這個問題,第一次GConv后進行channel shuffle操作,就是將組之間的特征進行交換,使得每個組包含了其他組的特征,從而實現不同信道組之間的信息通信,提高了板栗圖像特征提取的準確性。為了進一步提取板栗的特征細節,shuffle操作后進行深度可分離卷積(Depthwise Separable Convolution,Dwc)操作,Dwc操作主要是降低傳統卷積的計算復雜度,卷積核大小為3*3,步距等于2,卷積后經過BN操作。DwcBN后的板栗圖像特征矩陣再次GConvBnRelu完成主線操作。

在主線的DwcBN,步距等于2,而特征圖大小減小,輸入與輸出的特征圖的形狀不一致。因此Shuffle1殘差單元(分支)安排一個核大小為3*3、步距等于2的平均池化層(3*3Apool),從而使得主線和分支的輸出特征圖的形狀一致才能用Concat聯接輸出,輸出為28*28*116.

Shuffle2、Shuffle3和Shuffle4的結構形狀與Shuffle1相同,但是DwcBN的步距等于1,分支沒有平均池化層。4個Shuffle后的板栗特征圖進一步經過128個卷積核、核大小為1*1的卷積(圖2(a)的Conv5),至此完成板栗圖像的特征提取。

圖 2 Shnet-1卷積神經網絡結構

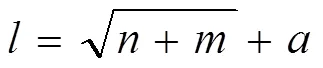

分類器是一個多層感知器(Multilayer Perceptron,MLP),MLP包括一個全局平均池化層(GAP)、一個隱藏層和一個輸出層,不同于Shufflenet的分類器,設計的Shnet-1增加了一個隱藏層,根據公式(6)計算隱藏層神經元個數為316。板栗共有優等品、一等品、合格品、霉爛和蟲蛀品5類,所以修改Shufflenet的輸出層的1 000個神經元為5個神經元,。Shnet-1的超參數如學習率、迭代次數和優化函數在第2部分介紹。

=max(0,)(5)

式中:—隱含層的神經元個數;—輸入層神經元個數;—輸出層神經元個數;—常數,設計中令=0。

2 網絡模型的訓練與驗證

2.1 環境與數據導入

4個網絡模型的訓練和驗證的操作系統為Window10,深度學習軟件框架為TensorFlow.keras。訓練和驗證的硬件環境CPU型號為AMD-Ryzen-5-3550H,內存為16 G,主頻2.1 GHZ。不使用GPU。

程序設計采用python語言,運用Keras的image_dataset_from_directory函數導入訓練、驗證和測試數據并在數據加載的同時打亂數據,將label_mode參數設置為categorical,從而使得圖像數據自動生成標簽向量,每批處理的數據為32幅圖像,對導入的圖像數據作歸一化處理。

2.2 訓練和驗證

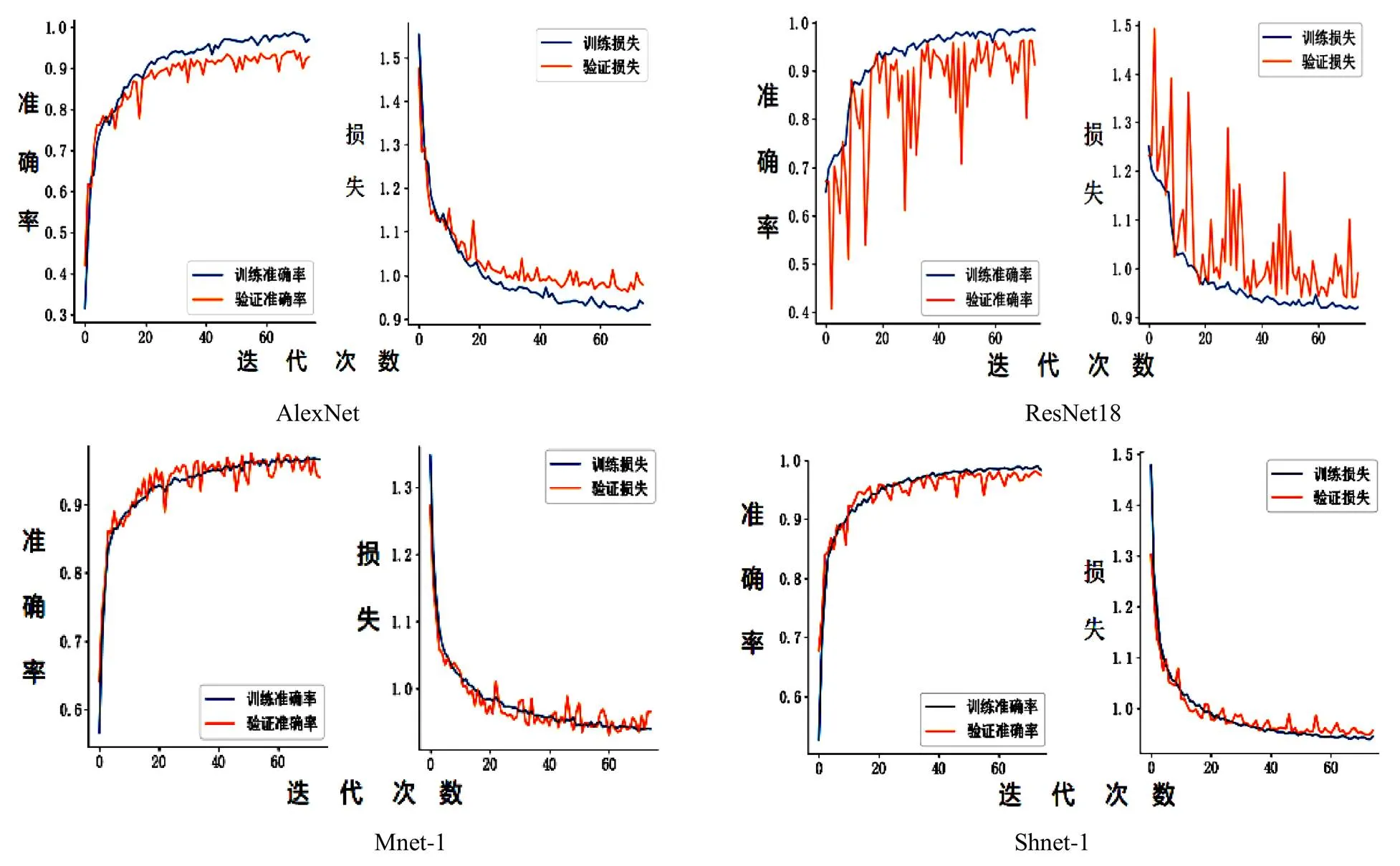

分別以訓練組和驗證組的板栗圖像對卷積神經網絡模型AlexNet、ResNet18、Mnet-1和Shnet-1進行訓練和驗證。根據以往對卷積神經網絡應用于農產品分級的研究中發現,在卷積神經網絡訓練的過程中,自適應矩估計(Adaptive moment estimation,Adam)優化器是最優的優化函數,動量因子設置為0.9。學習率過大會造成網絡無法收斂,在最優值附近振蕩,通過手動人工調整學習率的方法發現,當學習率為0.001時板栗分類的綜合效果最好。模型訓練迭代次數為75次,損失函數為對數交叉熵損失。訓練和驗證的準確率以及損失見圖3,橫坐標是訓練和驗證的迭代次數(epoch)。損失值反映了模型的擬合能力,損失越低,代表卷積神經網絡模型擬合的能力越強。

ResNet18在板栗的訓練與驗證過程中,表現出不穩定的狀態,準確率和損失一直處于波動狀態。AlexNet的訓練和驗證準確率在迭代60次后處于穩定,訓練的損失在0.93附近,驗證損失接近于1。Mnet-1在epoch=50時,訓練準確率達到最高值1,訓練損失達到最低值的0.5,驗證準確率達到0.97,驗證損失為0.62并且一直保持穩定。Shnet-1在epoch=50時訓練準確率達到極值1并保持穩定,驗證準確率達到99%,訓練損失達到最低值的0.38,驗證損失為0.42。

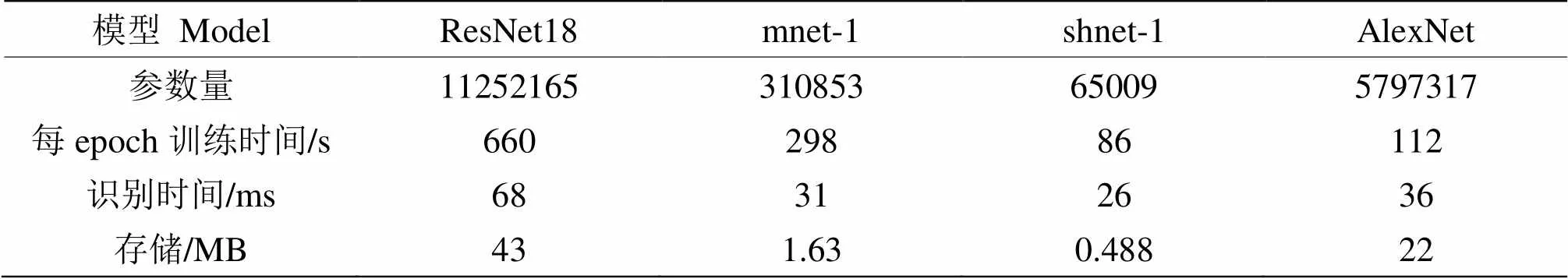

表3是四種卷積神經網絡模型在訓練和驗證的性能參數,隨著網絡深度的增加,參數量和訓練時間增加,ResNet18每個epoch訓練和驗證時間為11 min,75次迭代的時間達到13.7 h,Shnet-1每個epoch的訓練和驗證時間為1.43 min,75次迭代的時間達到1.8 h,Shnet-1的權重存儲只占488 KB,單幅板栗的分級識別時間僅用26 ms。

表 3 四種卷積網絡模型的性能對比

綜合板栗圖像的分類訓練和驗證的準確率以及損失,卷積網絡模型ResNet18不適合板栗的分級應用。基于ShuffIeNet改進的卷積神經網絡模型Shnet-1在訓練和驗證集上損失值波動很小且達到最低值0.40左右,證明該模型相比基于MobileNet改進的Mnet-1和AlexNet網絡模型泛化能力強。Shnet-1的訓練和驗證準確率是最高的,占用存儲空間和圖像識別時間是最低的,這也說明Shnet-1的學習效果是最好的。

3 網絡模型的測試

3.1 評價指標的選擇

混淆矩陣可以很好地展示分級的類型和分布,通過混淆矩陣計算網絡模型的相關評估指標如準確率、召回率和特異度。準確率廣泛地應用于分類的評估中,準確率是最直觀的評價指標,反映的是預測正確的樣本數占全部總樣本個數的比例,針對的是所有樣本的統計量(公式7),但當出現樣本不均衡的情況時,準確率并不能合理反映模型的預測能力。召回率克服了準確率的缺陷(公式8),特異度指標在一些嚴格要求不能漏檢異常樣本的任務中比較有意義(公式9),在板栗的分級中,霉爛和蟲蛀板栗不能被分為優等品、合格品或者一等品板栗。在混淆矩陣中,檳榔分級正確的有兩個參數,一個是正確預測為正樣本的數量(True Positive, TP),另一個是正確預測為負樣本的數量(True Negative,TN);檳榔分級錯誤的也有兩個參數,一個是錯誤的預測為正樣本的數量(False Positive,FP),另一個是錯誤地預測為負樣本的數量(False Negative, FN)。

=(+)/(+++)(7)

=/(+)(8)

=/(+)(9)

圖 3 四個網絡模型訓練和驗證的準確率和損失

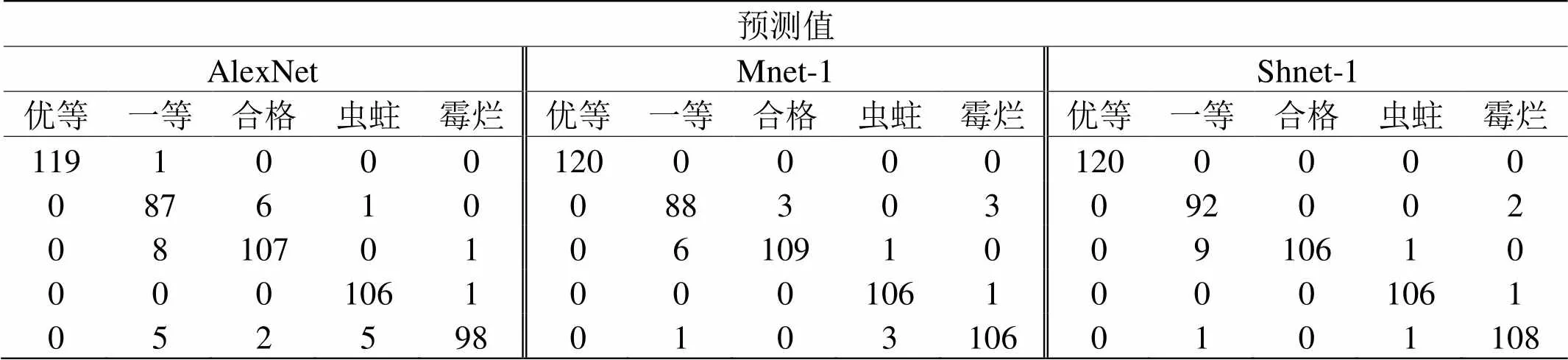

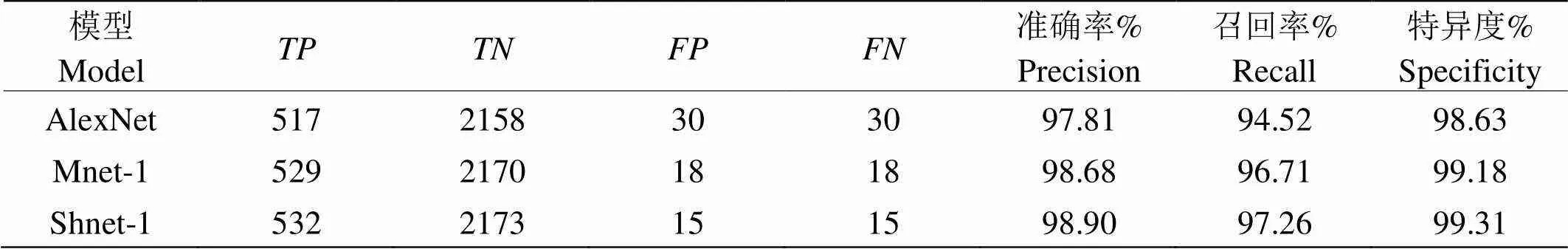

3.2 模型對比分析

將訓練好的AlexNet、Mnet-1和Shnet-1三個網絡模型用于板栗的分級測試,測試板栗圖像為測試數據組的547幅圖像,3個網絡模型測試結果的混淆矩陣如表4所示,測試結果的性能指標如表5所示。

如果把優等品、一等品和合格品板栗稱為好板栗,把霉爛品和蟲蛀品板栗稱為壞板栗,那么就板栗加工企業的要求而言,壞板栗是不能被分為好板栗的,否則就損害消費者利益,從而影響企業聲譽。為了增加企業利潤,好板栗分為壞板栗的比例要小。AlexNet模型對好板栗分級準確率為94.8%,對壞板栗分級準確率為94%,5粒霉爛板栗被預測為一等品,2粒霉爛板栗被預測為合格品,共占霉爛板栗的6.4%。

Mnet-1在547幅板栗圖像的分級中,優等品板栗全都被正確分級,一等品板栗有6粒被分錯,其中3粒被分成了合格品、3粒被分成了霉爛品,合格品板栗有7粒被分錯,其中6粒被分成了一等品、1粒被分成了蟲蛀品,蟲蛀品板栗僅有1粒被錯誤地分成霉爛品,霉爛品板栗有4粒被分錯,其中1粒被分成了一等品(低于1%)、3粒被分成了蟲蛀品。壞的板栗被分為好板栗的比例為0.18%。

Mnet-1模型對好板栗分級準確率為98.8%,對壞板栗分級準確率為99.5%。Mnet-1模型測試的整體分類識別準確率為98.68%。Mnet-1模型權重占用1.63 MB的存儲容量,單張板栗圖像的識別分級時間33 ms。

Shnet-1在547幅板栗圖像的分級中,優等品板栗全都被正確分級,一等品板栗有2粒被分錯為霉爛品,合格品板栗有10粒被分錯,合格品的誤判率較高,其中9粒被分成了一等品、1粒被分成了蟲蛀品,實際上有小部分合格品板栗與一等品板栗外形特征十分接近,所以模型識別困難,其它三個模型也有類似現象,人工篩分級有少部分的一等品板栗和合格品板栗界限也很模糊。蟲蛀品板栗僅有1粒被錯誤地分成霉爛品,霉爛品板栗有2粒被分錯,其中1粒被分成了一等品(低于1%)、1粒被分成了蟲蛀品。壞的板栗被分為好板栗的比例為0.18%。

Shnet-1模型對好板栗分級準確率為99.1%,對壞板栗分級準確率為99.5%。優等品板栗的分級準確率為100%,一等品板栗分類識別準確率為97.87%,合格品板栗分類識別準確率為91.38%,蟲蛀品板栗分類識別準確率為99.07%,霉爛品板栗分類識別準確率為98.18%,Shnet-1模型測試的整體分類識別準確率為98.90%。Shnet-1模型對板栗分級的準確率、和召回率的值都超過97%,特異度的值都超過99%,說明壞板栗的漏檢率很低,所以基于Adam優化的Shnet-1模型對板栗分級的效果好。Shnet-1的參數總量是65 009,Shnet-1的模型的深度小,參數總數和所占用的空間也小,最終的模型權重占用488 KB的存儲容量,單幅板栗圖像的識別分級時間只有26 ms,滿足嵌入式設備的要求。

CNN的層數增加,模型的復雜性也增加,參數的總數呈指數級增長又會導致增加了存儲空間,但是增加了深度并不能提高模型的性能。較深的卷積神經網絡對于板栗的分級訓練出現特征消失、過擬合和速度慢等問題,卷積網絡層數多反而降低了板栗分級的準確率,ResNet18,AlexNet卷積神經網絡不適和板栗分級的應用。因為板栗圖像特征并不復雜,比ImageNet數據庫中的圖像簡單的多,針對板栗圖像的分級,深度卷積網絡結構是不必要的。根據對比,Shnet-1對板栗的分級具有最高的準確率,其它的指標相對于深層模型AlexNet和Mnet-1同樣具有較高的比率,所以Shnet-1模型針對板栗分級的性能是最高的。

表 4 神經網絡模型的混淆矩陣

表 5 網絡模型的性能指標

4 結論

以板栗待加工品為對象,吸收ShuffleNet的網絡優勢,設計的卷積神經網絡模型Shnet-1對板栗的優等品、一等品、合格品、蟲蛀品和霉爛品5類板栗進行分級檢測。Shnet-1模型對板栗分級檢測的準確識別率高達98.90%,其中對優等品、一等品、合格品、蟲蛀品和霉爛品的識別率分別達到了100%、97.87%、91.38%、99.07%和98.18%。通過與AlexNet、Mnet-1、ResNet18三種卷積神經網絡的訓練、驗證和測試的對比,Shnet-1卷積神經網絡模型算法能有效提高板栗分級檢測識別的準確率,降低了壞板栗識別為好板栗的誤識率。

模型不依賴高端的計算設備就能進行實時的板栗分級檢測,Shnet-1吸收ShuffleNet神經網絡模型算法優點,具有準確率高、權重空間小、計算功耗低、實時性強的優點,易于部署在移動端和嵌入式設備中。為實現板栗分級檢測的自動化控制提供了基礎,具有一定的商業與工業價值。

在今后的工作中,可進一步研究增強模型的適用性和網絡參數的自適應調節,增加更多數量的各級原始板栗圖像訓練卷積神經網絡模型,提高模型的泛化能力,進一步減少壞板栗識別為好板栗的比率。

[1] 馮斌,汪懋華.基于計算機視覺的水果大小檢測方法[J].農業機械學報,2003,34(1):73-75

[2] 戴建民,曹鑄,孔令華,等.基于多特征模糊識別的煙葉品質分級算法[J].江蘇農業科學,2020,48(20):241-247

[3] 馬本學,李聰,李玉潔,等.基于殘差網絡和圖像處理的干制哈密大棗外部品質檢測[J].農業機械學報,2021,52(11):358-366

[4] 彭文,蘭玉彬,岳學軍,等.基于深度卷積神經網絡的水稻田雜草識別研究[J].華南農業大學學報,2020,41(6):75-81

[5] 彭旭,饒元,喬焰.基于寬度卷積神經網絡的異常農情數據檢測方法[[J].華南農業大學學報,2022,43(2):113-121

[6] 鄧向武,馬旭,齊龍,等.基于卷積神經網絡與遷移學習的稻田苗期雜草識別[J].農機化研究,2021,43(10):167-171

[7] 陸健強,林佳翰,黃仲強,等.基于Mixup算法和卷積神經網絡的柑橘黃龍病果實識別研究[J].華南農業大學學報, 2021,42(3):94-101

[8] 樊湘鵬,周建平,許燕.基于改進區域卷積神經網絡的田間玉米葉部病害識別[J].華南農業大學學報,2020,41(6):82-91

[9] 王璨,武新慧,李志偉.基于卷積神經網絡提取多尺度分層特征識別玉米雜草[J].農業工程學報,2018,34(5):144-151

[10] 李強,劉姣娣,許洪振,等.基于卷積神經網絡的蔗芽識別定位[J].農機化研究,2022,44(7):27-32

[11] 謝圣橋,宋健,湯修映,等.基于深度學習的機器人疏果前毛桃目標識別方法[J].農機化研究,2023,45(8):183-187

[12] 朱德利,林智健.基于MF-SSD卷積神經網絡的玉米穗絲目標檢測方法[[J].華南農業大學學報,2020,41(6):109-118

[13] 劉仕良.基于機器視覺的板栗分級設備研究[D].北京:北方工業大學,2005

[14] 展慧,李小昱,王為,等.基于機器視覺的板栗分級檢測方法[J].農業工程學報,2010,26(4):327-331

[15] 展慧,李小昱,王為,等.蟲眼板栗的圖像識別方法研究[J].農機化研究,2010,32(8):121-124

[16] 展慧,李小昱,周竹,等.基于近紅外光譜和機器視覺融合技術的板栗缺陷檢測[J].農業工程學報,2011,27(2):327-331.345-349

[17] Jiang YJ. Automatic classification of chestnuts based on decision fusion [C]. 2010 3rd International Conference on Computer and Electrical Engineering (ICCEE 2010), IPCSIT vol. 53 (2012)?(2012) IACSIT Press,Singapore,DOI: 10.7763/IPCSIT.2012.V53.No.2.59

[18] 汪小旵,吳忠賢,孫曄,等.基于葉綠素熒光成像技術的番茄苗熱害脅迫智能識別方法[J].農業工程學報,2022,38(7):171-179

[19] 金守峰,侯一澤,焦航,等.基于改進AlexNet模型的抓毛織物質量檢測方法[J].紡織學報,2022,43(6):134-139

[20] 謝州益,馮亞枝,胡彥蓉,等.基于Res Net18特征編碼器的水稻病蟲害圖像描述生成[J].農業工程學報,2022,38(12):197-206

[21] 張垚鑫,朱榮光,孟令峰,等.改進ResNet18網絡模型的羊肉部位分類與移動端應用[J].農業工程學報,2021,37(18):331-338

[22] 曾華福,楊杰,李林紅.基于改進ShuffleNet v1的服裝圖像分類算法[J].現代紡織技術,2023,31(2):23-35

[23] 彭紅星,徐慧明,劉華鼐.基于改進ShuffIeNet V2的輕量化農作物害蟲識別模型[J].農業工程學報,2022,38(11):161-170

Chestnut Grading Method Based on Improved ShuffleNet

LI Zhi-chen1, LING Xiu-jun1, LI Hong-qiu1, LI Zhi-jun2

1.211169,2.262302,

The traditional chestnut grading method mainly relies on manual or mechanical multi-stage vibrating screens, which not only have low grading accuracy but also easily divide bad chestnuts into good ones. In response to the problems in chestnut grading, a lightweight convolutional neural network was constructed to achieve high-precision automatic grading of chestnuts. Under natural light conditions, a total of 5481 images of high-quality, first-class, qualified, worm-eaten, and moldy chestnuts were captured using a Xiaomi Note9 mobile phone and applied to the training, validation, and testing of convolutional network models. On the basis of learning ShuffleNet, a shallow convolutional neural network Shnet-1 was constructed. Shnet-1 is a chestnut image feature extraction network composed of two convolutional modules and four Shuffles. The feature extraction network connects the Chinese chestnut classifier. The classifier is a multilayer perceptron composed of a global average pooling layer, a hidden layer and an output layer. In order to achieve the maximum accuracy and minimum amount of calculation of chestnut classification, the hyperparameter of Shnet-1 model was optimized. The classification performance of Shnet-1 was compared and analyzed with various deep learning models such as AlexNet, Mnet-1, and ResNet18. The accuracy of applying the shallow convolutional neural network Shnet-1 network model to chestnut grading reaches 98.90%, and the proportion of bad chestnuts being classified as good chestnuts is less than 0.5%. The computational complexity of Shnet-1 is small, with a classification time of 26 ms for chestnut images, and its weight only accounts for 488KB of physical storage capacity. The improved ShuffleNet convolutional neural network model Shnet-1 can quickly and accurately grade chestnuts, providing intelligent decision support for automatic grading of chestnuts.

Chestnut grading;Net

TS736+.4

A

1000-2324(2023)02-0299-09

10.3969/j.issn.1000-2324.2023.02.020

2023-02-28

2023-03-11

國家自然科學基金面上項目(51775270)

李志臣(1970-),男,博士研究生,副教授,主要從事機電一體化研究. E-mail:lzc@jit.edu.cn