基于遷移學(xué)習(xí)和改進殘差網(wǎng)絡(luò)的復(fù)雜背景下害蟲圖像識別

溫艷蘭 陳友鵬 王克強 程杏安 林欽永 蔡肯 馬佳佳 孔翰博

摘要:在農(nóng)業(yè)生產(chǎn)中,蟲害已經(jīng)成為影響作物產(chǎn)量和質(zhì)量的主要威脅之一,針對傳統(tǒng)識別方法對復(fù)雜背景下蟲害圖像識別準確率和效率低等問題,本研究提出一種基于遷移學(xué)習(xí)和改進殘差網(wǎng)絡(luò)的蟲害圖像識別方法。首先,利用數(shù)據(jù)增強技術(shù)對采集的橘小實蠅蟲害圖像進行樣本數(shù)據(jù)的擴充;再在ResNet-34模型的基礎(chǔ)上,增加了2個注意力模塊層,并重新設(shè)計了全連接層模塊,獲得能夠改進后的網(wǎng)絡(luò)模型;最后利用遷移學(xué)習(xí)的方法將預(yù)訓(xùn)練的參數(shù)權(quán)重遷移到本模型中進行訓(xùn)練,并在試驗過程中分析學(xué)習(xí)方式、樣本量、學(xué)習(xí)率、批量大小等參數(shù)對模型性能的影響。結(jié)果表明,采用旋轉(zhuǎn)、翻轉(zhuǎn)和亮度變換操作對圖像進行數(shù)據(jù)擴充的數(shù)據(jù)集,在訓(xùn)練模型的全部層的遷移學(xué)習(xí)方法中獲得99.77%的測試準確率。本研究提出的模型具有較高的識別準確率和較強的魯棒性,可為實現(xiàn)復(fù)雜背景下蟲害的識別提供參考。

關(guān)鍵詞:遷移學(xué)習(xí);卷積神經(jīng)網(wǎng)絡(luò);注意力機制;圖像識別

中圖分類號:TP391.41 文獻標志碼:A

文章編號:1002-1302(2023)08-0171-06

基金項目:國家自然科學(xué)基金(編號:62003379);廣東省科技計劃(編號:KA1721404);廣東省普通高校重點領(lǐng)域?qū)m棧ň幪枺?019GZDXM007)。

作者簡介:溫艷蘭(1995—),女,廣東梅縣人,碩士研究生,主要研究方向為機器視覺。E-mail:164734302@qq.com。

通信作者:王克強,碩士,教授,主要研究方向為農(nóng)業(yè)機器人。E-mail:wangkq2003@126.com。

柑橘味道鮮美且營養(yǎng)豐富,深受廣大消費者的喜愛。據(jù)國家統(tǒng)計局數(shù)據(jù)了解,2020年我國柑橘種植面積近270萬hm2,柑橘產(chǎn)量達到5 121.9萬t[1],已成為我國栽培面積最大、產(chǎn)量最高的水果。柑橘是橘小實蠅偏好的寄主水果,其產(chǎn)量和質(zhì)量受橘小實蠅影響嚴重,進而造成嚴重的經(jīng)濟損失[2]。因此,實現(xiàn)快速準確地識別橘小實蠅,能夠使管理者及時采取有效的防治措施,提高柑橘的產(chǎn)量和品質(zhì)。

近年來,隨著機器視覺和計算機技術(shù)的深入發(fā)展,深度學(xué)習(xí)算法在圖像識別中發(fā)揮著越來越重要的作用,并在蘋果[3-5]、柑橘[6-8]、棉花[9-10]、大豆[11-12]、玉米[13-15]、水稻[16-18]等作物病蟲害識別[19-23]中取得了不錯的研究成果。趙立新等在棉花病蟲害的識別中,通過改進AlexNet模型中的全連接層的結(jié)構(gòu),獲得了97.16%的平均測試準確率,為棉花葉部病蟲害識別提供了可靠依據(jù)[24]。He等采用雙層Faster R-CNN對褐飛虱進行不同數(shù)量和不同蟲齡的檢測[25]。而李衡霞等則將Fast R-CNN與VGG16進行結(jié)合,實現(xiàn)對油菜害蟲94.12%的平均分類準確率[26]。李昊等采用DenseNet網(wǎng)絡(luò)模型對柑橘病害的平均識別精度達到95.46%,可實現(xiàn)柑橘智能監(jiān)控的管理,為病蟲害物聯(lián)網(wǎng)監(jiān)控提供了參考[27]。孫鵬等將注意力機制運用到卷積神經(jīng)網(wǎng)絡(luò)模型中,通過串聯(lián)的方式將提取的粗尺度圖像作為細尺度圖像的輸入來提取更細的特征,不僅實現(xiàn)了大豆蚜蟲的準確識別,而且為農(nóng)業(yè)信息化的技術(shù)可行性提供了可靠的理論依據(jù)[28]。

Malathi等通過對ResNet-50模型的超參數(shù)和層次進行微調(diào),再引入遷移學(xué)習(xí)方法,實現(xiàn)對10種水稻害蟲準確分類識別[29]。Zhang等在殘差網(wǎng)絡(luò)中引入離散卷積,實現(xiàn)對儲糧害蟲進行識別,平均識別準確率達96.72%[30]。曹躍騰等通過調(diào)整底層卷積尺寸、改進殘差塊結(jié)構(gòu)和模型剪枝操作,得到一種輕量化的植物葉片病蟲害識別算法——Simplify-ResNet,并在人工采集圖像和PlantVillage數(shù)據(jù)集圖像中,獲得更高的準確率和更好的穩(wěn)定性能,為移動端植物病蟲害識別解決了最重要的算法設(shè)計問題[31]。賈少鵬等在卷積神經(jīng)網(wǎng)絡(luò)(CNN)架構(gòu)中加入了膠囊網(wǎng)絡(luò)進行結(jié)構(gòu)優(yōu)化,彌補了CNN在輸出時丟失大量信息的缺陷,優(yōu)化后的模型對番茄灰霉病病害的識別精度比原模型提高了3.55%[32]。王鐸等將深度卷積條件加入到生成對抗網(wǎng)絡(luò)中,增強了模型穩(wěn)定性,能夠適應(yīng)于不同成長階段的蟲害和種類繁多的分類場景[33]。

在上述研究中,大多數(shù)試驗樣本都是在簡單的背景下取得的,對復(fù)雜背景的適應(yīng)性較差,存在一定的局限性。本研究基于ResNet-34模型,采用遷移學(xué)習(xí)的方法,對復(fù)雜背景下的橘小實蠅蟲害圖像進行訓(xùn)練,以期實現(xiàn)復(fù)雜背景下柑橘蟲害的高效準確識別。

1 材料與方法

1.1 圖像數(shù)據(jù)采集

本研究以橘小實蠅為研究對象。橘小實蠅成蟲體長6~8 mm,翅展14~16 mm,全體深黑色和黃色相間,胸部背面大部分黑色,但黃色的“U”字形斑紋明顯,腹部呈黃色[34]。由于在自然環(huán)境中,橘小實蠅移動迅速,其圖像難以獲取,本研究在實驗室內(nèi)搭建了一套模擬自然環(huán)境的圖像采集系統(tǒng),在復(fù)雜背景中對橘小實蠅進行多角度拍攝。選用德國IDS工業(yè)相機(型號:UI-3070CP-C-HQ Rev.2)作為圖像采集設(shè)備,分辨率為2 056像素×1 542像素。采集成蟲在復(fù)雜背景下的樣本圖像1 700幅及無成蟲的圖像1 700幅,共3 400幅清晰彩色圖像作為本研究的原始數(shù)據(jù)集。

1.2 圖像數(shù)據(jù)預(yù)處理及數(shù)據(jù)增強

首先,將采集到的原始圖像利用圖像處理工具包OpenCV批量裁剪出520像素×520像素大小的JPG圖像,橘小實蠅蟲害圖像和無蟲害圖像各1 700幅,2種樣本共計3 400幅。然后,通過旋轉(zhuǎn)變換和翻轉(zhuǎn)變換擴充圖像數(shù)量,分別旋轉(zhuǎn)90°、180°、270°、水平翻轉(zhuǎn)和垂直翻轉(zhuǎn),以模擬拍攝的角度差異。并通過明亮度變換(變亮、變暗)進行擴充,模擬拍攝的光線差異。通過上述圖像擴充操作后,圖像總計27 200幅。最后,把圖像尺寸統(tǒng)一縮放到224像素×224像素,得到最終的樣本圖像數(shù)據(jù)集。本研究按照6 ∶2 ∶2的比例將獲得的圖像數(shù)據(jù)集劃分為訓(xùn)練集、驗證集和測試集,樣本示例如圖1所示。

1.3 模型結(jié)構(gòu)設(shè)計

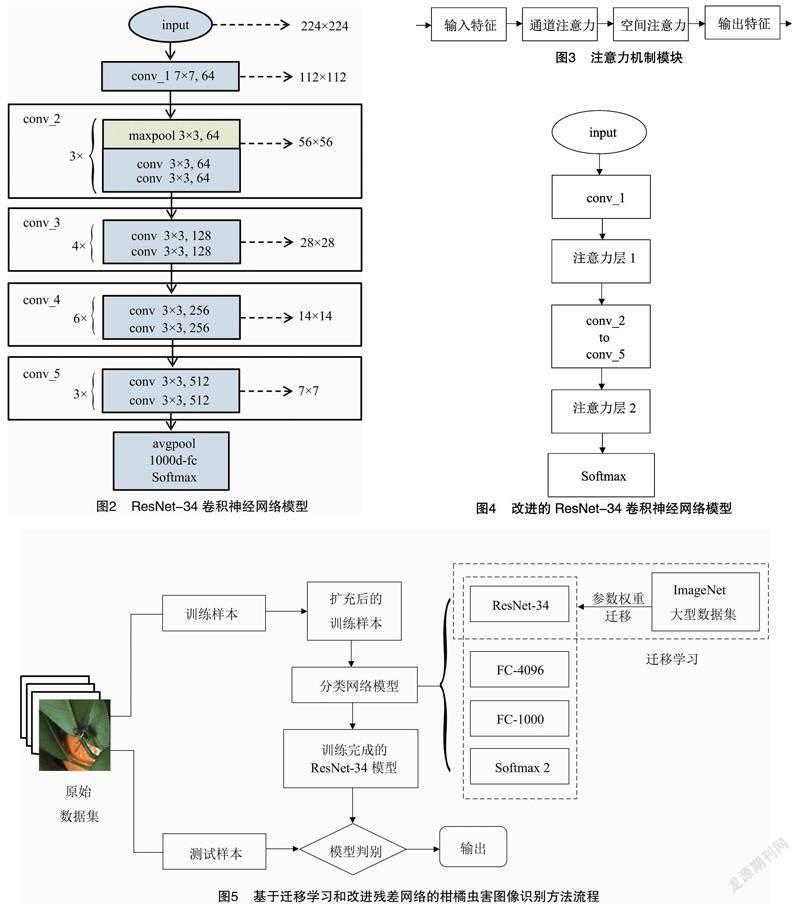

ResNet是何愷明等提出來的一種深層次的深度學(xué)習(xí)網(wǎng)絡(luò)[35],本研究使用ResNet-34基本網(wǎng)絡(luò)模型進行遷移學(xué)習(xí),其模型結(jié)構(gòu)如圖2所示。ResNet-34除第1層7×7卷積和最后一層全連接外,共有4組殘差組,每個殘差組各有3、4、6、3個殘差單元,而且1個殘差單元包含2個3×3卷積。本研究在殘差網(wǎng)絡(luò)中加入注意力機制模塊,如圖3所示,包含通道注意力和空間注意力。加入注意力機制模塊后的ResNet-34結(jié)構(gòu)如圖4所示。

ResNet-34利用ImageNet數(shù)據(jù)集中上百萬幅圖像完成訓(xùn)練,得到一個較好的分類識別模型。在目前條件下,橘小實蠅蟲害圖像還沒能夠達到如此巨大的數(shù)據(jù)集,因而想要訓(xùn)練出效果理想的分類模型是比較困難的。而遷移學(xué)習(xí)能夠?qū)⒁粋€基礎(chǔ)數(shù)據(jù)集和基礎(chǔ)任務(wù)上訓(xùn)練所得的網(wǎng)絡(luò)模型遷移到目標數(shù)據(jù)和目標任務(wù)的訓(xùn)練網(wǎng)絡(luò)中。因此,可以采用遷移學(xué)習(xí)的方法來進行柑橘蟲害的分類識別。本研究采用的方法是保留圖2中前5個卷積模塊,并且加入注意力模塊,再重新設(shè)計全連接層模塊,然后利用遷移學(xué)習(xí)的方法將預(yù)訓(xùn)練ResNet-34模型的權(quán)重和參數(shù)運用到柑橘蟲害的檢測與識別中,具體的流程圖如圖5所示。

1.4 試驗環(huán)境與參數(shù)設(shè)計

1.4.1 試驗環(huán)境

試驗在Python 3.7.11、torch-GPU 1.10.2軟件環(huán)境下完成。試驗中訓(xùn)練模型的硬件環(huán)境為64位Windows10系統(tǒng),并配置有11th Gen Intel CoreTM i7-11700K CPU,主頻3.6 GHz,圖形處理單元(GPU)采用NVIDIA GeForce RTX 3060,12 GB顯存。試驗在GPU模式下進行,采用Python語言進行編程,利用OpenCV圖像處理庫及pytorch框架相關(guān)的深度學(xué)習(xí)庫完成網(wǎng)絡(luò)的搭建。

1.4.2 試驗參數(shù)的設(shè)計

在深度學(xué)習(xí)中,模型的性能受到諸多因素的影響。本研究綜合考慮4個影響因素,包括模型的訓(xùn)練方式、數(shù)據(jù)增強方法、學(xué)習(xí)率和批量大小(batch_size)對模型性能的影響,總共進行了15組模型訓(xùn)練,每組試驗都運行100次迭代(epoch),并且每次迭代前都打亂訓(xùn)練集的輸入順序。

2 結(jié)果與分析

2.1 學(xué)習(xí)方式對模型性能的影響

在學(xué)習(xí)率為0.01、batch_size為16的條件下,采用2種不同的訓(xùn)練機制對原始圖像數(shù)據(jù)集進行訓(xùn)練,并對改進前后的模型進行對比試驗,得到訓(xùn)練集、驗證集和測試集的準確率如表1所示。

從表1可以看出,在相同的試驗條件下,2種不同的訓(xùn)練機制下所得到的驗證準確率與測試準確率相符,而且對模型所有層的所有參數(shù)都進行目標域的訓(xùn)練獲得了最佳的識別效果,訓(xùn)練集平均準確率為97.17%,測試集準確率為99.55%。2種訓(xùn)練方式改進模型前后的識別準確率和損失值如圖6所示。

從圖6-a中可以看出,對模型所有層的所有參數(shù)都進行目標域訓(xùn)練的遷移學(xué)習(xí)比僅訓(xùn)練分類器參數(shù)的訓(xùn)練精度更高、更穩(wěn)定,而且修改后的模型的收斂速度更快。而且從圖6-b中可以看出,2種模型的損失值均在0.06以下,而且對模型所有層的所有參數(shù)都進行訓(xùn)練的遷移學(xué)習(xí)的損失值下降速度更快,到達穩(wěn)定點基本可以維持在0.001左右,訓(xùn)練效果比較理想。

2.2 圖像數(shù)據(jù)擴充對模型性能的影響

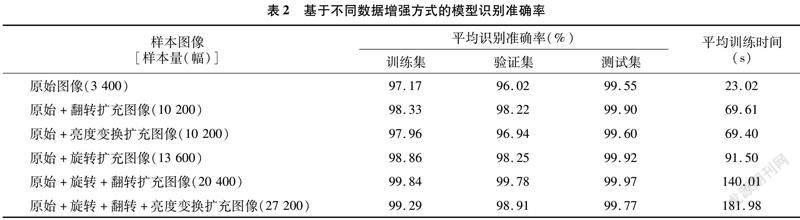

從“2.1”節(jié)中可知,對改進后的模型所有層的所有參數(shù)都進行目標域訓(xùn)練的遷移學(xué)習(xí)模型獲得了更好的性能,因此,本節(jié)采用這一模型對圖像數(shù)據(jù)擴充進行進一步的研究。為研究模型在不同擴充圖像的泛化能力,本研究對原始圖像數(shù)據(jù)集、原始+翻轉(zhuǎn)擴充圖像數(shù)據(jù)集、原始+亮度變換擴充圖像數(shù)據(jù)集、原始+旋轉(zhuǎn)擴充圖像數(shù)據(jù)集、原始+旋轉(zhuǎn)+翻轉(zhuǎn)擴充圖像數(shù)據(jù)集以及原始+旋轉(zhuǎn)+翻轉(zhuǎn)+亮度變換擴充圖像數(shù)據(jù)集進行訓(xùn)練、驗證和測試。在初始學(xué)習(xí)率均為0.01的情況下,采用不同的數(shù)據(jù)擴充方式對模型進行訓(xùn)練,識別準確率情況如表2所示。

從表2可知,不同數(shù)據(jù)增強情況下的訓(xùn)練與測試準確率相差不大,一方面可能是因為數(shù)據(jù)圖像采集時采用了明亮度不同的多角度拍攝,因而數(shù)據(jù)增強操作對圖像的質(zhì)量改變不大,另一方面是遷移學(xué)習(xí)使用的模型是從大型數(shù)據(jù)集ImageNet上獲得的,對特征的提取能力較高,對樣本的數(shù)量擴充依賴性較低。由此可見,遷移學(xué)習(xí)對復(fù)雜背景下小樣本的橘小實蠅蟲害識別也具有較高的魯棒性,而且能夠有效地減少訓(xùn)練所需時間。

2.3 學(xué)習(xí)率對模型性能的影響

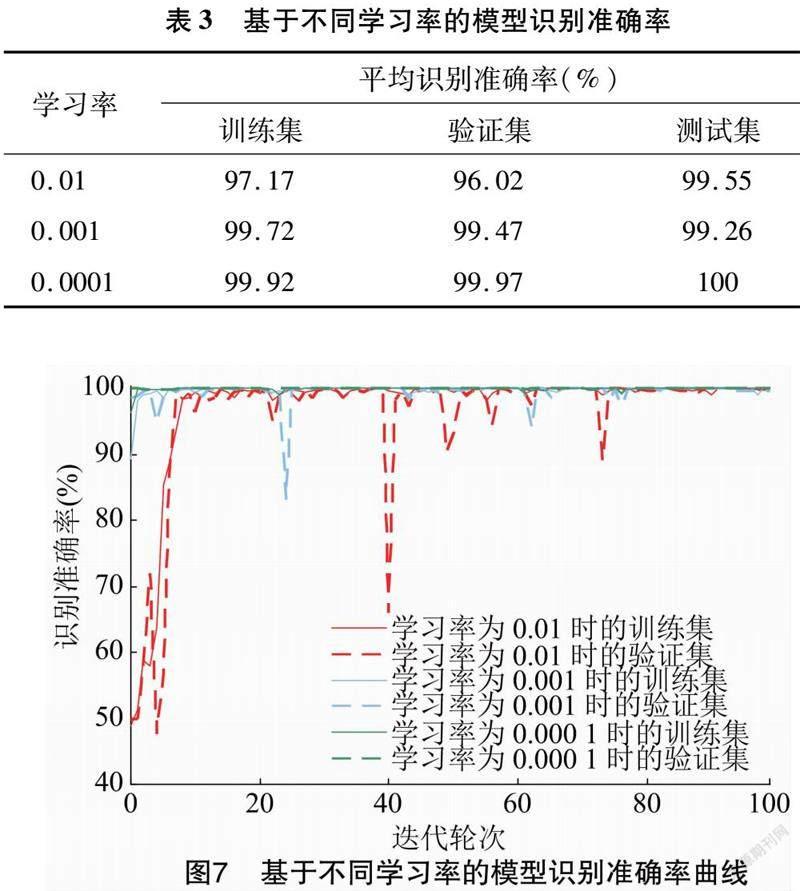

對原始數(shù)據(jù)集采用3種不同的學(xué)習(xí)率對模型進行訓(xùn)練,識別準確率情況如表3所示,訓(xùn)練和驗證曲線如圖7所示。

由表3可知,模型測試集的平均識別準確率均達到99%以上,模型都得到了較好的魯棒性。但是從圖7可以看出,學(xué)習(xí)率為0.000 1訓(xùn)練集和測試集準確率都能夠穩(wěn)定維持在較高水平上,而學(xué)習(xí)率為0.01和0.001的模型雖然也能夠獲得較高的訓(xùn)練精度,但是在驗證集上存在一定的波動,模型的穩(wěn)定性相對較差。因此,學(xué)習(xí)率為0.000 1的模型識別效果最佳。

2.4 批量大小對模型性能的影響

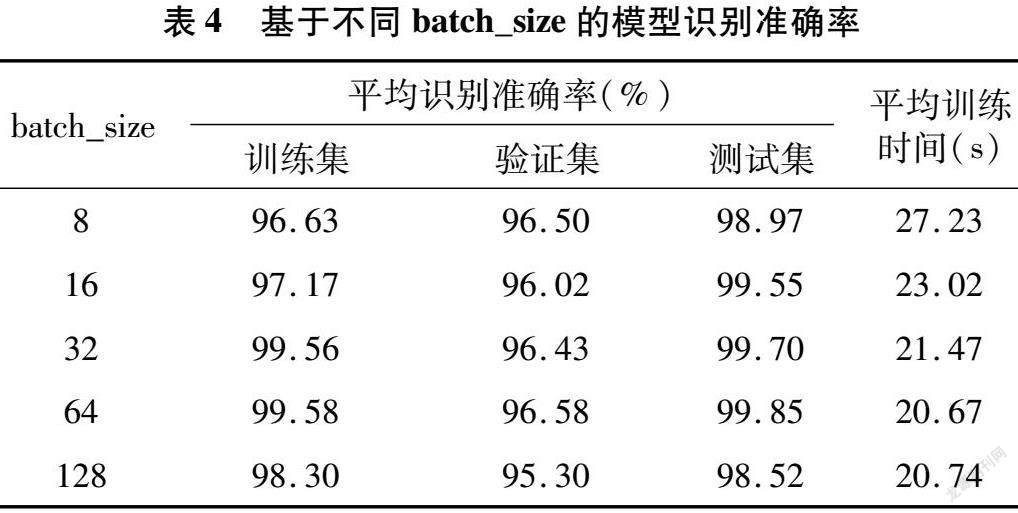

由“2.3”節(jié)可知,學(xué)習(xí)率為0.000 1時模型的識別效果最佳,訓(xùn)練、驗證和測試準確率均達到99%以上,如果在此基礎(chǔ)上對batch_size設(shè)置對比試驗,試驗對比效果不太明顯,因此,在學(xué)習(xí)率為0.01的情況下,采用5種不同batch_size對模型進行訓(xùn)練,識別準確率情況如表4所示。

從表4可以看出,隨著batch_size的增加,平均訓(xùn)練時間相對減少,但是模型的識別準確率呈現(xiàn)正態(tài)分布的趨勢,因此,batch_size選取得過大或者過小都會使得模型的泛化能力降低。

2.5 模型用戶界面開發(fā)

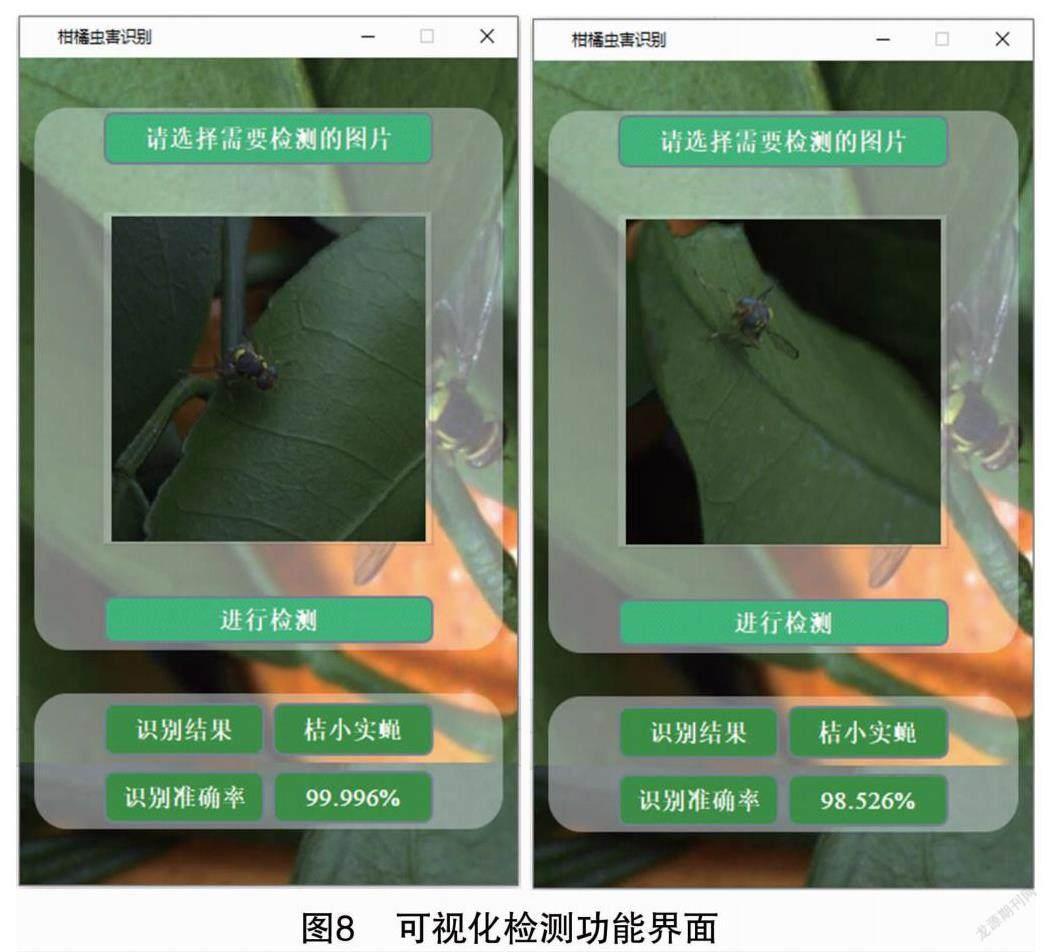

為了方便使用者操作,將程序開發(fā)成用戶界面,只需選擇好自己需要檢測的圖像即可進行檢測。現(xiàn)隨機選擇2幅橘小實蠅圖像進行檢測,檢測結(jié)果如圖8所示,識別的準確率分別為99.996%和98.526%,具有良好的應(yīng)用效果。

3 討論與結(jié)論

本研究以ResNet-34為基礎(chǔ)模型,融入了注意力機制,并對其全連接層的結(jié)構(gòu)進行了改進,用于復(fù)雜背景下橘小實蠅的蟲害圖像識別建模。通過設(shè)置15組模型訓(xùn)練試驗,選取出魯棒性高、泛化能力強的模型。根據(jù)試驗結(jié)果,可以得出以下結(jié)論。

(1)在相同的試驗條件下,對模型所有層的所有參數(shù)都進行目標域訓(xùn)練的遷移學(xué)習(xí)模型的整體性能比僅訓(xùn)練分類器參數(shù)的模型更好,能夠在橘小實蠅蟲害圖像識別中獲得97.17%的平均識別準確率。

(2)遷移學(xué)習(xí)弱化了模型對樣本數(shù)量擴充的依賴性。雖然數(shù)據(jù)擴充會使得訓(xùn)練時長增加,但是充足的樣本量能夠在一定程度上提高模型的識別性能。將采集的圖像數(shù)據(jù)擴充到原來的8倍后,訓(xùn)練集準確率從97.17%的基礎(chǔ)上提升了2.12%。

(3)在遷移學(xué)習(xí)中,3種學(xué)習(xí)率均獲得了良好的訓(xùn)練效果,但是學(xué)習(xí)率為0.01和0.001的模型在測試集中識別準確率波動比較大,而學(xué)習(xí)率為0.000 1的模型測試集準確率高且穩(wěn)定,識別效果最佳。

(4)batch_size較小時花費時間較長,且實際測試精度相對較低;batch_size較大時,不同batch的梯度方向沒有任何變化,容易陷入局部極小值,使得實際測試精度較低。

本研究結(jié)合深度卷積神經(jīng)網(wǎng)絡(luò)和遷移學(xué)習(xí),對復(fù)雜背景下的橘小實蠅進行識別,獲得了較好的應(yīng)用效果。下一步研究計劃搜集更多復(fù)雜環(huán)境下的其他蟲害的圖像,進一步豐富蟲害數(shù)據(jù),然后對多種蟲害進行混合并研究其識別方法,以提升模型的應(yīng)用價值。

參考文獻:

[1]國家統(tǒng)計局. 中國統(tǒng)計摘要2021[M]. 北京:中國統(tǒng)計出版社,2022.

[2]王明召,陽廷密,趙小龍,等. 橘小實蠅田間消長動態(tài)及對柑橘果實危害研究[J]. 應(yīng)用昆蟲學(xué)報,2019,56(3):485-491.

[3]Ding W G,Taylor G. Automatic moth detection from trap images for pest management[J]. Computers and Electronics in Agriculture,2016,123:17-28.

[4]于洪濤,袁明新,王 琪,等. 基于VGG-F動態(tài)學(xué)習(xí)模型的蘋果病蟲害識別[J]. 科學(xué)技術(shù)與工程,2019,19(32):249-253.

[5]周宏威,沈恒宇,袁新佩,等. 基于遷移學(xué)習(xí)的蘋果樹葉片病蟲害識別方法研究[J]. 中國農(nóng)機化學(xué)報,2021,42(11):151-158.

[6]Xing S L,Lee M,Lee K K. Citrus pests and diseases recognition model using weakly dense connected convolution network[J]. Sensors,2019,19(14):3195.

[7]Morteza K,Ezzatollah A A,Ehsan K. Citrus pests classification using an ensemble of deep learning models[J]. Computers and Electronics in Agriculture,2021,186:106192.

[8]Partel V,Nunes L,Stansly P,et al. Automated vision-based system for monitoring Asian citrus psyllid in orchards utilizing artificial intelligence[J]. Computers and Electronics in Agriculture,2019,162:328-336.

[9]Alves A N,Souza W S R,Borges D L. Cotton pests classification in field-based images using deep residual networks[J]. Computers and Electronics in Agriculture,2020,174:105488.

[10]張建華,孔繁濤,吳建寨,等. 基于改進VGG卷積神經(jīng)網(wǎng)絡(luò)的棉花病害識別模型[J]. 中國農(nóng)業(yè)大學(xué)學(xué)報,2018,23(11):161-171.

[11]Tetila E C,Machado B B,Menezes G K,et al. Automatic recognition of soybean leaf diseases using UAV images and deep convolutional neural networks[J]. IEEE Geoscience and Remote Sensing Letters,2020,17(5):903-907.

[12]Amorim W P,Tetila E C,Pistori H,et al. Semi-supervised learning with convolutional neural networks for UAV images automatic recognition[J]. Computers and Electronics in Agriculture,2019,164:104932.

[13]李 靜,陳桂芬,安 宇. 基于優(yōu)化卷積神經(jīng)網(wǎng)絡(luò)的玉米螟蟲害圖像識別[J]. 華南農(nóng)業(yè)大學(xué)學(xué)報,2020,41(3):110-116.

[14]Waheed A,Goyal M,Gupta D,et al. An optimized dense convolutional neural network model for disease recognition and classification in corn leaf[J]. Computers and Electronics in Agriculture,2020,175:105456.

[15]許景輝,邵明燁,王一琛,等. 基于遷移學(xué)習(xí)的卷積神經(jīng)網(wǎng)絡(luò)玉米病害圖像識別[J]. 農(nóng)業(yè)機械學(xué)報,2020,51(2):230-236,253.

[16]Jiang F,Lu Y,Chen Y,et al. Image recognition of four rice leaf diseases based on deep learning and support vector machine[J]. Computers and Electronics in Agriculture,2020,179:105824.

[17]Wang F Y,Wang R J,Xie C J,et al. Convolutional neural network based automatic pest monitoring system using hand-held mobile image analysis towards non-site-specific wild environment[J]. Computers and Electronics in Agriculture,2021,187:106268.

[18]Yao Q,F(xiàn)eng J,Tang J,et al. Development of an automatic monitoring system for rice light-trap pests based on machine vision[J]. Journal of Integrative Agriculture,2020,19(10):2500-2513.

[19]余小東,楊孟輯,張海清,等. 基于遷移學(xué)習(xí)的農(nóng)作物病蟲害檢測方法研究與應(yīng)用[J]. 農(nóng)業(yè)機械學(xué)報,2020,51(10):252-258.

[20]萬軍杰,祁力鈞,盧中奧,等. 基于遷移學(xué)習(xí)的GoogLeNet果園病蟲害識別與分級[J]. 中國農(nóng)業(yè)大學(xué)學(xué)報,2021,26(11):209-221.

[21]Kamal K C,Yin Z D,Wu M Y,et al. Depthwise separable convolution architectures for plant disease classification[J]. Computers and Electronics in Agriculture,2019,165:104948.

[22]Wang D W,Deng L M,Ni J G,et al. Recognition pest by image-based transfer learning[J]. Journal of the Science of Food and Agriculture,2019,99(10):4524-4531.

[23]溫艷蘭,陳友鵬,王克強,等. 基于機器視覺的病蟲害檢測綜述[J]. 中國糧油學(xué)報,2022,37(10):271-279.

[24]趙立新,侯發(fā)東,呂正超,等. 基于遷移學(xué)習(xí)的棉花葉部病蟲害圖像識別[J]. 農(nóng)業(yè)工程學(xué)報,2020,36(7):184-191.

[25]He Y,Zhou Z Y,Tian L H,et al. Brown rice planthopper (Nilaparvata lugens Stal) detection based on deep learning[J]. Precision Agriculture,2020,21(6):1385-1402.

[26]李衡霞,龍陳鋒,曾 蒙,等. 一種基于深度卷積神經(jīng)網(wǎng)絡(luò)的油菜蟲害檢測方法[J]. 湖南農(nóng)業(yè)大學(xué)學(xué)報(自然科學(xué)版),2019,45(5):560-564.

[27]李 昊,劉海隆,劉生龍. 基于深度學(xué)習(xí)的柑橘病蟲害動態(tài)識別系統(tǒng)研發(fā)[J]. 中國農(nóng)機化學(xué)報,2021,42(9):195-201,208.

[28]孫 鵬,陳桂芬,曹麗英. 基于注意力卷積神經(jīng)網(wǎng)絡(luò)的大豆害蟲圖像識別[J]. 中國農(nóng)機化學(xué)報,2020,41(2):171-176.

[29]Malathi V,Gopinath M P.Classification of pest detection in paddy crop based on transfer learning approach[J]. Acta Agriculturae Scandinavica,Section B-Soil & Plant Science,2021,71(7):552-559.

[30]Zhang Y Y,Zhong W B,Pan H. Identification of stored grain pests by modified residual network[J]. Computers and Electronics in Agriculture,2021,182:105983.

[31]曹躍騰,朱學(xué)巖,趙燕東,等. 基于改進ResNet的植物葉片病蟲害識別[J]. 中國農(nóng)機化學(xué)報,2021,42(12):175-181.

[32]賈少鵬,高紅菊,杭 瀟. 基于深度學(xué)習(xí)的農(nóng)作物病蟲害圖像識別技術(shù)研究進展[J]. 農(nóng)業(yè)機械學(xué)報,2019,50(增刊1):313-317.

[33]王 鐸,溫長吉,王希龍,等. 基于深度卷積條件生成對抗網(wǎng)絡(luò)的蟲害分類算法研究[J]. 中國農(nóng)機化學(xué)報,2020,41(6):179-187.

[34]楊麗英,李之洪. 橘小實蠅的形態(tài)特征、影響因素和防治措施[J]. 湖北農(nóng)機化,2020(1):58.

[35]He K M,Zhang X Y,Ren S Q,et al. Deep residual learning for image recognition[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition. Las Vegas,NV,USA:IEEE,2016:770-778.