MSV-Net:面向科學模擬面體混合數據的超分重建方法

曹斯銘,王曉華,王弘堃,曹 軼+

1.中物院高性能數值模擬軟件中心,北京100088

2.北京應用物理與計算數學研究所,北京100088

科學數據可視化是領域專家發現和理解復雜現象的有效工具。高保真度的可視分析通常依賴于大規模科學模擬產生的耦合幾何模型的高分辨率網格數據集,其時變數據量通常可達TB量級甚至更大規模。然而,隨著超級計算機的峰值性能的快速提升,I/O存儲設備的速度和容量卻無法跟上計算能力的增長。當前,超級計算機的計算速度與存儲速度、存儲容量之間的差距越來越大[1]。由于這些超算系統沒有足夠的輸入輸出能力,大規模科學模擬應用保存所有高分辨率計算結果,再進行事后可視分析變得越來越不可行。如何克服大規模數據的數據存儲瓶頸,實現高分辨率數據的流暢和高保真可視分析是近幾年科學數據可視化領域重要的研究方向之一。

圖像分辨率是關于圖像中存儲信息量的一種度量。圖像的超分辨率重建是圖像處理領域一個重要的研究課題,它在醫學成像、衛星遙感、刑偵安防等領域都具有廣泛的應用。例如,在醫學成像領域,通過醫學影像設備掃描得到的圖像往往分辨率較低,超分辨率重建后的圖像可以幫助醫生更準確地進行病體定位、診斷病情;在衛星遙感領域,受衛星轉運、通訊傳輸成本的限制,很難獲得高分辨率的圖像,超分辨率重建后的圖像可以更好地進行地形地貌的繪制和勘探,幫助地質災害監測、軍事偵察;在刑偵安防領域,監控獲取的運動圖像往往是模糊的,檢測到異常后通過對車牌、人臉等信息進行超分辨率重建,可以幫助快速定位嫌疑人、輔助治安管理。目前,圖像超分辨率重建技術已經成為深度學習的研究熱點之一。

在科學模擬時如果能夠采用低分辨率網格,不僅有利于加速計算過程,而且可以極大降低輸出的科學模擬數據量。如果能夠在此基礎上,采用超分辨率方法高效地重建高分辨率網格數據的可視分析結果,則極有希望解決由于超算存儲瓶頸造成的高置信度可視分析問題。但截至目前,超分辨率重建在科學可視分析中的應用仍不多見。適應復雜科學模擬數據集合的超分辨率方法仍然有待開展研究。

為此,本文提出了一種面向大規模科學模擬面體混合數據的超分辨率重建方法。本研究的創新點如下:

(1)提出了一種面向面體混合數據超分辨率重建的端到端的深度神經網絡(network for mixed surface-volume,MSV-Net),通過一系列非線性變換,實現從低分辨數據到高分辨數據的混合繪制映射的聯合學習;該網絡舍棄了全連接層,不僅可以減少網絡參數,而且能夠提升網絡可復用性。

(2)構建了一個面向大規模電磁模擬應用的面體混合數據集(dataset for mixed surface-volume,MSVDataset)。該數據集由采用不透明幾何模型繪制耦合半透明體繪制的混合繪制圖像構成。該數據集可適用于多類可視化任務,如超分辨率重建、參數生成和集合模擬。

1 相關工作

(1)大規模科學數據可視化。1987年,原位可視化概念在超大規模計算的背景下被提出[2]。原位可視化將數值模擬與可視化處理緊密地結合起來,可以避免超級計算機的存儲瓶頸問題。基于圖像的可視分析方法,可被視為原位可視化的一種實際應用,它可以在沒有原始科學數據的情況下實現交互可視分析。Ahrens 等[3]提出了一個基于圖像的可視交互框架,該框架基于預先生成的圖像數據集對科學數據進行交互可視分析。然而,原始的高分辨率模擬數據沒有被存儲,這限制了事后勘探的靈活性。體數據上采樣是指依托低分辨率體數據生成高分辨率體數據。Zhou 等[4]提出了一種基于卷積神經網絡的體數據上采樣方法。該方法學習從低分辨率數據塊到高分辨率數據塊的端到端映射。但是,體數據上采樣不適用于大規模數據可視分析,因為它給計算機存儲帶來了巨大的壓力。當前,大規模科學數據的高保真可視分析,通常依賴大規模科學模擬產生的耦合幾何模型的高分辨率網格數據。為此,本文針對大規模科學模擬面體混合數據的超分辨率重建問題展開研究,通過深度學習來解決數據存儲和流暢交互的挑戰問題。

(2)圖像超分辨率重建。通常,分辨率越高的圖像可以顯示越詳細的信息,這意味著具有更高的保真度。傳統的超分辨率重建方法(最近鄰插值、雙線性插值[5]和雙三次插值[6])主要利用點周圍的已知像素值來計算缺失的像素值。隨著深度學習的快速發展,相關的方法被應用到圖像超分辨率重建中。2015 年,Dong 等[7]提出了一種基于卷積神經網絡的超分辨率重建算法模型。首先采用雙三次插值將低分辨率圖像放大到目標尺寸,然后采用三層卷積網絡對非線性映射進行擬合,最后輸出高分辨率圖像。Dong等[8]改進了他們之前的方法,使得原始低分辨率圖像可以直接輸入到網絡中。Shi等[9]提出了一種新的超分辨率圖像重建方法,使用亞像素卷積對特征圖進行上采樣。這種上采樣策略可以獲得更好的數據重建效果。本文采用與Shi類似的方法,設計了基于深度學習技術的MSV-Net,用于大規模科學數據混合可視分析結果的超分辨率重建。

(3)科學數據可視化與深度學習。近年來,一些研究將深度學習技術用于科學數據可視化。體繪制和面繪制是科學可視化的兩類主要方法。針對體繪制,Berger等[10]提出了一種利用生成模型合成和分析體繪制圖像的技術,改進了現有基于光線投射或基于紋理的體繪制方法。針對面繪制,Weiss 等[11]采用卷積神經網絡來減少等值面射線投射的樣本數量。無論是重建表面的幾何形狀還是環境光遮擋,與全分辨率下的優化光線投射相比,他們的方法性能更高。針對半透明體繪制和不透明等值面繪制,Han等提出被用于空間和時間尺度時變數據的上采樣方法[12-13],目標是生成更高時空分辨率和細節的序列數據,實現時空超分辨率。但從已有文獻可知,目前尚沒有超分辨率可視分析研究能夠同時考慮半透明體繪制結果和不透明面繪制結果。

2 MSV-Net &MSV-Dataset

本章將介紹面向面體混合數據超分辨率重建的端到端的深度神經網絡與面向大規模電磁模擬應用的面體混合數據集。

2.1 MSV-Net

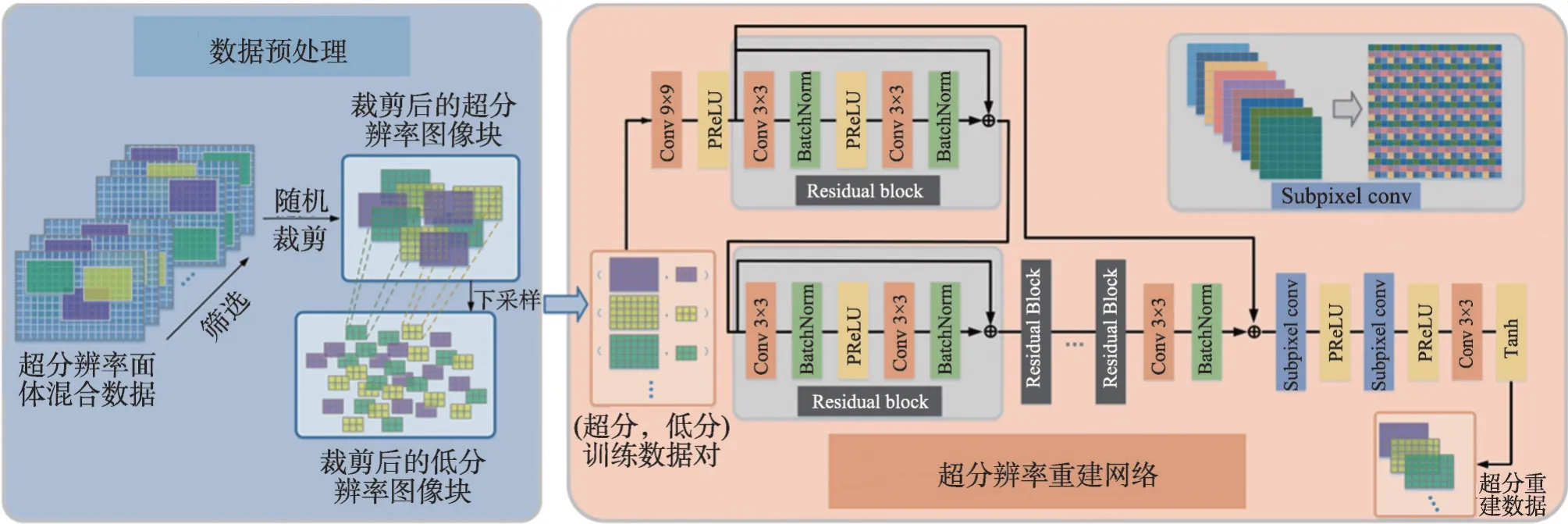

MSV-Net的結構示意圖如圖1所示,其中主要包含兩部分,分別是數據預處理和超分辨率重建網絡。首先,數據預處理階段主要包括隨機裁剪、圖片篩選和下采樣,輸出一一對應的高、低分辨率圖像對,用于下一步的神經網絡訓練、驗證和測試。其次,訓練階段負責在每個訓練圖像中隨機剪切n×n子塊,保留背景占比80%以下的圖片,將其視為目標高分辨率圖像,然后采用雙三次樣條插值方法,基于下采樣系數(重建系數)α對高分辨率圖像進行下采樣,得到對應的低分辨率圖像,圖像尺寸為nα×nα。隨機裁剪策略不僅增加了訓練樣本的數量,而且加快了神經網絡的收斂速度。最后,在驗證和測試階段,選擇可被下采樣系數整除的最大尺寸,隨機提取圖像子塊作為目標高分辨率圖像,同樣采用雙三次樣條插值方法進行下采樣得到對應的低分辨率圖像,然后輸入到訓練好的模型中進行超分辨率重建,輸出重建得到的超分辨率圖像。

圖1 MSV-Net的結構示意圖Fig. 1 Overview of MSV-Net

MSV-Net 主要包含12 個殘差單元和2 個亞像素卷積層。整個網絡拋棄了全連接層,為全卷積網絡。這些策略在減少網絡參數和提升性能的同時增加了網絡的可復用性。

MSV-Net 的超分辨率重建網絡的主要組成部分為殘差單元[14],殘差單元在淺層輸出和深層輸出之間創建了捷徑連接,其表示特征的恒等映射。x是淺層輸出,H(x)表示對x映射后的擬合結果,為深層輸出。F(x)為夾在二者中間的網絡結構所代表的變換,在MSV-Net中,F(x)由兩個連續的3×3卷積層、批標準化和PReLU激活函數構成。當淺層輸出x所代表的特征已經足夠優秀,x的任何改變都會讓損失變大的話,F(x)則會自動地趨向于學習變為0,x則從捷徑連接的路徑繼續傳遞下去。這樣就實現了當淺層輸出已經足夠優秀時,深層網絡后面的層能夠實現恒等映射作用的目的。這緩解了深度神經網絡消失梯度和模型退化的問題。數學表示如下所示:

MSV-Net 中上采樣部分采用了亞像素卷積。亞像素卷積是一種圖像上采樣的新方法,也稱為像素重組。該結構減少了圖像上采樣過程中的人為干擾,并將圖像上采樣過程集成到網絡學習中。與傳統上采樣方法相比,該方法能夠更好地擬合像素之間的關系,得到全局最優解。假設希望將原始圖像放大n倍,則需要生成n2相同大小的特征圖。換言之,特征圖通道的數量必須擴展n2倍。然后,將n2具有相同大小的特征圖拼接在一起,形成一個放大n2倍的特征圖。特征圖通道的擴展可以通過普通的卷積運算來實現。亞像素卷積層的數量ns與重建系數α有關。數學表示如下所示:

此外,MSV-Net 舍棄了全連接層,為全卷積神經網絡,因此在模型的訓練、驗證和測試階段都非常靈活,不受圖像大小的限制,可以接受任何圖像大小作為輸入。即使重建系數α發生變化,它仍然可以適應現有的模型,只需少量的訓練進行微調。該策略不僅可以減少網絡參數,而且能夠提升網絡的靈活性與可復用性。

2.2 MSV-Dataset

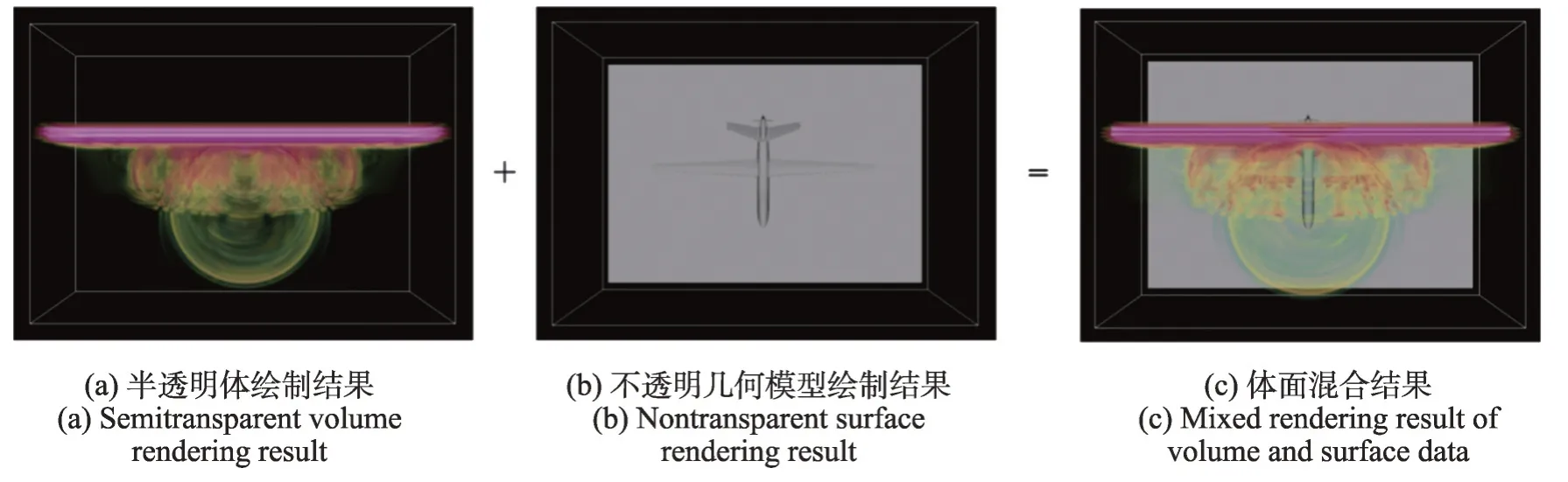

本文采用的原始數據源是基于并行應用框架[15]的電磁模擬應用程序產生的耦合幾何模型的高分辨率網格數據,并且基于大規模可視分析平臺[16]生成的可視分析數據集MSV-Dataset。該數據集由采用不透明幾何模型繪制耦合半透明體繪制的混合繪制圖像構成,如圖2 所示。在電磁仿真應用中,領域專家通常關注電磁波擊中無人機時的波前效應,這對應于圖像中的一系列同心圓。

圖2 MSV-Dataset可視化結果示例Fig. 2 Example of visualization results for MSV-Dataset

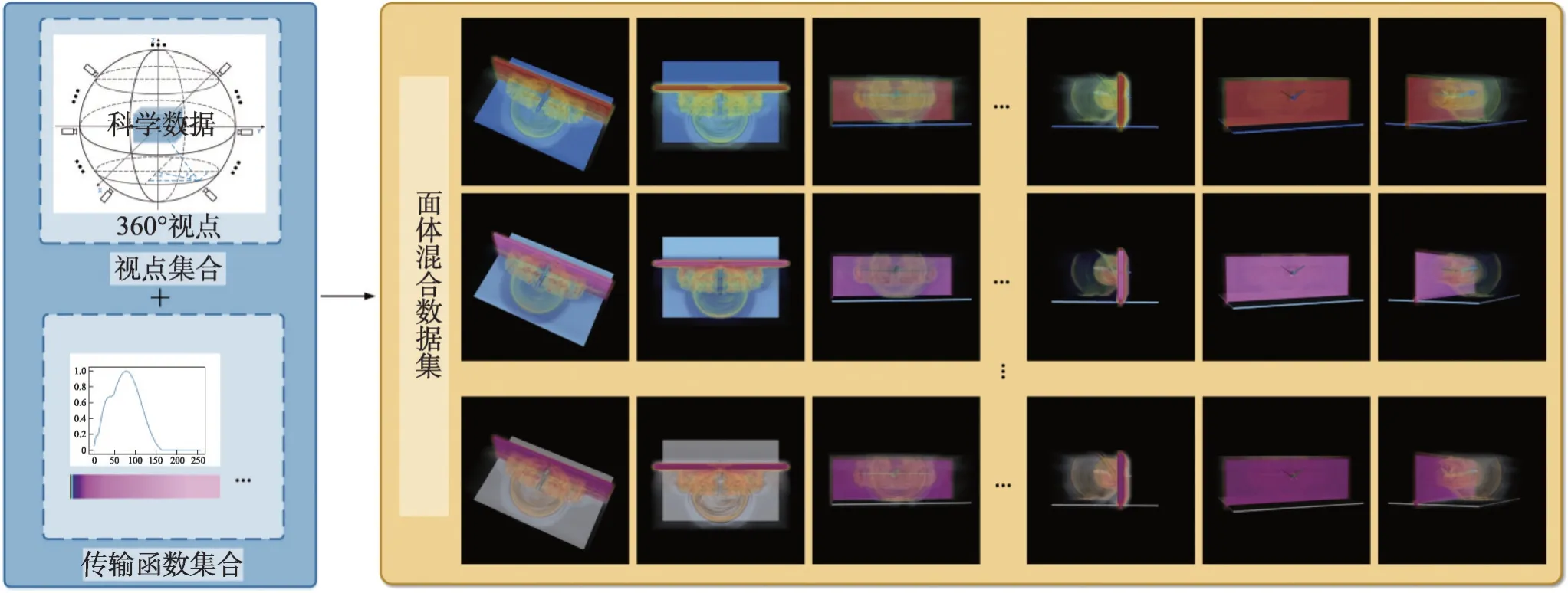

圖3 顯示了面向大規模電磁模擬應用的面體混合數據集構建過程的流程圖。已有研究表明,標記數據的數量與質量直接影響深度學習模型的性能。與計算機視覺領域中易于采集的自然圖像或視頻不同,物理效應高保真的可視化結果必須由領域專家生成和驗證,想要大規模生成非常困難。

圖3 MSV-Dataset構建過程的流程圖Fig. 3 Flow chart of MSV-Dataset building process

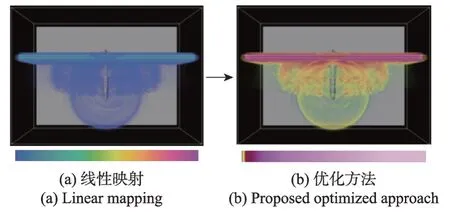

視點和傳輸函數的選擇都是基于以前的研究工作[17-18]。視點大致均勻分布在模擬數據周圍的球體上,換句話說,均勻分布在經度和緯度柵格上。在科學模擬數據的探索和分析中,顏色映射是傳遞數據信息的重要方法。色彩映射的載體是傳輸函數。圖4 顯示了無人機輻射屏蔽分析應用程序的線性映射和優化方法之間的顏色映射結果比較。從圖2、圖4可以看出本文構建的面體混合數據集具有高保真性,可以高質量地表現出更多物理效應場層次細節,波前效應顯著。

圖4 不同顏色傳輸函數對比Fig. 4 Comparison of different color transfer functions

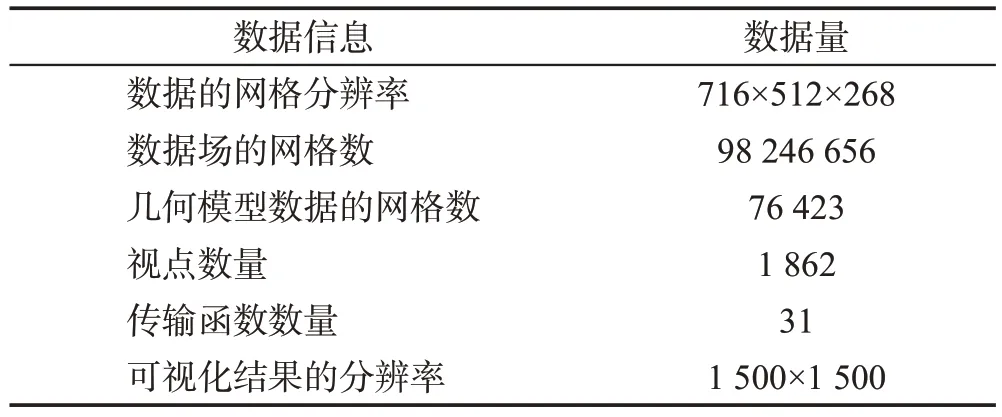

表1 給出了MSV-Dataset 的相關信息,包括可視化結果及其對應的可視化參數。該數據集可適用于多類可視化任務,如超分辨率重建、參數生成和集合模擬。目前,該數據集仍在建設中。

表1 MSV-Dataset的相關信息Table 1 Information about MSV-Dataset

3 實驗結果與分析

本文的實驗平臺為CentOS 7 系統,運用Python語言在Pytorch[19]深度學習框架下進行編寫,該實驗在24核Intel Xeon e5-2680v4 2.40 GHz浪潮服務器節點上進行,該節點CPU內存為16 GB,GPU為NVIDIA Tesla V100。MSV-Net 訓練200 次需要27 h,當重建系數α發生變化,它也只需少量的訓練進行微調,長期來看,本文方法比直接使用TeraVAP生成高分辨率的圖像性價比高。

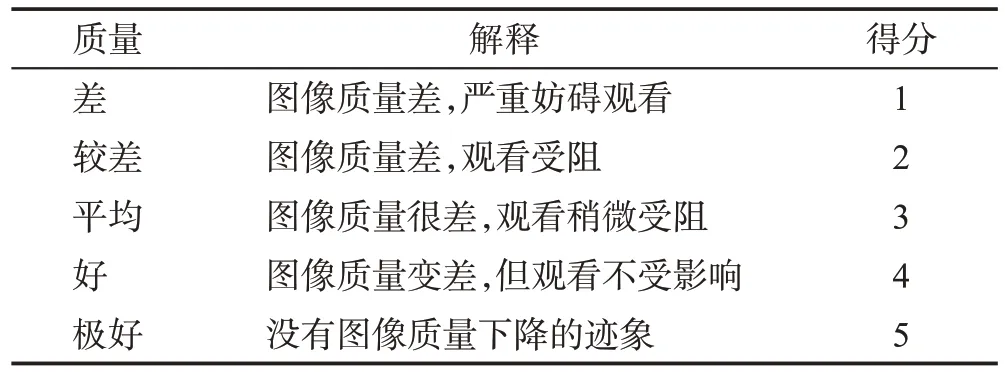

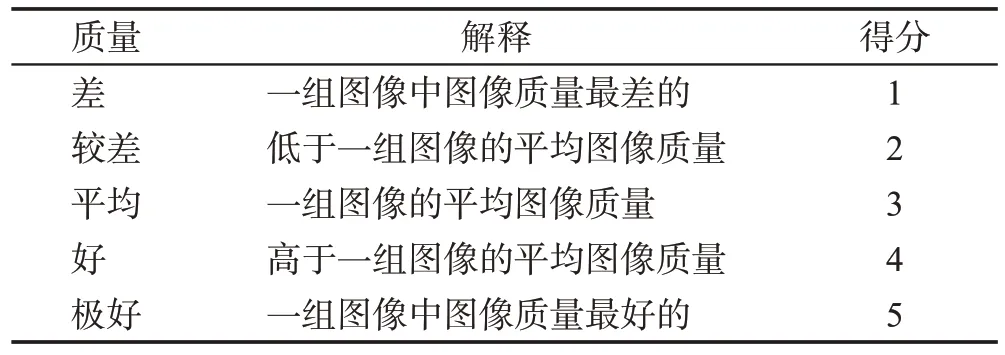

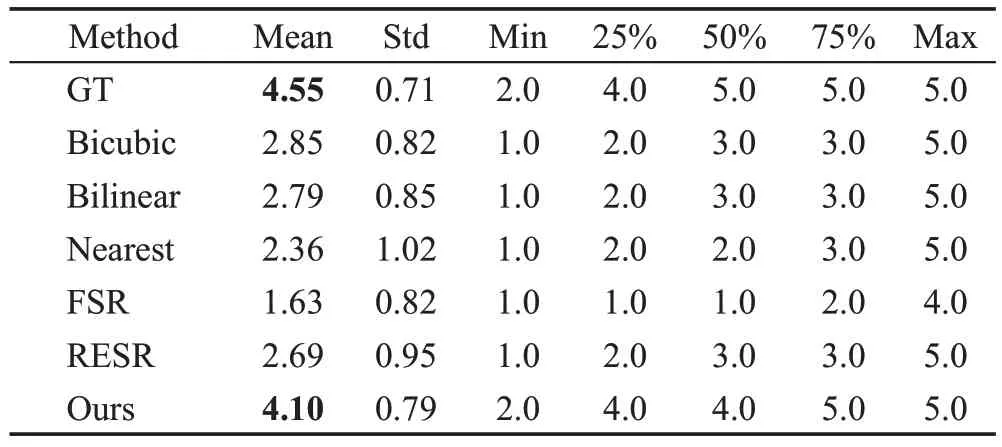

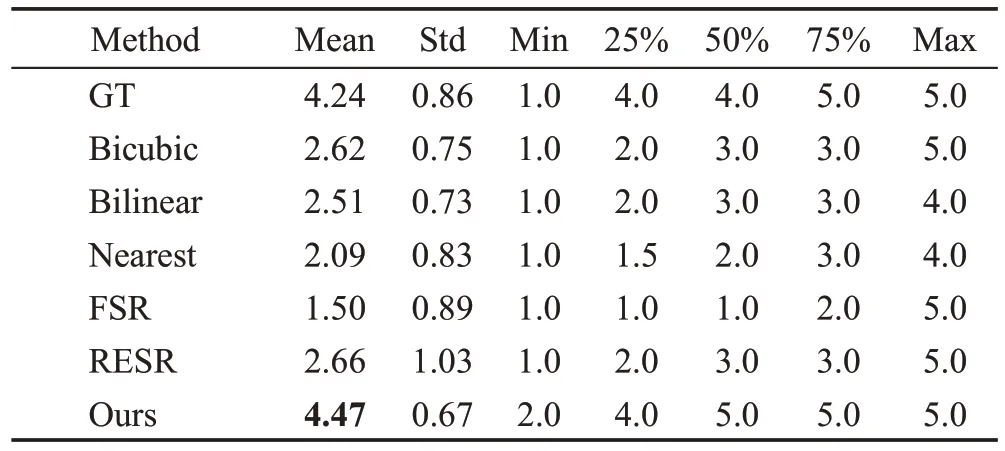

本文采用平均意見評分測試(mean opinion score,MOS)對不同的超分辨率重建方法進行量化評估。邀請了25 名觀察者對這些圖像進行主觀定性評估。表2、表3列出了評估標準。表2是絕對評估,即觀察者以真實圖像作為參考,將每組待評估圖像與真實圖像進行比較,按相似度給出相應的評估值。表3是相對評估,即不告訴觀察者哪一組為真實值。觀察者對參與評估的多組圖像相互進行比較,按評估標準給出相應的評估值。

表2 評價標準(絕對評價)Table 2 Evaluation criteria(absolute evaluation)

表3 評價標準(相對評價)Table 3 Evaluation criteria(relative evaluation)

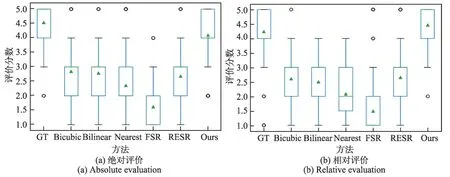

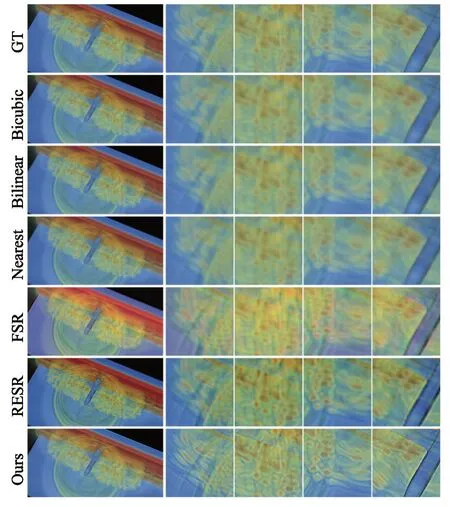

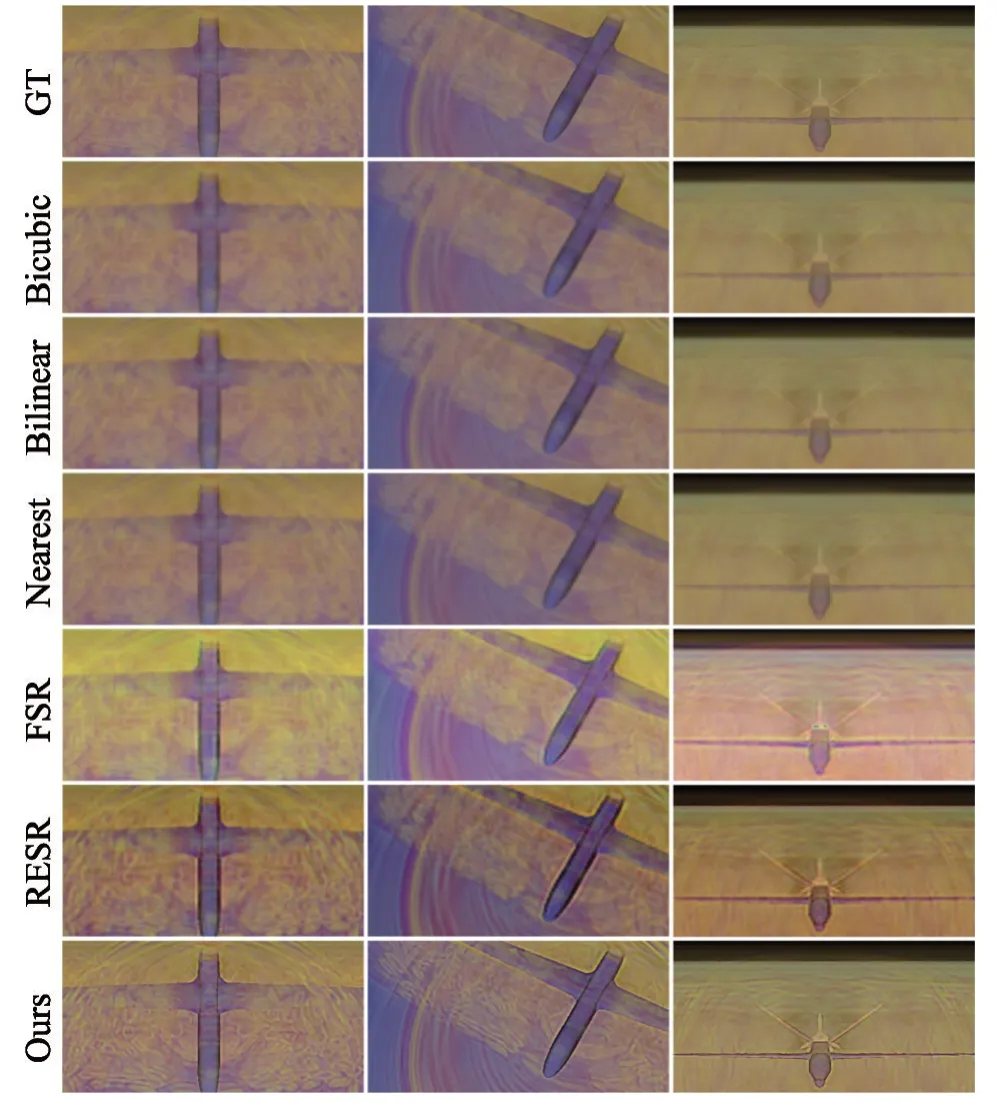

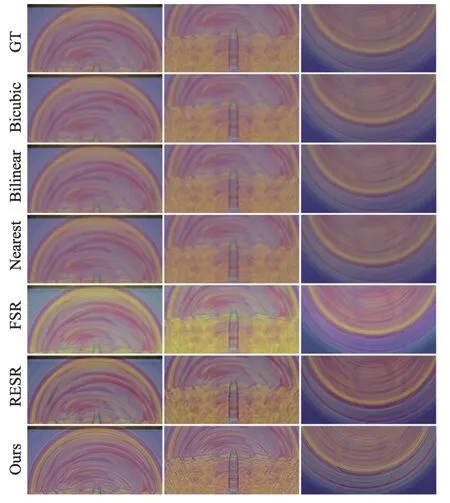

每個觀察者對819 個以隨機順序呈現的圖像進行評分。表4、表5和圖5展示了MOS測試的實驗結果,表4、表5中,在MSV-Dataset的測試集上,將本文方法與多種傳統方法和深度學習方法的性能進行了比較。這些方法包括傳統方法(最近鄰插值(nearest)、雙線性插值(bilinear)、雙三次插值(bicubic))和深度學習方法(加速超分辨率卷積神經網絡(fast super resolution,FSR)、超分辨率殘差網絡(residual super resolution,RESR))。圖5是對比實驗結果的箱線圖(綠色的小三角形表示評價的平均值)。對于相同的圖像,發現評價結果沒有顯著差異。在絕對評估中,大多數觀察者一致認為FSR 重建的圖像質量最差,真實值(ground truth,GT)的圖像質量最好;在相對評估中,大多數觀察者一致認為FSR重建的圖像質量最差,MSV-Net重建的圖像質量最好。

表4 MSV-Dataset測試集上MSV-Net與其他方法的比較(絕對評價)Table 4 Comparison of MSV-Net with other methods on MSV-Dataset(absolute evaluation)

表5 MSV-Dataset測試集上MSV-Net與其他方法的比較(相對評價)Table 5 Comparison of MSV-Net with other methods on MSV-Dataset(relative evaluation)

圖5 實驗結果比較箱線圖Fig. 5 Boxplot for comparison of experimental results

從表4、表5和圖5可以看出,在真實圖像未知的情況下,觀察者認為MSV-Net 重建的圖像質量優于其他方法重建的圖像,甚至優于真實圖像,這表明MSV-Net的準確性和有效性。為了評估MSV-Net的效率,表6列出了MSV-Net與直接使用TeraVAP生成高分辨率可視化結果的時間成本對比,從中可以看出,TeraVAP 繪制生成1 500×1 500 分辨率的圖像需要66.28 s。但是,如果首先使用TeraVAP 繪制生成375×375 分辨率的圖像,然后使用MSV-Net 進行超分辨率重建,只需要4.14 s。交互性能提升了約15倍。

表6 MSV-Net與直接使用TeraVAP的時間成本對比Table 6 Comparison of time cost between MSV-Net and using TeraVAP directly

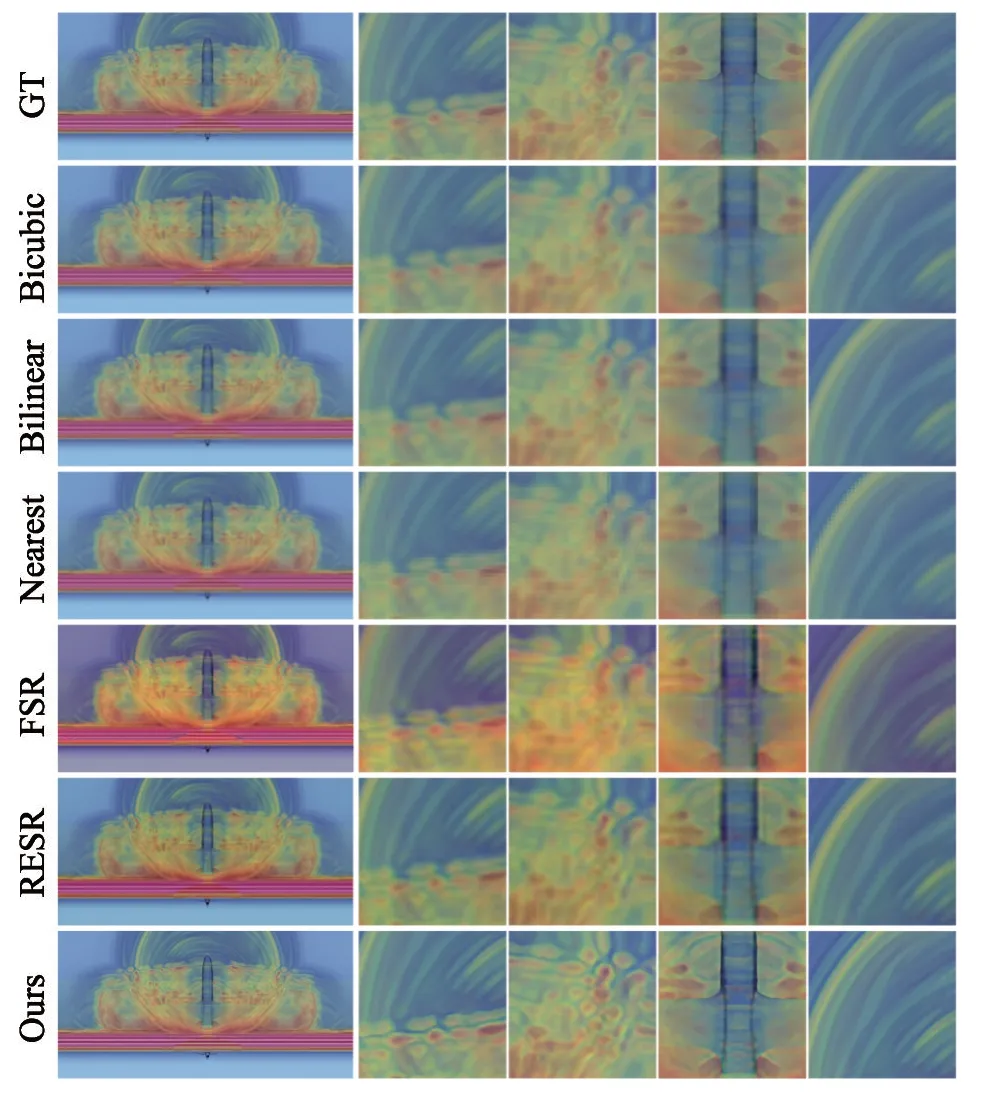

圖6~圖9 展示了一些實驗結果示例。可以看出,使用MSV-Net 重建的圖像最接近真實圖像,有時甚至比真實圖像更清晰。其他重建方法存在不同程度的混疊、模糊和顏色變化問題。

圖6 實驗結果示例1Fig. 6 Example 1 of experimental results

圖7 實驗結果示例2Fig. 7 Example 2 of experimental results

圖8 實驗結果示例3Fig. 8 Example 3 of experimental results

圖9 實驗結果示例4Fig. 9 Example 4 of experimental results

4 結束語

本文提出了一個面向大規模科學模擬面體混合數據的超分辨率重建方法MSV-Net。采用該方法可以避免大規模數值模擬的數據存儲瓶頸問題,實現高分辨率數據的流暢和高保真可視分析。實驗結果驗證了本文方法的有效性和高效性。此外,本文還構建了面向大規模電磁模擬應用的面體混合數據集MSV-Dataset,用于模型訓練和驗證。該數據集由不透明幾何模型繪制耦合半透明體繪制的混合繪制圖像構成,可適用于大規模科學模擬的多類可視化任務。未來將針對深度學習和科學可視化的融合進行更深入的研究,例如對序列數據的時空超分辨率重建、參數空間重建可視空間等。