算法推薦風險影響因素系統動力學研究

崔文波 張濤 孫欽瑩 馬海群

摘? ?要:作為智能情報分析中的重要應用場景,算法推薦提供的個性化和精準化信息服務為現代快速決策增加了價值,但算法推薦風險問題也尤為突出,探尋算法推薦風險影響因素對科學地提出算法風險治理策略至關重要。文章采用LDA模型對科研論文進行主題聚類,聚類結果與《互聯網信息服務算法推薦管理規(guī)定》進行相似度計算,以識別算法推薦風險影響因素,從風險產生和風險治理兩個維度構建系統動力學模型,然后利用Vensim PLE軟件和文本計算數據進行仿真與靈敏度分析。研究識別出算法素養(yǎng)、大數據技術、算法偏見、網絡安全審查等影響因素,通過文本計算獲得的數據進行仿真能夠較好的擬合算法推薦風險治理現實情況,并基于靈敏度分析提出如下建議:加強算法素養(yǎng)教育,提高個人隱私保護意識;建立算法全流程監(jiān)管機制,提升算法的可解釋性;建立“制度+技術”機制,提高平臺風險防范能力。

關鍵詞:算法推薦;LDA;主題聚類;系統動力學;仿真分析

中圖分類號:N941.3? ?文獻標識碼:A? ?DOI:10.11968/tsyqb.1003-6938.2023008

Abstract As an important application scenario in intelligent intelligence analysis, personalized and precise information services provided by algorithm recommendation add value to modern fast decision-making, but the problem of algorithm recommendation risk is also particularly prominent. Exploring the influencing factors of algorithm recommendation risk is crucial to scientifically proposing algorithm risk governance strategies, so this study has important practical significance. This paper using the LDA model for research paper topic clustering, clustering results should be compared with the "Regulations on the Recommendation Management administration of Internet Information Service Algorithms" for similarity calculation, to identify the risk influencing factors of algorithm recommendation, the system dynamics model is constructed from two dimensions of risk generation and risk governance, and then use Vensim PLE calculation software and text data to analyze simulation and sensitivity. Identify algorithm literacy, big data technology, and algorithm of prejudice, network security, and other factors, for the calculation of the data obtained through the calculation of the text to a better fitting method recommended management reality, and put forward the following suggestions based on sensitivity analysis: strengthen algorithm literacy education, to improve personal privacy protection awareness; Establish the whole process supervision mechanism of the algorithm to improve the interpretability of the algorithm; We will establish an "institutional and technological governance" mechanism to improve the platform's ability to prevent risks.

Key words algorithm recommendation; LDA; topic clustering; system dynamics; the simulation analysis

隨著大數據和人工智能的快速發(fā)展與應用,算法推薦逐漸進入公眾視野,它通過提供個性化和精準化信息來增加價值、輔助決策,以智能情報為例,近年來算法推薦被廣泛應用到智能情報分析項目中[1],并且在科技情報檢索[2]、科技情報關聯[3]等方面發(fā)揮了重要作用。但由于算法推薦本身的不透明性、不可解釋性以及各個平臺對用戶隱私安全保護強度不一,平臺質量無法保障等造成大數據殺熟、隱私泄露事件頻發(fā),嚴重威脅用戶的隱私安全,成為當下亟需解決的問題。為此,2021年我國出臺了《互聯網信息服務算法推薦管理規(guī)定》(以下簡稱《規(guī)定》)[4],旨在對算法推薦風險進行規(guī)制,使用戶免受其特定數據驅動的算法支配,確保用戶隱私和數據安全。《規(guī)定》作為頂層設計,為我國算法風險治理的戰(zhàn)略指導方向,但當前我國算法風險治理相關配套制度尚未建立,面對智能算法的快速迭代升級和用戶數據量爆炸式增長的雙重挑戰(zhàn),現有制度無法靈活地應對動態(tài)復雜的算法推薦產生的風險問題。因此,一方面應基于政策與科研主題的協同性[5],充分結合現有政策和科研成果,積極探尋算法推薦風險影響因素,有利于政府更為全面地制定算法風險治理策略;另一方面應基于系統仿真視角,模擬算法風險的動態(tài),有利于科學地提出算法風險治理策略,具有重要的現實意義。

1? ?文獻述評

隨著互聯網的廣泛普及,使得人們對大量以算法推薦提供個性化信息服務的APP應用平臺產生過度依賴,但同時算法推薦也為個人帶來了隱私安全風險。國內外學者圍繞這一現實問題從定性與定量兩個維度展開研究:一是在定性研究方面。主要包括:(1)算法推薦應用風險治理。圍繞算法推薦應用所產生的公共風險[6]、倫理安全[7-8]、信息繭房[9]、可解釋性和透明性[10-11]等從風險預防和外部問責的方式展開治理[12-13],研究成果多集中在法學和公共管理等領域。如Banker和Khetani[14]基于實驗證明了消費者經常過于依賴算法生成的推薦,對自身福祉構成潛在危害,并導致其在傳播中可能影響其他用戶的系統性偏見方面發(fā)揮作用。馬天一提出在《規(guī)定》的基礎上,以傳統法學教義學方法解決未成年人數字化閱讀中的算法推薦服務中存在的不良數據等風險[15];(2)算法推薦內生風險治理。從算法內部優(yōu)化的視角,將安全因素考慮到算法的設計和應用當中。如Descampe等基于自動新聞推薦系統實驗證明了嵌入算法的標準與其公開的意圖相對應,提出定義算法問責制時應考慮對抗行為的魯棒性,以更好地捕捉算法決策固有的風險[16]。馬鑫等將內容安全風險問題納入用戶協同過濾推薦算法的優(yōu)化過程,提出一種改進面向電商內容安全風險管控的CSCFR算法[17];二是定量研究方面。目前專門針對算法推薦的量化研究較少,如丁睿豪和夏德元使用Citespace軟件對國內新聞傳播學領域個性化算法推薦文獻進行科學知識圖譜分析[18]。陳軍等使用社會網絡分析方法等對WOS和CNKI的大數據算法推薦文獻進行高頻關鍵詞共現等量化比較研究[19]。

綜上所述,現有研究主要以定性的方式針對算法推薦產生的風險提出對應的治理措施,有少部分學者使用文獻計量的方式進行算法推薦知識圖譜構建,但較少有學者從系統仿真視角考慮算法推薦的風險治理。雖然已有學者使用系統動力學圍繞政府數據開放[20-22]等展開研究,但其以定性的方式確定影響因素、以問卷調查法和專家訪談法獲得仿真數據的研究方法存在一定程度上的主觀性和片面性。因此,本文在已有研究的基礎上,提出在政策與科研主題協同視角下,使用能夠挖掘文本淺層語義信息的LDA模型定量識別算法推薦風險影響因素[23-24],并通過文本計算獲得的數據,利用系統動力學方法對算法推薦風險影響因素進行仿真研究。本文主要貢獻有兩點:(1)通過政策與科研主題協同性定量識別算法推薦風險的影響因素;(2)通過文本計算為算法推薦系統流圖進行科學化賦值。

2? ?研究方法

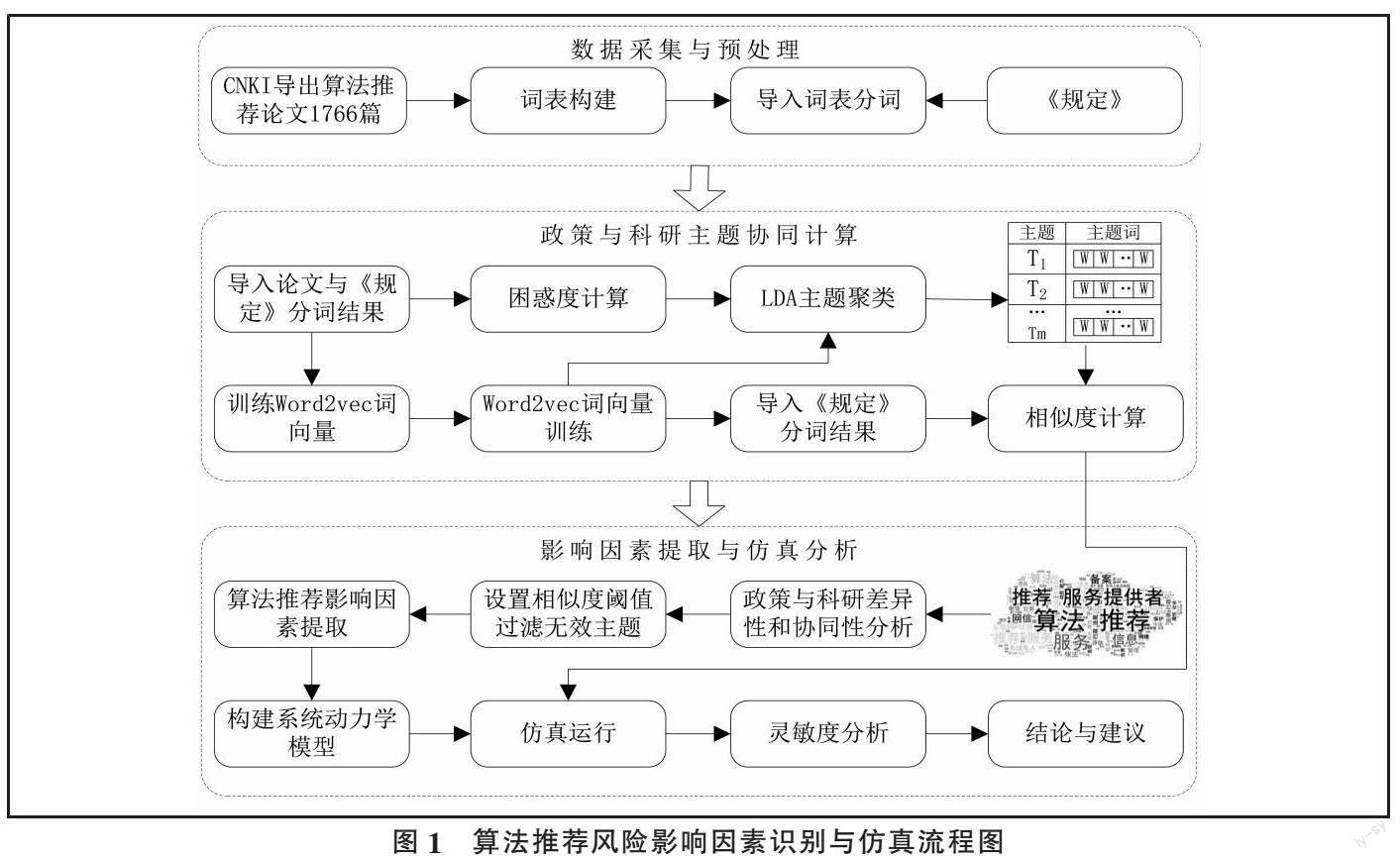

本文提出文本計算與系統動力學相融合的方法研究算法推薦風險治理。主要包括:數據采集與預處理、政策與科研主題協同計算、影響因素提取與仿真分析三個步驟(見圖1)。

首先,選擇CNKI數據庫中算法推薦治理核心期刊論文作為研究對象,使用LDA進行主題聚類,然后結合《規(guī)定》使用Word2Vec訓練詞向量[25],使用余弦相似度計算每個主題與《規(guī)定》之間的相似度,基于政策和科研主題協同性,過濾協同性低的主題,提取出算法推薦影響因素;其次,在此基礎上,使用系統動力學構建算法推薦影響因素之間的因果關系圖和系統流圖;最后,利用Vensim PLE軟件,結合相似度數值對系統模型進行仿真運行和靈敏度分析,進而對我國算法推薦風險影響因素變化情況進行探討。

3? ?實證研究

3.1? ? ?數據采集與預處理

鑒于科研成果通常以科研論文的形式呈現,本文選擇《規(guī)定》和 CNKI中算法推薦科研論文作為數據源。首先,通過文獻調研確定檢索式為“算法推薦”O(jiān)R“推薦算法”,在 CNKI數據庫中進行主題高級檢索,提取論文的篇名、摘要和關鍵詞。同時為了聚焦算法推薦風險主題,基于《規(guī)定》從風險識別和風險治理兩個維度進行人工初步篩選,截至時間到2023年2月,共篩選出2309篇;其次,提取科研論文關鍵詞構建算法推薦的特征詞表;最后,利用python語言jieba工具對由“篇名+摘要”組成的文本進行分詞、去停用詞等數據預處理操作。

3.2? ? 主題數目確定

研究采用困惑度評價指標確定文本數據的最優(yōu)主題數目。困惑度表示對文檔所屬主題的不確定性,困惑度越低,說明聚類的效果越好,主題數目最優(yōu)[26],為防止過擬合,選取困惑度下降不明顯或處于拐點的值,結合困惑度曲線最終確定最優(yōu)主題數目為18(見圖2)。

3.3? ? 政策與科研主題識別

研究通過相似度定量探討政策與科研主題的協同性。首先,使用LDA模型對分詞后的論文的篇名、摘要及關鍵詞進行主題聚類,生成主題-詞的分布;其次,合并《規(guī)定》和論文數據,使用Word2Vec訓練詞向量;最后,使用余弦相似度計算《規(guī)定》與每個主題之間的相似度(主題識別和相似度計算結果見表1)。

3.4? ? 政策與科研主題分析

由表1可知,算法推薦在政策與科研主題之間存在差異性和協同性特征,并根據主題的可解釋性將0.25作為區(qū)分差異性和協同性的相似度閾值[27]。一是差異性(S<0.25),包括:T1、T6、T8、T11、T16五個主題。這類主題與《規(guī)定》差異性特征主要體現在三個方面:(1)算法推薦文本分析方法,如語義、位置、語義分析等主題詞;(2)算法推薦的方式和過程,如個性化推薦、推薦系統等主題詞;(3)推薦算法的設計,如差分隱私、協同過濾推薦等主題詞。二是協同性(S>=0.25),這類主題反映了《規(guī)定》和科研論文在算法推薦方面具有一定共性,科研能夠圍繞算法風險治理的頂層設計進行完善治理策略,能夠從學術研究和政府治理等多個層面反映出我國算法推薦治理現狀。基于此,本文選擇與《規(guī)定》具有協同性的主題作為算法推薦影響因素的來源。

3.5? ? 政策和科研主題協同視角下的系統動力學模型構建

系統動力學可以實現對真實系統的仿真,能夠有效地揭示復雜系統在各種因果關系作用下所呈現出的動態(tài)變化規(guī)律[28]。因此,運用系統動力學方法研究算法推薦風險問題,能夠從系統視角深入地分析算法推薦風險治理的結構、功能與行為之間的動態(tài)關系,從而為我國算法推薦治理提供科學化的建議。

(1)系統邊界。以《規(guī)定》所涉及的風險要素與治理要素作為系統的邊界,可以將LDA主題識別結果劃分為:算法推薦風險、算法推薦治理、算法推薦主體和信息技術應用四大類。每類中所包含的影響因素取自《規(guī)定》與科研論文協同性的主題。針對存在主題詞不明確的情況,設定選取規(guī)則:若同一主題包含相同含義主題詞,則進行補充;若不存在同一主題包含相同含義主題詞,則結合數據或算法本體安全治理特征進行整合(結果見表2)。

(2)模型假設。由于算法推薦系統動力學模型構建涉及影響因素眾多,包括用戶、數據、智能算法、平臺、政府等,為保證模型的正常構建,無法囊括所有因素,故做以下假設:

假設1:采用一種開放的態(tài)度,不刻意區(qū)分數據與信息,且算法推薦風險形成與風險治理是持續(xù)運轉的動態(tài)過程,要素之間能夠互動反饋;

假設2:通過用戶隱私安全程度來表征風險治理效果,且僅使用算法推薦風險程度和算法推薦治理程度來衡量;

假設3:算法推薦模型中算法推薦風險程度、算法推薦治理程度及用戶隱私安全程度默認初始值為1,并在多次預仿真實驗中調整和確定,其余變量賦值通過文本計算方式設定;

假設4:算法推薦模型只受劃定系統邊界內因素的影響,不涉及平臺利益等其它外部因素。

(3)因果關系圖。為了刻畫出算法推薦治理影響因素之間的邏輯關系和反饋回路[29],本文在影響因素識別的基礎上,梳理要素之間的因果關系,并從風險形成與風險治理的視角構建算法推薦系統的因果關系圖(見圖3)。算法推薦風險是指平臺使用智能推薦算法基于用戶行為數據提供個性化服務過程產生的各種安全風險;算法推薦治理是指對算法推薦產生的風險進行治理,主要以政府網絡安全審查為主導,用戶數據保護、平臺風險防范等多方參與的協同治理。

研究系統中包括兩條重要的回路類型(見表3):回路類型1從系統層面呈現算法推薦從風險形成到風險治理后,風險降低的過程,在此過程中,虛假數據是算法推薦風險的重要源頭,這類數據若被智能推薦算法應用,會產生謠言傳播等一系列風險,從而導致算法推薦風險程度增加,進而需要政府開展網絡安全審查等治理工作以降低風險,因此,虛假數據所反映出的數據質量問題決定了算法推薦風險的程度;回路類型2主要是從用戶行為數據層面呈現算法推薦風險與用戶網絡活動安全保護能力的關系,用戶網絡活動安全保護能力越強,用戶進行網絡活動所產生的行為數據量越少、脫敏程度越高,從而能夠降低算法推薦風險的程度。

(4)系統流圖。為探究算法推薦風險形成與風險治理之間的內在結構關系及治理機制,研究基于因果關系圖,根據實際情況在模型中不斷修正并最終確定各子系統中相應變量,最終繪制出算法推薦的系統動力學模型流圖(見圖4)。

該系統流圖包括3個狀態(tài)變量,4個速率變量,10個輔助變量和15個常量(見表4)。

(5)參數設定。由于《規(guī)定》頒布較晚,處理事件產生的數據有限,通過以上分析可知,算法推薦是以“個人-數據-算法-平臺-政府”構建的具有非線性、復雜性、動態(tài)性的循環(huán)交互系統,影響因素寬泛、復雜,本文提出文本計算的方法,將影響因素對應的主題與《規(guī)定》之間的相似度數值作為參數的初始設定,并乘0.1進行數據歸一化處理,如虛假數據取自T9主題,則其初始值為0.51*0.1=0.051。相似度數值反應了《規(guī)定》與科研論文的協同性,影響因素選取是概率值較高的主題詞,能夠反映出算法推薦關注的重點。因此,將相似度數值作為系統仿真數據具備合理性和科學性(主要方程設計及參數說明見表5)。

4? ?仿真分析

4.1? ?模型仿真分析

對算法推薦模型進行有效性檢驗,旨在觀察通過文本計算獲得的仿真數據是否符合真實系統的特點與變化規(guī)律,確保模型的有效運行。利用仿真軟件Vensim PLE,將仿真時間限定為12個月,時間步長為1個月,選取關鍵變量進行驗證,得到初始狀態(tài)下仿真結果(見圖5)。

(1)已知風險率和治理率呈先快速增長后逐漸下降的趨勢。這是由于算法推薦中產生的隱私泄露等可檢測的已知風險,能夠通過《規(guī)定》等進行規(guī)制。因此,在開展算法推薦治理工作的前一個月內,已知風險被快速監(jiān)測和治理,對應的風險率和治理率快速增長,但隨著時間的推移,可治理的已知風險逐漸下降,對應的風險率和治理率也隨之下降。

(2)潛在風險率和未治理率呈先快速增長后逐漸增長的趨勢。潛在風險是指由智能算法所導致的算法黑箱、算法共謀、算法操縱等難預測的未知風險。且隨著大數據、區(qū)塊鏈、人工智能以及元宇宙等技術的發(fā)展和場景應用,潛在風險會不斷加劇。因此,整體上潛在風險率和未治理率呈增長的趨勢,從而導致算法治理程度也呈上升趨勢。而在系統中前一個月內潛在風險率和未治理率增長幅度較大的原因可能是由于治理手段均是針對已知風險的治理,而風險的產生是多方面,且潛在風險轉變成已知風險需要一定的時間。

(3)用戶隱私安全程度始終呈持續(xù)增長趨勢。盡管治理率在后期呈逐漸下降、潛在風險率和未治理率呈增長趨勢,但算法推薦風險經過系統治理,總體上算法推薦風險程度的增長小于算法推薦治理程度的增長,從而使得用戶隱私安全程度始終呈持續(xù)增長的趨勢。因此,該系統仿真變化曲線符合算法推薦治理現實情況,同時也證明了使用文本計算獲取的數據的合理性。

4.2? ? 靈敏度分析

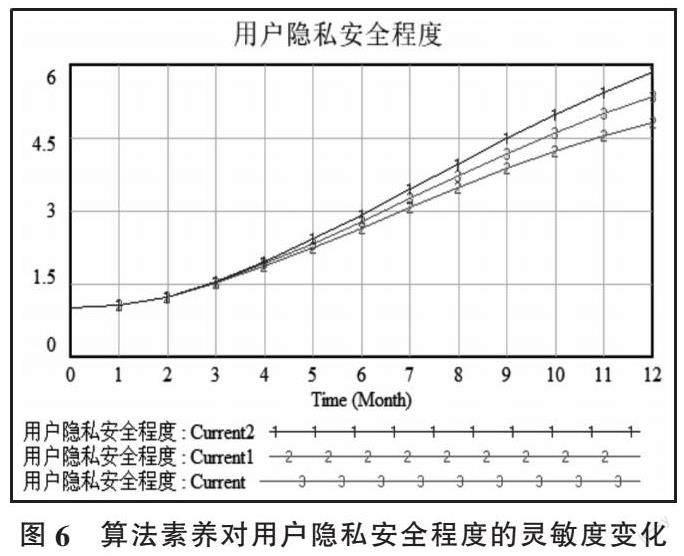

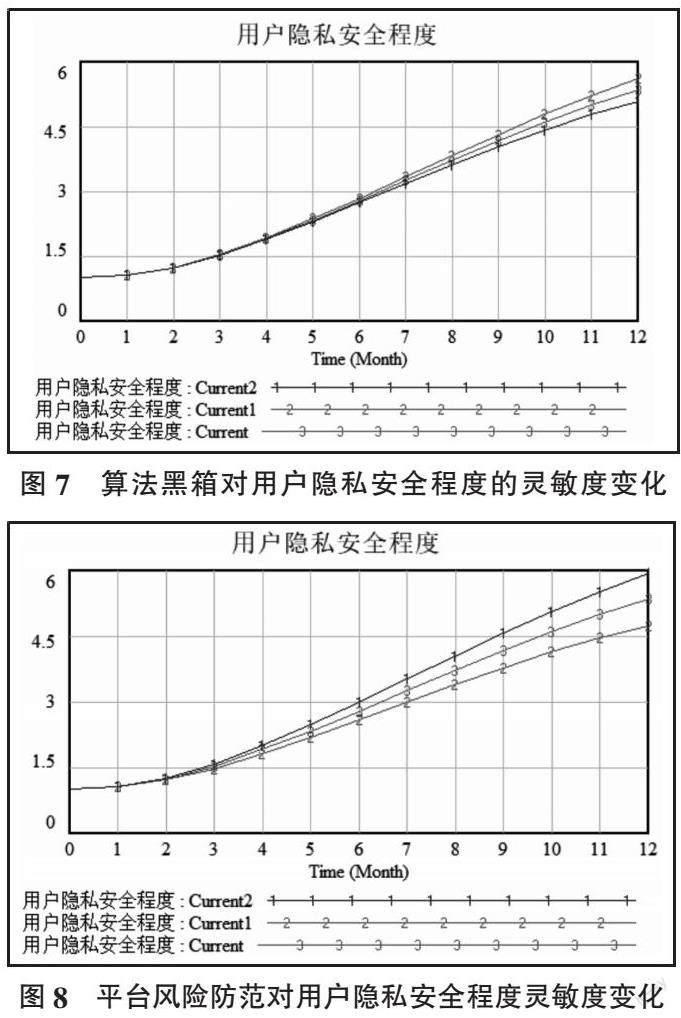

通過算法推薦系統因果關系圖和系統流圖分析可知,數據與算法都是兩個不可分割的數字世界底層邏輯融合體,平臺是數據與算法融合的載體。為探究算法推薦關鍵變量對系統的影響及影響程度,本文對算法推薦應用過程涉及的影響因素進行靈敏度分析[30],即從“用戶-算法-平臺”視角選取算法素養(yǎng)、算法黑箱、平臺風險防范3個變量。設定各變量初始值為文本計算得到的數值,根據控制變量法將其中某一個變量上下變化0.02,其它變量數值不變,其中數值變化反映了在某一時間內《規(guī)定》發(fā)布修訂版或該主題論文數量變化情況。以上三個影響因素分別從用戶、算法及平臺維度探討算法推薦治理,能夠較好地反映對算法推薦系統的影響。

(1)算法素養(yǎng)。將算法素養(yǎng)分別設置為Current(0.044),Current1(0.024),Current2(0.064),通過對比三條模擬曲線發(fā)現,隨著算法素養(yǎng)不斷提升,用戶隱私安全程度能夠得到明顯提高,呈正向影響(見圖6)。算法是由數據驅動的,通過系統反饋回路可知,用戶行為數據是算法推薦風險產生的關鍵。因此,提高用戶算法素養(yǎng),進而提高用戶網絡活動安全保護能力,能起到事前風險防范,從算法推薦風險源頭解決問題的作用。此外,與算法素養(yǎng)具有同樣作用的還包括媒介素養(yǎng)及思想政治教育。

(2)算法黑箱。將算法黑箱分別設置為Current(0.044),Current1(0.024),Current2(0.064),通過對比三條模擬曲線發(fā)現,隨著算法黑箱程度的提高,用戶隱私安全程度逐漸下降,呈負向影響(見圖7)。但由于系統內部算法推薦治理主要聚焦于用戶和制度在系統內對用戶隱私安全程度影響,這類風險對用戶隱私安全程度表現變化幅度相對較小。由于算法的復雜性導致了算法黑箱的形成,這也是是技術因素的體現,需要從算法設計本身、算法可解釋性層面考慮算法黑箱問題,將安全貫穿到算法的全生命周期內,從而提高算法的魯棒性和安全性。

(3)平臺風險防范。將平臺風險防范能力分別設置為Current(0.041),Current1(0.021),Current2(0.061),通過對比三條模擬曲線發(fā)現,隨著平臺風險防范的提高,用戶隱私安全程度能夠得到明顯提高,呈正向影響,特別是后期增幅顯著(見圖8)。政府作為監(jiān)管者,往往只能起到事后風險問責的作用,而平臺作為數據和算法融合的載體,決定了提供用戶信息服務方式和內容。隨著政府支持平臺參與算法推薦治理,平臺的風險防范能力逐漸提高,用戶隱私安全程度進一步得到保障。因此,強化平臺風險防范可以起到事前風險預防、事中風險監(jiān)控的作用。

5? ?結論與建議

本文提出政策文本計算與系統動力學相融合的方法,使用LDA模型并結合相似度定量識別出:算法素養(yǎng)、大數據技術、算法偏見、網絡安全審查等影響因素,在此基礎上建立算法推薦治理系統動力學模型,并使用文本計算獲取的數據,對算法推薦影響因素作用過程進行系統仿真,并對已知風險率、潛在風險率、治理率、未治理率、算法推薦風險程度、算法推薦治理程度及用戶隱私安全程度進行了有效性檢驗,證明系統仿真表現符合現實情況,為算法推薦治理及政策系統仿真研究提供了方向和理論參考。存在的不足之處在于,影響因素的提取具有一定的經驗因素,未來將進一步探索主題識別模型并提高影響因素識別的準確性。基于靈敏度分析結果,提出以下建議:

(1)加強算法素養(yǎng)教育,提高個人隱私保護意識。受當下疫情等突發(fā)事件的影響,網絡成為日常生活和學習必不可少的組成部分,需要進一步加強算法素養(yǎng)教育,預防信息泄露、謠言傳播、大數據殺熟等事件發(fā)生。一是建立算法素養(yǎng)評估體系,針對不同群體特征,進行算法素養(yǎng)差異性分析,從而有針對性地開展全民算法素養(yǎng)教育,以及對算法素養(yǎng)教育進行反饋評估;二是根據算法素養(yǎng)評估體系開展算法素養(yǎng)教育。對于算法推薦設計者與控制者,需要掌握算法安全專業(yè)知識、算法技術倫理規(guī)范及法律規(guī)范,起到在源頭開展算法推薦治理的作用;對于算法推薦治理主體和普通用戶,特別兒童、老人等信息弱勢群體,可以依托課程設置、網絡資源等開展算法知識通識性教育,使人們在特定算法推薦應用情景下,認識算法的存在及其可能帶來的風險,提高防范、對抗風險的能力[31]。

(2)建立算法全流程監(jiān)管機制,提升算法的可解釋性。規(guī)制算法黑箱問題的重要途徑是提高算法的可解釋性,而提高算法的可解釋性可通過建立算法全流程設計的監(jiān)管機制,從算法黑箱產生的前中后三方面進行考慮。一是算法設計前:算法的形成是為了從數據中總結出普遍規(guī)律和發(fā)現新的知識。因此,在保證算法精度的情況下,盡量生成具有可解釋性的算法,可通過可視化、異常點排查、代表性樣本選擇等方法明確訓練數據的質量和特點,并通過給算法增加稀疏性、可加性、單調性等適度降低算法的復雜度,使得算法具有可解釋性。二是算法設計中:算法初步形成后,可通過第三方平臺進行風險檢測,其中可解釋性檢測可通過對比敏感性分析、LIME、SHAP等解析方法并出具合格報告;三是算法設計后:算法通過第三方平臺檢測合格后,遞交政府進行算法監(jiān)管沙盒測試[32],以發(fā)現算法在不同真實應用場景中導致變化的原因,從而降低算法重構和應用風險。同時政府建立算法備案機制,便于對算法應用后進行審查和回溯。

(3)建立“制度+技術”治理機制,提高平臺風險防范能力。互聯網平臺作為發(fā)展數字經濟重要的服務機構,具有關系多層性、主體多元性、影響跨邊性、功能社會性及邊界動態(tài)性[33],需要在強化平臺風險監(jiān)管的同時,平衡好安全與創(chuàng)新發(fā)展的關系[34]。一是需要以平臺為載體,加強數據與算法的協同治理。雖然目前我國出臺了《數據保護法》《個人信息保護法》《網絡安全法》及《規(guī)定》形成“三法一規(guī)”的頂層設計[35],但以數據為驅動的算法推薦涉及各種風險管理場景,需要解決算法推薦的精準性、個性化與數據安全的平衡問題,圍繞“三法一規(guī)”構建數據與算法協同的安全標準體系;二是需要政策支持平臺參與算法推薦治理,助推平臺突破核心技術以提高風險監(jiān)測和安全評估能力。通過差分隱私、透明度工具等新技術應用風險監(jiān)管以彌補政府外部問責的監(jiān)管漏洞,從而將平臺真正融入風險治理中,與政府、社會、個人等構建起多方參與、協同共治的風險治理模式,進而保障個人數據安全,引導更為公平、開放的數字競爭市場。

參考文獻:

[1]? 張濤,馬海群.智能情報分析中算法風險及其規(guī)制研究[J].圖書情報工作,2021,65(12):47-56.

[2]? 張建偉,李月琳,李東東.網絡學術資源平臺個性化推薦服務特征研究[J].情報資料工作,2021,42(5):76-83.

[3]? 趙輝,化柏林,何鴻魏.科技情報用戶畫像標簽生成與推薦[J].情報學報,2020,39(11):1214-1222.

[4]? 國家互聯網信息辦公室.互聯網信息服務算法推薦管理規(guī)定[EB/OL].[2023-01-01].http://www.cac.gov.cn/2022-01/04/c_1642894606364259.htm.

[5]? 文禹衡,付張祎.基于計量分析的我國數據確權政策與科研協同研究[J].現代情報,2022,42(10):58-70.

[6]? 夏夢穎.算法推薦可能引致的公共風險及綜合治理路徑[J].天府新論,2022(2):124-129.

[7]? 周穎玉,柯平,劉海鷗.面向算法推薦倫理失范的人機和諧生態(tài)建構研究[J].情報理論與實踐,2022,45(10):54-61.

[8]? Seaver N.CARE AND SCALE:Decorrelative Ethics in Algorithmic Recommendation[J].Cultural Anthropology,2021,36(3): 509-537.

[9]? 李龍飛,張國良.算法時代“信息繭房”效應生成機理與治理路徑——基于信息生態(tài)理論視角[J].電子政務,2022(9):51-62.

[10]? 蘇宇.優(yōu)化算法可解釋性及透明度義務之詮釋與展開[J].法律科學(西北政法大學學報),2022,40(1):133-141.

[11]? Watson H J,Nations C.Addressing the Growing Need for Algorithmic Transparency[J].Communications of the Association for Information Systems,2019,45(1):26.

[12]? 林洹民.個性化推薦算法的多維治理[J].法制與社會發(fā)展,2022,28(4):162-179.

[13]? 許可.算法規(guī)制體系的中國建構與理論反思[J].法律科學(西北政法大學學報),2022,40(1):124-132.

[14]? Banker S.Khetani S.Algorithm Overdependence: How the Use of Algorithmic Recommendation Systems Can Increase Risks to Consumer Well-Being[J].Journal of Public Policy & Marketing,2019,38(4):500-515.

[15]? 馬天一.算法推薦視域下的智慧圖書館未成年人保護進路[J].圖書館論壇,2023,43(2):14-25.

[16]? Descampe A,Massart C,Poelman S,et al.Automated news recommendation in front of adversarial examples and the technical limits of transparency in algorithmic accountability[J].Ai & Society,2022,37(1):67-80.

[17]? 馬鑫,王芳,段剛龍.面向電商內容安全風險管控的協同過濾推薦算法研究[J].情報理論與實踐,2022,45(10):176-187.

[18]? 丁睿豪,夏德元.傳播學視角下算法推薦研究的學術場域——基于2010-2019年新聞傳播學文獻的Citespace可視化科學知識圖譜分析[J].新聞愛好者,2022(1):16-21.

[19]? 陳軍,謝衛(wèi)紅,陳揚森.國內外大數據推薦算法領域前沿動態(tài)研究[J].中國科技論壇,2018(1):173-181.

[20]? 馬海群,張濤,李鐘雋.新冠疫情下政府數據開放與安全的系統動力學研究[J].現代情報,2020,40(7):3-13.

[21]? 張曉娟,莫富傳,馮翠翠.政府數據開放價值實現的機理:基于系統動力學的分析[J].情報理論與實踐,2022,45(5):75-83.

[22]? 袁紅,王燾.政府開放數據生態(tài)系統可持續(xù)發(fā)展實現路徑的系統動力學分析[J].圖書情報工作,2021,65(17):13-25.

[23]? Blei D M.Probabilistic topic models[J].Communications of the ACM,2012,55(4):77-84.

[24]? Blei D M,Ng A Y,Jordan M J.Latent Dirichlet allocation[J].Machine Learning Research,2003,3(Jan):993-1022.

[25]? Mikolov T,Sutskever I,Chen K,et al.Distributed representations of words and phrases and their compositionality[J].Advances in Neural Information Processing Systems,2013,26:3111-3119.

[26]? Griffiths T L,Steyvers M.Finding scientific topics[J].Proceedings of the National academy fo Sciences,2004,101(S1):5228-5235.

[27]? 李慧,胡吉霞,佟志穎.面向多源數據的學科主題挖掘與演化分析[J].數據分析與知識發(fā)現,2022,6(7):44-55.

[28]? 張濤,馬海群.人工智能數據安全影響因素的系統動力學研究[J].情報探索,2021(3):1-10.

[29]? 孫華偉,王克平,張亞男,等.基于大數據思維的科技智庫情報服務機制系統動力學仿真研究[J].情報理論與實踐,2022,45(12):128-137.

[30]? 趙又霖,曹宏楠.面向應急管理的政務微博信息交流效率及其影響因素研究[J].農業(yè)圖書情報學報,2022,34(9):72-85.

[31]? 彭蘭.如何實現“與算法共存”——算法社會中的算法素養(yǎng)及其兩大面向[J].探索與爭鳴,2021(3):13-15.

[32]? 張濤,馬海群.智能情報分析中數據與算法風險識別模型構建研究[J].情報學報,2022,41(8):832-844.

[33]? 肖紅軍,李平.平臺型企業(yè)社會責任的生態(tài)化治理[J].管理世界,2019,35(4):120-144.

[34]? 李凌.平臺經濟發(fā)展與政府管制模式變革[J].經濟學家,2015(7):27-34.

[35]? 馬海群,張濤.我國數據與算法安全治理:特征及對策[J].電子政務,2023(3):118-128.

作者簡介:崔文波,男,黑龍江大學信息管理學院碩士研究生,研究方向:數據分析與知識發(fā)現;張濤,男,黑龍江大學信息管理學院副教授,研究方向:政策文本計算與數據分析;孫欽瑩,女,黑龍江大學信息管理學院講師,研究方向:應急情報管理;馬海群,男,黑龍江大學信息管理學院二級教授,博士生導師,研究方向:信息政策與法律、數據治理。