機器視覺技術(shù)在我國農(nóng)業(yè)領(lǐng)域內(nèi)的應用分析

田鵬菲 王皞陽

摘要:機器視覺技術(shù)在我國打造高水平農(nóng)業(yè)的道路上扮演了重要角色。為幫助相關(guān)研究人員整體了解我國農(nóng)業(yè)領(lǐng)域內(nèi)機器視覺技術(shù)的應用情況,把握其研究方向,以中國知網(wǎng)為文獻數(shù)據(jù)來源,通過文獻解讀,結(jié)合文獻計量學和知識圖譜可視化軟件,系統(tǒng)分析機器視覺技術(shù)在我國農(nóng)業(yè)中的應用情況,并提出現(xiàn)有的研究弱勢和未來的發(fā)展趨勢。結(jié)果表明,機器視覺技術(shù)在我國農(nóng)業(yè)領(lǐng)域內(nèi)的發(fā)展大致可以分為3個階段,研究數(shù)量整體呈現(xiàn)上升趨勢,應用方向可以分為視覺導航、無損檢測、精確定位、病蟲害識別、長勢監(jiān)測、目標識別或判斷、信息采集或測算,研究重點為導航、農(nóng)業(yè)機械、識別、算法、無損檢測、圖像處理,未來的研究方向為高精度智能化視覺系統(tǒng)的研發(fā)。

關(guān)鍵詞:機器視覺技術(shù);農(nóng)業(yè);文獻計量分析;知識圖譜;研究數(shù)量;應用方向;研究重點;研究方向;突發(fā)詞

中圖分類號:TP391.41;S126文獻標志碼:A

文章編號:1002-1302(2023)14-0013-09

機器視覺廣泛應用于我國農(nóng)業(yè)領(lǐng)域內(nèi)的多個生產(chǎn)環(huán)節(jié),具有精度高、效率高、適用廣的優(yōu)點。從最初的植物品種識別發(fā)展至今,已經(jīng)成為從考種、種植、采收,再到后期分級加工乃至貫穿整個農(nóng)業(yè)生產(chǎn)環(huán)節(jié)的成熟技術(shù),在種植業(yè)以外的其他涉農(nóng)行業(yè)也有應用,對提高作業(yè)精度、節(jié)約勞動力、帶動產(chǎn)業(yè)升級、推動農(nóng)機信息化和智能化等具有重要意義,為我國農(nóng)業(yè)發(fā)展作出了重要貢獻。目前,我國正處于由傳統(tǒng)農(nóng)業(yè)邁向現(xiàn)代農(nóng)業(yè)的過渡期,機器視覺作為農(nóng)業(yè)機械的“眼睛”,在近幾年得到了飛速發(fā)展,極大地提高了生產(chǎn)效率和農(nóng)機自動化水平。把握好該技術(shù)在我國農(nóng)業(yè)領(lǐng)域內(nèi)的研究現(xiàn)狀和熱點,對補足我國農(nóng)業(yè)中機器視覺技術(shù)的弱勢、明確未來視覺技術(shù)的發(fā)展趨勢具有重要的參考價值。

1 文獻數(shù)據(jù)來源及分析方法

1.1 文獻數(shù)據(jù)來源

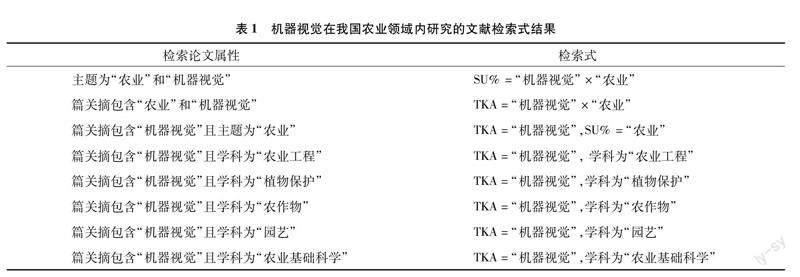

文獻數(shù)據(jù)為收錄在中國知網(wǎng)的核心、EI及SCI論文,發(fā)表截至時間為2021年12月31日,檢索時間為2022年8月1日,運用中國知網(wǎng)專業(yè)檢索功能,使用表1檢索式逐次進行檢索后,再匯總、去重、去除相關(guān)度不高或綜述性的論文,以篩選后的 503篇論文作為分析對象。

1.2 文獻分析方法

運用CiteSpace對文獻數(shù)據(jù)進行文獻計量學中的年度分布分析、關(guān)鍵詞分析及知識圖譜繪制,通過人工閱讀篩選進行文獻研究內(nèi)容分類,借助Excel進行統(tǒng)計數(shù)據(jù)的圖表繪制。

2 發(fā)展情況簡析

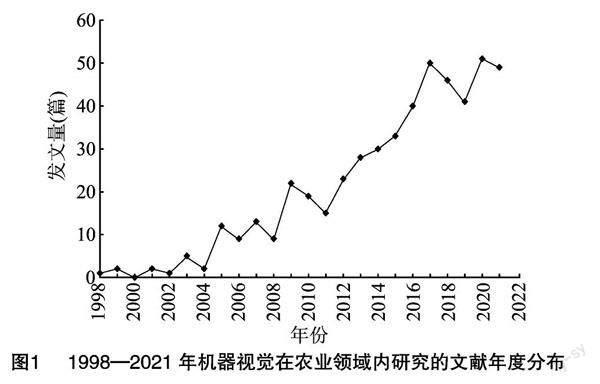

由圖1可知,機器視覺在我國農(nóng)業(yè)領(lǐng)域內(nèi)的相關(guān)研究發(fā)文數(shù)量整體呈現(xiàn)上升趨勢,局部具有微小波動。按照發(fā)文數(shù)量將機器視覺在我國農(nóng)業(yè)領(lǐng)域內(nèi)的發(fā)展大致分為以下3個階段。

第一階段為1998—2008年,此階段每年的發(fā)文數(shù)量較少,共計發(fā)文56篇,該階段稱為萌芽期。機器視覺作為一種農(nóng)業(yè)新技術(shù),在該階段的相關(guān)研究多以算法的實現(xiàn)為主,受制于計算機低算力和圖像采集系統(tǒng)的低分辨率,該階段的研究成果很難支撐起快速準確的在線檢測或數(shù)據(jù)處理,整體分析精度不高,以通過靜態(tài)圖片進行算法研究為主,實用性不強。此外,在人工閱讀篩選和分析文獻時,發(fā)現(xiàn)該階段的論文有許多都是介紹國外研究成果的科普性綜述,其數(shù)量在某些年份甚至多過研究性論文,說明該階段國內(nèi)農(nóng)業(yè)領(lǐng)域?qū)C器視覺的研究及應用遠不如國外,我國視覺技術(shù)起步較晚、應用于農(nóng)業(yè)的程度較低的劣勢在該階段非常明顯。

第二階段為2009—2015年,此階段的發(fā)文數(shù)量逐步上升,共計發(fā)文170篇,此階段稱為視覺技術(shù)的成長期。經(jīng)過一段時間的發(fā)展和研究,機器視覺技術(shù)已經(jīng)在農(nóng)業(yè)生產(chǎn)中有了一定的應用,雖然也是以算法的實現(xiàn)為主,但此階段中有不少以解決實際需求為出發(fā)點、以算法與農(nóng)業(yè)機械的結(jié)合為目的進行研究,精度和處理速度的提升也使得機器視覺在農(nóng)業(yè)生產(chǎn)中的實用性得到增強。

第三階段為2016—2021年,此階段發(fā)文數(shù)量較多,共計發(fā)文277篇,該階段稱為成熟期。此階段機器視覺在農(nóng)業(yè)中的應用愈發(fā)廣泛,技術(shù)也愈發(fā)成熟,以優(yōu)化算法增強實用性的研究逐漸增多。依托于網(wǎng)絡技術(shù)和計算機算力的進步,機器視覺技術(shù)正在由“幫助機器看到”向“幫助機器思考”發(fā)展,深度學習等方法的引入使得機器視覺在農(nóng)業(yè)中的應用越來越接近智能化,算法的魯棒性也越來越高。

綜上,我國農(nóng)業(yè)領(lǐng)域內(nèi)的機器視覺技術(shù)發(fā)展可以簡單總結(jié)為從無到有、從有到實用、從實用向智能發(fā)展3個過程。

3 應用方向歸類

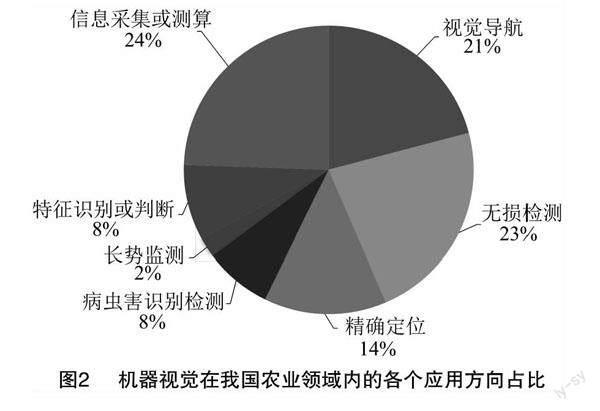

通過閱讀分析,可以將機器視覺在我國農(nóng)業(yè)領(lǐng)域內(nèi)的應用分為視覺導航、無損檢測、精確定位、病蟲害識別檢測、長勢監(jiān)測、特征識別或判斷、信息采集或測算7個方向。

分類原則以相關(guān)論文研究內(nèi)容的終端應用目的為準,如倪江楠等基于光學導航的采摘機器人系統(tǒng)設計及定位方法研究[1],雖然題目中包含“導航”,研究中有果實的識別內(nèi)容,但是其研究的應用目的是幫助采摘機器人更好地定位果實所在位置。因此,該論文的應用方向歸類為精確定位。其他論文均以此準則進行歸類,各應用方向的發(fā)文比例如圖2所示,具體數(shù)量分布如表2所示。

4 各應用方向的研究情況簡析

4.1 視覺導航

視覺導航的研究目標大致可以分為2類,一類為幫助農(nóng)業(yè)裝備進行路徑規(guī)劃,從而實現(xiàn)作業(yè)線路導航或無人駕駛作業(yè);另一類為輔助農(nóng)業(yè)裝備避障或避開農(nóng)作物。作為自主導航農(nóng)機的重要組成部分,機器視覺可以通過識別作物行[2-3]、道路[4-5]、地頭線[6]、根茬[7-8]、障礙物[9-10]等完成導航。

視覺導航是機器視覺在我國農(nóng)業(yè)中最早的應用方向之一,1998年,王豐元等根據(jù)霍夫(Hough)變換設計出一種直線檢測方法,這是本研究檢索的文獻數(shù)據(jù)中最早關(guān)于機器視覺在導航中的應用研究[11]。當時視覺導航技術(shù)還未在我國農(nóng)業(yè)中投入使用,相關(guān)研究僅限于算法研究與可行性分析。經(jīng)過多年發(fā)展,具有自主導航功能的農(nóng)業(yè)機械越來越多地應用于農(nóng)業(yè)生產(chǎn)中,相關(guān)研究涉及田間作業(yè)導航[12-13]、收獲[14]、運輸[15]等多個方面。

機器視覺導航共有3種應用途徑,一是獨立視覺導航,即僅通過機器視覺對農(nóng)業(yè)機械進行導航;二是視覺輔助導航,即作為全球?qū)Ш叫l(wèi)星系統(tǒng)(GNSS)導航受到干擾時的臨時輔助導航;三是聯(lián)合導航,即使用機器視覺、GNSS、超聲波或其他傳感器進行聯(lián)合導航,常見的視覺導航典型結(jié)構(gòu)見圖3。

獨立視覺導航的相關(guān)研究多應用于農(nóng)機在農(nóng)田內(nèi)的行走路徑導航,利用機器視覺進行路徑規(guī)劃。關(guān)卓懷等經(jīng)過畸變矯正、高斯濾波、2R-G-B超紅特征模型的圖像二值化割、二值圖像形態(tài)學開-閉運算、抑制噪聲等流程實現(xiàn)了4種光線環(huán)境下水稻收獲作業(yè)路徑提取[16];王僑等依據(jù)農(nóng)田內(nèi)外像素灰度跳變特征判斷地頭是否出現(xiàn),經(jīng)過平滑處理、建立按序離群度參數(shù)、確定跳變特征點的像素坐標等流程獲得農(nóng)機所在地頭安全轉(zhuǎn)向掉頭的邊界線[17]。

視覺輔助導航的相關(guān)研究多應用于自主性較強,但作業(yè)環(huán)境可能短暫失去GNSS信號的無人駕駛設備。張振乾等使用型號為ZED雙目相機采集圖像,通過點云獲取和實時三維重建,結(jié)合改進 K-means 聚類方法實現(xiàn)巡檢機器人在香蕉園內(nèi)的路徑提取[18];田光兆等使用BBX3三目相機采集圖像,并實現(xiàn)自主導航拖拉機短時離開衛(wèi)星定位時的運動軌跡預測[19]。

聯(lián)合導航的相關(guān)研究主要應用于智能農(nóng)機或可以無人監(jiān)管的自主行駛農(nóng)業(yè)設備。李云伍等采用差分全球?qū)Ш蕉ㄎ幌到y(tǒng)(RTK-GNSS)進行路網(wǎng)信息采集、實時定位和路徑規(guī)劃,利用機器視覺進行田間道路識別和路徑跟蹤線提取,研制出丘陵山區(qū)田間道路自主轉(zhuǎn)運車的導航系統(tǒng),在3種不同路況下均有較小的行駛誤差,可以滿足轉(zhuǎn)運車自主行駛的安全要求[20];王東等利用GNSS導航進行無人機果園作業(yè)的行間切換,利用機器視覺進行果樹識別并實現(xiàn)無人機軌跡控制,研發(fā)出一種適用于山地果園且精度較高的無人機軌跡控制系統(tǒng)[21]。

總體而言,視覺導航技術(shù)已經(jīng)較成熟,在我國農(nóng)業(yè)中應用廣泛,近年來,以增加智能程度和提高精度為目的展開的研究日益增多。未來的研究傾向于機器視覺與GNSS等技術(shù)結(jié)合的高精度、高自主性導航設備研發(fā),如2022年9月3日,在廣西壯族自治區(qū)柳州市舉辦的“‘科創(chuàng)中國丘陵山區(qū)智能農(nóng)機裝備高質(zhì)量發(fā)展研討會”上,羅錫文院士展示的水稻無人農(nóng)場內(nèi)的自主導航作業(yè)機械,既具有自主識別作業(yè)路徑、作業(yè)目標的功能,還可以與配套農(nóng)機協(xié)同作業(yè)、自主入庫。此類智能農(nóng)機如何投入更多種農(nóng)作物的生產(chǎn)中,是未來幾年視覺導航的研究重點。

4.2 無損檢測

機器視覺無損檢測技術(shù)在我國農(nóng)業(yè)中的應用主要有2種,一是機器視覺考種,使用機器視覺檢測種子或種苗,判斷種子或種苗活力;二是機器視覺對果蔬進行無損檢測分級(圖4)。

機器視覺考種具有無損、快速、低成本、無污染、無主觀影響的優(yōu)點。張晗等將1 200粒正常種子、1 200粒霉變種子、1 200粒破損種子作為圖像采集樣本,使用HALCON軟件提取種子的18個顏色和12個形態(tài)特征,建立相關(guān)檢測模型,實現(xiàn)了較高準確率的玉米種子分選試驗結(jié)構(gòu)[22];張秀花等對YOLOv3-Tiny卷積神經(jīng)網(wǎng)絡的目標檢測模型進行改進,實現(xiàn)了番茄穴盤苗內(nèi)無苗、弱苗、壯苗穴盤識別分級,在重合閾值為50%的條件下平均精度達到97.64%,且單張圖像的處理時間為 5.03 ms,相比于人工乃至其他目標檢測算法均有優(yōu)勢,對種苗檢測具有重要參考價值[23]。

機器視覺無損檢測分級可以通過對尺寸、顏色、缺陷情況等指標綜合考量后進行果蔬自動分級,在大量、多指標的農(nóng)產(chǎn)品分級任務中相比于人工或其他物理分級系統(tǒng)具有無主觀影響、能綜合指標分級的明顯優(yōu)勢。王風云等提出基于分水嶺、Canny算子、閉運算等處理的雙孢蘑菇圖像大小分級算法,同時開發(fā)出相關(guān)分析與控制軟件、研發(fā)出樣機,該研究在輸送速度為12.7 m/min、相機行頻為 1 900 Hz 下,具有97.42%的平均準確率[24];向陽等探究一種基于遷移學習的芒果雙面成熟度在線檢測分級系統(tǒng),通過獲取、合并、預處理芒果上下兩面的圖像,以顏色信息為分級依據(jù),利用卷積神經(jīng)網(wǎng)絡模型對芒果成熟度進行分級,試驗中該模型的平均準確率達到96.72%,單個樣品檢測耗時 0.16 s,具有實用價值[25]。

無論是機器視覺考種還是果蔬等農(nóng)產(chǎn)品分級,都需要針對不同作業(yè)目標的不同評級標準進行算法訓練,因此很難形成具有普遍適用性的無損檢測系統(tǒng)。隨著處理器人工智能(AI)算力的進步,識別訓練可以利用網(wǎng)絡大數(shù)據(jù)進行,對各類缺陷進行特征歸類、建立檢測系統(tǒng)框架和數(shù)據(jù)庫,以此改變必須對待測物及缺陷先進行特定訓練才能視覺無損檢測的現(xiàn)狀,進而實現(xiàn)更高效的無損檢測系統(tǒng)的開發(fā)。

4.3 精確定位

基于機器視覺的精確定位在我國農(nóng)業(yè)中的應用[CM(21]主要有2種,一是采摘機械作業(yè)時需要的果蔬空間位置定位,二是植保作業(yè)時植保機械對作業(yè)目標的精確對靶。利用機器視覺進行精確定位的研究是隨著農(nóng)業(yè)機器人的發(fā)展而興起的,其作業(yè)時的底層原理是目標識別。在采摘作業(yè)中精確定位時,機器視覺需要識別待采摘果蔬的特征,分辨果蔬所在的空間位置,并盡可能去除枝葉干擾,判斷果蔬距離。陳軍等利用HSV顏色模型,通過分割紅色區(qū)域的方法識別成熟草莓,利用測距模塊保持機器與種植壟的距離恒定,設計出配套執(zhí)行部件并實現(xiàn)成熟草莓的識別與精確定位,在試驗條件下具有90%的無傷采摘成功率[26];鄭如新等通過圖像采集、噪音消除、RGB和HSV顏色分割、Canny算法邊緣檢測等流程實現(xiàn)了金銀花的識別,改進后的識別率為93.75%,可以滿足金銀花采摘機器人實時作業(yè)要求[27]。

在植保作業(yè)精確定位時,機器視覺需要通過識別雜草、作物或作物行等目標實現(xiàn)精準控制對靶,從而達到精確施肥、噴藥或避苗作業(yè)的目的。韓長杰等通過改進超綠算法(ExG算法)提取顏色信息,提出甘藍作物行與多作物行自適應感興趣區(qū)域(ROI)提取方法,并設計基于PID軌跡追蹤算法的對行噴霧控制系統(tǒng),在田間試驗中對行準確率達到93.33%,對行偏差在 1.54 cm 以內(nèi),可以滿足田間作業(yè)需求[28];宗澤等利用顏色特征識別玉米株心,使用切片式排肥器進行間歇排肥,建立施肥滯后誤差補償模型,進而實現(xiàn)準確的玉米按株定位定量施肥,施肥位置誤差平均為3.2 cm,可以滿足科學施肥、減少化肥浪費的目的[29]。

目前,我國利用機器視覺精確定位的相關(guān)研究多具有針對性,可識別作業(yè)目標較少,通常在植物保護技術(shù)作業(yè)中的實際應用較多。未來可以通過結(jié)合激光測距、超聲波測障、TOF鏡頭深度測量等技術(shù)手段實現(xiàn)更高精度的定位。

4.4 病蟲害識別檢測

機器視覺可以幫助種植人員更快更好地識別病蟲害類型,評估病蟲害受災情況,從而制定恰當?shù)膽獙Υ胧T缙诶脵C器視覺實現(xiàn)的病蟲害識別主要利用簡單的形狀邏輯判斷,而后發(fā)展到基于特征向量的模式識別,如今隨著深度學習的發(fā)展,卷積神經(jīng)網(wǎng)絡及其改進算法的引入大幅提高了識別率[30]。李就好等提出一種基于改進的更快速區(qū)域卷積神經(jīng)網(wǎng)絡(Faster R-CNN)的苦瓜葉部病害目標檢測方法,經(jīng)過圖像采集、深度學習模型訓練、圖像隨機處理、融入特征金字塔網(wǎng)絡等流程,建立識別苦瓜健康葉片、白粉病、灰斑病、蔓枯病、斑點病且具有良好魯棒性的檢測模型[31];黨滿意等利用RGB、HSV顏色空間中馬鈴薯葉片的顏色變化建立晚疫病無病和患病模型,并用熵值和能量值描述病情的嚴重程度,相比于傳統(tǒng)理化值檢測法可以節(jié)約大量時間[32];張哲宇等利用改進YOLOv3和DBTNet-101雙層網(wǎng)絡建立稻縱卷葉螟檢測模型,配合相關(guān)硬件設施搭建基于深度學習的機器視覺稻縱卷葉螟性誘智能監(jiān)測系統(tǒng),實現(xiàn)稻縱卷葉螟成蟲的實時自動檢測,精確率達到97.6%[33]。

雖然利用機器視覺識別病蟲害的研究隨著向量機、深度學習等算法的引入及優(yōu)化變得越發(fā)穩(wěn)定和成熟,但是由于病蟲害種類繁多,且各類病蟲害的可視化表征可能相似或重疊,導致目前機器視覺識別病蟲害之前必須進行大量針對性訓練。開發(fā)一個可以識別大量病蟲害種類、評估受災情況的系統(tǒng)任重而道遠。未來該技術(shù)的研究可以向普適性識別和提供意見結(jié)合的方向發(fā)展,先從病蟲害數(shù)據(jù)庫建立著手,經(jīng)過長期的圖像采集和特征提取,制定統(tǒng)一病蟲害嚴重情況評判標準,而后引入專家應對意見,實現(xiàn)識別、防治雙功能。

4.5 長勢監(jiān)測

對農(nóng)作物進行長勢監(jiān)測是精準農(nóng)業(yè)的重要組成部分,通過視覺系統(tǒng)獲取作物生長狀況、環(huán)境因素等數(shù)據(jù),有利于田間管理者做出決策建議,可以更加精準地進行水肥配給。建立長勢與收獲相關(guān)模型,可以通過長勢監(jiān)測數(shù)據(jù)進行產(chǎn)量預估。

傳統(tǒng)的長勢監(jiān)測系統(tǒng)常見于設施農(nóng)業(yè)中,多利用較固定的監(jiān)測點在一定區(qū)域內(nèi)進行長期監(jiān)測,從而獲得完整生長周期內(nèi)的長勢與環(huán)境相關(guān)度信息,具有較高的穩(wěn)定性和數(shù)據(jù)預測準確度。李云霞等對2017—2019年連續(xù)2個生長季的冬小麥進行多次圖像采集,分別構(gòu)建苗期冠層和開花期麥穗數(shù)據(jù)集,利用RGB圖像和深度學習完成冬小麥長勢參數(shù)模塊和麥穗計數(shù)模塊的搭建,可以滿足冬小麥田間長勢參數(shù)估算需求[34]。相比于傳統(tǒng)長勢監(jiān)測系統(tǒng),利用無人機進行長勢監(jiān)測具有覆蓋范圍大、靈活、機動性好、作業(yè)效率高、布局成本低的優(yōu)點。寧川等利用無人機搭載數(shù)碼相機采集油菜圖像,經(jīng)過對圖像進行預處理和色度(HIS)色彩空間灰度化、閾值分割等流程,最終實現(xiàn)了以色度(H)分量值為特征參數(shù)的油菜長勢評價系統(tǒng),為油菜長勢調(diào)查和產(chǎn)量預測提供依據(jù)[35]。

從長勢監(jiān)測系統(tǒng)的實際應用經(jīng)驗來看,結(jié)合多種傳感器、環(huán)境可控的設施農(nóng)業(yè)內(nèi)部具有最好的長勢監(jiān)測條件,大田應用場景中很難滿足精細布局和光線調(diào)控的需要,利用無人機進行長勢監(jiān)測是大田作業(yè)要求下的發(fā)展趨勢。為了避免明暗干擾,未來可以嘗試在夜間進行基于紅外線或多光譜結(jié)合的機器視覺長勢監(jiān)測。

4.6 特征識別或判斷

機器視覺進行特征識別或判斷的技術(shù)最常見于人臉識別、拍照識圖等場景,在農(nóng)業(yè)領(lǐng)域內(nèi)的目標識別或判斷多用于利用機器視覺進行種植業(yè)內(nèi)的植物品種或類型識別、養(yǎng)殖業(yè)內(nèi)的動物個體身份或行為識別,乃至通過特征識別判斷植物是否可食用或有價值、動物是否需要調(diào)整養(yǎng)殖條件。

種植業(yè)中的農(nóng)作物種類繁多,傳統(tǒng)植物識別方法需要工作人員具備扎實的植物形態(tài)學知識,機器視覺可以依據(jù)花、果實、枝葉等器官的形態(tài)、紋理、顏色等特征對植物進行識別分類。溫長吉等以多個植物圖像數(shù)據(jù)庫的照片為試驗數(shù)據(jù)集,引入并改進稠密膠囊網(wǎng)絡模型進行花卉和葉片等植物器官的識別,通過增加前景待識別區(qū)域的特征權(quán)值降低背景干擾,實現(xiàn)了圖片尺寸為32像素×32像素時77.2%、圖片尺寸為227像素×227像素時95.1%的平均識別準確率[36];林楠等利用Retinex算法增強圖像,通過中值濾波進行圖像去噪預處理,以改進HSV色彩空間進行識別,實現(xiàn)野生菌的快速有效識別[37]。

養(yǎng)殖業(yè)內(nèi)對動物個體進行身份識別是智能化養(yǎng)殖中實現(xiàn)精準監(jiān)測與溯源的重要手段之一,對動物行為進行識別是養(yǎng)殖人員判斷動物身體狀況與訴求、保證動物福利的重要依據(jù)。謝秋菊等建立改進的融合注意力機制的密集卷積網(wǎng)絡(DenseNet-CBAM)模型對豬臉進行識別,通過嵌入密集卷積網(wǎng)絡(CBAM)注意力模塊加強豬臉關(guān)鍵特征的提取,并實現(xiàn)豬臉圖像分類,豬臉識別準確率達到99.25%[38];王少華等使用改進的高斯混合模型進行運動奶牛目標檢測,通過色彩及紋理信息去除干擾背景,再利用AlexNet深度學習網(wǎng)絡訓練奶牛行為分類網(wǎng)絡模型,識別奶牛爬跨行為,實現(xiàn)100%的奶牛發(fā)情行為自動識別[39]。

隨著智能手機的發(fā)展,圖像識別技術(shù)的普及度越來越高,但是農(nóng)業(yè)中真正成熟的目標識別判斷系統(tǒng)依然稀缺。農(nóng)業(yè)領(lǐng)域內(nèi)圖像識別的難點,主要是需要識別的物體種類和難以歸類處理的特征太多。建立一套識別系統(tǒng)需要大量的數(shù)據(jù),如果要進行植物種類識別,首先要有大量的植物圖像可供系統(tǒng)訓練,其次要對各類相似植物的細微差異進行區(qū)分,最后還要通過不同角度、不同光照環(huán)境適應性練習保證貼近實際應用場景;如果要對某種動物進行個體識別,則需要對該動物較固定的形貌特征進行提取,并長期對該特征進行跟蹤和對比,得出該特征隨時間延長而發(fā)生變化的函數(shù),通過多次預測和修正減少動物成長帶來的干擾。總之,精準精確的目標識別判斷在我國農(nóng)業(yè)內(nèi)大量應用還有很長的一段路要走。

4.7 信息采集或測算

農(nóng)業(yè)生產(chǎn)中通過機器視覺進行信息采集或測算具有非接觸、準確率高、速度快、節(jié)約勞動力的優(yōu)點,因此在農(nóng)田技術(shù)指標采集、農(nóng)產(chǎn)品質(zhì)量評價、動物發(fā)育狀況考評等方面具有大量的應用與研究[40]。

某些農(nóng)田指標的采集需要耗費大量勞動力,同時作業(yè)效率低,利用視覺技術(shù)可以在成本較低且不改變農(nóng)田待測指標的情況下完成信息采集。安曉飛等利用K-means聚類算法從背景中分離秸稈圖像,分區(qū)尋優(yōu),再通過對秸稈像素點數(shù)量的計算獲得田地里玉米秸稈的覆蓋率,經(jīng)過驗證,該方法與人工拉繩法和人工圖像標記法均有較高的相關(guān)系數(shù),誤判率為7%,能夠在不同條件下代替人工進行秸稈覆蓋率計算[41]。

農(nóng)產(chǎn)品質(zhì)量評價對農(nóng)產(chǎn)品價格評估具有重要參考價值,許多傳統(tǒng)評價方法具有工序繁雜費時、主觀因素影響大、評價指標易浮動的缺點,機器視覺的大量應用,使得快速采集農(nóng)產(chǎn)品優(yōu)劣信息進行農(nóng)產(chǎn)品質(zhì)量評價成為現(xiàn)實。萬龍等采用RGB雙面成像方法獲取籽棉樣本圖像,通過分析圖像內(nèi)雜質(zhì)面積預測已去除大雜的籽棉含雜率和小雜質(zhì)量,最后結(jié)合大小雜質(zhì)數(shù)據(jù)預測樣本總含雜率,結(jié)果表明該系統(tǒng)具有較高的準確率,同時比人工檢測有更高的效率[42]。

動物的生長發(fā)育狀況常通過動物體尺、體質(zhì)量、體態(tài)等指標進行考評,傳統(tǒng)的測量方法常需要人工作業(yè),效率低且具有安全隱患,利用機器視覺進行無接觸測量具有安全高效的優(yōu)點。司永勝等利用Kinect相機獲取的視頻數(shù)據(jù)對長白豬和大白豬進行豬體姿態(tài)檢測和體尺測量,利用最小外接矩形法調(diào)整豬體為水平方向,利用投影法和差分法識別豬體的頭、尾位置,通過頭部邊界標記法判斷耳部是否缺失,再通過骨骼化算法結(jié)合霍夫變換檢測豬體頭部是否歪斜,進而進行體尺測量,該算法對豬體寬、高、長的平均測量精度分別為95.5%、96.3%、97.3%,準確率較高,對實現(xiàn)無接觸豬體尺測量具有參考價值[43]。

非接觸式信息采集或測算是未來農(nóng)業(yè)信息化發(fā)展的重要組成部分。受新冠疫情影響,近2年非接觸測量變得越來越常見,在農(nóng)業(yè)中的應用也層出不窮。除了非接觸外,機器視覺相較于人眼或傳統(tǒng)物理信息采測方法具有更高的分辨能力、數(shù)據(jù)量化能力和環(huán)境適應能力。近年來相關(guān)研究的目的主要是代替原有落后或低效信息的采測方法,提高作業(yè)效率,預計未來幾年基于機器視覺的信息采集或測算系統(tǒng)會淘汰更多傳統(tǒng)人力信息采集或測算方法。

5 研究重點及趨勢分析

5.1 關(guān)鍵詞共現(xiàn)分析

關(guān)鍵詞一定程度上反映某一領(lǐng)域的研究重點,結(jié)合具體應用情況可以推斷各研究的熱度走向。對1998—2021年所有農(nóng)業(yè)領(lǐng)域的機器視覺相關(guān)文獻進行關(guān)鍵詞共現(xiàn)分析,除去“機器視覺”后的關(guān)鍵詞共現(xiàn)圖譜見圖5。

由圖5可知,機器視覺在我國農(nóng)業(yè)中的研究重點主要有6點。第一,導航。視覺導航隨著智能農(nóng)機、自動駕駛等技術(shù)的發(fā)展越發(fā)成熟,預計未來幾年會達到研究熱度的頂峰,而后成為成熟技術(shù),在大規(guī)模應用于農(nóng)業(yè)機械時研究熱度會逐漸下降。第二,農(nóng)業(yè)機械。該關(guān)鍵詞的出現(xiàn)意味著我國農(nóng)業(yè)領(lǐng)域內(nèi)的機器視覺研究中有一大部分是為農(nóng)業(yè)機械服務的,其研究目的是幫助農(nóng)業(yè)機械實現(xiàn)導航、采摘、植物保護等作業(yè),側(cè)面證明機器視覺在我國農(nóng)業(yè)中的實際應用較多,由于我國農(nóng)業(yè)機械發(fā)展情況向好,所以將機器視覺應用于農(nóng)業(yè)機械的研究大概率會繼續(xù)維持熱度,直至智能農(nóng)機較成熟。第三,識別。識別是機器視覺得以完成許多作業(yè)的前提,由關(guān)鍵詞共現(xiàn)圖譜可知,識別的研究與其他研究重點聯(lián)系密切,處于中介地位,由于絕大多數(shù)機器視覺作業(yè)都需要先識別作業(yè)目標,所以可以預見識別相關(guān)的研究熱度會較穩(wěn)定地持續(xù)下去。第四,算法。算法是圖像采集系統(tǒng)、數(shù)據(jù)存儲系統(tǒng)、終端執(zhí)行系統(tǒng)等硬件設施得以進行作業(yè)的靈魂,機器視覺在我國農(nóng)業(yè)中的相關(guān)研究均需要算法設計、算法優(yōu)化的支撐展開,除硬件設計外的相關(guān)研究一般均涉及算法,所以機器視覺的研究中算法會始終占有一席之地。第五,無損檢測。作為機器視覺在農(nóng)業(yè)中的重要應用方向,無損檢測相關(guān)研究具有持續(xù)且較高的熱度,由于各種農(nóng)作物或種子的檢測及考評指標不同,相關(guān)研究應該還需要很長時間才能達到飽和。第六,圖像處理。圖像處理是視覺系統(tǒng)得以看清RIO區(qū)域的重要流程,此類研究主要是為了幫助機器視覺提高抗干擾能力展開的,包括但不限于不同光照條件、不同遮擋情況等干擾下的圖像增強或優(yōu)化,為了保證作業(yè)精度,圖像處理的相關(guān)研究應該會始終維持一定的研究熱度。

5.2 突發(fā)詞探測分析

使用CiteSpace對關(guān)鍵詞進行突發(fā)性(burstness)探測,得到的突發(fā)詞在一定程度上可以反映出某一階段的研究傾向,最新的突發(fā)詞對未來的發(fā)展趨勢具有參考價值。對數(shù)據(jù)庫內(nèi)2011—2021年的文獻進行突發(fā)性探測,結(jié)果見圖6。

從突發(fā)詞強度(strength)和時間持續(xù)情況來看,深度學習極有可能成為機器視覺在算法研究中的主流方法,其原因與智能農(nóng)機、無人農(nóng)場及農(nóng)業(yè)機器人的發(fā)展關(guān)系密切。深度學習在機器視覺中應用的目的是幫助視覺系統(tǒng)提高精度和學習,最終達到幫助視覺系統(tǒng)思考、實現(xiàn)機器視覺智能化。目前最常見的應用于機器視覺的深度學習方法為卷積神經(jīng)網(wǎng)絡(CNN)及其優(yōu)化算法,彭文等利用深度卷積神經(jīng)網(wǎng)絡建立精度較高的水稻田雜草識別模型[44];張樂等利用改進的更快速區(qū)域卷積神經(jīng)網(wǎng)絡(Faster R-CNN)實現(xiàn)了高精度的油菜田雜草識別[45]。

從突發(fā)詞還可以看出,機器視覺在農(nóng)業(yè)無人機中的應用有較大概率在未來幾年繼續(xù)保持不錯的發(fā)展趨勢,無人機在精準噴藥[46]、田間信息采集[47]等作業(yè)中具有靈活、高效的優(yōu)勢。開發(fā)更多搭載于無人機的視覺功能,對實現(xiàn)高機動性信息化農(nóng)業(yè)具有巨大幫助。

6 結(jié)論

機器視覺在我國農(nóng)業(yè)領(lǐng)域內(nèi)的應用范圍廣泛,為我國農(nóng)業(yè)走向機械化、信息化乃至智能化起到重要作用。目前,機器視覺在我國農(nóng)業(yè)中有7個應用方向和6個研究重點,雖然各項技術(shù)已經(jīng)趨于成熟,但是礙于農(nóng)業(yè)領(lǐng)域內(nèi)數(shù)據(jù)量龐大、機器視覺的智能程度不高,所以不少帶有視覺系統(tǒng)的農(nóng)業(yè)機械仍處于試驗推廣階段。

近幾年機器視覺在我國農(nóng)業(yè)中的研究越發(fā)偏向于智能化,“如何讓機器視覺幫助農(nóng)業(yè)機械思考”是未來幾年的研究重點。深度學習是提高視覺系統(tǒng)精度、實現(xiàn)多種視覺功能的有效途徑。雖然基于深度學習的機器視覺作業(yè)算法已經(jīng)很常見,但是還不算成熟,多用于提高精度。此外,機器視覺在農(nóng)業(yè)無人機中的應用也具有較高的研究價值。

總體而言,我國農(nóng)業(yè)領(lǐng)域?qū)C器視覺的應用較成功,未來可以參考各類無人農(nóng)場的模式,將機器視覺與其他傳感器進行技術(shù)融合,進而實現(xiàn)更多作物、更高精度的全程機械化。

參考文獻:

[1]倪江楠,石新龍.基于光學導航的采摘機器人系統(tǒng)設計及定位方法研究[J]. 農(nóng)機化研究,2021,43(3):221-225.

[2]楊 洋,張博立,查家翼,等. 玉米行間導航線實時提取[J]. 農(nóng)業(yè)工程學報,2020,36(12):162-171.

[3]馬志艷,湯有勝,楊光友.基于視覺的茶作物行間行走路徑規(guī)劃研究[J]. 農(nóng)機化研究,2017,39(1):202-206.

[4]李云伍,徐俊杰,王銘楓,等. 丘陵山區(qū)田間道路自主行駛轉(zhuǎn)運車及其視覺導航系統(tǒng)研制[J]. 農(nóng)業(yè)工程學報,2019,35(1):52-61.

[5]陳玉樓.自主行走拖拉機道路識別與路徑導航——基于激光掃描測距[J]. 農(nóng)機化研究,2018,40(9):227-231.

[6]喬榆杰,楊鵬樹,孟志軍,等. 面向自動駕駛農(nóng)機的農(nóng)田地頭邊界線檢測系統(tǒng)[J]. 農(nóng)機化研究,2022,44(11):24-30.

[7]王春雷,盧彩云,李洪文,等. 基于支持向量機的玉米根茬行圖像分割[J]. 農(nóng)業(yè)工程學報,2021,37(16):117-126.

[8]李景彬,楊禹錕,溫寶琴,等. 基于根茬檢測的秋后殘膜回收導航路徑提取方法[J]. 吉林大學學報(工學版),2021,51(4):1528-1539.

[9]吳春玉.農(nóng)用四軸飛行器避障控制系統(tǒng)設計——基于機器視覺和超聲波測距[J]. 農(nóng)機化研究,2022,44(4):110-114.

[10]姬長英,沈子堯,顧寶興,等. 基于點云圖的農(nóng)業(yè)導航中障礙物檢測方法[J]. 農(nóng)業(yè)工程學報,2015,31(7):173-179.

[11]王豐元,周一鳴,孫壯志.車輛引導路線檢測的計算機視覺技術(shù)初探[J]. 農(nóng)業(yè)機械學報,1998,29(1):1-5.

[12]譚文豪,桑永英,胡敏英,等. 基于機器視覺的高地隙噴霧機自動導航系統(tǒng)設計[J]. 農(nóng)機化研究,2022,44(1):130-136.

[13]張 漫,項 明,魏 爽,等. 玉米中耕除草復合導航系統(tǒng)設計與試驗[J]. 農(nóng)業(yè)機械學報,2015,46(增刊1):8-14.

[14]胡丹丹,殷 歡.基于機器視覺的玉米收獲機器人路徑識別[J]. 農(nóng)機化研究,2017,39(12):190-194.

[15]鄧明華.基于GSM嵌入式物流監(jiān)控的農(nóng)業(yè)自主導航車輛設計[J]. 農(nóng)機化研究,2017,39(2):237-241.

[16]關(guān)卓懷,陳科尹,丁幼春,等. 水稻收獲作業(yè)視覺導航路徑提取方法[J]. 農(nóng)業(yè)機械學報,2020,51(1):19-28.

[17]王 僑,劉 卉,楊鵬樹,等. 基于機器視覺的農(nóng)田地頭邊界線檢測方法[J]. 農(nóng)業(yè)機械學報,2020,51(5):18-27.

[18]張振乾,李世超,李晨陽,等. 基于雙目視覺的香蕉園巡檢機器人導航路徑提取方法[J]. 農(nóng)業(yè)工程學報,2021,37(21):9-15.

[19]田光兆,顧寶興,Mari I A,等. 基于三目視覺的自主導航拖拉機行駛軌跡預測方法及試驗[J]. 農(nóng)業(yè)工程學報,2018,34(19):40-45.

[20]李云伍,徐俊杰,王銘楓,等. 丘陵山區(qū)田間道路自主行駛轉(zhuǎn)運車及其視覺導航系統(tǒng)研制[J]. 農(nóng)業(yè)工程學報,2019,35(1):52-61.

[21]王 東,范葉滿,薛金儒,等. 基于GNSS與視覺融合的山地果園無人機航跡控制[J]. 農(nóng)業(yè)機械學報,2019,50(4):20-28.

[22]張 晗,閆 寧,吳旭東,等. 在線式玉米單粒種子檢測分選裝置設計與試驗[J]. 農(nóng)業(yè)機械學報,2022,53(6):159-166.

[23]張秀花,靜茂凱,袁永偉,等. 基于改進YOLOv3-Tiny的番茄苗分級檢測[J]. 農(nóng)業(yè)工程學報,2022,38(1):221-229.

[24]王風云,封文杰,鄭紀業(yè),等. 基于機器視覺的雙孢蘑菇在線自動分級系統(tǒng)設計與試驗[J]. 農(nóng)業(yè)工程學報,2018,34(7):256-263.

[25]向 陽,林潔雯,李亞軍,等. 芒果雙面成熟度在線檢測分級系統(tǒng)[J]. 農(nóng)業(yè)工程學報,2019,35(10):259-266.

[26]陳 軍,張繼耀,張 欣.基于機器視覺的草莓自動采摘機的設計[J]. 農(nóng)機化研究,2020,42(2):141-145.

[27]鄭如新,孫青云,肖國棟.基于機器視覺的金銀花圖像識別處理算法研究[J]. 中國農(nóng)機化學報,2022,43(4):153-159.

[28]韓長杰,鄭 康,趙學觀,等. 大田甘藍作物行識別與對行噴霧控制系統(tǒng)設計與試驗[J]. 農(nóng)業(yè)機械學報,2022,53(6):89-101.

[29]宗 澤,劉 剛.基于機器視覺的玉米定位施肥控制系統(tǒng)設計與試驗[J]. 農(nóng)業(yè)機械學報,2021,52(增刊1):66-73.

[30]楊 濤,李曉曉.機器視覺技術(shù)在現(xiàn)代農(nóng)業(yè)生產(chǎn)中的研究進展[J]. 中國農(nóng)機化學報,2021,42(3):171-181.

[31]李就好,林樂堅,田 凱,等. 改進Faster R-CNN的田間苦瓜葉部病害檢測[J]. 農(nóng)業(yè)工程學報,2020,36(12):179-185.

[32]黨滿意,孟慶魁,谷 芳,等. 基于機器視覺的馬鈴薯晚疫病快速識別[J]. 農(nóng)業(yè)工程學報,2020,36(2):193-200.

[33]張哲宇,孫果鎵,楊保軍,等. 基于機器視覺和深度學習的稻縱卷葉螟性誘智能監(jiān)測系統(tǒng)[J]. 昆蟲學報,2022,65(8):1045-1055.

[34]李云霞,馬浚誠,劉紅杰,等. 基于RGB圖像與深度學習的冬小麥田間長勢參數(shù)估算系統(tǒng)[J]. 農(nóng)業(yè)工程學報,2021,37(24):189-198.

[35]寧 川,趙慶展,韓 峰.基于機器視覺的無人機油菜長勢調(diào)查研究[J]. 農(nóng)機化研究,2020,42(1):265-268.

[36]溫長吉,婁 月,張笑然,等. 基于改進稠密膠囊網(wǎng)絡模型的植物識別方法[J]. 農(nóng)業(yè)工程學報,2020,36(8):143-155.

[37]林 楠,王 娜,李卓識,等. 基于機器視覺的野生食用菌特征提取識別研究[J]. 中國農(nóng)機化學報,2020,41(5):111-119.

[38]謝秋菊,吳夢茹,包 軍,等. 融合注意力機制的個體豬臉識別[J]. 農(nóng)業(yè)工程學報,2022,38(7):180-188.

[39]王少華,何東健,劉 冬.基于機器視覺的奶牛發(fā)情行為自動識別方法[J]. 農(nóng)業(yè)機械學報,2020,51(4):241-249.

[40]吳旭東,張 晗,羅 斌,等. 基于機器視覺的小麥種子活力檢測方法[J]. 江蘇農(nóng)業(yè)科學,2021,49(24):189-194.

[41]安曉飛,王 培,羅長海,等. 基于K-means聚類和分區(qū)尋優(yōu)的秸稈覆蓋率計算方法[J]. 農(nóng)業(yè)機械學報,2021,52(10):84-89.

[42]萬 龍,龐宇杰,張若宇,等. 機采籽棉收購環(huán)節(jié)含雜率快速檢測系統(tǒng)研制[J]. 農(nóng)業(yè)工程學報,2021,37(6):182-189.

[43]司永勝,安露露,劉 剛,等. 基于Kinect相機的豬體理想姿態(tài)檢測與體尺測量[J]. 農(nóng)業(yè)機械學報,2019,50(1):58-65.

[44]彭 文,蘭玉彬,岳學軍,等. 基于深度卷積神經(jīng)網(wǎng)絡的水稻田雜草識別研究[J]. 華南農(nóng)業(yè)大學學報,2020,41(6):75-81.

[45]張 樂,金 秀,傅雷揚,等. 基于Faster R-CNN深度網(wǎng)絡的油菜田間雜草識別方法[J]. 激光與光電子學進展,2020,57(2):304-312.

[46]胡志偉,楊 華,婁甜田,等. 基于全卷積網(wǎng)絡的生豬輪廓提取[J]. 華南農(nóng)業(yè)大學學報,2018,39(6):111-119.

[47]許真珠,黃 鶯. 基于無人機技術(shù)的水稻精準噴藥系統(tǒng)研究[J]. 農(nóng)機化研究,2019,41(2):238-241,247.

收稿日期:2022-09-30

基金項目:國家自然科學基金(編號:31960503)。

作者簡介:田鵬菲(1999—),女,山東聊城人,碩士研究生,主要從事農(nóng)業(yè)信息化研究。E-mail:1807588926@qq.com。

通信作者:王皞陽(1999—),男,甘肅天水人,碩士研究生,主要從事生物質(zhì)資源化利用研究。E-mail:2029278614@qq.com。