基于貝葉斯超參數優化的Gradient Boosting方法的導彈氣動特性預測

崔榕峰 馬海 郭承鵬 李鴻巖 劉哲

摘 要:在導彈設計與研發的初期階段,需要尋求高效且低成本的導彈氣動力特性的分析方法。然而,氣動性能分析過程中往往存在試驗成本高、周期長、局限性大等問題。因此,本文采用基于提升(Boosting)的機器學習集成算法進行導彈氣動特性預測,通過輸入導彈的氣動外形參數、馬赫數和迎角,對于導彈氣動力系數實現快速預測。結果表明,Boosting能夠對導彈氣動力系數進行精準高效預測。為進一步提升預測精度,與傳統的機器學習參數調整方法相比,采用貝葉斯優化方法對梯度提升(Gradient Boosting)算法超參數進行優化,調優后的Gradient Boosting方法預測的導彈氣動力系數與實際值吻合度得到提升,并將貝葉斯優化的Gradient Boosting方法與XGBoost、LightGBM、Adaboost方法進行了對比,貝葉斯優化的Gradient Boosting方法預測精度優于其他Boosting方法,證明了優化方法的可行性與有效性。

關鍵詞:導彈; 氣動特性; Boosting; Gradient Boosting; 貝葉斯優化

中圖分類號:V211.3 文獻標識碼:A DOI:10.19452/j.issn1007-5453.2023.07.003

在導彈氣動外形方案設計階段,氣動性能分析是重要的組成部分,通常會根據戰術指標要求提出若干總體布局方案,并對各種方案進行評估,同時還需要開展一些參數優化,以確定幾個優化方案。傳統的導彈氣動性能參數獲取主要通過飛行試驗方法、計算流體力學(CFD)方法和風洞試驗方法[1-2]。飛行試驗和風洞試驗都存在成本高、周期長、存在局限性等問題,所以在導彈設計的初步階段不適宜使用,而CFD方法不可避免地存在計算復雜、計算代價高等問題[3-5]。

近年來,基于機器學習方法預測分析導彈的氣動特性研究取得了一些突破性進展。文獻[6]提出了一種基于神經網絡的思維進化算法,該方法對于導彈氣動參數的預測具有明顯的優化效果。文獻[7]提出了一種基于自動核構造高斯過程,對某導彈氣動特性快速預測具有良好的性能。文獻[8]、[9]分別使用人工神經網絡和卷積神經網絡對導彈的氣動參數及氣動外形進行預測分析,試驗結果也驗證了其可行性。但目前提出的機器方法中,可能存在對于決策者的可解釋性較差、數據預處理過于復雜、預測結果過度擬和等問題。

本文采用一種基于提升(Boosting)方法中的梯度提升(Gradient Boosting)算法進行導彈氣動特性預測。近年來,Boosting方法作為機器學習中的一種集成方法被廣泛應用于解決不同的分類與回歸問題,并取得了突破性的進展[10]。在氣動特性分析方面,與傳統的物理試驗、數值仿真方法相比,Boosting方法因其快速且低損耗的預測優勢,能夠縮減分析的時間與經濟成本。同時,與其他機器學習方法相比,Boosting方法通過其決策樹的特性,從根本上減少了模型過擬合等問題。從時間復雜度上來看,建立決策樹需要的時間成本較低,與支持向量機或神經網絡等算法相比,Boosting算法在計算時間上更具有優勢[11]。

本文通過使用某模擬器軟件,將某導彈幾何外形與飛行條件參數作為輸入,并計算其對應的氣動力系數。應用基于回歸樹的Boosting方法來驗證模型方法對于導彈氣動力系數預測的可行性和有效性,并通過貝葉斯優化方法對于Boosting算法中的Gradient Boosting方法進行優化處理,并比較優化前后的效果。

1 Boosting方法

Boosting方法是一種基于集成學習的機器學習技術。集成學習算法是指通過一系列弱學習器組合成一個強學習器,從而可以達到最小化預測誤差的目的。Boosting方法則以基于決策樹的集成方法為核心,進行逐步增強的集成訓練,通過不斷建立新的決策樹糾正先前決策樹模型中存在的錯誤,直到精準預測訓練數據集或者添加的決策樹或回歸樹的數量達到了最大限度[11]。Boosting方法因描述和繪制決策樹相對容易,所以其可解釋性有助于決策者進行可視化和理解。除此之外,基于樹的集成方法可以處理不同類型和分布的預測變量,需要很少的數據預處理,并且可以擬合復雜的非線性關系。同時,如果數據出現多重共線性的特征,不需要對數據進行特征篩選從而減少變量之間的相關性[12],并且Boosting方法具有非參數特點,可以不假定數據遵循特定的分布,從而節約數據轉換為正態分布的時間成本。另外,Boosting方法對過擬合具有魯棒性,其應用存在高偏差的多個弱學習器,并將其組合成一個強學習器,所以從根本上減少了模型過擬合的問題[12]。

1.1 Gradient Boosting回歸樹方法

Gradient Boosting作為一種機器學習的算法,通過以弱學習模型不斷集合的形式產生最終的強學習模型。當弱學習模型是回歸樹時,其被稱為Gradient Boosting回歸樹方法。Gradient Boosting決策樹方法采用構建淺層樹,并且隨后生成的每一棵樹都在前一棵樹的基礎上學習和改進。雖然每組淺層樹的預測效果一般,但是通過每組淺層樹之間不斷的梯度增強,最終形成的基于多組淺層樹的組合會得出有效的預測結果[16]。

Gradient Boosting回歸樹算法主要分成三個步驟:(1)確定優化的損失函數并生成初始值;(2)建立單個回歸樹進行預測分析;(3)通過循環添加新的回歸樹以最小化損失函數,最終得出一個疊合模型[13]。具體步驟為:

(3)為了最終能獲得最優的模型性能,對第(2)步進行K次迭代,從而將K個回歸樹逐步添加到組合模型中[14]。

Gradient Boosting回歸樹算法因以回歸樹作為基礎估計器,具備了回歸樹的優點。首先,模型對于數據缺失值敏感度非常低,無須進行數據填補工作。其次,因其具有非參數化的特征,無須進行數據預處理的工作,如對于特征進行標準化或歸一化處理。最后,回歸樹可以非常靈活地處理不同函數分布的數據。同時,回歸樹也具有很明顯的缺點,其中最大的問題則是模型易出現過度擬合,而Gradient Boosting與回歸樹算法結合所產生的集成方法則解決了此類問題,這是因為Gradient Boosting回歸樹算法采用的都是復雜程度相對較低的回歸樹(弱學習器),所得到的結果方差較小,通過梯度提升生成的疊合模型很有效地解決了結果過擬合的問題[15]。

1.2 其他的Boosting方法

除Gradient Boosting回歸樹算法外,基于Boosting的集成方法的算法也在其他方向有所進展。其中自適應提升(Adaboost)作為一種迭代提升的集成方法,同時被廣泛應用。Adaboost與Gradient Boosting 的主要區別是基于不同的角度對上一輪迭代所產生的訓練錯誤進行調整。Adaboost是根據當前迭代中的實際結果調整權重,目的是在下一輪的模型訓練和學習中,給予訓練中產生的錯誤數據更多關注,所以算法需要不斷對數據重新加權得到最終的聚合權重[16]。

另外,作為基于Gradient Boosting的二次開發算法,極端梯度提升算法(XGBoost)和輕量級梯度提升機(LightGBM)同樣展示出了高效的性能。XGBoost在損失函數上進行了二階泰勒展開、引入了目標函數的正則項等一系列改進,在訓練速度和精度上都有很大的提升[17]。而LightGBM則采用更優的leaf-wise方法分裂葉子節點,與其他用于Boosting算法中的分裂算法depth-wise或level-wise進行比較,leaf-wise可以在損失函數上降低更多且運行速度更快[18]。

2 貝葉斯優化方法

在機器學習中,超參數優化可以使模型本身發揮出最佳的性能,所以對于機器學習算法進行超參數優化是必要的。然而,由于大量的超參數和復雜的模型,如集成方法或深度神經網絡方法,超參數優化在評估目標函數以找到最優解的過程中存在時間成本非常高的問題。到目前為止,網格搜索與隨機搜索常被用于解決超參數選取和優化的問題[19]。其中,網格搜索是指通過一組手動指定的超參數值進行的窮舉搜索法,也稱暴力搜索法;而隨機搜索舍棄了暴力搜索的方法,尋找網格空間來選取隨機的參數組合。然而,這些方法都無法保證能獲取到超參數的最優解且相對低效,通常會浪費大量時間評估比較差的超參數[20]。

與隨機搜索或網格搜索相比,貝葉斯方法則擁有跟蹤過去評估結果的特點,將超參數映射到目標函數形成一種概率模型,這種模型也被稱為目標函數的代理模型[21]。與目標函數相比,代理模型更容易進行優化。貝葉斯方法通過選擇在代理模型上表現出最佳的超參數,以此來評估實際目標函數,接下來不斷更新代理模型,得出新的超參數結果,再次評估目標函數,直到達到最大的迭代次數方才停止。貝葉斯方法的主要核心是通過在每次評估目標函數后不斷更新代理模型,使其獲取到的數據誤差最小化[22]。整體上來看,貝葉斯優化方法是有效的,其使用更多的時間在代理函數中選擇超參數,以減少對目標函數的調用,并且通過評估過去結果中性能更好的超參數,可以在更少的迭代中找到比隨機搜索和網格搜索更優的模型超參數設置。

綜上所述,假設F為目標函數,S為超參數的搜索范圍、 s為選擇的超參數組合、K為采集函數、P為代理模型,Data表示采樣的數據集、 j為最大迭代次數,貝葉斯優化的偽代碼流程可以表示為

3 試驗流程與結果分析

3.1 數據集生成

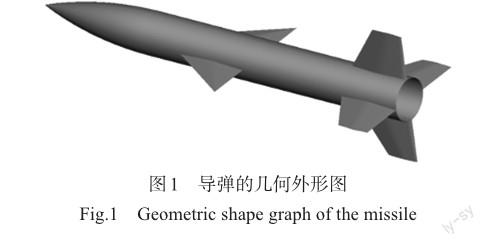

本文采用某軟件對于輸入的某導彈參數與氣動參數進行升力、阻力系數生成,生成的導彈幾何外形如圖1所示,本文涉及的導彈幾何參數有彈翼軸向位置、彈翼展長、彈翼根弦長、十字舵展長、十字舵根弦長、十字舵梢弦長,氣動參數有馬赫數、迎角。每種導彈參數在±10%的取值范圍內波動,并通過隨機生成的方式形成導彈參數數據。每組導彈幾何參數(共6個)在不同的來流工況 Ma = {0.5, 0.8, 1.2, 2.5, 3.5}、α = {0, 4.0, 8.0, 12.0, 16.0, 20.0, 24.0, 28.0} 組合下,共生成40個對應的氣動力系數。本文如上所述共產生185組不同的導彈幾何構型,共生成7400個氣動力系數。

3.2 試驗流程介紹

本文的試驗流程主要分為兩個部分:第一部分為論證Boosting方法對于導彈氣動力系數預測的可行性和有效性,其中涉及的Boosting方法有:Gradient Boosting、XGBoost、LightGBM和Adaboost方法。第二部分是對Gradient Boosting方法進行貝葉斯優化,比較優化前后的精準度與擬和度的差異變化。試驗使用交叉檢驗方法將部分訓練集作為檢驗集進行結果驗證,訓練集與測試集的比例為8∶2。本文提出的Boosting和貝葉斯優化算法均基于Python 3.10開發環境開展,其中Gradient Boosting和Adaboost方法使用的是sklearn工具包,XGBoost和LightGBM分別使用的是xgboost和lightgbm工具包。

在貝葉斯優化中,對XGBoost和LightGBM進行初步優化測試,其效果并不理想,優化后的結果的精準度無法超過其默認設置。而Adaboost方法本身參數很少,優化方法并不適用,最終選擇Gradient Boosting方法進行貝葉斯優化。優化下的Gradient Boosting參數選取中,本次試驗選擇了learning_rate、n_estimators、min_samples_split和max_depth共4種參數。其中,learning_rate表示學習率,其控制著每個回歸樹的貢獻度,本次試驗學習率的取值范圍為0.1~1;n_estimators表示最終聚合模型的回歸樹數量,本次試驗學習率的取值范圍為50~500;min_samples_split表示拆分每個回歸樹中內部節點所需的最小樣本數,本次試驗設計的取值范圍為2~5;max_depth表示每個回歸樹的最大深度,其控制著樹中的節點數,本次試驗設計的取值范圍為1~5。試驗共進行100次迭代,通過貝葉斯優化算法選取出在取值范圍內最優的超參數組合。

3.3 試驗結果分析

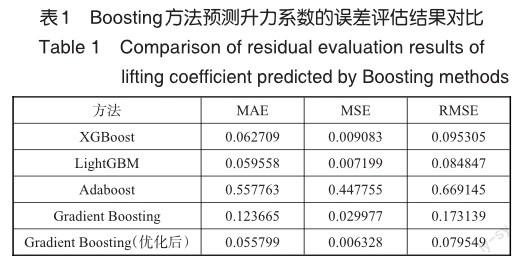

從表1中Boosting方法預測升力系數的比較結果可知,如果暫時不計入Gradient Boosting優化后的結果,XGBoost和LightGBM的預測結果精準度良好,其次是Gradient Boosting,其精準度的結果與前兩者相比略顯下降,最后是Adaboost,與其他三種方法相比,其各項指標有所不足。總體來看,在Gradient Boosting方法優化前,XGBoost與LightGBM對于導彈升力系數的預測效果顯著。

通過對Gradient Boosting進行貝葉斯優化,最終優化選取的參數組合為(learning_rate = 0.19838,max_depth = 4,n_estimators = 499,min_samples_split = 4)。從表1中結果來看,Gradient Boosting模型方法與優化前相比,在精準度上有所提高,這說明貝葉斯優化方法對于Gradient Boosting的性能提升有所幫助。同時通過對比發現,優化后的Gradient Boosting在精準度上均優于其他Boosting方法,可見其優化效果是可觀的。

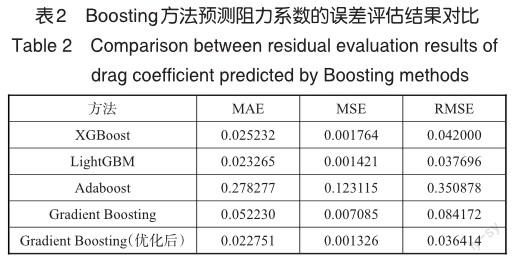

從表2中Boosting方法預測阻力系數的比較結果能夠得出與表1中相同的結論。對于阻力系數,貝葉斯優化下的Gradient Boosting最終選取的參數組合為(learning_rate= 0.09276,max_depth=4,n_estimators=475,min_samples_split =3),Gradient Boosting采用優化得出的超參數組合后,與其他Boosting方法相比,對阻力系數的預測在精準度方面展現出了最佳的性能。最后,通過對表1和表2進行比較得出,Boosting方法對于阻力系數預測結果的精準度與其升力系數相比,阻力系數的精準度結果略好一些。

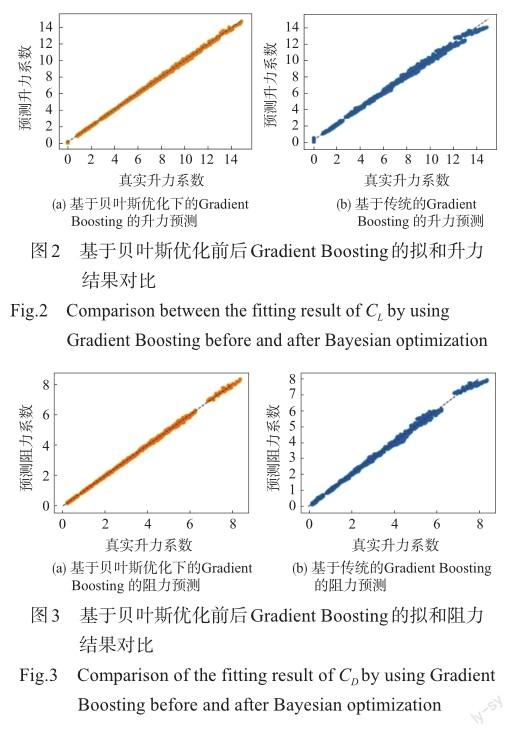

圖2與圖3分別展示出了Gradient Boosting優化前后對于升力和阻力系數的預測擬和結果,圖中黑色虛線代表的是對角線,越靠近對角線的點,說明擬和程度越好。從圖2中能夠得出,無論是升力還是阻力系數分析,均可以觀察到模型優化后擬和度有所提升。這可以說明貝葉斯優化方法對于Gradient Boosting方法的優化效果是顯著的。

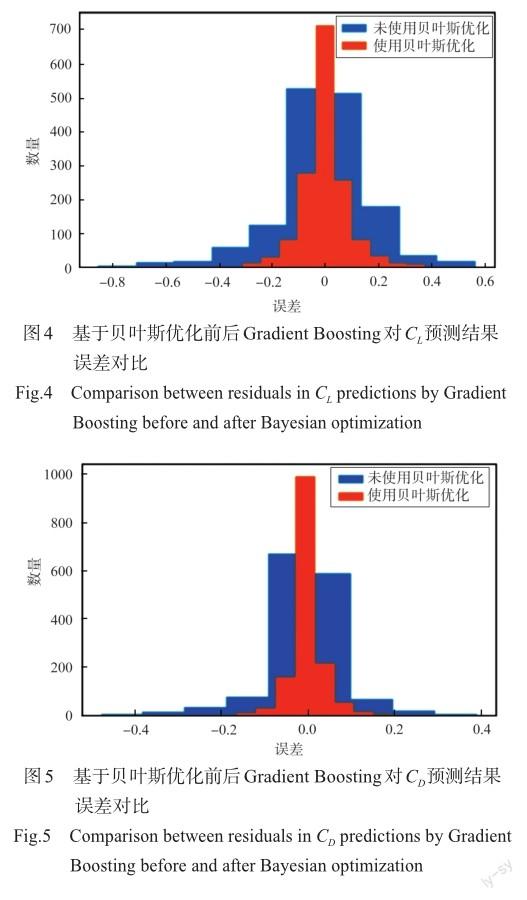

圖4和圖5分別展示了在貝葉斯優化方法前后,Gradient Boosting方法對于升力系數CL和阻力系數CD的預測結果的誤差直方圖,從圖中可以看出,無論是對于CL還是CD,貝葉斯優化與Gradient Boosting方法結合后使誤差的范圍明顯縮小,其誤差結果更加趨近于零。另外,通過觀察優化前后的誤差分布情況,貝葉斯優化前后的誤差都近似于正態分布,這說明貝葉斯優化與Gradient Boosting方法對于CL與CD的預測結果是有效的。

4 結論

針對風洞試驗方法和CFD方法對于導彈的氣動力特性分析存在很多局限性問題,本文采用基于機器學習中多種Boosting集成學習算法與貝葉斯優化方法對導彈氣動數據進行預測分析,得到的結論如下:

(1)通過比較Boosting方法中Gradient Boosting、XGBoost、LightGBM和Adaboost方法,試驗結果表明XGBoost和LightGBM有著良好的準確度。同時, Gradient Boosting在未優化前的性能雖略差于前兩者,但也表現出了較高的精準度和擬和程度。

(2)基于貝葉斯優化下的Gradient Boosting方法與其他Boosting方法相比,可以得出采用貝葉斯優化的Gradient Boosting方法表現出了最佳的性能,不僅在精準度上達到最優,而且擬合度也發生顯著的提升。這說明貝葉斯優化方法對于模型性能的提升是有效的。

(3)目前數據集中考慮到的幾何參數有限,后續計劃增加構型的數量進一步增加樣本總量與樣本維度,探究Gradient Boosting貝葉斯優化算法的極限適用范圍,并進行貝葉斯優化算法中高斯過程的算法改進,從而提升預測的精準度。

參考文獻

[1]Sun J, Cummings R M. Evaluation of missile aerodynamic characteristics using rapid prediction techniques[J]. Journal of Spacecraft and Rockets, 1984, 21(6): 513-520.

[2]呂國鑫.飛航導彈氣動設計[M].北京:中國宇航出版社,1989. Lyu Guoxin. Aerodynamic design of cruise missile [M]. Beijing: China Aerospace Press, 1989.(in Chinese)

[3]Yue Chunguo, Chang Xinlong, Zhang Youhong, et al. Numerical calculation of a missile’s aerodynamic characteristic[J]. Advanced Materials Research, 2011, 186: 220-224.

[4]Zhang Jian, Yang Lin, Zhang Wei, et al. Numerical simulation and experimental study for aerodynamic characteristics and powder transport behavior of novel nozzle[J]. Optics and Lasers in Engineering, 2020, 126: 105873.

[5]丘淦興. 利用飛行試驗數據校驗導彈氣動參數[J]. 航天控制,1997(2) : 1-5. Qiu Ganxing. Verification of aerodynamic parameters of missile using flight test data [J]. Aerospace Control, 1997(2) : 1-5. (in Chinese)

[6]原智杰,張公平,崔茅,等.基于神經網絡的導彈氣動參數預測[J].航空兵器,2020,27(5):28-32. Yuan Zhijie, Zhang Gongping, Cui Mao, et al. Prediction of missile aerodynamic parameters based on neural network [J]. Aviation Weapons, 2020, 27 (5): 28-32.(in Chinese)

[7]胡偉杰,黃增輝,劉學軍,等.基于自動核構造高斯過程的導彈氣動性能預測[J].航空學報,2021,42(4):289-302. Hu Weijie, Huang Zenghui, Liu Xuejun, et al. Prediction of aerodynamic performance of missiles based on automatic kernel construction Gaussian process [J]. Journal of Aeronautics, 2021,42(4): 289-302. (in Chinese)

[8]Balla K, Sevilla R, Hassan O, et al. An application of neural networks to the prediction of aerodynamic coefficients of aerofoils and wings[J]. Applied Mathematical Modelling, 2021, 96: 456-479.

[9]Zan Bowen, Han Zhonghua, Xu Chenzhou, et al. Highdimensional aerodynamic data modeling using machine learning method based on convolutional neural network [J]. Advances in Aerodynamics, 2022, 4(1): 1-31.

[10]Duffy N, Helmbold D. Boosting methods for regression[J]. Machine Learning, 2002, 47: 153-200.

[11]Elith J, Leathwick J, Hastie T. A working guide. to boosted regression trees[J]. Journal of Animal Ecology, 2008, 77(4): 802-813.

[12]Zhang Y, Haghani A. A gradient boosting method to improve travel time prediction[J]. Transportation Research Part C: Emerging Technologies, 2015, 58: 308-324.

[13]Bentéjac C, Cs?rg? A, Martínez-Mu?oz G. A comparative analysis of gradient boosting algorithms[J]. Artificial Intelligence Review, 2021, 54(3): 1937-1967.

[14]Natekin A, Knoll A. Gradient boosting machines, a tutorial[J]. Frontiers in Neurorobotics, 2013, 7: 21.

[15]Bentéjac C, Cs?rg? A, Martínez-Mu?oz G. A comparative anal‐ysis of gradient boosting algorithms[J]. Artificial Intelligence Review, 2021, 54: 1937-1967.

[16]Schapire R E. Explaining adaboost[M]. Berlin: Springer, 2013.

[17]Chen T, Guestrin C. Xgboost: A scalable tree boosting system[C]//Proceedings of the 22nd Acmsigkdd International Confer‐ence on Knowledge Discovery and Data Mining, 2016: 785-794.

[18]Ke G, Meng Q, Finley T, et al. Lightgbm: A highly efficient gradient boosting decision tree[J]. Advances in Neural Information Processing Systems, 2017, 30: 1-3.

[19]Buslim N, Rahmatullah I L, Setyawan B A, et al. Comparing Bitcoin’s prediction model using GRU, RNN, and LSTM by hyperparameter optimization grid search and random search[C].9th International Conference on Cyber and IT Service Management (CITSM), 2021: 1-6.

[20]Victoria A H, Maragatham G. Automatic tuning of hyperparameters using Bayesian optimization[J]. Evolving Systems, 2021, 12(1): 217-223.

[21]Snoek J, Larochelle H, Adams R P. Practical bayesian optimization of machine learning algorithms[J]. Advances in Neural Information Processing Systems, 2012, 25: 1-3.

[22]Pelikan M, Goldberg D E, Cantú-Paz E. BOA: The Bayesian optimization algorithm[C]//Proceedings of the Genetic and Evolutionary Computation Conference,1999.

[23]Ozaki Y, Tanigaki Y, Watanabe S, et al. Multiobjective treestructured parzen estimator for computationally expensive optimization problems[C]//Proceedings of the 2020 Genetic and Evolutionary Computation Conference, 2020: 533-541.

[24]Nguyen H P, Liu J, Zio E. A long-term prediction approach based on long short-term memory neural networks with automatic parameter optimization by Tree-structured Parzen Estimator and applied to time-series data of NPP steam generators[J]. Applied Soft Computing, 2020, 89: 106116.

Prediction of Missile Aerodynamic Data Based on Gradient Boosting under Bayesian Hyperparametric Optimization

Cui Rongfeng, Ma Hai, Guo Chengpeng, Li Hongyan, Liu Zhe

Aviation Key Laboratory of Science and Technology on Aerodynamics of High Speed and High Reynolds Number,AVIC Aerodynamics Research Institute, Shenyang 110034, China

Abstract: In the initial stage of missile design, the aerodynamic characteristics of missiles need to be quickly and preliminarily evaluated. When analyzing the aerodynamic performance of missiles, the traditional engineering method has the problem of high experiment costs and the long experiment period. Meanwhile, the CFD method is also difficult to calculate due to its complex calculation process, and the calculation cost is high. Therefore, this paper applys the method of missile aerodynamic data prediction based on several Boosting methods in machine learning. By inputting aerodynamic shape, mach number, and angle of attack data of the missile, the lift coefficient and drag coefficient are quickly predicted. The result shows that Boosting method can predict the aerodynamic coefficients of missiles accurately. In order to further improve the prediction accuracy, compared with other traditional hyperatameter selection methods, Bayesian Hyperparameter Optimization method as an automatic hyperatameter selection method is used to optimize the parameters of the Gradient Boosting algorithm, and it turns out that the predicted value is much closer to the actual value. Finally, the Gradient Boosting method under Bayesian Optimization is compared with XGBoost, LightGBM and Adaboost methods, and the Gradient Boosting method under Bayesian Optimization is more accurate than other Boosting methods, which proves the feasibility and effectiveness.

Key Words: missiles; aerodynamic characteristics; Boosting; Gradient Boosting; Bayesian optimization