中國大模型,什么水平?

榮智慧

半年多以前,ChatGPT橫空出世,熱錢奔涌。如今,當時的押注迎來了第一批收獲。

8月的最后一天,中國多家人工智能大語言模型拿到許可備案,包括百度的文心一言、抖音的云雀、智譜AI的智譜清言、中科院的紫東太初等。此前,這些大模型一直處于內測階段,即使下載應用也沒法注冊使用;備案后,它們真正面向社會開放,經受用戶的花樣考驗。

同一天,阿聯酋人工智能公司G42推出了Jais大模型,以阿拉伯語和英語數據為基礎,供全球4億多名操阿拉伯語者使用。Jais名字源自阿聯酋海拔最高的山峰。G42的投資伙伴包括阿布扎比國家石油公司、財富基金穆巴達拉和阿提哈德航空公司。

全球各個語言文化圈,都為“自己的”大語言模型苦心經營。

更不消說大模型的發源地—硅谷,Meta正在憋一個據說足以挑戰ChatGPT的“大招”、比LLAMA-2還“強大幾倍”;蘋果每個月在人工智能研發上砸下數百萬美元;谷歌和微軟各自為旗下“王牌”Anthropic和OpenAI招兵買馬。

大模型之戰,呈現出國家、地區以及內部競爭的火熱局面—畢竟肩負著帶領全球經濟走出低迷的浪漫期待。因此,它是什么,如何運作,以及怎樣變現,成為人們最關心的問題。

“注意力是必需”

人工智能時代,本質是大模型時代。

大模型,也叫大語言模型(Large Language Model,LLM)、多模態模型(multimodal model)。最火爆的GPT,是大模型的一種形態,G代表生成性的(generative),P代表預訓練(pre-trained),T代表變換器(transformer)。

大模型的“大”,是指模型參數至少達到1億以上。像GPT-3的參數規模是1750億。大模型之外,還有“超大模型”,通常擁有數萬億到數千萬億參數。大模型和超大模型的主要區別,就在于模型參數數量的多寡、計算資源的需求和性能表現。

如今絕大多數大模型,都算得上“超大模型”,比如1.6萬億參數的谷歌switch transformer,1.9萬億參數的快手推薦精排模型,1萬億參數的阿里達摩院M6等等。

因為參數規模膨脹得比較厲害,“超大模型”都不大有人叫了,一律都用“大模型”概括。

模型,通常是一個函數或者一組函數,以線性函數、非線性函數、決策樹、神經網絡等各種形式呈現。模型的實質,就是對這個/組函數映射的描述和抽象。訓練和優化各種模型,就能夠得到更加準確和有效的函數映射。模型的目的,是為了從數據中找出一些規律和模式,好預測未來。

而且參數越多,模型就越“高端”,就可以處理更豐富的信息,具備更高的準確性。大模型一般用來解決自然語言處理、電腦視覺和語音辨識等復雜任務。

大模型是人工智能領域“聯結學派”的“勝利”。

七十年來,人工智能研究者大概分為三個派別:符號學派、聯結學派和行為學派。符號學派,也叫邏輯主義學派,主張通過電腦符號操作來類比人的認知過程和大腦抽象邏輯思維。聯結學派,又稱仿生學派,強調對人類大腦的直接類比,認為神經網絡間的連接機制與學習方法能夠產生人工智能。聯結學派日后的技術突破最大,神經網絡、深度學習都來自這一派。行為學派的思想理論源自進化論和控制論。它的目標在于預見和控制行為。

一直到20世紀80年代,符號學派都占主流。聯結學派自1986年以來,在機器學習、深度學習領域,綜合應用了心理學、生物學、神經生物學、數學、自動化和計算機科學理論,取得較大進展。

特別是2017年6月,谷歌團隊的瓦斯瓦尼等人發表論文《注意力是必需》(“Attention Is All You Need”),系統提出了Transformer的原理、構建和大模型演算法,將預訓練模型推而廣之。

Transformer一舉擊敗了卷積神經網絡、遞歸神經網絡,成為最受歡迎的神經網絡架構,主要優勢就是“注意力機制”。

自此,Transformer一舉擊敗了卷積神經網絡、遞歸神經網絡,成為最受歡迎的神經網絡架構,主要優勢就是“注意力機制”。

簡單而言,就是它知道該把注意力放在哪里—通過“理解”上下文,Transformer會準確預測“重點”,從而做出判斷:輸入的序列再長、相關信息隔得再遠,都沒有關系。

淘金先要有“鏟子”

大模型再神奇,也建立在“過硬的”硬件基礎之上。

先不要爭論OpenAI的ChatGPT是不是最火爆,或者Midjourney、Anthropic的Claude更有人緣,賣芯片的英偉達才是最大贏家—別人淘金時,他靠賣鏟子暴富。

根據第二季度財報,英偉達該季度收入67.0億美元,凈收入飆升至6.56億美元。在ChatGPT帶來的人工智能熱潮之前,英偉達靠賣礦卡—“挖”比特幣的高性能GPU而聞名;再之前,它是PC游戲玩家的心頭好。

東風壓倒西風。現在人人都說,沒有英偉達,就沒有ChatGPT。財報顯示,英偉達人工智能硬件部門的收入達到了創紀錄的10億美元—超過總銷售額的3/4,遠超加密幣和游戲的收入。

英偉達最炙手可熱的旗艦產品,是GPUH100,人稱“世界上第一塊為生成型AI設計的芯片”。只要想在人工智能、大模型的餡餅上切一塊的人,都得盡可能多地囤貨。假如買不到供不應求的H100,它的前身A100也行。

最惹眼的客戶是微軟,其花費數億美元為OpenAI購買了上千塊A100芯片。2019年,微軟投資了OpenAI,投資協議就包含了“買芯片”的內容。正是由于這項投資,以及英偉達的硬件,OpenAI才能夠打造舉世矚目的ChatGPT。

所以,每塊售價4萬美元的籌碼必須“先下手為強”:沙特阿拉伯已經購買了3000塊H100芯片,阿聯酋也買了數千塊。兩個海灣國家的領導人表態,他們的目標是在人工智能領域取得領導地位,以推動雄心勃勃的經濟發展計劃。

誰不是呢?中國的科技巨頭,包括騰訊和阿里巴巴,也在尋求購買英偉達高性能芯片的機會。

據悉,英偉達現在已經占據高達95%的人工智能GPU市場。

不過,縱觀芯片發展史,一直坐在寶座的王者不多。AMD和英特爾等芯片巨頭,已投入數十億美元開發自己的機器學習處理器。谷歌和亞馬遜也不甘人后。就算是買得多的微軟,也不想命脈系于人手,正創建一個內部AI芯片項目。

這些競爭對手都看到了英偉達“落后”的產能:去年9月才發布的H100,2024年就會售罄。英偉達計劃將其產量增加兩倍,近日又推出了名為TensorRTLLM的新型開源軟件,預計將令H100的性能翻倍,更快運行大模型。

B端變現路漫漫

由于高性能GPU芯片短缺,采購受限,以及中文數據庫質量參差不齊,中國今年發布的100多個大模型,普遍與ChatGPT存在差距。

優質大模型開源已久,Meta的LLAMA-2近日又宣布開源,導致整個行業的技術門檻不高,且逐漸降低。

客觀來看,中國在大模型開發方面,起步比美國晚,研制大模型的單位和企業比美國多,但數量不能代表質量和研發水平。一些模型的參數量已經超過1萬億,高于GPT-4,而同臺評測的數據和報道,一般都顯示出了它們肉眼可見的能力差異。

當然,評價大模型也需要多維度的標準。中國企業在獲得中文語料和對中國文化的理解方面比外國企業有天然的優勢,中國制造業門類最全,具有面向實體產業訓練產業大模型的有利條件。

從技術上看,中國企業做企業級的大模型已經相對容易;從應用上看,在商業化上推陳出新,路徑尚不清晰。

先行一步、面向C端(個體消費者)的ChatGPT,正在開啟商業化模式。OpenAI宣布,預計在未來12個月內通過銷售人工智能軟件及其計算能力,將獲得超過10億美元的收入。

微軟聯合OpenAI發布的企業級Azure OpenAI GPT-4云服務,擁有11000名客戶。今年以來,微軟智能云收入超過了1100億美元,其中Azure占比首次超過50%。

相較于頭部的OpenAI的良好前景,到目前為止,市場還沒有觀察到中國企業級大模型明顯的營收增長。即便是360公司獲得近2000萬元,也屬于軟件會員費用和企業安全云的SaaS服務。其他發布大模型的公司,也沒有單獨披露大模型技術所帶來的收入數據。

從技術上看,中國企業做企業級的大模型已經相對容易;從應用上看,在商業化上推陳出新,路徑尚不清晰。

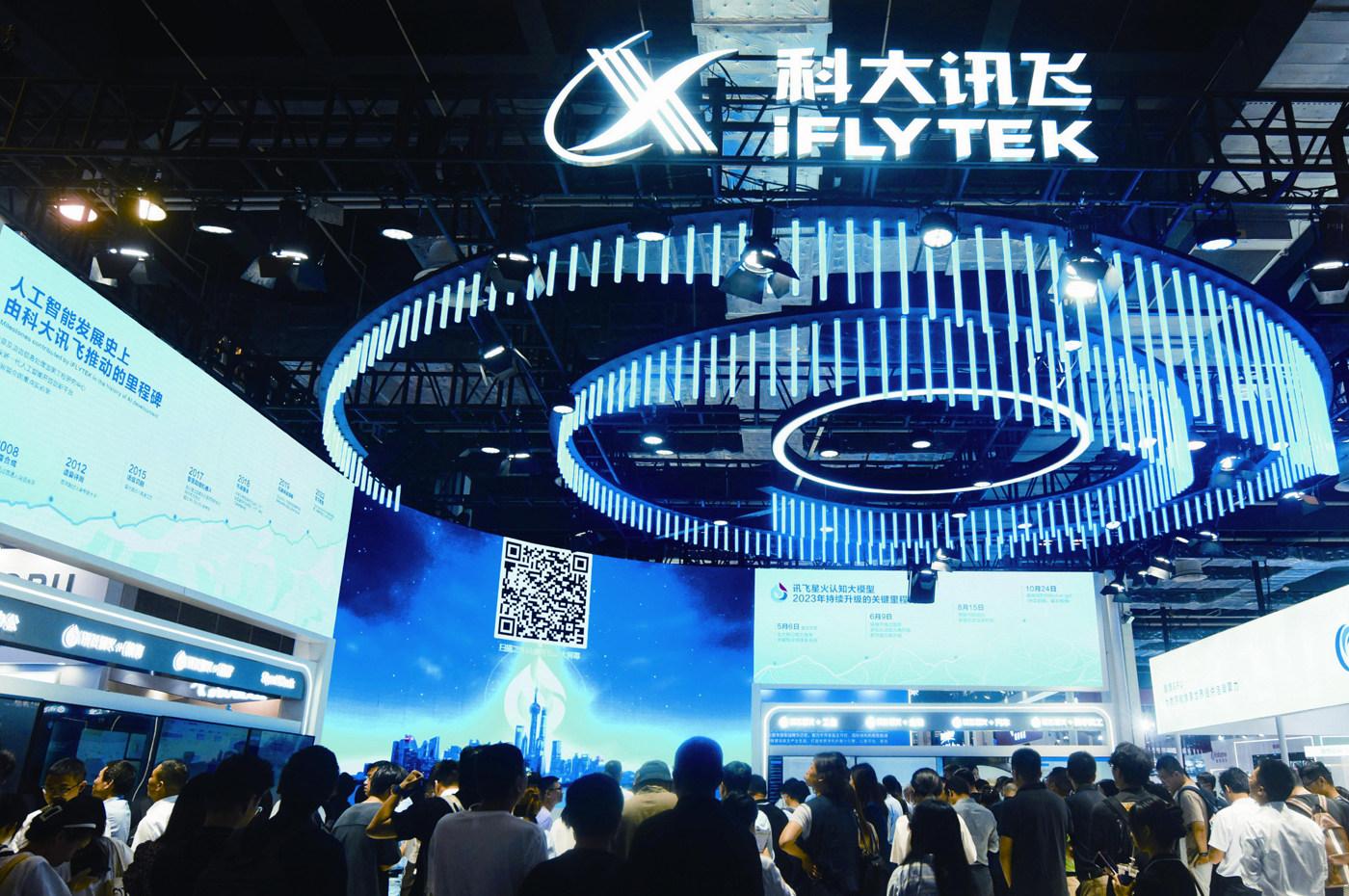

商業價值的增加則有正向反饋。科大訊飛半年報顯示,自訊飛星火大模型發布并完成首次升級以來,5月至6月,公司AI學習機的GMV(商品交易總額)分別同比增長136%、217%;訊飛AI硬件(AI學習、AI辦公、AI健康)在“618”期間銷售額同比增長125%。

此外,大模型也可以為內部賦能,提升整條產品鏈的商業價值。據訊飛星火介紹,其一開始就確認了“1+N”的體系。“1”就是通用的基礎認知大模型,“N”就是訊飛星火在教育、辦公、汽車、人機交互、醫療等領域進行應用落地。截至2023年8月15日,訊飛星火已經在訊飛AI學習機、訊飛智能辦公本、訊飛聽見APP、星火語伴APP、iFLYCode等C端軟硬件及教育、醫療、工業、辦公、汽車等B端業務賽道落地應用。

B端(企業用戶)大模型賽道,比C端更具吸引力。

6月20日、9月1日,兩批境內深度合成服務算法備案清單公布,其中包括360智腦文本生成算法、網易有道機器翻譯算法、快手生成合成算法、天工大語言模型算法、愛奇藝生成合成算法、云雀大模型算法、華為云盤古多模態大模型算法等。

2023全球數字經濟大會人工智能高峰論壇上,周鴻祎表示,大模型真正的機會在企業級市場,中國做大模型,最應該抓住產業發展的機會。但目前的公有大模型用在政府、城市、行業等企業級場景時,存在四點不足,包括缺乏行業深度、數據安全隱患、無法保障內容可信、訓練和部署成本過高等。

當下B端大模型商業模式,可以分為三種:出售大模型API(應用程序接口),向公司或開發者按照調用次數收費;直接賣大模型開發服務,向傳統企業輸出大模型行業解決方案;使用大模型改造現有業務,提高產品的競爭力,獲得更多商業回報,即Model-As-AService(MaaS),模型即服務。

在人工智能領域,復制比亞迪趕超特斯拉的經驗也并非不可能。

中國工程院院士鄔賀銓就表示,基于訓練ChatGPT的原理,利用行業與企業的知識圖譜進行深度訓練,有可能開發出企業專用的大模型。

他說,在ChatGPT出現之前,有人認為中國在AI方面的論文與專利數與美國不相上下,ChatGPT的上線使我們看到了中美的差距。現在需要清楚認識和重視我們面對的挑戰,做實實在在的創新,將挑戰化為機遇,在新一輪的AI賽道上做出中國的貢獻。