基于CT 影像組學和深度學習的硅肺病影像分期預測研究

楊柳瓊,李穎,鄭建軍

塵肺病是勞動者在職業活動中長期吸入不同致病性的生產性粉塵,并在肺內潴留而引起的以肺組織彌漫性纖維化為主的一種全身性疾病[1],其中硅肺病是我國發病率最高、危害性最強的病種[2]。硅肺病的影像分期是目前主要的病情評估指標[3],而分期診斷過程耗時費力、可重復性差,且由于胸片固有缺陷及診斷醫師主觀性的限制導致最后判別結果一致性差、誤診率高[4-5]。影像組學及深度學習方法作為醫學影像分析的新手段可以挖掘到肉眼觀察不到的深層次信息來進行分類和預測,進而無創、全面地評估疾病[6-7]。本研究探討和比較基于CT 影像組學及深度學習方法構建的多分類模型對于硅肺病影像分期的預測能力,現報道如下。

1 資料與方法

1.1 一般資料 回顧性收集2016 年1 月至2020 年12 月寧波市第二醫院經職業病診斷且具有明確硅塵接觸史的245 例患者的基本臨床資料、分期結果及CT 影像資料。納入標準:(1)有明確的硅塵接觸史;(2)在X 線檢查前/后1 個月內接受CT 檢查;(3)有明確的依據GBZ70-2015《職業性塵肺病的診斷》[3]的專家小組鑒定的分期結果。排除標準:(1)除硅肺病外其他類型的塵肺病;(2)CT 圖像質量不能滿足診斷要求;(3)合并其他病變,如肺感染性疾病、肺結核等。最終共納入0 期(無矽肺)104 例,Ⅰ期矽肺病77 例,Ⅱ期矽肺病30 例,Ⅲ期矽肺病24 例。本研究經寧波市第二醫院醫學倫理委員會批準。

1.2 CT 掃描方法 采用Siemens Somatom Definition Flash 及AS 64 排螺旋CT 機行胸部CT 掃描。掃描參數:管電壓120 kV,自適應電流,視野342 mm×267 mm,采集矩陣512×512,軸向圖像層厚5 mm,層間距5 mm,以2 mm層厚重建成像,用此薄層圖像重構MIP圖像,投影厚度為10 mm,無間隔成像。

1.3 影像組學分析方法

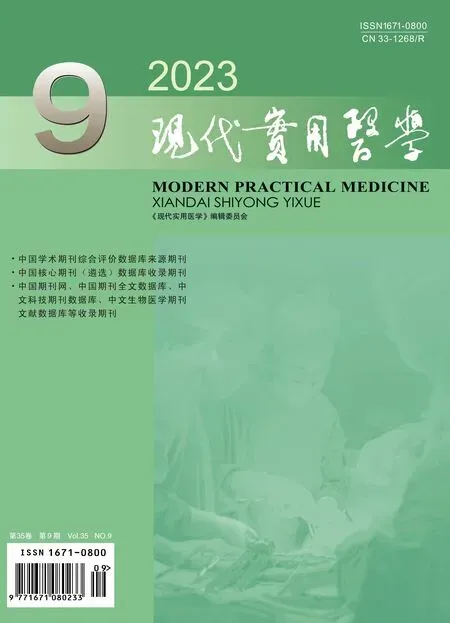

1.3.1 圖像分割與特征提取 將MIP 重建圖像重采樣至1 mm×1 mm×1 mm 的體素大小,導入3Dslicer 軟件(version 4.11.0),先由1 名有豐富經驗的放射科醫師在對分期結果不知情的情況下進行半自動圖像分割,具體分割步驟:基于分水嶺方法自動勾勒肺區域的邊緣并選中,將葉以上支氣管及血管排除在外以減少干擾,然后根據正常肺實質的CT 值閾值(-∞~-750 HU)減去正常肺組織區域,最后得到病灶加肺紋理區域,見圖1。逐層進行勾畫得到VOI,之后由另1 名醫師對其分割結果進行審核以提高準確性。使用Artificial Intelligence Kit(V3.3.0.R,GE Healtheare)軟件對VOI 進行特征提取,計算后得到一階特征、形態學特征及紋理特征共107 個影像組學特征。

圖1 ROI 勾畫示意圖

1.3.2 特征篩選與影像組學建模 對影像組學特征進行歸一化和標準化處理,按照7∶3 的比例隨機分為訓練組和驗證組。依次采用相關性分析及梯度提升迭代決策樹(GBDT)算法篩選出最有效的特征組合。基于這些特征采用支持向量機(SVM)進行機器學習,采用5 折交叉驗證法訓練模型,并計算它們在驗證集中的分類準確性。

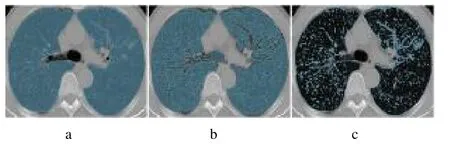

1.4 深度學習分析方法(1)數據預處理:為了減少人工勾畫主觀性帶來的差異,本研究使用全肺區域CT圖像來訓練深度學習模型,將三維的掩膜數據以切片的形式保存為分辨率512×512 大小的JPG 格式,從而將三維數據轉換成二維圖像,通過縮放、隨機剪裁等數據增強方法來增加模型對于不同數據分布條件下的適應能力。(2)深度學習模型建立:在Ubuntu 系統下采用pytorch 1.04 深度學習庫建模。按照4∶1 的比例隨機分為訓練組和驗證組。選擇Hao 等[8]發表的不確定性導向的圖注意網絡(UGGAT)方法,這種方法不僅繞過對大規模標注數據集的要求,避免三維網絡由于高維體輸入而導致的過擬合缺陷,而且利用不同切片之間的空間關系。整個方法由特征提取器和CT 圖像分類器組成,分為兩個階段分別進行訓練,見圖2。所有試驗均在單卡GTX 2080 Ti 下進行。

圖2 UG-GAT 方法流程圖

1.5 統計方法 采用R3.5.1 軟件和Python3.5.6 軟件進行分析,計數資料采用Fisher's 精確檢驗,符合正態分布的計量資料以均數±標準差表示,采用單因素方差分析。在訓練組和驗證組分別繪制受試者工作特征曲線(ROC),計算曲線下面積(AUC),同時使用準確度、敏感度、特異度等指標來檢驗模型的預測效能。P <0.05 表示差異有統計學意義。

2 結果

2.1 一般資料 本研究共納入245 例患者,不同期別硅肺病患者性別、年齡和工齡差異均無統計學意義(P >0.05),見表1。

表1 一般資料情況

2.2 影像組學分析 篩選出7 個影像組學特征分別為偏度、伸長率、球度、為依賴熵、集群趨勢、聯合能量和強度,基于上述7 個特征建立的影像組學模型效能見表2。

表2 影像組學模型在訓練組和驗證組中鑒別各期硅肺病的診斷效能

2.3 深度學習模型的效能 基于UG-GAT 網絡訓練的硅肺病分期預測模型對0 ~Ⅲ期硅肺病分類的AUC、準確率、敏感度、特異度均高于影像組學模型,見表3。

表3 深度學習模型在訓練組和驗證組中鑒別各期硅肺病的診斷效能

3 討論

按照目前的診斷標準[3],高千伏胸片仍是硅肺病分期的主要依據,但其由于密度分辨率低、組織重疊等原因不能清楚顯示病灶,而CT 圖像克服了這些局限[9],在臨床實際工作中參考CT 圖像已經成為醫師對硅肺病進行影像分期診斷時不可或缺的重要環節[10]。我國有學者嘗試參照診斷標準探討CT 圖像的小陰影密集度判定方法并進行診斷分期[11],結果顯示CT 和高千伏胸片對硅肺病分期診斷結果無明顯差異,但兩者對小陰影總體密集度的判斷符合率低(59.05%),同樣,該方法存在過程繁瑣且嚴重依賴于診斷醫師的主觀視覺及診斷經驗等問題。

人工智能在醫學影像領域的蓬勃發展為臨床提供了一種新的分析思路,目前也已經有一些研究基于X 線胸片訓練深度學習模型用于硅肺病篩查與分期[12-14],這表明了計算機系統輔助診斷硅肺病有助于提高診斷效率和準確性,具有重要的應用價值。但既往的研究重點都集中于分析胸片和篩查硅肺病方面,為了克服現有方法的不足,筆者對人工智能技術應用于基于CT 圖像的硅肺病影像分期診斷進行探索性研究,使用影像組學和深度學習方法分析學習硅肺病CT 圖像特征。本文結果顯示兩種模型在訓練集和驗證集均表現良好,能夠較準確地鑒別0 期及各期硅肺病,可以為診斷提供一些基于圖像衍生的用于硅肺病分期的放射學標志物。

本研究利用同一批數據,分別建立了基于CT圖像的傳統影像組學模型和深度學習模型,評估其對于不同期別矽肺病的分類預測能力。本研究結果表明CT影像組學分析可以較準確地預測硅肺病分期,且深度學習技術可以進一步提高診斷的準確性,這可能與深度學習避免了人工提取特征這一過程有關,深度學習方法利用圖像塊進行特征提取,避免了分割病灶這一過程,在一定程度上降低了人為因素導致的誤差[15]。另外深度學習技術可以獲得更高層次及更豐富的特征,并能保留圖像的全局信息,也可能進一步提高預測性能。

本研究的局限性:(1)為單中心研究,缺乏外部驗證;(2)由人工手動分割圖像,存在一定的主觀影響;(3)缺乏更多的臨床信息。

利益沖突所有作者聲明無利益沖突