基于改進YOLOv8的復雜環境行人檢測算法研究

摘 要:復雜場景下行人檢測的準確性和魯棒性面臨極大挑戰,本文提出了一種改進YOLOv8的行人檢測算法,以提高檢測質量。首先,本文將重參數化網絡UniRepLKNet代替原YOLOv8s模型的骨干網絡,將其用于行人特征提取。該網絡不僅增大了感受野,而且避免了小尺寸核大量地堆疊使用。其次,將Focal-Modulation模塊替代原SPPF模塊,該模塊利用焦點調制機制聚焦行人圖像中的關鍵特征區域。最后,引入形態交并比損失Shape-IoU來提高邊界回歸準確性。在RTTS和WiderPerson數據集上進行試驗,結果顯示,與原YOLOv8s模型相比,改進算法的平均精度(AP)提升了3.1%、2.6%。所提算法具有較高的檢測精度和魯棒性,可以滿足監控領域復雜場景下行人檢測的需求。

關鍵詞:行人檢測;YOLOv8;UniRepLKNet;Focal-Modulation

中圖分類號:TP 391 " " 文獻標志碼:A

行人檢測是計算機視覺領域中的常見任務,被廣泛應用于智能交通、智能安防等領域[1]。目標檢測算法的不斷更新推動了行人檢測的發展,但是復雜環境下的行人檢測的精度依然具有挑戰性。目前主流的基于深度學習的目標檢測模型分為兩階段檢測算法和單階段檢測算法,前者以R-CNN系列算法[2]為代表,后者以YOLO系列算法為代表,后者在速度上顯著優于前者,但是檢測精度不足[3]。隨著深度學習技術發展,YOLO系列算法的較新版本在精度上已經高于兩階段檢測算法。

為進行復雜環境下的行人檢測,本文提出了一種基于YOLOv8的行人檢測算法,利用UniRepLKNet網絡來提取行人特征,采用Focal-Modulation模塊來處理行人關鍵特征區域,引入Shape-IoU損失來提高邊界回歸的準確性。

1 YOLOv8算法

在計算機視覺領域中,YOLO算法不僅廣泛應用于工業界,而且廣泛應用于學界,其版本也不斷更新,在實時性、準確性和靈活性方面表現優秀。YOLOv8算法是由Ultralytics團隊提出的較新的YOLO系列算法。根據不同的網絡深度,YOLOv8算法具有N、S、M、L和X共5種尺度的模型,其作用是滿足不同場景下的需求。其中YOLOv8s是最輕量級的網絡,訓練速度和檢測速度均較快,因此本文將YOLOv8s作為基礎模型框架進行改進。

YOLOv8算法是在YOLOv5算法的基礎上加入了新的功能和方法,進一步提升了模型性能。在主干網絡部分,YOLOv8算法將梯度流更豐富的C2f模塊替換YOLOv5算法中的C3模塊,調整了不同深度網絡的通道數量,不僅計算量顯著降低,而且模型收斂速度和收斂效果也顯著提升。在網絡頭部分,YOLOv8算法將Anchor-Based替換成Anchor-Free,其優點是算法相對簡潔,無須設計大量錨框,更適用于小目標檢測,同時采用解耦頭的設計,將分類和檢測頭分離,使二者功能更集中,能夠有效提高目標檢測的準確性和泛化性。在損失函數部分,YOLOv8算法將正、負樣本匹配策略代替傳統的IOU匹配方法,同時采用Distribution Focal Loss(DFL)來解決正樣本少、負樣本多導致的模型學習不均衡的問題。

2 改進的YOLOv8模型

2.1 構建重參數化骨干網絡(UniRepLKNet)

在目前的行人檢測任務中,通用的目標檢測模型均使用小尺寸卷積核(例如3*3)來堆疊網絡結構,這種感受野較小的網絡結構不適用于大視野監控視角下的行人檢測,因此需要檢測網絡具有更大的感受野,以學習行人目標的空間分布,同時也需要增加模型網絡深度,以提高高級語義特征的提取能力。UniRepLKNet[4]是一種新穎的卷積神經網絡架構,它采用大尺寸卷積核、高效的局部結構設計和重參數化等機制,不僅保證了大尺寸感受野,而且提高了網絡的表征能力和抽象層次,因此本文將YOLOv8s模型的骨干網絡替代為UniRepLKNet。

一個完整的UniRepLKNet網絡包括4個階段,每個階段均由不同的大尺寸核塊和小尺寸核塊交替排列組成,它借鑒了ConvNeXt網絡的架構思想,將1個大尺寸核塊和2個小尺寸核塊作為1組,4個階段的組數分別為{1,1,3,1}。

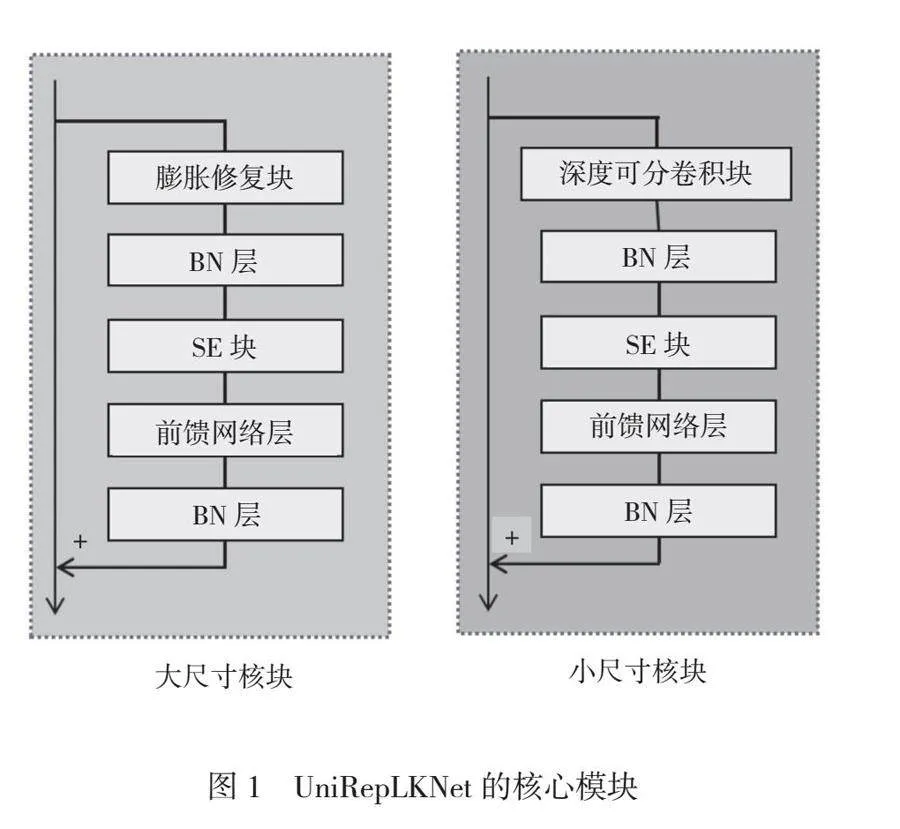

UniRepLKNet的大尺寸核塊和小尺寸核塊結構圖如圖1所示,可以看出,大尺寸核塊與小尺寸核塊的結構基本相同,不同的是大尺寸核塊中采用的是膨脹修復塊,而小尺寸核塊采用的是尺寸為3*3的深度可分卷積塊。通常將大尺寸卷積核與小尺寸卷積核并行使用,再分別通過BN層操作將兩者輸出結果相加。但是大尺寸卷積核的參數較多,會降低模型提取的特征效果,因此需要借鑒結構重參數化的思想,將BN層操作與卷積層一起使用,可以達到大、小不同卷積核尺寸合并推斷的效果,同時也符合膨脹修復塊的捕捉模式特征的機制。

首先,UniRepLKNet網絡采用少量大卷積核,能夠保證大感受野,在不過度增加模型深度的情況下可以有效擴展模型對空間信息的感知范圍。其次,小尺寸核塊中的深度可分離卷積結構可以提高特征抽象層次,允許模型能夠在局部區域更有效地捕捉特征。最后,本文引入了一些高效結構,例如SE塊和瓶頸結構來提高模型深度,使其能夠更好地擬合復雜函數,從而更全面地學習輸入數據的復雜特征和關系。

2.2 引入Focal-Modulation模塊

YOLOv8算法沿用了YOLOv5算法中的SPPF(快速空間金字塔池化)模塊,它通常在目標檢測算法中用于處理各種尺寸的輸入圖像,并產生大小相同的輸出圖像,同時還能保持較快的處理速度。但是對復雜場景下的行人檢測任務來說,SPPF模塊不能較好地處理小目標和遮擋目標,也不能較好地定位到圖像中的關鍵區域。Focal-Modulation模塊[5]是一種新的特征增強方法,它采用焦點調制機制,能夠聚焦于圖像中的關鍵區域,不僅可以處理不同尺寸的輸入圖像,而且可以更精確地識別和定位圖像中的對象。因此本文提出將SPPF模塊替代為Focal-Modulation模塊。

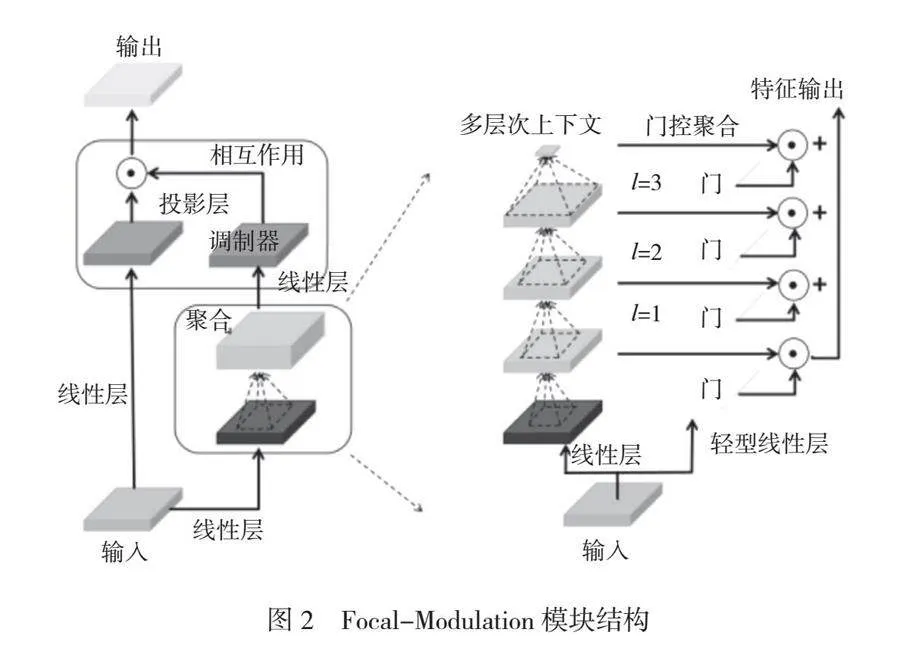

Focal-Modulation模塊結構如圖2所示,該模塊運行步驟包括3個方面。1)焦點上、下文化。該模塊使用一系列深度卷積層堆棧實現焦點上、下文化,從短范圍到長范圍對視覺上、下文進行編碼,從而允許網絡在不同層次上理解圖像內容,增強對圖像全局結構的認識。2)門控聚合。該模塊選擇性地將多層次上、下文信息(l=1,2,3)聚合到每個查詢令牌的調制器中,即網絡能夠決定哪些特定的上、下文信息對當前處理的查詢令牌是重要的,從而專注于那些最具相關性的信息。3)逐元素仿射變換。模塊使用聚合后的調制器,對每個查詢令牌進行逐元素仿射變換,更細致地識別每個查詢令牌的特征,并根據上、下文信息增強或抑制某些特征。通過這3個步驟,Focal-Modulation模塊能夠在聚合上、下文信息過程中保持對局部細節的敏感性,增強模型對全局特征的認識,也可以選擇性地集中處理重要的上、下文信息,提升網絡的效率和性能,還可以利用上、下文信息來調整查詢令牌,增強模型對關鍵視覺特征的捕捉和表達能力。因此Focal-Modulation模塊特別適用于處理目標檢測中難以檢測的小對象或復雜背景中的對象。

2.3 引入Shape-IoU損失函數

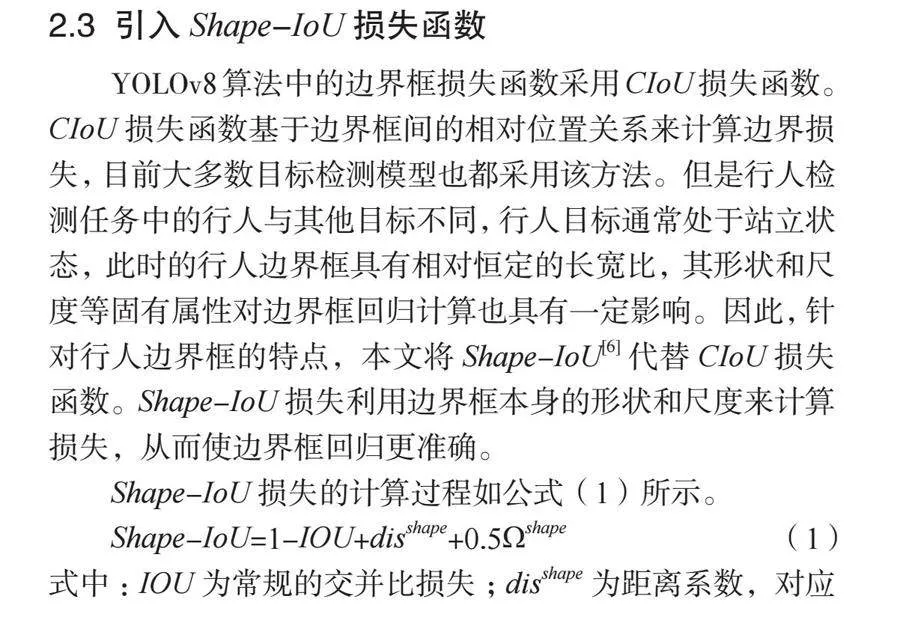

YOLOv8算法中的邊界框損失函數采用CIoU損失函數。CIoU損失函數基于邊界框間的相對位置關系來計算邊界損失,目前大多數目標檢測模型也都采用該方法。但是行人檢測任務中的行人與其他目標不同,行人目標通常處于站立狀態,此時的行人邊界框具有相對恒定的長寬比,其形狀和尺度等固有屬性對邊界框回歸計算也具有一定影響。因此,針對行人邊界框的特點,本文將Shape-IoU[6]代替CIoU損失函數。Shape-IoU損失利用邊界框本身的形狀和尺度來計算損失,從而使邊界框回歸更準確。

Shape-IoU損失的計算過程如公式(1)所示。

Shape-IoU=1-IOU+disshape+0.5Ωshape (1)

式中:IOU為常規的交并比損失;disshape為距離系數,對應邊界框的尺度偏差;Ωshape為形狀系數,對應邊界框的形狀偏差,具體計算方式見文獻[6]。

3 試驗結果與分析

3.1 試驗數據集

常見的行人檢測數據集包括CityPersons、VOC和COCO等,這些數據集中圖片的光照、分辨率和背景環境等因素都較好,行人目標可以較容易地檢測出來。為了評估所提改進模型在復雜場景下的效果,本文使用RTTS和WiderPerson數據集進行試驗。RTTS數據集是RESIDE數據集下的一個子分支,所有數據均在霧、雨和雪天氣條件下采集,包括道路、鄉村和景區等不同場景。WiderPerson數據集在戶外進行數據采集,專門用于戶外行人檢測任務,數據集中行人眾多、圖片分辨率各異。這2個數據集包括復雜天氣、遮擋和密集分布的情形,更貼近實際應用場景,能夠更好地驗證模型的有效性。

3.2 評價指標

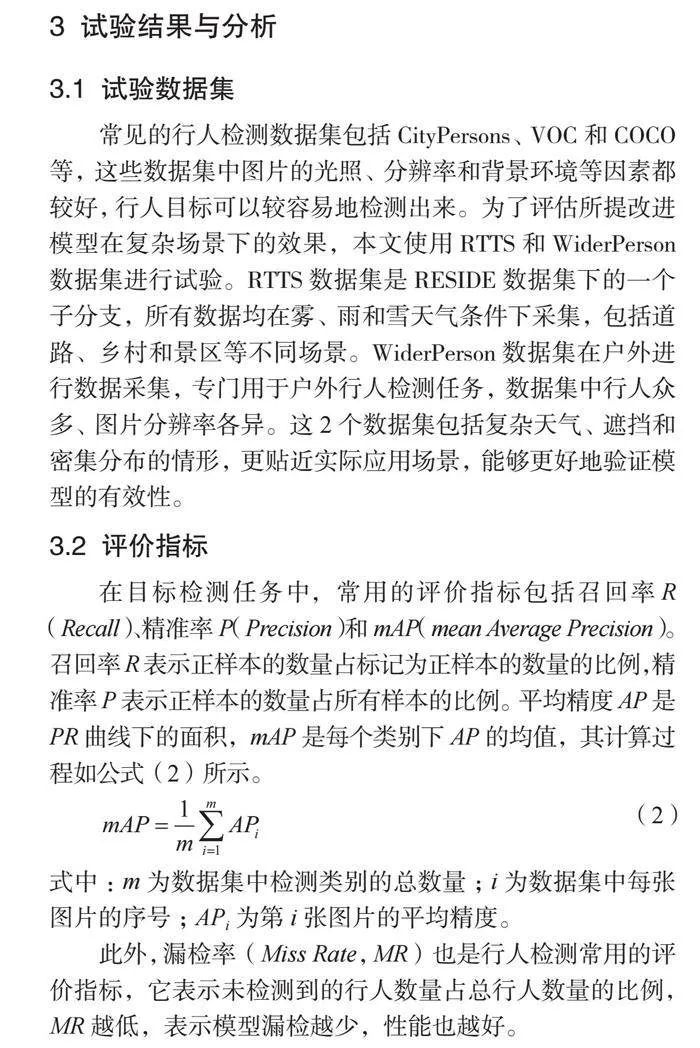

在目標檢測任務中,常用的評價指標包括召回率R(Recall)、精準率P(Precision)和mAP(mean Average Precision)。召回率R表示正樣本的數量占標記為正樣本的數量的比例,精準率P表示正樣本的數量占所有樣本的比例。平均精度AP是PR曲線下的面積,mAP是每個類別下AP的均值,其計算過程如公式(2)所示。

(2)

式中:m為數據集中檢測類別的總數量;i為數據集中每張圖片的序號;APi為第i張圖片的平均精度。

此外,漏檢率(Miss Rate,MR)也是行人檢測常用的評價指標,它表示未檢測到的行人數量占總行人數量的比例,MR越低,表示模型漏檢越少,性能也越好。

3.3 試驗結果和分析

本文試驗環境包括操作系統Windows 10、Pytorch-1.12、CUDA-11.7和GPU-MVIDIA GeForce RTX 2070 SUPER。

試驗訓練的相關設置如下所示。采用UniRepLKNet的預訓練權重,使用Adam優化器,設momentum為0.9,初始學習率為1×10-3,權重衰減系數為5×10-4,BatchSize為16,迭代輪數epoch為300。在輸入端的數據增強方面,延續使用YOLOv5中的Mosaic數據增強方式,即通過隨機縮放、隨機裁剪和隨機排布的方式將輸入圖片進行拼接,這種方式對小目標的檢測效果較好。在訓練策略上,本文引入了YOLOX中的數據增強策略,在訓練的最后10個epoch關閉Mosaic數據增強,該策略可以有效提升模型精度。改進YOLOv8s模型在RTTS數據集中的試驗結果見表1。

由表1可知,與YOLOv8s基準檢測模型相比,本文改進的YOLOv8s模型的平均精度(AP)提升了3.1%,召回率提升了3.9%,精度提升了0.1%,并且在精度方面基本取得了二階段檢測網絡Faster R-CNN的效果。

為了分析改進YOLOv8s模型的各項改進內容的效果,本文進行了消融試驗,其結果見表2。可以看出,單獨使用UniRepLKNet、Focal-Modulation和Shape-IoU,均能提升模型精度,聯合使用這3個模塊,模型的平均精度(AP)比基準模型提高3.1%,證明了改進模型的有效性。

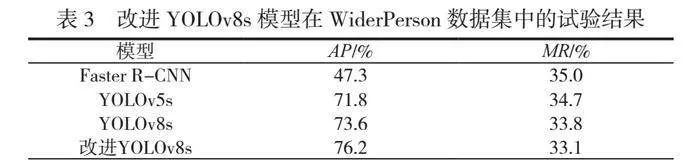

改進模型在WiderPerson數據集中的試驗結果見表3。可以看出,與基準模型相比,改進模型的平均精度(AP)提升了2.6%,漏檢率(MR)下降了0.7%。

綜合表2、表3的試驗結果可知,本文提出的3個改進方面均能有效增強模型的準確性和魯棒性,在復雜環境,例如光照變化、遮擋情況、背景相似情況和小目標情況下,仍然能夠檢查出行人邊框,并降低漏檢率。綜上所述,本文提出的改進模型在復雜環境下能夠有效提取并處理行人特征,更能滿足現實監控場景的需求。

4 結語

為了提高復雜環境下行人檢測的質量,本文在YOLOv8模型基礎上進行了3個方面的改進。首先,將UniRepLKNet作為骨干網絡,以有效感知空間信息和捕捉局部區域特征。其次,選用Focal-Modulation模塊來捕捉圖像中的關鍵視覺特征和上、下文信息,以處理難以檢測的小對象或復雜背景中的對象。最后,選用Shape-IoU損失函數,它不僅符合行人邊框的特點,而且使邊界框回歸更精確。試驗結果表明,3個方面的改進均有成效,改進模型取得了較優異的檢測效果,具有較好的準確性和魯棒性。

參考文獻

[1]羅會蘭,陳鴻坤.基于深度學習的目標檢測研究綜述[J].電子學報,2020,48(6):1230-1239.

[2]郭慶梅,劉寧波,王中訓,等.基于深度學習的目標檢測算法綜述[J].探測與控制學報,2023,45(6):10-20.

[3]劉毅,于暢洋,李國燕,等.UAST-RCNN:遮擋行人的目標檢測算法[J].電子測量與儀器學報,2022(12):168-175.

[4]肖志鵬,何書峰,田春岐.EmoRepLKNet:一種基于UniRep-

LKNet的面部情緒識別神經網絡[EB/OL].(2024-10-12)[2024-11-18].https://doi.org/10.19678/j.issn.1000-3428.0069761.

[5]YANG J W,LI C Y,DAI X Y.Focal Modulation Networks[EB/OL].

[2022-03-22].https://arxiv.org/abs/2203.11926?context=cs.

[6]ZHANG H,ZHANG S J.Shape-IoU:More accurate metric considering bounding box shape and scale[EB/OL].[2023-11-29].https:

//arxiv.org/abs/2312.17663?context=cs.