USformer-Net:基于U-Net 和Swin Transformer 的腦部MRI 圖像質量評價方法

李沛釗,王同罕,賈惠珍,吳 通

(東華理工大學信息工程學院,江西南昌 330013)

0 引 言

腦部磁共振成像(Magnetic Resonance Imaging,MRI)是一種利用磁場和射頻信號產生人體內部結構圖像的技術,它在診斷和評估腦部疾病方面具有重要的臨床價值,相較于其他醫學成像方法的優勢在于其無創無輻射、分辨率高、對軟組織的對比度好、能夠提供多種平面和三維的圖像等[1]。但是由于成像設備的技術局限性、人為的操作失誤以及患者的主觀運動,可能導致圖像出現噪聲、模糊、失真、偽影等現象,從而降低圖像的可讀性和可診斷性[2]。

圖像質量評價方法分為兩類:主觀評估,由人類進行判斷;客觀評估,使用數學算法進行計算[3]。客觀評估進一步分為三類:全參考(Full-Reference Image Quality Assessment, FR-IQA),其中存在一個完美的參考圖像用于與測試圖像進行比較;半參考(Reduced-Reference Image Quality Assessment, RR-IQA),其中包含參考圖像的部分信息;無參考(No-Reference Image Quality Assessment, NR-IQA),在沒有參考圖像的情況下對圖像質量進行評估[4]。由于很少有完美圖像可作為圖像評估的參考,因此,NR-IQA 是醫學圖像最適合的評估方法。

目前,已經有許多針對不同類型和模態的醫學圖像質量評價方法被提出。文獻[5]通過提取無監督的顯著性圖特征和有監督的卷積神經網絡特征,并將兩者結合起來訓練SVM(Support Vector Machine)分類器進行視網膜圖像質量評估。文獻[6]利用圖像中的空氣背景評價三維MRI 圖像質量。文獻[7]首先提出的基于卷積神經網絡的無參考圖像質量評價模型。文獻[8]提出DeepBIQ 網絡,基于分類任務預訓練和遷移學習的思路得到圖像質量評價模型。文獻[9]提出了一種基于機器學習算法的監督學習方法,用數值觀測器對人類觀測器進行建模,以評估圖像質量。

早期的MRI 無參考圖像質量評價算法大多針對特定形變,但是由于需要大量的特征提取和統計數據造成運行速度偏慢[10]。文獻[11]對IQA 使用了兩級MRI 融合度量,其中兩個圖像被融合以改進失真檢測。為了開發自動深度學習方法,文獻[12]引入了一種半監督技術,使用均值學習方法和感興趣區域一致性,該技術專門用于胎兒大腦MRI 圖像的無參考圖像質量評價。此外,文獻[13]使用半監督學習來解決圖像分割任務中創建噪聲注釋的問題。

Transformer[14]是一種深度學習體系結構,已經在自然語言處理領域取得了突破性的進展,涉及識別、合成等多方面任務。文獻[15]利用皮膚鏡圖像檢測黑色素瘤,他們提議將SWN Transformer 與無參數注意模塊SimAM 相結合。文獻[16]提出了一種金字塔醫療Transformer,它通過處理多分辨率圖像來捕獲多范圍關系。文獻[17]在編碼器中添加了選通軸向Transformer層,利用整體圖像和補丁對應地學習全局和局部特征。基于Transformer 的方法也被應用于各種醫學圖像處理任務[18]。

本文在現有的醫學圖像質量評價方法和思路的基礎上,首先創建了包含7 023 張圖像且帶有主觀評價標簽的數據集,并提出了一種全新的自動評估腦部MRI 圖像質量的模型USformer - Net(U - Net and Swin Transformer based Neural Network)。該模型可自動評估患者的影像資料,以確保圖像滿足臨床診斷的要求。本文提出的USformer-Net 模型在腦部MRI 圖像質量評價流程中通過圖像分割有效地選擇了臨床醫生感興趣區域,即具有實際臨床診斷價值的區域,忽略了一些無關區域的噪聲、失真等對整幅圖像評價過程的影響,具有很好的實際使用價值和臨床診斷意義。

本文主要貢獻有:給出了一種腦部MRI 圖像質量評價新途徑,分割并提取患者MRI 圖像中腦部主要結構區域,減少了無關區域圖像質量對評價結果的影響,使其更加符合臨床醫生、放射科醫生進行診斷的現實意義;提出了腦部MRI 圖像評價模型USformer-Net,在準確率上相較于其他方法有顯著提升;創建了帶有主觀評價標簽的腦部MRI 圖像數據集,提高了腦部MRI 圖像質量評價領域數據集的質量,有助于進一步發展和改進MRI 圖像質量評價算法。

1 模型設計及數據集構建

1.1 數據集構建

1.1.1 數據集預處理

本文使用的數據集是基于公開且已經授權使用的“Brain Tumor Dataset”數據集進行整理得到,該數據集最初由美國匹茲堡大學醫學中心的兩位神經外科醫生(Dr.Katrin Bauer 和Dr.Stefan Bauer)和他們的團隊收集和整理,從中提取到了7 023 張人類腦部MRI 圖像。患者在帶有相控陣線圈的3.0T MR 裝置上進行掃描。

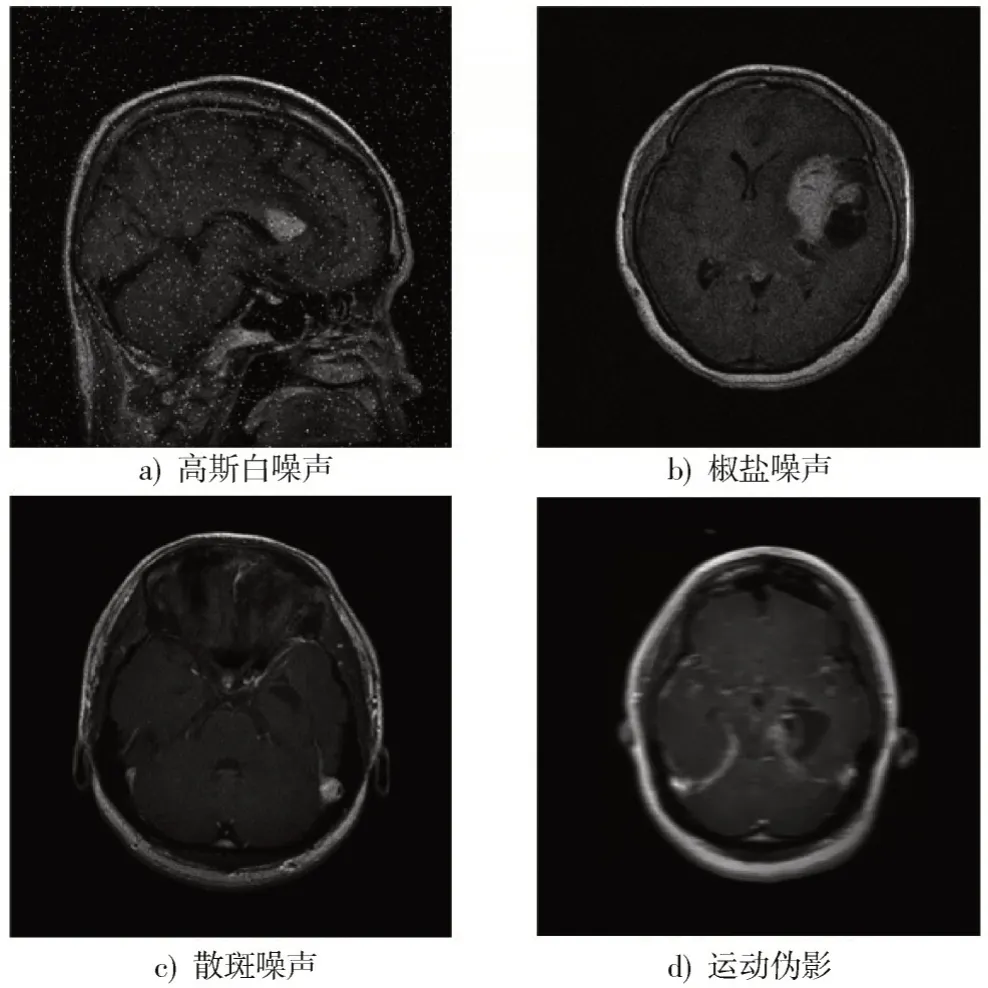

為了解決數據集中圖像類別不平衡的問題,同時提高模型的泛化能力和魯棒性,本文對數據集進行了數據增強。本文使用Matlab 中的imnoise 函數在原始圖像上添加了三種不同的噪聲:高斯白噪聲;椒鹽噪聲和散斑噪聲,其模擬了圖像傳感器或傳輸過程中的隨機錯誤;偽影噪聲,其模擬了MRI 成像過程中由于設備或患者運動等因素引起的條紋或鬼影現象。通過噪聲程度的調節,分別模擬了模糊失真、噪聲失真、對比度失真和壓縮失真4種常見的失真情況。最終效果如圖1所示。

圖1 不同類型的噪聲

1.1.2 數據集主觀質量評價

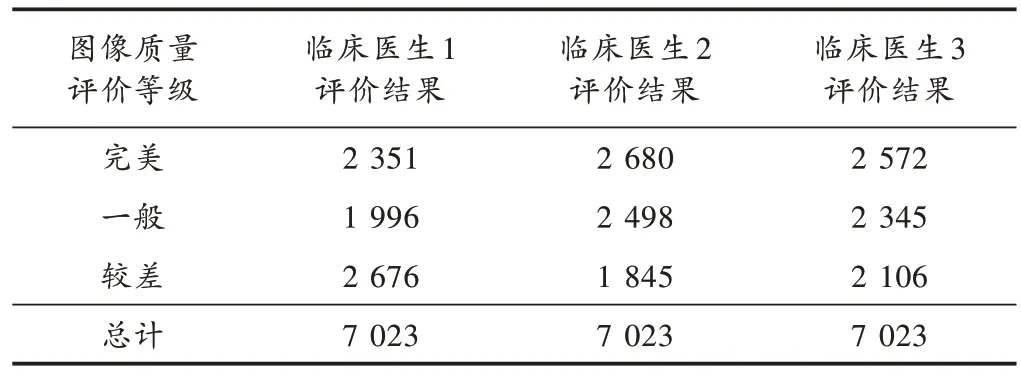

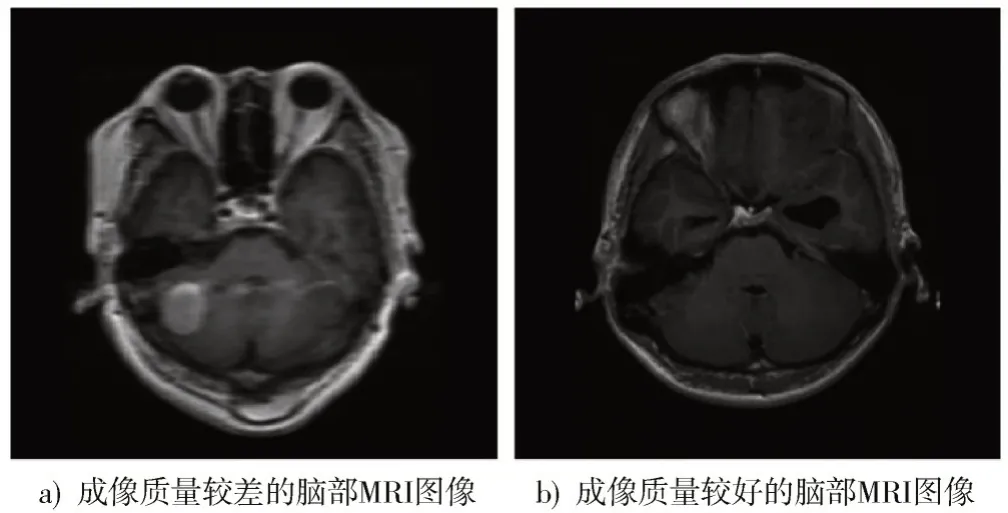

為了評估數據集的質量和可診斷性,邀請了三位經驗豐富的臨床醫生和放射科醫生對處理后的7 023 張圖像進行了主觀評價,每位醫生按照以下標準對每張圖像進行了分類:圖像是否包含了腦部的主要結構;圖像中的主要結構、解剖結構、解剖細節是否清晰可見;圖像是否能夠滿足臨床診斷的需求。圖像被分為三個等級:完美、一般和較差。圖2 列舉了成像質量較差以及較好的兩幅腦部MRI 圖像。其中圖2a)為質量較差的MRI圖像,圖2b)為質量較好的MRI 圖像。最終三位醫生的評價結果如表1 所示。

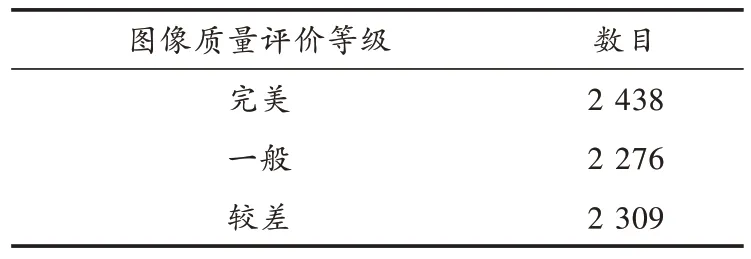

表1 數據集主觀評價結果

圖2 不同成像質量的腦部MRI 圖像

為了確定每張圖像的最終標簽,本文采用了以下規則:如果某張圖像被三位醫生中的至少兩位標注為同一類別,那么該圖像就被歸為該類別;如果某張圖像被三位醫生分別標注為不同的類別,那么醫生們會再次對該圖像進行評價并進行討論,直到達成一致或者有兩位醫生同意某一標簽。最終得到的數據集如表2 所示。

表2 主觀評價實驗結果

1.1.3 數據集標簽一致性檢驗

Fleiss′ kappa 系數是一種用于評估多個評分者對多個分類的標注一致性的統計量,它的取值范圍為-1~1,其中0 表示隨機一致性,1 表示完全一致性,小于0 表示評分者的一致性程度低于隨機。Fleiss′ kappa 系數通常用于評估醫學圖像、自然語言處理、心理學等領域中評價結果的一致性[19]。計算公式如下:

式中:po是觀察者之間的觀察一致性的概率,po=其中N是觀察者的數量,pi是第i個分類的比例;pe是預期的一致性概率,它是基于觀察者的總體分類概率計算得出的,其中pj是第j個分類的總體比例。最終的一致性結果為0.81,表明醫生們對圖像質量的評價具有較高的一致性,證明了主觀評價實驗后得到的數據集的可靠性。

1.2 模型設計

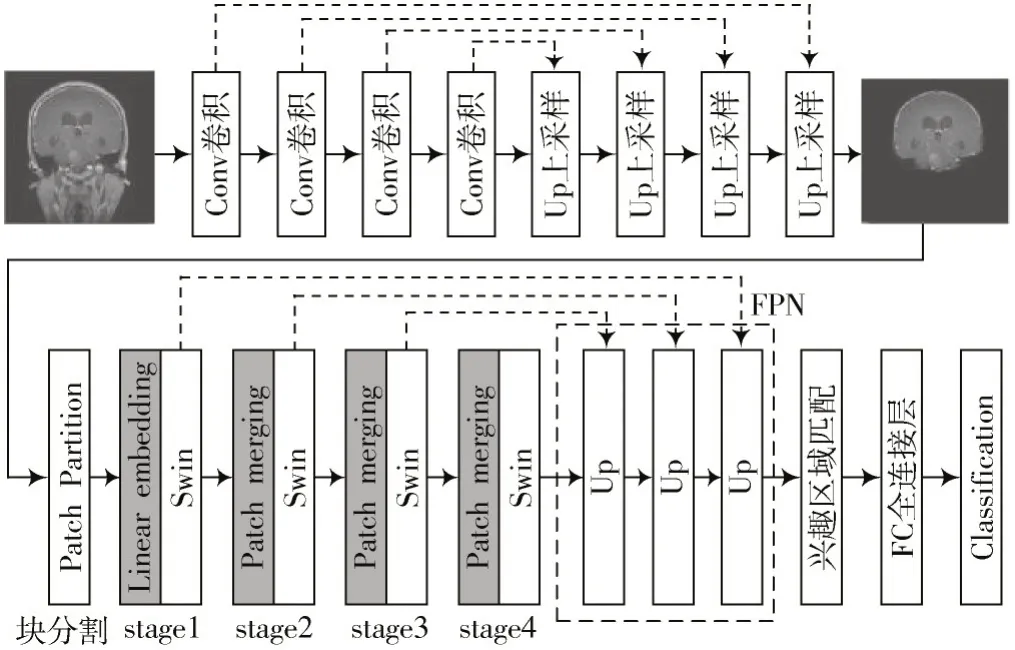

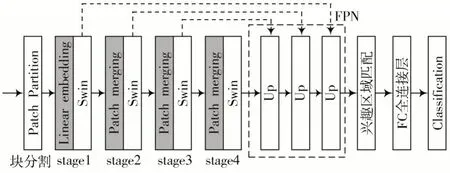

本文提出的USformer-Net 模型包含圖像分割模塊以及圖像質量評價模塊兩個模塊。在圖像分割模塊使用了醫學圖像領域當下流行且具有良好效果的U-Net分割網絡作為主干網絡;圖像質量評價模塊使用了基于Transformer 改進的Swin-Transformer 作為主干網絡。這種融合方式結合了U-Net 和Swin Transformer 的優勢,利用U-Net 進行圖像分割,提取出腦部MRI 圖像中臨床醫生感興趣的主要區域。利用Swin Transformer 進行圖像質量評價,利用其全局最大池、卷積神經網絡和自注意力模塊提取出圖像的質量特征,并進行分類和預測。為了使該模型在腦部MRI 圖像質量評價更加有效,對兩個主干網絡進行了相應的更改,在1.2.1 節與1.2.2 節對這兩個網絡分別進行了詳細介紹。USformer-Net 整體模型架構如圖3 所示。

圖3 USformer-Net 整體模型架構

1.2.1 基于U-Net的圖像分割模型

U-Net[20]是一種基于全卷積神經網絡的圖像語義分割模型,它借鑒了自動編碼器的思想,將輸入圖像映射到輸出圖像。U-Net 包含兩條路徑:一條是收縮路徑(編碼器),用于提取輸入圖像的特征;另一條是擴展路徑(解碼器),用于恢復輸入圖像的細節和空間信息。

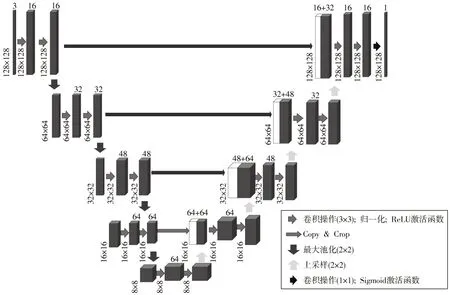

隨著醫療圖像分割領域更加深入的研究,發現傳統的U-Net 網絡在腦部MRI 圖像分割精度以及部署過程中存在一定的欠缺[21],于是在本文提出的USformer-Net模型中對分割網絡中的解碼編碼結構進行了更改,使其在滿足較高分割精度的同時實現輕量化。在模型的編碼部分對輸入圖像進行了大小為4×4 的無重疊片劃分,嵌入層將特征維度映射到任意維度。其中網絡具有4 個卷積塊,網絡的每個卷積塊包含2 個卷積層,其內核大小為3×3。每個卷積塊的濾波器大小在每個層之后變化,其中濾波器大小以16 的步長遞增。卷積塊的每一層由校正線性單元(ReLU)激活,同時在這些層之間應用批歸一化步驟。改進后的U-Net 網絡結構如圖4所示。

圖4 改進后的U-Net 網絡結構

1.2.2 基于Swin Transformer 的圖像評價模型

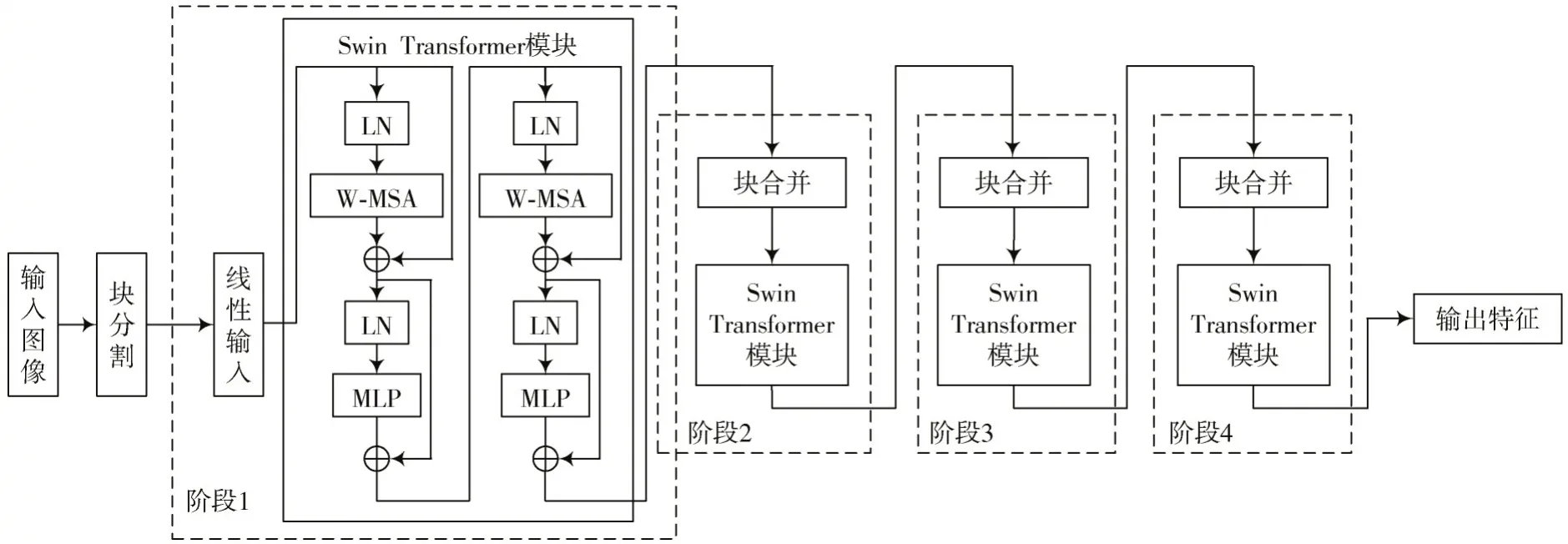

Swin Transformer 是一種可用于圖像質量評估的新型深度學習模型[22]。它結合了全局最大池、卷積神經網絡和自注意力模塊,利用這些技術來檢測圖像質量和特征[23]。Swin Transformer 的結構分為三個主要模塊:全局最大池、CNN 和自注意力模塊。

首先,Swin Transformer 使用全局最大池化(GMP)模塊從輸入圖像中提取特征,它采用不同的池大小和步長將原始圖像分解成多個子圖像,從而提取出更多的特征信息。

其次,Swin Transformer 使用CNN 模塊將圖像特征轉換成更高級的特征。該模塊使用多個CNN 層以提取出更多的特征,并有助于改進圖像識別的準確性。

最后,Swin Transformer 使用自注意力模塊來檢測圖像中的質量特征。相對于傳統的Transformer 模型,Swin Transformer 模型具有更高效的計算、更好的可擴展性以及更好的可解釋性。Swin Transformer網絡結構如圖5所示。

圖5 Swin Transformer 網絡結構

為了使Swin Transformer 模型更適用于腦部MRI 圖像質量評價任務,本文對該模型進行了相應的改進。改進后的模型結構如圖6 所示。

圖6 改進后的模型結構

將特征金字塔(FPN)、興趣區域匹配(ROI Align)及全連接網絡(FC)結合在Swin Transformer 骨干特征提取網絡中,每個FPN 階段的輸出代表不同尺寸的特征圖,經過上采樣后與上一特征圖融合,獲得包含不同尺寸缺陷特征的新特征圖。ROI Align 則將特征圖經過池化綜合轉換為向量,再經過全連接網絡進行分類預測,獲取檢測結果。

特征金字塔是一種用于多尺度目標檢測的技術,可以在不同尺度上提取圖像特征,從而提高模型對于不同尺度物體的識別準確率。興趣區域匹配網絡是一種用于準確地對圖像中的興趣區域進行特征提取的方法。興趣區域匹配網絡可以幫助模型準確地提取圖像中不同區域的特征,從而提高評價的準確性。全連接網絡是一種用于分類的神經網絡結構,可以對輸入的特征進行分類。全連接網絡可以幫助模型將提取的特征進行更加準確的分類,從而得出最終的評價結果。相較于原始Swin Transformer 網絡,改進后的網絡具有更好的特征提取能力、更好的感受野、更好的檢測性能以及更好的泛化性能。

2 實驗及其結果分析

將分割后并提取的三類圖像按照7∶2∶1 的比例分為訓練集、驗證集和測試集。模型評價指標選取了敏感性(Sensitivity)、特異性(Specificity)、準確率(Accuracy)、精度(Precision)、召回率(Recall)和F1評分(F1-score)。計算公式分別如下:

式中:TP 為真陽性樣本的數量;即模型預測為正,實際為正的樣本數量;FP 為預測為正,實際為負的樣本數量;FN 為預測為負,實際為正的樣本數量;TN 為預測為負,實際為負的樣本數量。

2.1 分割實驗

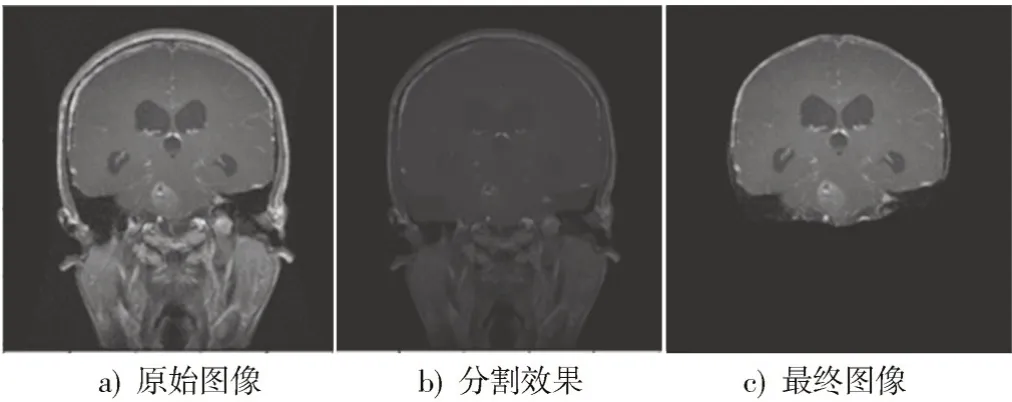

從數據集中提取了1 022 張圖像(三類圖像以隨機數目包含其中),使用標注工具進行人工標注腦部區域,生成了1 022 個Json 文檔,并按照7∶2∶1 的比例分為訓練集、驗證集和測試集輸入到改進后的U-Net 網絡中。分割效果如圖7 所示。

圖7 腦部MRI 圖像分割效果圖

最終效果顯示該模型能很好地分割并提取人類腦部MRI 圖像中的感興趣區域,使接下來的評估實驗不用受到無關背景的影響。

2.2 圖像質量評價結果

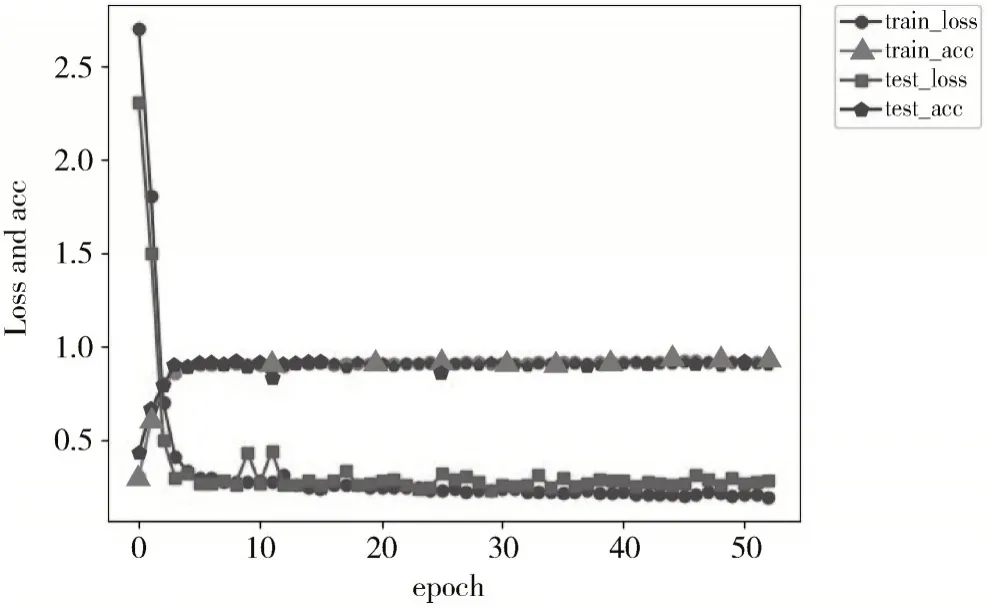

圖8 是在本文創建數據集集中進行訓練和測試時的準確率和損失變化。從圖中可以看出,隨著訓練輪數的增加,準確率不斷提高,損失率逐漸降低,最終趨于平穩,在測試集上達到最佳效果。

圖8 數據集的訓練過程

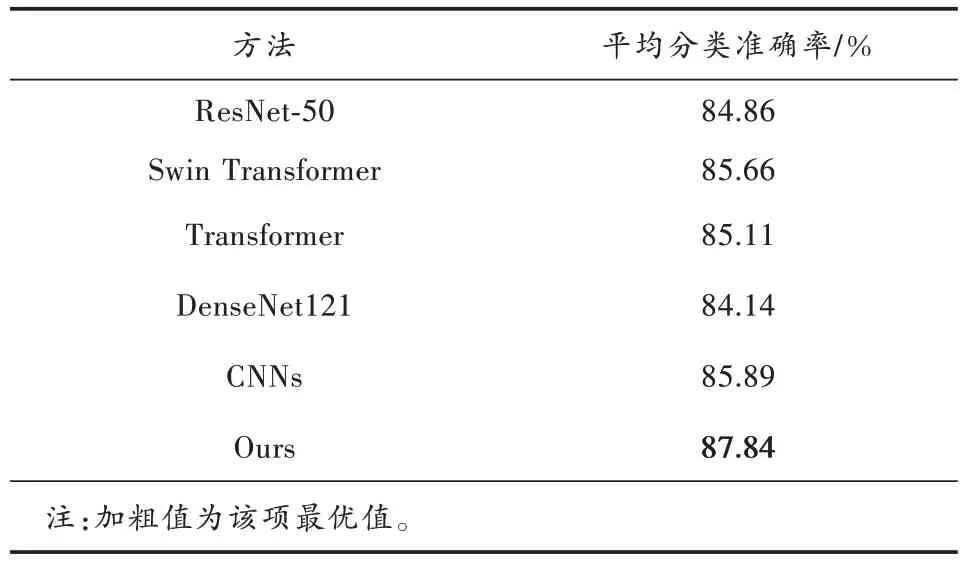

本文將改進后的網絡模型與當下應用于醫學圖像質量評價的主流模型ResNet-50[24]、Swin Transformer、Transformer、DenseNet121[25]以及MRI 圖像質量評價模型CNNS[26]使用相同數據集的結果進行了對比,對比結果如表3、表4 所示。

表3 USformer-Net 性能表現%

表4 主流模型性能表現

由表3 可知,該模型對完美質量圖像、一般質量圖像和較差質量圖像的分類準確率分別為86.95%、87.49%和88.08%,平均分類準確率為87.84%。該模型在Precision、Recall 和F1-Score 上的平均值也分別達到了91.84%、92.05%和91.99%。模型整體效果比較出色,能應用于具體的臨床環境中。從表4 可知,在腦部MRI 圖像質量評價任務中,本文提出的模型相較于其他主流模型,在平均分類準確率上有所提升。

3 結 論

醫學圖像質量評價是一個主觀問題,沒有唯一的標準來評估醫學圖像是否可用于臨床診斷。同時,由于圖像的可變性,腦部MRI 質量評估是一項具有挑戰性的任務,目前還沒有廣泛接受的模型和自動化程序用于此研究。另外,一個有效的質量評估模型需要大量特定數據來訓練網絡,現有的公開數據集并不能完全滿足醫學圖像質量評價領域的研究,這也導致了該領域的研究進展緩慢。

在本文的研究中,首先創建了一個豐富的帶有主觀評價標簽的腦部MRI 圖像數據集,改善了醫學圖像質量評價領域數據集不充足的現狀。本文提出了一種結合U-Net 和Swin Transformer 評估腦部MRI 圖像質量的新方法。與現有的腦部MRI 圖像質量評價方法相比,本文提出的方法更多關注醫學圖像的特殊性,側重于感興趣區域的提取與評價。從最終評價結果來看,本文提出的腦部MRI 圖像自動評價模型USformer-Net 的性能也更加優異。

致謝:此次圖像主觀評價實驗的數據結果獲取得到了來自四川省人民醫院、西南醫科大學附屬醫院的黃鈺愷、羅毅偉、范家瑞三位臨床醫生的幫助,在此表示衷心的感謝。

注:本文通訊作者為王同罕。