基于GAN與軸向區塊注意力的心臟磁共振圖像分割

摘 要:心臟磁共振圖像分割對心功能分析和心臟疾病診斷具有十分重要的意義。針對傳統心臟分割方法對心臟MR圖像特征提取不全面,以及基于注意力機制的深度學習方法參數量過大的問題,設計一種基于GAN與軸向區塊注意力的心臟磁共振圖像分割模型,對圖像特征進行多尺度、全方面地提取,結合GAN策略提升模型性能。實驗結果表明,模型實現了圖像的有效分割并提高了分割結果與真實標簽之間的一致性。

關鍵詞:圖像分割;GAN網絡;注意力機制;磁共振圖像

中圖分類號:TP391.4 文獻標識碼:A 文章編號:2096-4706(2024)13-0046-06

Cardiac Magnetic Resonance Image Segmentation Based on

GAN and Axial Block Attention

WANG Bo, HU Huaifei

(South-Central Minzu University, Wuhan 430074, China)

Abstract: Cardiac magnetic resonance image segmentation is of great significance for cardiac function analysis and cardiac disease diagnosis. Aiming at the problem that traditional cardiac segmentation methods can not fully extract features from cardiac MR images, and the Deep Learning method based on the Attention Mechanism has too many parameters. A cardiac magnetic resonance image segmentation model based on GAN and axial block attention is designed to extract image features at multiple scales and in all aspects, and combined with GAN strategy to improve model performance. Experimental results show that the model achieves effective segmentation of images and improves the consistency between segmentation results and real labels.

Keywords: image segmentation; GAN network; Attention Mechanism; magnetic resonance image

0 引 言

我國居民心血管疾病流行趨勢明顯,心血管疾病的發病人數持續增加[1]。磁共振(Magnetic Resonance, MR)技術能夠得到清晰的組織結構圖,使心功能分析在臨床實踐中變得更加精準全面[2]。由于患者MR圖像數量龐大,臨床醫師在閱片上需要耗費大量的時間和精力[3]。如何避免主觀因素影響實現高效準確地分割MR圖像成為難題。

1 相關研究

卷積神經網絡的應用不僅避免了主觀影響,還加快了MR圖像的分割速度。但卷積核具有局限性,無法有效獲取長距離的依賴關系,限制了圖像特征的表達能力。注意力機制(Attention Mechanism)通過動態學習模型的感興趣區域,合理分配模型的權重,提升了模型的表達能力和整體性能,打破了卷積神經網絡模型在特征提取方面的局限性。

Chen等[4]首次將自注意力機制引入醫學圖像分割任務,在U-Net模型中使用Transformer對所提取的特征信息進行全局編碼,豐富了圖像全局底層細節信息。Wang等[5]引入位置編碼對全局信息進行編碼,對自注意力模塊進行降維操作,有效降低了網絡模型的計算復雜度。Valanarasu等[6]在文獻[5]的基礎上向全局位置編碼增加門控單元(Gated Unit),提出了軸向門控注意力(Axial Attention),通過控制信息流動約束了信息傳遞,對自注意力機制進行了改進。Tu等[7]使用網格注意力模塊提取全局特征信息,結合區塊注意力(Block Attention)模塊提取局部特征信息,有效提升了模型對特征的提取表達能力。Rahman等[8]使用深度監督策略分別對模型進行并聯、級聯訓練,所提出的逐級特征融合策略在得到深層特征信息的同時實現了模型間的信息交互,增強了模型對特征的表達能力。Tragakis等[9]提出一種全卷積Transformer模型(Fully Convolution Transformer, FCT),該模型在解碼階段引入自注意力結構,能夠提取到長程語義依賴,結合逐級特征融合策略[8]將不同分辨率的特征圖進行融合,進一步提升了模型的分割性能。

Goodfellow等[10]借鑒博弈論(Game Theory)思想提出生成對抗網絡模型,通過生成器與鑒別器之間的博弈,訓練模型預測出更加符合真實數據分布的結果,顯著提升了預測的準確性和合理性。Kohl等[11]首次將生成對抗網絡應用于醫學圖像分割領域,該模型的預測結果更加合理。Peiris等[12]采用雙視圖半監督對抗訓練實現了醫學圖像的精準分割。Qi等[13]提出一種級聯條件GAN模型,該模型級聯兩個多尺度特征融合模型作為生成器,實現了雙心室的分割。

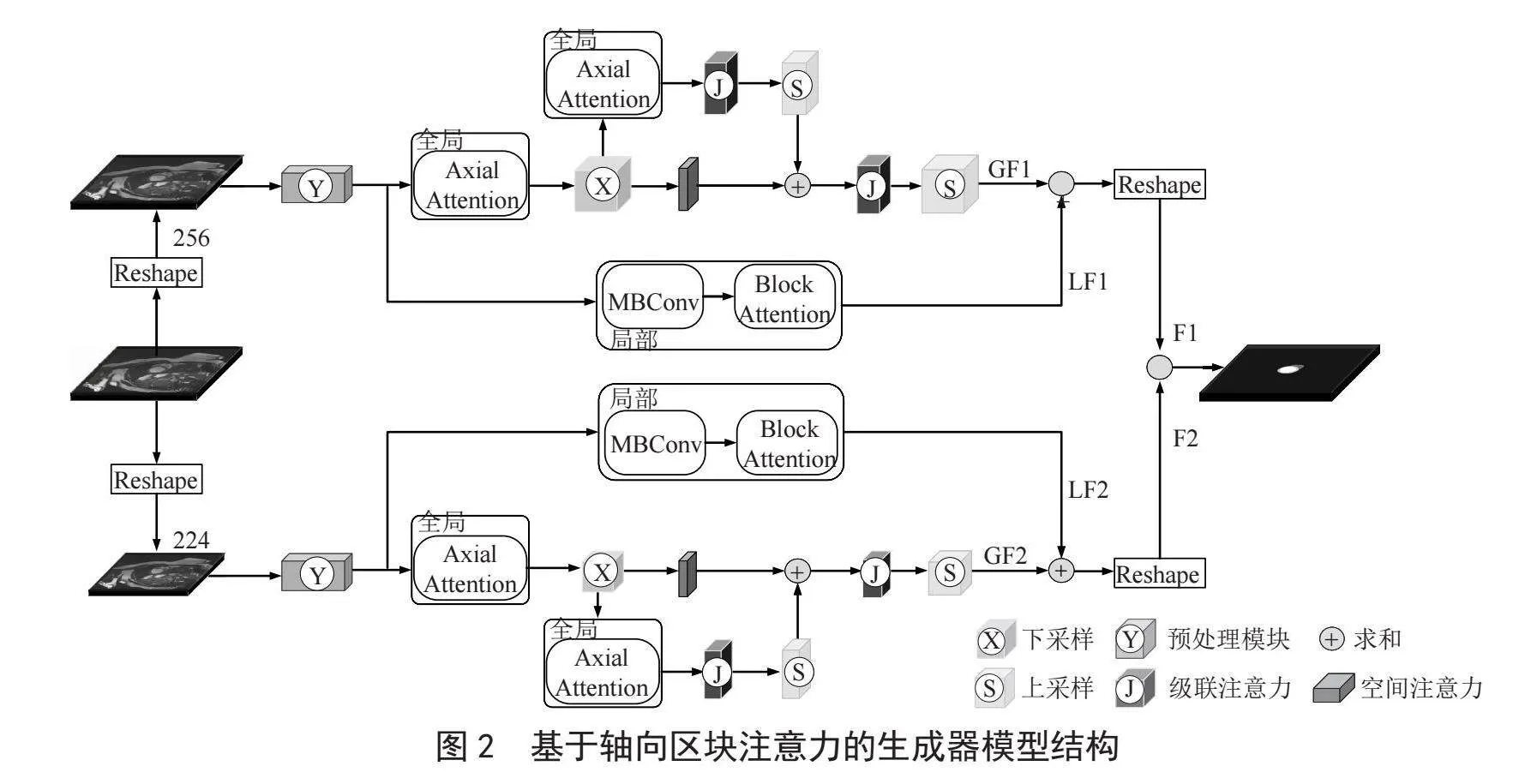

本文針對心臟MR圖像特征提取不全面、使用注意力方法參數量大、計算量高的問題,提出一種基于GAN與軸向區塊注意力的心臟MR圖像分割模型,模型的整體框架如圖1所示。該模型采用軸向門控注意力和區塊注意力相結合的方式提取圖像的全局代表性特征和局部代表性特征,并融合生成對抗策略協助模型進行學習數據的分布。該模型有效解決了圖像特征提取不全面的問題,增強了分割結果與真實標簽之間的一致性,提升了模型的特征提取能力和分割性能。

2 材料與方法

如圖1所示,首先,將待分割的MR圖像發送至由軸向門控注意力和區塊注意力組成的生成器G,生成預測的分割結果B。其次,計算分割結果B與對應真實標簽A之間的損失,并反饋給生成器。再次,將真實標簽A與分割結果B一起送入鑒別器D中鑒別二者數據分布的一致性。將鑒別結果作為模型的損失,分別反饋給生成器和鑒別器以便更新各自模型的參數,重復此過程直至訓練結束。

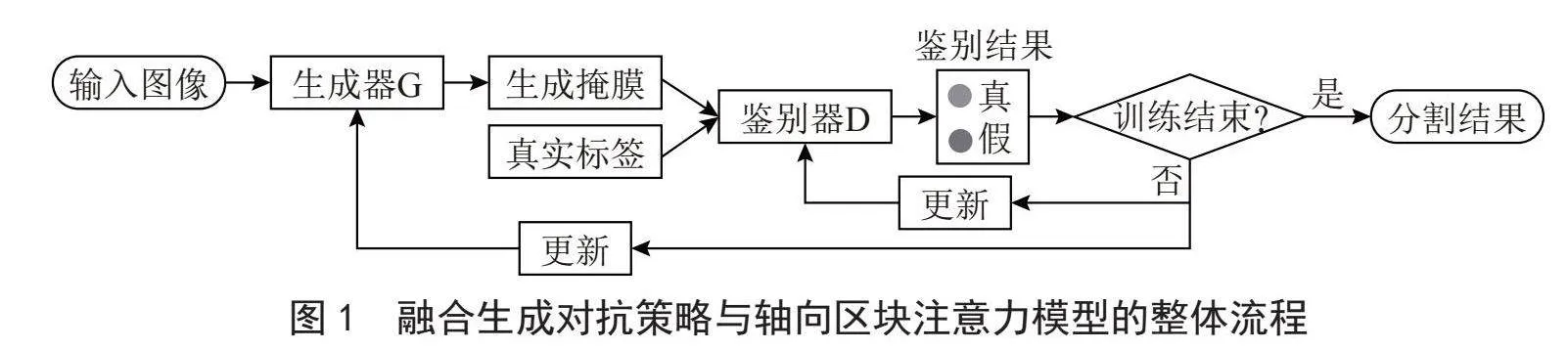

2.1 基于軸向區塊注意力的生成器模型

基于軸向區塊注意力的生成器模型結構如圖2所示,將輸入的心臟MR切片圖像尺寸調整為256×256像素和224×224像素,分別送入兩個結構相同的網絡中并行訓練。對于尺寸為256×256像素的圖像,首先圖像經過預處理模塊后進行下采樣操作。接著,使用軸向門控注意力[6]提取圖像的全局特征信息,并使用逐級特征融合策略[8]融合提取到的特征信息,得到圖像的全局特征信息GF1。同時,使用MBConv [14]模塊對下采樣的結果進行處理后,使用區塊注意力[9]提取圖像的局部特征信息,得到圖像的局部特征信息LF1。接著,將提取到的全局特征信息GF1與局部特征信息LF1進行融合,再次調整圖像的尺寸得到網絡的輸出結果F1。同理,對224×224像素的圖像進行處理可得到結果F2。最后,將兩個結果F1和F2進行融合,得到預測的分割結果。

2.1.1 軸向門控注意力

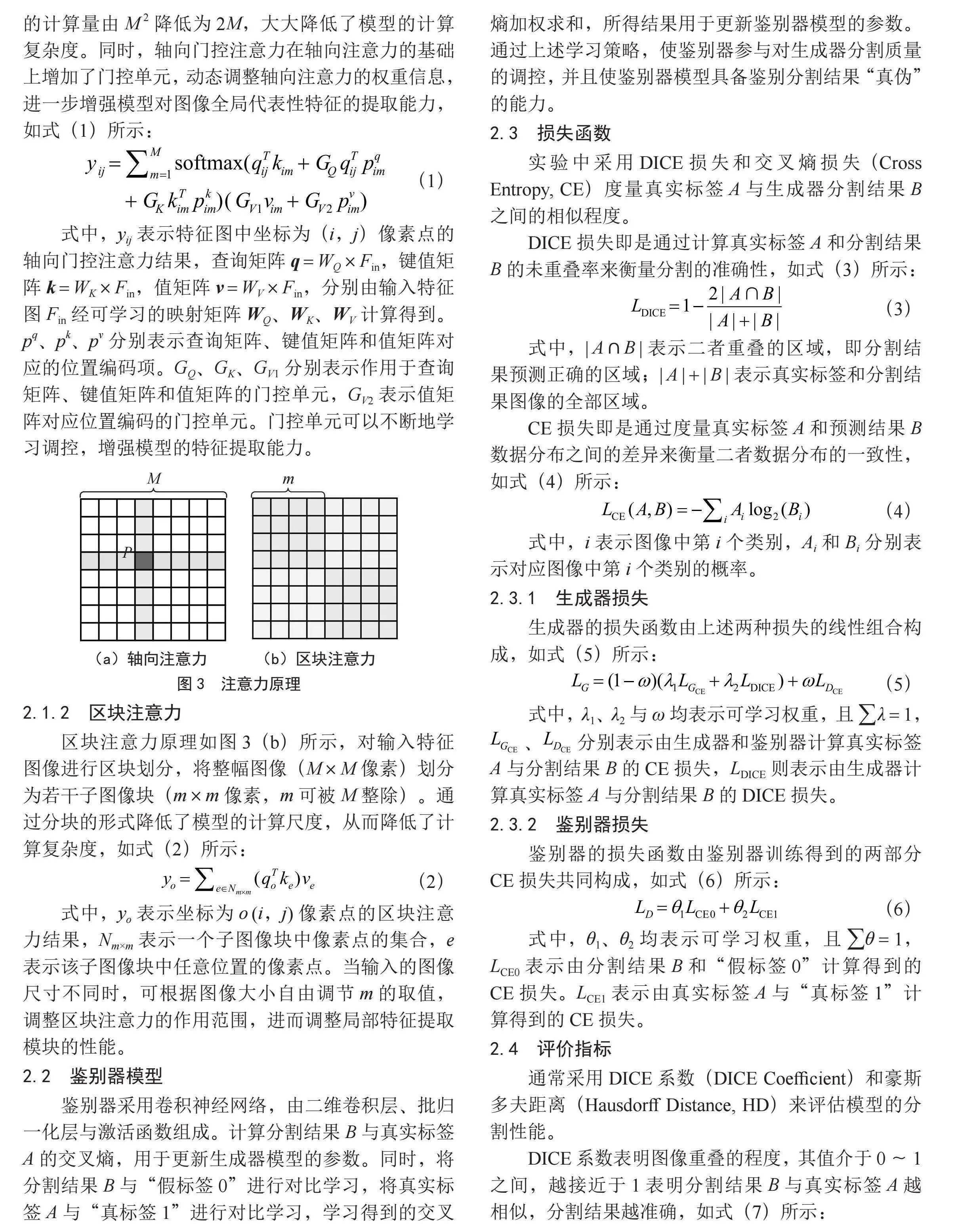

軸向注意力原理如圖3(a)所示,設圖像大小為M×M像素。軸向注意力對圖中某點P的全局注意力是通過計算以點P為中心,橫向一行與縱向一列的像素點得到的。與傳統注意力機制相比,計算量由整幅圖像降為橫向與縱向兩個軸上,即將全局注意力的計算量由M 2降低為2M,大大降低了模型的計算復雜度。同時,軸向門控注意力在軸向注意力的基礎上增加了門控單元,動態調整軸向注意力的權重信息,進一步增強模型對圖像全局代表性特征的提取能力,如式(1)所示:

式中,yij表示特征圖中坐標為(i,j)像素點的軸向門控注意力結果,查詢矩陣q = WQ×Fin,鍵值矩陣k = WK×Fin,值矩陣v = WV×Fin,分別由輸入特征圖Fin經可學習的映射矩陣WQ、WK、WV計算得到。pq、pk、pv分別表示查詢矩陣、鍵值矩陣和值矩陣對應的位置編碼項。GQ、GK、GV1分別表示作用于查詢矩陣、鍵值矩陣和值矩陣的門控單元,GV2表示值矩陣對應位置編碼的門控單元。門控單元可以不斷地學習調控,增強模型的特征提取能力。

2.1.2 區塊注意力

區塊注意力原理如圖3(b)所示,對輸入特征圖像進行區塊劃分,將整幅圖像(M×M像素)劃分為若干子圖像塊(m×m像素,m可被M整除)。通過分塊的形式降低了模型的計算尺度,從而降低了計算復雜度,如式(2)所示:

式中,yo表示坐標為o (i,j)像素點的區塊注意力結果,Nm×m表示一個子圖像塊中像素點的集合,e表示該子圖像塊中任意位置的像素點。當輸入的圖像尺寸不同時,可根據圖像大小自由調節m的取值,調整區塊注意力的作用范圍,進而調整局部特征提取模塊的性能。

2.2 鑒別器模型

鑒別器采用卷積神經網絡,由二維卷積層、批歸一化層與激活函數組成。計算分割結果B與真實標簽A的交叉熵,用于更新生成器模型的參數。同時,將分割結果B與“假標簽0”進行對比學習,將真實標簽A與“真標簽1”進行對比學習,學習得到的交叉熵加權求和,所得結果用于更新鑒別器模型的參數。通過上述學習策略,使鑒別器參與對生成器分割質量的調控,并且使鑒別器模型具備鑒別分割結果“真偽”的能力。

2.3 損失函數

實驗中采用DICE損失和交叉熵損失(Cross Entropy, CE)度量真實標簽A與生成器分割結果B之間的相似程度。

DICE損失即是通過計算真實標簽A和分割結果B的未重疊率來衡量分割的準確性,如式(3)所示:

式中,| A ∩ B |表示二者重疊的區域,即分割結果預測正確的區域;| A | + | B |表示真實標簽和分割結果圖像的全部區域。

CE損失即是通過度量真實標簽A和預測結果B數據分布之間的差異來衡量二者數據分布的一致性,如式(4)所示:

式中,i表示圖像中第i個類別,Ai和Bi分別表示對應圖像中第i個類別的概率。

2.3.1 生成器損失

生成器的損失函數由上述兩種損失的線性組合構成,如式(5)所示:

式中,λ1、λ2與ω均表示可學習權重,且∑ λ = 1, 、 分別表示由生成器和鑒別器計算真實標簽A與分割結果B的CE損失,LDICE則表示由生成器計算真實標簽A與分割結果B的DICE損失。

2.3.2 鑒別器損失

鑒別器的損失函數由鑒別器訓練得到的兩部分CE損失共同構成,如式(6)所示:

式中,θ1、θ2均表示可學習權重,且∑θ = 1,LCE0表示由分割結果B和“假標簽0”計算得到的CE損失。LCE1表示由真實標簽A與“真標簽1”計算得到的CE損失。

2.4 評價指標

通常采用DICE系數(DICE Coefficient)和豪斯多夫距離(Hausdorff Distance, HD)來評估模型的分割性能。

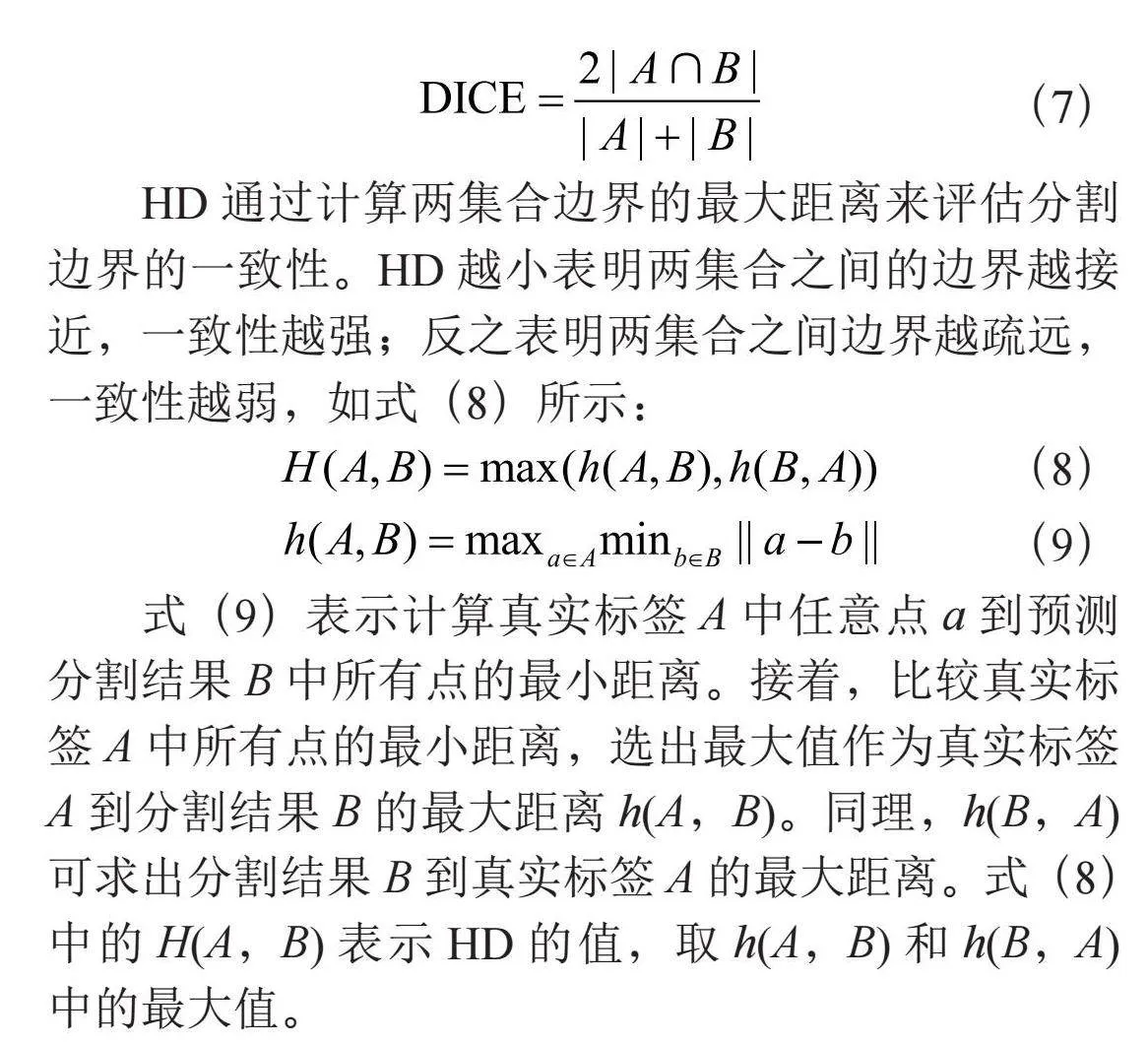

DICE系數表明圖像重疊的程度,其值介于0~1之間,越接近于1表明分割結果B與真實標簽A越相似,分割結果越準確,如式(7)所示:

HD通過計算兩集合邊界的最大距離來評估分割邊界的一致性。HD越小表明兩集合之間的邊界越接近,一致性越強;反之表明兩集合之間邊界越疏遠,一致性越弱,如式(8)所示:

式(9)表示計算真實標簽A中任意點a到預測分割結果B中所有點的最小距離。接著,比較真實標簽A中所有點的最小距離,選出最大值作為真實標簽A到分割結果B的最大距離h(A,B)。同理,h(B,A)可求出分割結果B到真實標簽A的最大距離。式(8)中的H(A,B)表示HD的值,取h(A,B)和h(B,A)中的最大值。

3 實驗測試

3.1 實驗數據集和實驗相關配置

本實驗所用數據集是由心臟分割挑戰賽(Automated Cardiac Diagnosis Challenge, ACDC)提供的心臟MR圖像[15]。該數據集是由150位患者舒張期(End Diastole, ED)和收縮期(End Systole, ES)的心臟MR圖像以及對應的真實標簽圖像所構成。數據集中包括正常群體、既往心梗患者、擴張型心肌患者、肥厚型心肌患者和右心室異常患者的心臟MR圖像,共五個醫療組,每個醫療組30例圖像。每例MR圖像的二維切片數量在9~18之間,對應的真實標簽圖像包括右心室(Right Ventricle, RV)、心肌(Myocardium, MYO)、左心室(Left Ventricle, LV)和背景四類標簽。

數據集的劃分如下:訓練集包括五個醫療組各18例共計90例心臟MR圖像,驗證集包括五個醫療組各2例共計10例心臟MR圖像,測試集使用官方挑戰賽固定的五個醫療組各10例共計50例心臟MR圖像。在訓練前對所有待使用的MR圖像進行切片和圖像尺寸標準化預處理,通過裁剪和填充將圖像修改為256×256像素。所有實驗均在原始數據量的前提下進行,分別對舒張期和收縮期兩個階段預處理后的圖像進行訓練和驗證。

本實驗使用的是基于PyThorch框架搭建的網絡模型,訓練過程中分別將生成器和鑒別器的學習率設定為0.000 1和0.000 05,且分別使用Adam優化器和RMSprop優化器。Axi_Block表示僅使用軸向區塊注意力模型作為生成器的模型;Axi_Block_GAN表示使用Axi_Block作為生成器并加上鑒別器的完整模型。

3.2 實驗結果

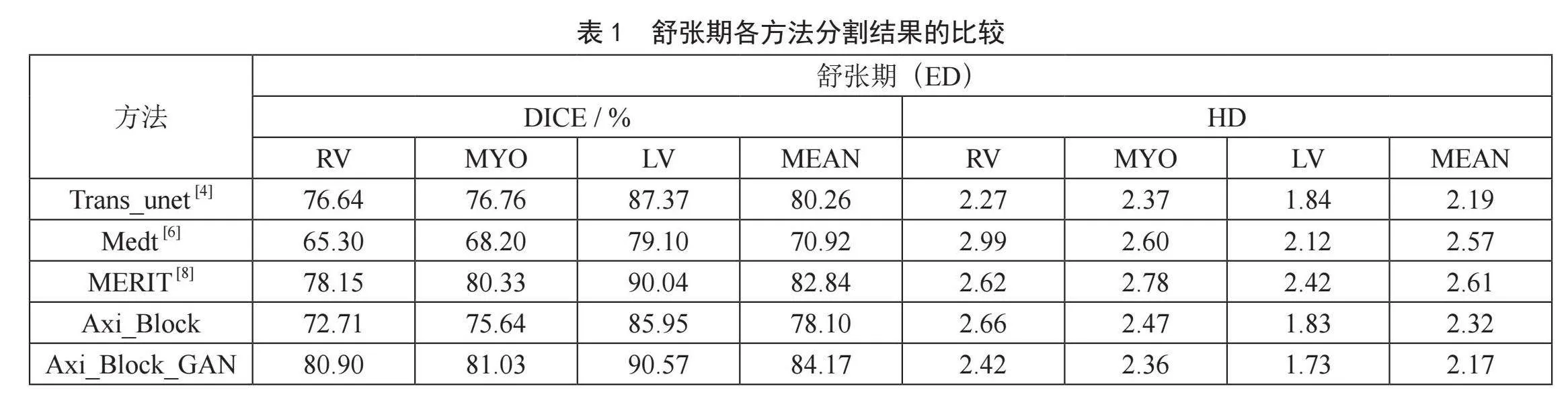

表1是所提模型與其他模型在心臟舒張期圖像分割結果上的對比。實驗結果表明:本文模型的右心室、心肌和左心室分割結果的DICE系數均高于其他方法,HD整體較好。心臟分割的平均DICE系數為84.17%(0.04),平均HD為2.17(0.54)。本文方法的分割精度優于其他方法,且分割的一致性最好。

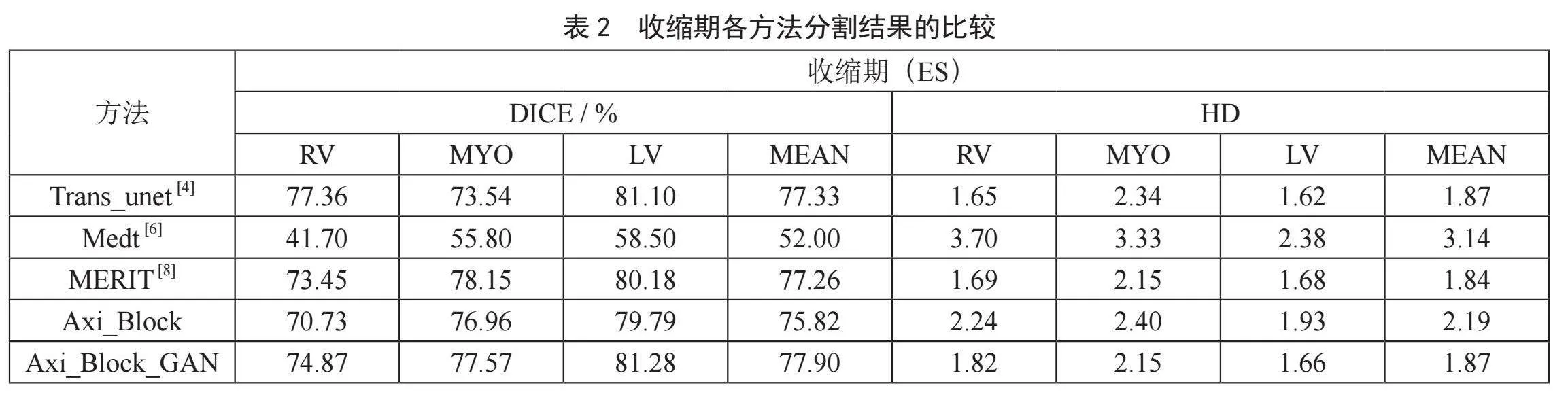

表2是所提模型與其他模型在心臟收縮期圖像分割結果上的對比。實驗結果表明:分割結果的DICE系數較好為77.90%(0.04),平均HD略高于其他方法為1.87(0.71)。本文方法的分割精度優于其他方法。

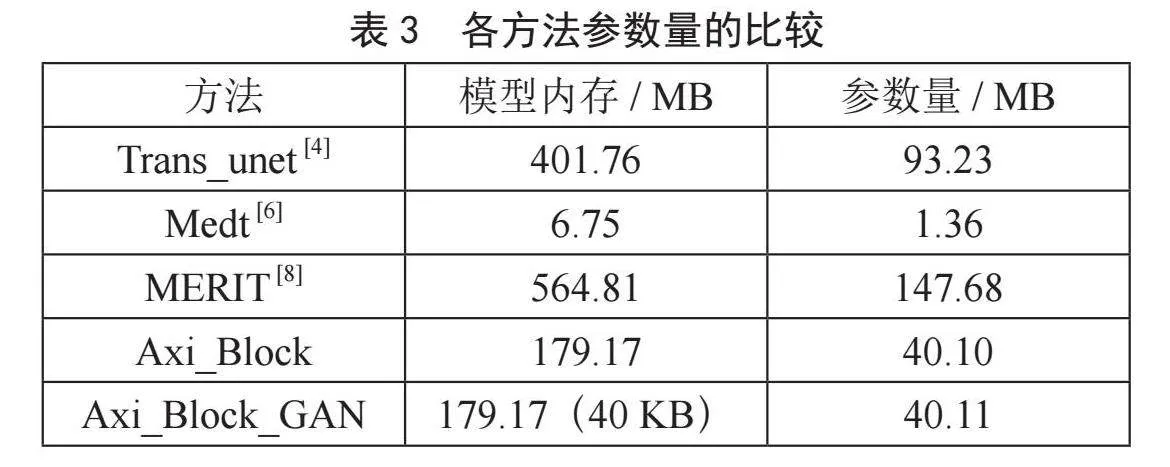

表3是各方法模型內存與參數量的比較。由Medt模型的實驗數據可知,參數量與模型性能成正相關。本文方法在較少參數量的情況下表現出較好的性能,實驗驗證了本文方法的有效性與優越性。括號內為鑒別器模型所占內存大小。

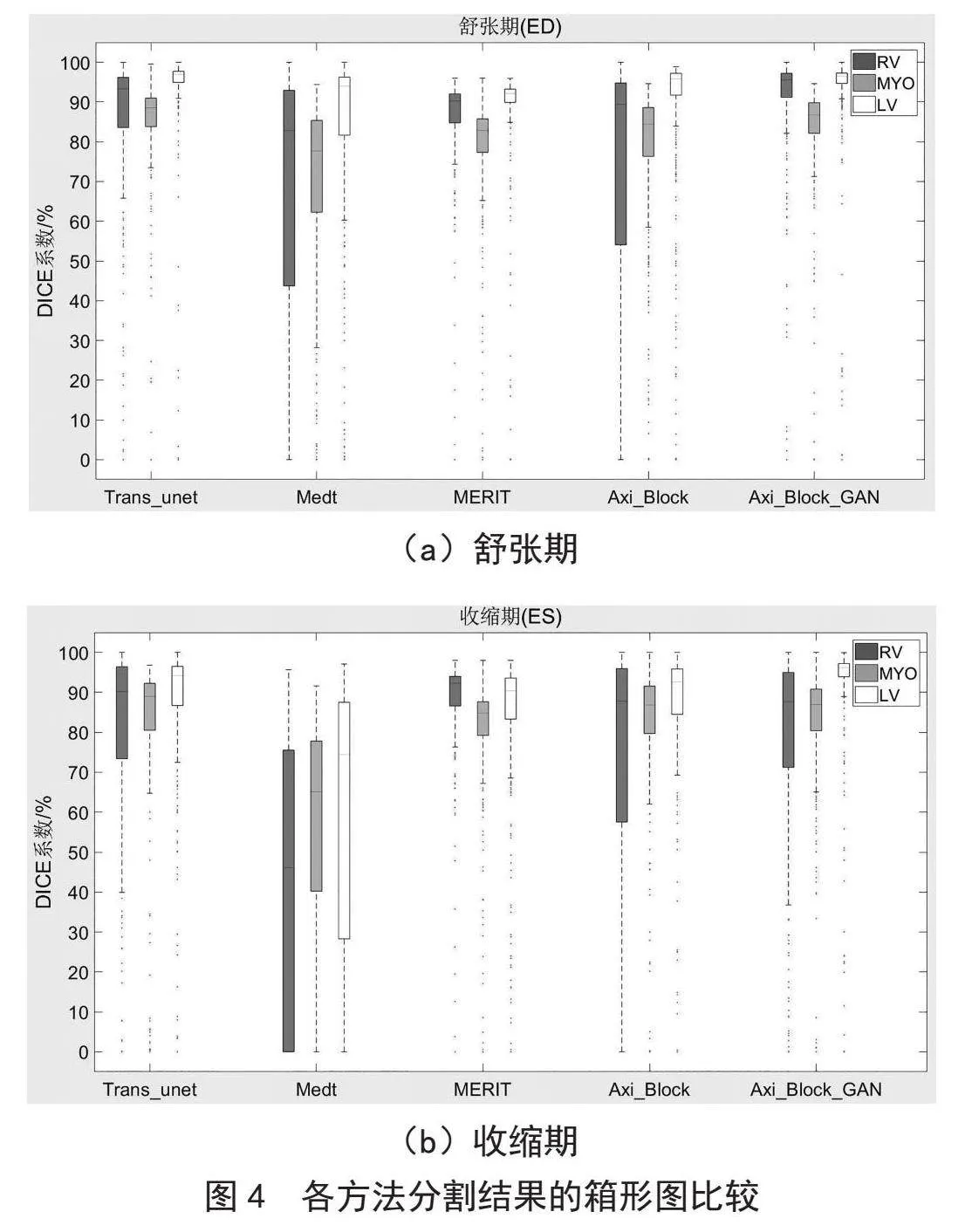

圖4為上述各方法在舒張期和收縮期分割結果的箱形圖比較。從圖4(a)中可以看出,在舒張期本文方法具有較強的分割性能且整體更加穩定;從圖4(b)中可以看出,在收縮期本文方法整體性能較好,且左心室分割效果最優。

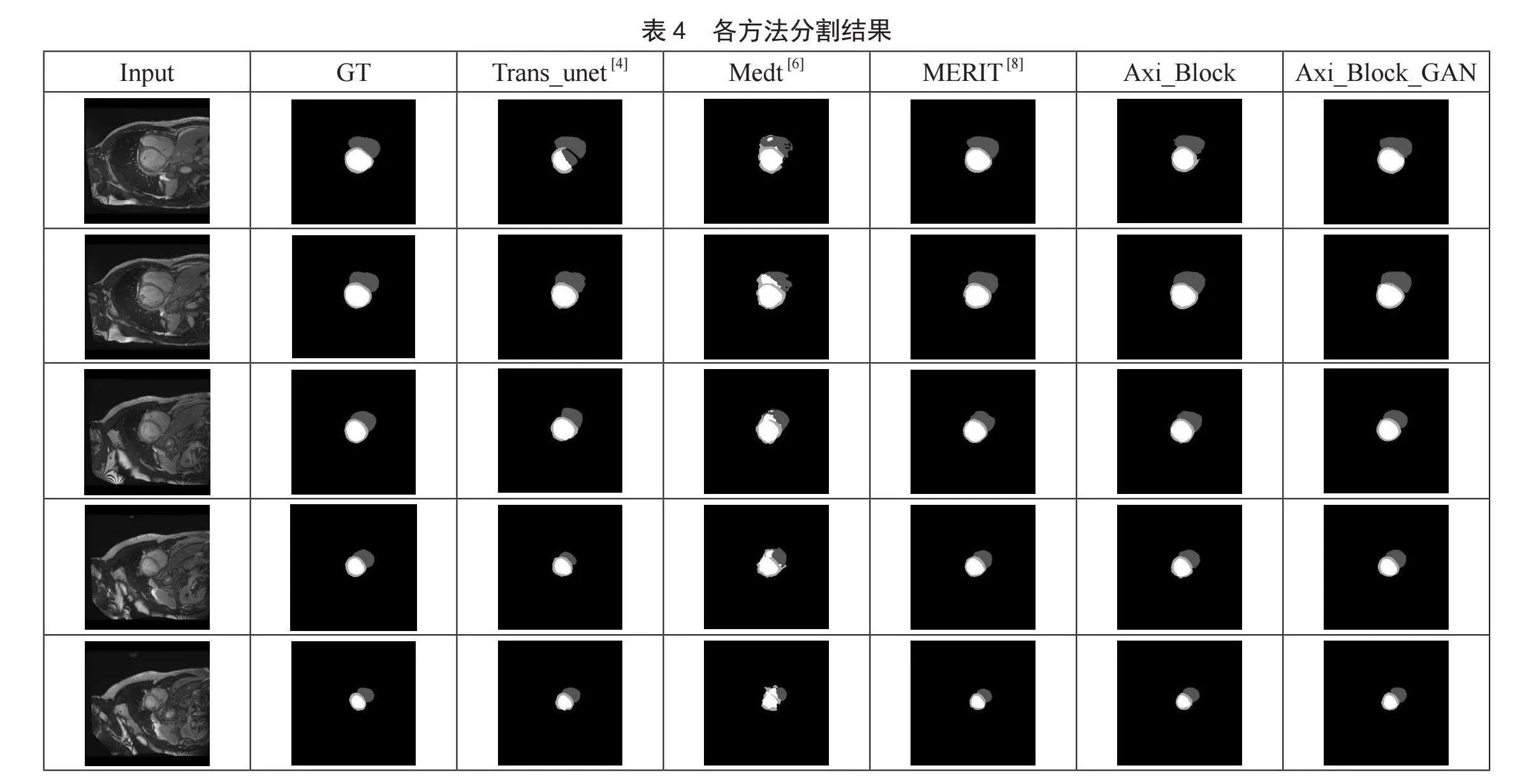

表4是本文方法與其他方法分割結果的對比。標簽圖由左心室(白色部分)、心肌(淺灰色部分)、右心室(深灰色部分)和背景(黑色部分)組成。從對比圖中可以看出,本文方法的結果與金標簽圖像更為接近,且各標簽分割結果連續無細小偽影,整體的分割效果更加接近金標簽更好。

4 結 論

采用軸向門控注意力提取圖像的全局特征,結合區塊注意力提取圖像的局部特征,二者組合使用有效降低了模型的參數量,同時也充分提升了模型的特征提取能力;結合多尺度特征信息融合策略,得到更加豐富、全面的特征信息;使用生成對抗策略生成一致性更好的分割結果。實驗結果表明,所提模型性能較好,分割結果準確且穩定。

參考文獻:

[1] 陳偉偉,高潤霖,劉力生,等.《中國心血管病報告2017》概要 [J].中國循環雜志,2018,33(1):1-8.

[2] KRAMER C M,BARKHAUSEN J,BUCCIARELLI-DUCCI C,et al. Standardized Cardiovascular Magnetic Resonance Imaging (CMR) Protocols: 2020 Update [J].Journal of Cardiovascular Magnetic Resonance,2020,22(1):1-18.

[3] LI Y Z,WANG Y,HUANG Y H,et al. RSU-Net: U-net Based on Residual and Self-attention Mechanism in the Segmentation of Cardiac Magnetic Resonance Images [J].Computer Methods and Programs in Biomedicine,2023,231:107437-107437.

[4] CHEN J N,LU Y Y,YU Q H,et al. Transunet: Transformers Make Strong Encoders for Medical Image Segmentation [J/OL].arXiv:2102.04306v1 [cs.CV].[2023-11-16].https://arxiv.org/abs/2102.04306.

[5] WANG H Y,ZHU Y K,GREEN B,et al. Axial-Deeplab: Stand-alone Axial-Attention for Panoptic Segmentation [C]//European Conference on Computer Vision. [S.I.]:Springer,2020:108-126.

[6] VALANARASU J M J,OZA P,HACIHALILOGLU I,et al. Medical Transformer: Gated Axial-attention for Medical Image Segmentation [C]//Medical Image Computing and Computer Assisted Intervention. [S.I.]:Springer,2021:36-46.

[7] TU Z Z,TALEBI H,ZHANG H,et al. MaxViT: Multi-axis Vision Transformer [C] //European Conference on Computer Vision. [S.I.]:Springer,2022:459-479.

[8] RAHMAN M M,MARCULESCU R. Medical Image Segmentation via Cascaded Attention Decoding [C]//Proceedings of the IEEE/CVF Winter Conference on Applications of Computer Vision. [S.I.]:IEEE,2023:6222-6231.

[9] TRAGAKIS A,KAUL C,MURRAY-SMITH R,et al. The Fully Convolutional Transformer for Medical Image Segmentation [C] //Proceedings of the IEEE/CVF Winter Conference on Applications of Computer Vision. [S.I.]:IEEE,2023:3660-3669.

[10] GOODFELLOW I J,POUGET-ABADIE J,MIRZA M,et al. Generative Adversarial nets [C]//Proceedings of the 27th International Conference on Neural Information Processing Systems. [S.I.]:Cambridge,2014:2672-2680.

[11] KOHL S,BONEKAMP D,SCHLEMMER H P,et al. Adversarial Networks for the Detection of Aggressive Prostate Cancer [J/OL].arXiv:1702.08014v1 [cs.CV].[2023-11-06].https://arxiv.org/abs/1702.08014.

[12] PEIRIS H,CHEN Z L,EGAN G,et al. Duo-SegNet: Adversarial Dual-views for Semi-supervised Medical Image Segmentation [C]//Medical Image Computing and Computer Assisted Intervention–MICCAI 2021. [S.I.]:Springer,2021:428-438.

[13] QI L,ZHANG H R,TAN W J,et al. Cascaded Conditional Generative Adversarial Networks with Multi-scale Attention Fusion for Automated Bi-ventricle Segmentation in Cardiac MRI [J].IEEE Access,2019,7:172305-172320.

[14] HOWARD A G,ZHU M L,CHEN B,et al. MobileNets: Efficient Convolutional Neural Networks for Mobile Vision Applications [J/OL].arXiv:1704.04861v1 [cs.CV].[2023-11-09].http://www.arxiv.org/abs/1704.04861 2017.

[15] BERNARD O,LALANDE A,ZOTTI C,et al. Deep Learning Techniques for Automatic MRI Cardiac Multi-Structures Segmentation and Diagnosis: Is the Problem Solved? [J].IEEE Transactions on Medical Imaging,2018,37(11):2514-2525.

作者簡介:王博(1999—),男,漢族,河南安陽人,碩士研究生在讀,研究方向:醫學圖像處理與人工智能。