基于改進YOLOv5的陶瓷表面缺陷檢測算法

摘 要:提出一種陶瓷表面缺陷檢測算法YOLOv5-G。該算法在YOLOv5框架的基礎上,將全局注意力機制(GAM)引入主干和頸部網絡中,該機制能夠在減少信息彌散的情況下放大全局交互特征,增強了網絡的特征表達能力;使用α-CIoU作為改進算法的邊界框回歸損失函數,自適應地向上加權高IoU對象的損失和梯度,使得模型可以更加關注IoU高的目標,從而幫助提高定位精度。在工業相機成像的陶瓷表面缺陷數據集上進行測試,結果表明,與YOLOv5模型相比,基于α-CIoU的YOLOv5模型的平均精度均值(mAP50)和召回率(Recall)分別提升了2.3%、4.6%;改進算法的平均精度均值(mAP50)、精確率(Precision)、召回率(Recall)分別提升了3.9%、1.7%、5.1%。

關鍵詞:陶瓷表面缺陷;全局注意力機制;α-IoU;YOLOv5

中圖分類號:TP183;TP391.4 文獻標識碼:A 文章編號:2096-4706(2024)13-0070-06

Ceramic Surface Defect Detection Algorithm Based on Improved YOLOv5

PAN Jinjing1, ZENG Cheng1, ZHANG Jing1, LI Zaiyong1, GENG Xuena2

(1.CYG Vision Technology (Zhuhai) Co., Ltd., Zhuhai 519085, China; 2. School of Computer Science and Technology, Changchun University of Science and Technology, Changchun 130013, China)

Abstract: It propose a ceramic surface defect detection algorithm YOLOv5-G. This algorithm introduces the Global Attention Mechanism (GAM) into the backbone and neck networks based on the YOLOv5 framework. This mechanism can amplify the global interaction features while reducing the information dispersion, and enhances the feature expression capability of the network. Taking α-CIoU as the bounding box regression loss function of the improved algorithm, the loss and gradient of high IoU objects are adaptively weighted upward, so that the model can pay more attention to the targets with high IoU, thus helping to improve the positioning accuracy. The test is carried out on the ceramic surface defect data set of the industrial camera imaging, and the results show that compared with the YOLOv5 model, the Mean Average Precision (mAP50) and Recall rate of the YOLOv5-G model based on α-CIoU are increased by 2.3% and 4.6% respectively. The Mean Average Precision (mAP50), Precision and Recall of the improved algorithm are all significantly improved by 3.9%, 1.7% and 5.1% respectively.

Keywords: ceramic surface defect; GAM; α-IoU; YOLOv5

0 引 言

陶瓷的表面質量直接影響到其外觀和使用壽命。因此,準確、有效的陶瓷表面缺陷檢測方法是非常重要的。目前,陶瓷表面缺陷檢測仍然主要依賴于人工檢測。該方法效率低下且評價標準過于主觀,不能滿足工業生產的需求。為了提高檢測的效率和準確性,越來越多的學者采用不同的技術進行陶瓷表面缺陷檢測。目前陶瓷缺陷檢測方法主要包括超聲波檢測[1]、機器視覺檢測、X射線檢測法[2]等。超聲波檢測依賴于陶瓷表面的反射和折射,其檢測精度和靈敏度與缺陷的深度有關,對于陶瓷表面顏色缺陷的檢測效果較差。X射線掃描陶瓷采用透射成像原理,可以檢測出小的內外缺陷。但該方法成本高、效率低,不適用于大規模陶瓷缺陷檢測。機器視覺檢測方法主要分為傳統方法和基于深度學習的檢測方法。

傳統方法主要依據缺陷顏色、形狀等特征,利用圖像處理方法或結合傳統機器學習方法進行檢測[3]。傳統方法依賴于經驗豐富的專家手工制作的特征,這些特征往往是有限的,有高度針對性的。由于陶瓷表面缺陷種類繁多,形態多樣,背景復雜,一旦產品材料或生產環境發生變化,傳統方法中的有限特征模板將難以應用。

基于深度學習的代表性檢測算法主要包括Faster R-CNN [4]和YOLO系列[5-8]。Faster R-CNN通常具有較高的檢測精度,但處理速度較慢;YOLOv5模型具有準確性、快速性、高效性優點,已被應用于不同場景下的智能缺陷檢測。蔣亞軍等[9]在YOLOv5s的骨干網絡中加入CBAM模塊,并增加一個檢測頭,有效提高了紙杯缺陷的檢測能力,對小尺寸和特征不明顯紙杯缺陷的檢測效果有明顯提升;王恩芝等[10]在YOLOv5骨干網絡中加入卷積注意力模塊,并在頸部引入自適應空間融合方法,提高了對織物缺陷的檢測精度;王旭等[11]在YOLOv5的骨干網絡中引入CBAM模塊,并用CARAFE算子替換原YOLOv5中最近鄰上采樣算子,有效地提高了對陶瓷環缺陷的檢測精度。

綜上,本文提出了一種改進YOLOv5的陶瓷表面缺陷檢測算法YOLOv5-G。首先,在YOLOv5的骨干網絡和頸部中引入全局注意力機制(Global Attention Mechanism, GAM)[12],使模型在通道、高度及寬度這三個維度上進一步提取缺陷特征,降低漏檢率。其次,引入α-IoU [13]作為改進算法的邊界框損失函數,自適應地向上加權高IoU對象的損失和梯度,使得模型可以更加關注IoU高的目標,加速了預測框的收斂,提高了預測框的回歸精度。本文在工業相機成像的陶瓷表面缺陷數據集上進行改進前后模型的驗證。結果表明,相較于YOLOv5模型,改進算法的檢測精度有明顯提升,可以較好地應用于陶瓷表面缺陷檢測任務中。

1 YOLOv5基本原理

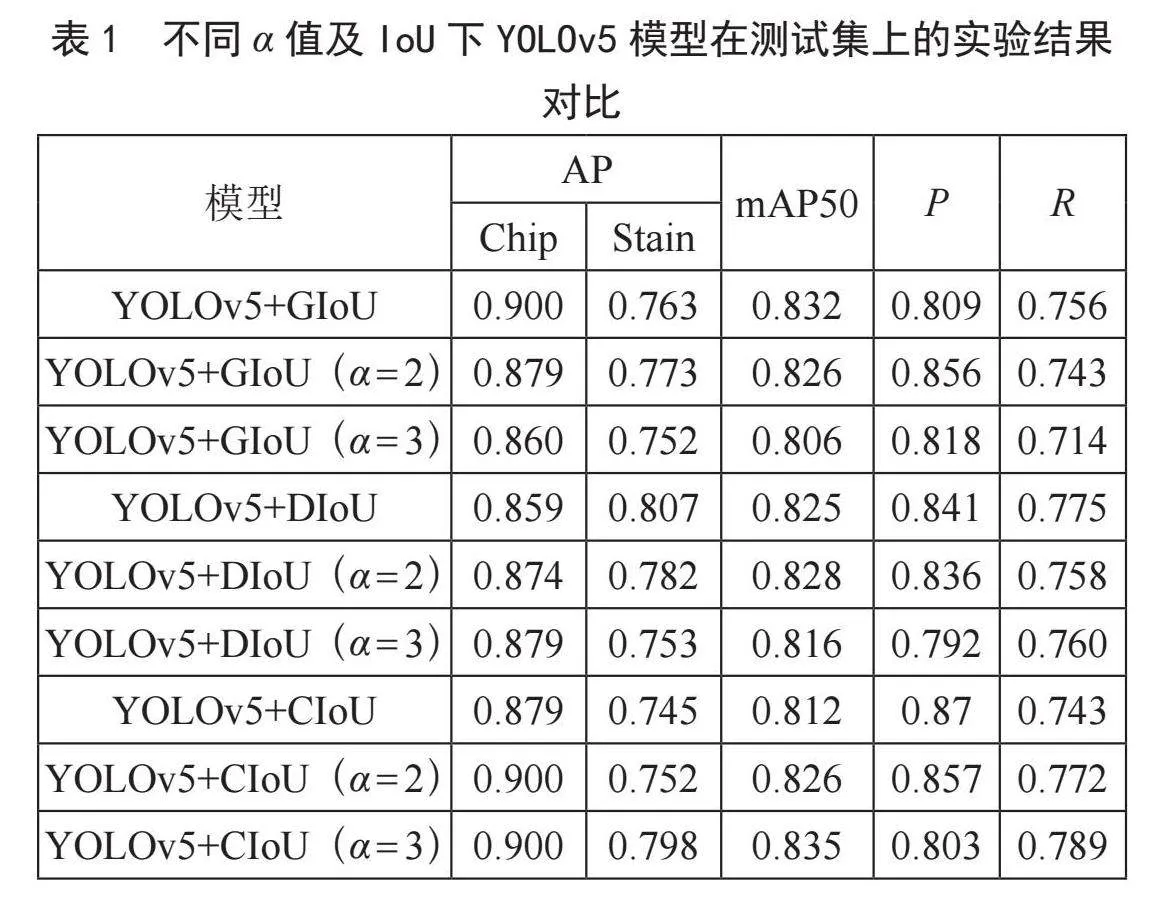

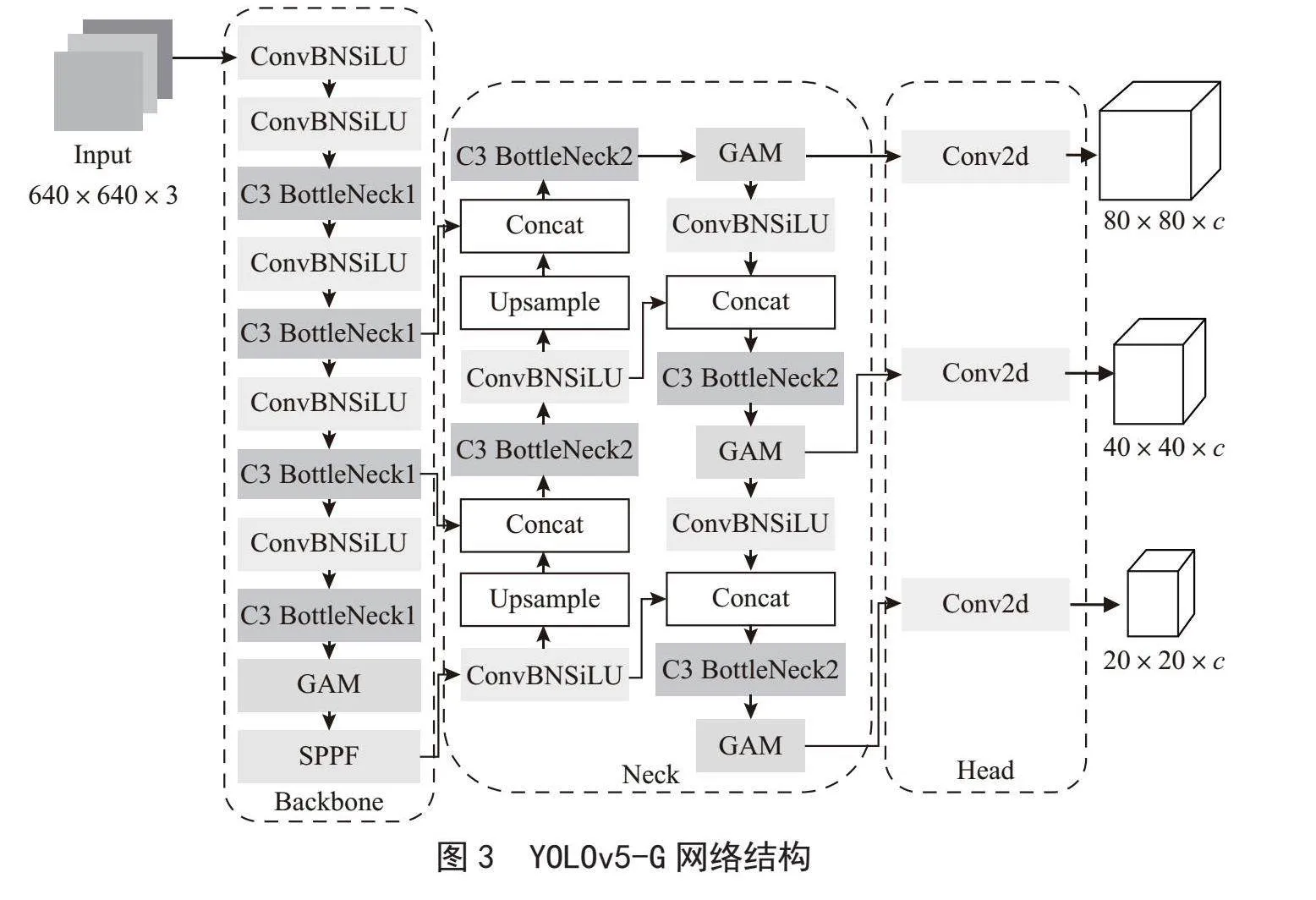

YOLOv5作為單階段目標檢測算法的SOTA(State-of the-Art),包括輸入端(Input)、骨干網絡(Backbone)、頸部(Neck)和頭部(Head)四部分。YOLOv5通過width_multiple和depth_multiple兩個參數來控制模型的寬度和深度,對應s、m、l、x這4種規模的網絡。其中,YOLOv5s的深度及特征圖寬度最小,其余網絡在此基礎上不斷加深、加寬,復雜度與精度也隨之提升。本文為了滿足工業場景下檢測速度與精度的權衡,選擇了YOLOv5s_6.0為基礎模型。圖1展示了YOLOv5_6.0的網絡結構。

1.1 輸入端

輸入端通過自適應圖片縮放將原始圖片統一縮放到一個標準尺寸,進行填充后,送入主干網絡中。使用Mosaic數據增強,隨機地將4張圖片進行縮放裁剪并拼接成新的圖片,該方法可以豐富檢測數據集,讓網絡的魯棒性更好。不同于傳統目標檢測算法需要手動設置錨框的大小和高寬比等參數,YOLOv5在訓練代碼中嵌入自適應錨框計算功能,自動獲取訓練數據集所對應的最佳錨框值,實現更精準的目標檢測。

1.2 主干網絡

主干網絡能夠從圖像中提取特征。如圖1所示,YOLOv5的主干網絡主要包括ConBNSiLU、C3及SPPF模塊。其中,ConBNSiLU是由2D卷積層、BN層及SiLU激活函數組成,其作用是進行特征提取,減少計算量和參數量,達到提速效果。C3由n個Bottleneck、3個ConBNSiLU及Concat模塊構成,C3減少了梯度信息的重復,增加網絡的深度和感受野,提高了骨干網絡的特征提取能力。YOLOv5_6.0用SPPF結構代替空間金字塔池化結構SPP [14],將輸入串行通過3個5×5大小的最大池化層,在輸出與SPP相同的條件下,速度更快。SPPF可以在一定程度上融合多尺度特征。

1.3 頸部網絡

頸部由特征金字塔(Feature Pyramid Network, FPN)[15]及路徑聚合網絡(Path Aggregation Network, PANet)[16]構成。FPN采用上采樣的方式將深層的強語義特征傳達到淺層,而PANet則通過下采樣的方式向深層傳達強定位信息,二者聯合,從不同的主干層對不同的檢測層進行參數聚合,生成具有多尺度信息的特征圖,以提高目標檢測的準確率。

1.4 輸出端

Head部分主要為檢測模塊,由3個1×1卷積構成,對應3個檢測特征層。當輸入圖片大小為640×640時,三個尺度上的特征圖大小分別為80×80、40×40、20×20,相對于輸入圖像分別做了8、16及32倍下采樣,分別適合檢測小目標、中等目標以及大目標。三個特征層對應的通道數為(類別數量+5)×每個檢測層上的錨框數量,其中5分別對應目標置信度和預測框坐標。

1.5 損失函數

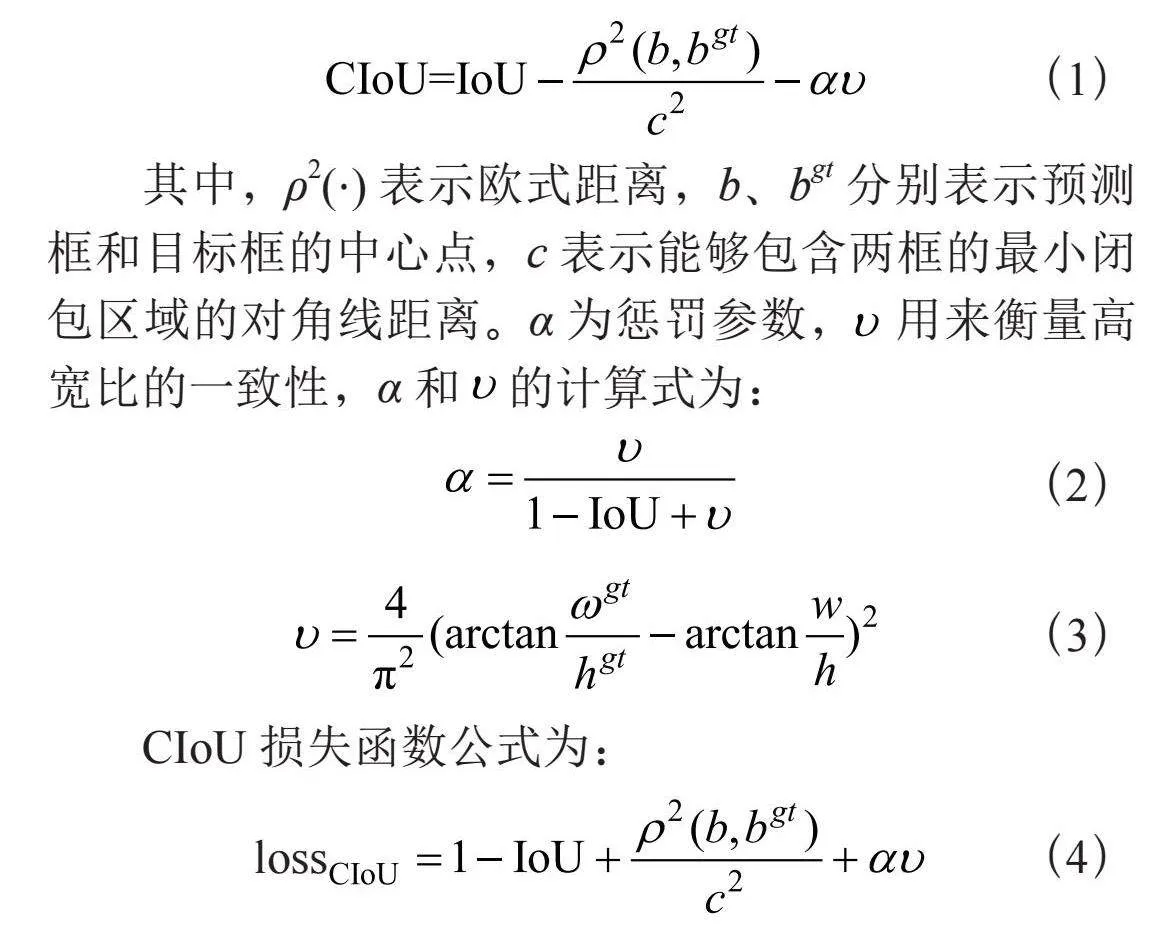

損失函數主要由3部分組成:分類損失、置信度損失及定位損失。其中,分類損失和置信度損失采用二元交叉熵來計算,定位損失采用CIoU [17]損失來計算。CIoU考慮了3個重要的幾何因素:目標框與預測框的重疊面積、中心點距離及寬高比,保證了預測框和目標框的寬高比的一致性,提高了預測框的定位精度,加快了網絡的收斂速度。CIoU公式為:

其中,ρ2(?)表示歐式距離,b、bgt分別表示預測框和目標框的中心點,c表示能夠包含兩框的最小閉包區域的對角線距離。α為懲罰參數, 用來衡量高寬比的一致性,α和 的計算式為:

CIoU損失函數公式為:

2 改進的YOLOv5模型

2.1 GAM引入Backbone和Neck

注意力機制是計算機視覺中的一個重要概念,它是指模型能夠在處理輸入數據時,集中關注某些重要的部分,忽略其他無關的部分。在計算機視覺任務中,注意力機制可以幫助模型更好地理解輸入圖像或視頻,從而提高模型的性能。注意力機制在圖像任務中的性能改進已有很多研究。Squeeze-and-Excitation Networks(SENet)[18]首次使用通道注意和通道特征融合來抑制不重要的通道,但效率較低。卷積注意力模塊(CBAM)[19]同時考慮了通道和空間維度,但忽略了通道-空間的相互作用,從而失去了跨維信息。考慮到跨維度交互作用的重要性,三重注意模塊(TAM)[20]利用每一對通道、空間寬度和空間高度的三維信息來提高效率。但每次操作僅應用于兩個維度,而不是全部三個維度。GAM注意力機制能夠放大跨維度的交互作用,同時獲取通道,空間高度及寬度三個維度的特征,避免信息丟失,從而提高檢測的精度。

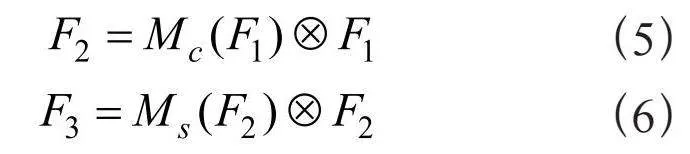

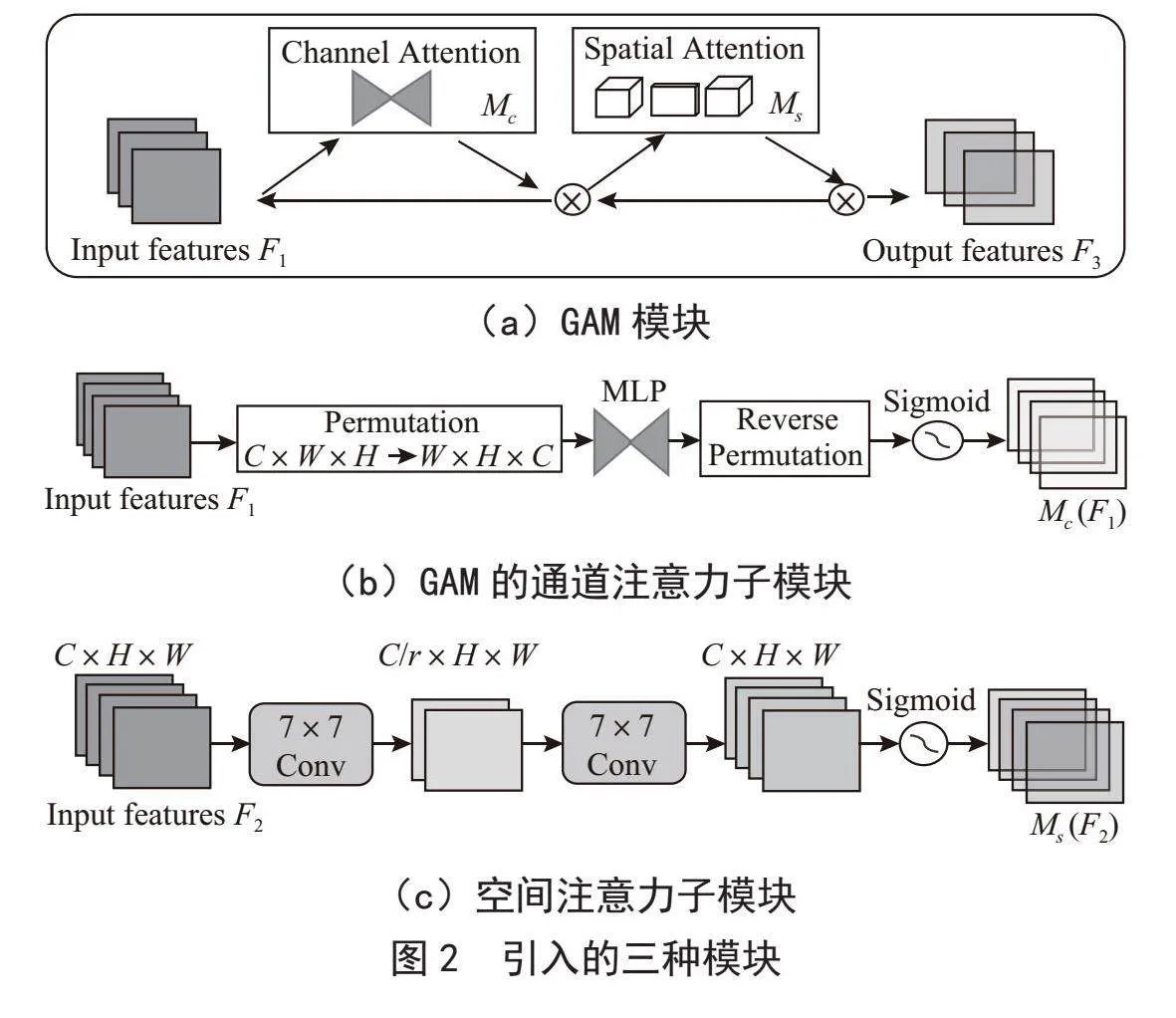

本研究在YOLOv5的骨干網絡及頸部引入GAM注意力模塊,如圖2(a)所示,給定輸入特征F1 ∈ RC×H×W,中間狀態和輸出如式(5)(6)所示:

其中,Mc和Ms分別表示通道和空間注意力圖,表示按元素進行乘法操作。GAM中的通道注意子模塊使用三維排列來保留三個維度上的信息,如圖2(b)所示。通過一個兩層的MLP(多層感知器)放大跨維的通道-空間依賴性。在空間注意力子模塊中,如圖2(c)所示,為了關注空間信息,使用兩個7×7卷積層進行空間信息融合。

GAM模塊能夠在減少信息彌散的情況下放大全局交互特征,增強了網絡的特征表達能力,能夠使得YOLOv5模型更加精準地進行目標檢測。YOLOv5-G將GAM模塊引入主干網絡和頸部,改進后的主干網絡如圖3所示。

2.2 α-IoU的引入

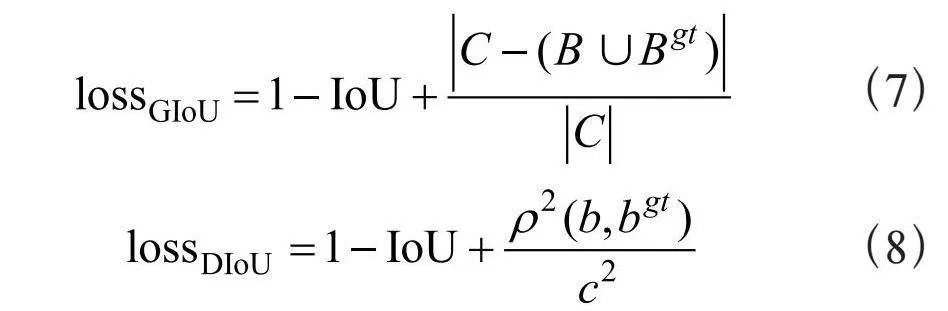

目標檢測作為計算機視覺的核心問題,其檢測性能依賴于損失函數的設計。邊界框損失函數作為目標檢測損失函數的重要組成部分,其良好的定義將為目標檢測模型帶來顯著的性能提升。早期的目標檢測工作使用IoU作為定位損失。然而,當目標框與預測框沒有交集時,IoU損失會出現梯度消失現象,導致無法繼續優化。這激發了幾種改進的基于IoU的損失設計,包括GIoU [21]、DIoU [17]、CIoU,計算式為:

其中,B和Bgt表示預測框和目標框,C表示包含B和Bgt的最小閉包,ρ2(?)表示歐幾里得距離,b和bgt表示預測框和目標框的中心點,w gt、hgt、w、h分別表示目標框及預測框的寬高。

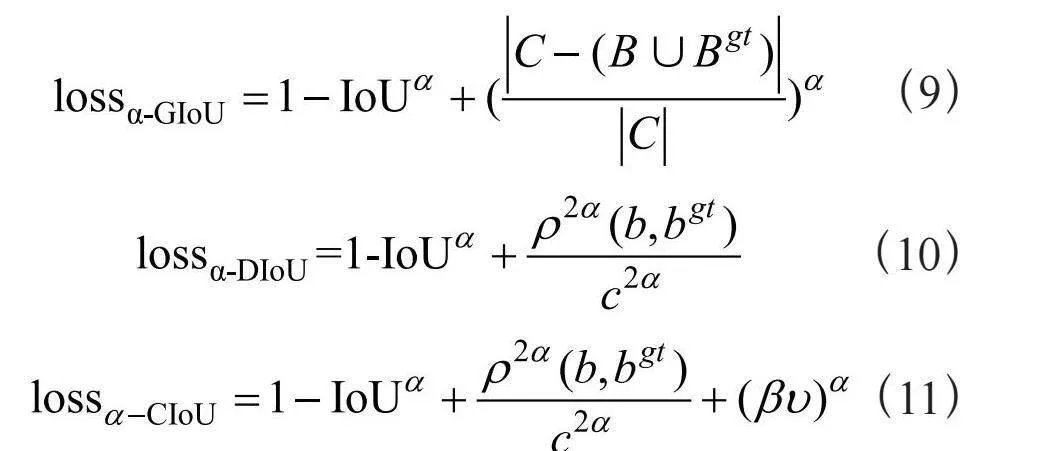

α-IoU表示一種新的IoU損失家族,通過在現有的IoU損失中引入power變換,用于控制IoU損失對總損失函數的貢獻,實現精準的預測框回歸和目標檢測。α-IoU對現有的基于IoU的損失進行了統一的冪化,合適的α值(即α>1)可以通過自適應地向上加權高IoU對象的損失和梯度,使得模型可以更加關注IoU高的目標,從而幫助提高定位精度。將α-IoU應用于GIoU、DIoU及CIoU,可得到α-GIoU,α-DIoU,α-CIoU,公式為:

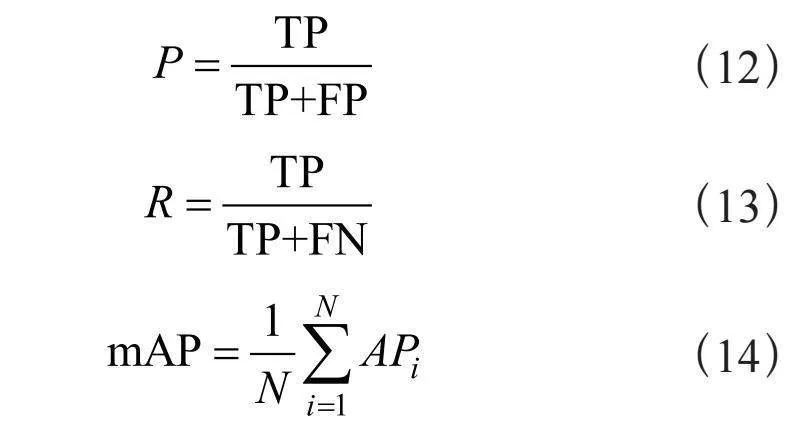

本文將探究不同的α值(α = 1,2,3)與不同IoU損失的組合在本研究數據集上對YOLOv5模型性能的影響,并選取最優的α值與IoU損失的組合。2NpFh3/ihd4P5CXGYCfvygbFL6xYphTLgX++Gq+Llp0=

3 實驗分析

3.1 實驗設置

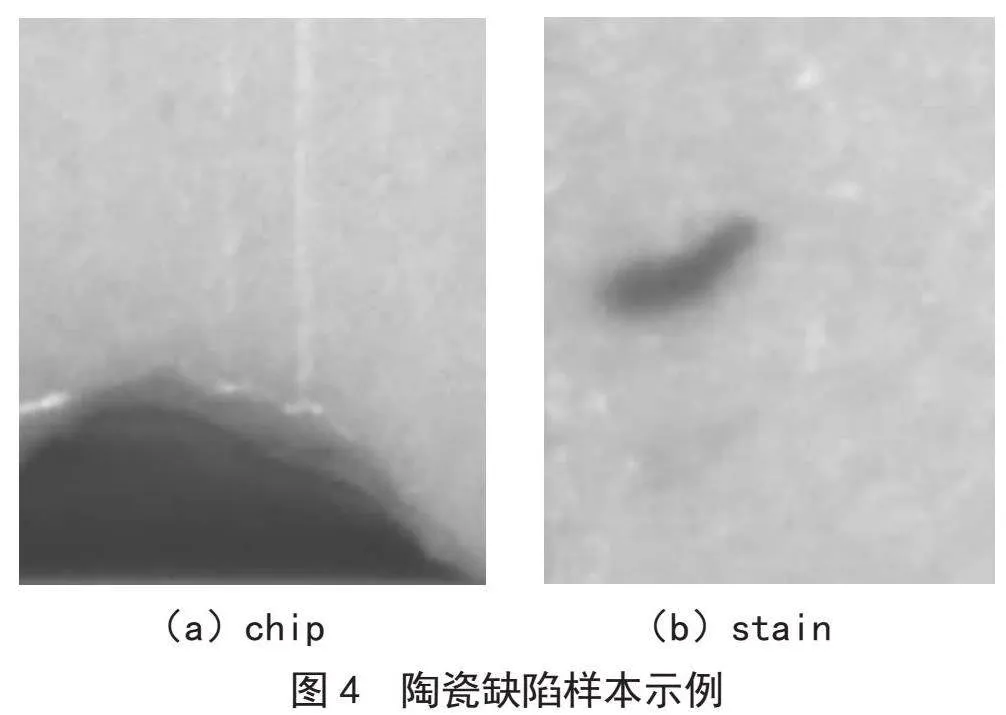

本實驗中使用的數據集來自工業相機成像,包含1 052張含標簽圖片。樣品的缺陷主要包括2種類別:chip(缺口)和stain(臟污),部分缺陷樣本如圖4所示。按照8:1:1的比例將數據集劃分為訓練集、驗證集和測試集。原始圖像尺寸為2 448×2 048×3,將所有輸入圖像尺寸統一裁剪為704×640×3。模型初始學習率為0.01,權重衰減系數為0.000 5,動量為0.937,Batch size為16,Epoch為450,使用Adam優化器進行參數優化。本實驗基于PyTorch深度學習框架,CPU為Intel Core i7 6600U,GPU為NVIDIA GeForce RTX 3090,用于加速運算,開發環境為Python 3.7.9,PyTorch 1.10.2,CUDA 11.6。

3.2 評估指標

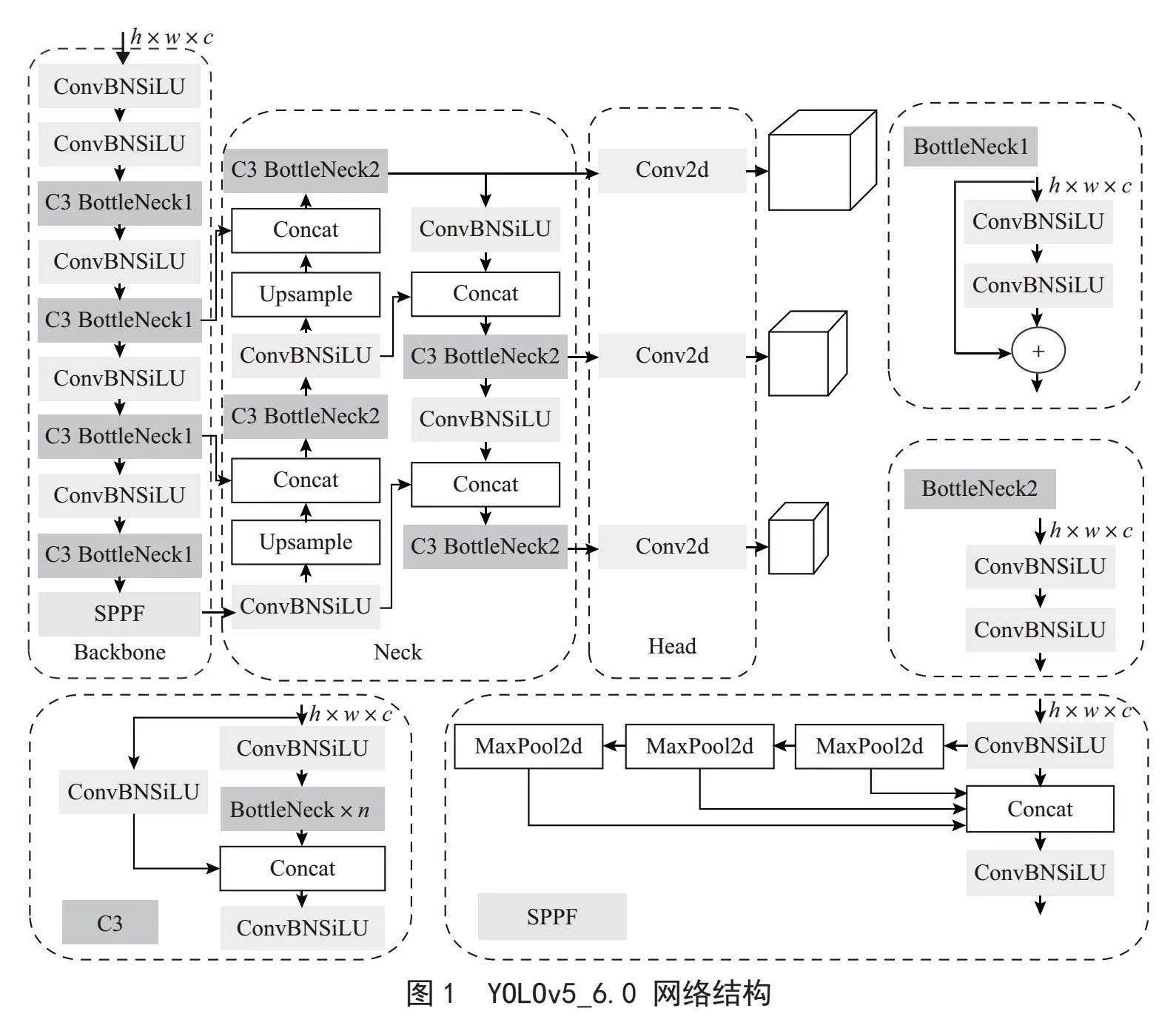

本實驗采用精確率(P),召回率(R)以及目標檢測領域常用的mAP50來評估YOLOv5模型及其改進模型的性能。計算式為:

精確率表示模型預測正確物體的能力,該指標表示在所有預測為缺陷的結果(TP+FP)中,模型預測為缺陷且正確的目標(TP)的占比。召回率表示模型能夠找全正確物體的能力,該指標表示在所有的缺陷樣本(TP+FN)中,模型預測為缺陷且正確的目標(TP)的占比。APi表示第i類的模型平均精度,若是多類別,則使用mAP(mean Average Precision)來衡量模型性能,計算方法為將多個AP值累加后求平均。mAP50是指在IoU閾值取0.5時的mAP值。

3.3 實驗結果分析

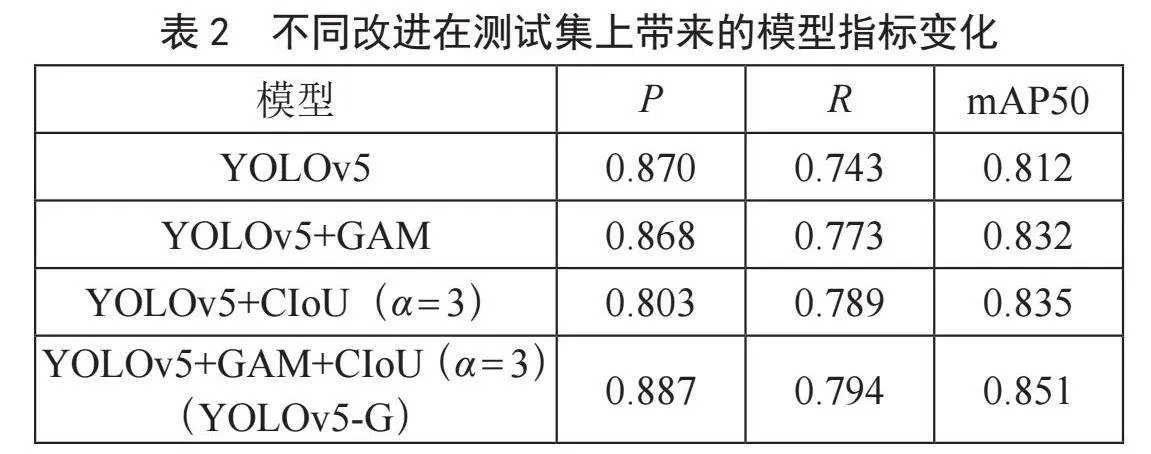

表1展示了YOLOv5模型在不同α值及IoU下,在測試集上的性能表現。通過表1可得出,YOLOv5在CIoU(α = 2)上具有最好的精確率,在CIoU(α = 3)上具有最好的召回率。對于不同模型的mAP50,CIoU(α = 3)表現最好,其次是GIoU和DIoU(α = 2)。YOLOv5+CIoU(α = 3)在本實驗中獲得了最好的mAP50和召回率,分別較之于YOLOv5原始模型(YOLOv5+CIoU)提升了2.3%、4.6%。因此,我們選用CIoU(α = 3)作為改進YOLOv5模型的邊界框回歸損失函數來提高模型的泛化能力。

改進后的模型YOLOv5-G,在主干網絡及頸部添加GAM模塊,將α-CIoU作為邊界框損失函數。將原模型及改進模型在測試集上進行測試,觀察不同改進對模型性能變化的影響。從表2可以觀察到,在引入GAM模塊后,相較于YOLOv5基礎模型,召回率提升了3.0%,mAP50提升了2.0%,但精確率略微有所下降。進一步地,將α-CIoU(α = 3)作為邊界框損失函數,YOLOv5-G相較于原模型,在精確率、召回率、mAP50上均有明顯提升,分別提升了1.7%、5.1%、3.9%。

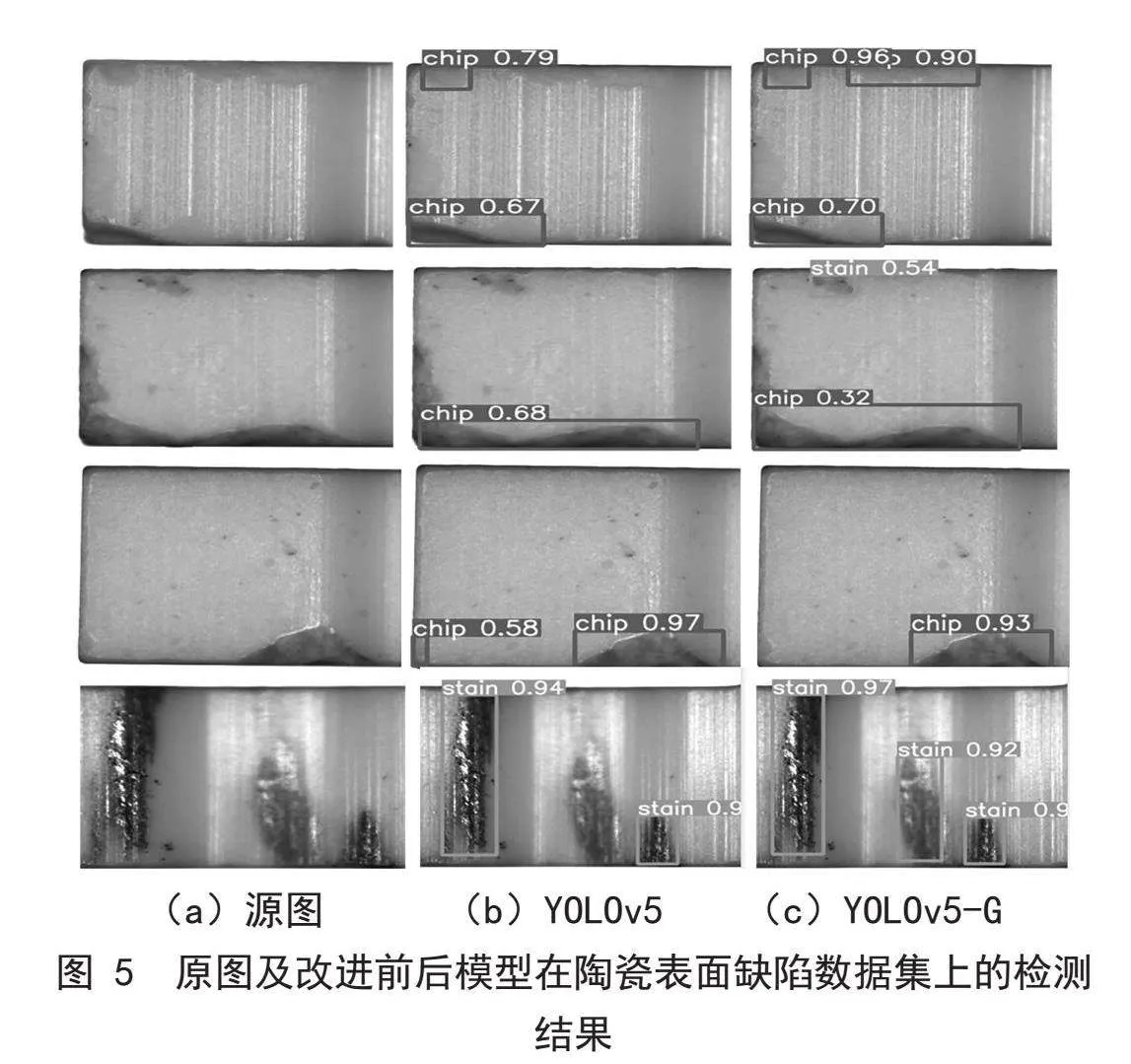

圖5展示了原圖及改進前后模型在陶瓷表面缺陷數據集上的檢測結果。第一、二組對比圖中,YOLOv5分別漏檢了一個chip缺陷及一個stain缺陷,而YOLOv5-G均將所有缺陷檢出;第三組圖像中,YOLOv5將圖左下角的微小陰影誤檢為chip缺陷,YOLOv5-G未出現誤檢現象;第四組對比圖中,YOLOv5漏檢了一塊較為明顯的stain缺陷,YOLOv5-G均以較高的置信度正確檢出,體現了更好的泛化性能。

4 結 論

本文基于YOLOv5提出了一種改進的陶瓷表面缺陷檢測算法(YOLOv5-G),在主干網絡及頸部加入全局注意力(GAM)模塊,增強了模型的特征表達能力,提高了檢測精度。引入α-CIoU(α = 3)邊界框回歸損失函數,進一步提高了缺陷的定位精度。實驗結果表明,YOLOv5-G算法相較于YOLOv5模型在精確率、召回率和平均精度值方面均得到了提升,具有優秀的檢測精度,能較好地應用于陶瓷表面缺陷檢測任務中。

參考文獻:

[1] CHESNOKOVA A A,KALAYEVA S Z,IVANOVA V A. Development of a Flaw Detection Material for the Magnetic Particle Method [J/OL].Journal of Physics: Conference Series,2017,881(1):12022[2023-11-20].https://iopscience.iop.org/article/10.1088/1742-6596/881/1/012022.

[2] PLESSIS A D,YADROITSAVA I,YADROITSEV I. Effects of Defects on Mechanical Properties in Metal Additive Manufacturing: A Review Focusing on X-ray Tomography Insights [J/OL].Materials & Design,2020,187:108385[2023-11-20].https://doi.org/10.1016/j.matdes.2019.108385.

[3] 羅東亮,蔡雨萱,楊子豪,等.工業缺陷檢測深度學習方法綜述 [J].中國科學:信息科學,2022,52(6):1002-1039.

[4] REN S Q,HE K M,GIRSHICK R,et al. Faster R-CNN: Towards Real-Time Object Detection with Region Proposal Networks [J].Advances in Neural Information Processing Systems,2017,39(6):1137-1149.

[5] REDMON J,FARHADI A. YOLO9000: Better,Faster,Stronger [C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Honolulu:IEEE,2017:6517-6525.

[6] REDMON J,FARHADI A. Yolov3: An Incremental Improvement [J/OL].arXiv:1804.02767 [cs.CV].(2018-04-08)[2023-12-01].https://arxiv.org/abs/1804.02767.

[7] BOCHKOVSKIY A,WANG C Y,LIAO H Y M. YOLOv4: Optimal Speed and Accuracy of Object Detection [J/OL].arXiv:2004.10934 [cs.CV].(2020-04-23)[2023-11-22].https://arxiv.org/abs/2009.10934.

[8] github. ultralytics/yolov5 [EB/OL].[2023-11-26].https://github.com/ultralytics/yolov5.

[9] 蔣亞軍,曹昭輝,丁椒平,等.基于改進YOLOv5s模型紙杯缺陷檢測方法 [J].包裝工程,2023,44(11):249-258.

[10] 王恩芝,張團善,劉亞.基于改進Yolo v5的織物缺陷檢測方法 [J].輕工機械,2022,40(2):54-60.

[11] 王旭,管聲啟,劉通,等.基于改進YOLOv5的陶瓷環缺陷檢測算法 [J].輕工機械,2023,41(3):66-71.

[12] LIU Y C,SHAO Z R,HOFFMANN N. Global Attention Mechanism: Retain Information to Enhance Channel-Spatial Interactions [J/OL].arXiv:2112.05561 [cs.CV].(2021-12-10)[2023-10-26].https://arxiv.org/abs/2112.05561.

[13] HE J B,ERFANI S,MA X J,et al. Alpha-IoU: A Family of Power Intersection over Union Losses for Bounding Box Regression [J/OL].arXiv:2110.13675 [cs.CV].(2022-1022)[2023-10-26].https://arxiv.org/abs/2110.13675.

[14] HE K M,ZHANG X Y,REN S Q,et al. Spatial Pyramid Pooling in Deep Convolutional Networks for Visual Recognition [J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2015,37(9):1904-1916.

[15] LIN T Y,DOLLAR P,GIRSHICK R,et al. Feature Pyramid Networks for Object Detection [C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR).Honolulu:IEEE,2017:936-944.

[16] LI H C,XIONG P F,AN J,et al. Pyramid Attention Network for Semantic Segmentation [J/OL].arXiv:1805.10180 [cs.CV].(2018-11-25)[2023-11-19].https://arxiv.org/abs/1805.10180v1.

[17] ZHENG Z H,WANG P,LIU W,et al. Distance-IoU Loss: Faster and Better Learning for Bounding Box Regression [C]//Proceedings of the 34th AAAI Conference on Artificial Intelligence.PaloAlto:AAAI Press,2020,34(7):12993-13000.

[18] HU J,SHEN L,ALBANIE S,et al. Squeeze-and-Excitation Networks [C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition.Salt Lake City:IEEE,2018:7132-7141.

[19] WOO S,PARK J,LEE JY,et al. CBAM: Convolutional Block Attention Module [C]//Proceedings of the 15th European Conference on Computer Vision.Munich:Springer,2018:3-19.

[20] MISRA D,NALAMADA T,ARASANIPALAI A U,et al. Rotate to Attend: Convolutional Triplet Attention Module [C]//Proceedings of the 2021 IEEE Winter Conference on Applications of Computer Vision.Waikoloa:IEEE,2021:3138-3147.

[21] REZATOFIGHI H,TSOI N,GWAK J Y,et al. Generalized Intersection Over Union: A Metric and a Loss for Bounding Box Regression [C]//2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR).Long Beach:IEEE,2019:658-666.

作者簡介:潘金晶(1991—),女,漢族,安徽滁州人,首席算法專家,博士,研究方向:數據挖掘、推薦系統、深度學習、計算機視覺;曾成(1984—),男,漢族,湖北武漢人,首席軟件官,博士,研究方向:軟件算法及通信協議優化、深度學習算法在工業檢測領域的應用與優化;張晶(1985—),女,漢族,湖北武漢人,總經理,本科,研究方向:工業視覺檢測項目的開發和管理;李再勇(1990—),男,漢族,湖北襄陽人,項目經理,研究方向:工業視覺檢測項目開發及管理;耿雪娜(1988—),女,漢族,吉林長春人,講師,博士,研究方向:故障診斷、自動推理、專家系統的算法。