融合距離閾值和雙向TCN的時空注意力行人軌跡預測模型

摘 要:為解決因缺乏部分行人建模思想、缺少時間維度的全局視野和忽略行人交互模式多樣性,而導致交互建模不充分、低預測精度等問題,提出基于Social-STGCNN(social spatio-temporal graph convolutional neural network)的改進模型STG-DTBTA(spatio-temporal graph distance threshold Bi-TCN attention)。首先,構建PPM(partial pedestrian module)模塊,對不滿足距離閾值等約束條件的行人交互連接剪枝以去噪。其次,引入時空注意力機制,空間注意力動態分配交互權重,并設置多個注意力頭以處理交互多樣性問題;時間注意力捕捉時序數據的時間依賴關系。最后,采用雙向TCN增加全局視野以捕捉軌跡數據中的動態模式和趨勢,并采用門控機制融合雙向特征。在ETH和UCY數據集上的實驗結果表明,與Social-STGCNN相比,STG-DTBTA在維持參數量與推理時間接近的情況下,ADE平均降低8%,FDE平均降低16%。STG-DTBTA具有良好的交互建模能力、模型性能和預測效果。

關鍵詞:行人軌跡預測;部分行人建模;距離閾值;時空注意力機制;雙向TCN;門控機制

中圖分類號:TP391.4;TP183 文獻標志碼:A 文章編號:1001-3695(2024)11-014-3303-08

doi:10.19734/j.issn.1001-3695.2024.04.0103

Fusion of distance threshold and Bi-TCN for spatio-temporal attention pedestrian trajectory prediction model

Wang Hongxia, Nie Zhenkai?, Zhong Qiang

(College of Information Science amp; Engineering, Shenyang Ligong University, Shenyang 110159, China)

Abstract:In order to solve the problems such as insufficient interaction modeling and low prediction accuracy due to the lack of partial pedestrian modeling ideas, the lack of global vision in time dimension, and the neglect of the diversity of pedestrian interaction modes, this paper proposed an improved model STG-DTBTA based on Social-STGCNN. Firstly, the model constructed PPM module, and pruned the pedestrians inter links that were not meet constraints such as distance threshold for de-noising. Secondly, the model introduced the spatio-temporal attention mechanism. Spatial attention dynamically assigned interactive weights, and set up multiple attention heads to deal with the interaction diversity problem. Temporal attention captured temporal dependencies of temporal data. Finally, the model used Bi-TCN to increase global perspective to capture dynamic patterns and trends in trajectory data, and used gating mechanism to incorporate the bidirectional features. The experimental results on the datasets ETH and UCY show that compared with Social-STGCNN, ADE and FDE are decreased by an ave-rage of 8% and 16% respectively when the number of parameters and the inference time kept close to it. The STG-DTBTA has good interactive modeling ability, model performance and prediction effect.

Key words:pedestrian trajectory prediction; partial pedestrian model; distance threshold; spatio-temporal attention mechanism; bidirectional temporal convolutional network (Bi-TCN); gating mechanism

0 引言

伴隨人工智能的出現,人們生活中涌現出越來越多的智能自主系統,這些系統感知、理解和預測人類行為的能力越來越重要。其中,行人軌跡預測已成為當前的熱點問題[1]。影響行人軌跡的因素眾多,最重要的是行人之間存在社會交互[2],通過某種方法模擬這一因素是目前面臨的一項挑戰。因此,行人軌跡預測的研究正日益關注如何更好地、更貼合實際地建模行人之間的交互。目前,常見的行人軌跡預測方法大致分為以下幾類:a)基于傳統方法如社會力模型[3]。這種方法簡化了交互建模過程,無法應對復雜的交互場景。b)基于LSTM的方法。Social LSTM(social-long short-term memory) [4]利用池化機制聚合大量的特征來模擬行人的社會交互,并期待獨特的隱藏狀態能夠捕捉到行人的運動特性,但該方法過度突出場景中最具影響力的交互,從而忽略了其他重要交互。SR-LSTM(state refinement for LSTM)[5]在其基礎上擴展了視覺特征和新的池化機制,并通過加權機制來衡量每個行人對其他行人的貢獻,但在時間維度難以捕捉序列之間的長期依賴關系。LG-LSTM(local-global LSTM)[6]實現了對軌跡以及本地和全局交互的建模,但其固定的網格結構無法適應多場景。c)基于GAN(gene-rative adversarial network)的方法。如Social GAN[7]、SoPhie[8]均是一個空間上下文關注網絡,關注全局特征并可預測行人多個社會可接受軌跡,但存在模式崩潰的風險。Kothari等人[9]提出一種改進的SGAN架構(SGANv2),通過協同采樣策略,在測試時也利用了學習到的鑒別器,不僅細化了碰撞軌跡,而且防止發生模式崩潰問題。李文禮等人[10]提出了一種基于視野域機制的行人軌跡預測模型,通過不同時刻頭部偏轉角度來構建當前的視野域,并同時記錄歷史視野范圍的變化,從而篩選有效信息并動態衡量行人之間的交互影響。d)基于Transformer如STAR[11],利用一種新型的基于Transformer的圖卷積機制對圖內人群交互建模,圖間的時間依賴關系用單獨的時間Transformer建模,完全拋棄了遞歸,同時考慮時空維度之間的相互關系和作用。趙懂宇等人[12]提出基于Informer算法的運動軌跡預測模型,采用聯合歸一化進行數據預處理,沿用Transformer網絡的編解碼器結構,并提出一種稀疏自注意力機制優化網絡結構,同時篩除冗余值從而降低計算復雜度。e)基于圖神經網絡的方法。由于圖的拓撲結構可以自然表示場景中行人之間的社會交互,所以越來越多的相關研究都采用基于圖神經網絡的方法。如Social-STGCNN[13]采用圖卷積和TCN提取時空特征,避免了循環結構誤差積累和梯度消失的問題,但使用核函數表示交互難以自適應不同密度的行人。RSBG(recursive social behavior graph)[14]結合GCN(graph neural network)的遞歸社會行為圖來建模社會互動,但大量的遞歸會增加計算成本,易過擬合。Social-BiGAT[15]結合了GAN的博弈結構,引入GAT(graph attention)來計算行人間的碰撞,通過雙向結構關注上下文信息,但同樣存在模式崩潰的風險。Scene-STGCNN[16]通過設計基于場景的微調模塊提取場景調節特征,顯示建模場景對行人特征的調節作用。但該模型的運動模塊提取行人的局部時空特征,可能會忽視掉一些重要交互。

雖然基于圖神經網絡的方法為行人軌跡預測開辟了新角度,也得到了一些成果,但當前很多方法仍在行人建模問題上存在局限性。

a)多數方法常將所有行人建模[17],如圖1(a)(b)所示。圖1(a)中的行人1和2行走方向相反,且行人1的位置在行人2之前,因此,行人1的軌跡不會受到行人2的影響;同時行人1的附近有行人3和4,行人5距離較遠,對于下一時刻來說,行人1的軌跡受到行人5的影響非常小,不應保留兩人之間的社會交互連接,如圖1(c),虛線表示距離閾值條件下可能剪枝的交互連接。

b)如何模擬行人之間的社會交互。Mohamed等人[13]采用手工核函數的方式表示行人間的社會交互,該方式無法靈活適應不同密度的行人。同時文獻[13]采用TCN(temporal convolutional network)無法提取全局信息,提取特征不充分。

綜上所述,為了解決這些問題,提出改進后的新模型STG-DTBTA(spatio-temporal graph distance threshold Bi-TCN attention)。其主要貢獻概括如下:a)設計PPM(partial pedestrian model)模塊,通過行人位置、運動方向和距離閾值三個條件實現部分行人建模;b)采用雙向TCN全局建模,經多種特征融合方式比較,采用門控機制融合正、逆向特征;c)引入時空注意力機制,采用多頭自注意力機制對空間維度建模解決交互模式多樣性問題,自適應學習目標行人與其他行人間的交互關系;采用自注意力機制對時間維度建模,計算余弦相似性來捕捉軌跡數據的時間相關性,通過時空維度的同步處理以實現時空耦合建模。

另外,行人的軌跡更多發自主觀意識,具有不確定性。如圖1(d)所示,目標行人的前方有人靠近,下一時刻該行人可能繼續直行,也可能左拐或右拐避讓,呈現多模態特性。基于雙變量高斯分布函數的穩定性,本文結合該函數預測軌跡的概率分布,選擇誤差最小的軌跡作為最終預測結果。

1 模型方法

1.1 行人軌跡預測問題定義

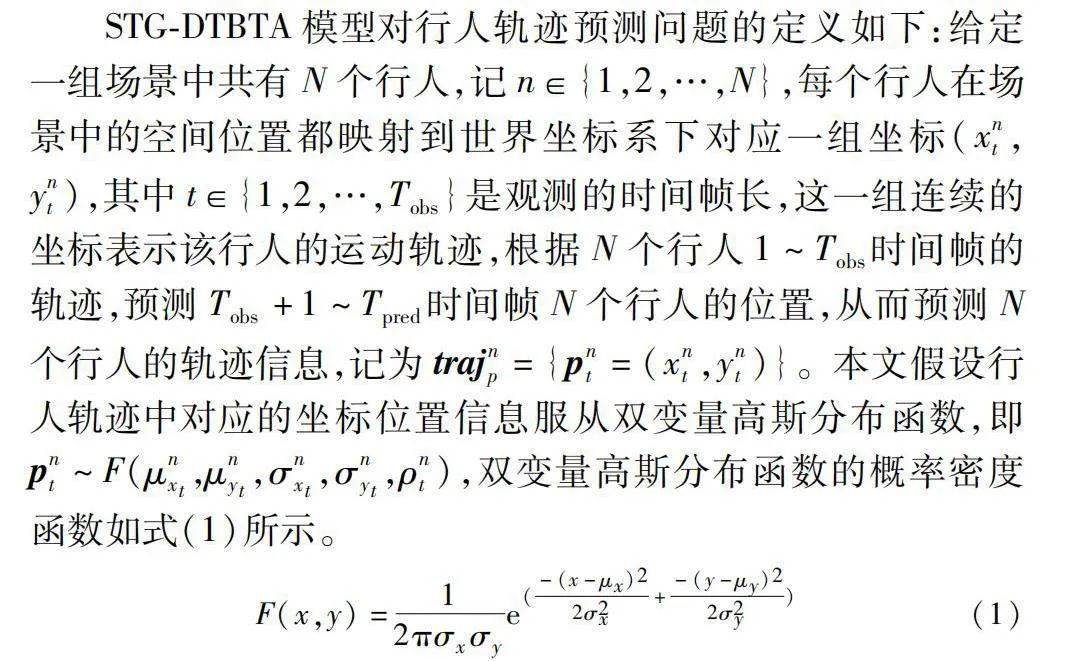

STG-DTBTA模型對行人軌跡預測問題的定義如下:給定一組場景中共有N個行人,記n∈{1,2,…,N},每個行人在場景中的空間位置都映射到世界坐標系下對應一組坐標(xnt,ynt),其中t∈{1,2,…,Tobs}是觀測的時間幀長,這一組連續的坐標表示該行人的運動軌跡,根據N個行人1~Tobs時間幀的軌跡,預測Tobs+1~Tpred時間幀N個行人的位置,從而預測N個行人的軌跡信息,記為trajnp={pnt=(xnt,ynt)}。本文假設行人軌跡中對應的坐標位置信息服從雙變量高斯分布函數,即pnt~F(μnxt,μnyt,σnxt,σnyt,ρnt),雙變量高斯分布函數的概率密度函數如式(1)所示。

F(x,y)=12πσxσye(-(x-μx)22σ2x+-(y-μy)22σ2y)(1)

1.2 模型整體概述

如圖2所示,STG-DTBTA主要由PPM模塊、時空維度建模和多模態軌跡預測三部分組成。首先將行人及交互關系處理為圖結構數據,分別得到行人自身特征矩陣x和矩陣元素為行人間歐氏距離的鄰接矩陣A,將其作為輸入,PPM模塊用于實現部分行人建模功能,通過設定合適的距離閾值以及方向、位置條件將A中不滿足條件的行人之間的連接剪枝。時空維度建模采用時空耦合建模方式,分別引入時、空注意力機制建模行人軌跡預測的時空關系,充分考慮行人之間的空間關聯性和軌跡的時間依賴性。通過GCN提取空間維度特征,將空間維度提取的特征傳入時間維度,通過雙向TCN提取時間維度特征,以此同步考慮時空維度的有效信息,并在時空維度加入全局視野;采用門控機制融合雙向特征得到最終用于多模態軌跡預測的特征信息。最后通過TXP-CNN(time-extrapolator CNN)進行預測,并結合雙變量高斯分布函數根據樣本數隨機抽樣得到軌跡的概率分布,選擇最優軌跡作為最終的預測結果。接下來將對這三部分進行詳細描述。

1.3 PPM模塊

行人建模過程中需要考慮行人之間的社會交互,這是行人軌跡預測精準與否的一個重要因素。針對這個抽象的概念,本文計算場景中行人之間的歐氏距離來反映行人之間社會交互影響程度。Social-STGCNN將場景中所有行人建模,但在現實場景中,行人之間的交互行為往往更多取決于距離較近、運動模式相似性較高的行人,此時全部建模會引入部分噪聲而降低預測精度。基于該問題,需要引入部分行人建模方法,剪枝當前場景當前時刻對目標行人軌跡影響極小的行人連接。通過該方法可以對此建模過程進行優化,剔除交互影響極小甚至沒有的行人以避免噪聲的影響;而行人的關注程度有局限性,進行局部、部分行人建模更符合實際行走模式。文獻[10,17]通過設置視野域,只對目標行人視野域內的行人進行建模,并在實驗中發現預測精度得到提升。因此本文在STG-DTBTA模型中設計了PPM模塊,通過行人之間的位置關系、運動方向以及距離閾值三個條件判斷是否剪枝交互連接,從而實現部分行人建模,根據2.4.1節中的實驗結果證明此改進方法對模型的預測具有積極作用,說明該方法的可行性。

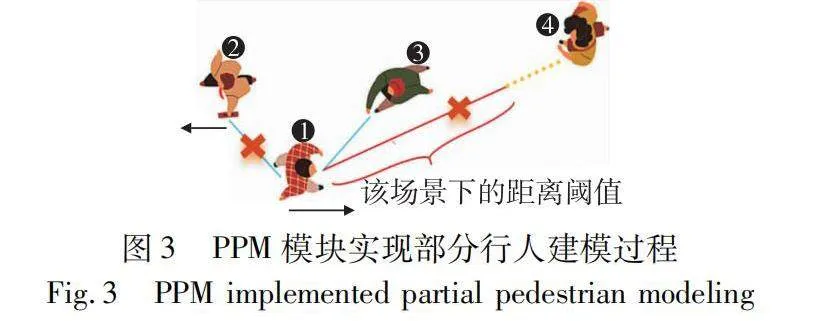

1.3.1 PPM模塊原理與實現過程

在特征輸入PPM模塊之前,本文先將場景中行人及其軌跡信息處理為圖結構數據,得到歐氏距離矩陣A,矩陣A中的每個元素{aij|i=1,2,…,N;j=1,2,…,N}表示行人之間的距離。得到距離矩陣A后,通過提出的三個條件進行剪枝。首先通過行人位置與行人運動方向來判斷,如圖3所示,以行人1作為目標行人,運動方向為x軸正方向,經計算可知行人1和2的運動方向相反,并且行人1的位置在行人2之前,具體計算公式見1.3.3和1.3.4節。不滿足位置和運動方向的約束條件意味著之后的時間步長中行人1和2之間不可能存在社會交互,因此,先將二人之間的連接剪枝;同理,若目標行人運動方向為x軸負方向,則兩人運動方向相反且1.3.3節中的計算結果為負時剪枝兩人之間的交互連接。滿足位置、方向條件后,為當前場景設定一個合適的距離閾值,圖中行人1和3之間的距離小于閾值,而行人1和4之間的距離大于閾值。說明當前時刻,行人1的軌跡極大程度上只受行人3的影響,此時若考慮行人4的交互影響會引入噪聲,因此,將行人1和4之間的連接剪枝,即矩陣中對應元素aij置為0。處理后得到稀疏矩陣As并對其歸一化,然后經過1.4節介紹的空間注意力機制得到該場景分配權重后行人間的社會交互影響力。

1.3.2 PPM模塊分析

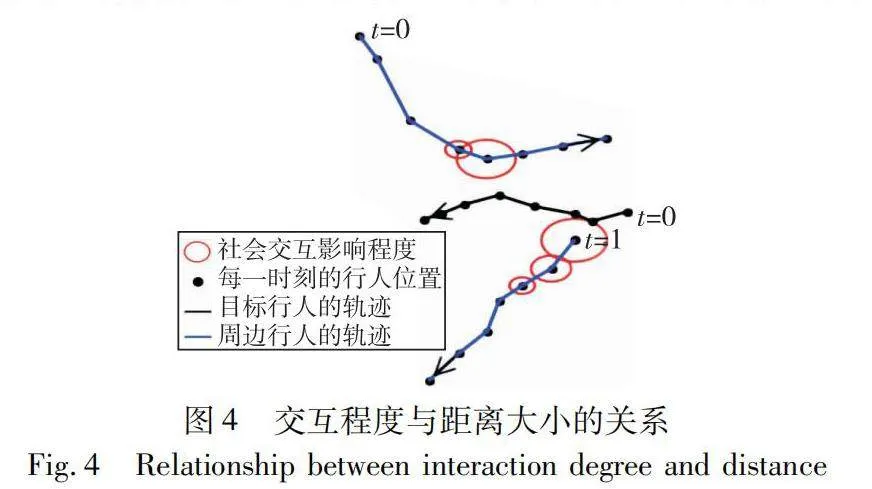

如圖4所示為某場景下行人之間存在交互的情況,圖中黑色軌跡為目標行人的移動軌跡,藍色軌跡(詳見電子版)為周圍行人的移動軌跡。t=0時,目標行人開始移動,下方行人處于靜止。當t=1時,目標行人若按當前行走方向繼續前進則會與該行人發生碰撞,兩者此時距離最近,反映了社會交互影響程度極大,為了避免碰撞,目標行人轉而向上方行進。同時隨著時間的增加,兩人距離越來越遠,從圖上可見兩人之間的社會交互影響程度逐漸變弱,t=3之后,兩人之間的距離足夠遠,不再具有社會交互。因此,在PPM模塊中,會在t=3之后將兩者之間的交互連接剪枝。又如目標行人上方的行人,兩人均從t=0時出發,在t=3之前,兩人距離足夠遠,不會產生社會交互,當t=3時,兩人存在較小的社會交互影響。t=4時,兩人即將發生碰撞,此時交互程度最強,分別改變行走方向避免發生碰撞。t=4之后兩人行走方向相反,且兩人朝著彼此的身后行走,即使兩人距離較近,但并不滿足位置關系和運動方向的約束條件,就不會存在社會交互影響。綜上,通過可視化的方式模擬并分析該方法的實現效果,與預期效果具有一致性。

1.3.3 行人位置關系計算

在二維坐標系中,本文通過行人的坐標計算位置關系,見式(2),若Δxgt;0,表示待預測行人位置在另一個行人前面。

Δx=xi-xj

i, j∈{1,2,…,N}(2)

1.3.4 行人運動方向計算

行人運動方向借助行人位置計算,如第一幀的坐標為Pt,第二幀的坐標為Pt+1,則通過Pt+1-Pt判斷其x的正負即可判斷是正向還是負向,見式(3)。

ΔPx=xt+1-xt

t∈{1,2,…,Tobs}(3)

1.4 時空維度建模

行人軌跡預測問題可以表示為一種序列生成問題,既要考慮行人之間的社會交互,又要考慮歷史運動信息的動態變化趨勢。因此在模型建立過程中需要同步考慮空間維度和時間維度兩方面,通過實現時空耦合建模來更全面地提取行人軌跡信息中的時空特征。

1.4.1 時空注意力機制

注意力機制的主要思想是為模型輸入的各個部分分配相應的權重,并根據權重對每個部分進行不同的關注[18]。這種機制主要通過計算輸入之間的相似度,并對相似度進行歸一化得到各自的權重,該權重反映了不同的關注程度。

1)空間注意力機制

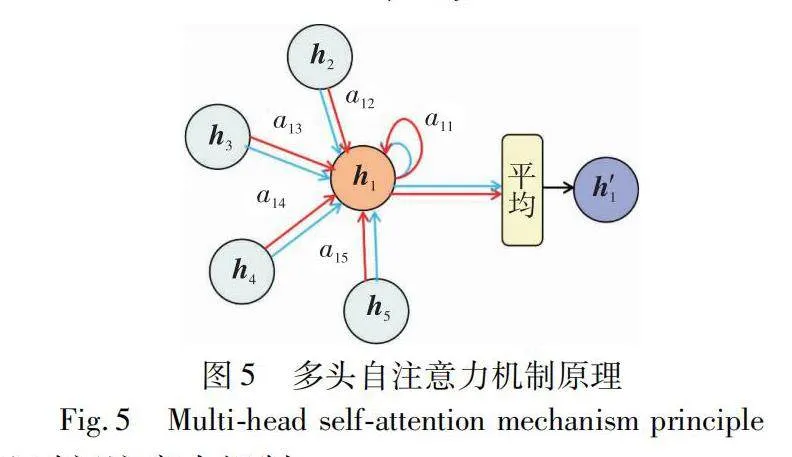

在不同場景中,行人之間往往均存在不同且復雜的交互行為,并且行人之間也存在著個體差異,這導致了行人交互具有多樣性。Social-STGCNN采用核函數來模擬這種復雜的交互具有局限性,無法很好地適應不同場景以及不同密度的行人;常用的單頭自注意力機制只能學習到一種關注模式,無法捕捉到行人之間交互模式的多樣性,這限制了模型對行人之間復雜的社會交互關系的建模能力。因此,本文在空間維度引入多頭自注意力機制,該方法可以感知行人之間不同的社會交互影響力,并分配相應的權重,通過多個注意力頭同時關注多個方面的信息,每個注意力頭可以專注于不同方面的相互影響,從而更準確地捕捉到行人之間的復雜關系,實現多尺度全局建模以處理交互的多樣性。輸入維度根據不同場景中行人的數量作出動態調整,從而更加靈活地適應不同密度的行人,提升模型的魯棒性。經2.4.1節中的實驗結果驗證,空間維度引入多頭自注意力機制具有有效性。如圖5所示,本文以自注意力頭數K=2為例,展示多頭自注意力機制原理。首先,計算節點之間的相似度,見式(4)。

eij=dot(Whi,Whj)(4)

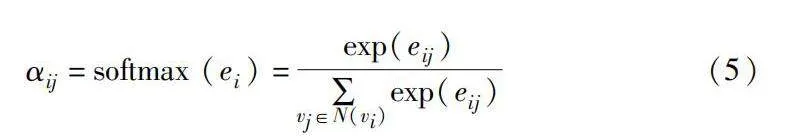

其中:W是該層節點特征線性變換的權重參數,本文采用線性變換方式;dot(·)是計算兩個節點相似度的函數,本文采用計算內積的方式。為了更好地分配權重,本文將與所有鄰居節點計算出的相似度進行統一的歸一化處理,從而得到相應的權重,見式(5)。

αij=softmax (ei)=exp(eij)∑vj∈N(vi)exp(eij)(5)

得到權重后,通過加權求和即可得到新的特征,見式(6)。

h′i=∑vr∈N(vi)αijWhr(6)

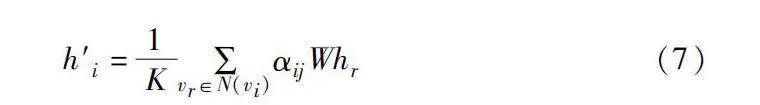

式(6)針對單頭自注意力機制,本文采用多頭自注意力機制,需要對頭數進行平均,不改變維度的情況下得到新特征,見式(7)。

h′i=1K∑vr∈N(vi)αijWhr(7)

2)時間注意力機制

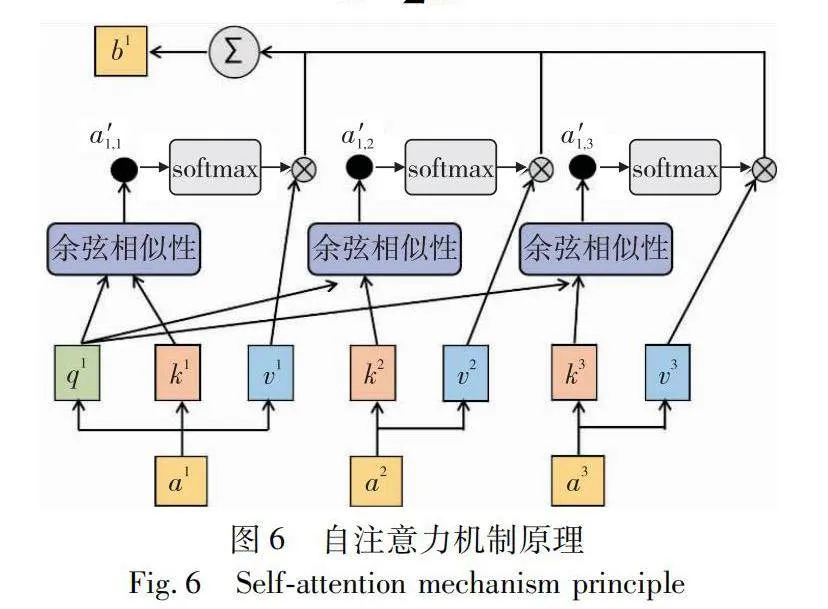

經空間注意力機制處理后得到行人交互的不同影響程度,同樣軌跡數據的時間維度也對預測結果存在不同的影響程度。在一組時間序列中,各個幀對應行人的一組位置信息。行人的運動使得位置信息發生改變,有時也會發生運動模式的改變,如急轉彎、驟停、突然加速行進等,這些情況對軌跡影響的程度應相對較高。因此未來軌跡預測的過程中,需要學習到觀測狀態下一組時間序列中軌跡信息的時間相關性,從而根據相關關系與不同的權重系數得到更精確的預測軌跡,而Social-STGCNN并未對該方面問題進行處理。因此,本文在時間維度引入自注意力機制,該方法可以更好地捕捉各幀軌跡數據之間的時間依賴關系。常用來計算輸入之間相似度的方法是計算query和key的內積,但這種方式過于關注向量的長度,忽略了方向和角度的差異,而且在時間維度上會受到時間偏移的影響,不適用于處理時間序列數據。因此,受Liu等人[18]的啟發,本文采用計算余弦相似性的方法來得到query和key之間的相似度。由于余弦相似性對向量的絕對大小不敏感,而是關注向量的方向與它們之間的夾角,專注于它們之間的形狀相似性,可以更好地區分輸入數據時間維度上的關聯程度并識別相似的模式和趨勢。同時余弦相似性計算方式較為簡單,降低了模型的計算復雜度。經2.4.1節中實驗結果驗證時間維度引入自注意力機制的有效性,且經2.5.3節的對比實驗驗證了計算余弦相似性的優越性。如圖6所示是時間維度引入的自注意力機制的原理圖,a1、a2、a3經過不同的全連接層得到各自的Q、K、V,見式(8)。

Qi=WqaiKi=WkaiVi=Wvai (8)

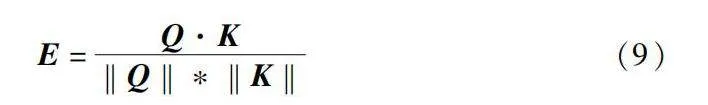

之后計算Q和K的相似度,采用余弦相似性的計算方法,見式(9)。

E=Q·K‖Q‖*‖K‖(9)

得到的E即為相似度,經過歸一化后得到權重系數,見式(10)。

α=softmax (E)(10)

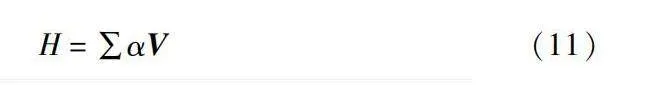

最終,將權重系數與V進行加權求和即為新的特征,見式(11)。

H=∑αV(11)

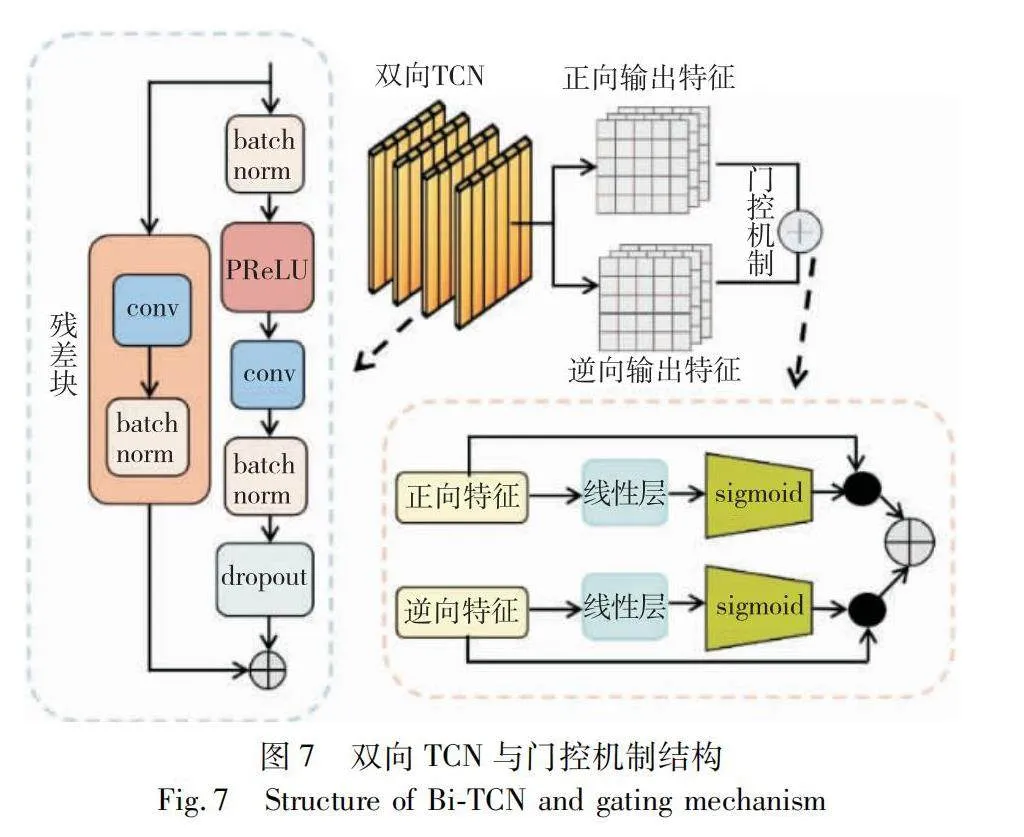

1.4.2 雙向TCN

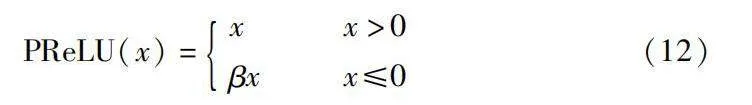

行人多幀下的軌跡數據可看作一組時序數據,存在一定的時序特征。目前,多數方法普遍通過循環神經網絡及其變體GRU(gate recurrent unit)、LSTM提取時間維度特征,然而基于循環結構的方法存在誤差積累和梯度消失等問題,并且循環結構的串行計算方式會導致模型低效。Social-STGCNN對此進行改進,采用單向TCN提取時序特征。但這種單向建模方式只能利用過去的信息,無法捕捉未來的上下文信息,在處理長期依賴關系時會導致部分特征信息丟失,而影響模型的預測精準度。因此,本文選擇雙向建模方式,采用雙向TCN同時利用過去和未來的數據,可以全局捕捉行人軌跡數據中的時序模式和動態變化,在面對未知數據時提高模型的泛化能力,并且該方法的并行計算方式大大提升了運行速度。經2.5.1節中實驗結果驗證,采用雙向TCN能夠提升預測精度。圖7所示是雙向TCN及門控機制的結構。首先對輸入進行批次歸一化處理,然后經過PReLU激活函數層,該激活函數的公式為

PReLU(x)=x xgt;0βx x≤0(12)

其中:β是一個可學習的參數,允許神經元在負數輸入下具有一定的響應,有助于減輕神經元死亡問題。之后經過卷積層并行提取特征,再進行批次歸一化處理,最后經過dropout層,防止模型過擬合。另有一個殘差塊由卷積層和批次歸一化層組成,解決了長期依賴問題,在反向傳播過程中防止梯度消失。時間維度建模時,需先將輸入數據翻轉得到逆向數據,經過雙向TCN后捕捉到正、逆向輸出特征,本文通過門控機制融合雙向特征。常見的特征融合方式僅對輸出的多個特征直接進行處理,而部分關鍵特征與其他特征的權重相同,從而影響預測效果。門控機制中采用sigmoid 非線性激活函數,該激活函數的公式為

sigmoid(x)=11+e-x(13)

門控機制允許網絡根據輸入特征的不同部分動態地控制信息的流動和處理。通過學習得到的門控權重,網絡可以自適應地選擇保留或丟棄不同特征的信息。具體來說,在門控機制中,先將雙向特征進行線性變換,使用sigmoid將其縮放到[0,1],越接近0表示對應的信息越不相關,以此來選擇性地處理和傳遞重要信息,實現對輸入的動態控制和調節。通過門控機制,雙向特征中更重要的信息被保留,丟棄部分噪聲,從而實現更合理的特征融合。同時門控機制可以共享參數,不會為網絡的實時性推理增加負擔。經過融合后,得到時空雙維度處理后的時空耦合特征,該特征即為行人軌跡數據中時空雙維度所有的有效信息,用于最后的軌跡預測任務,經2.5.2節中實驗結果可視化圖可知,采用門控機制達到了預期效果。

1.5 多模態軌跡預測

考慮到行人軌跡的不確定性,對行人軌跡的預測不能僅預測一條“平均好”的軌跡。首先,本文采用TXP-CNN進行預測,相比于循環結構,TXP-CNN可以一次性預測出目標行人未來時刻的所有軌跡,其輸出結果是維度為Tpred×5×N的特征,其中Tpred=12,N是該場景中行人的數量,5則對應雙變量高斯分布函數的5個重要參數:μ1、μ2、σ1、σ2和ρ。將學習到的參數特征代入雙變量高斯分布函數中進行隨機抽樣,便可得到行人預測軌跡的概率分布,從而實現多模態軌跡預測。

1.6 損失函數

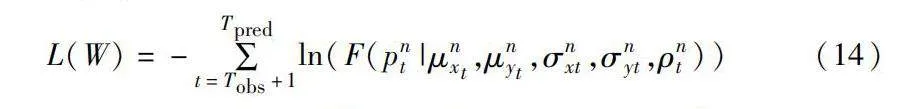

本文實現多模態軌跡預測時結合雙變量高斯分布函數得到軌跡的概率分布。針對該方法,更精確地匹配觀測數據的真實分布,意味著損失函數值為最小,即雙變量高斯分布函數要趨近于最大似然估計值。因此,本文引入負對數似然損失函數作為損失函數,公式為

L(W)=-∑Tpredt=Tobs+1ln(F(pnt|μnxt,μnyt,σnxt,σnyt,ρnt))(14)

其中:W表示當前學習到的模型參數;Tobs表示觀測時間步長;Tpred表示預測的時間步長;μ、σ、ρ均為每個時間步長下每個行人的x、y坐標對應于雙變量高斯分布函數中的必要參數,通過最小化損失函數得到最優的參數取值。

2 實驗分析

2.1 數據集和評估指標

2.1.1 數據集

本節在ETH[19]和UCY[20]兩個公共數據集上評估模型。ETH包括了eth和hotel兩個場景;UCY包括了univ、zara1和zara2三個場景。ETH中平均行人數量為5,UCY中平均行人數量為18。兩個數據集中的軌跡數據均映射到世界坐標系下,轉換為世界坐標,且每0.4 s采樣一次(1幀),這些數據集涵蓋了行人多種行走模式與社會交互。

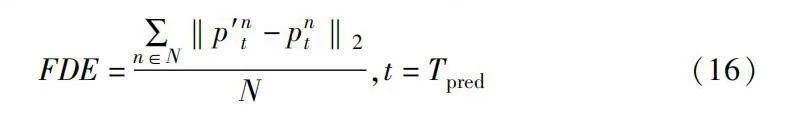

2.1.2 評估指標

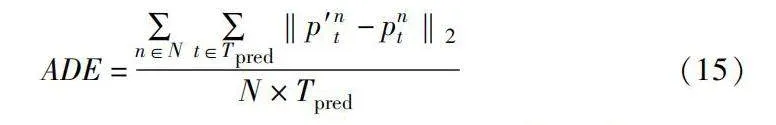

根據先前學者的研究,本文采用平均位移誤差(ADE)和最終位移誤差(FDE)作為評估指標。ADE(average displacement error)表示在行人的所有預測時間步長上,行人的實際觀測位置和預測結果之間的平均歐氏距離誤差,見式(15)。ADE越小,表示模型的預測越精確。

ADE=∑n∈N ∑t∈Tpred‖p′nt-pnt‖2N×Tpred(15)

FDE(final displacement error)表示在最后一幀預測的行人最終位置與實際觀測位置之間的歐氏距離誤差,見式(16)。FDE越小,表示模型的最終位置預測越準確。

FDE=∑n∈N‖p′nt-pnt‖2N,t=Tpred(16)

2.2 實現細節

本實驗根據文獻[13]消融研究的實驗結果,設置1層ST-GCNN層和5層TXP-CNN層,在PPM模塊中,根據2.4.2節的實驗結果,本文設置距離閾值為0.8 m。整體來說,本實驗設置批次大小為128,訓練輪數為250個epoch,采用隨機梯度下降算法SGD(stochastic gradient descent)優化梯度,前150個epoch的學習率為0.01,在此之后衰減為0.001,使用PReLU函數作為本文模型的激活函數,使用的CPU是i7-11370H,GPU是NVIDIA GeForce RTX 2050。

本實驗使用LOO (leave-one-out cross validation) 交叉驗證方法,即對數據集進行分組,每次評估過程中,選擇其中一組作為測試集,而將其他組作為訓練集和驗證集。此外,本實驗沿用大多數行人軌跡預測研究的方案,以8幀(3.2 s)作為觀察軌跡,預測接下來12幀(4.8 s)時間步長的行人軌跡。根據預測出的最優參數值,從基于預測的分布中生成20個樣本,分別計算每個樣本對應的評估指標。然后選擇評估指標最優的樣本作為最終該行人的社會可接受軌跡,記錄其評估指標值,并計算所有數據集下評估指標的平均值。

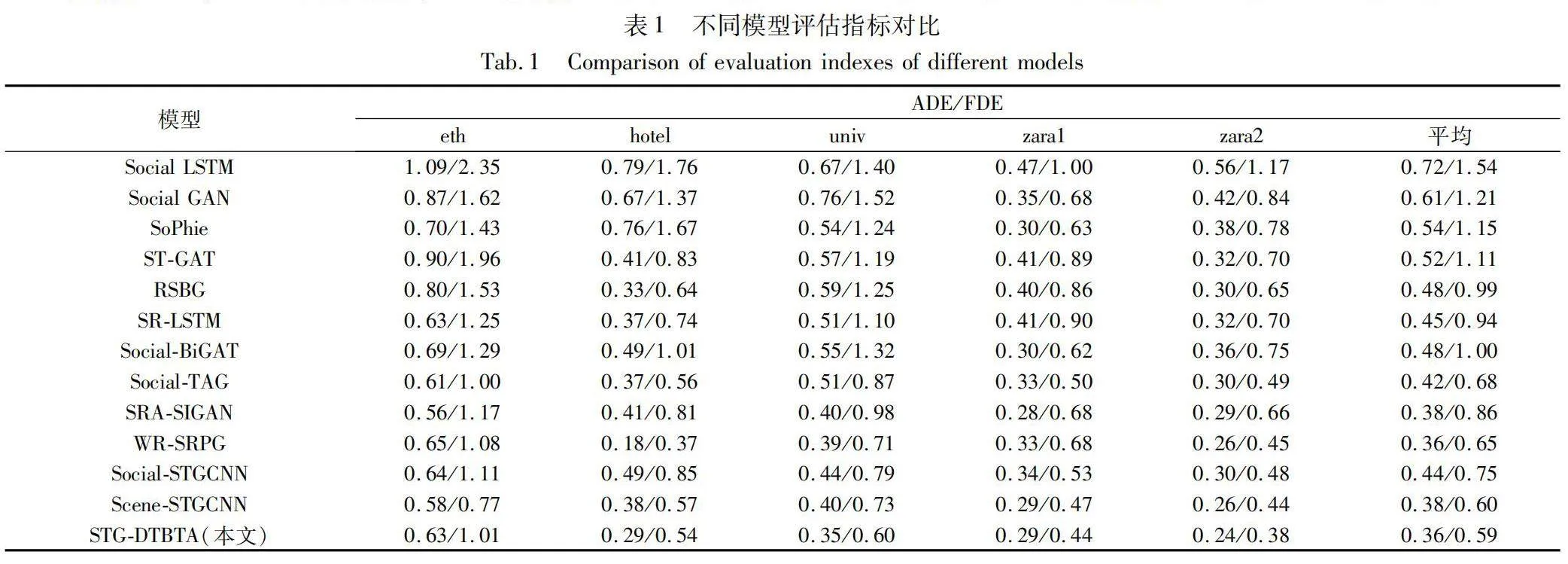

2.3 與現有方法的比較

如表1所示,本文STG-DTBTA與現有的經典模型:Social LSTM[4]、SR-LSTM[5]、Social GAN[7]、SoPhie[8]、Social-STGCNN[13]、RSBG[14]、Social-BiGAT[15]、ST-GAT[21]相比,在5個數據集上的表現以及平均值都優于經典模型,且具有較大幅度的提升,說明本文模型設計的PPM模塊引入時空注意力機制,采用雙向TCN,在提升軌跡預測精準度方面能夠起到積極作用。

本文模型與新模型如Scene-STGCNN[16]、Social-TAG[17]、SRA-SIGAN[22]、WR-SRPG[23]相比,同樣具有一定的競爭力。具體而言,STG-DTBTA在UCY上相比新模型具有良好的表現,但在ETH上還有一些提升空間,如SRA-SIGAN的ADE指標和Scene-STGCNN的ADE、FDE指標在eth場景下要略好于STG-DTBTA;WR-SRPG在hotel場景下的ADE、FDE指標要優于STG-DTBTA。原因可能是UCY中的行人數目較多且較為密集,當前設置的距離閾值適用該數據集中的場景;而ETH中的行人比較分散,且行人數目較少,在當前距離閾值作用下對于目標行人建模可能未將噪聲連接剪枝。因此,距離閾值的設定可能影響著ADE、FDE指標,具體討論見2.4.2節。但STG-DTBTA得到的指標平均值要優于新模型,且在univ、zara1、zara2上相比于新模型均具有良好表現。對于eth數據集,之后可引入自適應性距離閾值對其進行改進。

綜上所述,與基線模型Social-STGCNN相比,ADE均值比Social-STGCNN降低了8%;FDE均值比Social-STGCNN降低了16%,且5個數據集的預測效果均具有較大幅度的提升,驗證了在此基礎上,本文模型具有良好的改進效果,說明了其有效性與可行性。與表1中所有模型相比,STG-DTBTA獲得了最好的ADE均值和最好的FDE均值,并且分別在univ、zara1、zara2數據集上得到的ADE和FDE值均為所有模型中的最小值;在eth和hotel數據集上雖然評估指標不為最優,可能由于距離閾值的選取問題,但都接近最優值,同樣具有較小的預測誤差。因此,STG-DTBTA具有一定的競爭力,在行人軌跡預測問題中具備良好的預測效果。

2.4 消融實驗

2.4.1 模塊分析

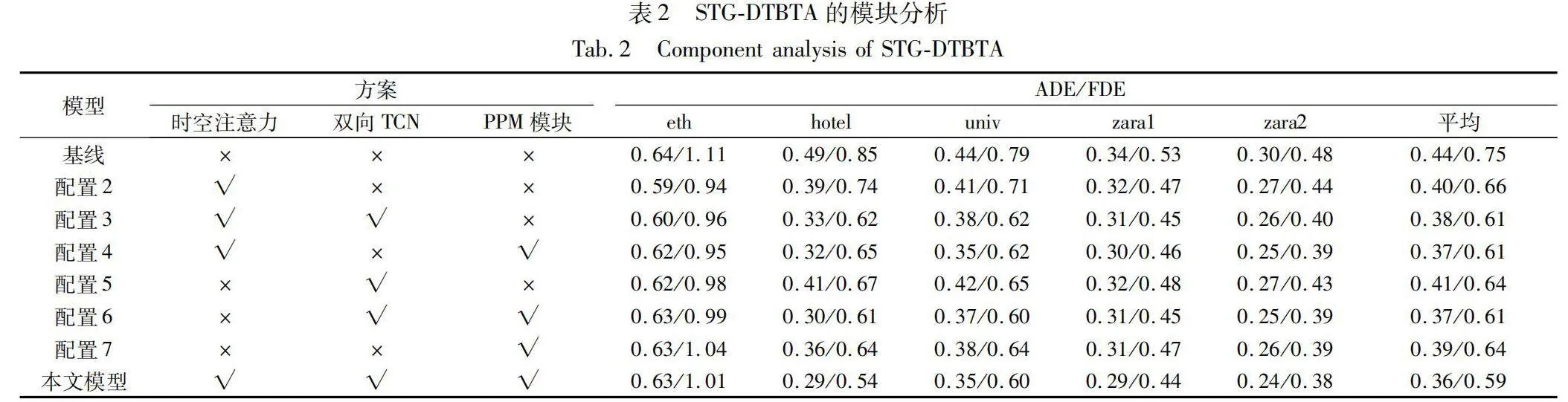

本節通過消融實驗驗證、評估不同方案對實驗結果的影響。將時空注意力、雙向TCN和PPM模塊三個方案進行排列組合,得到8種配置,其中配置1(基線)不采用任何方案,配置8(本文模型)采用三個方案。

由表2可知,采用了時空注意力的方案如配置2~4在所有場景下均具有一定效果,特別是配置2在eth場景下,ADE和FDE值取得了所有配置版本中的最小值;在univ場景下,行人數目最多,分散情況最復雜,采用PPM模塊的方案如配置4、6、7均得到了較好的預測效果;采用雙向TCN的方案如配置3、5、6在所有數據集中,相比于基線模型在預測精準度方面均有一定的提升。

采用雙向TCN和PPM模塊結合的方案如配置6在univ場景中的FDE值取得了較好效果。說明在部分行人建模基礎上,采用雙向TCN實現雙向建模對行人最后位置的預測具有良好效果,通過提取逆向特征能更靈活地應對行人在行進過程中的軌跡變化,從而更準確地預測出行人最終位置,證明了部分行人建模思想結合全局視野的建模,對FDE值具有一定的優化作用。

采用時空注意力機制和PPM模塊結合的方案如配置4在univ場景中的ADE值取得了較好效果。說明在部分行人建模基礎上,引入時空注意力機制細化了時空建模過程,通過更好的建模行人之間交互影響的多樣性以及軌跡數據的時間相關性、自適應計算的方式處理不同場景中的建模過程,能夠對未來每一幀下的行人位置的預測起到積極的作用。證明了部分行人建模思想結合改進后的時空維度建模對ADE值具有一定的優化作用。

以上結果說明模型中引入時空注意力機制、將單向TCN改為雙向TCN、采用部分行人建模思想這三個方案對模型預測軌跡的精確度均有積極影響,并且PPM模塊與雙向TCN的結合能夠得到更小的FDE值,PPM模塊與時空注意力機制結合能夠得到更小的ADE值。最終本文模型在hotel、univ、zara1和zara2數據集上均得到了最優的預測效果,評估指標的平均值也為所有配置中的最優值。基于各模塊之間的關聯,將三個方案結合使用在預測精準度方面作出了積極貢獻。另外,本文將在2.5.4節中討論STG-DTBTA的參數量與推理時間。

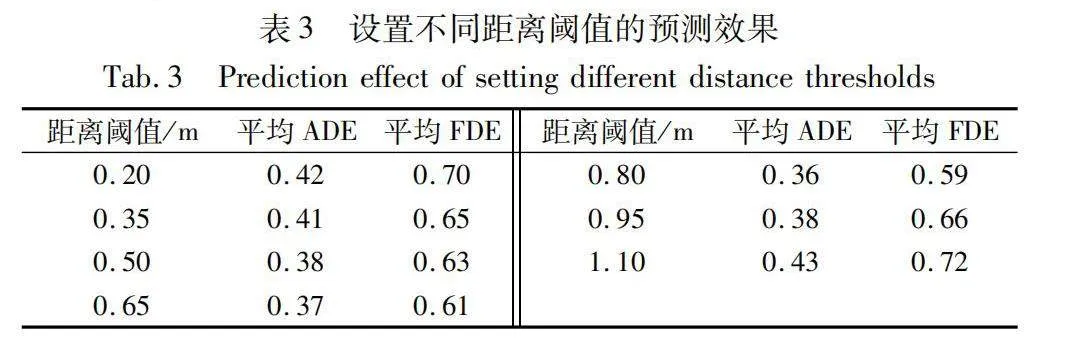

2.4.2 距離閾值對預測誤差的影響

為了本文模型能更好地實現部分行人建模所帶來的積極作用,距離閾值的選擇十分關鍵,若閾值設置過大,可能會有一些噪聲沒有去除掉;若閾值設置過小,可能會剪枝過多連接,從而導致圖結構過于稀疏。因此,為了研究距離閾值對預測誤差的具體影響,本節基于提出的模型,等差設置一系列距離閾值來進行實驗,設置的距離閾值間隔為0.15 m,如表3所示。從表中可以看出,距離閾值確實會對預測精準度產生影響。在表中給出的一系列距離閾值中,將閾值設為0.8 m得到的效果最好,平均ADE、FDE均為最優,同時距離閾值越小,誤差通常會變得越大,隨著距離閾值逐漸變大,誤差通常也在逐漸變大。該實驗驗證了結論的正確性與方案的可行性。因此,在 STG-DTBTA預測行人軌跡時,將所有數據集PPM模塊中的距離閾值設置為0.8 m。

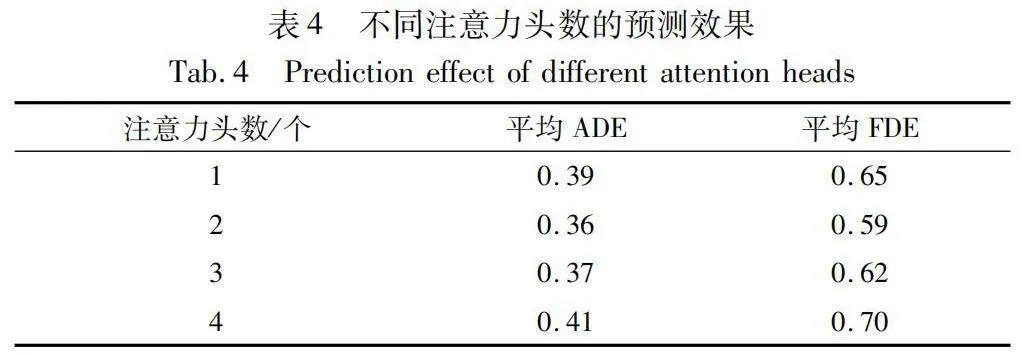

2.4.3 注意力頭數對預測誤差的影響

本文模型在空間維度引入多頭自注意力機制來分配行人之間社會交互影響權重,注意力頭數的選擇通常也會影響空間維度的建模效果,從而反映到預測精準度問題上。如表4所示,分別將注意力頭數設為1、2、3、4進行四次實驗,從表4可知,注意力頭數設為2得到了最好的效果。當頭數設置為4時,頭數設置過多,增加了模型的復雜程度,更容易發生過擬合的情況,并且每個頭都會有各自的數據信息,過多的頭數會引入大量冗余信息,因此效果不佳。當頭數設為1時,由于單頭可能無法很好地考慮不同密度行人之間社會交互的多樣性,所以效果不佳。當頭數設為3時,也得到了不錯的效果,但相比于2,多一個頭就會增加許多參數,綜合考慮,STG-DTBTA將空間維度引入的多頭自注意力機制的頭數設置為2。

2.5 對比實驗

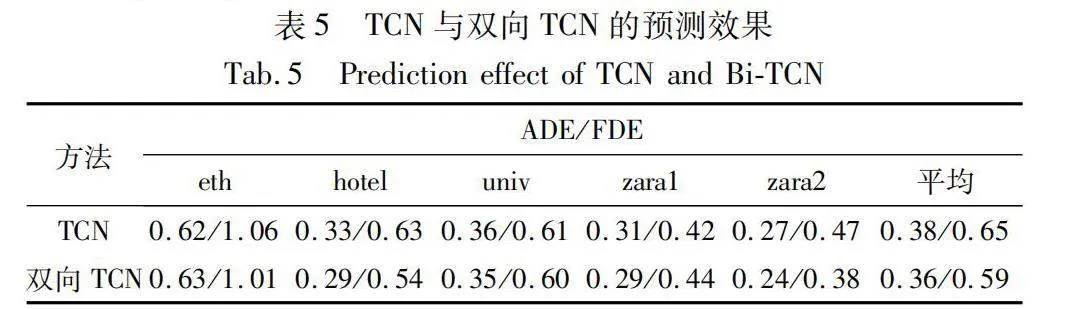

2.5.1 TCN與雙向TCN的比較

本文在時間維度的建模過程中將基線模型中的單向TCN替換為雙向TCN,并通過對比實驗驗證方案的可行性。如表5所示,雙向TCN具有更高的預測精度,因為雙向結構相比于單向結構能夠更好地建模時間序列的長期依賴性,同時利用過去和未來的上下文信息以捕捉全局特征。從表5可見,相比于單向TCN,雙向TCN的FDE值平均降低了6%,證明雙向建模能夠提高預測精度。因此STG-DTBTA采用雙向TCN。

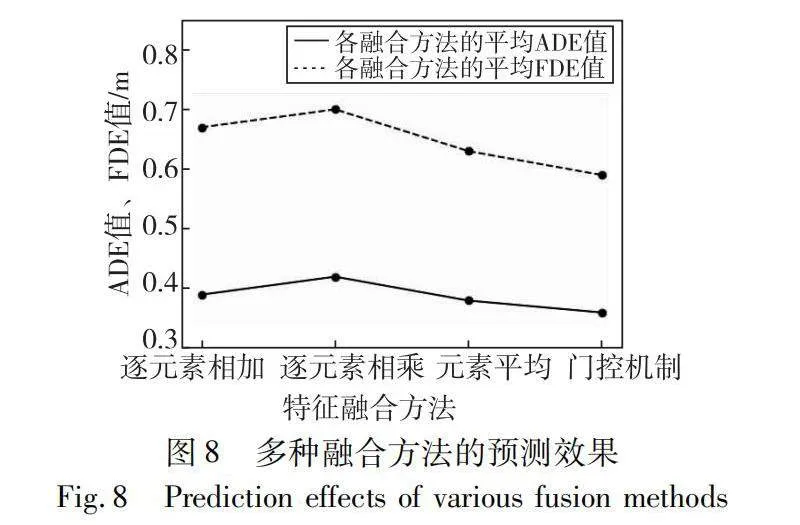

2.5.2 特征融合方法比較

在雙向TCN中,最初將輸入信息倒轉得到逆向信息輸入到網絡中以輸出正向特征和逆向特征。為了研究不同特征融合方式對預測精度的影響,本節使用四種不同的特征融合方法進行一組實驗,具體來說,分別采用逐元素相加、逐元素相乘、元素平均和門控機制實現特征融合。如圖8所示,采用逐元素相乘方法融合特征的效果最差,而門控機制得到的效果最好。這證明借助sigmoid函數將特征中每個元素縮放到[0,1],并采用門控機制動態有選擇地融合正、逆向特征的特征融合方式具有良好效果,因此本文采用門控機制進行特征融合。

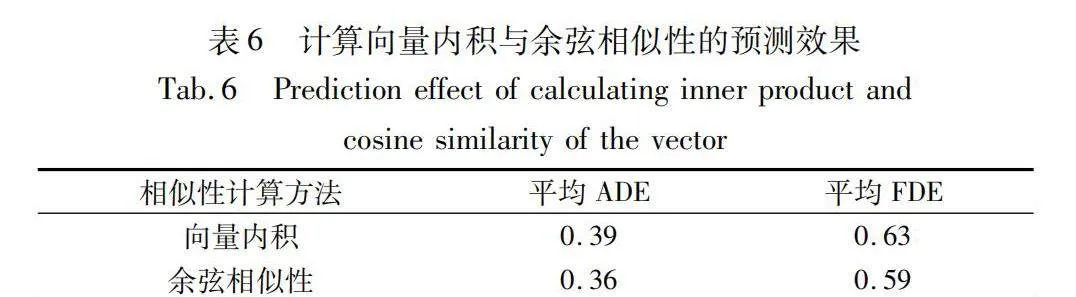

2.5.3 計算向量內積與余弦相似性方法的比較

STG-DTBTA在時間維度建模過程中引入自注意力機制,其中關鍵的一步是計算向量間的相似性,本節對兩種計算相似性的方法進行比較。當前大多數方法采用計算向量內積,但對于時間維度的時間序列數據,1.4.1節中的2)闡述了該方式的局限性。另一種方法是計算兩者之間的余弦相似性,該方法主要關注向量間的方向與角度,對維度具有較小的敏感度,更適用于處理時間序列數據。如表6所示,計算余弦相似性的方法得到的ADE和FDE的平均值均小于計算向量內積的方法,證明計算余弦相似性能夠更好地表示向量之間的相似性,從而優化軌跡預測的精度。因此,本文模型在時間注意力機制中采用計算余弦相似性的方法表示向量間的相似度。

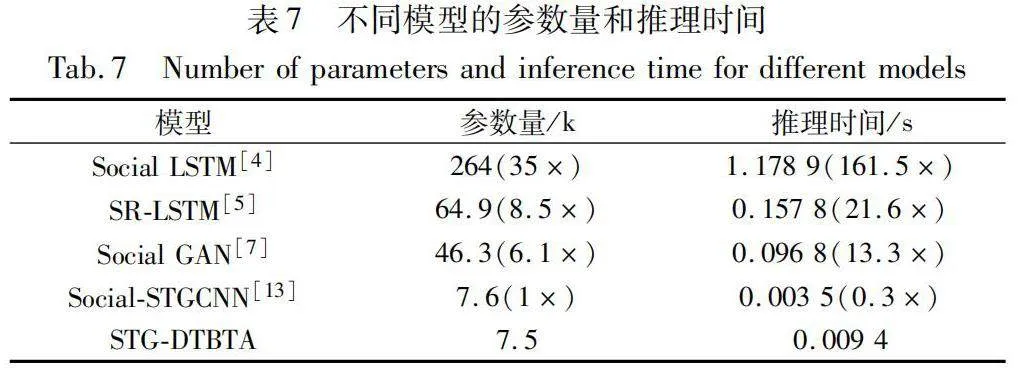

2.5.4 不同模型參數量與推理時間的比較

本節對不同模型的參數量和推理時間展開討論。如表7所示,本文模型的參數量與Social-STGCNN大致相同,小于其他模型且遠小于Social LSTM;推理時間小于其他模型,但高于Social-STGCNN。綜上所述,本文模型提升了預測精確度的同時并未大幅增加模型參數量和推理時間。因此,可證明本文模型具有較輕量的模型結構和較好的實時性。

2.6 定性分析

2.6.1 社會可接受軌跡生成

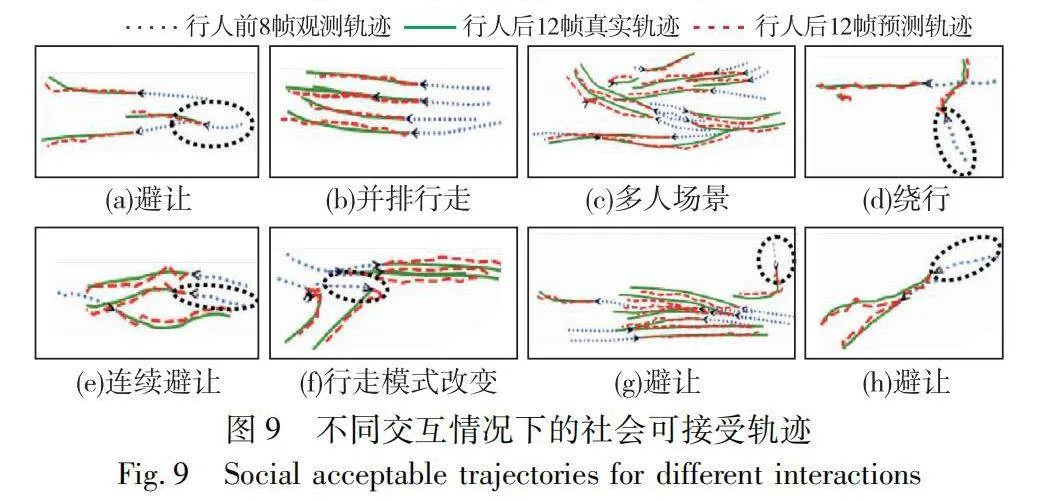

如圖9所示,在不同場景下對不同行人生成社會可接受的預測軌跡。圖(a)中目標行人在行進過程中改變行進方向來躲避下方行人;圖(d)中目標行人即將與上方行人碰撞,隨即從該行人后方繞行來避免碰撞;圖(e)中目標行人先躲避了前方接近的行人,改變方向后防止與上方行人碰撞而再次避讓;圖(g)中目標行人在多人場景中,向左轉避讓下方行人,并與該行人保持并排行進;圖(h)中目標行人與下方行人的目的地相同,但在行進過程中發生交互,防止碰撞而避讓。上述均為行人交互場景,從圖9可知STG-DTBTA預測出的軌跡基本符合實際情況,角度、方向與運動趨勢均有較好的預測效果。

圖(f)中目標行人突然改變運動模式,做出急轉的行為,STG-DTBTA基本預測出了該急轉趨勢。同時,其身后的行人發現目標行人改變了運動模式,防止之后可能發生碰撞,也改變了自己的行進方向,STG-DTBTA同樣預測出了該行人的軌跡變化。圖(b)為行人并排行走的情況,STG-DTBTA預測出的軌跡與實際情況基本重合,表示本文模型對于較為簡單的行走模式具有更好的預測效果。圖(c)為多人復雜場景,該圖中存在多個行人且運動模式雜亂無章,存在多個交互情況,STG-DTBTA也基本預測出了場景中行人的軌跡走向。

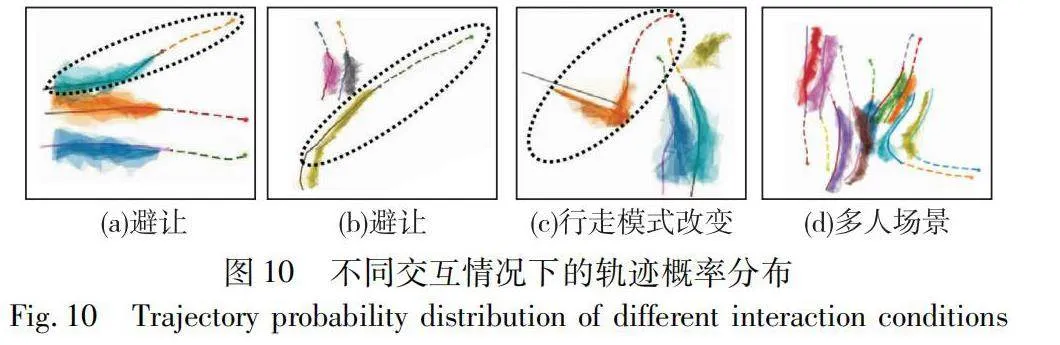

2.6.2 多模態軌跡預測

如圖10所示,圖(a)(b)均反映的是行人交互場景,虛線圈起的目標行人若按照原來的方向繼續行走,將會和行人發生碰撞,因此目標行人調整方向避讓。圖中可見概率分布基本覆蓋行人未來的真實軌跡,深色區域的角度與方向也基本符合行人未來真實軌跡。圖(c)反映行人的運動模式發生改變,目標行人行走一段時間后突然向左急轉彎,本文模型可以預測出其運動趨勢,其概率分布的角度、方向也基本一致。圖(d)展示多人場景,STG-DTBTA預測出的行人軌跡概率分布基本符合實際情況。因此,本文模型在多模態軌跡預測問題中同樣具有良好的表現。

3 結束語

本文提出STG-DTBTA模型預測行人軌跡。為了提高模型預測精準度,本文設計了PPM模塊實現部分行人建模;引入時空注意力機制、采用雙向TCN進行時空耦合建模。在ETH和UCY數據集上進行消融實驗和對比實驗,結果表明相對于其他模型,STG-DTBTA在ADE和FDE的評估指標上誤差更小,該方法在行人軌跡預測方面具有競爭力,通過定性分析可知預測軌跡的概率分布以及社會可接受軌跡基本符合實際情況。在行人軌跡預測問題中,本文模型通過改進行人交互建模過程和時空維度建模過程,可以在預測未來時刻的軌跡時表現出較好的預測精確度,并具有較好的實時性。

本文模型在eth場景下不具有優勢,原因可能在于選取的距離閾值不適用于該場景。因此,后續工作中將探索能夠自適應設置閾值的方法,對不同數據集自適應設置各自的最佳距離閾值,在不影響模型參數量和實時性的情況下進一步降低ADE和FDE的誤差。

參考文獻:

[1]孔瑋, 劉云, 李輝, 等. 基于深度學習的行人軌跡預測方法綜述[J]. 控制與決策, 2021, 36(12): 2841-2850. (Kong Wei, Liu Yun, Li Hui, et al. Survey of pedestrian trajectory prediction methods based on deep learning[J]. Control and Decision, 2021, 36(12): 2841-2850.)

[2]張睿, 吳伯雄, 張麗園, 等. 復雜場景下行人軌跡預測方法[J]. 計算機工程與應用, 2021, 57(6): 138-143. (Zhang Rui, Wu Boxiong, Zhang Liyuan, et al. Human trajectory prediction method for complex scenes[J]. Computer Engineering and Applications, 2021, 57(6): 138-143.)

[3]Helbing D, Molnar P. Social force model for pedestrian dynamics[J]. Physical Review E, 1995, 51(5): 4282.

[4]Alahi A, Goel K, Ramanathan V, et al. Social LSTM: human trajectory prediction in crowded spaces[C]// Proc of IEEE Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE Press, 2016: 961-971.

[5]Zhang Pu, Ouyang Wanli, Zhang Pengfei, et al. SR-LSTM: state refinement for LSTM towards pedestrian trajectory prediction[C]// Proc of IEEE/CVF Conference on Computer Vision and Pattern Recog-nition. Piscataway, NJ: IEEE Press, 2019: 12085-12094.

[6]Sun Hanbing, Chen Runfa, Liu Tianyu, et al. LG-LSTM: modeling LSTM-based interactions for multi-agent trajectory prediction[C]// Proc of IEEE International Conference on Multimedia and Expo. Piscataway, NJ: IEEE Press, 2022: 1-6.

[7]Gupta A, Johnson J, Li Feifei, et al. Social GAN: socially acceptable trajectories with generative adversarial networks[C]// Proc of IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE Press, 2018: 2255-2264.

[8]Sadeghian A, Kosaraju V, Sadeghian A, et al. SoPhie: an attentive GAN for predicting paths compliant to social and physical constraints[C]// Proc of IEEE/CVF Conference on Computer Visionand Pattern Recognition. Piscataway, NJ: IEEE Press, 2019: 1349-1358.

[9]Kothari P, Alahi A. Safety-compliant generate adversarial networks for human trajectory forecasting[J]. IEEE Trans on Intelligent Transportation Systems, 2023, 24(4): 4251-4261.

[10]李文禮, 張祎楠, 王夢昕. 基于視野域機制的行人軌跡預測[J]. 計算機應用研究, 2023, 40(1): 80-85. (Li Wenli, Zhang Yinan, Wang Mengxin. Pedestrian trajectory prediction based on field of view mechanism[J]. Application Research of Computers, 2023, 40(1): 80-85.)

[11]Yu Cunjun, Ma Xiao, Ren Jiawei, et al. Spatio-temporal graph transformer networks for pedestrian trajectory prediction[C]// Proc of the 16th European Conference on Computer Vision. Berlin: Springer, 2020: 507-523.

[12]趙懂宇, 王志建, 宋程龍. 基于Informer算法的網聯車輛運動軌跡預測模型[J]. 計算機應用研究, 2024, 41(4): 1029-1033. (Zhao Dongyu, Wang Zhijian, Song Chenglong. Model of predicting motion trajectory of connected vehicles based on Informer algorithm[J]. Application Research of Computers, 2024, 41(4): 1029-1033.)

[13]Mohamed A, Qian Kun, Elhoseiny M, et al. Social-STGCNN: a social spatio-temporal graph convolutional neural network for human trajectory prediction[C]// Proc of IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE Press, 2020: 14412-14420.

[14]Sun Jianhua, Jiang Qinhong, Lu Cewu. Recursive social behavior graph for trajectory prediction [C]// Proc of" IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE Press, 2020: 657-666.

[15]Kosaraju V, Sadeghian A, Martín-Martín R, et al. Social-BiGAT: multimodal trajectory forecasting using bicycle-GAN and graph attention networks[C]// Proc of the 33rd International Conference on Neural Information Processing Systems. Red Hook, NY: Curran Associates Inc., 2019: 137-146.

[16]陳浩東, 紀慶革. 用于行人軌跡預測的場景限制時空圖卷積網絡[J]. 中國圖象圖形學報, 2023, 28(10): 3163-3175. (Chen Haodong, Ji Qingge. Scene-constrained spatial-temporal graph convolutional network for pedestrian trajectory prediction[J]. Journal of Image and Graphics, 2023, 28(10): 3163-3175.)

[17]Zhang Xingchen, Abgeloudis P, Demiris Y. Dual-branch spatio-temporal graph neural networks for pedestrian trajectory prediction[J]. Pattern Recognition, 2023, 142: 109633.

[18]Liu Yanran, Guo Hongyan, Meng Qingyu, et al. Spatial-temporal graph attention network for pedestrian trajectory prediction[C]// Proc of the 6th CAA International Conference on Vehicular Control and Intelligence. Piscataway, NJ: IEEE Press, 2022: 1-6.

[19]Pellegrini S, Ess A, Van Gool L. Improving data association by joint modeling of pedestrian trajectories and groupings[C]// Proc of the 11th European Conference on Computer Vision. Berlin: Springer, 2010: 452-465.

[20]Yan Dapeng, Ding Gangyi, Huang Kexiang, et al. Enhanced crowd dynamics simulation with deep learning and improved social force model [J]. Electronics, 2024, 13(5): 934.

[21]Huang Yingfan, Bi Huikun, Li Zhaoxin, et al. STGAT: modeling spatial-temporal interactions for human trajectory prediction[C]// Proc of IEEE/CVF International Conference on Computer Vision. Piscataway, NJ: IEEE Press, 2019: 6271-6280.

[22]吳家皋, 章仕穩, 蔣宇棟, 等. 基于狀態精細化長短期記憶和注意力機制的社交生成對抗網絡用于行人軌跡預測[J]. 計算機應用, 2023, 43(5): 1565-1570. (Wu Jiagao, Zhang Shiwen, Jiang Yudong, et al. Social-interaction GAN for pedestrian trajectory prediction based on state-refinement long short term memory and attention mechanism[J]. Journal of Computer Applications, 2023, 43(5): 1565-1570.)

[23]Mo Haojie, Yuan Quan, Luo Guiyang, et al. WR-SRPG: joint wal-king rhythm and social relation-potential for pedestrian trajectory prediction[C]// Proc of IEEE International Intelligent Transportation Systems Conference. Piscataway, NJ: IEEE Press, 2021: 1890-1897.