機器學習方法用于建立乙酰膽堿酯酶抑制劑的分類模型

楊國兵 李澤榮 饒含兵 李象遠 陳宇綜

(1四川大學化學學院,成都 610064; 2四川大學化學工程學院,成都 610065; 3Department of Pharmacy,National University of Singapore,Singapore 117543)

機器學習方法用于建立乙酰膽堿酯酶抑制劑的分類模型

楊國兵2李澤榮1,?饒含兵1李象遠2陳宇綜3

(1四川大學化學學院,成都 610064;2四川大學化學工程學院,成都 610065;3Department of Pharmacy,National University of Singapore,Singapore 117543)

我們構建了表征乙酰膽堿酯酶抑制劑分子組成、電荷、拓撲、幾何結構及物理化學性質等特征的1559個描述符,通過Fischer Score排序過濾和Monte Carlo模擬退火法相結合進行變量篩選得到37個描述符,然后分別用支持向量學習機(SVM)、人工神經網絡(ANN)和k?近鄰(k?NN)等機器學習方法建立了乙酰膽堿酯酶抑制劑的分類預測模型.對于訓練集的515個樣本,通過五重交叉驗證,各機器學習方法對正樣本,負樣本和總樣本的平均預測精度分別為87.3%-92.7%,67.0%-81.0%和79.4%-88.2%;通過y?scrambling方法驗證SVM模型是否偶然相關,結果正樣本,負樣本和總樣本的平均預測精度分別為72.7%-82.5%,41.0%-53.0%和62.1%-69.1%,明顯低于實際所建模型的預測精度,表明所建模型不存在偶然相關;對172個沒有參與建模的外部獨立測試樣本,各機器學習方法對正樣本,負樣本和總樣本的預測精度分別為93.3%-100.0%, 74.6%-89.6%和86.1%-95.9%.所建模型中,SVM模型預測精度最好,且明顯高于其它文獻報道結果.

乙酰膽堿酯酶抑制劑;機器學習方法;變量篩選;應用域

阿爾茨海默病(Alzheimer disease,AD)即老年性癡呆癥,是慢性進行性神經退化疾病,嚴重影響患者的認知功能、記憶功能、個人生活能力和情感人格等,65歲以上人群中大約10%患有此病.一直以來,世界上較為接受的AD病理為“膽堿能缺失學說”,學說認為老年性癡呆癥患者大腦內神經遞質——乙酰膽堿的缺失是導致AD疾病的關鍵原因[1-2].乙酰膽堿酯酶(AChE)會催化乙酰膽堿的裂解反應,導致乙酰膽堿的缺失、神經信號傳遞失敗.目前對老年癡呆的藥物治療主要是通過用乙酰膽堿酯酶抑制劑(AChEIs)來減少乙酰膽堿的消耗,從而提高膽堿能神經元的興奮性,達到治療的效果[3].所以乙酰膽堿酯酶抑制劑作為主要治療手段已經被廣泛研究.1993年,第一個乙酰膽堿酯酶抑制劑他克林(tacrine)用于臨床治療AD[4],此后,越來越多的AChEIs被開發出來,比如多奈哌齊(donepezil)[5],加蘭他敏(galantamine)[6],利凡斯的明(rivastigmine)[7].

事實上,實驗方法開發AChEIs是比較盲目的,因此用計算的方法在實驗之前先進行針對性的篩選AChEIs是必要的,可以為實驗提供理論指導,挑選出一些有用的分子供實驗分析,這樣減少了藥物開發的盲目性,大大節省了開發的時間和資金.到目前為止,人們已經開發出了許多計算方法或模型去預測AChEIs,比如定量構效關系(QSAR)[8-11],分子對接(docking)[12-14].最近,Lv等[15]把三種機器學習方法SVM,k?NN和決策樹(DT)用于建立AChEIs分類模型,對抑制劑的預測精度在76.3%-88.0%,非抑制劑的預測精度在74.3%-79.6%,但是他們用的數據不夠多,預測結果也不夠理想.為此,本文著力于用機器學習方法(SVM[16],ANN[17],k?NN[18])使用更多的樣本去開發預測精度更高的模型,為篩選出有用的AChEIs提供更有效的手段.

1 原理與方法

1.1 數據收集

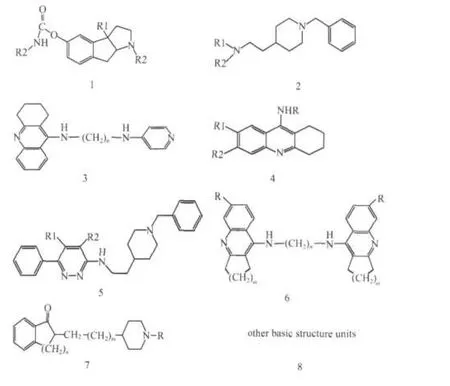

本文收集的717個抑制劑化合物分子(抑制劑的基本結構單元見Scheme 1)及它們的實驗半數抑制濃度IC50主要來源于參考文獻[12,19-55].同文獻[15]一樣,我們將IC50≤400 nmol·L-1的化合物劃分為抑制劑(正樣本),將IC50≥600 nmol·L-1的化合物劃分為非抑制劑(負樣本).這樣,717個分子包含了420個抑制劑和267個非抑制劑,此外,還有30個化合物的IC50在400和600 nmol·L-1之間,和文獻[15]一樣,這里也不把他們歸入抑制劑或非抑制劑,不對它們進行研究.本文所研究分子的穩定幾何結構均用HyperChem 7.0(http://www.hyper.com/)中的MM+力場優化得到.

1.2 數據集的結構多樣性

數據集中化合物的結構多樣性可以通過多樣性指標(DI)來評定,DI值是指數據集中成對化合物間的不相似性[56]:

其中N是數據集中化合物的個數,diss(i,j)是化合物i和j之間不相似度的度量.因為不相似度和相似度是互補的,所以經常定義為:

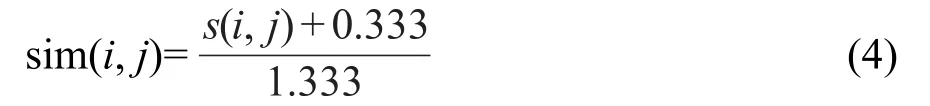

其中,sim(i,j)是化合物i和j之間的相似度的度量,本文中,相似度采用常用的Tanimoto系數[57],定義如下:

Scheme 1 Basic structure units ofacetylcholinesterase inhibitors

其中l是描述符的個數,xdi和xdj分別是化合物i和j的第d個描述符,s(i,j)為Tanimoto系數.由計算可知連續的Tanimoto系數的變化范圍為(-0.333,1.0),所以將Tanimoto系數歸一化,使其范圍為(0,1.0).歸一化的過程通過下式實現:

這樣代入式(2)得到的DI值的變化范圍為(0,1.0),數據集化合物的結構多樣性隨著DI值的增大而增加.

本文研究的687個分子的DI值為0.738,表明所研究對象具有足夠的結構多樣性.

1.3 分子描述符的計算及篩選

分子描述符是構建模型的關鍵,本研究我們采用MODEL軟件[58]進行描述符的計算,此軟件在網址(http://jing.cz3.nus.edu.sg/cgi?bin/model/model.cgi)可尋,是免費的學術軟件.我們對每個分子計算了1559個描述符,其中包含20個組成描述符、21個電荷相關描述符、2個物理化學性質描述符、482個拓撲描述符和1034個幾何描述符.

很顯然,并不是所有1559個描述符都與分子的活性相關,而且有些描述符之間存在線性相關,所以需要選擇合適的描述符以使建立的模型達到最好的預測能力.本文采用一套混合描述符篩選方法來尋找最優的描述符子集,其步驟如下.

(1)預處理:首先,如果有90%樣本的同一個描述符值是相同的,那么這個描述符對區別分子的活性無效,將它去除;其次,對任意一個描述符,遍及所有樣本計算該描述符的相對標準偏差,如果其值小于0.05,也將它刪除;最后,如果兩個描述符的Pearson相關系數[59]大于0.9,說明這兩個描述符高度相關,刪除其中之一.

(2)描述符排序:經過預處理后的描述符,按照Fischer Score(F?Score)[60]值遞減的順序排序.F?Score值F(i)是單個描述符的分辨能力的簡單度量,定義為:

其中μ+i和μ-i分別是第i個描述符的正、負樣本的平均值,σ+i和σ-i分別是它們的標準偏差.描述符的F?Score值越大,它對樣本的區分能力就越強.具體的篩選步驟如下:①計算每一個描述符的F?Score值,并將所有描述符按照F?Score值從大到小的順序排列;②把訓練集用五重交叉驗證的方法得到SVM模型的平均推廣誤差,并調節模型參數σ使推廣誤差最小;③刪除排序靠后5個描述符,回到第②步,直至模型的推廣誤差最小.由此,可選擇出F?Score值最好的描述符子集及對應的模型參數σ.

(3)Monte Carlo模擬退火算法:描述符在經過上述兩個步驟過濾后,進一步用Monte Carlo模擬退火法結合SVM進行篩選,文獻[61-62]有類似描述.首先我們給定一較高的模擬退火起始溫度T0,以及每一溫度的平衡步數和終止溫度,然后具體的篩選步驟如下:①給定SVM高斯指數的初值σ;②在初始溫度T0下隨機選擇一組描述符子集作為初始解;③用五重交叉驗證計算SVM模型的平均推廣誤差Eold;④對描述符子集給一隨機微擾,得到一新描述符子集,按上述方法計算模型的平均推廣誤差Enew;⑤如Enew<Eold,則接受新的描述符子集代替原來的描述符子集.反之,則以概率P=exp{-(Enew-Eold)/ T}接受為新描述符子集;⑥回到步驟④,直到達到此溫度下的最大平衡步數;⑦降低模擬退火溫度T,重復上步溫度的篩選過程,直到達到指定的終止退火溫度;⑧系統地調整σ值,返回步驟②,直至SVM模型的平均推廣誤差最小.由此,可得到最優的描述符子集和對應的最佳模型參數σ.

1.4 數據集的劃分和模型的驗證

本研究采用較流行的KS方法[63]來設計訓練集和外部獨立測試集.所構成的訓練集包含315個正樣本和200個負樣本,外部獨立測試集包含了105個正樣本和67個負樣本.訓練集用于模型的構建,外部獨立測試集用于客觀評價已建模型的預測能力.

本文中我們用三種方法去驗證分類模型.第一種是五重交叉驗證,把訓練集隨機分為5個數量接近的子集,每次用其中4個作為訓練集,另外一個作為測試集,這樣重復5次,保證每個子集都用作測試集一次.在此文中,我們用五重交叉驗證去優化預測模型:選出最優的描述符子集,優化模型參數如SVM中的高斯指數σ,ANN中隱含層的個數,k?NN中的k.第二種驗證方法是y?scrambling,用來評估所建模型是否偶然相關.保持訓練集樣本輸入變量不變,隨機將部分樣本的分類標號打亂,用打亂類別的訓練集建立新的分類模型,新模型的預測能力應該大大低于基于原始數據建立的實際模型[64],否則就是偶然相關,偶然相關的模型沒有預測能力.第三種驗證方法是外部獨立測試[65],把訓練集中所有樣本基于選出的最優描述符和最佳參數建立預測模型,用外部獨立測試集來評價已建模型的預測能力.因為外部獨立測試集中的樣本沒有參與模型的開發,所以這種驗證方法比交叉驗證更為嚴謹,更能客觀評價模型的預測能力.

1.5 機器學習方法

1.5.1 SVM方法

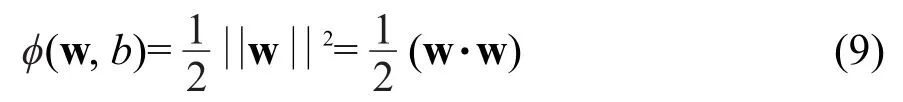

SVM方法是基于結構風險最小化準則,即通過對推廣誤差風險最小化,從而實現模型的最大推廣能力.該方法在文獻[16]中有詳細介紹,這里我們只做簡述.

給定一訓練集{xi,yi},i=1,2,…,n,yi∈{-1,+1},其中n是訓練集樣本的個數,yi∈{-1,+1}是類別標號.如果訓練集是線性可分的,SVM就是構建超平面

使正樣本和負樣本可分,且使其邊界上的點到該超平面的距離最大,這可轉化為下面的條件

限制下求函數

的最小值.由Lagrange乘數法可得解

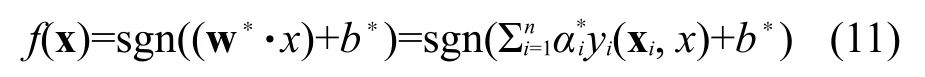

其中,sgn()為符號函數.如果訓練集是非線性可分的,則將向x通過非線性函數?(x)投影到某個高維特征空間,使其線性可分.非線性函數?(x)的引入是通過核函數K(xi,x)來實現的,即K(xi,x)=(?(xi)· ?(x)).此時的分類判別函數變為:

核函數K(xi,x)可以有多種形式,本文使用Gaussian核函數:

式中高斯指數σ稱為模型參數.

1.5.2 其他機器學習方法

此外,還分別將三層(包括輸入層、隱含層和輸出層)反向傳播ANN[17]和k?NN[18]方法用于建立乙酰膽堿酯酶抑制劑的分類預測模型.各機器學習方法的模型參數,即SVM中的高斯指數σ,ANN中隱含層的個數,k?NN中的k,均是通過五重交叉驗證使模型的推廣誤差最小來優化.上述方法均采用本小組自編的程序來實現.

1.6 結果評價

我們采用普遍使用的方法來評估分類模型對測試集的預測能力[66]:

靈敏性(sensitivity,SE):

特效性(specificity,SP):

總精度(accuracy,Q):

Matthews相關系數(MCC)[67]:

其中TP代表預測正確的正樣本數,TN代表預測正確的負樣本數,FP代表預測錯誤的負樣本數,FN代表預測錯誤的正樣本數.模型的敏感度分析SE用于評估正樣本的預測正確率,特效性分析SP用于評估負樣本的預測正確率.Q用于評估總體樣本的預測正確率.

2 結果和討論

2.1 描述符篩選對SVM預測性能影響

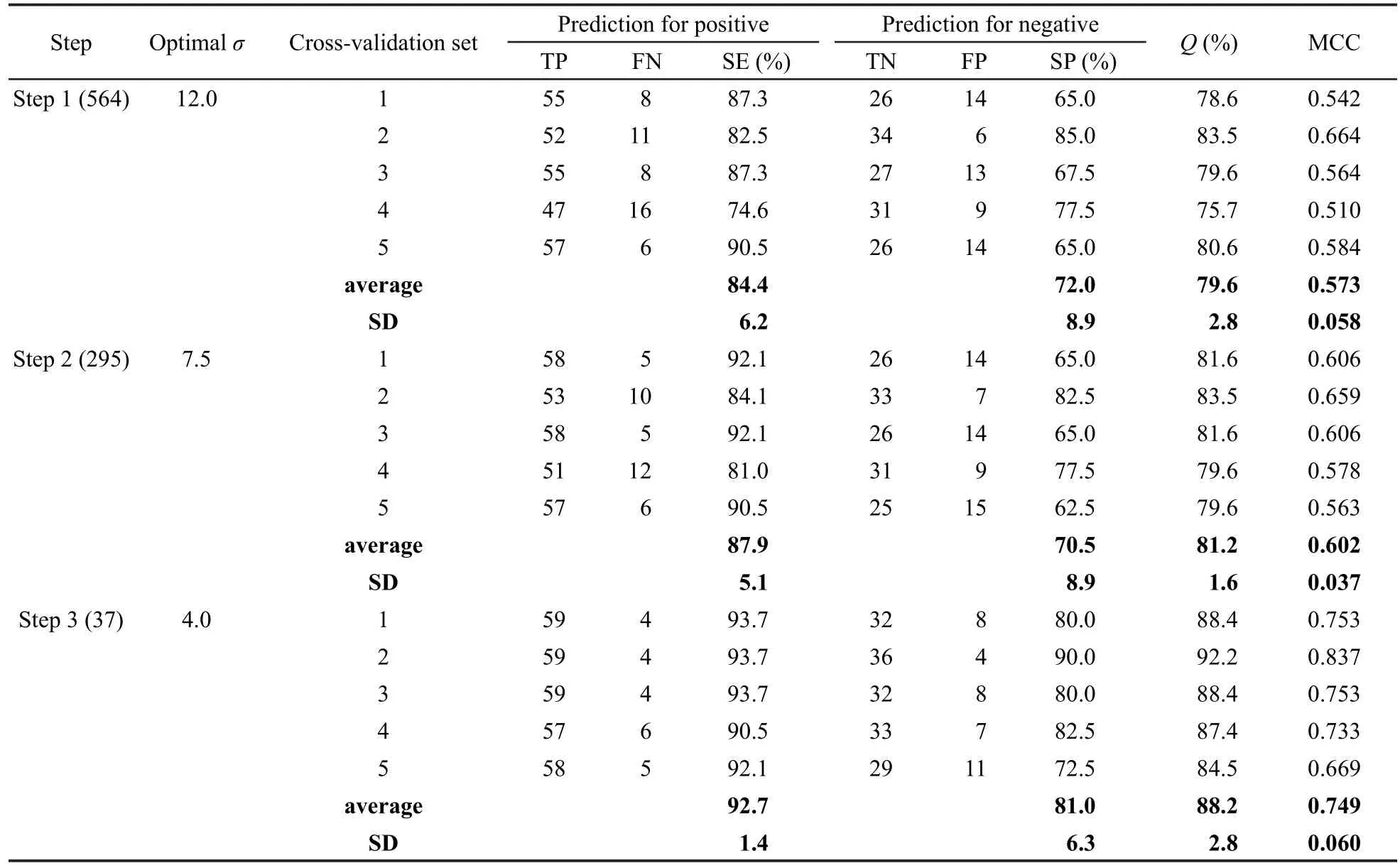

本研究中我們用SVM方法執行描述符變量的篩選,篩選結果列于表1.最初每個訓練集分子的描述符數目為1559個,經過預處理后,描述符的數目減少到564個,說明在最初的1559個變量中存在大量信息含量低或與其它描述符高度相關的描述符,經過預處理可以去掉.用這564個描述符通過五重交叉驗證方法建立SVM的分類預測模型,正樣本,負樣本和總樣本的平均預測正確率分別是84.4%, 72.0%和79.6%,MCC為0.573.進一步用F?Score值遞減排序篩選后,描述符數量減少到295個,通過五重交叉驗證建立SVM模型,正樣本,負樣本和總樣本的平均預測正確率分別是87.9%,70.5%和81.2%,MCC為0.602.對比兩組數據可知,F?Score排序步驟雖然沒有明顯提高模型的預測精度,但大大減少了描述符的數量,有利于提高模型的計算效率.由于描述符的個數還很多,故進一步用Monte Carlo模擬退火法進行篩選,最終得到37個描述符,此時SVM分類預測模型對正樣本,負樣本和總樣本的平均預測正確率分別為92.7%,81.0%和88.2%, MCC為0.749.由此可見,模擬退火法在大量減少描述符數量的同時能夠大大提高模型的預測精度,說明干擾變量和噪音變量已經被排除,得到了與分子活性相關性很強的描述符.最初的1559個描述符及篩選出的37個描述符列于Supporting Information中的表S1和S2.

表1 變量篩選對SVM預測精度的影響Table 1 Effect of feature selection on the performance of SVM

2.2 SVM模型y?scrambling驗證

為了評估所建模型對偶然相關的依賴程度,本文采用y?scrambling方法對SVM所建的模型進行驗證.首先將訓練集樣本中的輸入變量x保持不變,隨機將部分樣本對應的分類標號y改變類別,使這些樣本的輸入變量和類別號不再對應,以消除兩者之間存在的內在定量關系;隨后,針對上述改變類別的訓練集,采用本文的混合描述符篩選方法結合SVM通過五重交叉驗證建立新的預測模型;重復上述過程30次,并將其預測結果與基于原始樣本數據建立的實際預測模型進行比較,其預測結果見Sup?porting Information中的表S3.

從附表S3可以看出,通過y?scrambling方法驗證SVM模型,正樣本,負樣本和總樣本的平均預測精度分別在72.7%-82.5%,41.0%-53.0%和62.1%-62.1%-69.1%,很明顯,預測精度遠低于基于原始樣本數據建立的實際預測模型.這說明我們構建的SVM模型不存在偶然相關性.

2.3 其他機器學習方法

同時,為了檢驗所選描述符能否真正區別開不同類別的樣本,我們把SVM方法篩選出的37個描述符直接用于建立ANN和k?NN的分類模型,結果見表2.從表中可知,機器學習方法對正樣本、負樣本、總樣本的平均預測精度和MCC分別在87.3%-92.7%、67.0%-81.0%、79.4%-88.2%和0.561-0.749,SVM模型給出了最好的預測結果:SE= 92.7%,SP=81.0%,Q=88.2%,MCC=0.749.上面的結果表明我們所選擇的描述符也能用于其它機器學習方法建立分類模型并且可以得到良好的預測結果,所選的描述符是與乙酰膽堿酯酶抑制劑活性真正相關的.

2.4 外部獨立測試集

把所有的訓練集化合物用篩選出來的最優描述符子集和最優參數建立模型,然后用外部獨立測試集來評價模型.在討論外部測試之前,先討論模型的應用域.

機器學習方法所建立的模型是基于特定的訓練集而產生的,所以必定有其應用的范圍,只有確定模型的應用范圍,我們才知道所建模型對未知事物預測的可信度.模型的應用域就是用來討論模型應用范圍的.本論文中關于應用域的研究主要采用描述符空間(即訓練集化合物所覆蓋的描述符空間的組合,也稱之為描述符域[68])的方法,從建立模型所使用的訓練集和描述符出發進行研究.本文根據歐氏距離的方法來表征描述符域,Tropsha等[69]定義了應用域距離的閥值DT:

其中Z為閾值參數,〈D〉和s是訓練集中所有化合物間歐氏距離平均值和標準差.我們根據類似的方法定義應用域ST為:

〈S〉和σ是訓練集中所有化合物的歸一化Tanimoto相似性系數和標準差,Z為任意的閾值參數,目的是調控得到最大的應用域,我們設置Z缺省值為0.5.如果用來測試的化合物的Tanimoto相似性系數低于ST,則該化合物被認為是超出了應用領域,此時預測是不可靠的.

把篩選后37個描述符用于訓練集的計算,然后對所得的分子描述符數據進行標準化處理,即對每個變量先減去樣本平均值,再除以樣本方差,從而消除不同量綱對變量的影響,然后通過主成分分析(principal component analysis,PCA)消除多余的信息,并選取信息含量的加和大于90%的主成分(17個)用于樣本間相似性系數的計算.對于訓練集,經過歸一化的Tanimoto系數平均值為0.778,標準偏差為0.106,由式(19)計算出ST為0.725.對于172個獨立的測試集分子,嚴格地說只有9個化合物沒有在應用域范圍內,它們距離訓練集樣本最近分子的Tanimoto系數值分別為:0.656,0.682,0.720,0.680, 0.661,0.696,0.687,0.634和0.711.盡管這些Tanimoto系數低于ST值(0.725),但是彼此很接近,所以我們認為這9個分子也在所建模型的應用域范圍內.

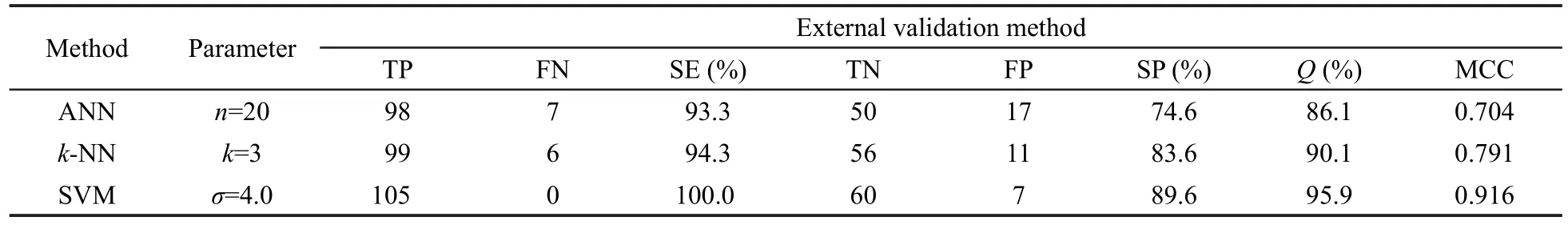

表3列出了模型對獨立測試集的預測結果,可以看到正樣本,負樣本,總樣本的預測精度和MCC分別在93.3%-100.0%,74.6%-89.6%,86.1%-95.9%和0.704-0.916.結果表明機器學習方法所建模型對外部獨立測試分子取得了良好的預測結果,所建模

型不存在過擬合的現象,同時也可以看出基于SVM方法所建模型的預測精度要明顯好于基于k?NN和ANN建立的模型.

表3 3種機器學習方法對外部獨立測試集預測結果的比較Table 3 Comparing predicted results based on three machine learning methods using independent validation sets

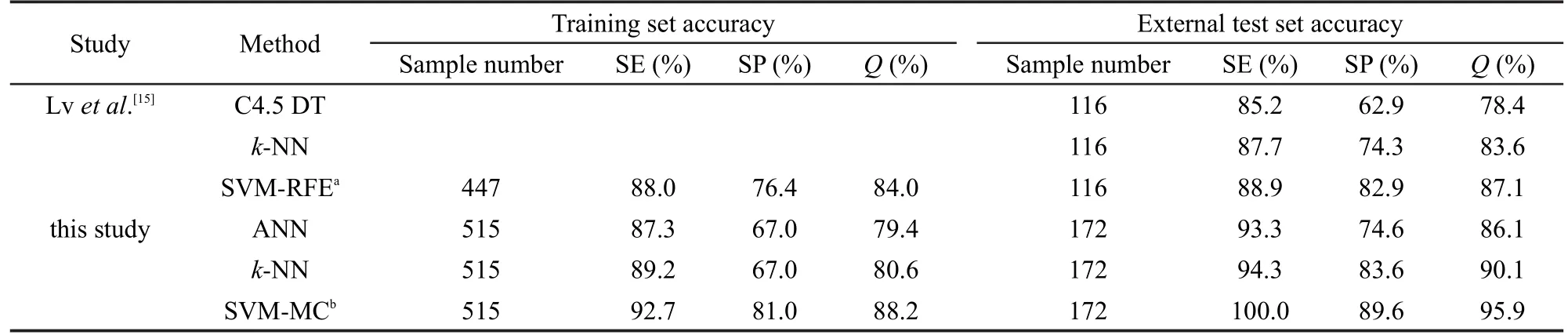

表4 本文與文獻[15]預測精度的比較Table 4 Comparison of the prediction accuracies of our models with literature[15]

2.5 文獻結果比較

將我們建立的模型的預測結果與文獻[15]預測的結果進行比較,以便檢驗我們模型的預測水平.但是需要指出的是直接和不同模型的預測結果相比較不太合理,因為不同的模型采用了不同的機器學習方法、不同的訓練集和測試集樣本、不同的分子描述符和不同的驗證方法.但是可以進行嘗試性的比較,以便對乙酰膽堿酯酶抑制劑的預測精度進行大概的評估.本研究主要與Lv等[15]建立的模型進行比較,他們也使用了三種機器學習方法建立了分類模型并取得了良好的預測結果.比較結果列于表4,從表中可以看出,本文的機器學習方法所建模型的預測精度要接近或者好于文獻報道的結果,尤其是SVM?MC模型,無論是交叉驗證還是外部獨立測試的結果,都明顯好于文獻報道結果,而且我們所用樣本的數量更多,化合物結構更具有多樣性,應用域覆蓋了更大的化學空間.所以我們建立的模型尤其是SVM?MC模型更加適用于對未知的乙酰膽堿酯酶抑制劑進行預測.

3 結論

本文對結構多樣性較大的乙酰膽堿酯酶抑制劑化合物數據集計算了1559個分子描述符,然后通過一套混合描述符篩選方法篩選出和抑制劑活性相關性很強的37個描述符,最后用SVM,k?NN和ANN建立乙酰膽堿酯酶抑制劑的分類預測模型.研究結果表明:變量篩選在大大減少描述符個數的同時能大大提高模型的預測能力;本文所建的SVM?MC模型要優于其他機器學習方法建立的模型,且預測精度明顯好于文獻已報道的結果,從而可以用于計算機輔助篩選具有乙酰膽堿酯酶抑制活性的先導化合物.

Supporting Information Available: Table S1 listed 1559 molecular descriptors.The selected molecular descriptors were listed in Table S2.Table S3 listed the results of y?scrambling test on SVM model.This information is available free of charge via the internet at http://www.whxb.pku.edu.cn.

1 Dekosky,S.T.;Scheff,S.W.Ann.Neurol.,1990,27:457

2 Terry,R.D.;Masliah,E.;Salmon,D.P.;Butters,N.;DeTeresa, R.;Hill,R.;Hansen,L.A.;Katzman,R.Ann.Neurol.,1991,30: 572

3 R?sler,M.;Anand,R.;Cicin?Sain,A.;Gauthier,S.;Agid,Y.;Dal?Bianco,P.;St?helin,H.B.;Hartman,R.;Gharabawi,M.Br.Med. J.,1999,318:633

4 Whitehouse,P.J.Acta Neurologica Scandinavica Supplement, 1993,149:42

5 Kelly,C.A.;Harvey,R.J.;Cayton,H.Br.Med.J.,1997,314:693

6 Scott,L.J.;Goa,L.K.Drugs,2000,60:1095

7 Gottwald,M.D.;Rozanski,R.I.Expert Opinion on Investigational Drugs,1999,8:1673

8 Hasegawa,K.J.Chem.Inf.Comput.Sci.,1999,39:112

9 Recanatini,M.;Cavalli,A.;Belluti,F.;Piazzi,L.;Rampa,A.; Bisi,A.;Gobbi,S.;Valenti,P.;Andrisano,V.;Bartolini,M.; Cavrini,V.J.Med.Chem.,2000,43:2007

10 Sheng,R.;Shen,Y.H.;Lin,X.;Luo,Y.;Fan,Y.J.;Li,J.Y.;Xia, H.R.;Hu,Y.Z.Chinese Journal of Medicinal Chemistry,2007, 17:348 [盛 榮,申艷紅,林 肖,羅 蘊,范永劍,李靜雅,夏海蓉,胡永洲.中國藥物化學雜志,2007,17:348]

11 Liu,A.L.;Guang,H.M.;Zhu,L.Y.;Du,G.H.;Li,M.Y.;Wang, Y.T.Sci.China Ser.C?Life Sci.,2007,37:503 [劉艾林,光紅梅,朱莉亞,杜冠華,李銘源,王一濤.中國科學C輯:生命科學, 2007,37:503]

12 Mizutani,M.Y.;Itai,A.J.Med.Chem.,2004,47:4818

13 Jiang,Y.R.;Xu,H.;Chen,F.J.;Ma,G.J.Acta Phys.?Chim.Sin., 2009,25:1379 [蔣玉仁,許 慧,陳芳軍,馬貫軍.物理化學學報,2009,25:1379]

14 Zheng,Q.C.;Chu,H.Y.;Niu,R.J.;Sun,C.C.Sci.China Ser.B?Chem.,2009,39:1454 [鄭清川,楚慧郢,牛瑞娟,孫家鍾.中國科學B輯:化學,2009,39:1454]

15 Lv,W.;Xue,Y.European Journal of Medicinal Chemistry,2010, 45:1167

16 Czerminski,R.;Yasri,A.;Hartsourgh,D.Quant.Struct.?Act. Relat.,2001,20:227

17 Tetko,I.V.;Luik,A.I.;Poda,G.I.J.Med.Chem.,1993,36:811

18 Ruiz,V.E.Pattern Recognition Letters,1986,4:145

19 Ishihara,Y.;Hirai,K.;Miyamoto,M.;Goto,G.J.Med.Chem., 1994,37:2292

20 Villalobos,A.;Blake,J.F.;Bigger,C.K.;Butler,T.W.;Chapin, D.S.;Chen,Y.L.;Ives,J.L.;Jones,S.B.;Liston,D.R.;Nagel, A.A.;Nason,D.M.;Nielsen,J.A.;Shalaby,I.A.;White,W.F. J.Med.Chem.,1994,37:2721

21 Chen,Y.L.;Nielsen,J.;Hedberg,K.;Dunaiskis,A.;Jones,S.; Russo,L.;Johnson,J.;Ives,J.;Liston,D.J.Med.Chem.,1992,5: 1429

22 Sugimoto,H.;Tsuchiya,Y.;Sugumi,H.;Higurashi,K.;Karibe, N.;Iimura,Y.;Sasaki,A.;Araki,S.;Yamanishi,Y.;Yamatsu,K. J.Med.Chem.,1992,35:4542

23 Villalobos,A.;Butler,T.W.;Chapin,D.S.;Chen,Y.L.; DeMattos,S.B.;Ives,J.L.;Jones,S.B.;Liston,D.R.;Nagel,A. A.;Nason,D.M.;Nielsen,J.A.;Ramirez,A.D,;Shalaby,I.A.; White,W.F.J.Med.Chem.,1995,38:2802

24 Rampa,A.;Bisi,A.;Valenti,P.;Recanatini,M.;Cavalli,A.; Andrisano,V.;Cavrini,V.;Fin,L.;Buriani,A.;Giusti,P.J.Med. Chem.,1998,41:3976

25 Contreras,J.M.;Rival,Y.M.;Chayer,S.;Bourguignon,J.J.; Wermuth,C.G.J.Med.Chem.,1999,42:730

26 Nagel,A.A.;Liston,D.R.;Jung,S.;Mahar,M.;Vincent,L.A.; Chapin,D.;Chen,Y.L.;Hubbard,S.;Ives,J.L.;Jones,S.B.; Nielsen,J.A.;Ramirez,A.;Shalaby,I.A.;Villalobos,A.;White, W.F.J.Med.Chem.,1995,38:1084

27 Vidaluc,J.L.;Calmel,F.;Bigg,D.C.H.;Carilla,E.;Briley,M. J.Med.Chem.,1995,38:2969

28 Carlier,P.R.;Chow,E.S.H.;Han,Y.;Liu,J.;Yazal,J.E.;Pang, Y.P.J.Med.Chem.,1999,42:4225

29 Kenna,M.T.M.;Proctor,G.R.;Young,L.C.;Harvey,A.L. J.Med.Chem.,1997,40:3516

30 Sugimoto,H.;Iimura,Y.;Yamanishi,Y.;Yamatsu,K.J.Med. Chem.,1995,38:4821

31 Rampa,A.;Piazzi,L.;Belluti,F.;Gobbi,S.;Bisi,A.;Bartolini, M.;Andrisano,V.;Cavrini,V.;Cavalli,A.;Recanatini,M.; Valenti,P.J.Med.Chem.,2001,44:3810

32 Contreras,J.M.;Parrot,I.;Sippl,W.;Rival,Y.M.;Wermuth,C. G.J.Med.Chem.,2001,44:2707

33 Hu,M.K.;Wu,L.J.;Hsiao,G.;Yen,M.H.J.Med.Chem.,2002, 45:2277

34 Recanatini,M.;Cavalli,A.;Belluti,F.;Piazzi,L.;Rampa,A.; Bisi,A.;Gobbi,S.;Valenti,P.;Andrisano,V.;Bartolini,M.; Cavrini,V.J.Med.Chem.,2000,43:2007

35 Belluti,F.;Rampa,A.;Piazzi,L.;Bisi,A.;Gobbi,S.;Bartolini, M.;Andrisano,V.;Cavalli,A.;Recanatini,M.;Valenti,P.J.Med. Chem.,2005,48:4444

36 Pilar,M.R.;Rubio,L.;Esther,G.P.;Dorronsoro,I.;Maria,M. M.;Valenzuela,R.;Usan,P.;Austria,C.;Bartolini,M.; Andrisano,V.;Axel,B.C.;Orozco,M.;Luque,F.J.;Medina,M.; Martinez,A.J.Med.Chem.,2005,48:7223

37 Sauvaitre,T.;Barlier,M.;Herlem,D.;Gresh,N.;Chiaroni,A.; Guenard,D.;Guillou,C.J.Med.Chem.,2007,50:5311

38 Cardoso,C.L.;Ian,C.G.;Silva,D.H.S.;Furlan,M.;Epifanio, R.A.;Pinto,A.C.;Rezende,C.M.;Lima,J.A.;Bolzani,V.S. J.Nat.Prod.,2004,67:1882

39 Bolognesi,M.L.;Cavalli,A.;Valgimigli,L.;Bartolini,M.; Rosini,M.;Andrisano,V.;Recanatini,M.;Melchiorre,C.J.Med. Chem.,2007,50:6446

40 Kavitha,C.V.;Gaonkar,S.L.;Chandra,J.N.;Sadashiva,C.T.; Rangappa,K.S.Bioorganic&Medicinal Chemistry,2007,15: 7391

41 Bianchi,D.A.;Hirschmann,G.S.;Theoduloz,C.;Bracca,A.B. J.;Kaufman,T.S.Bioorganic&Medicinal Chemistry Letters, 2005,15:2711

42 Sheng,R.;Lin,X.;Li,J.Y;Jiang,Y.K.;Shang,Z.C.;Hu,Y.Z. Bioorganic&Medicinal Chemistry Letters,2005,15:3834

43 Ishichi,Y.;Sasaki,M.;Setoh,M.;Tsukamoto,T.;Miwatashi,S.; Nagabukuro,H.;Okanishi,S.;Imai,S.;Saikawa,R.;Doi,T.; Ishihara,Y.Bioorganic&Medicinal Chemistry Letters,2005,13: 1901

44 Wang,B.;Mai,Y.C.;Li,Y.;Hou,J.Q.;Huang,S.L.;Ou,T.M.; Tan,J.H.;An,L.K.;Li,D.;Gu,L.Q.;Huang,Z.S.European J. Med.Chem.,2010,45:1415

45 Martinez,A.;Fernandez,E.;Castro,A.;Conde,S.;Isabel,R.F.; Banos,J.E.;Badia,A.J.Med.Chem.,2000,35:913

46 Shao,D.;Zou,C.Y.;Luo,C.;Tang,X.C.;Li,Y.C.Bioorganic& Medicinal Chemistry Letters,2004,14:4639

47 Belluti,F.;Piazzi,L.;Bisi,A.;Gobbi,S.;Bartolini,M.;Cavalli, A.;Valenti,P.;Rampa,A.European Journal of Medicinal Chemistry,2009,44:1341

48 Rampa,A.;Bisi,A.;Belluti,F.;Gobbi,S.;Valenti,P.;Andrisano, V.;Cavrini,V.;Cavalli,A.;Recanatini,M.Bioorganic& Medicinal Chemistry,2000,8:497

49 Toda,N.;Tago,K.;Marumoto,S.;Takami,K.;Ori,M.;Yamada, N.;Koyama,K.;Naruto,S.;Abe,K.;Yamazaki,R.;Hara,T.; Aoyagi,A.;Abe,Y.;Kaneko,T.;Kogen,H.Bioorganic& Medicinal Chemistry,2003,11:1935

50 Zaheer,U.H.;Mahmood,U.;Jehangir,B.Chem.Biol.Drug. Des.,2009,74:571

51 Pan,L.;Tan,J.H.;Hou,J.Q.;Huang,S.L.;Gu,L.Q.;Huang,Z. S.Bioorganic&Medicinal Chemistry Letters,2008,18:3790

52 Marco,J.L.;Rios,C.;Garcia,A.G.;Villarroya,M.;Carreiras,M. C.;Martins,C.;Eleuterio,A.;Morreale,A.;Orozco,M.;Luque, F.J.Bioorganic&Medicinal Chemistry,2004,12:2199

53 Shen,Q.;Peng,Q.;Shao,J.L.;Liu,X.F.;Huang,Z.S.;Pu,X. Z.;Ma,L.;Li,Y.M.;Chan,A.S.C.;Gu,L.Q.European Journal of Medicinal Chemistry,2005,40:1307

54 Martin,L.L.;Davis,L.;Klein,J.T.;Nemoto,P.;Olsen,G.E.; Bores,G.M.;Camacho,F.;Petko,W.W.;Rush,D.K.;Selk,D.; Smith,C.P.;Vargas,H.M.;Winslow,J.T.;Effland,R.C.;Fink, D.M.Bioorganic&Medicinal Chemistry Letters,1997,7:157

55 Sugimoto,H.;Yamanishi,Y.;Iimura,Y.;Kawakami,Y.Current Medicinal Chemistry,2000,7:303

56 Stewart,J.J.P.J.Comput.Chem.,1989,10:221

57 Willett,P.;Barnard,J.M.;Downs,G.M.J.Chem.Inf.Comput. Sci.,1998,38:983

58 Li,Z.R.;Han,L.Y.;Xue,Y.;Yap,C.W.;Li,H.;Jiang,L.;Chen, Y.Z.Biotechnol.Bioeng.,2007,97:389

59 Yang,C.W.;Su,J.Y.;Tsou,A.P.;Chau,G.Y.;Liu,H.L.;Chen, C.H.;Chien,C.Y.;Chou,C.K.Biochem.Biophys.Res. Commun.,2005,330:489

60 Fisher,R.A.Annals of Eugenics,1936,7:179

61 Ajmani,S.;Jadhav,K.;Kulkarni,S.A.J.Chem.Inf.Model., 2006,46:24

62 Li,P.;Tan,N.X.;Rao,H.B.;Li,Z.R.;Chen,Y.Z.Acta Phys.?Chim.Sin.,2009,25:1581 [李 平,談寧馨,饒含兵,李澤榮,陳宇綜.物理化學學報,2009,25:1581]

63 Kennard,R.W.;Stone,L.A.Technometrics,1969,11:137

64 Liu,H.;Papa,E.;Gramatica,P.Chem.Res.Toxicol.,2006,19: 1540

65 Liu,H.;Gramatica,P.Bioorganic&Medicinal Chemistry,2007, 15:5251

66 Bhasin,M.;Zhang,H.;Reinherz,E.L.;Reche,P.A.FEBS.Lett., 2005,579:4302

67 Matthews,B.W.Biochim.Biophys.Acta,1975,405:442

68 Dimitrov,S.;Dimitrova,G.;Pavlov,T.;Dimitrova,N.;Patlewicz, G.;Niemela,J.;Mekenyan,O.J.Chem.Inf.Model.,2005,45:839 69 Tropsha,A.;Golbraikh,A.Curr.Pharm.Des.,2007,13:3494

July 22,2010;Revised:August 15,2010;Published on Web:October 11,2010.

Classification Models for Acetylcholinesterase Inhibitors Based on Machine Learning Methods

YANG Guo?Bing2LI Ze?Rong1,?RAO Han?Bing1LI Xiang?Yuan2CHEN Yu?Zong3

(1College of Chemistry,Sichuan University,Chengdu 610064,P.R.China;2College of Chemical Engineering,Sichuan University,Chengdu 610065,P.R.China;3Department of Pharmacy,National University of Singapore,Singapore 117543)

A total of 1559 molecular descriptors including constitutional,charge distribution,topological, geometrical,and physicochemical descriptors were calculated to encode acetylcholinesterase inhibitors. The 37 molecular descriptors were selected using a hybrid filter/wrapper approach by combining a Fischer Score and Monte Carlo simulated annealing.Classification models for the acetylcholinesterase inhibitors were then built based on support vector machine (SVM),artificial neural networks(ANN),and k?nearest neighbor(k?NN)methods.For the 515 samples in the training set,we obtained average prediction accuracies of 87.3%-92.7%,67.0%-81.0%,and 79.4%-88.2%for the positive,the negative, -and the total samples,respectively,by 5?fold cross validation.Average prediction accuracies of 72.7%82.5%, 41.0%-53.0%,and 62.1%-69.1%were obtained for the positive,the negative,and the total samples, respectively,by the y?scrambling method,indicating that there was no chance correlation in our models.An external test was conducted on 172 samples that were not used for model building and we obtained prediction accuracies of 93.3%-100.0%,74.6%-89.6%,and 86.1%-95.9%for the positive,the negative,and the total samples,respectively.The prediction accuracies obtained by all the machine learning methods especially by the SVM method were far better than previously reported results.

Acetylcholinesterase inhibitor;Machine learning method;Feature selection; Applicability domain

O641

?Corresponding author.Email:lizerong@scu.edu.cn;Tel:+86?28?85406139.

The project was supported by the National Natural Science Foundation of China(20973118).

國家自然科學基金(20973118)資助項目