一種2DDCT與壓縮感知結(jié)合的人臉識(shí)別

路 翀 , 劉曉東 , 劉萬泉

(1.大連理工大學(xué) 電信學(xué)部,遼寧 大連 116024;2.澳大利亞科庭大學(xué) 西澳 佩斯市 6102;3.伊犁師范學(xué)院 新疆 伊寧 835000)

人臉識(shí)別技術(shù)在國內(nèi)外許多領(lǐng)域得到了廣泛應(yīng)用[1],研究者們?yōu)樘岣咦R(shí)別率提出了許多人臉識(shí)別方法。文獻(xiàn)[2-3]綜述了近幾年人臉識(shí)別的主要方法和進(jìn)展。人臉識(shí)別中的一個(gè)關(guān)鍵問題是特征選擇,其基本任務(wù)是從許多特征中找出最有效的特征。人臉圖像數(shù)據(jù)量一般十分龐大,直接用于識(shí)別效率不高,因此必須對(duì)原始圖像進(jìn)行有效降維。2DDCT是常用的圖像壓縮方法,其本質(zhì)是通過2DDCT對(duì)圖像進(jìn)行變換,用較少的數(shù)據(jù)表示較多的信息,實(shí)現(xiàn)圖像壓縮,以達(dá)到減少數(shù)據(jù)存儲(chǔ)量提高傳輸速率的目的。2DDCT既能有效地降低特征維數(shù),又可以保留對(duì)光照、表情以及姿態(tài)不敏感的類別信息,許多研究人員嘗試著將2DDCT應(yīng)用到圖像特征降維。文獻(xiàn)[4]詳細(xì)闡述了基于DCT的人臉表征,文獻(xiàn)[5]提出了一種M2DPCA和NFA相結(jié)合的人臉識(shí)別方法。

在模式識(shí)別中,壓縮感知(Compressive Sensing,or Compressed Sampling,簡(jiǎn)稱 CS)[6],是近幾年流行起來的一個(gè)介于數(shù)學(xué)和信息科學(xué)的新方向,由Candes、Terres Tao等人提出,挑戰(zhàn)傳統(tǒng)的采樣編碼技術(shù),即Nyquist采樣定理,CS理論是基于信號(hào)“信息”的一種采樣技術(shù),是對(duì)信號(hào)更為本質(zhì)的描述。目前,該理論是一個(gè)快速發(fā)展的領(lǐng)域,在許多基礎(chǔ)的信號(hào)和圖像處理中取得了很好的效果[7],在信號(hào)處理、圖像識(shí)別等領(lǐng)域也有廣泛的研究[8-9]。由于在圖像識(shí)別過程中,運(yùn)用CS理論需要預(yù)先將人臉圖像矩陣展開成一維的向量,轉(zhuǎn)換后的一維向量的維數(shù)一般較高,因此,對(duì)很多分辨率較高人臉圖像都要預(yù)先做裁剪。而2DDCT能夠有效地濾掉圖像中不敏感的中頻和高頻部分,保留信息的本質(zhì)內(nèi)容。

鑒于此,提出將二維離散余弦變換與壓縮感知相結(jié)合用于人臉識(shí)別。首先對(duì)原始人臉圖像實(shí)施2DDCT變換,接著進(jìn)行壓縮,濾掉圖像中不敏感的中頻和高頻部分后,在頻域中用壓縮感知算法提取人臉特征,將提取的人臉識(shí)別特征用最近鄰分類器完成識(shí)別,在ORL、Yale、YaleB及Feret人臉數(shù)據(jù)庫上得到了較好的識(shí)別效果,且能減少整體識(shí)別時(shí)間。

1 人臉識(shí)別模型

人臉圖像數(shù)據(jù)包含較大的冗余信息,需要進(jìn)行降維處理;首先將人臉圖像實(shí)施2DDCT,經(jīng)過2DDCT后能量主要集中在低頻系數(shù)上,適當(dāng)?shù)靥崛?DDCT系數(shù)也就達(dá)到了降維的目的。然后在頻域中應(yīng)用CS進(jìn)行特征提取,將提取的人臉識(shí)別特征利用最近鄰分類器完成識(shí)別。

1.1 離散余弦變換

人臉圖像數(shù)據(jù)是高度相關(guān)的,存在很大的冗余性。圖像經(jīng)過2DDCT變換后,其低頻分量集中在左上角,高頻分量分布在右下角。低頻分量包含了圖像的主要信息,與之相比高頻分量就顯得不那么重要了,所以可以忽略高頻分量,從而達(dá)到壓縮的目的。圖像經(jīng)過2DDCT變換后,只需用少量的數(shù)據(jù)點(diǎn)即可表示圖像。2DDCT系數(shù)很容易被量化,因此能獲得較好的塊壓縮,同時(shí)具有快速算法,因此在人臉識(shí)別中容易實(shí)現(xiàn)。

離散余弦變換是一種常用的圖像數(shù)據(jù)壓縮方法,它的壓縮質(zhì)量接近于信息壓縮的最優(yōu)變換(變K-L換)。 對(duì)于一幅M×N 的數(shù)字圖像 f(x,y),離散余弦變換的特點(diǎn)是:頻域變化因子 u,v較大時(shí),DCT 系數(shù) C(u,v)的值很小; 而數(shù)值較大的C(u,v)主要分布在u,v較小的左上角區(qū)域,這也是有用信息的集中區(qū)域。基于2DDCT系數(shù)重建圖像時(shí),保留少數(shù)離散余弦變換的低頻分量,而舍去大部分高頻分量,利用反變換仍可獲得與原始圖像相近的恢復(fù)圖像。

1.2 壓縮感知(CS)

壓縮感知的數(shù)學(xué)描述是:

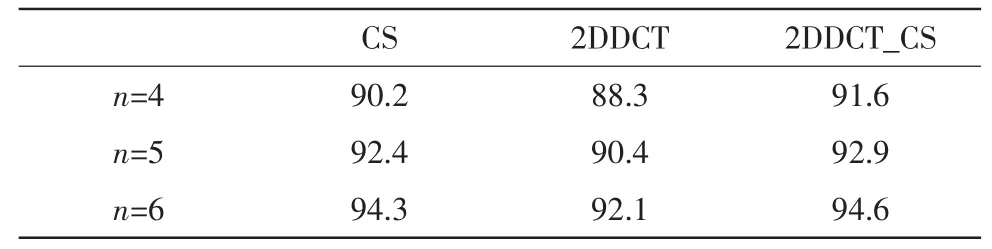

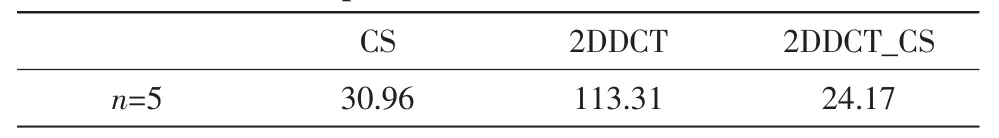

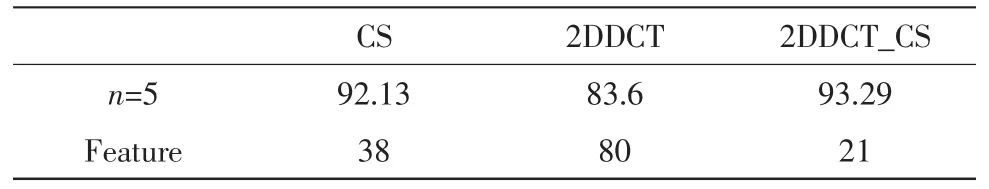

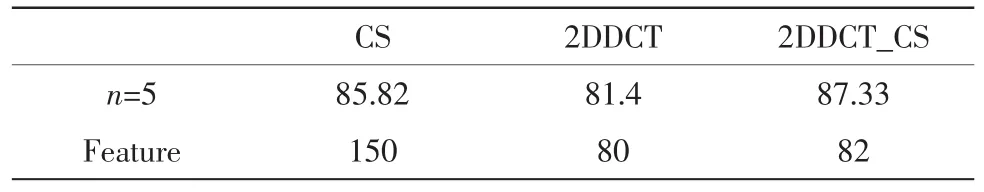

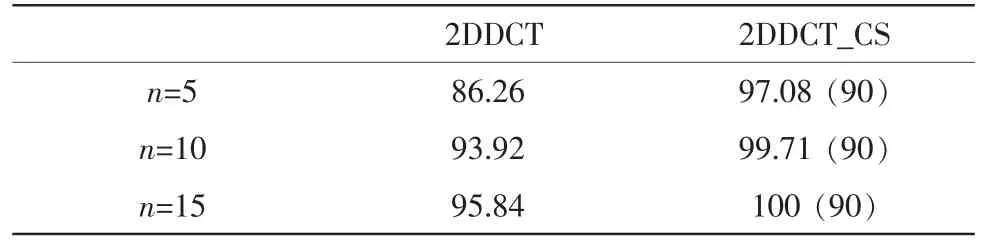

對(duì)給定的 T, 稀疏信號(hào) x∈Rn在數(shù)據(jù)字典 Ψ=[Ψ1,Ψ2,…Ψk]∈Rn×k,(n<k)上可以表示為 x=Ψα,α∈Rk且‖α‖0<T< 設(shè) Ω=ΦΨ∈Rp×k,(p< 由于p< 求得α^后,重構(gòu)信號(hào)可以用x^=Ψα^表示。 在稀疏分解算法的設(shè)計(jì)方面,已經(jīng)有許多好的算法[8],如基于貪婪迭代思想的MP(Matching Pursuit),正交最小二乘OLS(Orthogonal Least Squares)等算法以及與之相關(guān)的改進(jìn)算法,本文采用的是正交最小二乘算法OLS。 在壓縮感知人臉識(shí)別中,用所有的訓(xùn)練樣本構(gòu)造字典矩陣 Ψ=[A1,A2,…AC]∈Rn×N,這里訓(xùn)練樣本是一個(gè) n 維向量,N是訓(xùn)練樣本總數(shù);A1是包含第i類所有訓(xùn)練樣本的矩陣。將一個(gè)人臉 x表示為 x=Ψα,(‖α‖0<T)投映矩陣 Φ 有滿足高斯獨(dú)立分布的隨機(jī)矩陣產(chǎn)生并按列標(biāo)準(zhǔn)化,測(cè)量矩陣Y在訓(xùn)練階段產(chǎn)生,Y=ΦΨ∈Rp×N。給定一個(gè)測(cè)試樣本x,計(jì)算投映樣本y=Φx,然后,用 OLS 算法尋找稀疏向量α^,使其滿足 Yα=y;最后,用基于α^計(jì)算在每個(gè)類上的重構(gòu)誤差來確定測(cè)試樣本x屬于哪個(gè)類。 文章提出的算法是基于2DDCT特征提取和降維特性,由于在頻域中經(jīng)過2DDCT變換的圖像能夠比原本在時(shí)域中更有效降低光照和側(cè)轉(zhuǎn)等因素影響,所以,先用2DDCT將人臉矩陣投映到頻域后,取右上角w×w塊作為頻域中的“人臉”,然后運(yùn)用CS做人臉識(shí)別,亦即是為了去除噪音先用2DDCT進(jìn)行過濾,然后在頻域中取左上角較小塊做“人臉”,運(yùn)用CS做人臉識(shí)別,這樣能夠有效降低計(jì)算復(fù)雜度,提高識(shí)別效率。 算法步驟如下: 1)輸入c類N個(gè)訓(xùn)練樣本,用2DDCT將其投映到頻域空間,在頻域中取右上角w×w作為頻域中的訓(xùn)練樣本,構(gòu)成字典矩陣 Ψ=[A1,A2,…AC]∈Rn×N。 2)產(chǎn)生按列標(biāo)準(zhǔn)化的隨機(jī)投映矩陣Φ∈Rp×n。 3)給定一個(gè)測(cè)試圖像,將其用2DDCT投映到頻域空間,得到頻域中的測(cè)試圖像x。 4)在頻域空間計(jì)算 Yi=ΦA(chǔ)i,(i=1,…C)并計(jì)算測(cè)量矩陣Y=[Y1,Y2,…YC]=ΦΨ∈Rp×N 將文章提出的方法先在ORL人臉庫上進(jìn)行測(cè)試。該人臉庫包含40個(gè)人,每個(gè)人有10幅圖像。圖像為單一深色背景的正面圖像,包含了一定的光照、表情、面部細(xì)節(jié)變化以及一定范圍內(nèi)的深度旋轉(zhuǎn)。圖像大小均為112×92像素。實(shí)驗(yàn)中對(duì)每個(gè)人,隨機(jī)選取 4、5、6幅圖像作為訓(xùn)練樣本,其余的 6、5、4幅圖像分別用來做測(cè)試。首先運(yùn)用CS方法,取特征向量維數(shù)feature=150進(jìn)行識(shí)別,記作CS方法;然后將所有人臉圖像用2DDCT變換投映到頻域,在頻域中取能量集中的低頻部分64×64,分別運(yùn)用 2DDCT 和 CS 方法識(shí)別(取 feature=82),分別記作2DDCT和2DDCT_CS方法,實(shí)驗(yàn)結(jié)果為5次平均值,識(shí)別率比較見表1;每類用5個(gè)作為訓(xùn)練樣本,5次識(shí)別運(yùn)行平均時(shí)間(CPU:2 duo cpu 2.13 GHz, RAM:2.0 GB)比較見表 2。 從表1中可以看出,文章提出的2DDCT_CS方法比CS方法的識(shí)別率略高,比 2DDCT方法有明顯提高,在訓(xùn)練樣本n=6時(shí),2DDCT方法和2DDCT_CS方法識(shí)別率幾乎相同,訓(xùn)練樣本到一定數(shù)量識(shí)別率不在有大的區(qū)別。 表1 3種方法在ORL上的識(shí)別率(%)比較Tab.1 Recognition accuracy(%)in ORL database 表2 3種方法在ORL上識(shí)別的運(yùn)行時(shí)間(秒)比較Tab.2 Computation Cost in ORL database (s) 從表 2中可以看出,DCT耗費(fèi)時(shí)間最多,CS次之,2DDCT_CS方法最小,CS與2DDCT_CS方法相近,由于CS,2DDCT_CS方法在識(shí)別前都進(jìn)行了較大的降維處理,而2DDCT_CS方法進(jìn)行了兩次降維,所以,用時(shí)最少,當(dāng)訓(xùn)練樣本較少時(shí)含有較多的信息量,識(shí)別率較高。 另外兩組在Yale和Feret人臉庫上做實(shí)驗(yàn),Yale數(shù)據(jù)庫包含了15個(gè)人的不同條件下的圖像,數(shù)據(jù)庫中每個(gè)人各有11種不同光照、表情、姿態(tài),是否戴眼鏡等條件下的成像圖像,圖像總量為165張。這些圖像大小均為231×195像素,為做CS實(shí)驗(yàn)方便,將原圖像按中心對(duì)稱裁剪為100×80像素。在Feret人臉庫中包含不同表情,不同距離,不同時(shí)間,面部變化、旋轉(zhuǎn)等人臉圖像,將個(gè)體不少于10幅圖像共49人選出(超過10幅取前10幅),按給定的人眼和鼻子位置將原來640×480的圖像裁剪到112×92實(shí)驗(yàn)。與在ORL數(shù)據(jù)庫類似,比較各自最高識(shí)別率及其所取的特征向量維數(shù),見表3和表4。 表3 3種方法在Yale上的識(shí)別率(%)比較Tab.3 Comparison the recognition rates(%)of tree approaches under the Yale database 表4 3種方法在Feret上的識(shí)別率(%)比較Tab.4 Comparison the recognition rates(%)of tree approaches under the Feret database 從表3和表4中可以看出,文章提出的2DDCT_CS方法比CS、2DDCT的識(shí)別率都有一定的提高。 對(duì)于以上實(shí)驗(yàn),在像素較大的圖像運(yùn)用CS方法時(shí)都必須先進(jìn)行裁剪,得到像素較小的圖像后才能方便使用CS方法,而筆者提出的2DDCT_CS方法可以不進(jìn)行裁剪處理。因此,最后一個(gè)實(shí)驗(yàn)直接應(yīng)用2DDCT_CS方法在典型人臉數(shù)據(jù)庫YaleB作為實(shí)驗(yàn),YaleB數(shù)據(jù)庫包含了10個(gè)人的不同條件下、不同表情、不同背景和不同姿態(tài)下的圖像。數(shù)據(jù)庫中每個(gè)人各有64種不同光照、姿態(tài)等條件下的成像圖像,圖像總量為640張。這些圖像大小均為640×480像素。實(shí)驗(yàn)中對(duì)每個(gè)人,5次隨機(jī)選取5、10、15幅圖像作為訓(xùn)練樣本,其余每人的59、54、49幅圖像分別用來做測(cè)試識(shí)別方法的性能。首先將所有人臉圖像用2DDCT變換投映到頻域,在頻域中分別取能量集中的低頻部分 80×80,然后分別運(yùn)用 2DDCT和2DDCT_CS方法識(shí)別,實(shí)驗(yàn)結(jié)果為5次平均值 (小括號(hào)中為2DDCT_CS在頻域中所取的特征值)。實(shí)驗(yàn)結(jié)果見表5: 表5 兩種方法在YaleB上的識(shí)別率(%)Tab.5 Comparison the recognition rates(%)of two approaches on ORL database 從表5中可以看出,文章提出的2DDCT_CS方法比2DDCT方法的識(shí)別率有顯著提高,當(dāng)訓(xùn)練樣本n達(dá)到15時(shí),識(shí)別率可達(dá)100%,且不需要對(duì)圖像進(jìn)行裁剪,這說明該算法的有效性和魯棒性。 2DDCT既能有效地降低特征維數(shù),又可以保留對(duì)光照、表情以及姿態(tài)不敏感的類別信息。 文章結(jié)合2DDCT和CS的優(yōu)點(diǎn)提出了一種2DDCT_CS人臉識(shí)別方法,無論是對(duì)高維問題還是大樣本集問題都可進(jìn)行有效地特征抽取,提高正確識(shí)別率,特別是在YaleB人臉數(shù)據(jù)庫運(yùn)用該方法得到了很好的實(shí)驗(yàn)結(jié)果。此外,在對(duì)CS方法以及在2DDCT變換頻域塊的取值和經(jīng)過2DDCT變換后,對(duì)不同的人臉數(shù)據(jù)庫中的特征值應(yīng)如何設(shè)置才能更好地提高識(shí)別效率,仍需進(jìn)一步研究。 [1]Kwak K C,Pedrycz W.Face recognition using an enhanced independent component analysis approach [J].IEEE Trans.Neural Networks (S1045-9227), 2007, 18(2):530-541. [2]Fmatos F,Batista L V,Poel J D.Face recognition using DCT coefficients election [C]//Proceedings of the 2008 ACM Symposium on Applied Computing.Fortaleza:Brazl,2008:1753-1757. [3]Bengherabi M,Mezai L,Harizi F.2DPCA based techniques in DCT domain for face recognition[J].Int.J.Intelligent Systems Technologies and Applications,2009,7(3):243-264. [4]梁淑芬,甘俊英.基于局部小波變換與DCT的人臉識(shí)別算法[J].微計(jì)算機(jī)信息,2006,22(2):206.LIANG Shu-fen,GAN Jun-ying.Face recognition based on local wavelet transform and discrete cosine transform[J].Microcomputer Information,2006,22(2):206. [5]陳勝.一種M2DPCA和NFA相結(jié)合的人臉識(shí)別方法[J].電子設(shè)計(jì)工程,2011,19(13):163-165.CHEN Sheng.A facerecognition algorithm based on combination of modular 2DPCA and NFA[J].Electronic Design Engineering,2011,19(13):163-165. [6]Candes E J,Tao T. “Near-optimal signal recovery from random projections: Universal encoding strategies?”[J]. IEEE Transactions on Information Theory,2006,52 (12):5406-5425. [7]Michael Elad.Optimized projections for compressed sensing[J].IEEE Transactions on Signal Processing,2007,55 (12):5695-5702. [8]張宗念 ,黃仁泰 ,閆敬文.壓縮感知信號(hào)盲稀疏度重構(gòu)算法[J].電子學(xué)報(bào),2011,39(1):18-22.ZHANG Zong-nian,HUANG Ren-tai,YAN Jing-wen.A blind sparsity reconstruction algorithm for compressed sensing signal[J].Acta Electronica Sinica,2011,39(1):18-22. [9]Nhat Vo,Duc Vo,Subhash Challa,et al.Compressed Sensing for Face Recognition [C]//Computational Intelligence for Image Processing,2009:104-109.

1.3 基于壓縮感知的人臉識(shí)別(CSFR)

1.4 基于2DDCT的壓縮感知算法

2 試驗(yàn)結(jié)果與分析

3 結(jié)束語