基于灰度概率統計的視覺注意改進算法

劉 兵,霍建亮

(1.駐二○九所軍代室 四川 成都 610041;2.西南技術物理研究所 四川 成都 610041)

人類能夠在一個復雜的場景中快速的有選擇的找到“顯著的”或“感興趣”的物體,而忽略那些不太突出的物體,這個過程稱為視覺注意。視覺注意機制在人的日常生活過程中起著非常重要的作用。當人們面對一個復雜場景時,在視野中的信息是海量的,但是人們大腦同時并行處理信息的能力是有限的,與此同時,并不是所有的信息都是同等重要的,需要根據它的重要程度分別給予不同的重視級別。因此,通過視覺注意機制,人類可以對輸入的視覺信息進行有效地篩選,使得人類能夠對突發、緊急和危險情況作出及時的反應。在計算機視覺處理中引入這種注意機制,來更好地處理數據篩選問題,對提高機器人的智能具有重大意義[1]。

視覺注意機制是一個多門學科交叉的研究領域。視覺生理學與認知心理學等領域的學者,主要研究視覺注意機制的神經機理和認知模型;計算機視覺、模式識別、人工智能與信息處理等領域的學者,主要研究如何建立視覺注意的計算模型來模擬實現,視覺生理學和認知心理學對視覺注意的研究成果及其提出的合理假設[2]。文中研究的是構造視覺注意的計算模型,來更好的模擬視覺注意機制。

1 視覺注意計算模型

在眾多視覺注意建模思路中,Itti等人提出一種視覺注意計算模型,簡稱為ITTI模型[3],引起了廣泛的關注。Itti模型采用一種自底向上的注意機制,提取輸入圖像的亮度、顏色和方向特征做為視覺初級特征,采用中央周邊差操作和非線性歸一化得到對應的特征圖顯著圖,將各特征顯著圖進行線性組合得到總顯著圖,最后采用勝者全贏的神經網絡和禁止返回機制進行注意轉移。圖1所示是Itti模型的結構圖,該模型能自適應地檢測圖像中的感興趣區域,在目標檢測和識別等圖像處理任務中有很大的優勢。

1.1 高斯金字塔結構

解剖學和神經科學的研究發現,視網膜中心具有較小的感受野,外周的則較大,采樣密度和視覺分辨率隨著到視網膜中央的距離增大而降低,外圍的信息被大量壓縮。Itti模型采用了高斯金字塔結構來模擬這種非均勻采樣機制。

建立金字塔結構是由平滑和下采樣兩部分組成的。對于一幅圖像 I(i,j),設 s為金字塔的層數,當 s=0 時,I0(x,y)=I,這表示圖像金字塔結構最底層為原始圖像,則金字塔的s層由s-1層計算得到,計算公式為:

圖1 Itti模型的結構圖Fig.1 Architecture of the Itti model

這里w(m,n)為下采樣的核函數,一般選取高斯核函數。Itti模型中采用[1,4,6,4,1]的平滑濾波器,分別對圖像進行行濾波和列濾波。注意這里濾波時采取隔點濾波,達到下采樣的效果。Itti模型進行8次高斯濾波下采樣,加上原來的原圖像,形成一個9層的高斯金字塔結構。

1.2 初級視覺特征提取

特征的選取是計算模型中最重要的問題。Itti模型提取了輸入圖像的亮度、顏色和方向特征作為初級視覺特征。

1.2.1 亮度特征

設 r(s),g(s),b(s)分別表示圖像的紅色、綠色和藍色通道,這里 s表示圖像金字塔的層數,取值范圍是[0,1,…,8]。Itti模型中金字塔結構的每一層圖像的亮度特征為:

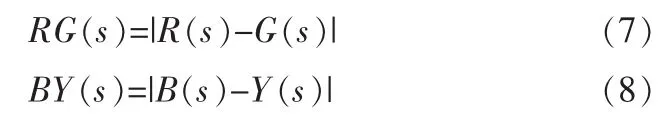

1.2.2 顏色特征

由圖像的 r(s),g(s),b(s)3 個通道計算得到廣義上的紅、綠、藍和黃4個通道:

然后組成紅-綠和藍-黃通道為:

1.2.3 方向特征

圖像處理中,Gabor函數有很好的方向選擇性[4]。二維Gabor濾波器的數學表達式為:

這里,α與β分別為x和y方向上的標準差,λ為正弦波的波長,θk為方向,定義為(k-1),k=1,2,…,n。

Itti模型中取 0°,45°,90°,135°4 個方向的 Gabor濾波器輸出作為方向特征,即 n=4。 xθk和 yθk的計算公式為:

獲得 0°,45°,90°,135°4 個方向的 Gabor濾波器,然后對高斯金字塔結構中的每層圖像進行濾波,得到4個方向上的特征圖。

1.2.4 總顯著圖

設 c表示金字塔結構的中央層,取值為{2,3,4};c+s表示金字塔結構的周邊層,s取值為{3,4},Θ表示中央層與對應的周邊層進行層間相減操作。 Mint[c,(c+s)]表示亮度特征圖,

MRG[c,(c+s)]表示紅-綠通道特征圖,

MBY[c,(c+s)]表示藍-黃通道特征圖,

設θ為Gabor濾波器的輸出方向,取值范圍為(0°,45°,90°,135°),o(σ,θ)為尺度空間為 σ 時,θ方向上的方向特征圖,則對應方向特征圖 Mor[c,c(c+s),θ],計算公式為:

經過非線性歸一化操作N(·)[5],對每個特征圖進行中央自激勵,對周圍鄰域進行抑制,得到 N(Mint(c,c+s))、N(MRG(c,c+s))、N(MBY(c,c+s))和 N(Mori(c,c+s,θ))。 通過層間相加操作和歸一化形成3個特征顯著圖:亮度顯著圖Cint,顏色顯著圖Ccol和方向顯著圖Cori[6]。然后對3種特征進行平均加權,得到總顯著圖為:

總顯著中的各目標通過競爭吸引注意焦點,焦點在各個待注意目標之間按照一定的原則轉移,這個過程被稱為注意焦點轉移。然后采用勝者全贏來選擇總顯著圖中的最大值,采用禁止返回來找到轉移目標。這個便是完整的Itti模型。

2 改進的Itti模型

在Itti模型中,計算亮度和顏色特征提取過程中,采用相差3層和4層的金字塔結構中的圖像相減,這樣依靠高層金字塔圖像中的顯著目標在下采樣的過程中,融入背景中,然后與低層金字塔圖像進行相減得到顯著目標。這樣存在有2個缺陷:第一,Itti模型只考慮了顯著目標與背景的絕對灰度差,而在實際檢測場景中,一些顯著目標和背景各自存在亮度和顏色特征的相似性,并且兩者的之間的存在一定的差異,人們很容易注意到這類顯著目標,但是在Itti模型中并沒有相應的考慮。第二,由于Itti模型提取的顯著目標由于采用了高斯金字塔圖像之間的差來提取顯著目標,然后縮放到到原圖中,這樣很容易造成了提取目標位置的偏移和提取區域的不準確。因此,我們在原有特征圖像中,增加計算圖像區域中灰度分布概率統計提取的特征圖像,最后對所有特征圖像進行加權融合。

2.1 顯著性計算

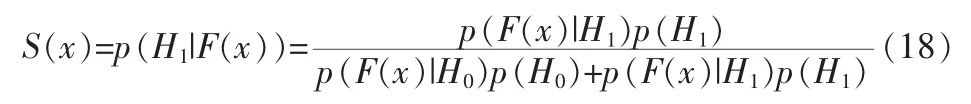

這里先定義一個矩形框W,它為內核框K和邊緣框B組成[7-8],如圖2所示。wW,hW分別為矩形框W的寬和高,同樣wK,hK分別為內核框K的寬和高。F(x)為圖像初始特征,這里我們選用亮度和顏色作為初始特征。定義H0表示當前點為不顯著點,H1表示當前點為顯著點,分別對應的概率為P(H0)和P(H1)。 我們假設內核框 K中為目標,邊緣框 B為背景,則 p(F(x)|H1)和 p(F(x)|H0)對應的框內的灰度概率分布。我們定義p(H1|F(x))為當前區域的顯著性度量,使用貝葉斯理論,

這里 p(F(x))=p(F(x)|H0)p0(H0)+p(F(x)|H1)p(H1),所以得到

圖2 顯著性計算示意圖Fig.2 Illustration of the definition of the saliency measure

圖3 計算圖像的顯著值示意圖Fig.3 Illustration of the computation of the saliency value for an image I

2.2 全圖顯著性提取

如圖3所示,使用2.1提到的顯著性計算方式,在亮度和顏色特征圖上,以步長SW進行掃描計算,得到相應的顯著值,對重疊像素區域采取S(x)={Sj(x)|x∈W(j)}。

3 實驗結果

如圖4所示,Itti模型提取的顯著區域包括郵箱中心白色區域和郵箱上面部分,和圖中兩個樹枝的位置,而樹枝位置由于提取采用了顯著圖像縮放到原圖中,造成提取的小目標區域偏移到旁邊草地位置。而特征圖分支中增加了灰度概率統計方法這個分支后,得到的圖像位置比之前更為準確,而且也會克服只選用灰度概率統計方法只提取自身灰度相似的顯著目標,而丟棄紋理復雜部分的缺陷。

圖4 對比結果Fig.4 The comparison of results

4 結 論

提出了基于灰度概率統計方法對Itti模型進行改進,它側重考慮了目標自身灰度的相似性,使得它克服了Itti模型只考慮了灰度值的絕對差異,而且提取顯著目標位置不會像Itti模型那樣發生大的偏移。實驗證明了它能更好提取圖像中的顯著目標及其輪廓。

[1]張巧榮.視覺注意計算模型及其關鍵技術研究[D].哈爾濱:哈爾濱工程大學,2011.

[2]謝春蘭.視覺注意模型及其在目標檢測中的應用研究[D].重慶:重慶大學,2009.

[3]Laurent I,Christof K,Ernst N.A model of saliency-based visual attention for rapid scene analysis[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,1998,20(11):1254-1259.

[4]張菁,沈蘭蓀,高靜靜.基于視覺注意機制的感興趣區檢測[J].光子學報,2009,38(6):1561-1565.ZHANG Jing,HEN Lan-sun,GAO Jing-jin.Regionsof interest detection based on visual attention mechanism[J].Acta Photonica Sinica,2009,38(6):1561-1565.

[5]Laurent I,Christof K.A saliency-based search mechanism for overt and covert shifts of visual attention[J].Vision Research,2000,40(10):1489-1506.

[6]靳薇,張建奇,張翔.基于視覺注意力模型的紅外目標檢測[J].紅外技術,2007,29(12)720-723.JIN Wei,ZHANG Jian-qi,ZHANG Xiang.Method for IR target detection based on visual attention model[J].Infared Technology,2007,29(12)720-723.

[7]Esa R,Janne H.A simple and efficient saliency detector for background subtraction [J].Computer Vision Workshops(ICCV Workshops),2009,12(9):1137-1144.

[8]Esa R,Juho K,Mikko S,et la.Segmenting salient objects from images and videos[J].European Conference on Computer Vision (ECCV),2010,31(1):366-379.