基于B2DPCA和極端學習機的人臉識別

趙永卿,安建成

(太原理工大學計算機科學與技術學院,山西 太原 030024)

一個完整的人臉自動識別系統必須能可靠地完成人臉檢測、特征提取和人臉識別。在此之前,一些研究人員使用了局部面部特征提取和分類來達到理想目標。自動人臉識別系統分為基于部件識別和基于面部識別[1]。可靠的面部特征提取是一個極其復雜的任務,因為人臉當大小和形狀發生微小的變化時將會引起提取的特征發生變化。因此,研究人員提出把人臉看作二維強度模式的基于面部識別系統,并且通過檢測和匹配其統計特性,將該系統實現,本文主要介紹基于面部識別。

Kirby[2]等人利用主成分分析法(Principal Component Analysis,PCA)把人臉描述成加權特征向量的線性組合,基于PCA的人臉識別系統有辨別能力差和計算量過大的缺點,J.Lu[3]等人為了改進人臉識別,提出利用線性判別分析法(Linear Discriminant Analysis,LDA)使類間散布矩陣和類內散布矩陣的比例達到最大值。J.M.Fellus[4]提出EP(Evolutionary Pursuit)法和彈性束圖匹配法(Elastic Bunch Graph Matching,EBGH)以期產生最優軸投影。為了改善針對高維圖像的人臉識別系統的性能,近些年研究的基于曲波變換的人臉識別方法有基于曲波變換的PCA法[5]、基于曲波變換的 LDA 法[6]和基于曲波變換的PCA+LDA法[7]。人臉識別算法有其自身局限性,比如對視點的變化、原型數量、分類速度有較大的敏感性。本文把曲波變換與雙向二維主成分分析(Bidirectional Two Dimensional Principal Component Analysis,B2DPCA)和極端學習機(Extreme Learning Machine,ELM)結合起來消除以往方法中固有的缺陷。

1 曲波變換[8]

小波變換在傳達準確的時間和空間信息上是一個顯著的多分辨率分析工具,但小波變換也存在很多問題,針對這些問題,Candes和Donoho在1999年提出了曲波變換理論[9],并構造了曲波的緊框架,對于具有光滑奇異性曲線的目標函數,曲波提供了穩定的、高效的和近乎最優的表示。曲波變換直接以邊緣為基本表示元素,曲波變換是各向異性的,具有很強的方向性,非常有利于圖像邊緣的高效表示。它符合生理學研究所指出的“最優”的圖像表示方法應具有的特征。

第一代曲波變換理論由脊波理論衍生而來。曲波變換和小波變換相同之處是都是多尺度變換,以刻度和空間位置參數為構成基礎。但曲波變換有方向參數,曲波金字塔包含一種方向特征的基本原理。此外曲波變換基于各向異性尺度法則。

第二代曲波與第一代曲波在構造上已經完全不同,第一代曲波的構造思想是通過足夠小的分塊將曲線近似地當作每個分塊中的直線來看待,然后利用局部的脊波分析其特性。而第二代曲波和脊波理論并沒有關系,實現過程也不需要用到脊波。本文中主要利用曲波變換分解圖像。

2 雙向二維主成分分析法(B2DPCA)

Karhunen-Loeve展開式,又被稱作主成分分析法(PCA),是一種被廣泛地應用在模式識別和壓縮的數據表示技術。Yang[10]等人提出了2DPCA圖像表示法,與PCA不同,2DPCA是基于二維矩陣而不是一維向量。因此,圖像的矩陣在進行特征提取前不需要矢量化,而是使用原始圖像矩陣直接計算圖像協方差矩陣。

設X表示一個q維單位化列向量,2DPCA的思想是將p×q圖像的矩陣A經線性變換Y=AX直接投影到X上,得到一個A的投影特征向量Y。可以用投影樣本的總體散布情況來衡量投影向量X對樣本的識別能力。投影樣本的總體散布可用投影特征向量的協方差矩陣的跡進行描述。這樣,可采用以下判定準則

式中:SX表示訓練樣本的投影特征向量的協方差矩陣,tr(SX)表示SX的跡。找出上式中判定準則的最大值的物理意義是找到一個使所有樣本都能被涉及到的投影方向X,以使這些投影樣本的總體散布被最大化。協方差矩陣SX可以表示為

所以

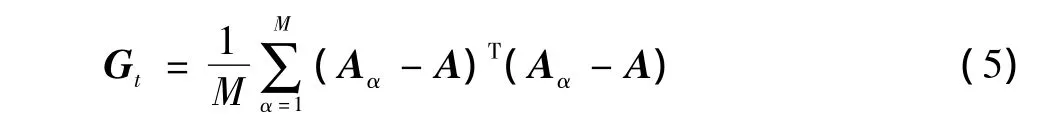

定義一個圖像的協方差矩陣Gt

從定義容易證明Gt是一個非負的q×q矩陣。可使用訓練圖像樣本直接計算Gt。假定共有M個訓練圖像樣本,第α個訓練圖像樣本用一個p×q矩陣Aα表示(α=1,2,…,M),所有訓練圖像樣本的平均圖像用A表示。則Gt可由下式計算得到

則有

使判定準則J(X)取最大值的線性向量Xopt稱作最佳投影軸,一般情況下,只有一個最佳投影軸是不夠的,通常需要選擇滿足正交條件和使判定準則J(X)取最大值的一簇投影軸 X1,X2,…,XM,實際上,最佳投影軸是 Gt對應于前M個最大本征值的正交本征向量。

基于2DPCA識別的局限性使它的可操作性只能沿著行方向,Zhang和Zhou[11]在基于假設訓練圖像零均值的基礎上提出(2D)2PCA方法。因此,可以用行/列圖像矢量的外積計算圖像的協方差矩陣。利用式(5)計算出GtRow和GtCol,首先按照Aα和A的行向量計算,接著對其列向量用相同方法。對GtRow和GtCol的最佳投影軸進行取值分別記作X1opt和Z1opt,值得一提的是Gt和GtRow都是基于行計算的,因此它們的最佳投影軸Xopt和X1opt是相似的,通過變換把Aα表示成。

為了保證行列關系和生成區別特征集,降維算法沿行列是獨立完成的,本文方法是利用最佳投影軸生成圖像協方差矩陣[11],并對其進一步優化。一旦最佳投影軸把Xoptα計算出來,圖像的矩陣Aα沿其列向量降維,利用式(7)得到圖像集Aβ,把新生成的圖像集看作一個新的數據庫,計算得出新的圖像協方差矩陣Gtβ和新的最佳投影軸Xoptβ。最后,通過式(8左乘Aβ得到輸出矩陣AΘ

Kong[12]等人將 2DPCA 進行改進,提出了 B2DPCA(Binary Two Dimensional Principal Component Analysis)算法來降維。本文在算法一中簡單介紹了此算法主要步驟。

算法一:B2DPCA算法

INPUT:輸入圖像的矩陣 AN×N,N∈Z+。

OUTPUT:輸出M×M矩陣AΘ,N∈Z+。

1)利用式(5)計算Aα圖像的協方差矩陣Gtα;

2)計算 J(X)=XTGtαX;

3)最佳投影軸 Xoptα={X1,X2,…,XM},Xi表示正交向量;

4)沿列降維得到 Aβ=AαXoptα;

5)計算Aβ的圖像協方差矩陣Gtβ;

6)同步驟(3)計算 Xoptβ;

7)通過式(8)進行行降維。

3 極端學習機

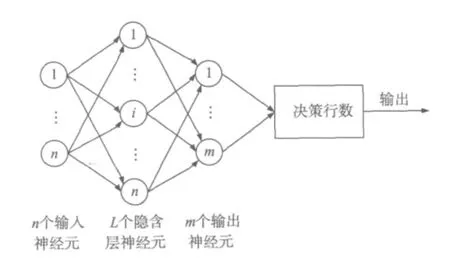

傳統前饋神經網絡多采用梯度下降算法調整權值,缺點是學習速度較慢、泛化性能差,為了解決這些缺陷,Huang[13]等人提出了極端學習機算法(Extreme Learning Machine,ELM),該算法對單隱層神經網絡的輸入權值和隱層節點偏移量進行隨機賦值,并且只通過一步計算即可解析求出網絡輸出權值,如圖1所示。

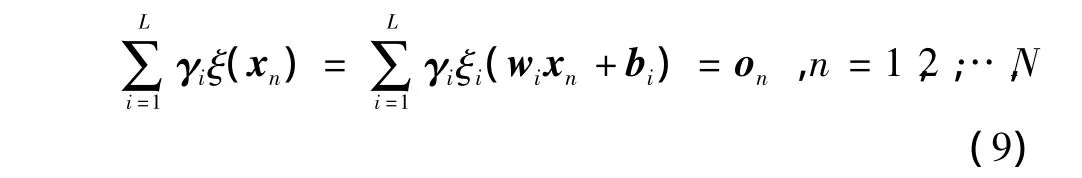

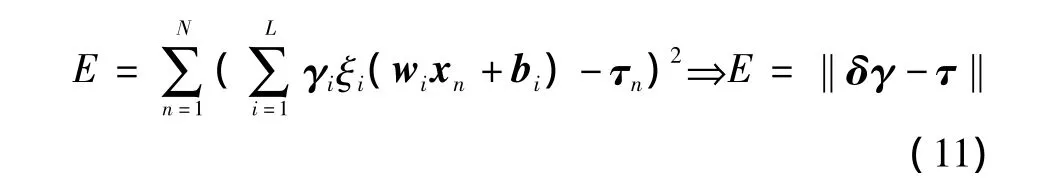

考慮到N 個不同樣本集(xi,ti),其中 xi=[xi1,xi2,…,xin]T∈Rn,ti=[ti1,ti2,…,tim]T∈Rm,可以把含有 L 個隱節點和一個激活函數ξ(x)的ELM建模為

圖1 極端學習機分類器結構

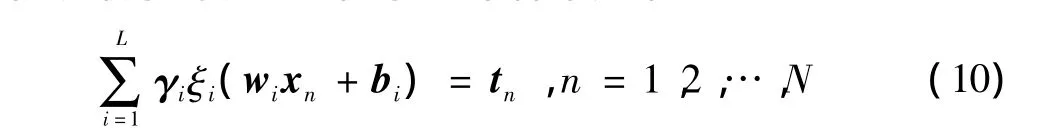

式中:wi=[wi1,wi2,…,win]表示輸入;γi=[γi1,γi2,…,γin]表示隱含層權值向量;bi是隱節點偏移量。極端學習機以最小的誤差近似于N個樣本如下

式(10)也可以表示成 δγ = τ ,δ =(w1,w2,…,wL,b1,b2,…,bL,x1,x2,…,xN),這樣 δ 的第 i列就表示輸入為x1,x2,…,xN的第i層隱節點的輸出。如果激活函數ξ(x)是無窮可微的,事實證明隱節點數L?N,極端學習機的訓練需要把誤差函數E最小化

經典神經網絡δ是利用梯度下降算法調整的,在學習效率為ρ情況下,把輸入權值wi,隱含層權值γi,隱節點偏移量bi進行迭代調整。ρ值過小將會使學習算法收斂速度過慢,而ρ值過大又會導致不穩定。為了解決這一問題,ELM采用了極小范數最小二乘法。網絡的輸入權值和偏移量可直接隨機賦值而不必采用梯度下降算法迭代調整,而δγ=τ的最小二乘法可以簡化這個問題。隱含層輸出矩陣δ是一個非方陣,范數最小二乘法可以歸納為γ=δ*τ,其中δ*表示δ的廣義逆矩陣。因為ELM表示一個線性系統的最小二乘法,所以可以得到一個無限小的訓練誤差,公式為

4 本文提出的人臉識別算法

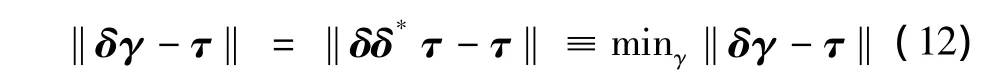

本文方法是基于曲波變換的圖像分解和使用降維后的系數來識別的,利用B2DPCA得的特征集來訓練和測試ELM分類器,算法示意圖如圖2所示。

圖2 本文人臉識別算法示意圖

數據庫中每個圖像大小減小一倍轉換成灰度圖像,每個圖像數據庫隨機分為訓練集和測試集,這樣每個目標圖像有40%~45%當作原型,剩下的圖像用在測試階段。曲波變換用來生成初始特征向量,因為它不僅在存有奇異點的高維矩陣中顯示優越的性能,而且能以最小的噪聲影響增強高頻成分的定位。首先把輸入圖像尺寸重置,因為當全局信息在同一層次的時候,類似圖像尺寸支持曲波特征向量的生成。此外,所有數據庫中圖像的曲波分解是在3個尺度8個角方向下計算的,因此,長生25個不同的子帶。

計算出每個子帶的標準差,選取標準差最大的子帶作為初始特征向量,尺寸為U×V,其中U×V?R×C,其中R×C是輸入圖像尺寸。與T.Mandal[14]等人選擇2個子帶相比,本文僅僅選擇了1個子帶,那是因為2個標準差不同子帶的區別是十分明顯的,所有被測試數據庫標準差都有顯著差別。該方法的基礎是選擇最大標準差的子帶,這在降維時可以最大限度地節約計算成本。

B2DPCA是用來生成獨特特征集的,并且使整體框架計算復雜度最簡化。2DPCA法以一個單一的協方差矩陣分別沿行和列對圖像降維,然而本文提出的方法是沿與坐標軸無關的正交方向降維。通過初始特征矩陣的初次降維提取中間特征,即沿其列選取曲波子帶。然后沿中間特征的行對其進行降維以得到最終特征集,每個特征集尺寸為U′×C′,其中U′×C′?U ×V。本文經過改進的方法能保存臨近像素點之間的關鍵鄰域信息,并且能生成區別性的特征。對于每一個數據集,隨機選擇其中降維后的曲波特征集用于ELM的訓練,而同一個數據集中剩余特征集用來判斷框架的可分離性。

5 實驗結果與分析

利用ORL和GTech人臉數據庫,用本文提出的方法進行了大量實驗。所有圖像的維數降低一倍,并從RGB轉換成灰度圖像。在所有數據庫中,每個目標圖像的40%~45%作為原型,而剩下的用作測試目的。利用曲波變換在3個尺度8個角方向下訓練和測試圖像,先利用B2PCA得到降維后的近似曲波系數,接著利用ELM進行矢量化、訓練和測試。針對每個數據庫,每個實驗做100次,保留平均結果。為了簡單起見,接下來的實驗把本文方法的結果和基于曲波的PCA+LAD方法[14]得到的結果相比較。

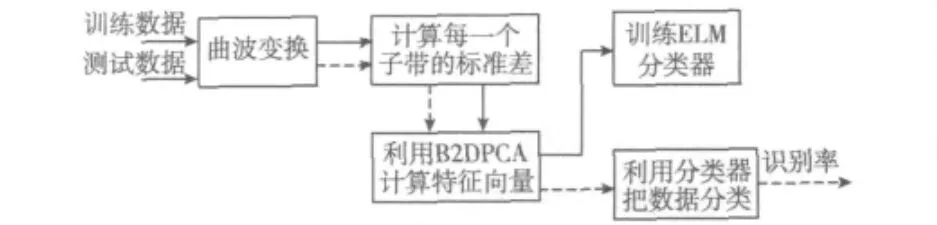

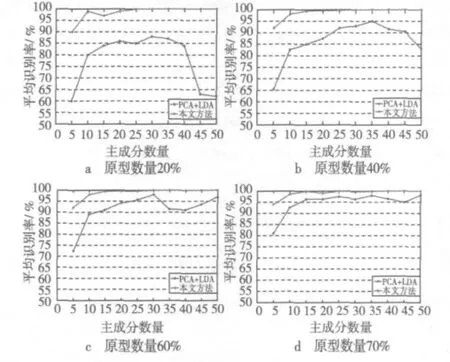

通過ORL數據庫和GTech數據庫,用不同數目主成分實驗得到的平均識別率和基于曲波的PCA+LAD法相比較得到的結果如表1所示。以下實驗數據可以看出,本文提出的方法識別準確率高于基于PCA+LAD的方法。本文的方法對于ORL數據庫和GTech數據庫識別率的提高是明顯的,并且適用于具有挑戰性的數據庫(視點在各個方向)。值得一提的是,增加主成分數量不是提高識別率的必要條件,利用人臉識別的局部信息也有可能產生更好的結果。本文提出的方法和其他人臉識別算法相比除了提高了識別率之外,另一個優點是原型的數量對于識別率影響非常小。ORL數據庫中原型數量分別占30%,40%,60%,70%時的識別率如圖3所示(y軸表示平均識別率,x軸表示主成分的數量)。

表1 ORL和GTech人臉數據庫平均識別率 %

圖3 原型數量占不同比例時的平均識別率

6 結論

本文基于曲波特征空間提出了一種高效的人臉識別技術,曲波變換是用來實現高維稀疏性的,利用B2DPCA對稀疏特征降維得到不同特征集。最后把這些特征集作為ELM的輸入來分析學習最優模型。實驗證明本文提出的方法不僅比現存的方法識別準確率有所提高,而且在用以訓練的原型數量上具有獨立性。在將來,希望能把局部特征和基于曲波分解的全局信息結合起來應用到識別精度和分類速度上。

[1]閆娟,程武山,孫鑫.人臉識別的技術研究與發展概況[J].電視技術,2006,30(12):67-69.

[2]KIRBY M,SIROVICH L.Application of the Karhunen– Loeve procedure for the characterization of human faces[J].IEEE Trans.Pattern A-nalysis and Machine Intelligence,1990,12(1):103-108.

[3]LU J,PLATANIOTIS K N,VENETSANOPOULOS A N.Face recognition using LDA-based algorithms[J].IEEE Trans.Neural Networks,2003,14(1):195-200.

[4]WISKOTT L,FELLUS J M,KRUGER N,et al.Face recognition by elastic bunch graph matching[J].IEEE Trans.Pattern Analysis and Machine Intelligence,1997,19(7):775-779.

[5]FENG G C,YUEN P C,DAI D Q.Human face recognition using PCA on wavelet subband[J].Journal of Electronic Imaging,2000,9(2):226-233.

[6]CHIEN J T,WU C C.Discriminant waveletfaces and nearest feature classifiers for face recognition[J].IEEE Trans.Pattern Analysis and Machine Intelligence,2004,24(2):1644-1649.

[7]MANDAL T,WU Q M,YUAN Y.Curvelet based face recognition via dimension reduction[J].Elsevier Signal Processing,2009,89(3):2345-2353.

[8]吳春穎.淺談曲波變換的應用[J].福建電腦,2011(10):79-80.

[9]CANDES E J,DEMANET L,DONOHO D L,et al.Fast discrete curvelet trans-forms[J].Multiscale Modeling and Simulation,2006,5(3):861-899.

[10]YANG L,ZHANG D,FRANGI A F,et al.Two-dimensional PCA:a new approach to appearance based face representation and recognition[J].IEEE Trans.Pattern Analysis and Machine Intelligence,2004,26(1):131-137.

[11]ZHANG D,ZHOU Z H.(2D)2PCA:two-directional two-dimensional PCA for efficient face representation and recognition[J].Elsevier Neurocomputing,2005,69(1):224-231.

[12]KONG H,WANG L,TEOH E K,et al.Generalized 2D principal component analysis for face image representation and recognition[J].Neural Networks,2005,18(5-6):589-594.

[13]HUANG G Q,ZHU Q,SIEW C.Extreme learning machine:theory and applications[J].Elsevier Neurocomputing,2006,70(1-3):489-501.

[14]MANDAL T,WU Q M,YUAN Y.Curvelet based face recognition via dimension reduction[J].Elsevier Signal Processing,2009,89(3):2345-2353.