采用WA-WBA與改進INSCT的圖像融合算法

趙春暉 馬麗娟 邵國鋒

?

采用WA-WBA與改進INSCT的圖像融合算法

趙春暉*馬麗娟 邵國鋒

(哈爾濱工程大學信息與通信工程學院 哈爾濱 150001)

在冗余提升變換與多方向分析相結合的圖像融合算法改進的非下采樣輪廓波變換(INSCT)中,冗余提升部分采用的Neville算子在多尺度分解的過程中丟失了很多方向信息,不利于后續的多方向分析。針對這一問題,該文提出了一組新算子,可以在頻帶分解部分很好地保持圖像的方向信息,并在此基礎上提出一種圖像融合算法。該算法先用直方圖均衡化的方法提高紅外圖像中目標區域的灰度值;然后用新算子代替Neville算子對可見光圖像與處理后的紅外圖像進行多尺度分解;最后采用基于權重窗口的活動級與加權求和相結合(WA-WBA)的方法替代簡單的加權求和方法對低頻子帶進行融合,采用一致性測度,實現了各子帶系數的自適應融合,有效地彌補了基于像素的圖像融合方法的不足。實驗結果表明,該算法使融合后的圖像更好地保持了可見光的細節信息,同時獲得了較清晰的紅外圖像中的目標信息。

圖像融合;冗余提升;一致性測度;權重窗口的活動級與加權求和相結合(WA-WBA)

1 引言

圖像融合技術是在不引入額外信息的前提下,將包含在多幅源圖像中的重要信息融合起來,得到一幅包含信息更豐富的圖像[1, 2]。可見光圖像包含了場景豐富的細節紋理信息,但往往捕獲不到隱藏在低光照條件下或者偽裝的對象。相反,紅外圖像能捕獲到有熱輻射的目標,但是無法體現場景的細節紋理信息。將可見光圖像與紅外圖像進行融合,得到一幅同時包含細節紋理信息和目標信息的綜合圖像,可有效降低虛警概率,提高在復雜背景中正確識別和跟蹤目標的概率。近年來,圖像融合領域的研究主要集中在多分辨率分析工具和融合規則兩部分。

多分辨率分析的核心任務是高效地描述圖像,即有效地捕獲圖像的奇異點信息。基于小波變換的多分辨率分析成功應用于圖像融合領域,然而,由于小波基函數所具有的各向同性和方向局限性,對高度奇異性的邊緣不能給出最優解[3]。基于以上問題,文獻[4]提出了脊波變換,該變換采用剖分的思想實現了對曲線奇異的檢測。隨后提出了二代脊波變換(Curvelet)[5], Curvelet采用的楔形基充分考慮了奇異點的幾何形狀,并具有任意角度的方向性。受Curvelet的啟發,文獻[6]提出了Contourlet Transform(CT), CT具有良好的時頻局部特性和各向異性特性,然而CT不具備平移不變性,在奇異點處容易產生吉布斯效應。非下采樣輪廓波變換(Non-Subsampled Contourlet Transform, NSCT)[7,8]繼承了CT的所有優點,且采用非下采樣的操作克服了吉布斯效應,然而NSCT中頻帶分解(NSPFB)的本質是金字塔分解,此方法不能高效地描述圖像的邊緣、紋理等細節特征。王衛星等人[9]用冗余不可分離提升小波變換(Redundant Lifting Non- Separable Wavelet Transform, RL-NSWT)對圖像進行多分辨率分析,相比NSPFB能更好地捕獲圖像的細節紋理特征,且同樣具有平移不變性。孔韋韋等人[10]將RL-NSWT與NSCT結合起來,提出了INSCT變換,但只是簡單地將冗余提升變換和多方向分析結合在一起使用,在分解部分采用中心像素與鄰域像素最大值作差的方法來產生細節信號,該方法丟失了圖像的方向信息,不利于后續的多方向分解。

融合規則選取的不當會嚴重影響融合效果。近幾年這方面的研究主要集中在高頻部分,低頻部分一般采用簡單的加權求和法,然而低頻部分和高頻部分是相互作用和相互影響的,簡單的加權求和會平滑掉圖像的一些細節信息,基于權重窗口的活動級測定和加權求和相結合的方法(WA-WBA)克服了傳統算法的不足。此外,目前大部分的圖像融合算法只關注融合圖像中包含了多少待融合圖像的重要信息,而不重視對比度增強的問題,如果待融合圖像的對比度不高,融合后的圖像也很難獲得較高的對比度[11]。

基于RL-NSWT, WA-WBA的優勢和圖像增強的必要性,本文提出了一種采用WA-WBA與改進INSCT的圖像融合方法,該方法在融合前用直方圖均衡化方法增強紅外圖像的對比度,采用RL-NSWT對圖像進行多尺度分解,用方向濾波器對圖像進行多方向分解,采用WA-WBA融合低頻部分,采用NHM融合高頻部分。在RL-NSWT多尺度分解部分,采用了一種預測和重構性能更好的預測算子和更新算子。通過主觀分析和結構相似度(SSIM),因子,相關系數這3個指標客觀地評價本文的融合方法,結果表明本文方法更好地保留了可見光圖像的細節信息和紅外圖像的目標信息,更適合人眼觀察。

2 RL-NSWT的實現

2.1 實現過程

提升小波變換進行信號分解時,分解過程每執行一次,數據長度變成原來的一半,當分解級數越來越大時,近似信息和紋理信息數據點數逐漸變少。冗余提升小波變換將提升小波變換中的第1步奇偶分解改成復制,使分解結果中逼近信號與細節信號的長度與原始信號相同,從而保證了該分解方法與NSCT中的NSPFB一樣,能保持圖像的平移不變特性。冗余提升變換由正變換和反變換兩部分構成,正變換通過水平提升和對角提升將圖像分解為3個頻帶的子圖像,反變換是完全相反的過程。具體實現過程見參考文獻[12]。

圖1 冗余提升正變換框架

2.2 新算子的提出

經典的Neville算子冗余提升水平/垂直預測如式(1),即用中心像素上下左右4個位置像素的最大值與中心像素的差值作為細節信號,對角提升如式(2),即用中心像素4個對角位置像素的最大值與中心像素的差值作為細節信號,具體內容見參考文獻[12]。

由于在圖像融合中采用RL-NSWT將圖像分解為3個頻帶之后,需要再對其進行方向濾波,因此要求在提升部分最大限度地獲取細節信息,與鄰域最大值作差,只能提取出中心像素與最大值連線方向的細節信息,而丟失了其它方向的信息,基于此,采用式(3)和式(4)來保存方向信息。式(3)計算出以中心像素為中心的水平位置與垂直位置上5個像素的均值,并與中心像素作差,將此差值作為細節信息。式(4)求出以中心像素為中心的對角線位置上5個像素的均值,并與中心像素作差,此差值作為細節信號。用均值作差的方法保留了圖像各個方向的細節信息。

基于式(3)推出新的預測算子矩陣和*,其表示為

3 非子采樣方向濾波器組(NSDFB)

表1 兩種重構方法的對比

4 基于WA-WBA和改進INSCT的圖像融合策略

4.1融合方案

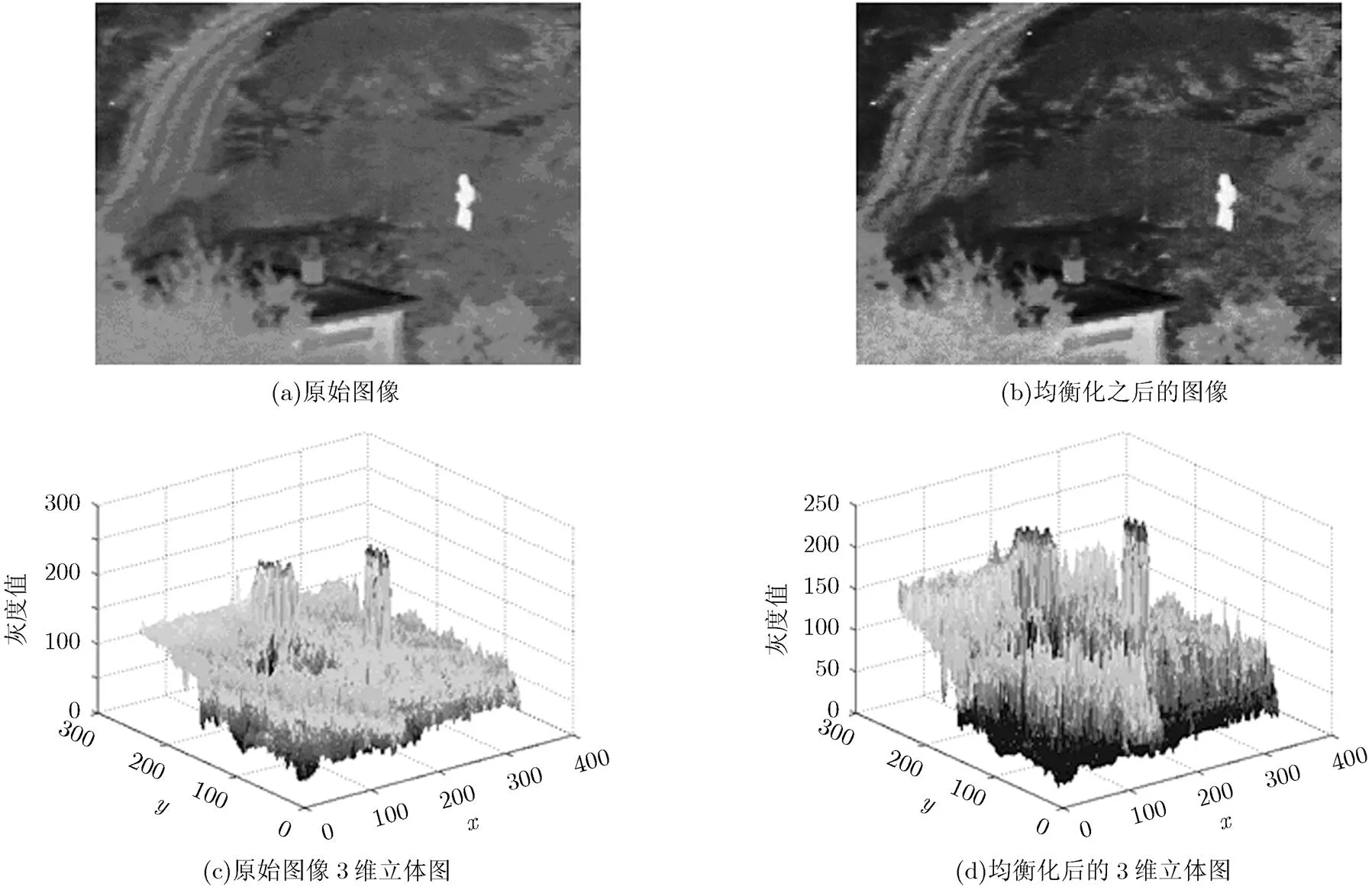

(1)利用待融合可見光圖像的灰度直方圖來均衡化紅外圖像。計算可見光圖像分別在各個灰度值所占的像素個數,將紅外圖像的灰度值按這個比例調整,如圖4(a)所示,紅外圖像的灰度值大部分都集中在[50, 100],在這個灰度值區間很難將目標和背景分開,通過直方圖均衡化,將紅外圖像的灰度區間變成在全部灰度范圍內的均勻分布,通過這種非線性拉伸來增強紅外圖像的對比度,增強后的圖像如圖4(b)所示。從圖中可以看到,均衡化方法提高了目標區域(亮度較高區域)的灰度,降低了背景區域的灰度,即降低了紅外圖像中背景區域的無用信息在融合時對有用信息的干擾,使得融合后的圖像更適合人眼的觀察,仿真結果如圖4。

圖2兩種方法完全重構性能仿真結果

4.2低頻融合規則

圖4直方圖均衡化

圖6 高斯內核

4.3 高頻融合規則

對中頻方向子帶和高頻方向子帶用基于鄰域一致性測度(Neighborhood Homogeneous Measur- ement, NHM)的局部自適應方法融合,具體實現過程見參考文獻[13]。

將所有方向子帶都按照上述方法進行融合后,經過NSDFB反變換得到融合后的3個頻率通帶,將其進行冗余提升反變換,得到融合后的圖像。

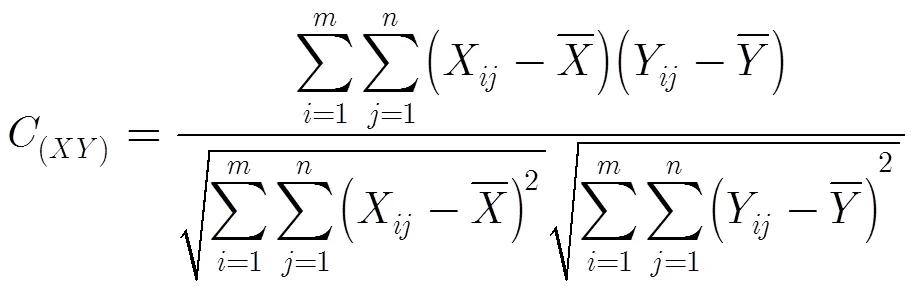

5 評價指標

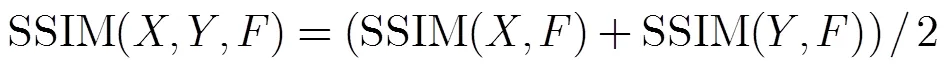

因子和SSIM是基于結構信息傳遞量的評價方法,客觀反應了融合圖像與原始圖像的結構相似度。平均相關系數反映了融合圖像與原始圖像的相關程度。它們的定義如下:

6 實驗結果與性能分析

為了驗證本文算法的有效性,在此給出兩組不同類型數據源的融合實驗結果。數據1來自“Octec”有限公司的David Dwyer公布的紅外與可見光序列圖,數據2來自“英國布里斯托大學”博士Stavri Nikolov拍攝的“Bristol Quees Road”紅外與可見光圖像序列圖。本文算法與NSCT變換,參考文獻[9]的算法,參考文獻[10]的INSCT進行比較,并分析了實驗結果。其中NHM的參數TH取0.7。為了更加客觀地評價本文的多分辨率分析方法和低頻融合規則的優越性,對比算法的高頻融合規則與本文高頻部分的融合規則相同,都為NHM。

第1組仿真實驗,圖7(a)可見光圖像中大部分的房屋被濃濃的白煙遮蓋,圖7(b)紅外圖像中可以看到在濃煙的后面有幾個人正在逃生,這組數據融合后需要重點提取房屋和被遮擋的人。圖7(c)中基于梯度的融合規則使得融合后的圖像中包含可見光信息較多,紅外圖像的亮度信息無法清晰地提取。圖7(d)和圖7(e)逃生的人也沒有清晰地提取出來。圖7(f)中能相對清晰地看到在煙霧中逃生的兩個人,同時也可以看出房屋的概貌和遠處樹木的概貌。仿真數據見表2,本文算法相比參考文獻[9],NSCT變換和INSCT算法在,和SSIM方面均有明顯提升。

表2數據1仿真結果

[9]NSCT變換INSCT變換本文算法 C0.56610.56150.73280.7611 Q0.71260.73440.75800.7748 SSIM0.88010.89950.51500.9034

第2組仿真實驗,圖8(a)可見光數據中,左上方牌子上的字跡清晰可辨,但無法看清路上行人;圖8(b)的紅外圖像中,路上的行人與車輛都能夠辨識,但文字不夠清晰;圖8(c)和圖8 (d)中文字基本可以辨識,但右下角的人輪廓模糊;圖8(e)中的文字不容易辨識;圖8(f)所示的本文算法結果圖中文字和行人都清晰可見,人像也清晰可見。仿真數據見表3,本文算法相對3種對比算法,有最大的,和SSIM值。

表3數據2仿真結果

參考文獻[9]NSCT變換INSCT變換本文算法 C0.67240.62550.65460.7113 Q0.75040.72950.74840.7906 SSIM0.69260.70190.73190.7652

圖7第1組數據的4種方法的仿真結果比較

圖8第2組數據的4種方法的仿真結果比較

7 結論

本文提出的融合算法在多尺度分解部分采用了一組新的算子,該算子能更好地重構圖像,使重構后的圖像與原始圖像的RMSE更小。在融合前將待融合的紅外圖像進行直方圖均衡化,突出紅外圖像中的目標信息,使得在融合的時候紅外圖像中的背景區域更多地選擇可見光信息,而在目標區域更多地選擇紅外圖像信息,此方法在一定程度上提升了融合質量,有助于人眼觀察。采用基于權重窗口的活動級測定與加權求和相結合的方法作為低頻融合規則,此融合方法比簡單的加權求和法及平均法能夠使融合后的圖像更恰當地選擇源圖像中的亮度信息。相比目前應用較廣泛的幾種算法及其改進算法,本文提出的算法很好地將待融合圖像中的細節信息和亮度信息進行融合,使融合后的圖像分辨率高,目標輪廓清晰,更適用于人眼的觀察。

[1] Parmar K and Kher R. A comparative analysis of multimodality medical image fusion methods[C]. Proceedings of the IEEE Modelling Symposium (AMS), Austin, 2012: 93-97.

[2] Jang J H, Bae Y, and Ra J B. Contrast-enhanced fusion of multisensor images using subband-decomposed multiscale retinex[J]., 2012, 21(8): 3479-3490.

[3] 楊曉慧, 賈建, 李成. 基于活性測度和閉環反饋的非下采樣Contourlet域圖像融合[J]. 電子與信息學報, 2010, 32(2): 422-426.

Yang Xiao-hui, Jia Jian, and Li Cheng. Image fusion algorithm in nonsubsampled contourlet domain based on activity measure and closed loop feedback[J].&2010, 32(2): 422-426.

[4] KangZhi-wei and Yang Lei. A new transform for image processing[J]., 2010, 21(2): 627-639.

[5] Mahyari A G and Yazdi M. A novel image fusion method using Curvelet transform based on linear dependency test[C]. Proceedings of the IEEE Digital Image Processing, Beijing, 2009: 351-354.

[6] Liu Kun, Guo Lei, and Chen Jing-song. Contourlet transform for image fusion using cycle spinning[J]., 2011, 22(2): 353-357.

[7] Adu Jian-hua, Wang Ming-hui, and Wu Zhen-ya. Multi-focus image fusion based on the non-subsampled contourlet transform[J].2012, 59(15): 1355-1362.

[8] Da Cunha A L, Zhou J, and Do M N. The nonsubsampled contourlet transform: theory, design, and applications[J]., 2006, 15(10): 3089-3101.

[9] 王衛星, 曾基兵. 冗余提升不可分離小波的圖像融合方法[J]. 電子科技大學學報, 2009, 38(1): 13-16.

Wang Wei-xing and Zeng Ji-bin. Image fusion method based on redundant lifting no-separable wavelet transform[J]., 2009, 38(1): 13-16.

[10] 孔韋韋, 雷英杰, 雷陽. 基于改進型NSCT變換的灰度可見光與紅外圖像的融合方法[J]. 控制與決策, 2010, 25(11): 1608-1612.

Kong Wei-wei, Lei Ying-jie, and Lei Yang. Fusion method for gray-scale visible light and infrared images based on improved NSCT[J]., 2010, 25(11): 1608-1612.

[11] Kim D, Choi S, and Sohn K. Visual comfort enhancement for stereoscopic video based on binocular fusion characteristics[J]., 2013, 23(3): 482-487.

[12] 康志偉, 廖劍利, 何怡剛. 基于提升算法的不可分離小波圖像邊緣檢測[J]. 華中科技大學學報, 2006, 34(4): 57-62.

Kang Zhi-wei, Liao Jian-li, and He Yi-gang. Detection of the image edges of non-separated wavelets based on lifting scheme[J]., 2006, 34(4): 57-62.

[13] Zhang Qiang and Guo Bao-long. Multifocus image fusion using the nonsubsampled contourlet transform[J]., 2009, 89(7): 1334-1346.

[14] Hossny M, Nahavandi S, and Reighton D. An evaluation mechanism for saliency functions used in localized image fusion quality metrics[C]. Proceedings of the IEEE Computer Modelling and Simulation, Britain, 2012: 407-415.

[15] Xydeas C S and Petrovic V. Objective image fusion performance measure[J]., 2000, 36(4): 308-309.

[16] Wang Zhou and Booik A C. Image quality assessment: from error visibility to structural similarity[J]., 2004, 13(4): 600-612.

趙春暉: 男,1965年生,教授,博士生導師,研究方向為數字信號和圖像處理、通信信號處理.

馬麗娟: 女,1988年生,碩士生,研究方向為圖像融合.

邵國鋒: 男,1985年生,碩士生,研究方向為圖像融合.

An Image Fusion Algorithm Based on WA-WBA and Improved Non-subsampled Contourlet Transform

Zhao Chun-hui Ma Li-juan Shao Guo-feng

(,,150001,)

The Improved Non-Subsampled Contourlet Transform (INSCT) algorithm combines redundancy ascending transform and multi direction analysis. Neville-operator is used in the part of redundancy ascending and direction information is lost in the process of multi-scale decomposition, which is bad for follow-up analysis. To solve this problem, a new set of operators which effectively preserves direction information in frequency band decomposition part is designed in this paper, and a new image fusion algorithm using the operators is proposed. First, the histogram equalization method is used to enhance grey values of the target zone in infrared image. Second, the multi-scale decomposition is performed on visible image and the enhanced infrared image using the new set of operator rather than the Neville-operator. Finally, low-frequency sub-band is fused using a new method incorporating the activity level based on Weighted Average-Window Based Activity measurement (WA-WBA) rather than the simple weighted sum method. The use of neighborhood homogeneous measurement realizes the adaptive fusion of each sub-band coefficient, and the proposed method effectively makes up the disadvantages of pixel-based image fusion method. The experimental results show that the proposed method preserves details of the visible image and obtains clear target information in the infrared image.

Image fusion; Redundant lifting; Homogeneity measure; Weighted Average-Window Based Activity measurement (WA-WBA)

TP391

A

1009-5896(2014)02-0304-08

10.3724/SP.J.1146.2013.00542

趙春暉 zhaochunhui@hrbeu.edu.cn

2013-04-22收到,2013-09-17改回

國家自然科學基金(61077079),教育部博士點基金(20102304 110013),黑龍江省自然科學基金重點項目(ZD201216)和哈爾濱市優秀學科帶頭人基金(RC2013XK009003)資助課題