基于隨機(jī)森林的長(zhǎng)期目標(biāo)跟蹤方法

張 丹,陳興文,趙姝穎,程立英,3

(1.大連民族學(xué)院創(chuàng)新教育中心,遼寧大連116605;2.東北大學(xué)信息科學(xué)與工程學(xué)院,遼寧沈陽(yáng)110819;3.沈陽(yáng)師范大學(xué)物理科學(xué)與技術(shù)學(xué)院,遼寧沈陽(yáng)110034)

目標(biāo)跟蹤的研究與應(yīng)用是計(jì)算機(jī)視覺的一個(gè)重要分支,也是其研究領(lǐng)域中的難點(diǎn)和熱點(diǎn),廣泛應(yīng)用于科學(xué)研究、航空航天、醫(yī)學(xué)、國(guó)防軍事、人機(jī)交互、機(jī)器人及國(guó)民經(jīng)濟(jì)的各個(gè)領(lǐng)域。目標(biāo)跟蹤的關(guān)鍵技術(shù)在于合理提取特征和準(zhǔn)確的識(shí)別目標(biāo),實(shí)時(shí)、準(zhǔn)確的長(zhǎng)期目標(biāo)跟蹤對(duì)于人機(jī)交互技術(shù)、人工智能等技術(shù)的發(fā)展具有重要的理論意義和應(yīng)用價(jià)值。

長(zhǎng)期目標(biāo)跟蹤過程中,易出現(xiàn)目標(biāo)的遮擋、丟失、運(yùn)動(dòng)速度過快等問題。光照干擾、復(fù)雜多變背景使得跟蹤過程中計(jì)算量大、處理滯后,影響跟蹤效果。這些問題給快速、精確的長(zhǎng)期目標(biāo)跟蹤造成很大的難度。

國(guó)內(nèi)外學(xué)者已經(jīng)對(duì)長(zhǎng)期跟蹤作了大量研究,Jorge[1]等人提出區(qū)域跟蹤算法,利用分割結(jié)果,將連續(xù)幀的目標(biāo)匹配起來進(jìn)行跟蹤;Moravec[2]提出利用圖像灰度自相關(guān)函數(shù)的特征點(diǎn)檢驗(yàn)算子;Kass[3]等人提出 Snake 模型,Menet[4]提出 B-Snake模型,解決了快速跟蹤的問題;Deilamani M.J[5]等人提出了將色彩與邊緣特征相結(jié)合的Mean-Shift算法,可以很好的克服部分遮擋和光照的變化;Dr.Zdenek Kalal[6]在 2007 年到 2010 年間提出來并不斷完善的TLD算法,適合長(zhǎng)時(shí)間跟蹤;chen等人[7]提出基于四元數(shù)的光流估計(jì)跟蹤方法,提高了算法的魯棒性;陳添丁等人[8]提出的稀疏光流快四計(jì)算動(dòng)態(tài)目標(biāo)檢測(cè)與跟蹤算法,一定程度上提高了跟蹤的實(shí)時(shí)性;Wang等人[9]提出在線學(xué)習(xí)跟蹤的方法,提高了目標(biāo)跟蹤的精度,王愛平[10]等人提出增量式隨機(jī)森林分類器,提高了短視屏流跟蹤的準(zhǔn)確性;袁紅衛(wèi)等人[11]提出一種基于光流的運(yùn)動(dòng)小目標(biāo)檢測(cè)算法;佟國(guó)峰等人[12]提出一種基于隨機(jī)蕨叢的長(zhǎng)期目標(biāo)跟蹤方法,提高了跟蹤的適應(yīng)性;李勁菊[13],郝志成[14]等人提出了一種復(fù)雜背景下運(yùn)動(dòng)目標(biāo)檢測(cè)與跟蹤的方法,提高了復(fù)雜背景下目標(biāo)跟蹤的準(zhǔn)確性。這些方法一定程度上解決了目標(biāo)遮擋、快速運(yùn)動(dòng)的跟蹤問題,但是目標(biāo)一旦丟失,無法快速恢復(fù)跟蹤,在復(fù)雜背景快速變化的過程中也難以實(shí)現(xiàn)實(shí)時(shí)、準(zhǔn)確的跟蹤。

本文針對(duì)長(zhǎng)期跟蹤情況下目標(biāo)由于遮擋、快速運(yùn)動(dòng)易丟失、跟蹤實(shí)時(shí)性、準(zhǔn)確性差等問題,結(jié)合正負(fù)樣本相互作用的思想和隨機(jī)森林算法,提出了一種基于TLD的隨機(jī)森林目標(biāo)跟蹤方法。該方法在TLD算法的基礎(chǔ)上,采用隨機(jī)森林方法,構(gòu)建在線學(xué)習(xí)模型,融合大運(yùn)動(dòng)捕捉跟蹤器,分別從跟蹤實(shí)時(shí)性、準(zhǔn)確性上進(jìn)行改進(jìn)。

1 隨機(jī)森林算法及分析

1.1 隨機(jī)森林算法

單棵決策樹可以按照結(jié)點(diǎn)屬性值進(jìn)行分類,為了明顯提高精度,很容易想到種植一片樹林,并讓所有樹參加投票,選出最好的分類,這就是隨機(jī)森林[13]的思想。對(duì)第k棵樹引入隨機(jī)變量θk,它與前面的k-1 個(gè)隨機(jī)變量 θ1,θ2,…θk-1是獨(dú)立同分布的。通過訓(xùn)練集θk來生成第k棵樹,相當(dāng)于產(chǎn)生一個(gè)分類器h(X,θk),其中X是一個(gè)輸入量。隨機(jī)森林有較好的數(shù)學(xué)理論基礎(chǔ),不會(huì)出現(xiàn)過度擬合,符合大數(shù)定律。構(gòu)建隨機(jī)森林有多種形式和方法,可以根據(jù)實(shí)際需要,采用不同的方式構(gòu)建隨機(jī)森林。本文中采用更新權(quán)重構(gòu)建方法中的Adaboost方法進(jìn)行構(gòu)建。Adaboost方法是由Freund和 Schapire于1996年正式提出的,它是在前面分類器錯(cuò)誤分類的基礎(chǔ)之上,為下一個(gè)分類器的輸入,更新訓(xùn)練集上的權(quán)重,每個(gè)分類器都可以利用一個(gè)訓(xùn)練集和一個(gè)權(quán)重訓(xùn)練集來改進(jìn)。

設(shè)w(1),…w(k)(∑wi(k)=1,wi(k)≥0)為關(guān)于訓(xùn)練集的k個(gè)不同的權(quán)重向量,對(duì)訓(xùn)練集進(jìn)行k種不同方式加權(quán),這樣,得到的加權(quán)數(shù)據(jù)構(gòu)成一個(gè)大集合。取權(quán)重概率p(1),p(2),…p(k)且(i)=1 時(shí),依據(jù)概率p(1),p(2),…p(k)從1,2,…k抽取整數(shù),記為θ。利用訓(xùn)練集與權(quán)重w(k)產(chǎn)生分類器h(x,θ)。

在 Adaboost算法中,w(k+1)= φ(w(k)),φ是由起初分類器定義的函數(shù)。設(shè)第k個(gè)分類器為h(x,wk),其投票權(quán)重為Q(wk),所以對(duì)于將輸入x分類為j的規(guī)范化投票等于:

Adaboost算法主要針對(duì)一個(gè)訓(xùn)練集訓(xùn)練不同的分類器,然后把這些弱分類器集合起來,構(gòu)成一個(gè)最終分類器(強(qiáng)分類器)。

1.2 算法分析

隨機(jī)森林有很多優(yōu)點(diǎn):精度高,穩(wěn)定性好,可以有效的處理大數(shù)據(jù)集,在分類的過程中給出變量重要性的估計(jì)等,與其他集成方法相比,對(duì)于數(shù)據(jù)噪聲更穩(wěn)定[15]。隨機(jī)森林方法雖然支持在線學(xué)習(xí),但是在學(xué)習(xí)過程中也較為容易出現(xiàn)誤判,如果數(shù)據(jù)集較大,算法運(yùn)行時(shí)間長(zhǎng),那么積累的誤差就更大,分類錯(cuò)誤率將會(huì)上升[15]。而TLD方法加入正負(fù)樣本互限思想,進(jìn)行誤差一致矯正,提高樣本判別的準(zhǔn)確性。因此,本文提出一種基于TLD的隨機(jī)森林方法。

2 基于TLD的目標(biāo)跟蹤方法

2.1 在線學(xué)習(xí)模型

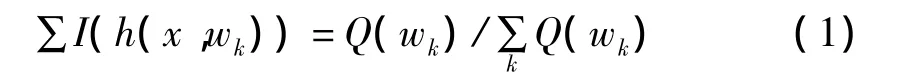

本文在線學(xué)習(xí)的過程主要使用正樣本增長(zhǎng)、負(fù)樣本減少的方法。正樣本增長(zhǎng)與負(fù)樣本減少同時(shí)進(jìn)行,主要基于一個(gè)相似的閾值θ,當(dāng)兩個(gè)目標(biāo)窗口樣本的距離小于θ時(shí)就認(rèn)為其與目標(biāo)軌跡相似,反之亦然,這樣不斷的更新在線學(xué)習(xí)模型中的特征,使得特征更加精確。正樣本增長(zhǎng)過程為從跟蹤軌跡中選擇相似的樣本并進(jìn)行模型的更新。在負(fù)樣本減少過程中,假設(shè)被跟蹤的目標(biāo)在場(chǎng)景中是唯一的,如果跟蹤器和檢測(cè)器都認(rèn)為其中探測(cè)點(diǎn)是正確的,那么其余的探測(cè)點(diǎn)就被認(rèn)為是負(fù)樣本,并且從模型中移走。

在線學(xué)習(xí)模型主要依靠正負(fù)樣本學(xué)習(xí)框架進(jìn)行特征的更新。與目標(biāo)軌跡接近的特征窗口使用正樣本更新探測(cè)器,正樣本增長(zhǎng)。使用檢測(cè)器檢測(cè)目標(biāo),非最大置信度的探測(cè)點(diǎn)使用負(fù)樣本更新,即負(fù)樣本減少。它們相互作用產(chǎn)生誤差,并不斷的消除誤差,使得學(xué)習(xí)更穩(wěn)固,特征更精確。相互作用關(guān)系如圖1。

圖1 正負(fù)樣本相互作用關(guān)系示意圖

2.2 基于在線學(xué)習(xí)的隨機(jī)森林目標(biāo)檢測(cè)器

將隨機(jī)森林的思想與在線學(xué)習(xí)模型結(jié)合起來,以實(shí)現(xiàn)目標(biāo)的在線學(xué)習(xí)檢測(cè)模型,具體步驟如下:

(1)初始化分類器。提取正樣本訓(xùn)練隨機(jī)森林分類器,包含目標(biāo)物體的矩形區(qū)域?yàn)檎龢颖緟^(qū)域,其他部分被視為負(fù)樣本區(qū)域,將大小規(guī)則的圖像塊作為樣本進(jìn)行處理,相對(duì)于單個(gè)像素而言,圖像塊包含更豐富的信息。在此階段,為了給分類器提供足夠的訓(xùn)練樣本,在正樣本區(qū)域和負(fù)樣本區(qū)域內(nèi)隨機(jī)產(chǎn)生大量子窗口,這些窗口可相互重疊,且位置隨機(jī),每個(gè)子窗口從9×9像素大小到整幅圖像大小隨機(jī)產(chǎn)生,子窗口對(duì)應(yīng)的圖像塊即可作為樣本進(jìn)行處理,這樣即可完成分類器的初始化。

(2)在線學(xué)習(xí)模型。將分類器與在線學(xué)習(xí)模型相結(jié)合,構(gòu)成增量式的隨機(jī)森林分類器。采用2bitBP特征形成特征空間,利用滑動(dòng)窗口方法,在線學(xué)習(xí)模型分別對(duì)同一視頻圖像進(jìn)行分類識(shí)別,正樣本增長(zhǎng)模型將自身置信度高的樣本給特征空間進(jìn)行增量學(xué)習(xí)分類,同時(shí)負(fù)樣本減少模型根據(jù)自身樣本的置信度判斷特征空間中的不正確樣本,將其從特征空間中去掉。這樣他們相互作用使得特征空間在不斷擴(kuò)大的同時(shí),使得其特征更加精確,也使得分類更加精確。

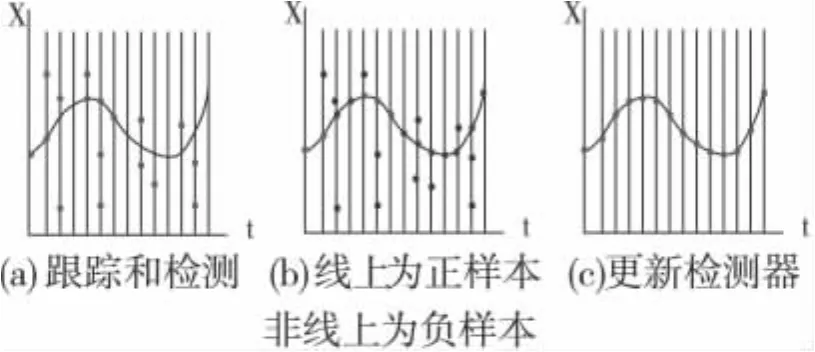

得到的分類器與在線學(xué)習(xí)模型相結(jié)合,不斷訓(xùn)練樣本,如圖2,具體步驟為:

(1)使用分類器標(biāo)記未標(biāo)記的樣本;

(2)識(shí)別并重新標(biāo)記違背結(jié)構(gòu)限制的樣本;

(3)不斷的擴(kuò)大訓(xùn)練集;

(4)重新訓(xùn)練分類器。

圖2 在線學(xué)習(xí)與分類器訓(xùn)練數(shù)據(jù)示意圖

其中Xu為未標(biāo)記的用于訓(xùn)練的數(shù)據(jù),(X1,Y1)為已經(jīng)標(biāo)記的訓(xùn)練集數(shù)據(jù),(Xt,Yt)為訓(xùn)練集輸出的數(shù)據(jù),需要再進(jìn)行訓(xùn)練的數(shù)據(jù),結(jié)構(gòu)限制主要是正樣本增長(zhǎng)和負(fù)樣本減少,(Xc,Yc)是通過在線學(xué)習(xí)輸出的數(shù)據(jù),θ為在線學(xué)習(xí)所對(duì)應(yīng)的分類器的估計(jì)數(shù)據(jù)。

2.3 基于捕獲最大運(yùn)動(dòng)的目標(biāo)跟蹤器

基于在線學(xué)習(xí)的隨機(jī)森林方法可進(jìn)行目標(biāo)檢測(cè),但是無法實(shí)現(xiàn)較大運(yùn)動(dòng)的目標(biāo)跟蹤。本文集合金字塔技術(shù),采用LK光流法,根據(jù)所取特征,使用均值方式預(yù)測(cè)目標(biāo)的運(yùn)動(dòng)和位移方向,與目標(biāo)檢測(cè)器相結(jié)合,實(shí)現(xiàn)長(zhǎng)期的目標(biāo)跟蹤。

LK光流法[16]最初于1981年提出,由于算法易于應(yīng)用在輸入圖像中的一組點(diǎn)上,后來成為求稀疏光流的一種重要方法,該方法基于亮度恒定、時(shí)間連續(xù)或者運(yùn)動(dòng)是“小運(yùn)動(dòng)”、空間一致三個(gè)假設(shè),光流約束方程如(4)式所示。

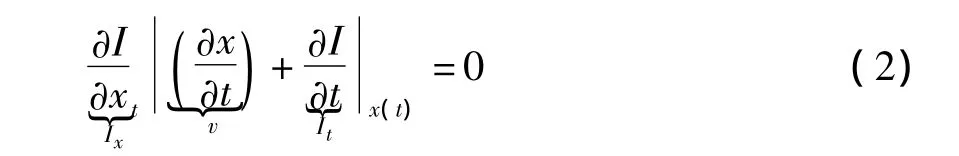

將亮度的定義I(x(t),t)表示,應(yīng)用偏微分鏈?zhǔn)揭?guī)則:

其中,Ix是圖像的偏導(dǎo)數(shù),It是隨時(shí)間的導(dǎo)數(shù),v是要求的速度。

前面是LK光流法在一維空間上的用法,將其擴(kuò)展到二維圖像上,速度的y分量為v,x分量為u,得到:

孔徑問題即用小孔或小窗口去測(cè)量運(yùn)動(dòng),只能觀測(cè)到物體邊緣而觀測(cè)不到角點(diǎn),只依靠邊緣是不足以判斷整個(gè)運(yùn)動(dòng)物體的運(yùn)動(dòng)朝向的。而角點(diǎn)是可用于跟蹤的良好特征點(diǎn),其檢測(cè)幾乎不受攝像機(jī)姿態(tài)和光照條件的影響,具有旋轉(zhuǎn)不變性,在圖像配準(zhǔn)與匹配、運(yùn)動(dòng)估計(jì)等計(jì)算機(jī)視覺領(lǐng)域有著非常重要的作用。

但是,對(duì)于大多數(shù)30HZ的攝像機(jī),大而不連貫的運(yùn)動(dòng)是普遍存在的。也正因?yàn)檫@個(gè)原因LK光流法在實(shí)際中的跟蹤效果并不是很好,本文結(jié)合金字塔技術(shù),計(jì)算所取特征均值進(jìn)行改進(jìn),解決此問題。

該方法的思想如下:原圖像作為金字塔基層I=0,將原圖減采樣至原尺寸的(一般N=1),獲得I=1層圖像,則該層相鄰幀間的目標(biāo)像素運(yùn)動(dòng)距離為(D為原圖中相鄰幀間的目標(biāo)像素運(yùn)動(dòng)距離)。當(dāng)I達(dá)到一定值時(shí)(一般3≤I≤5),可滿足光流約束條件。在最高層Vf=0,圖像細(xì)節(jié)最少,ΔVf是f層的光流計(jì)算結(jié)果,作為下一層圖像的運(yùn)動(dòng)估計(jì)。

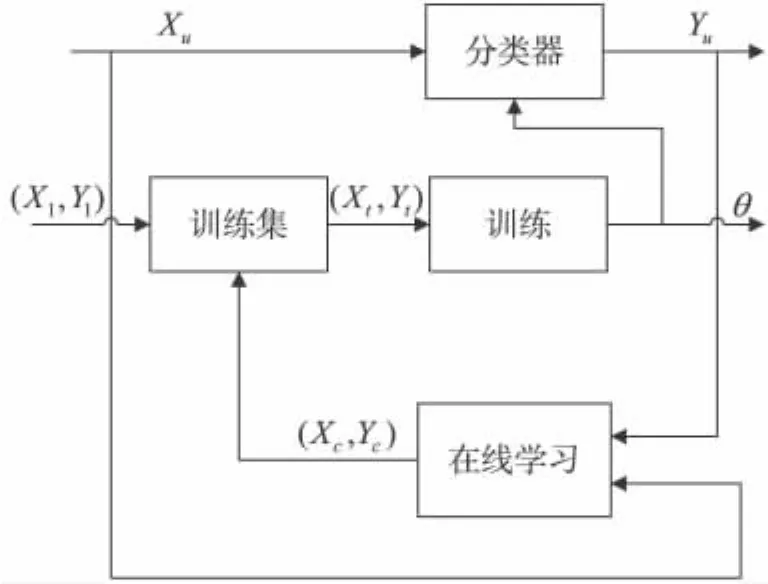

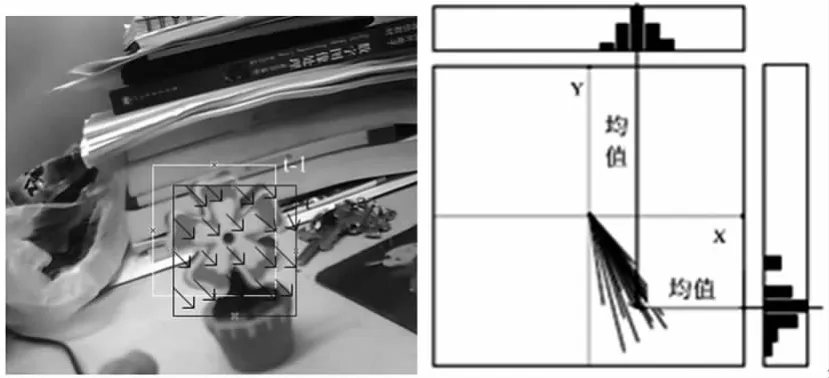

LK算法在幀與幀之間跟蹤這些點(diǎn),產(chǎn)生矢量光流場(chǎng),根據(jù)所取的特征,使用均值的方式預(yù)測(cè)下一幀中目標(biāo)的運(yùn)動(dòng)和位移方向。在每一幀中都有一系列的新的特征點(diǎn)被跟蹤,因此使得跟蹤具有較強(qiáng)的適應(yīng)性,對(duì)部分遮擋的物體跟蹤具有較好的魯棒性,跟蹤算法示意圖如圖3。

圖3 跟蹤算法示意圖

2.4 算法描述

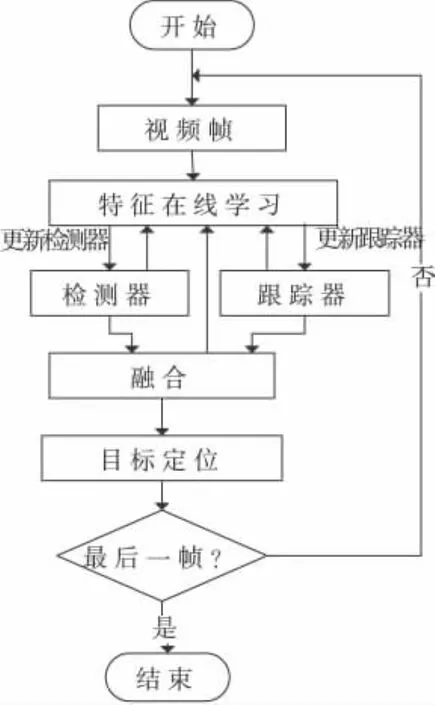

本文算法流程描述如下,算法流程圖如圖4:

1)根據(jù)視頻幀,獲得相應(yīng)的訓(xùn)練集;

2)進(jìn)行特征在線學(xué)習(xí)學(xué)習(xí);

3)根據(jù)獲得的特征不斷的更新檢測(cè)器和跟蹤器,同時(shí)跟蹤器和檢測(cè)器也將得到的數(shù)據(jù)反饋給在線學(xué)習(xí)模型;

4)檢測(cè)器對(duì)目標(biāo)進(jìn)行檢測(cè),與跟蹤器相融合,對(duì)比置信度,實(shí)現(xiàn)目標(biāo)的跟蹤。

圖4 算法流程圖

3 實(shí)驗(yàn)結(jié)果與分析

實(shí)驗(yàn)計(jì)算機(jī)為 CPU E5500@2.80GHz,2GB內(nèi)存,在Matlab R2009a環(huán)境下運(yùn)行。本文中圖像是RGB格式,分辨率為320*240,幀率為30幀每秒。視頻包括原參考文獻(xiàn)中的及自己錄制的,分別為摩托車的運(yùn)動(dòng)[17],由2917幀組成(2分33秒),在這段視頻中包含了目標(biāo)的遮擋、消失、快速運(yùn)動(dòng)、特征的突然變化等;復(fù)雜背景下的非剛性球的運(yùn)動(dòng),由(2452)幀組成(1分22秒),包括了目標(biāo)的遮擋、消失和相機(jī)的移動(dòng);復(fù)雜邊緣物體的運(yùn)動(dòng)由(4740)幀組成(2分36秒),包括了目標(biāo)由慢向快的運(yùn)動(dòng)、遮擋、丟失、相似背景干擾和相機(jī)的移動(dòng)。

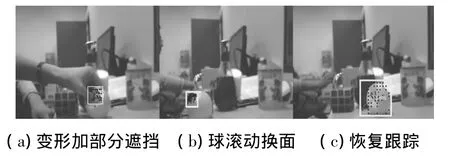

圖5中被跟蹤的目標(biāo)是非剛性軟球,5(a)中由于手力的作用使得球變形,雖然深色采樣點(diǎn)所取范圍變小,但是從圖中可以看出本算法依然可以找到跟蹤目標(biāo)的中心點(diǎn),實(shí)現(xiàn)跟蹤;5(b)中球面進(jìn)行了滾動(dòng),即所跟蹤的球面已經(jīng)不是第一幀獲得運(yùn)動(dòng)目標(biāo)時(shí)的球面,但是通過球在運(yùn)動(dòng)過程中,對(duì)特征的不斷學(xué)習(xí),使得算法越來越精確,雖然球換面,但是依然能實(shí)現(xiàn)目標(biāo)跟蹤;5(c)中可以看到在手離開之后,本算法恢復(fù)了對(duì)變形球的跟蹤,而且跟蹤效果較好,這就是跟蹤器、檢測(cè)器和在線學(xué)習(xí)共同作用的結(jié)果。

圖5 非剛性物體跟蹤效果圖

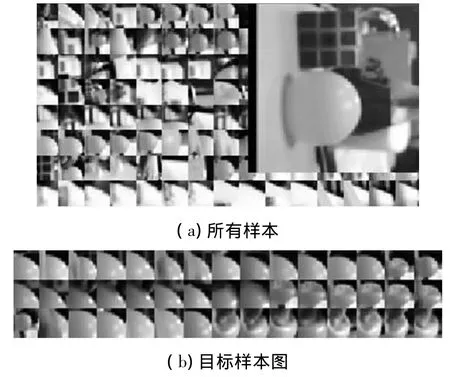

目標(biāo)跟蹤過程中獲得的樣本圖如圖6,6(a)中為所有樣本,既包括目標(biāo)樣本也包括背景樣本,6(b)為目標(biāo)樣本,即在跟蹤過程中,通過計(jì)算與第一幀獲得的標(biāo)準(zhǔn)目標(biāo)樣本的重合率大于50%的樣本,這些樣本主要是通過在線學(xué)習(xí)模型獲得,雖然這些樣本有各種變化,各不相同,但是還是可以搜索到漂移,時(shí)刻進(jìn)行修正,跟蹤目標(biāo)。

圖6 跟蹤目標(biāo)樣本圖

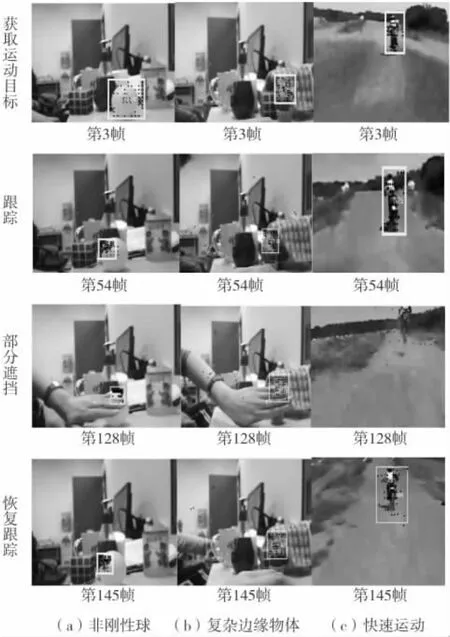

對(duì)三個(gè)目標(biāo)的跟蹤如圖7,第一個(gè)是復(fù)雜背景的非剛性球跟蹤,第二個(gè)是復(fù)雜背景下復(fù)雜邊緣物體跟蹤,第三個(gè)雖然背景較為簡(jiǎn)單,但是目標(biāo)的運(yùn)動(dòng)速度非常的快。從圖中可以看出無論是出現(xiàn)部分遮擋還是快速運(yùn)動(dòng),本算法都進(jìn)行了較好的跟蹤。在7(a)和7(b)中運(yùn)動(dòng)目標(biāo)的背景相當(dāng)復(fù)雜,甚至有些背景的灰度與目標(biāo)很接近,但是從跟蹤效果可以看出,本算法在復(fù)雜背景下進(jìn)行了實(shí)時(shí)準(zhǔn)確的跟蹤。在測(cè)試摩托車手的視頻中,在出現(xiàn)部分遮擋之后,目標(biāo)丟失,目標(biāo)中心點(diǎn)與深色取樣點(diǎn)出現(xiàn)了較大的偏差,但是在下一幀時(shí),依然能檢測(cè)到運(yùn)動(dòng)的目標(biāo),原因就是在前后兩幀中運(yùn)動(dòng)目標(biāo)由于運(yùn)動(dòng)速度非常快,位置發(fā)生很大的變化,而追蹤對(duì)象的搜索范圍較小產(chǎn)生的,但是在下一幀時(shí)算法便克服其誤差,進(jìn)行大范圍的搜索,得到了運(yùn)動(dòng)目標(biāo)。

圖7 跟蹤效果圖

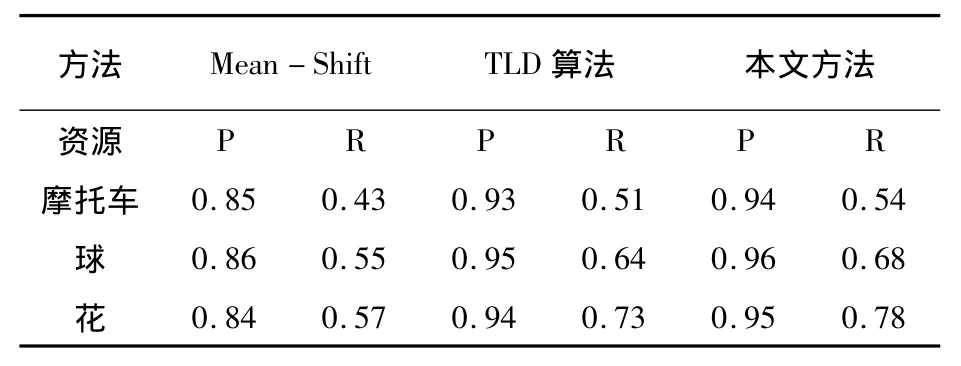

本文采用文獻(xiàn)[18]中的評(píng)估標(biāo)準(zhǔn),將跟蹤過程中算法選擇的所有目標(biāo)窗口數(shù)(樣本)定義為ST,手動(dòng)選擇的目標(biāo)窗口(樣本)個(gè)數(shù)定義為GT,如果跟蹤獲得的窗口和手動(dòng)選擇的窗口的重合率超過70%,就認(rèn)為獲得是正樣本,用TP表示,否則為FP,準(zhǔn)確率用P表示,定義為:

用R來表示正樣本和手動(dòng)選擇目標(biāo)窗口的比,定義為:

本文使用P和R這兩個(gè)參數(shù)估計(jì)跟蹤方法的質(zhì)量。將本文方法與Mean-Shift算法和原TLD算法進(jìn)行對(duì)比,跟蹤質(zhì)量見表1。

表1 跟蹤質(zhì)量表

從表1中可以看出TLD算法的準(zhǔn)確率明顯高于Mean-Shift算法,無論是哪種視頻資源,都進(jìn)行了很好的跟蹤,復(fù)雜背景并沒有影響跟蹤效果;正樣本對(duì)于手動(dòng)選擇的樣本比例,本文算法也明顯高于Mean-Shift算法,且高于TLD算法。由此可見,本文算法得到了較好的跟蹤效果,準(zhǔn)確率較高,可以進(jìn)行復(fù)雜背景下運(yùn)動(dòng)目標(biāo)的跟蹤。

4 結(jié)論

對(duì)隨機(jī)森林算法進(jìn)行分析研究,結(jié)合TLD的思想,構(gòu)建在線學(xué)習(xí)模型進(jìn)行結(jié)構(gòu)限制,使得分類結(jié)果更準(zhǔn)確;為捕捉大運(yùn)動(dòng)目標(biāo),改進(jìn)光流法構(gòu)建跟蹤器,設(shè)計(jì)結(jié)構(gòu),實(shí)現(xiàn)檢測(cè)器與跟蹤器的融合,并通過一系列實(shí)驗(yàn)對(duì)本文方法的有效性進(jìn)行驗(yàn)證。實(shí)驗(yàn)表明,本文算法實(shí)現(xiàn)了剛性物體、非剛性物體在快速運(yùn)動(dòng)、部分遮擋、完全丟失、攝像機(jī)運(yùn)動(dòng)等情況下的跟蹤,取得了較好的跟蹤效果,跟蹤準(zhǔn)確率可以達(dá)到93%以上。

[1]JORGE B,BOBER M,PLA F.Motion and intensity based segmentation and its application to traffic monitoring[C].In Proceedings,International Conference on Image Analysis and Processing ICIAP,F(xiàn)lorence,Italy,1997:502-509.

[2]MORAVEC H P.Towards automatic visual obstacle avoidance[C].In Proceedings of the 5th International Joint Conference on Artificial Intelligence,1977.

[3]KASS M,WITKINM A,TERZOPOULOS D.Active contour models[J].International Journal on Computer Vision(IJCV),1988,1(4):321-331.

[4] MENET S,SAINT-MARC P,MEDIONI G.BSnakes:Implementation and application to stereo[C].DARPA Image Understanding Workshop,1990,720-726.

[5] DEILAMANI M.J,ASLI R N Moving object tracking based on mean shift algorithm and features fusion [J].Artificial Intelligence and Signal Processing(AISP).2011:48-53.

[6]KALAL Z,MIKOLAJCZYK K,MATAS J.Face-TLD:Tracking-Learning-Detection Applied to Faces[J].International Conference on Image Processing,2010.

[7]CHEN E,XU Y,YANG X K,et al.Quaternion based optical flow estimation for robust object tracking[J].Digital Signal Processing,2013,23(1):118-125.

[8]陳添丁,胡鑒,吳滌.稀疏光流快速計(jì)算的動(dòng)態(tài)目標(biāo)檢測(cè)與跟蹤[J].中國(guó)圖象圖形學(xué)報(bào),2013,18(12):1593-1600.

[9]WANG J,CHEN F,YANG J M,et al.Transferring visual Prior for online object tracking[J].IEEE Transactions on Image Processing,2012,21(7):3296-3305.

[10]王愛平,萬(wàn)國(guó)偉,程志全,等.支持在線學(xué)習(xí)的增量式極端隨機(jī)森林分類器[J].軟件學(xué)報(bào),2011,22(9):2059-2074.

[11]袁衛(wèi)紅,盧雁,毛海岑,等.基于光流的運(yùn)動(dòng)小目標(biāo)檢測(cè)算法[J].光學(xué)與光電技術(shù),2012,1(10):67-70.

[12]佟國(guó)峰,蔣昭炎,谷久宏,等.基于隨機(jī)蕨叢的長(zhǎng)期目標(biāo)跟蹤算法[J].東北大學(xué)學(xué)報(bào):自然科學(xué)版,2013,43(1):4-8.

[13]李勁菊,朱青,王耀南.一種復(fù)雜背景下運(yùn)動(dòng)目標(biāo)檢測(cè)與跟蹤方法[J].儀器儀表學(xué)報(bào),2010,31(10):2242-2247.

[14]郝志成.決策主導(dǎo)的多模式融合目標(biāo)跟蹤算法[J].儀器儀表學(xué)報(bào),2013,34(3):487-492.

[15]BREIMAN L.Random forests[J].Machine Learning,2001,45(1):5-32.

[16]LUCAS B,KANADE T.An iterative image registration technique with an application to stereo vision[C].Proceedings of DARPA Image Understanding WorkShop.San Francisco,USA:Morgan Kaufmann Publishers Inc.1981,147-151.

[17]CHAN T,VESE L.Active contours without edges[J].IEEE Transaction on Image Processing,2001,10(2):266-277.

[18]ZDENEK K,JIRI M,KRYSTIAN M.Online learning of robust object detectors during unstable tracking [J].On-line Learning for Computer Vision Workshop,2009.