利用深度視頻中的關節運動信息研究人體行為識別

劉 智 董世都

(重慶理工大學計算機科學與工程學院 重慶 400054)

利用深度視頻中的關節運動信息研究人體行為識別

劉 智 董世都

(重慶理工大學計算機科學與工程學院 重慶 400054)

由于計算開銷大等原因,基于RGB視頻和人工特征的行為識別方法在近些年的研究進展比較緩慢。相對于RGB視頻,深度視頻能提取運動物體的幾何結構信息,不會隨著光線的變化而變化,因此在視頻分割、行為識別等視覺任務中比RGB視頻具有更好的區分性。以深度視頻中的關節運動信息為基礎,提出一種簡單而有效的人體行為識別方法。首先,根據深度視頻中人體關節信息分別提取表示關節之間角度和相對位置的2個特征向量,然后使用LIBLINEAR分類器分別對提取的2個特征向量進行分類識別,最后,通過融合其分類結果得到最終的行為識別結果。該提取的特征僅包括關節間的相對位置和角度信息,不會因視角的變化而變化,具有一定的視角不變性。實驗結果表明,所提出方法在UTKinect-Action3D數據集上能夠獲得與當前最好方法一致的識別效果,而且該方法具有很低的時間開銷,實時性好。

深度學習 人體行為識別 深度視頻 關節信息

0 引 言

人體行為識別在視頻監控,人機交互,視頻提取等很多領域都扮演著十分重要的角色。在過去的一段時間,機器視覺類任務大多數基于人工設計的特征,如尺度不變特征變換(SIFT)[1]、方向梯度直方圖(HOG)[2]等。然而,很多經典的視覺識別方法僅僅是通過拼湊現有的一些成功方法來實現。有學者認為,行為識別的研究在近些年的研究進展非常緩慢[3]。幸運的是,深度視頻相機的出現而且價格的進一步降低使得研究者可以重新考慮圖像處理和機器視覺的一些問題[4]。與RGB相機僅僅拍攝顏色和紋理信息不同,深度相機能記錄人體的深度信息,從而獲得人體的幾何信息和關節信息。而且,深度相機對光線的變化不敏感,因而在視頻分割,目標識別,行為識別等視覺任務中比傳統的RGB視頻具有更好的可分辨性。基于此,本文以深度視頻為研究對象,提出了一種直觀有效的人體行為識別方法。該方法根據深度視頻的關節位置信息提取角度特征向量和相對位置特征向量,具有視角不變性的特點。實驗結果表明,本文提出的方法在UTKinect-Action3D數據集上能獲得與當前最好方法一致的識別效果,而且時間開銷低,便于系統的實時性。

本文的主要貢獻如下:

1) 使用深度視頻中的關節信息,提出了一種簡單有效的行為識別方法,實驗結果表明了該方法的有效性,并且方法具有視角不變性的特點;

2) 提出了兩種不同的基于關節位置信息的特征向量提取方法,它們分別是表示相對位置信息的以兩髖中心為基準的特征向量HCBV(Hip center based vector)和表示角度信息的角度特征向量AV(Angle Vector);

3) 通過融合HCBV和AV的分類結果,本文提出方法能夠在UTKinect-Action3D數據集上獲得與當前最好方法一致的識別效果。并且該方法時間開銷小,實時性好。

1 相關研究

在過去的十多年間,低層次特征在傳統的行為識別中獲得了很成功的應用,如SIFT[1,5]、HOG[2,6]、時空興趣點STIP(space-time interest points)[7]和加速魯棒特征SURF(speeded up robust features)[8]。然而近些年來,基于RGB視頻的行為識別算法的研究往往是原有成熟方法的堆積,其研究進展似乎停滯不前。可喜的是,Kinect[4]等低價深度相機的出現重新喚起了科研工作者試圖提高屬性識別、行為識別,視頻分割等視覺任務效果的興趣。Ye等人[9]對基于深度視頻的人體行為識別研究做了一個較為詳細的綜述。在基于深度視頻的人體行為識別方法中,HOG[2]、STIP和3D詞袋模型(bag-of-3Dpoints)[10]是經常用到的一些特征。與此同時,文獻[7]通過融合時空特征和關節信息來研究基于深度視頻的行為識別,其實驗表明深度視頻中的關節信息能夠顯著提高識別的效果。此后,越來越多的行為識別研究專注于尋找人體行為和關節運動信息之間的潛在關系[11-12]。Shotton等人[4,13]提出為每一單獨幀來建模人體行為識別問題,使用隨機森林和條件回歸森林的方法計算每一個像素點的統計模式。在文獻[14]中,作者將人的靜態姿勢,運動屬性和基于關節的總體變化信息進行組合形成一個新的行為屬性描述子EigenJoints,并且提出了一種人體行為識別的有效方法。Zanfir等人利用關節的結構,速度和加速度等信息提出了運動姿勢描述子[11]。為降低某些關節錯誤位置估計的影響,作者使用分割和時態約束[15]選擇最準確的k個關節,并使用關節相對位置向量[16]作為描述物體運動的補充信息。和文獻[11]不同的是,Xia等人[17]通過構建3D關節位置直方圖模型HOJ3D(histograms of 3D joint locations)來表示人體的一個姿勢。除此之外,Devanne[18]和Chrungoo等人[19]也利用深度視頻中的關節信息研究人體行為識別。本文將沿用利用關節運動信息建模人體行為的方法,提出了一種基于深度視頻中關節運動信息并且簡單有效的人體行為識別方法。實驗結果表明本方法在UTKinect-Action3D數據集上能獲得與當前最好方法一致的識別效果,并且具有較低的時間開銷,算法更為簡單。

2 基于關節運動信息的特征提取和分類融合

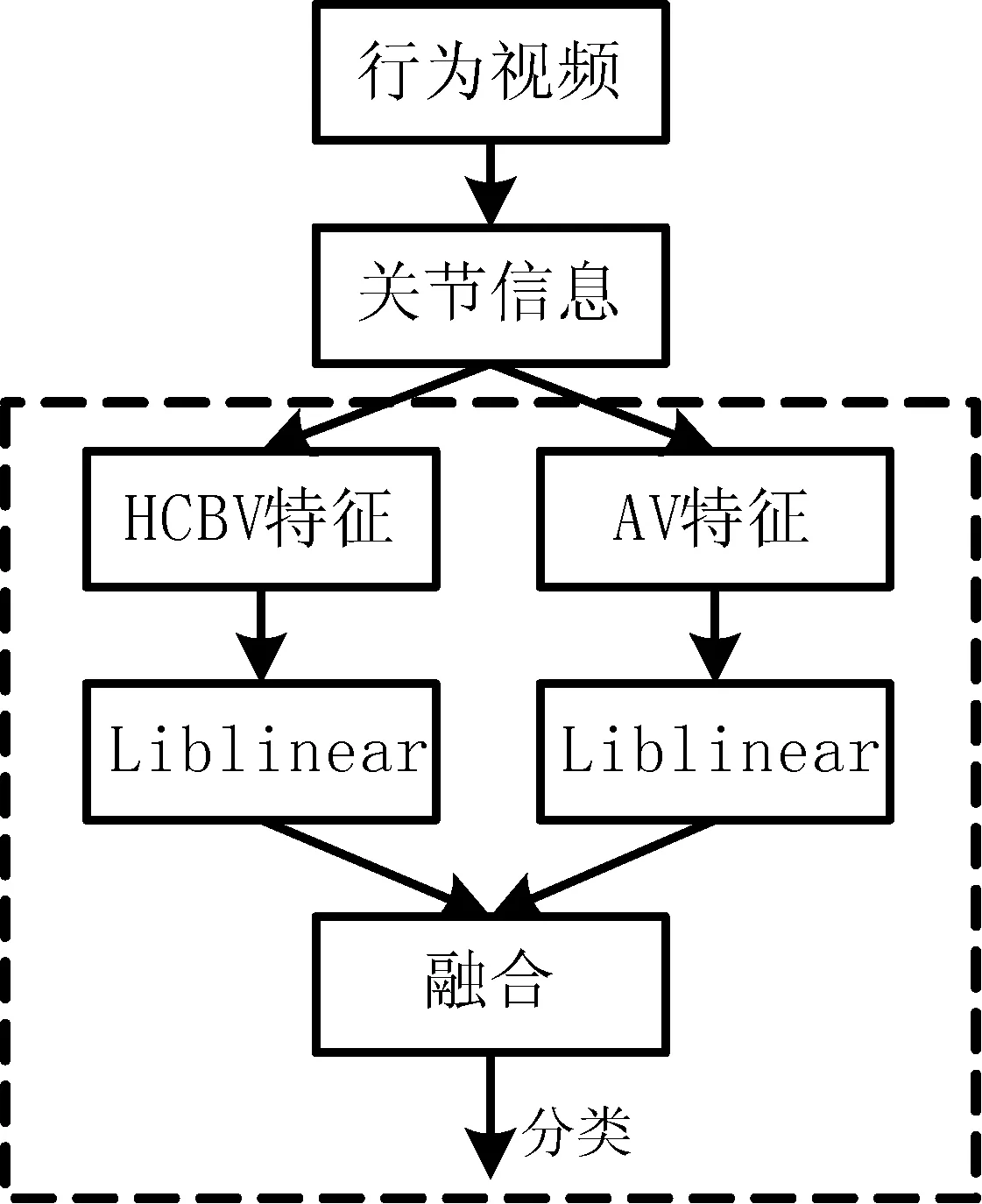

從深度視頻中可獲取人體的20個關節x、y、z坐標信息,這20個關節分別是兩髖中心、脊、兩肩中心、頭、左肩、左肘、左腕、左手、右肩、右肘、右腕、右手、左髖、左膝、左踝、左腳、右髖、右膝、右踝、右腳。傳統的方法利用每一幀中所有像素點提取特征,而本文方法僅利用人體的關節信息來提取深度視頻中的特征,方法更簡單、更高效、實時性更高。受到文獻[16]相對位置特征向量的啟發,本文針對每一個深度視頻,提取2個不同的特征向量,它們分別是表示關節間相對位置信息的以兩髖中心為基準的特征向量HCBV和表示各關節間角度信息的角度特征向量AV。然后使用LIBLINEAR[20]分類器分別對所提取的兩種特征向量進行分類。最后對兩種特征向量的分類結果進行融合得到最后的識別結果。其基本框架如圖1所示。分類結果的融合是對每個分類器得出的各個類別的識別概率進行加權求和,求和后概率最大的即為算法識別出的行為。根據實驗結果,本文中HCBV、AV分類器的融合權值分別設置為0.4和0.6。

圖1 本文所提出方法基本框架

2.1 以兩髖中心為基準的特征向量(HCBV)

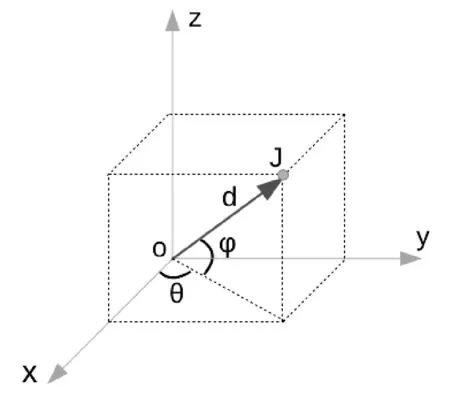

本節提出了一種簡單直觀的HCBV特征提取方法。HCBV特征向量提取每個關節相對于兩髖中心關節的角度信息和位置信息。圖2給出了HCBV的計算方法及過程。相對其他關節而言,兩髖中心關節位移幅度最小,所以HCBV計算方法以兩髖中心關節作為3D直角坐標的原點。對于視頻的每一幀,除兩髖中心關節之外的其他關節,可以計算以下三個參數:該關節到原點的距離(d)、仰角(φ)和方位角(θ)。HCBV將視頻所有幀的距離,仰角和方位角參數進行連接形成一個特征向量。因為,除兩髖中心關節之外,每幀視頻仍有19個關節,因此對于具有tNum長度的視頻,最終的HCBV向量的長度為3×19×tNum。

圖2 HCBV計算示意圖,對每一幀,以兩髖中心關節為原點, 計算其他關節到原點的距離(d)、仰角(φ)和方位角(θ)

2.2 角度特征向量(AV)

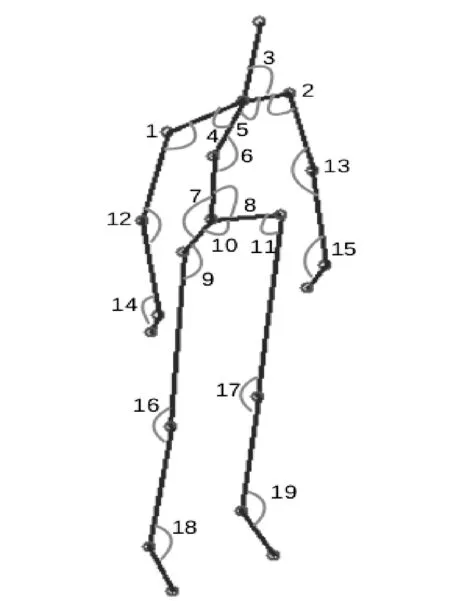

角度特征向量是將人體任何兩個相鄰部分之間的角度參數連接在一起而形成的向量,它旨在提取人體的全局角度信息。圖3給出了某一幀視頻的角度特征向量的計算示意圖。將視頻序列中每一幀的所有角度信息進行連接即得到該視頻的角度特征向量。由于每幀視頻中共有19個角度參數,因此,對于長度為tNum的視頻,角度特征向量的維度為19×tNum。

圖3 角度特征向量的計算示意圖,計算每幀視頻 骨架結構中所有關節間夾角,共19個參數

3 實驗及結果

3.1 數據集和預處理

本文提出的方法在UTKinect-Action3D數據集[17]上進行了實驗評估。該數據集使用靜止Kinect相機采集而成,由10個不同的被試完成10種不同的行為動作(如表1所示),每位被試每個行為動作拍攝2次。該數據集總共含有199個有效視頻,數據集中給出了每個視頻所有幀的20個關節的3維坐標。為實驗的方便,本文實驗中使用了200個視頻序列,即將缺失的第10位被試carry動作的第二次行為拍攝使用原始數據中1242幀到1300幀的視頻進行補充。UTKinect-Action3D數據集包含了從多個不同角度拍攝的視頻序列并且具有很高的類內差異性,因此十分具有挑戰性。在實驗前,我們對每個視頻進行了簡單的預處理,其一是使用插值技術將數據集中的所有視頻規范化到統一的長度,該長度即為所有視頻長度的中間值,據此,本文將所有行為視頻均規范化到28幀。第二個簡單處理是使用min-max方法將分別將所有視頻的x、y、z坐標值規范化到[0,1]范圍。

3.2 實驗結果評價

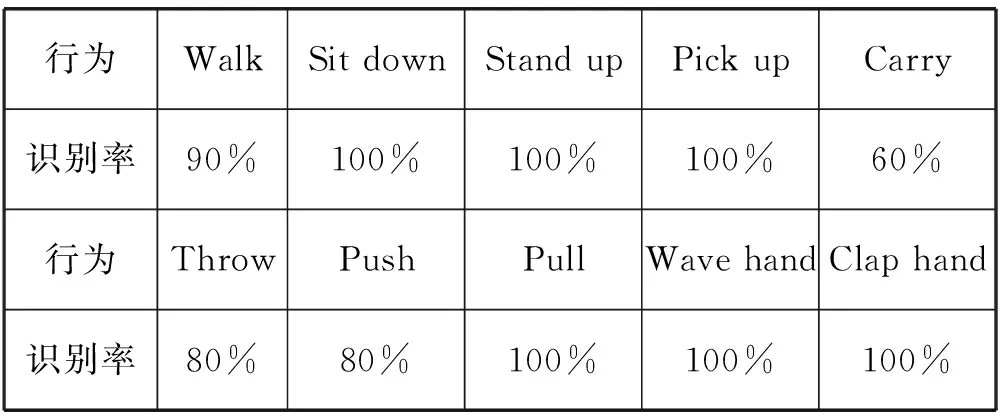

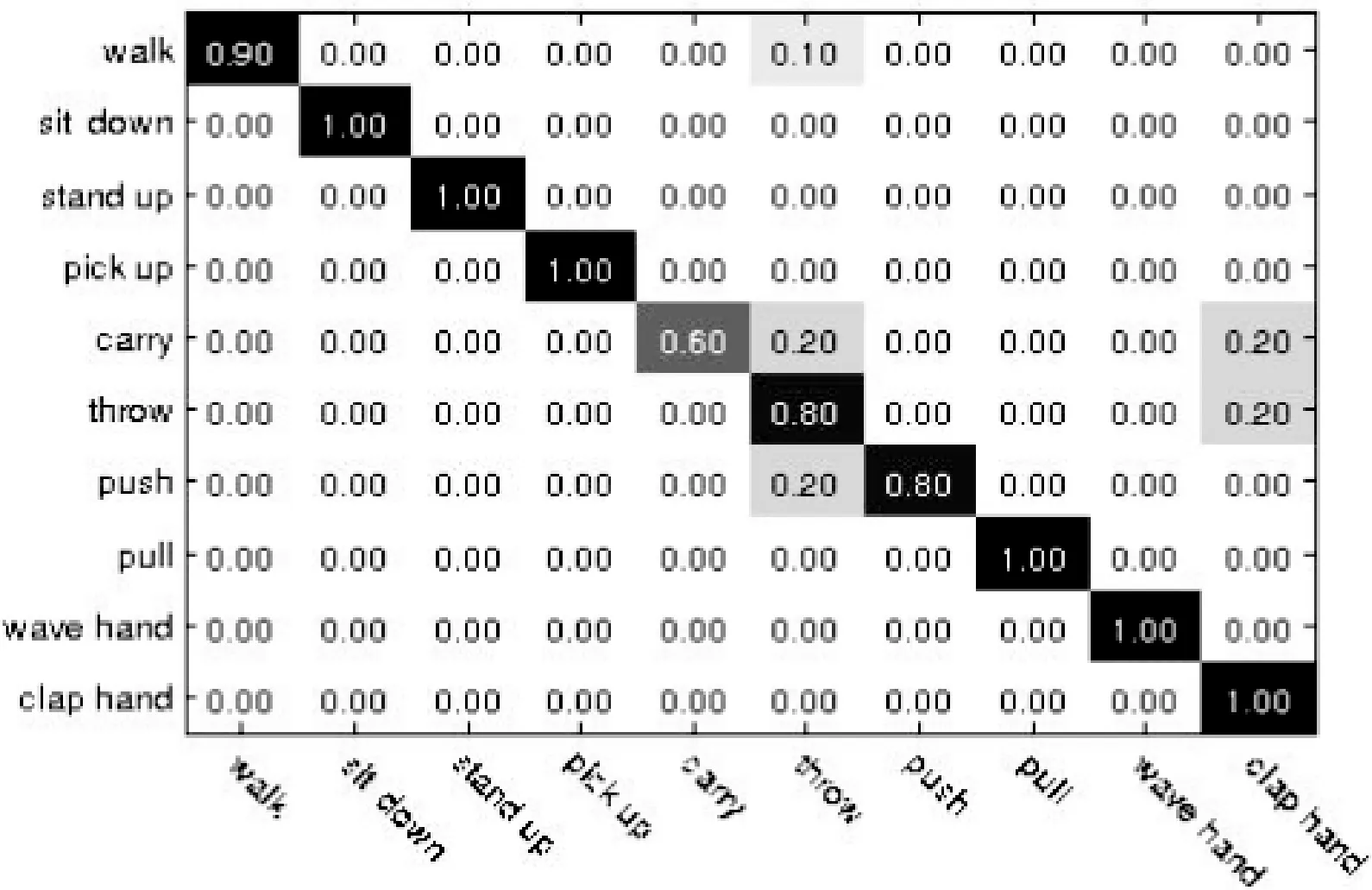

對于在UTKinect-Action3D數據集上的實驗評估,本文使用交叉被試的實驗設置,即被試{1,3,5,7,9}的行為序列用于訓練而被試{2,4,6,8,10}的行為序列用于測試。表1和圖4分別以表和混淆矩陣的方式給出了每類行為的識別準確性。從中可以看出,大部分行為能正確的識別,各行為的平均識別準確率為91%。高識別率的實驗結果表明了本文方法的有效性及視角不變性的特點。從圖4中的混淆矩陣可看出,carry,throw和push動作的識別率相對較低。其中carry動作很容易被錯誤地識別為動作throw和clap hand,很可能是因為動作carry含有的視頻幀數較少而導致所提供的信息量不足,而throw被錯誤地識別為clap hand可能是它們都是正面動作而且其手部運動和clap hand非常類似。

表1 UTKINECT-ACTION3D數據集上各行為 的識別率(平均:91%)

圖4 UTKINECT-ACTION3D數據集上識別結果的混淆矩陣

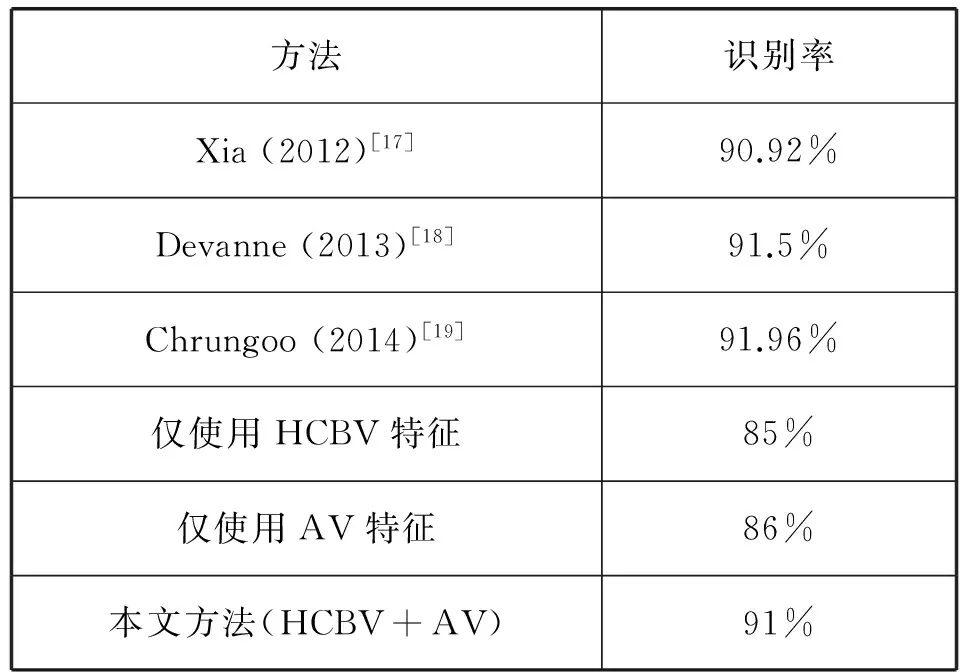

表2給出了本文方法和近些年最好方法的識別效果進行了比較。本文提出的方法獲得了91%的分類性能,這一結果和當前基于關節信息行為識別的最好方法[17-19]的結果相當。 值得一提的是,本文使用了200個視頻,其中有個是其他方法認為無效的視頻,而其他方法只使用了199個視頻序列。除此之外,文獻[17-19]方法對行為視頻每一幀逐個像素進行特征提取,而本文方法僅根據每一幀中20個關節點的信息計算HCBV和AV特征,從特征提取的原理上可知本文方法更加簡單和高效。在具有4核Intel(R) Core(TM) i5-4200M CPU@ 2.50 GHz處理器和4 GB內存的計算機上,提取一個幀數為28的視頻中HCBV和AV特征的時間開銷是0.18秒,完全能夠滿足系統實時處理的要求。

表2 本文方法和已有方法在UTKINECT-ACTION3D 上識別效果比較

4 結 語

基于深度視頻提供的關節信息,本文提出了一種直觀而簡單有效的人體行為識別方法,該方法通過提取視頻中關節間的相對位置信息和角度信息形成兩種不同的特征向量HCBV和AV。通過融合HCBV和AV兩個特征向量的分類結果,本文的方法在UTKinect-Action3D數據集獲得了很好的識別結果,該結果與近些年最好的方法的識別準確率基本相當。相對于其他方法,本文所提出方法更簡單直觀,時間開銷小,具有很好的實時性。與此同時,UTKinect-Action3D數據集是多視角數據,本文提取的特征僅包括關節間的相對位置和角度信息,不會因視角的變化而變化,實驗結果表明算法具有一定的視角不變性。

[1] Lowe D G. Distinctive image features from scale-invariant keypoints[J]. International Journal of Computer Vision, 2004, 60(2): 91-110.

[2] Dalal N, Triggs B. Histograms of oriented gradients for human detection[C]//Computer Vision and Pattern Recognition, 2005 IEEE Computer Society Conference on. IEEE, 2005: 886-893.

[3] Girshick R, Donahue J, Darrell T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation[C]//Computer Vision and Pattern Recognition (CVPR), 2014 IEEE Conference on. IEEE, 2014: 580-587.

[4] Shotton J, Fitzgibbon A, Cook M, et al. Real-time human pose recognition in parts from single depth images[C]//Computer Vision and Pattern Recognition (CVPR), 2011 IEEE Conference on, 2011: 1297-1304.

[5]LoweDG.Objectrecognitionfromlocalscale-invariantfeatures[C]//ProceedingsoftheSeventhIEEEInternationalConferenceonComputerVision.IEEE, 1999: 1150-1157.

[6]LaptevI,MarszalekM,SchmidC,etal.Learningrealistichumanactionsfrommovies[C]//ComputerVisionandPatternRecognition, 2008IEEEConferenceon, 2008: 1-8.

[7]ZhuY,ChenW,GuoG.Evaluatingspatiotemporalinterestpointfeaturesfordepth-basedactionrecognition[J].ImageandVisionComputing, 2014, 32(8): 453-464.

[8]BayH,EssA,TuytelaarsT,etal.Speeded-uprobustfeatures(SURF)[J].ComputerVisionandImageUnderstanding, 2008, 110(3): 346-359.

[9]YeM,ZhangQ,WangL,etal.Asurveyonhumanmotionanalysisfromdepthdata[M]//Time-of-FlightandDepthImaging,Sensors,Algorithms,andApplications.Springer, 2013: 149-187.

[10]LiW,ZhangZ,LiuZ.Actionrecognitionbasedonabagof3Dpoints[C]//ComputerVisionandPatternRecognitionWorkshops(CVPRW), 2010IEEEComputerSocietyConferenceon, 2010: 9-14.

[11]ZanfirM,LeordeanuM,SminchisescuC.Themovingpose:anefficient3Dkinematicsdescriptorforlow-latencyactionrecognitionanddetection[C]//ComputerVision(ICCV), 2013IEEEInternationalConferenceon, 2013: 2752-2759.

[12]VemulapalliR,Arratef,ChellappaR.Humanactionrecognitionbyrepresenting3Dskeletonsaspointsinaliegroup[C]//ComputerVisionandPatternRecognition(CVPR), 2014IEEEConferenceon, 2014: 588-595.

[13]SunM,KohliP,ShottonJ.Conditionalregressionforestsforhumanposeestimation[C]//ComputerVisionandPatternRecognition(CVPR), 2012IEEEConferenceon.IEEE, 2012: 3394-3401.

[14]YangX,TianY.Effective3DactionrecognitionusingEigenJoints[J].JournalofVisualCommunicationandImageRepresentation, 2014, 25(1): 2-11.

[15]WangC,WangY,YuilleAL.Anapproachtopose-basedactionrecognition[C]//ComputerVisionandPatternRecognition(CVPR), 2013IEEEConferenceon.IEEE, 2013: 915-922.

[16]WangJ,LiuZ,WuY,etal.Miningactionletensembleforactionrecognitionwithdepthcameras[C]//ComputerVisionandPatternRecognition(CVPR), 2012IEEEConferenceon, 2012: 1290-1297.

[17]XiaL,ChenCC,AggarwalJK.Viewinvarianthumanactionrecognitionusinghistogramsof3Djoints[C]//ComputerVisionandPatternRecognitionWorkshops(CVPRW), 2012IEEEComputerSocietyConferenceon, 2012: 20-27.

[18]DevanneM,WannousH,BerrettiS,etal.Space-timeposerepresentationfor3Dhumanactionrecognition[C]//ProceedingsoftheICIAP2013InternationalWorkshopsonNewTrendsinImageAnalysisandProcessing.Springer, 2013: 456-464.

[19]ChrungooA,ManimaranSS,RavindranB.Activityrecognitionfornaturalhumanrobotinteraction[C]//Proceedingsofthe6thInternationalConferenceonSocialRobotics.Springer, 2014: 84-94.

[20]FanRE,ChangKW,HsiehCJ,etal.LIBLINEAR:alibraryforlargelinearclassification[J].TheJournalofMachineLearningResearch, 2008, 9: 1871-1874.

STUDY OF HUMAN ACTION RECOGNITION BY USING SKELETON MOTION INFORMATION IN DEPTH VIDEO

Liu Zhi Dong Shidu

(CollegeofComputerScienceandEngineering,ChongqingUniversityofTechnology,Chongqing400054,China)

Due to high computation overhead, little progress has been achieved in human action recognition (HAR) based on hand-crafted feature and RGB videos in recent years. Compared with RGB video, depth video sequence is able to extract geometry structural information of animated objects, it is also more insensitive to light changes and more discriminative in many vision tasks such as segmentation and activity recognition. Thus, an effective and straightforward HAR method by using joints motion information of the depth sequence is proposed. First, two feature vectors are extracted according to the human joints information in depth video to indicate the angle and position information among joints. Then, the obtained vectors are classified and identified by using Liblinear classifier. Finally, the action recognition result is achieved by fusing the classification results. The extracted features are view-invariant because the vectors contain only angle and relative position information among joints, they keep the same even though the angle of view is different. Experimental results demonstrate that the method has low computation overhead and performs comparable results on the UTKinect-Action3D dataset compared with state-of-the-art methods.

Deep learning Human action recognition Depth video Skeleton information

2015-12-30。國家自然科學基金項目(61202348);重慶市教委科學技術研究項目(KJ1400926)。劉智,副教授,主研領域:行為識別,深度學習。董世都,副教授。

TP3

A

10.3969/j.issn.1000-386x.2017.02.033