基于HOG與支持向量機的成熟蘋果自動識別

陳珂 許林峰 柯文德

摘要:由于采摘目標背景復雜多變,采摘機器人提取目標時經常會出現輪廓不均勻以及分割不準確的現象。針對前期背景和目標物的分離處理,選取了最大類間方差法即Otsu算法提取目標物的粗輪廓,引入目標輪廓的HOG梯度方向特征訓練支持向量機,進而對提取的輪廓進行細篩選,實現自動識別目標。以識別成熟蘋果的試驗證明,支持向量機能夠準確識別單個蘋果的輪廓,準確率在93%以上,并獲得了較好的識別效果。

關鍵詞:最大類間方差法;支持向量機;HOG特征;采摘識別

中圖分類號: TP391.41文獻標志碼: A文章編號:1002-1302(2017)07-0211-05

采摘機器人視覺系統在野外成熟果實的識別過程中,容易受到光照強度變化以及復雜背景的干擾,在很大程度上降低采摘機器人作業的實時性和識別的準確率。快速、準確地識別出果實是采摘機器人視覺系統最重要而關鍵的部分,因而很多學者在此領域進行了大量的研究。毛亮等通過模糊聚類算法自動獲取合適的初始演化曲線輪廓,然后利用水平集方法對目標區域輪廓進行精確的提取,很好地保持了目標區域的完整性[1]。熊俊濤等利用基于雙邊濾波的Retinex算法進行荔枝圖像增強,從而凸顯果實和果梗,降低不同光照對荔枝的干擾[2]。郭艾俠等提出基于EA與FCM相結合的策略,將荔枝果與結果母枝從已識別的荔枝串中提取出來,但是對于強光條件下的荔枝果分割所產生的凹陷,處理并不好[3]。孔德運等利用蟻群算法確定初始化的聚類中心,最后引入空間約束FCM對初始分割目標區域進行提取,并且避免了FCM在迭代過程中陷入局部最優解[4]。楊永提出了一種基于離散小波變換的圖像模型,對于傳統的中值濾波算法,其處理速度更加高效[5]。對于水果圖像識別的通用快速圖像分割算法,彭紅星等提出一種基于改進的雙次Otsu算法,能夠對圖像中的背景、果梗、果實進行粗分割和細分割,表現出良好的分割質量以及穩定性[6]。

對于環境光照變化以及干擾物的遮掩,傳統的分割算法處理效果并不好。為改進對果實輪廓的提取,本研究選取了YCbCr色彩空間Cr分量來提取背景,能夠有效地去除果梗以及葉子等復雜大背景信息。以Cr分量灰度圖為基礎,比較區域增長法、K-means、FCM以及Otsu法[7]對輪廓的識別率以及運行時間,試驗結果表明,Otsu算法對于復雜背景下的分割具有良好的效果,同時其算法復雜度也低于傳統的 K-means 以及FCM[8],具有實時性高、輪廓切割平滑的特點,因此本研究選用Otsu法進行輪廓的粗提取。

結合果實輪廓特征,本研究首次引入了一種基于方向梯度直方圖(histogram of oriented gradient,HOG)特征[9]的機器學習算法。HOG特征通過計算和統計圖像局部梯度方向直方圖來構成特征,對于成熟蘋果的梯度特征,建立正HOG特征集合與負HOG特征集的監督學習來訓練SVM,對于Otsu提取的粗輪廓,進一步來篩選成熟果實的輪廓,從而實現對果實的有效識別。

1蘋果輪廓提取

1.1顏色模型選擇

對于普通的RGB圖像來說,由于在野外復雜環境下會有向光、背光、遮擋等自然光的變化,因此選取一種能夠在任何光照條件下不變的特征分量是很重要的。YCbCr顏色模型[10]是色彩空間的一種,通常會用于影片中的影像連續處理,或是數字攝影系統中,其中Y是亮度分量,Cb是藍色色度分量,Cr是紅色色度分量,其中RGB與YCbCr的相互轉換公式為[11]:

YCbCr顏色模型中Cr分量的取值范圍較Y分量和Cb分量集中,對于成熟蘋果的顏色空間分析,可以發現其在Cr紅色顏色分量的灰度化圖像中較好地保留了與背景物的顏色分量差異[12],因此應用YCbCr色彩空間的Cr分量具有較好的分割背景的能力。

1.2提取蘋果輪廓

Otsu法即最大類間方差法[13],其基本思想是使用1個閾值將整個數據分成2個類,如果2個類之間的方差最大,那么這個閾值就是最佳的閾值。其中方差的定義為[14]:

式中:pi表示某樣本分布概率,μ=E(X)表示X期望值,xi表示某樣本值。若一幅圖像有L個灰度級,[1,2,…,L]表示一幅灰度圖的等級,假設通過一個灰度級為k的門限將這些像素點劃分為2類:C0和C1(背景和目標),則C0表示灰度級為[1,…,k]的像素點,C1表示灰度級為[k+1,…,L]的像素點。那么,每一類出現的概率以及各類的平均灰度級分別由下面的式子給出:

式中:ω(k)=∑ki=1pi表示像素點占圖像比例,μ(k)=∑ki=1ipi表示像素點的平均灰度值,μT=μ(L)=∑Li=1ipi表示圖像的總平均灰度值。

同時定義類內方差σ2W與類間方差σ2B、總方差β如下:

因此Otsu法目的是將目標物從背景提取出來,即使式(10)的總體方差最大,需要使灰度從取值范圍[0,1,…,L-1]依次取值,使得方差β最大的灰度值即為最佳閾值。

2基于HOG特征的成熟蘋果輪廓分類

在得到基于顏色空間提取的輪廓特征后,還需進一步從形狀特征來提取目標的真實輪廓,針對一些樹枝和葉子不同的輪廓形狀,需要尋找一種能夠不受光照變化和幾何變化的特征。HOG特征對于輪廓形變和光照變化具有很強的不變性,尤其是對于成熟果實這種圓形的輪廓,能夠很好地描述局部目標表象和形狀的梯度或邊緣方向密度分布,在這里采用HOG特征作為對果實形狀的描述子。

2.1HOG特征提取

對于一幅灰度圖來說,首先需要找出檢測的目標以及掃描窗口,為后續支持向量機的學習提供特征輸入。本研究建立了包含目標窗口的圖片庫,在這些特征庫中,需要人為地先對這些圖片進行裁剪,建立目標特征集,再提取HOG特征,具體過程見圖1。

2.2標準化Gamma空間和顏色空間

為減少光照度對識別的影響,需要先將灰度圖進行歸一化處理,在圖像的紋理強度中,局部表層曝光貢獻比重較大,所以這種壓縮處理能夠有效降低圖像的陰影和光照變化,Gamma壓縮公式如下,其中Gamma可取1/2。

2.3計算梯度

計算圖像橫坐標和縱坐標的梯度強度和方向,一般常用的方法是Sobel離散微分算子[14],是離散性差分算子,用來運算圖像亮度函數的灰度近似值。設圖像像素點(x,y)水平方向梯度為Gx(x,y),豎直方向梯度為Gy(x,y),則有:

則像素點(x,y)處的梯度幅值和梯度方向可以表示為:

2.4構建細胞單元梯度方向直方圖

本研究采用8×8像素細胞矩陣,以2×2的細胞矩陣為一個Block(塊)矩陣,則Block矩陣的大小為16×16,對于一個大小為64×64像素的圖像來說,可以將其劃分為64個細胞矩陣。對于每個細胞矩陣(Cell),本研究對這8×8個像素建立9個bin的直方圖,進而統計這64個像素的梯度信息,再將細胞矩陣的梯度方向360°分為9個方向塊。因此,需要對每個像素所在的梯度方向在直方圖中進行加權投影,并且映射到相應的梯度方向范圍之內,在這里,需要將梯度強度作為投影權值,其中細胞矩陣的梯度示意圖見圖2,構建細胞單元示意圖見圖3。

2.5串聯每個細胞組成塊并統計每個塊的HOG特征

由于局部光照變化以及前景和背景對比度變化,在梯度運算時,其具有一個較大的取值范圍,因此需要對梯度強度進行歸一化操作。本研究將每個細胞單元在空間上串聯成一個Block的聯通區域,并且這些Block區域互有重疊,意味著每一個單元格的特征會以不同的結果多次出現在最后的特征向量中。這樣一方面可以有效減弱圖像局部變化的影響,另一方面也能提高特征的利用率,降低了局部圖像突變對后期支持向量機的訓練影響。

2.6果實的輪廓特征識別

在對果實的識別過程中,訓練集的果實輪廓特征可以分為遮掩和無遮掩2個大類,對于無遮掩的情況,其大致輪廓呈現為圓形,也就是單個果實能夠在輪廓上分開來區別。而對于多個果實有遮掩的情況,其輪廓特征是復雜的,對于支持向量機[15]來說,本研究首先將單個果實的HOG特征歸類為正HOG特征,而將遮掩情況歸類為負HOG特征,具體訓練流程見圖4。

3試驗分析

本研究首先選取經過去噪處理的513幅蘋果圖片作為訓練集,包含在向光、背光、陰影等多種光照不同環境下的果實圖片,確保每種光照條件下的樣本數量平均分布。對于前景與背景的分離,比較了區域增長法、K-means聚類、FCM以及Otsu對圖片的分割效果,其中平均識別率R可以定義為:

式中:r表示圖中識別果實輪廓個數,rt表示圖中真實輪廓果實個數。

3.1目標果實提取分析

由圖5至圖7可以看出,Otsu法在不同光照下,大部分都能準確分割蘋果的輪廓,由表1可以看出,其中向光、背光、陰影3種光照條件下的平均識別率依次是94.6%、93.2%、877%,但是也存在對果實誤分的現象,比如果實被葉子、果梗遮擋,光照太弱或者太強都會影響蘋果的準確分割。

在圖7中,FCM和K-means聚類均出現了誤分情況,在試驗過程中發現,K-means聚類受聚類數目的影響較大,由于它是以空間中k個點為中心進行聚類,因此需要考慮圖片中背景顏色的多樣性。在背景顏色大部分為綠色背景下,當聚類數目為2,可將大部分背景與目標物識別開來,即將目標和背景分為一類和二類。若背景中存在果梗、葉子、土壤等多種干擾物后,會擾亂目標物在顏色空間中的分布,導致將其歸為同一類,因此在試驗中,作為折中效果方案,將聚類數目設為3,能夠對一些背景復雜情況做出較好分割,同時也說明了 K-means聚類對目標物的提取效果容易受到目標和背景區分度以及背景復雜度的影響,其魯棒性并不強。

3.2基于輪廓特征的果實識別

在提取果實的HOG特征過程中,本研究分2步進行,首先將500幅圖片分成2類,一類是果實輪廓不重疊圖像,另一類則是果實輪廓重疊圖像。對于第1類,從原特征集中選取200幅符合條件的不重疊輪廓圖像,并建立對應的HOG特征庫。對于支持向量機,本研究采用交叉驗證法,即首先將數據集分成n個大小相等的子集,選擇其中1個子集作為驗證集,剩余的n-1個子集將作為訓練集訓練SVM,在這里,采用了4-交叉驗證法,即n=4。

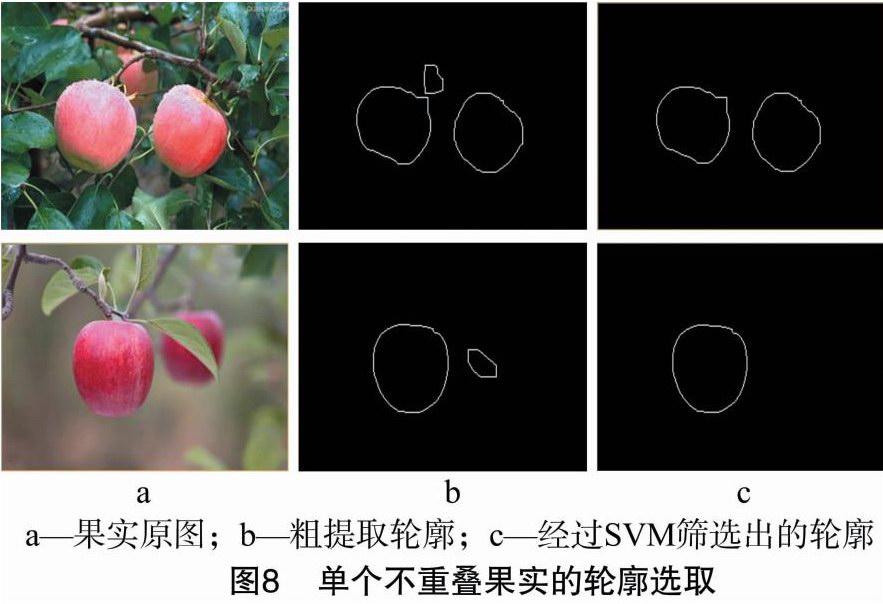

通過試驗可以發現,當果實之間不存在遮擋的情況下,即輪廓不重疊,支持向量機對圓特征的HOG特征識別比較準確;同時針對一些果實被葉子以及樹枝遮擋的情況,會因為一SVM的訓練參數將直接影響分類的效果,比如核函數 K(x,xi) 的選擇以及懲罰參數C的大小等,都會影響后續的分類,本研究首先進行對單個果實的輪廓識別,需要將多個遮掩果實以及非果實輪廓放入負HOG特征庫當中,選用多項式核函數、徑向基核函數以及Sigmoid核函數對樣本集進行交叉驗證試驗,其中C設為5,多項式核函數的最高項次數d設為3,徑向基核函數中的函數寬度σ2=3/2,Sigmoid 核函數的 γ=2,r=0.4,測試結果見表2。

由表2可以看出,采用多項式與Sigmoid核函數的運行時間基本上差不多,其中徑向基花費時間較長,但其識別率最高,對于單個果實輪廓的識別,徑向基的識別率高達94.3%,已基本滿足采摘識別的需要,也能夠保證對實時采摘的要求。

4結論

針對以往對采摘環境下的復雜背景所帶來的干擾,選取YCbCr色彩空間下的Cr分量作為圖片的預輸入,該分量能夠對光照變化以及綠葉所帶來的色調變化保持不變性,同時在該顏色空間下,成熟果實的深紅分量能夠明顯與背景區分開來。

比較傳統的區域增長法、K-means聚類、FCM以及Otsu圖像分割方法,在背景提取方面,Otsu法的平均識別率普遍高于其他3種算法,并且Otsu算法的運行效率也能夠滿足實時采摘的需要,對于一些果梗以及樹枝的分離,Otsu的分割質量和穩定性也表現較好。

基于形狀特征的識別,引入了果實的HOG特征,結合支持向量機對HOG特征的識別,試驗結果表明,對于單個不遮擋果實輪廓的識別率已達90%以上,并且識別速度基本在025 s以內,滿足快速識別的要求。

參考文獻:

[1]毛亮,薛月菊,孔德運,等. 基于稀疏場水平集的荔枝圖像分割算法[J]. 農業工程學報,2011,27(4):345-349.

[2]熊俊濤,鄒湘軍,王紅軍,等. 基于Retinex圖像增強的不同光照條件下的成熟荔枝識別[J]. 農業工程學報,2013,29(12):170-178.

[3]郭艾俠,鄒湘軍,朱夢思,等. 基于探索性分析的荔枝果及結果母枝顏色特征分析與識別[J]. 農業工程報,2013,29(4):191-198.

[4]孔德運,薛月菊,毛亮,等. 基于蟻群和帶空間約束FCM的荔枝圖像分割算法[J]. 計算機工程與應用,2013,49(7):187-190,203.

[5]楊永. 一種離散小波域荔枝圖像處理模型[J]. 江蘇農業科學,2015,43(3):385-387.

[6]彭紅星,鄒湘軍,陳麗娟,等. 基于雙次Otsu算法的野外荔枝多類色彩目標快速識別[J]. 農業機械學報,2014,45(4):61-68,75.

[7]胡敏,宋銀龍. 基于二維Otsu和模糊聚類的圖像分割算法[J]. 計算機應用研究,2012,29(4):1563-1565.

[8]Kondo N,Yata K,Iida M,et al.Development of an end-effector for a tomato cluster harvesting robot[J]. Engineering in Agriculture:Environment and Food,2010,3(1):20-24.

[9]蔡健榮,趙杰文. 自然場景下成熟水果的計算機視覺識別[J]. 農業機械學報,2005,36(2):61-64.

[10]董建民,陳偉海,岳昊嵩,等. 基于Kinect視覺系統的西紅柿自動識別與定位[J]. 中國農機化學報,2014,35(4):169-173.

[11]劉立波,趙春江,吳華瑞,等. 數學形態學在作物病害圖像預處理中的應用研究[J]. 農機化研究,2013(8):180-183.

[12]Bulanon D M,Kataoka T. Fruit detection system and an end effector for robotic harvesting of Fuji apples[J]. Agricultural Engineering International:CIGR Journal,2010,12(1):203-210.

[13]姚立健,丁為民,張培培,等. 基于改進型廣義Hough變換的茄子果實位姿識別方法[J]. 農業工程學報,2009,25(12):128-132.

[14]葉敏,鄒湘軍,蔡沛鋒,等. 水果采摘機器人通用夾持機構設計[J]. 農業機械學報,2011,42(增刊1):177-180.

[15]歐陽俊,陸鋒,劉興權,等. 基于多核混合支持向量機的城市短時交通預測[J]. 中國圖像圖形學報,2010,15(11):1688-1695.