基于布谷鳥(niǎo)優(yōu)化算法的加權(quán)極限學(xué)習(xí)機(jī)模型

王琴

(海南醫(yī)學(xué)院,海南 海口 570102)

基于布谷鳥(niǎo)優(yōu)化算法的加權(quán)極限學(xué)習(xí)機(jī)模型

王琴

(海南醫(yī)學(xué)院,海南 海口 570102)

鑒于極限學(xué)習(xí)機(jī)的待定參數(shù)對(duì)模型極大的影響力,利用布谷鳥(niǎo)優(yōu)化算法對(duì)核參數(shù)和懲罰因子進(jìn)行優(yōu)化選擇,以進(jìn)一步提高模型的預(yù)測(cè)精度,然后利用非線性權(quán)值函數(shù)對(duì)極限學(xué)習(xí)機(jī)的不同樣本數(shù)據(jù)進(jìn)行加權(quán),得到新的加權(quán)極限學(xué)習(xí)機(jī)模型,提高模型的魯棒性能。

極限學(xué)習(xí)機(jī);核函數(shù);加權(quán)矩陣;布谷鳥(niǎo)優(yōu)化算法

極限學(xué)習(xí)機(jī)(ELM)[1]是訓(xùn)練單向隱藏層神經(jīng)網(wǎng)絡(luò)的一種算法。ELM通過(guò)隨機(jī)產(chǎn)生且不需要任何調(diào)整的隱藏層參數(shù)來(lái)實(shí)現(xiàn)非線性映射的逼近。ELM有很多優(yōu)點(diǎn),比如易于操作,快速的訓(xùn)練速度,較好的泛化能力等。

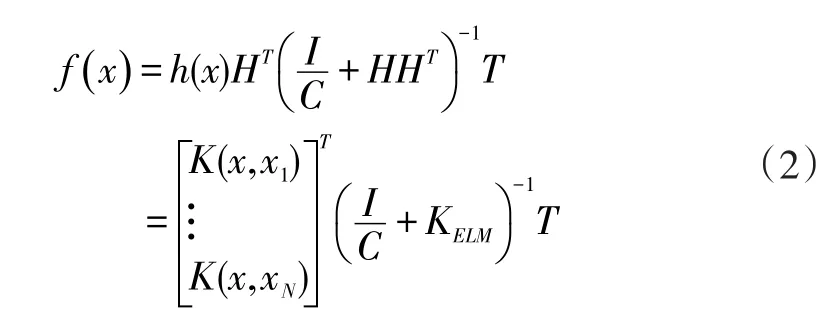

近些年,核學(xué)習(xí)方法已經(jīng)被廣泛研究并且在各個(gè)方面得到應(yīng)用,如分類(lèi)、函數(shù)逼近、異常檢測(cè)等。其最典型的特征就是Mercer核的運(yùn)用,Mercer核通過(guò)從低維空間向高維空間實(shí)現(xiàn)特征變換,在再生核空間中將非線性問(wèn)題線性化。在ELM中,隨機(jī)初始化隱藏層的處理可以看成是產(chǎn)生一個(gè)從輸入數(shù)據(jù)映射到特征空間的非線性映射。如果ELM核映射未知,ELM能定義核函數(shù),隨之產(chǎn)生核極限學(xué)習(xí)機(jī)(KELM)[2]。在KELM中,隱藏層的個(gè)數(shù)即隱藏層特征空間的維數(shù)可以為無(wú)窮大,也不需要指定,這樣KELM就能獲得較好的泛化能力,且通過(guò)核技巧降低運(yùn)算成本。

鑒于不同樣本點(diǎn)對(duì)ELM的輸出會(huì)有不同影響,為了更好地處理這些不平衡數(shù)據(jù)的預(yù)測(cè),加權(quán)極限學(xué)習(xí)機(jī)[3](WELM)通過(guò)對(duì)不同樣本進(jìn)行加權(quán),合理分配不同樣本的權(quán)值,大大提高ELM的學(xué)習(xí)能力。

權(quán)重函數(shù)的選擇對(duì)WELM的魯棒特性影響很大,ELM中的核參數(shù)γ和懲罰參數(shù)C的調(diào)整對(duì)降低泛化誤差,獲得精確的ELM模型也起著至關(guān)重要的作用。本文運(yùn)用最新研究的布谷鳥(niǎo)優(yōu)化算法(COA)[4]對(duì)ELM模型參數(shù)進(jìn)行優(yōu)化選擇,采用非線性權(quán)值對(duì)ELM進(jìn)行加權(quán),通過(guò)多次迭代最后輸出理想結(jié)果。

1 核極限學(xué)習(xí)機(jī)

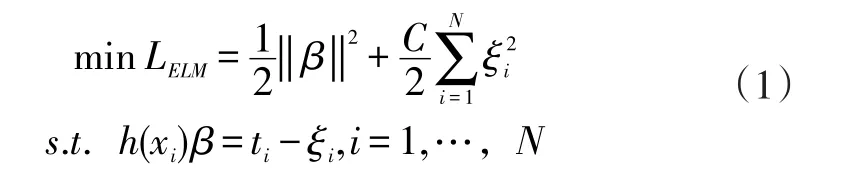

ELM輸出為:

2 加權(quán)極限學(xué)習(xí)機(jī)

3 基于COA的參數(shù)調(diào)整

目前,有很多不同的演化算法已經(jīng)廣泛地應(yīng)用于ELM的參數(shù)優(yōu)化,如遺傳算法、粒子群算法等。COA是基于布谷鳥(niǎo)特殊的孵育寄生行為而提出的一種新興仿生智能優(yōu)化算法,COA具有全局搜尋能力強(qiáng)、聚集性更快、簡(jiǎn)單易實(shí)現(xiàn)等優(yōu)點(diǎn),相比其他演化算法,更具潛力。

COA以初始化那些產(chǎn)卵于其他鳥(niǎo)類(lèi)棲息地的布谷鳥(niǎo)種群開(kāi)始,然后在宿主鳥(niǎo)巢內(nèi)隨機(jī)產(chǎn)卵。布谷鳥(niǎo)的卵與宿主鳥(niǎo)的卵相似程度越高,則被宿主鳥(niǎo)孵化并長(zhǎng)大成為成熟的布谷鳥(niǎo)的機(jī)會(huì)越大。宿主鳥(niǎo)會(huì)發(fā)現(xiàn)其中部分卵(約10%),然后將其移出巢穴。某個(gè)區(qū)域被孵化長(zhǎng)出來(lái)的鳥(niǎo)卵數(shù)量就代表了這個(gè)區(qū)域的適度值。為了提高寄生卵的存活率,布谷鳥(niǎo)會(huì)遷移到更合適的環(huán)境去產(chǎn)卵。所以最終卵存活的最佳棲息地即為COA的優(yōu)化目標(biāo)。

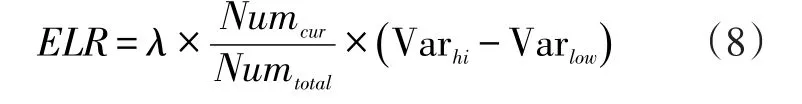

布谷鳥(niǎo)隨機(jī)產(chǎn)下的卵置于一定數(shù)量的宿主鳥(niǎo)巢中,宿主鳥(niǎo)巢在一個(gè)大的范圍內(nèi),這個(gè)范圍叫做最大產(chǎn)卵半徑(ELR),其取決于鳥(niǎo)卵總數(shù)量,當(dāng)前卵數(shù)以及變量上限與下限,所以ELR定義如下:

式(8)中,λ表示調(diào)節(jié)系數(shù),Numcur和Numtotal分別表示鳥(niǎo)卵總數(shù)量和當(dāng)前卵數(shù),Varhi和Varlow分別表示優(yōu)化問(wèn)題中每個(gè)變量的上限和下限。

基于上述理論,COA的優(yōu)化過(guò)程可描述如下:①初始化布谷鳥(niǎo)種群;②確定每只布谷鳥(niǎo)的產(chǎn)卵數(shù),計(jì)算每個(gè)布谷鳥(niǎo)的ELR;③刪除被宿主鳥(niǎo)察覺(jué)的寄生鳥(niǎo)卵,使其他未被識(shí)別的卵被孵化并長(zhǎng)大為成熟的布谷鳥(niǎo);④計(jì)算環(huán)境適應(yīng)度,限定布谷鳥(niǎo)數(shù)量的最大值,剔除適應(yīng)度小的布谷鳥(niǎo);⑤聚類(lèi)布谷鳥(niǎo)種群,尋找遷徙的目標(biāo)棲息地;⑥新的布谷鳥(niǎo)種群遷徙至目標(biāo)棲息地;⑦重復(fù)②至⑥直至滿足迭代終止條件。

4 基于COA的WELM

如上所述,基于COA的WELM算法步驟如下:①對(duì)給定數(shù)據(jù),利用COA尋找到ELM的最佳參數(shù)組合γ和C,確定ELM模型;②通過(guò)ELM模型計(jì)算ξi,然后確定;③通過(guò)式(6)確定加權(quán)矩陣W,得到WELM模型;④根據(jù)WELM再次計(jì)算ξi和,重新得到W;⑤若vk=vk+1,則算法結(jié)束,建立WELM,否則再回到步驟3。

5 結(jié)語(yǔ)

本文將COA對(duì)ELM的參數(shù)進(jìn)行綜合尋優(yōu),獲得最佳的WELM參數(shù)組合,基于COA的參數(shù)優(yōu)化選擇不僅可以縮短WELM的訓(xùn)練時(shí)間,也降低了初值選擇對(duì)模型輸出的影響,并對(duì)ELM采用非線性的權(quán)值對(duì)樣本進(jìn)行處理,降低奇異數(shù)據(jù)對(duì)模型輸出的影響,提高ELM模型的魯棒性能。

[1]Huang GB,Zhu QY,Siew CK.Extreme learning machine: Theory and applications[J].Neurocomputing,2006(1):489-501.

[2]Huang GB,Zhou H,Ding X,et al.Extreme learning machine for regression and multiclass classification[J].IEEE Transactions on Systems,Man and Cybernetics part B,Cybernetics,2012(2):513-529.

[3]Zong W,Huang GB,Chen Y.Weighted Extreme learningmachine for imbalance leaming[J].Neurocomputing,2013(3):229-242.

[4]Rajabioun R.Cuckoo optimization algorithm[J].Applied Soft Computing,2011(8):5508-5518.

[5]陶莉莉,鐘偉民,羅娜,等.基于粗差判別的參數(shù)優(yōu)化自適應(yīng)加權(quán)最小二乘支持向量機(jī)在PX氧化過(guò)程參數(shù)估計(jì)中的應(yīng)用[J].化工學(xué)報(bào),2012(12):3943-3950.

Weighted Extreme Learning Machine Optimized by Cuckoo Optimization Algorithm

Wang Qin

(Hainan Medical University,Haikou Hainan 570102)

In view of the great influence of undetermined parameters of extreme learning machine on the model,cuckoo optimization algorithm was utilized to optimize the kernel parameter and penalty factor in order to improve the prediction accuracy,novel weighted extreme learning model was obtained through weighing different sample data of extreme learning machine by nolinear weighting function afterwards,consequently,the robustness of the model was enhanced.

extreme learning machine;kernel function;weighted matrix;cuckoo optimization algorithm

TP393.08

A

1003-5168(2017)05-0036-02

2017-04-15

王琴(1984-),女,講師,研究方向:機(jī)器學(xué)習(xí)及信號(hào)處理。