基于卷積神經網絡的空心村高分影像建筑物檢測方法

李 政 李永樹 吳 璽 劉 剛 魯 恒 唐 敏

(1.西南交通大學地球科學與環境工程學院, 成都 611756; 2.四川省土地統征整理事物中心, 成都 610041; 3.成都理工大學地球科學學院, 成都 610059; 4.四川大學水利水電學院,成都 610065; 5.中鐵二院工程集團有限公司, 成都 610031)

基于卷積神經網絡的空心村高分影像建筑物檢測方法

李 政1李永樹1吳 璽2劉 剛3魯 恒4唐 敏5

(1.西南交通大學地球科學與環境工程學院, 成都 611756; 2.四川省土地統征整理事物中心, 成都 610041; 3.成都理工大學地球科學學院, 成都 610059; 4.四川大學水利水電學院,成都 610065; 5.中鐵二院工程集團有限公司, 成都 610031)

基于卷積神經網絡(CNN)提出了一種適用于空心村高分影像的建筑物自動檢測方法,該方法利用多尺度顯著性檢測來獲取包含建筑物信息的顯著性區域,然后通過滑動窗口獲取顯著性區域內目標樣本塊,再將這些樣本塊輸入訓練好的CNN并結合SVM來實現分類。為檢驗方法有效性,選取高分影像進行實驗,結果表明,顯著性檢測能夠有效地獲取主要目標,減弱其他無關目標的影響,降低數據冗余;卷積神經網絡能夠自動學習高層次的特征,基于CNN對高分影像進行建筑物檢測,分類準確度可以達到97.6%,表明該方法具有較好的魯棒性和有效性。

空心村; 建筑物檢測; 卷積神經網絡; 高分影像; 多尺度顯著性檢測

引言

隨著我國工業化、城鎮化的快速發展,農村人口非農業化轉移速度不斷加快,農村常住人口逐漸減少,農村人地關系發生了巨大變化,其中最突出的問題是出現了“人走房空”的“空心房”現象,并逐步由個體出現、擴張,發展為村域成片廢棄和整村閑置,產生了農村聚落大規模的“空心化”景觀,并由人口空心化逐漸轉變為農村人口、土地、產業和基礎設施空心化的農村地域空心化,不斷發展的結果就是產生了大量的空心村[1]。由于缺乏規劃引導導致新建房屋分布凌亂、鄉村建設用地脫離原有核心結構、無序拓展逐漸空心化,空心村的存在造成土地資源浪費、低效利用以及村落人居環境品質退化等尖銳矛盾[2]。因此,面對廣袤的農村地區,高效、準確地獲取建筑物信息對空心村的研究具有重要意義。

遙感已經廣泛應用于農村土地利用調查、測繪以及地理國(省)情監測等領域。特別是無人機高分遙感具有較高的空間分辨率,可以獲取高精度的數字高程模型以及高分辨率正射影像,給空心村內信息的智能識別提供了可能性,其應用于空心村建筑物快速檢測具有優勢[3-4]。傳統農村建筑物信息獲取主要依靠外業大比例尺測圖和人工目視解譯兩種方式。外業大比例尺測圖易受到天氣等環境因素制約,費時費力;采取人工目視解譯方法在遙感影像上獲取高精度房屋信息,效率低工作量大[5-6]。如何從高分影像中自動檢測建筑物是遙感應用的熱點問題,研究有效的高分影像建筑物提取方法具有較高的實用價值。早期的建筑物自動提取研究應用的是低層次的特征,比如邊緣、線段分割和角點檢測。隨著高分影像的分辨率越來越高,盡管現有分類方法眾多,然而如何在高分影像上進行建筑物自動檢測仍然是個難題。

非監督特征學習或者是手動設計的低層次特征在復雜場景中具有一定的局限性,特別是對于地形多變,建筑物被樹木遮擋,建筑物本身光譜信息復雜的空心村區域,基于像素或者是面向對象的方法在空心村區域很難獲得良好的效果。隨著深度學習技術的發展,深層卷積神經網絡在圖像分類、目標檢測、圖像語義分割等領域取得了一系列突破性研究成果[7-10]。HINTON等[11]在2006年提出深度學習,該模型具有更強的表達能力,使卷積神經網絡能夠更深層次的表達檢測目標的特征,進而能夠在高分影像上更準確高效地獲取建筑物信息。針對傳統低層次特征的不足,本文結合卷積神經網絡強大的特征學習與分類能力提出一種基于CNN的空心村高分影像建筑物自動檢測方法。

1 理論方法

本文基于多尺度顯著性檢測算法[12-13],獲取待檢測高分影像中的建筑物顯著性區域,降低了數據冗余并且減弱了其他無關目標的影響,然后利用滑動窗口對獲取的顯著區域進行采樣,采集待分類的目標樣本塊,最后利用訓練好的CNN網絡結合SVM進行分類,從而檢測得到研究區域內的建筑物。整體流程如圖1所示。

圖1 整體流程圖Fig.1 Flow chart of proposed method

1.1 多尺度顯著性檢測

(1)

(2)

式中o——訓練集O中的個體

本文首先對輸入高分影像進行下采樣,獲得5層影像金字塔,然后對獲取的每層影像金字塔計算顯著圖。接著使用窗口ω對每層的顯著圖進行采樣,利用式(1)計算每個窗口的顯著性值,最終選取顯著性值最大的5個顯著性區域來構建建筑物的選區,有效地降低了數據冗余并且減弱了其他無關目標影響,具體流程如圖1所示。接著利用滑動窗口在構建的建筑物選區內采集用于分類的樣本塊。

1.2 基于CNN的分類

卷積神經網絡(CNN)主要用來識別位移、縮放及其他形式扭曲不變性的二維圖形[15]。由于CNN的特征檢測層通過訓練數據進行學習,所以在使用CNN時,避免了顯式的特征提取,而隱式地從訓練數據中進行學習;由于同一特征映射面上的神經元權值相同,所以網絡可以并行學習,這也是卷積網絡相對于神經元彼此相連網絡的一大優勢[16-17]。

特征提取是對影像信息進行抽象,得到一組可以描述影像的特征向量,是影像分類的關鍵,特征提取決定了最終的分類結果。對于新的數據和任務,一般人工目視解譯可以獲得較好的分類結果,但工作量大,效率低,具有主觀性強和非定量等缺陷[18-20]。中、低層次的特征,比如HOVW、SIFT、HOG等,在特定的分類和識別任務中具有良好效果。然而,空心村內的建筑物數據為高分影像,與普通的自然圖像差異極大,空間光譜變化較大,因此中低層次的特征提取效果不佳。隨著深度學習的深入,通過輸入數據逐級提取從底層到高層的特征,可以很好地建立從底層信號到高層語義的映射關系,從而獲得建筑物的高層次特征,能夠更好地表達空心村內建筑物[21-24]。

卷積神經網絡避免了顯式的特征取樣,隱式地從訓練數據中進行學習,這使得卷積神經網絡明顯有別于其他基于神經網絡的分類器,通過結構重組和減少權值將特征提取功能融合進多層感知器,它可以直接處理灰度圖片,能夠直接用于處理基于圖像的分類[25]。其在圖像處理方面有如下優點:輸入圖像和網絡的拓撲結構能很好吻合;特征提取和模式分類同時進行,并同時在訓練中產生;權重共享可以減少網絡的訓練參數,使神經網絡結構變得更簡單,適應性更強[26-28]。一個基本的卷積神經網絡結構可以分為3層:特征提取層、特征映射層以及特征池化層,通過堆積多個基本網絡結構可以形成一個深度卷積網絡。

(1)特征提取層:特征提取層的作用是,每個神經元的輸入與前一層的局部感受野相連,并提取該局部的特征。假設輸入影像I是一個二維矩陣,大小為γ×c,利用一個可訓練的過濾器組K,尺寸為w×w,對其進行卷積運算,l為步長,最終得到一個大小為[(γ-w)/l+1]×[(c-w)/l+1]的輸出Y。

(3)

式中xi——卷積層的輸入kij——卷積核參數bi——偏差值

*表示卷積運算,每個濾波器對應一種特定的特征。

(2)特征映射層:利用一個非線性函數對過濾層的結果進行映射來保證特征有效性,得到特征圖F。

(4)

式中,δ是激活函數,常用的激活函數有tanh、sigmoid和softplus。tanh函數是sigmoid函數的一種變體,其取值范圍是[0,1]。線性修正單元ReLU[29]與生物神經元受刺激后的激活模型最為接近,而且具有一定的稀疏性,計算簡單,有助于提升效果。

(3)特征池化層:理論上可以通過卷積獲得特征以后直接利用這些特征訓練分類器,然而一個中等大小的圖像卷積后的特征維度都在百萬數量級,直接訓練分類器很容易過擬合(overfitting),因此需要對卷積特征進行池化操作,即下采樣。F為卷積特征圖,將其分成為大小m×m的不相交區域,然后統計這些區域的平均值(或最大值)作為池化特征P,大小為{[(γ-w)/l+1]/m}×{[(c-w)/l+1]/m}。池化后的特征維度大大降低,避免了過擬合,而且具備抗差性。

本文利用Caffe框架[30]對KRIZHEVSKY[31]提出的AlexNet進行了訓練,由于本文研究的是二分類問題,因此將AlexNet的FC8層用2分類輸出取代了多分類輸出,圖2為本文構建的R-CNN[32]分類流程。

圖2 改進的R-CNN分類流程Fig.2 Improved R-CNN classification process

將窗口采集的樣本塊統一為256像素×256像素,然后送入訓練好的CNN網絡,結合SVM分類器進行分類,并對結果進行標記,實現建筑物的快速檢測。

2 實驗與分析

2.1 實驗數據

研究區位于四川省成都市,包含多個典型空心化村莊。實驗采用無人機獲取高分影像,空間分辨率為0.2 m,影像覆蓋面積總計46.48 km2。訓練樣本對分類準確率具有重要影響,而正樣本選取是關鍵。本文利用目視解譯的方法,為不同建筑物類型手工標注了大量正樣本,并通過旋轉、鏡像等方式擴充了樣本數據,基本包含了空心村區域內各種建筑物類型。隨著不同類型、結構建筑物正樣本數量的增加,卷積神經網絡能更深層次地表達建筑物特征,進而能夠在影像上更準確高效地獲取建筑物信息,識別準確率也會相應地提高。對于負樣本的選擇,本文利用ArcGIS軟件通過隨機選取的方式在空心村區域內獲取大量背景負樣本,然后通過人工篩選方式選取除建筑物以外的多種對象,包含的非建筑物樣本種類越多,識別準確率也會得到提高。樣本包括RGB 3個波段,并按照標準規范格式進行存儲,形成高分影像建筑物樣本庫。構建的樣本庫包括建筑物正樣本5 000個,建筑物負樣本10 000個,所有樣本均縮放到256像素×256像素。樣本示例如圖3所示。

圖3 建筑物樣本庫示例Fig.3 Samples of building sample library

2.2 實驗結果與分析

為了驗證本文方法的有效性,選取了HOG特征及BOVW特征在構建的樣本庫中進行了交叉實驗。本文使用混淆矩陣[33]來驗證構建解譯模型的精度,評價指標體系如表1所示。

表1 混淆矩陣相關指標Tab.1 Related indicators of confusion matrix

其中TP表示將正類預測為正類數;TN表示將負類預測為負類數;FP表示將負類預測為正類數;FN表示將正類預測為負類數。同時定義精確率Pre、準確率Acc和召回率Rec為

(5)

(6)

(7)

實驗采用支持向量機(SVM)作為分類器,采用線性核函數,利用L2正則化,取平方根誤差L2作為損失函數。訓練過程中留10%的樣本(1 500個)用于測試。訓練結果如下:HOG、BOVW特征和CNN特征交叉驗證最佳參數分別為{‘C’: 8 000}、{‘C’: 6 000}和{‘C’: 3 000},關鍵參數C采用6-fold(6文件夾)交叉驗證獲得。它們的混淆矩陣如表2所示。

表2 混淆矩陣Tab.2 Confusion matrix

從表2中可以看出,低層次的HOG特征分類準確率為79.1%,中層次的詞袋模型分類準確率可以達到87.6%,而利用卷積神經網絡的分類準確率可以達到97.6%。說明了卷積特征對于目標具有很好的識別能力。

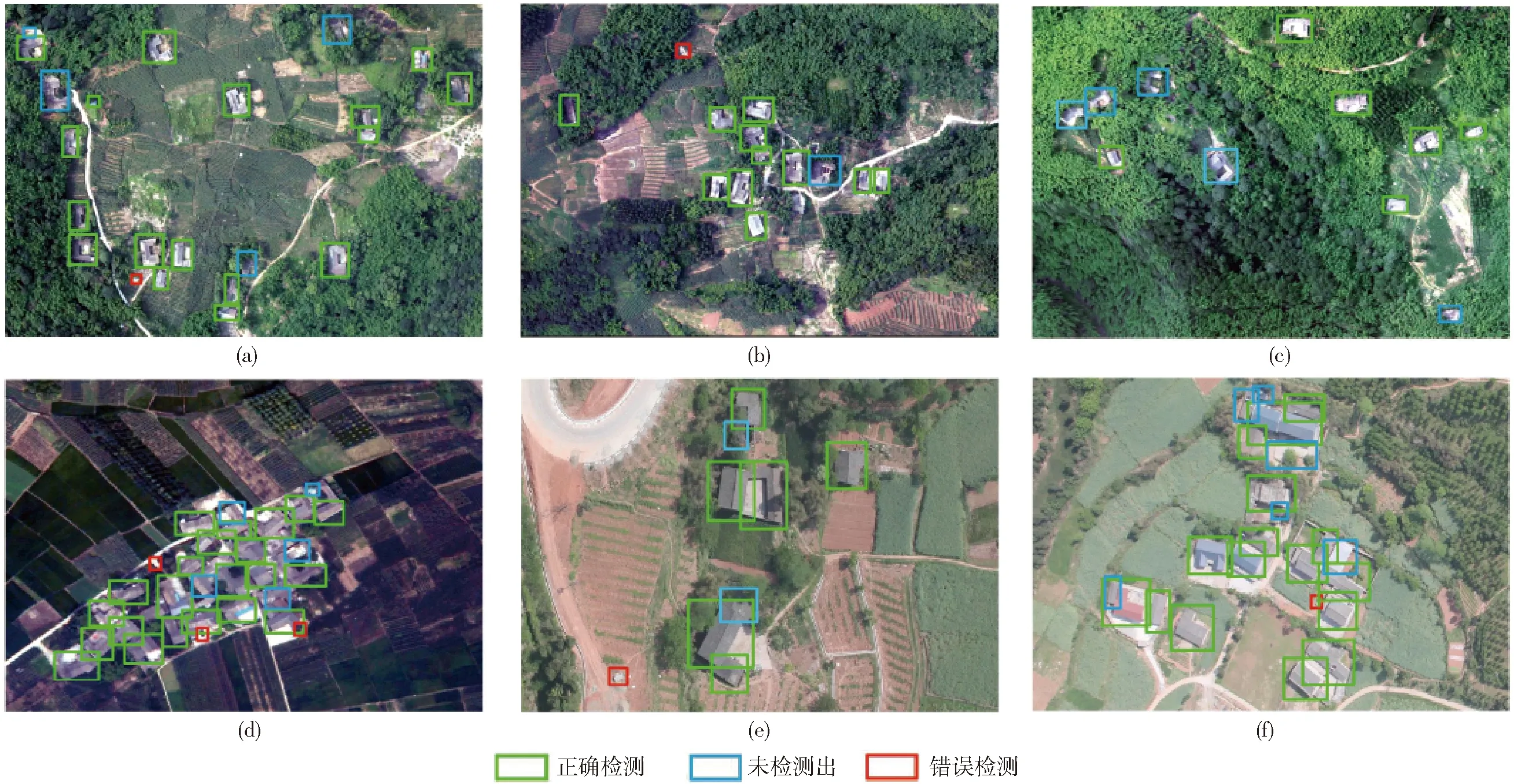

圖5 不同區域檢測結果Fig.5 Detection results of different areas

本文利用卷積神經網絡構建了建筑物檢測方法,并在未進行樣本采集的區域內進行檢測,實驗在空心村區域內選取了4個代表性的區域:地形平坦、地勢起伏較大、遮擋較嚴重以及建筑物密集區域,并另外選取了2處非空心村區域高分影像作為對比實驗,如圖4所示。

圖4 實驗區域Fig.4 Experimental areas

實驗基于Caffe框架,使用的是Intel i7 6700K CPU, 16 G內存, GeForce GTX 1080 GUPs的工作站。各個區域的檢測結果如圖5所示。

利用本文構建的建筑物檢測方法對影像進行了分區域檢測實驗。如圖5a、5b與5e所示,在地形比較平坦、建筑物無遮擋的區域可以獲得更好的檢測結果。但是對于圖5c,由于地勢起伏較大,建筑物遮擋嚴重,導致檢測效果不佳。如圖5d與5f所示,對于建筑物密集區域,檢測結果會出現重疊,不能完整地檢測出整個建筑物。本文對整個研究區域進行了分塊檢測,由統計檢測結果可知,本文所述方法的整體準確率可以達到81%,表明該方法具有較好的識別準確率。

3 結束語

基于無人機高分影像構建了建筑物樣本庫,以空心村為研究對象,利用顯著性檢驗和卷積神經網絡提出了一種適用于空心村高分影像的建筑物檢測方法。該方法可以準確高效地檢測出空心村內建筑物,對于空心村調查研究具有較高的實用價值。

1 陳玉福,孫虎,劉彥隨. 中國典型農區空心村綜合整治模式[J]. 地理學報,2010,65(6):727-735. CHEN Yufu, SUN Hu, LIU Yansui. Reconstruction models of hollowed villages in key agricultural regions of China[J]. Acta Geographica Sinica, 2010, 65(6):727-735. (in Chinese)

2 SUN H, LIU Y, XU K. Hollow villages and rural restructuring in major rural regions of China: a case study of Yucheng City, Shandong Province[J]. Chinese Geographical Science, 2011, 21(3): 354-363.

3 MAGGIORI E, TARABALKA Y, CHARPIAT G, et al. Convolutional neural networks for large-scale remote-sensing image classification [J]. IEEE Transactions on Geoscience and Remote Sensing, 2017, 55(2): 645-657.

4 ZHANG L, LI A, ZHANG Z, et al. Global and local saliency analysis for the extraction of residential areas in high-spatial-resolution remote sensing image[J]. IEEE Transactions on Geoscience and Remote Sensing, 2016, 54(7): 3750-3763.

5 史舟,梁宗正,楊媛媛,等.農業遙感研究現狀與展望[J/OL]. 農業機械學報,2015,46(2):247-260. http:∥www.j-csam.org/jcsam/ch/reader/view_abstract.aspx?flag=1&file_no=20150237&journal_id=jcsam.DOI:10.6041/j.issn.1000-1298.2015.02.037. SHI Zhou, LIANG Zongzheng, YANG Yuanyuan, et al. Status and prospect of agricultural remote sensing[J/OL]. Transactions of the Chinese Society for Agricultural Machinery, 2015, 46(2):247-260. (in Chinese)

6 LE T H A, LE H M, DINH T P. Feature selection in machine learning: an exact penalty approach using a difference of convex function algorithm[J]. Machine Learning, 2015, 101(1-3): 163-186.

7 LECUN Y, BOTTOU L, BENGIO Y, et al. Gradient-based learning applied to document recognition[J]. Proceedings of the IEEE, 1998, 86(11): 2278-2324.

8 SHIN H C, ROTH H R, GAO M, et al. Deep convolutional neural networks for computer-aided detection: CNN architectures, dataset characteristics and transfer learning[J]. IEEE Transactions on Medical Imaging, 2016, 35(5): 1285-1298.

9 何小飛,鄒崢嶸,陶超,等. 聯合顯著性和多層卷積神經網絡的高分影像場景分類[J]. 測繪學報, 2016, 45(9):1073-1080. HE Xiaofei, ZOU Zhengrong, TAO Chao, et al. Combine dsaliency with muti-convolutional neural network for high resolution remote sensing scene classification[J]. Acta Geodaetica et Cartographica Snica.,2016,45(9):1073-1080. (in Chinese)

10 TAYLOR M E, STONE P. Transfer learning for reinforcement learning domains: a survey[J]. Journal of Machine Learning Research, 2009, 10(7): 1633-1685.

11 HINTON G E, SALAKHUTDINOV R R. Reducing the dimensionality of data with neural networks[J]. Science, 2006, 313(5786): 504-507.

12 ALEXE B, DESELAERS T, FERRARI V. What is an object?[C]∥2010 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2010: 73-80.

13 HOU X, ZHANG L. Saliency detection: a spectral residual approach[C]∥2007 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2007: 1-8.

14 ZHANG Q, WANG Y, LIU Q, et al. CNN based suburban building detection using monocular high resolution Google Earth images[C]∥2016 International IEEE Geoscience and Remote Sensing Symposium (IGARSS), 2016: 661-664.

15 LAWRENCE S, GILES C L, TSOI A C, et al. Face recognition: a convolutional neural-network approach[J]. IEEE Transactions on Neural Networks, 1997, 8(1): 98-113.

16 CIRESAN D C, MEIER U, MASCI J, et al. Flexible, high performance convolutional neural networks for image classification[C]∥Proceedings of the 22nd International Joint Conference on Artificial Intelligence(IJCAI), 2011: 1-41.

17 魯恒,付蕭,賀一楠, 等.基于遷移學習的無人機影像耕地信息提取方法[J/OL].農業機械學報,2015,46(12):274-279,284.http:∥www.j-csam.org/jcsam/ch/reader/view_abstract.aspx?flag=1&file_no=20151237&journal_id=jcsam. DOI:10.6041/j.issn.1000-1298.2015.02.037. LU Heng,FU Xiao, HE Yi’nan, et al. Cultivated land information extraction from high resolution UAV images based on transfer learning[J/OL]. Transactions of the Chinese Society for Agricultural Machinery, 2015,46(12):274-279,284. (in Chinese)

18 LI Y, TAO C, TAN Y, et al. Unsupervised multilayer feature learning for satellite image scene classification [J]. IEEE Geoscience and Remote Sensing Letters, 2016, 13(2): 157-161.

19 DONAHUE J, JIA Y, VINYALS O, et al. DeCAF: a deep convolutional activation feature for generic visual recognition[C]∥Proceedings of the 31st International Conference on Machine Learning, 2014: 647-655.

20 GHAFFARIAN S. Automatic building detection based on purposive FastICA (PFICA) algorithm using monocular high resolution Google Earth images[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2014, 97: 152-159.

21 HUERTAS A, NEVATIA R. Detecting buildings in aerial images[J]. Computer Vision, Graphics, and Image Processing, 1988, 41(2): 131-152.

22 GIRSHICK R, DONAHUE J, DARRELL T, et al. Region-based convolutional networks for accurate object detection and segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2016, 38(1): 142-158.

23 CIREGAN D, MEIER U, SCHMIDHUBER J. Multi-column deep neural networks for image classification[C]∥2012 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2012: 3642-3649.

24 OQUAB M, BOTTOU L, LAPTEV I, et al. Learning and transferring mid-level image representations using convolutional neural networks[C]∥Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2014: 1717-1724.

25 YANG J, YANG F, WANG G, et al. Multi-channel and multi-scale mid-level image representation for scene classification[J]. Journal of Electronic Imaging, 2017, 26(2): 023018.

26 WEI Y, ZHAO Z, SONG J. Urban building extraction from high-resolution satellite panchromatic image using clustering and edge detection[C]∥2004 IEEE International Geoscience and Remote Sensing Symposium, 2004, 3: 2008-2010.

27 REN S, HE K, GIRSHICK R, et al. Faster R-CNN: towards real-time object detection with region proposal networks[C]∥Advances in Neural Information Processing Systems, 2015: 91-99.

28 SCHMIDHUBER J. Deep learning in neural networks: an overview[J]. Neural Networks, 2015, 61: 85-117.

29 MAAS A L, HANNUN A Y, NG A Y. Rectifier nonlinearities improve neural network acoustic models[C]∥Proceedings of the 30th International Conference on Machine Learning (ICML), 2013, 30(1):1-6.

30 JIA Y, SHELHAMER E, DONAHUE J, et al. Caffe: convolutional architecture for fast feature embedding[C]∥Proceedings of the 22nd ACM International Conference on Multimedia (ACM), 2014: 675-678.

31 KRIZHEVSKY A, SUTSKEVER I, HINTON G E. Imagenet classification with deep convolutional neural networks[C]∥Advances in Neural Information Processing Systems, 2012: 1097-1105.

32 GIRSHICK R, DONAHUE J, DARRELL T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation[C]∥Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2014: 580-587.

33 HARRINGTON P. Machine learing in action[M]. Greenwich, CT:Manning Publications, 2012:116-133.

HollowVillageBuildingDetectionMethodUsingHighResolutionRemoteSensingImageBasedonCNN

LI Zheng1LI Yongshu1WU Xi2LIU Gang3LU Heng4TANG Min5

(1.FacultyofGeosciencesandEnvironmentalEngineering,SouthwestJiaotongUniversity,Chengdu611756,China2.CenterofLandAcquisitionandConsolidationinSichuanProvince,Chengdu610041,China3.CollegeofEarthSciences,ChengduUniversityofTechnology,Chengdu610059,China4.CollegeofHydraulicandHydroelectricEngineering,SichuanUniversity,Chengdu610065,China5.ChinaRailwayEryuanEngineeringGroupCo.,Ltd.,Chengdu610031,China)

Accurately obtaining the building information in the hollow village areas is important for hollow village renovation and research. With the rapid development of remote sensing technology, remote sensing image resolution has been greatly improved and the ground targets can be obtained from high-resolution remote sensing image. But the traditional methods based on low-level hand-engineered features or mid-level features have great limitation in complex environment, especially in hollow village areas. So it needs to use high-level features to express. Convolution neural network (CNN) has become one of the important methods of ground object recognition and detection. Based on CNN, a novel automatic building detection method was proposed. Firstly, a multi-scale saliency computation was employed to extract building areas and a sliding windows approach was applied to generate candidate regions. And then a CNN was applied to classify the regions. In order to verify the validity of this method, the high resolution remote sensing image of typical hollow village was selected to construct the building sample library. Finally, the model for building interpretation was experimentally studied based on the sample library. The results showed that multi-scale saliency can effectively get the main target, weaken the impact of other unrelated targets, and reduce data redundancy. The CNN can automatically learn the high level feature, and the classification accuracy (ACC) of this method can reach 97.6%. So the proposed method can be used to detect building and it had high practical value to hollow village research and renovation.

hollow village; building detection; convolution neural network; high resolution remote sensing image; multi-scale saliency test

P231.5; TP75

A

1000-1298(2017)09-0160-06

10.6041/j.issn.1000-1298.2017.09.020

2017-01-10

2017-02-23

“十二五”國家科技支撐計劃項目(2014BAL01B04)

李政(1989—),男,博士生,主要從事遙感影像處理和圖像理解研究,E-mail: lizswjtu@163.com