基于SHVC的幀間算法研究

王忠剛

(上海海事大學 信息工程學院,上海 201306)

基于SHVC的幀間算法研究

王忠剛

(上海海事大學 信息工程學院,上海201306)

為了減小算法復雜度,針對SHVC,結合了CU分割、PU預測模式兩個方面,提出了一種快速算法。該算法在PSNR與碼率有略微變化(可忽略不計)的前提下,平均編碼時間降低了約30%~45%。并將HEVC的幀間預測技術創造性地升華到SHVC中,在一定程度上對SHVC的幀間算法研究進行了改進。根據在測試模型SHM的實驗證明,該算法可行、有效。

可伸縮視頻編碼;幀間;編碼單元;預測單元

0 引言

隨著視頻行業的迅速發展,關于視頻通信的應用越來越多,而現有的視頻服務已經不能滿足用戶的需求,網絡不穩定與終端設備多樣性問題突出。根源在于,當前采用的單層視頻編碼不具備可伸縮性能,不能與不同的網絡環境進行互動。一旦網絡環境異常就有可能造成數據包丟失,從而迫使視頻通信中斷。

對此,聯合協作組在2012年7月發出征集號召,到2012年10月共收到了20種提案, SHVC的標準最終由此確立。ITU-T于2015年4月發布了第3版;IS0/IEC也于2015年5月發布了ISO/IEC 23008-2第2版[1]。

1 SHVC介紹

1.1可伸縮視頻編碼

與單一的視頻編碼碼流不同的是,可伸縮視頻編碼碼流分為基本層(1個)和增強層(大于等于1)。這樣,便將同一視頻不同特性(如分辨率)合并在同一比特流中,可根據網絡特性隨時對碼流進行調整。基本層碼流包含了視頻通信的大部分信息,它必須被接收,視頻通信才能正常進行。在基本層被接收的前提下,視頻通信的質量與接收到的增強層數目呈正相關。根據碼流特性,可伸縮視頻編碼又可具體分為:空間、時間、質量、位深、色域以及混合編解碼器上的可伸縮[2-3]。

1.2編碼原理

SHVC(Scalable extension of High efficiency Video Coding)是HEVC的可伸縮擴展,它支持空間、時間、質量、位深、色域及混合編解碼6種可伸縮性。相鄰層之間存在著一定關系,如圖1所示,在較高層(非基本層)編解碼中使用了上一層的信息,這即是SHVC引入的層間參考預測技術(ILR)[4-6]。

圖1 SHVC三層編解碼架構

圖1是SHVC的編解碼框架,僅以三層為例。SHVC的基本層與HEVC單層編碼過程相同。增強層的處理過程與基本層不同,BL0中重構圖像經過環路濾波以后的圖像需經過上采樣,得到的圖像與增強層 EL1有相同的分辨率,被用來作為EL1層的層間參考圖像。同理,EL1中,重構圖像經過環路濾波以后的圖像需經過上采樣,得到的圖像與增強層 EL2有相同的分辨率,被用來作為EL2層的層間參考圖像。

1.3基本層與增強層的映射關系

以伸縮比例為2的空間可伸縮為例,基本層BL0的圖像是增強層EL1圖像的1/4大小。首先是CTU的對應關系。由于CTU是按照Raster順序進行的掃描,所以基本層的一個CTU中的4個32×32的CU單元對應著增強層的4個CTU。文獻[4]中唐曉麗的SHVC增強層預測單元分割模式快速選擇算法一文中有詳細介紹,在此不做贅述。

2 幀間預測算法研究

2.1幀間運動特性研究

由于運動劇烈的兩幀(比如場景切換情況下)間可借鑒的運動特性較低,不適合進行優化處理。故應先判斷當前幀與前一幀之間是否發生了劇烈運動[7-8],再決定是否進行幀間算法優化處理,具體方法是采用基于灰度的算法。灰度值平均絕對差公式:

(1)

式中,DMVD(n)為第n幀與前一幀的灰度平均絕對值差,fn(i,j)和fn-1(i,j)分別為第n幀與第n-1幀在(i,j)位置的亮度分量值,M和N分別為圖像的寬和高。DMVD(n)的取值范圍為0~255,經過大量實驗發現:DMVD(n)>42時,當前幀相對前一幀發生了劇烈運動,否則,判定沒有發生劇烈運動。

2.2相鄰兩幀對應位置的CU與PU相關性研究

由前面介紹可知:SHVC的每一層都沿用了HEVC的編解碼結構,只在增強層對HEVC修改了高級語法。不同于H.264的宏塊,SHVC使用的也是HEVC的四叉樹編碼結構,是以犧牲編解碼復雜度來換取更高的壓縮效率。在四叉樹編碼結構中,需要進行4個深度的遍歷,即由最大的編碼單元64×64到最小的8×8,而隨著深度的增加,劃分復雜度也就成倍數地增加[3-4]。

將CU分割完成后,對于每一個確定尺寸的CU又需遍歷不同的PU預測模式,而預測數目高達11個,也就是率失真代價需要計算11次,再根據率失真代價的大小選擇最優的模式進行編碼。這種過程太過復雜,如何確定CU與PU的關系,減少率失真計算的次數,將是降低算法復雜度的難點。

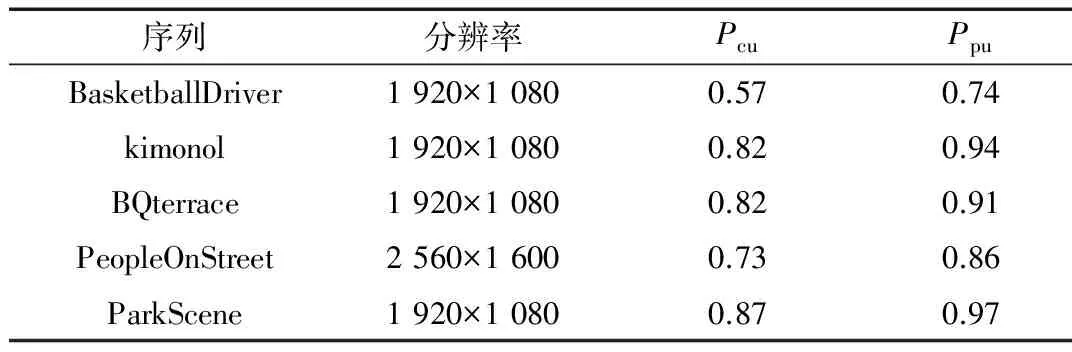

為更好地減小復雜度,本文對相鄰兩幀相同層的CU與PU的關系進行了分析,以便于減少CU分割與PU模式的選擇。在測試模型SHM9.0中分別統計了表1中5種不同分辨率和運動特性的測試序列CU與PU的相似度。為了能更直觀地描述相似性,引入了以下概念:PCU、PPU、ACU-neighbour、ACU-total、APU-neighbour、APU-total。統計是在相鄰兩幀對應層對應位置上進行的。ACU-neighbour表示相鄰幀某一層某一位置上與當前幀同一層同一位置CU相同的面積和,ACU-total表示當前幀所有的CU的總面積,APU-neighbour表示相鄰幀某一層某一位置上某一CU分割下PU模式與當前幀同一層同一位置同一CU分割模式下的面積和,APU-total表示當前幀總的PU的總面積,PCU表示當前幀與相鄰幀對應層對應位置CU相同的概率,PPU表示當前幀與相鄰幀對應層同一位置的PU分割模式完全相同的概率,具體可分別由下面公式計算獲得[5]:

(2)

(3)

統計結果如下表1所示。由表1可以計算出PCU、PPU的平均概率分別達到了0.76與0.88。也就是說,相鄰兩幀對應層對應位置CU分割模式相同的概率為0.76,相鄰兩幀對應層對應位置同一CU分割模式下,對應的PU預測模式相同的概率高達0.88。因此,可以利用這種關系,減小PU 模式選擇的復雜度。

表1 相鄰兩幀對應層對應位置 CU及PU的相似性分析

2.3CU分割的優化

考慮到相鄰幀之間同一層同一位置CU分割相同的可能性僅有0.76,還有較大可能性不同,因此,分割當前幀CU單元時不能僅參考相鄰幀間對應位置CU分割方式。考慮從相鄰幀對應層對應位置CU深度的相關性入手。本文對測試序列ParkScene、kimonol、BQterrace、PeopleOnStreet、BasketballDriver前一幀相同位置CU的深度比當前CU深度大于等于2的概率進行了統計。發現此事件的平均概率僅近似為1.8%。也就是說,分割當前幀CU時,如果參考幀對應位置 CU的深度達到了d+2并且深度d為最佳的可能性低于1.8%,可以不再進行深度d

表2 實驗參數配置表

的計算,直接計算深度為d+1即可。為保險起見,考慮當前編碼CU傾向于選擇較大的劃分塊的極端情況,它有較大的可能性采用SKIP模式,因此這種模式應該保留[9]。

綜上,針對CU分割進行如下簡化:

(1)判斷當前幀與參考幀間是否發生了劇烈運動。若沒有發生劇烈運動,進入(2),否則不適合進行幀間編碼算法的優化。

(2)進入一個CU,記其深度為d,再獲取參考幀同一位置CU的深度dref及其4個子CU的深度dsub0、dsub1、dsub2、dsub3。

(3)若dsub0、dsub1、dsub2、dsub3均大于等于d+1,則只需計算當前深度的SKIP模式并進入到下一層CU,否則進行正常的CU分割流程。

2.4PU模式選擇的優化

在CU尺寸確定后,通常采用拉格朗日率失真優化算法對PU劃分模式進行判決,代價最小者為最優劃分模式。但如果將每一種模式都進行遍歷復雜度太高。首先將PU預測模式進行分類:(1)左右結構:{nL×2N,nR×2N,N×2N};(2)上下結構:{2N×N,2N×UN,2N×DN};(3)均勻結構:{2N×2N,N×N}。當判斷沒發生劇烈運動時,在相鄰幀對應層對應位置CU分割相同的情況下PU預測相同的可能性有88%,CU分割不同時可根據相鄰兩幀之間的時域相關性及時域上的運動方向性,當對應CU的PU為左右兩部分結構(nL×2N,nR×2N,N×2N)時,說明此時當前塊中的運動對象有大于88%的概率分為左右兩部分,只需對相應PU遍歷左右部分的模式即可。為保證視頻質量,應該把2N×2N的情況也考慮進去。上下結構亦是如此[10-12]。

綜合以上,算法流程可表示如下:

(1)根據參考幀對應位置CU下的PU情況,選擇合適的PU結構模式進行遍歷,對于基本層進入步驟(3),對于增強層進入步驟(2);

(2)判斷上一層的對應位置的PU結構與步驟(1)中的結構是否一致,若一致進入步驟(3),否則再加入上一層對應的PU結構。

(3)根據PU結構模式的遍歷,計算其中率失真代價(具體為拉格朗日率失真優化算法),各個模式的率失真最小者即為最優劃分模式。

3 結果分析

本文提出的幀間與層間算法在SHM9.0下進行仿真實驗,實驗平臺為CPU 2.5 GHz、Intel Core i7、內存4 GB,操作系統為Windows 10的64位計算機,運行環境是Microsoft Visual Studio 2010,編碼結構為IPPP。試驗中參數配置如表2所示。

與SHM9.0相比,實驗結果統計于表3中。總體來看,編碼時間減少了30%~45%,而比特率增加比例與PSNR下降量可忽略不計。

表3 實驗統計結果表

4 結論

本文提出的算法綜合考慮了CU分割、PU模式選擇兩個方面因素。首先對當前幀與前一幀相比是否發生劇烈運動進行判斷,再簡化CU分割與PU模式選擇過程。算法減少了CU分割以及PU預測模式的遍歷數目。總體來看,本文提出的綜合算法編碼時間減少了約30%~45%,而PSNR與比特率變化較小,可忽略不計。說明本文結合CU分割、PU模式選擇于一身的算法可行、有效。

[1] 盧鑫,林茂六,金雪松,等.新一代可伸縮視頻編碼標準:背景、特征、技術及其應用[J].電子測量與儀器學報,2015,29(10):1415-1423.

[2] BOYCE J M,YE Y,CHEN J,et al.Overview of SHVC: scalable extensions of the high efficiency video coding standard[J].IEEE Transactions on Circuits & Systems for Video Technology,2015,26(1):1-1.

[3] BAILLEUL R,COCK J D,WALLE R V D.Fast mode decision for SNR scalability in SHVC digest of technical papers[C].IEEE International Conference on Consumer Electronics.IEEE,2014:193-194.

[4] 唐曉麗.SHVC增強層預測單元分割模式快速選擇算法[D].西安:西安電子科技大學,2014.

[5] LAUDE T,XIU X,DONG J,et al.Improved inter-layer prediction for the scalable extensions of HEVC[C].Data Compression Conference,2014:412-412.

[6] LEE H,LEE J,KANG J W,et al.Smoothed inter-layer residual prediction for SHVC[C].International Conference on ICT Convergence.IEEE,2013:604-605.

[7] KESSENTINI A,DAMAK T,AYED M A B,et al.Scalable high efficiency video coding (SHEVC) performance evaluation[C].World Congress on Information Technology and Computer Applications Congress, 2015:1-4.

[8] WALI I,KESSENTINI A,ALI B A M,et al.Scalable extension of the high efficiency video coding SHEVC performance study[C].Computer Networks and Information Security.IEEE,2015:1-4.

[9] 彭金虎,岑峰.HEVC幀間運動歸并技術的研究[J].微型機與應用,2013,32(1):40-41.

[10] 徐秋萍.HEVC快速幀間編碼技術研究[D].南京:南京郵電大學,2015.

[11] 李靜敏,楊靜.基于HEVC的快速幀間預測算法[J].電視技術,2016,40(7):1-5.

[12] 劉娟,鐘國韻,王蕾,等.基于時域相關性的快速HEVC幀間模式判決方法[J].電視技術,2014,38(13):1-6.

An inter-frame algorithm research based on SHVC

Wang Zhonggang

(College of Information Engineering,Shanghai Maritime University,Shanghai 201306,China)

To reduce the high complexity in SHVC ,the paper proposes a fast method which does some optimization in the division of CU and the choice of PU mode.On the premise of guaranteeing the quality of the video,the average of encoding time decreases by about 30%~45%.And the technology of the inter-frame prediction based on HEVC is creatively used in the SHVC.To a certain extent,it improves the inter-frame algorithm based on SHVC.The results show that the proposed algorithm is feasible and effective.

SHVC; inter-frame; CU; PU

TN919

A

10.19358/j.issn.1674-7720.2017.21.011

王忠剛.基于SHVC的幀間算法研究J.微型機與應用,2017,36(21):35-38.

2017-04-15)

王忠剛(1991-),男,碩士研究生,主要研究方向:SHVC的幀間算法研究。