基于HALCON的機器人運動空間中心點攝像機標定方法

,,

(安徽工程大學 電氣工程學院,安徽 蕪湖 241000)

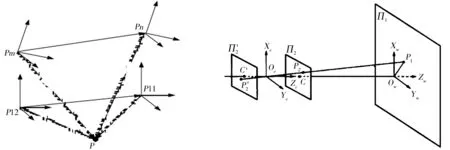

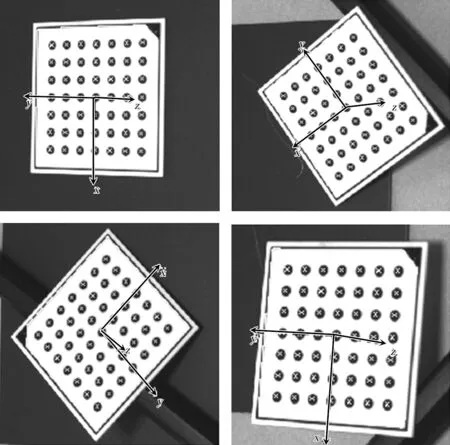

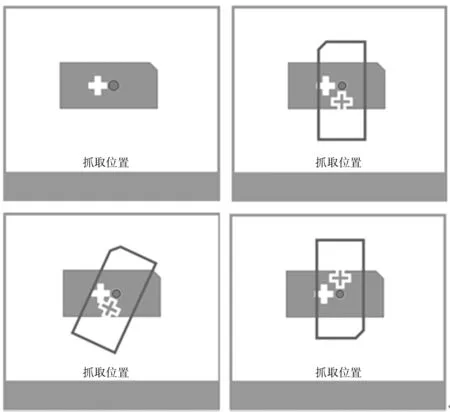

視覺是人類獲取外界信息的重要途徑,擁有視覺的生物能夠讓他們的生活變得更方便,同樣擁有視覺的機器人可以定位出空間物體的信息,并方便抓取[1].目前,在需要對產品進行搬運與裝配的自動化生產流水線上,大部分機器人僅能在預先編程好的程序和專門的環境下工作,缺乏對周圍環境的判斷,因而無法及時應變,因此極大地限制了機器人的應用.隨著各類新型傳感器技術的日益發展,為了滿足在工業上的生產需求,讓工業機器人發揮更大的作用[2].搭載了類似人類的視覺系統,讓機器人更加的智能化,可以實現部分人類視覺的功能.而這種視覺引導的工業機器人利用視覺傳感器采集圖像,并且利用算法進行圖像處理以獲得空間定位的數據,實現了對三維空間的坐標定位并進行路徑地圖規劃,最終實現了工業生產流水線的搬運與裝配[3-4].而在實際生產流水線工作的時候,為了得到空間幾何信息與采集圖像之間的對應關系,視覺機器人在不同位勢下采集圖像,需要對攝像機進行標定[5-6].傳統的攝像機標定方法存在一定的缺陷,必須在特定的環境和已知的參照物下才能標定.比如文獻[7]提出的確定模板上點陣的物理坐標以及圖像和模板之間的點的匹配來實現標定求取內外參數;Tsai[8]等提出的線性模型攝像機的外參數和焦距標定方法等.隨著標定技術研究的不斷發展,其多用點、線、圓弧等基本特征來進行標定且自身參數之間相互約束,因而更為靈活.如文獻[9]提出的一種特殊的平移運動方式完成自標定;文獻[10]提出的另一種特殊的旋轉運動方式確定的一種自標定等.結合各種標定方法的文獻,研究中提出的基于HALCON的機器人運動空間中心點攝像機標定方法,便是通過點特征來進行標定的,機器人攜帶攝像機在工作空間中進行圖片采集,圖像采集結果如圖1所示.設其重合空間內某一點為中心點,利用HALCON進行視覺圖像處理,對攝像機采集到的照片進行分析,它在視覺軟件開發成本和周期上均具有很大的優勢,且具有靈活的架構[11].

1 針孔模型

圖像是空間物體幾何信息通過攝像機模型在二維成像平面的反映[12].針孔模型是最常被使用的經典模型,空間中的物體通過孔投射到成像平面,形成倒立的實像,稱為針孔模型[13],如圖2所示.設光線延長線與Z軸平行,原點為光軸中心,以指向目標點為正方向建立坐標系P1(x1,y1,z1),P2(x2,y2,z2)得:

(1)

式中,f是攝像機的焦距,f=z2.

圖1 圖像采集結果圖2 針孔模型

2 攝像機參數的求取

2.1 攝像機內參數的求取

由式(1)相似原理知,設空間中幾何坐標系的點投影到圖像平面上坐標系的坐標為(u,v),與成像平面的交點記為(u0,v0),它們之間的關系為:

(2)

即:

(3)

轉換成矩陣形式為:

(4)

2.2 攝像機外參數的求取

如圖2所示,由上面推導可知,空間中幾何坐標系的點與成像坐標系的變換關系為:

(5)

3 中心點攝像機標定方法

在攝像機視場內,機器人做特定的平移和旋轉運動,調節機器人的不同位勢采集圖像,至少采集3組圖像,并記錄3組末端姿態.根據圖像軟件處理,將目標重合空間內的某一點設為中心點,在中心點平面上建立世界坐標系,以其法線方向作為z軸.所以zw=0.

由式(4)、式(5)得:

(6)

式中,ud=u-u0;vd=v-v0;

將式(6)展開消去zc,得:

(7)

提取標定點,通過最小二乘法可以求得[h11,h12,h14,h24,h31,h32]T.

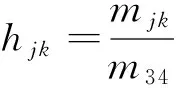

因為‖m33‖=1,m1·m3=0和m2·m3=0得:

(8)

(9)

ax3+bx3+cx+d=0,

(10)

式中,

由以上各式得:

(11)

(12)

利用數值計算方法容易獲得式(10)的解,其中至少有一個正實根xr.對其開平方可以求出m34,然后通過式(8)分別求出m12、m23和m33,其中m33的符號根據h11和h22確定.由式(9)可以求出kx和ky,然后利用式(12)求出其他參數,獲得外參矩陣.

4 HALCON的標定實驗

HALCON是德國 MVtec 公司開發的圖像處理軟件,它具有完善的綜合標準軟件庫和機器視覺集成開發環境.HALCON 提供了豐富的函數庫 ,包括 blob 分析 、形態學 、模式匹配、 測量、 三維目標識別和立體視覺等. 它支持Windows,Linux 和 Solaris 操作環境 , 整個函數庫可以用C,C++,C#,Visual Basic 和 Delphi 等多種普通編程語言開發,有效提高了開發效率,并且執行速度快,具有良好的跨平臺移植性.

為了讓視覺搬運機器人在工作時定位更加準確,必須建立空間中物體與所采集圖像之間點的存在關系,因此必須對攝像機進行標定.在空間中放置一個已知信息的平板即標定板[13],使用的是制作的30 mm*30 mm標定板.通過HALCON算子gen_caltab來制作一個標定板.

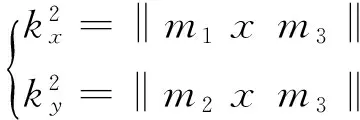

4.1 標定板的制作

在機器視覺定位、搬運等應用中,為了得到空間中物體與其采集圖像中對應點之間的關系,進行攝像機標定,由攝像機模型計算得到高精度的測量和定位結果.在HALCON中自帶算子gen_caltab(::XNum,YNum,MarkDist,DiameterRatio,CalTabDescrFile,CalTabPSFile:)方便自己動手制作一個合適的標定版,如圖3所示.

XNum為每行黑色圓點的個數.YNum為每列黑色圓點的個數.MarkDist為相鄰黑色圓點的中心距.DiameterRatio為圓點的直徑和圓點之間圓心距的比值.CalTabDescrFile為標定板描述文件的文件路徑(.descr).CalTabPSFile為標定板圖像文件的文件路徑(.ps).使用制作的標定板標定其參數如下:gen_caltab(7,7,0.003 75,0.5,'D:/30_30.descr','D:/30_30.ps').

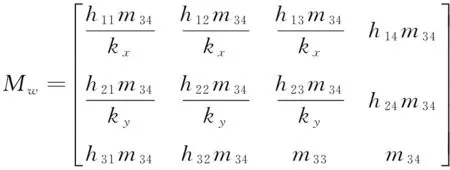

4.2 基于HALCON的標定

在實際生產應用中,視覺引導機器人分為Eye-In-Hand或者Eye-To-Hand兩種常用方式.而研究中所使用的是攝像機與機器人分開固定的另一種安裝方式,即Eye-To-Hand手眼標定,攝像機固定不動,由機器人運動完成任務.在標定時機器人將制作好的標定板夾持在適當的位置,在不同的位勢下對標定版進行圖像采集,其標定流程圖如圖4所示.

圖3 30 mm*30 mm標定版圖4 標定流程圖

在進行攝像機標定時,采集圖像的個數和標定的精度成正比關系,理論上所采集的圖片越多越好,所選圖像中標定板的位置必須能覆蓋所需標定圖像的4個角.在實驗中通過HALCON軟件處理的部分圖像的拍攝效果及標定如圖5所示.

圖5 標定效果

5 實驗結果及分析

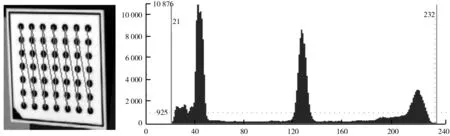

在實驗室里,利用HALCON中的Calibration助手進行攝像機的標定,選擇加載圖像文件中上述制作的標定板,刪除加載失敗的采集圖片進行標定.對標定板圖像進行特征處理,在其特定的區域內抓取輪廓范圍,分析其灰度,確定標定版的邊界轉化為XLD輪廓如圖6所示.通過HALCON軟件對其特征圖進行處理,其直方圖如圖7所示.

圖6 輪廓圖圖7 灰度直方圖

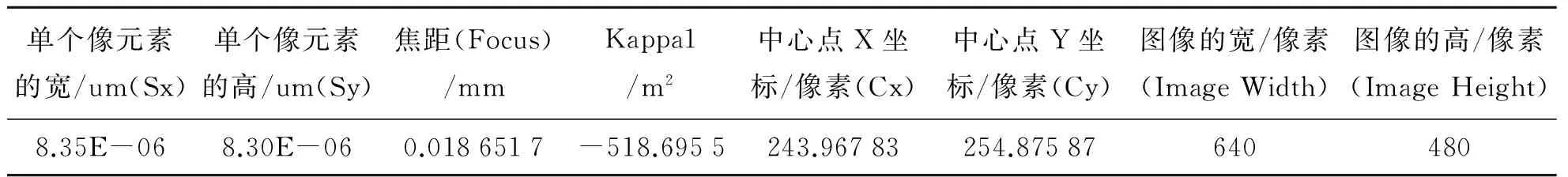

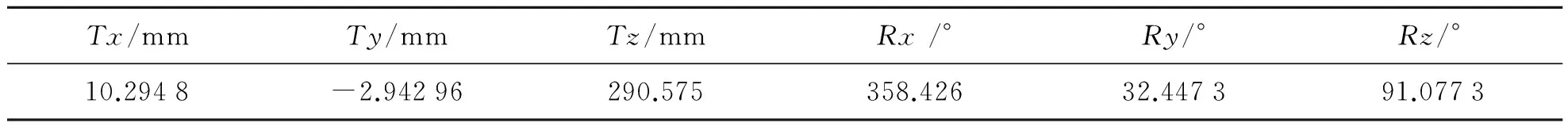

因為每個攝像機本身的物理屬性不同,在攝像機標定完成后,攝像機的參數也不再變化,相機也不可移動,否則需要重新標定.實驗標定的攝像機參數結果如表1所示,標定后攝像機的位勢如表2所示.

表1 標定后攝像機參數

表2 標定后攝像機的位勢

為了驗證標定的準確性,在標定機器人視覺系統后,現場進行實際測試,測試圖如圖8所示.

圖8 標定測試圖

采用校驗點真實的世界坐標,即機器人坐標和利用標定后參數所求得的坐標之差的平均值作為標定精度的度量參數.

(13)

分別計算橫坐標Tx=10.655 8 mm, 縱坐標Ty=-2.851 29 mm.又因為ABB機器人的XY軸坐標精度為0.01 mm, 研究中采用的攝像機有500萬像素精度,測量精度理論值為0.01 mm, 所以可得標定精度在一個像素范圍內, 且精度較高.

另外計算得橫坐標最大差值為0.361 mm, 縱坐標最大差值為0.143 mm, 橫坐標差值的標準差為0.128 mm, 縱坐標標準差為0.049 mm.因為標準差可以表征測量系統的不確定度, 因此橫縱坐標的不確定度都在一個像素范圍內, 且精度較好.

6 結論

機器視覺結合機器人在搬運行業的應用,打開了工業機器人逐步智能化的開端.而視覺的定位、識別等離不開攝像機的標定,其標定的結果影響著整個系統的精度,所以只有做好攝像機的標定才能進行后續的工作.研究中提出的中心點攝像機標定方法,利用HALCON軟件對視覺搬運機器人的標定方法進行了研究,其標定結果精確、運算率高、操作簡單,具有良好的實用性.

[1] 潘武.基于機器視覺的工件的識別和定位[D].北京:北京化工大學,2012.

[2] 王殿君.雙目視覺在移動機器人定位中的應用[J].中國機械工程,2013,24(9):1 155-1 158.

[3] 劉維.基于雙目立體視覺的物體深度信息提取系統研究[D].長沙:中南大學,2009.

[4] 吳躍民,劉榮,董代.用于光電子器件對準的顯微立體視覺系統及其標定方法研究[J].中國機械工程,2005,16(14):1 235-1 239.

[5] 羅晨,朱利民,丁漢.標定模板與圖像平面平行時的攝像機標定方法[J].中國機械工程,2005,16(17):1 558-1 560.

[6] 張世輝,郭翠翠.一種新的基于并聯機構的攝像機線性標定方法[J].中國機械工程,2009,20(14):1 651-1 655.

[7] Z ZHANG.A Flexible new technique for camera calibration[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2000,22(11):1 330-1 334.

[8] R Y TSAI.A versatile camera calibration technique for high-accuracy 3D machine vision metrology using off-the-shelf cameras and lens[J].IEEE Transactions on Robotics and Automation,1987,3(4):323-344.

[9] S D MA.A self-calibration technique for active system[J].IEEE Transaction on Robotics and Automation,1996, 12(1):114-120.

[10] R HARTLEY.Self-calibration of stationary cameras[J].International Journal of Computer Vision,1997,229(1):2-5.

[11] 羅珍茜,薛雷.基于HALCON的攝像機標定[J].電視技術,2010,34(4):100-102.

[12] Z ZHANG.A flexible new technique for camera calibration[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2000,22(11):1 330-1 334.

[13] 解則曉,程傳景,金明.基于共面法的視覺傳感器的標定方法[J].中國機械工程,2006,17(16):1 690-1 693.