COPLIP新模型及其圖像增強(qiáng)新算法

馮玉穎, 王俊平, 馬塾亮, 李 超, 伍 堯

(西安電子科技大學(xué) 通信工程學(xué)院,陜西 西安 710071)

COPLIP新模型及其圖像增強(qiáng)新算法

馮玉穎, 王俊平, 馬塾亮, 李 超, 伍 堯

(西安電子科技大學(xué) 通信工程學(xué)院,陜西 西安 710071)

針對(duì)現(xiàn)有對(duì)數(shù)模型在彩色圖像領(lǐng)域的瓶頸問(wèn)題,把帶參數(shù)的對(duì)數(shù)模型擴(kuò)展到彩色圖像,提出一種帶參數(shù)的彩色對(duì)數(shù)圖像處理新模型,定義了新模型的彩色色調(diào)函數(shù),加、數(shù)乘、取反運(yùn)算和基本同態(tài)函數(shù).為了驗(yàn)證其有效性,設(shè)計(jì)了基于新模型的圖像增強(qiáng)新算法,色調(diào)函數(shù)的評(píng)價(jià)結(jié)果表明,新模型在圖像增強(qiáng)上具有更好的效果,與人類(lèi)的視覺(jué)模型更加匹配,能選取更多的參數(shù)來(lái)調(diào)整圖像中感興趣的部分.

對(duì)數(shù)模型;帶參數(shù)的彩色對(duì)數(shù)圖像處理;彩色圖像;圖像增強(qiáng)

對(duì)數(shù)圖像處理模型能更好地處理圖像細(xì)節(jié),突出圖像中人們感興趣區(qū)域,一直是研究的熱點(diǎn),如對(duì)數(shù)圖像處理(Logarithmic Image Processing,LIP),一般對(duì)數(shù)圖像處理(Generalized LIP,GLIP),參數(shù)對(duì)數(shù)圖像處理(Parameterized LIP,PLIP),同質(zhì)對(duì)數(shù)圖像處理(Homomorphic LIP,HLIP),對(duì)稱(chēng)對(duì)數(shù)圖像處理(Symmetric LIP,SLIP),參數(shù)對(duì)稱(chēng)的對(duì)數(shù)圖像處理(Parameterized SLIP,PSLIP)模型的提出與應(yīng)用[1-6].近年來(lái),研究者進(jìn)行了更深入的研究[7-12],其中,文獻(xiàn)[7]把PLIP模型同高斯拉普拉斯濾波結(jié)合來(lái)增強(qiáng)胸透圖像中的肺結(jié)節(jié),從而檢測(cè)肺部是否有癌變; 文獻(xiàn)[8]結(jié)合GLIP模型與SLIP模型,提出了SGLIP模型; 文獻(xiàn)[9]基于LIP模型和小波變換,提出了對(duì)數(shù)小波變換來(lái)進(jìn)行邊緣檢測(cè)和圖像再現(xiàn);文獻(xiàn)[10]介紹了一種遠(yuǎn)程遙感圖像的增強(qiáng)方法,該方法結(jié)合非下采樣剪切波變換和PLIP模型來(lái)改善遠(yuǎn)程遙感圖像的視覺(jué)效果;文獻(xiàn)[11]運(yùn)用SLIP模型提出了廣義的伽馬校正算法,然后對(duì)整體或局部低對(duì)比度圖像進(jìn)行增強(qiáng).

然而,以上應(yīng)用都是基于灰度對(duì)數(shù)模型的研究,對(duì)于彩色圖像的對(duì)數(shù)研究還有待發(fā)展.文獻(xiàn)[13]提出了彩色對(duì)數(shù)圖像處理(Color Logarithmic Image Processing,CoLIP) 模型,并把它應(yīng)用到白色平衡修正,但是該模型只是把最簡(jiǎn)單的LIP模型擴(kuò)展到彩色圖像上,只采用了一個(gè)固定值來(lái)調(diào)整圖像,有一定的局限性.

筆者提出一種帶參數(shù)的彩色對(duì)數(shù)圖像處理(COlor Parameterized Logarithmic Image Processing, COPLIP)新模型.新模型保護(hù)了彩色圖像的原有彩色信息成分,定義了彩色色調(diào)函數(shù),色調(diào)函數(shù)的加、數(shù)乘、取反矢量運(yùn)算以及彩色同態(tài)函數(shù).新模型把彩色圖像作為三維矢量來(lái)處理,既能夠與人類(lèi)的視覺(jué)模型相匹配,還可以選取更多的參數(shù)來(lái)調(diào)整圖像,并且在圖像增強(qiáng)上有很好的處理結(jié)果.

1 PLIP模型

PLIP模型[3]的基本同態(tài)函數(shù)為

φ(g)=-λ(N) lnβ(1-g/λ(N)) ,

(1)

其中,灰度值g定義在[0,N)的范圍內(nèi),N是正常數(shù).λ(N)為AN+B的函數(shù),A,B為常數(shù).

PLIP模型中灰度色調(diào)函數(shù)定義為

f=λ(N)-F,g=λ(N)-G,

(2)

其中,F(xiàn)和G分別表示兩幅圖像的灰度值.

PLIP模型的3種向量運(yùn)算:

加法: 灰度色調(diào)函數(shù)f和g的對(duì)數(shù)加定義為

f?g=f+g-fg/λ(N) ,

(3)

減法: 灰度色調(diào)函數(shù)f和g的對(duì)數(shù)減定義為

f?g=λ(N)(f-g)/(λ(N)-g+ε) ,

(4)

其中,ε是很小常數(shù).

乘法: 灰度色調(diào)函數(shù)f和標(biāo)量μ的對(duì)數(shù)乘定義為

μ?f=λ(N)-λ(N)(1-f/λ(N))μ.

(5)

該模型僅能應(yīng)用到灰度圖像上.

2 COPLIP新模型

2.1 彩色RGB空間轉(zhuǎn)化為符合人類(lèi)視覺(jué)的a-rg-yb空間

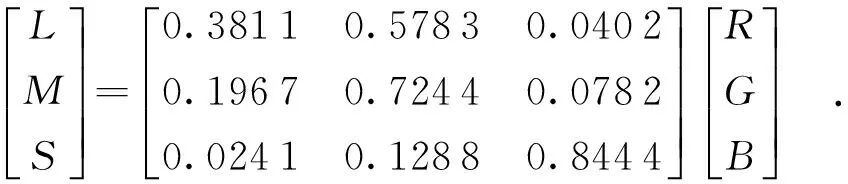

人類(lèi)視網(wǎng)膜上有3種感光細(xì)胞,又稱(chēng)錐體細(xì)胞,能大量吸收短波光線(xiàn)的錐體叫S錐體,能較多吸收中波、長(zhǎng)波光線(xiàn)的錐體叫M和L錐體[13].(L,M,S)空間是符合人類(lèi)視覺(jué)的顏色空間,可以轉(zhuǎn)換為a-rg-yb空間,而別的顏色空間并不適用于新模型.因此,首先將彩色圖像的RGB空間轉(zhuǎn)換為L(zhǎng)MS空間

(6)

彩色色調(diào)(l,m,s)與LMS空間中的錐體細(xì)胞強(qiáng)度(L,M,S)的關(guān)系:

c=N-C,

(7)

其中,C∈{L,M,S},c∈{l,m,s},在數(shù)字圖像處理中,對(duì)于 8 bit 圖像N取值為255.彩色色調(diào)的取值范圍是[0,N)3.把PLIP的基本同態(tài)函數(shù)應(yīng)用到式(7),得到

c′=φc(c)=-λ(N) lnβ(1-c/(λ(N))) ,

(8)

(11)

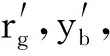

由文獻(xiàn)[13],可將參數(shù)矩陣PCOPLIP取值為

(12)

(13)

2.2 COPLIP彩色色調(diào)函數(shù)的定義

COPLIP彩色色調(diào)函數(shù)的定義為

(14)

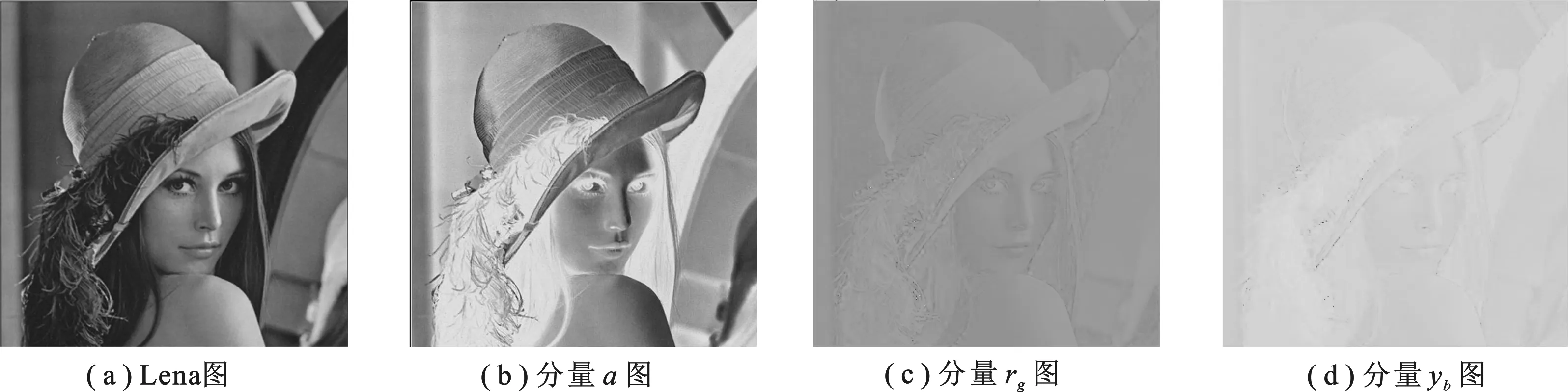

其中,f(x,y)的3個(gè)分量由錐形體強(qiáng)度(L,M,S)映射得到.圖1表示了Lena圖的彩色色調(diào)函數(shù)的3個(gè)分量.

圖1 彩色圖像色調(diào)函數(shù)分量argyb

2.3 COPLIP色調(diào)函數(shù)的運(yùn)算

文中定義了COPLIP色調(diào)函數(shù)的3種運(yùn)算: 加法、數(shù)乘、取反.其中,加法和數(shù)乘對(duì)于任何實(shí)數(shù)都成立,取反運(yùn)算中,當(dāng)且僅當(dāng)a≠λ(N)、rg≠λ(N)且yb≠λ(N)時(shí)運(yùn)算成立.圖2采用了經(jīng)典的Lena圖和24色卡(色彩測(cè)試標(biāo)準(zhǔn)板)對(duì)3種運(yùn)算進(jìn)行測(cè)試,有效地驗(yàn)證了運(yùn)算的可行性.

圖2 圖像進(jìn)行COPLIP對(duì)數(shù)運(yùn)算的結(jié)果

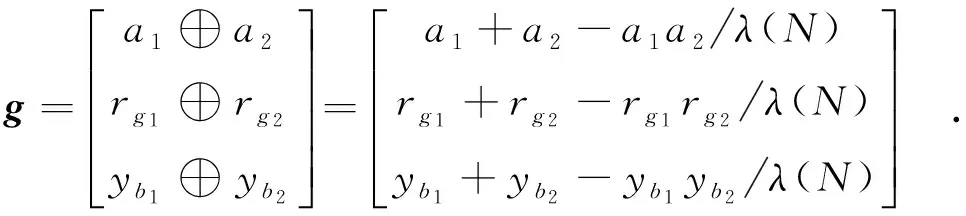

對(duì)于兩幅彩色圖像,彩色色調(diào)函數(shù)f和g的對(duì)數(shù)加定義為

(15)

標(biāo)量μ乘以彩色色調(diào)函數(shù)f,定義為

(16)

彩色色調(diào)函數(shù)f進(jìn)行取反,定義為

(17)

2.4 COPLIP模型的基本同態(tài)函數(shù)

COPLIP模型的基本同態(tài)函數(shù)為

φ(f)=-λ(N) lnβ(|1-f/λ(N)|) ,

(18)

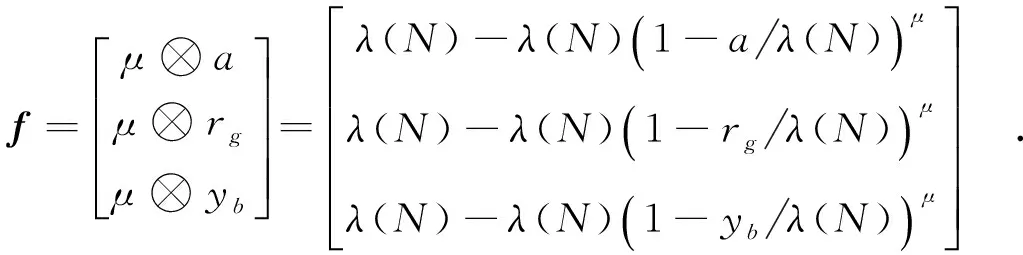

其中,參數(shù)β可以對(duì)同態(tài)函數(shù)進(jìn)行更精細(xì)的微調(diào),較小β可以將靈敏度調(diào)節(jié)至像素強(qiáng)度范圍的最暗一端,較大β將其調(diào)節(jié)至最亮的一端,這樣可以更好地模擬人眼在不同光照強(qiáng)度下的可變響應(yīng),參照文獻(xiàn)[3],筆者選取β值為1.2.彩色色調(diào)函數(shù)f的取值范圍是 (-∞,N)3,即f的3個(gè)分量a,rg,yb的取值范圍均為 (-∞,N),因此a,rg,yb的基本同態(tài)函數(shù)圖形是一致的.文中只列出了一個(gè)分量的同態(tài)函數(shù)圖形來(lái)說(shuō)明問(wèn)題.圖3比較了λ(N)取不同值時(shí)COPLIP、PLIP模型基本同態(tài)函數(shù)的圖形.可以看出,新模型具有以下特點(diǎn):

(1) COPLIP模型解決了PLIP模型不能處理圖像負(fù)值信息的缺點(diǎn);

(2) 當(dāng)λ(N)=N時(shí),COPLIP模型即變?yōu)榱薈OLIP模型;

(3) 相比于COLIP模型,COPLIP模型可以選擇更多的λ(N)的值來(lái)獲取視覺(jué)愉悅的圖像;

(4)λ(N)越大,COPLIP基本同態(tài)函數(shù)越趨近于直線(xiàn);

(5) 當(dāng)λ(N)<255時(shí): 若f<λ(N),則φ(f)隨著f的增大而增大;若f>λ(N),則φ(f)隨著f的增大而減小.

當(dāng)λ(N)<255時(shí),在f=λ(N)的點(diǎn)處,同態(tài)函數(shù)取值為無(wú)窮大,同態(tài)函數(shù)不是連續(xù)的函數(shù),因此在現(xiàn)實(shí)應(yīng)用中,λ(N)的取值應(yīng)大于255.

圖3 COPLIP模型和PLIP模型基本同態(tài)函數(shù)比較

3 基于COPLIP模型的圖像增強(qiáng)

為了證明COPLIP模型的有效性,將該模型應(yīng)用于圖像增強(qiáng)中.增強(qiáng)算法步驟如下:

步驟1 輸入一幅真彩色圖像,通過(guò)式(6)將RGB彩色空間轉(zhuǎn)換為L(zhǎng)MS彩色空間.

步驟2 利用式(7)將上述轉(zhuǎn)化的LMS的彩色空間分量L、M、S轉(zhuǎn)化為l、m、s分量.

步驟3 利用式(13)將l、m、s分量轉(zhuǎn)化為a、rg、yb,即得到圖像的COPLIP色調(diào)函數(shù)的3個(gè)分量.

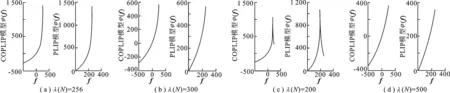

由步驟3得到了彩色圖像的3個(gè)通道a、rg、yb,由于a表示非彩色通道,rg表示紅綠通道,yb表示黃藍(lán)通道,因此,對(duì)于發(fā)黃圖像,減少yb的值,使其黃色信息減少; 對(duì)于發(fā)紅圖像,減少rg的值,使其紅色信息減少.實(shí)驗(yàn)中,隨機(jī)選取百度圖片中有顏色偏差的圖像進(jìn)行COLIP、COPLIP增強(qiáng)(參數(shù)N隨機(jī)取值為300)、PSLIP增強(qiáng)的對(duì)比分析如圖4所示.圖4(a)為原始圖,經(jīng)過(guò)COLIP圖像增強(qiáng)的結(jié)果為圖4(b),經(jīng)過(guò)COPLIP圖像增強(qiáng)的結(jié)果為圖4(c),經(jīng)過(guò)PSLIP圖像增強(qiáng)的結(jié)果為圖4(d).

圖4 COPLIP圖像增強(qiáng)

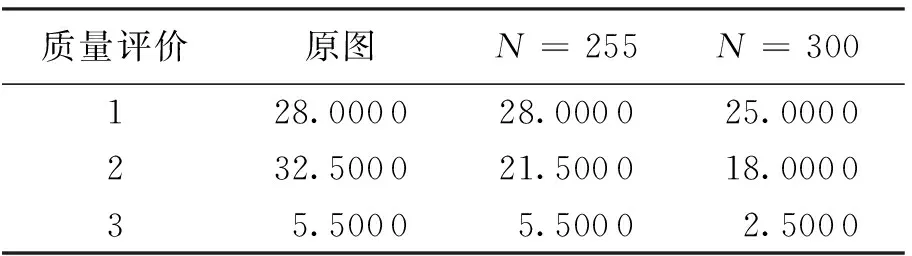

質(zhì)量評(píng)價(jià)原圖N=255N=300128.000028.000025.0000232.500021.500018.000035.50005.50002.5000

從主觀來(lái)看,PSLIP增強(qiáng)算法僅提升了圖像的整體對(duì)比度,不能解決圖像色彩偏差的問(wèn)題;COPLIP模型有效地減少了圖像多余的彩色信息,并恢復(fù)出圖像原有的色彩;處理后,圖像的對(duì)比度更強(qiáng),顏色更加自然.由于主觀評(píng)價(jià)受到個(gè)人因素影響,因此又從客觀方面增加了圖像處理效果的評(píng)價(jià).文中采用文獻(xiàn)[14]的EGRNN-BIQA無(wú)參考圖像質(zhì)量評(píng)價(jià)方法對(duì)圖4進(jìn)行質(zhì)量評(píng)估,使用LIVE的IQA數(shù)據(jù)庫(kù)Release2進(jìn)行了測(cè)試[14],圖像的質(zhì)量評(píng)價(jià)結(jié)果見(jiàn)表1.

由此可得,文中方法所得分?jǐn)?shù)最小(分?jǐn)?shù)越小,圖像質(zhì)量越高),因此該方法性能更優(yōu); COLIP模型就是COPLIP中參數(shù)N取值為255的一個(gè)特例,雖然主觀上COLIP有一定的增強(qiáng)效果,但是客觀上部分處理后的圖像與原圖的分?jǐn)?shù)一致,表現(xiàn)出COLIP模型的局限性;相比COLIP模型,COPLIP模型能選取更多的參數(shù)來(lái)獲得高質(zhì)量的圖像,在現(xiàn)實(shí)應(yīng)用中,可以根據(jù)自己的需要選擇參數(shù).同時(shí),再次選擇20幅有顏色偏差的圖像進(jìn)行以上實(shí)驗(yàn),能夠得到相似結(jié)論.綜上所述,說(shuō)明了COPLIP增強(qiáng)算法可以通過(guò)調(diào)節(jié)相關(guān)參數(shù)來(lái)獲得使人視覺(jué)愉悅的圖像效果.

4 結(jié) 束 語(yǔ)

筆者提出一種帶參數(shù)的彩色對(duì)數(shù)圖像處理COPLIP新模型,該模型解決了彩色圖像的對(duì)數(shù)模型處理難題.新模型不僅能夠選取更多的參數(shù)來(lái)調(diào)整圖像中感興趣的部分,而且能夠與人類(lèi)的視覺(jué)模型相匹配.在圖像增強(qiáng)中的應(yīng)用表明了COPLIP模型的有效性,如何將COPLIP模型應(yīng)用于圖像邊緣檢測(cè)等方面將是后續(xù)研究的主要方向.

參考文獻(xiàn):

[1] 張廣燕. 對(duì)數(shù)圖像處理新模型及其應(yīng)用研究[D]. 西安: 西安電子科技大學(xué), 2014.

[2] DENG G. A Generalized Logarithmic Image Processing Model Based on the Gigavision Sensor Model[J]. IEEE Transactions on Image Processing, 2012, 21(3): 1406-1414.

[3] PANETTA K, AGAIAN S, ZHOU Y, et al. Parameterized Logarithmic Framework for Image Enhancement[J]. IEEE Transactions on Systems, Man, and Cybernetics. Part B: Cybernetics, 2011, 41(2): 460-473.

[4] PATRASCU V. Rough Sets on Four-valued Fuzzy Approximation Space[C]//Proceedings of the IEEE International Conference on Fuzzy Systems. Piscataway: IEEE, 2007: 4295368.

[5] 張廣燕, 王俊平, 汪松, 等. 一種SLIP模型的圖像增強(qiáng)新算法[J]. 西安電子科技大學(xué)學(xué)報(bào), 2014, 41(1):105-109.

ZHANG Guangyan, WANG Junping, WANG Song, et al. New Image Enhancement Algorithm of SLIP Model[J]. Journal of Xidian University, 2014, 41(1):105-109.

[6] 張廣燕, 王俊平, 邢潤(rùn)森, 等. PSLIP新模型及在邊緣檢測(cè)和圖像增強(qiáng)中的應(yīng)用[J]. 電子學(xué)報(bào), 2015, 43(2): 377-382.

ZHANG Guangyan, WANG Junping, XING Runsen, et al. A New PSLIP Model and Its Application in Edge Detection and Image Enhancement[J]. Acta Electronica Sinica, 2015, 43(2): 377-382.

[7] CHEN S, YAO L P, CHEN B. A Parameterized Logarithmic Image Processing Method with Laplacian of Gaussian Filtering for Lung Nodule Enhancement in Chest Radiographs[J]. Medical and Biological Engineering and Computing, 2016, 54(11): 1793-1806.

[8] DENG G. The Symmetric Generalized LIP Model and Its Application in Dynamic Range Enhancement[J]. Journal of Mathematical Imaging and Vision, 2016, 55(3): 253-265.

[9] TU G J, Karstoft H. Logarithmic Dyadic Wavelet Transform with Its Applications in Edge Detection and Reconstruction[J]. Applied Soft Computing, 2015, 26: 193-201.

[10] TAO F X, WU Y Q. Remote Sensing Image Enhancement Based on Non-subsampled Shearlet Transform and Parameterized Logarithmic Image Processing Model[J]. Acta Geodaetica et Cartographica Sinica, 2015, 44(8): 884-892.

[11] DENG G. A Generalized Gamma Correction Algorithm Based on the SLIP Model[J]. Eurasip Journal on Advances in Signal Processing, 2016, 2016(1): 1-15.

[12] KIM Y C, KIM Y M, KIM S G, et al. Development of the Mechenical System and Vision Algorithm for the External Appearance Test Using Vision Image Processing[J]. Journal of the Korea Academia-industrial Cooperation Society 2016, 17(2):202-208.

[13] GOUINAUD H, GAVET Y, DEBAYLE J, et al. Color Correction in the Framework of Color Logarithmic Image Processing[C]//Proceedings of the 7th International Symposium on Image and Signal Processing and Analysis. Piscataway: IEEE, 2011: 129-133.

[14] 王俊平, 李超, 陳偉華. 基于圖像非平坦區(qū)域DCT特性和EGRNN的盲圖像質(zhì)量評(píng)價(jià)[J]. 計(jì)算機(jī)學(xué)報(bào), 2016, 39(83):1-18.

WANG Junping, LI Chao, CHEN Weihua. Blind Image Quality Assessment Based on DCT Features in the Non-flat Region and EGRNN[J]. Chinese Journal of Computers, 2016, 39(83):1-18.

NewCOPLIPmodelanditsimageenhancementalgorithm

FENGYuying,WANGJunping,MAShuliang,LIChao,WUYao

(School of Telecommunications Engineering, Xidian Univ., Xi’an 710071, China)

This paper proposes a new model of color parameterized logarithmic image processing (COPLIP), in view of the existing logarithmic bottleneck in the field of the color image processing model, extending the parameters of the logarithmic model to color images. The color tonal function of color images, operations of addition, multiplication and invertion and the concept of fundamental homomorphism function are defined. In order to verify the validity of the COPLIP model, this paper designs an image enhancement algorithm based on the model with a good effect. Experiments show that the new model proposed in this paper can not only match the human visual model, but also select more parameters to get the interested parts in the image.

logarithmic model; color parameterized logarithmic image processing; color images; image enhancement

2016-12-02

時(shí)間:2017-06-29

國(guó)家自然科學(xué)基金資助項(xiàng)目(61173088);西安市科技攻關(guān)計(jì)劃資助項(xiàng)目(CX1248⑤);高等學(xué)校學(xué)科創(chuàng)新引智計(jì)劃(“111計(jì)劃”)資助項(xiàng)目(B08038)

馮玉穎(1991-),女,西安電子科技大學(xué)碩士研究生,E-mail: 1159869196@qq.com.

http://kns.cnki.net/kcms/detail/61.1076.TN.20170629.1734.024.html

10.3969/j.issn.1001-2400.2018.01.012

TP391.41

A

1001-2400(2018)01-0066-06

(編輯: 王 瑞)