基于神經(jīng)網(wǎng)絡(luò)及虛擬現(xiàn)實(shí)技術(shù)的智能手勢(shì)識(shí)別研究

劉 敏

(湄洲灣職業(yè)技術(shù)學(xué)院,福建莆田 351254)

隨著虛擬現(xiàn)實(shí)技術(shù)以及神經(jīng)網(wǎng)絡(luò)技術(shù)的不斷發(fā)展,各種智能識(shí)別及交互技術(shù)不斷涌現(xiàn),手勢(shì)識(shí)別就是其中一種,該種技術(shù)屬于智能生物識(shí)別技術(shù),在人類(lèi)交流中具有廣泛用途。當(dāng)前手勢(shì)識(shí)別技術(shù)仍舊處于研究階段,在眾多方面有待突破,其圖像處理以及數(shù)據(jù)處理部分為該技術(shù)運(yùn)行基礎(chǔ),可通過(guò)神經(jīng)網(wǎng)絡(luò)以及虛擬現(xiàn)實(shí)技術(shù)進(jìn)行解析并推進(jìn)其應(yīng)用進(jìn)程。

1 手勢(shì)識(shí)別圖像處理及模型構(gòu)建

視頻圖像處理是將收集到的圖像進(jìn)行有效處理,使之成為智能系統(tǒng)可識(shí)別的量化數(shù)據(jù)。手勢(shì)識(shí)別主要是將收集到視頻文件進(jìn)行有效識(shí)別,并將其與標(biāo)準(zhǔn)數(shù)據(jù)庫(kù)進(jìn)行比對(duì),從而得出手勢(shì)識(shí)別得到的結(jié)果,以輸入輸出進(jìn)行信息的錄入和傳輸。

1.1 手勢(shì)識(shí)別捕捉

對(duì)手勢(shì)目標(biāo)檢測(cè)是開(kāi)展手勢(shì)內(nèi)容分析的基礎(chǔ),在實(shí)際檢測(cè)過(guò)程中需要準(zhǔn)確提取手勢(shì)圖像,后續(xù)手勢(shì)特征提取及識(shí)別均建立在精確檢測(cè)基礎(chǔ)上,若檢測(cè)精度不夠則無(wú)法展開(kāi)后續(xù)工作。實(shí)際檢測(cè)過(guò)程中會(huì)存在一些無(wú)法控制的干擾因素,例如捕捉裝置晃動(dòng)、環(huán)境光線變化、背景色調(diào)影響等,為運(yùn)動(dòng)檢測(cè)帶來(lái)一定難度。因此,需要建立科學(xué)有效的捕捉算法。在本研究中通過(guò)虛擬現(xiàn)實(shí)技術(shù)結(jié)合笛卡爾坐標(biāo)進(jìn)行手勢(shì)動(dòng)作的有效捕捉[1]。

圖1所示為笛卡爾三維坐標(biāo)系,本研究中該坐標(biāo)系在建立過(guò)程中遵循左手定則,以大拇指朝向?yàn)閄軸正方向,反方向則為X軸負(fù)方向。以食指所指方向?yàn)閅軸正方向,反方向則為Y軸負(fù)方向;以中指所指方向?yàn)閆軸正方向,反方向則為Z軸負(fù)方向。建立該坐標(biāo)系后便可結(jié)合實(shí)踐形成空間4D坐標(biāo)系,從而可在該坐標(biāo)系基礎(chǔ)上實(shí)現(xiàn)人體運(yùn)動(dòng)過(guò)程的動(dòng)態(tài)追蹤。

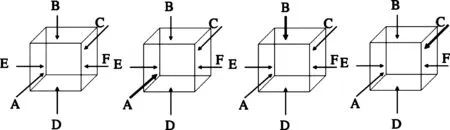

在該坐標(biāo)系中,手勢(shì)主要有6個(gè)自由度方向,可分別圍繞X、Y、Z三個(gè)軸進(jìn)行旋轉(zhuǎn),并可旋轉(zhuǎn)相應(yīng)的角度,通過(guò)手勢(shì)自由度分析便可得到相應(yīng)的坐標(biāo)轉(zhuǎn)換過(guò)程。如圖2所示,設(shè)定手勢(shì)在實(shí)際運(yùn)動(dòng)過(guò)程中分別圍繞X、Y、Z三個(gè)軸進(jìn)行旋轉(zhuǎn)的角度分別為ψ,θ,φ,則可將其旋轉(zhuǎn)角度采用空間向量矩陣形式表達(dá)出來(lái),將4D過(guò)程表示為式(1),其中各項(xiàng)參數(shù)均表示虛數(shù)單位,并假設(shè)該四元數(shù)q表示手在空間結(jié)構(gòu)中以其向量N為軸,旋轉(zhuǎn)α角度。則可將以上參數(shù)關(guān)系表示為式(2)[2]。

圖1 笛卡爾三維坐標(biāo)系

圖2 坐標(biāo)變換

(1)

q=[cos(α/2),sin(α/2)N].

(2)

通過(guò)以上分析便可建立手勢(shì)模型圍繞中心軸旋轉(zhuǎn)α角度后的關(guān)系式:

α=2arccos(w).

(3)

(4)

(5)

(6)

對(duì)其進(jìn)行四維坐標(biāo)變換后便可得到如下結(jié)果:

qw=cos(α/2)cos(θ/2)-sin(α/2)sin(θ/2)sin(ψ/2).

(7)

qx=cos(φ/2)sin(φ/2)sin(ψ/2)+sin(ψ/2)cos(θ/2)cos(ψ/2).

(8)

qy=cos(φ/2)sin(θ/2)sin(ψ/2)+sin(φ/2)cos(θ/2)sin(ψ/2).

(9)

qz=cos(φ/2)cos(θ/2)sin(ψ/2)-sin(φ/2)sin(θ/2)sin(ψ/2).

(10)

1.2 BP神經(jīng)網(wǎng)絡(luò)

圖3 BP神經(jīng)網(wǎng)絡(luò)

BP神經(jīng)網(wǎng)絡(luò)屬于一種多目標(biāo)優(yōu)化問(wèn)題,其主要過(guò)程見(jiàn)圖3。圖中分別用[X1,X2,…,Xn]以及[Y1,Y2,…,Yn]表示輸入以及輸出值,則在此基礎(chǔ)上分別通過(guò)w和b表示該網(wǎng)絡(luò)的權(quán)值以及閾值,從本質(zhì)上來(lái)說(shuō)BP神經(jīng)網(wǎng)絡(luò)的主要作用就是通過(guò)人的思維方式解決問(wèn)題,并在實(shí)際發(fā)展過(guò)程中通過(guò)多種方式將人的工作過(guò)程表示出來(lái),結(jié)合專(zhuān)家經(jīng)驗(yàn)實(shí)現(xiàn)對(duì)各種不確定問(wèn)題的有效改進(jìn),在此基礎(chǔ)上得到準(zhǔn)確結(jié)果,并將所得到的結(jié)果作為后續(xù)決策的依據(jù),制定出具有一定針對(duì)性的策略。BP神經(jīng)網(wǎng)絡(luò)是一種可靠的計(jì)算機(jī)算法,在制作過(guò)程中存在一定自身弊端,因此在實(shí)際工作中可對(duì)該種算法進(jìn)行分類(lèi)處理,結(jié)合其他算法進(jìn)行優(yōu)化后得到效率更高、可靠性更強(qiáng)的系統(tǒng),實(shí)現(xiàn)對(duì)該種系統(tǒng)網(wǎng)絡(luò)的有效提升[3]。

1.3 虛擬現(xiàn)實(shí)技術(shù)構(gòu)建智能手勢(shì)模型

在構(gòu)建模型過(guò)程中采用UML作為可視化建模語(yǔ)言。相較于其他模型在實(shí)際構(gòu)建過(guò)程中的唯一性,需要結(jié)合實(shí)際情況,從多個(gè)角度對(duì)模型進(jìn)行綜合性分析,建立與模型相關(guān)的算法結(jié)構(gòu)。圖4所示為采用UML作為可視化建模語(yǔ)言的一種范例,通過(guò)多角度設(shè)計(jì)的觀察,促進(jìn)該系統(tǒng)的不斷完善,構(gòu)建具有一定實(shí)際效應(yīng)的系統(tǒng),并能夠及時(shí)發(fā)現(xiàn)問(wèn)題所在,是一種高效的可視化建模語(yǔ)言[4]。

圖4 可視化建模語(yǔ)言使用范例

可視化建模語(yǔ)言在實(shí)際建模過(guò)程中還需要對(duì)圖像進(jìn)行轉(zhuǎn)換,實(shí)現(xiàn)由2D圖像向3D圖像的轉(zhuǎn)變,在圖4中設(shè)定推向設(shè)定運(yùn)動(dòng)矢量為V,轉(zhuǎn)換深度為D,則可將其表達(dá)為:

(11)

設(shè)定活動(dòng)窗口大小表示為W×H,M(x,y)可表示為該窗口的樣本均值,中心點(diǎn)設(shè)置為(x,y),表示以中心點(diǎn)為中心的窗口區(qū)域,則可將其高階矩陣表示為式(12),設(shè)定該圖像的任一點(diǎn)圖像灰度值為ρ,可得到如式(13)所示的轉(zhuǎn)換方式。

(12)

ρ=xcos(θ)+ysin(θ).

(13)

圖5 手掌部分的可視化建模示意圖

通過(guò)以上分析不難發(fā)現(xiàn),在進(jìn)行手勢(shì)建模過(guò)程中需要對(duì)各個(gè)部分進(jìn)行綜合性分析,尤其是手掌姿勢(shì)等。通過(guò)可視化建模語(yǔ)言對(duì)手掌各個(gè)部分進(jìn)行精細(xì)化處理,能夠有效提升建模效果,通過(guò)設(shè)置各個(gè)網(wǎng)絡(luò)點(diǎn)方式構(gòu)建出較為詳細(xì)的模型結(jié)構(gòu),降低模型構(gòu)建中可能出現(xiàn)的誤差[5]。

圖5為手掌部分的可視化建模示意圖,通過(guò)可視化建模語(yǔ)言建模,將手勢(shì)各個(gè)部分進(jìn)行拆分,結(jié)合各個(gè)部分的實(shí)際狀況進(jìn)行綜合性分析,并在此基礎(chǔ)上得出相應(yīng)特點(diǎn),從實(shí)際情況出發(fā),在細(xì)節(jié)部分予以修正。采用網(wǎng)格模型結(jié)構(gòu)對(duì)模型進(jìn)行分析,將其與實(shí)際手勢(shì)進(jìn)行比對(duì),得出相應(yīng)的結(jié)果。

2 圖像處理

2.1 圖像預(yù)處理技術(shù)

通過(guò)BP神經(jīng)網(wǎng)絡(luò)結(jié)合圖像處理算法對(duì)圖像進(jìn)行智能處理。對(duì)人的手勢(shì)目標(biāo)檢測(cè)主要是將運(yùn)動(dòng)中的研究目標(biāo)的連續(xù)圖像展現(xiàn)出來(lái),從圖像中檢測(cè)出所需部分,鎖定具體目標(biāo),將其從背景中分離,便于后續(xù)處理及分析、判斷。提取人體運(yùn)動(dòng)過(guò)程,后續(xù)運(yùn)動(dòng)特征提取及運(yùn)動(dòng)識(shí)別均建立在精確檢測(cè)的基礎(chǔ)上。而實(shí)際檢測(cè)過(guò)程中會(huì)存在一些無(wú)法控制的干擾因素,例如捕捉裝置晃動(dòng)、環(huán)境光線變化、背景色調(diào)影響等,為運(yùn)動(dòng)檢測(cè)帶來(lái)一定難度。

2.2 中值濾波

所謂中值濾波主要是指一種非線性平滑可抑制噪聲的方法,該方法特點(diǎn)是操作簡(jiǎn)單,運(yùn)算過(guò)程便捷,具有一定可行性,尤其對(duì)脈沖噪聲有一定抑制作用,且對(duì)圖像邊緣具有良好保護(hù)作用,避免邊緣模糊不清。中值濾波實(shí)現(xiàn)方法為將處理窗原圖灰度值中值作為窗口中心處新值,下面就該過(guò)程展開(kāi)分析。

一維環(huán)境下,假設(shè)a1,a2,…,an表示原始信號(hào)序列,其排列順序由大到小。則其中值可表示為:

(14)

假設(shè)原始信號(hào)為一維5點(diǎn)形式,序列為“70,80,200,110,120”,從分布來(lái)看中心處存在最大孤立噪聲。在對(duì)該類(lèi)信號(hào)進(jìn)行中值濾波處理時(shí)應(yīng)該將中值“110”作為原“200”處新值。由此可見(jiàn),無(wú)論孤立噪聲多大,均可通過(guò)中值濾波將噪聲有效消除。再如序列為“100,100,200,200,200”,則通過(guò)中值濾波處理后其中心位置仍舊是“200”,即不會(huì)出現(xiàn)邊緣模糊現(xiàn)象。若噪聲并非孤立,而是以序列情況出現(xiàn),如序列為“100,200,200,100,100”,則利用中值濾波可將噪聲完全消除。因此,相較于其他處理方法,中值濾波處理效果更佳。在二維情況下,通過(guò)中值濾波處理時(shí)將二維窗像素灰度值中值作為窗口中心處新值,表達(dá)式為[6]:

g(m,n)=Median[f(i,j)]或g(m,n)=Median[f(m-i,n-j)].

(15)

式(15)分別表達(dá)中心坐標(biāo)為(m,n)和(0,0)的情況。常用二維窗形狀見(jiàn)圖6。

圖6 常用二維窗形狀

進(jìn)行中值濾波處理時(shí)為選擇合適處理窗,本文選用多窗口中值濾波法——MWMF(Multi-Windows Median Filter)。假設(shè)3×3處理窗中心點(diǎn)為O,則可表示為:

(16)

利用MWMF法進(jìn)行處理,計(jì)算上述3×3十字窗像素中值:

md1=Median{b,d,f,h,O}.

(17)

計(jì)算上述3×3X形窗像素中值:

md2=Median{a,c,e,g,O}.

(18)

計(jì)算處理窗均值:

(19)

計(jì)算差值:

(20)

窗口處新值為:

(21)

2.3 圖像銳化增強(qiáng)

在進(jìn)行手勢(shì)運(yùn)動(dòng)分析時(shí),往往需要增強(qiáng)圖像邊緣和灰度跳變部分,即將圖像銳化增強(qiáng)。該方法的基本原理是將對(duì)圖像進(jìn)行微分處理,計(jì)算出結(jié)果,并將結(jié)果與圖像進(jìn)行疊加處理。微分處理為二階,一般指拉氏算子,用于對(duì)刻畫(huà)圖像變化。從性質(zhì)上來(lái)看,拉氏算子屬于線性算子,可對(duì)點(diǎn)、線等邊界進(jìn)行有效提取,使各項(xiàng)具有唯一不變性,定義為:

(22)

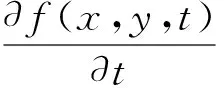

在成像過(guò)程中常會(huì)出現(xiàn)擴(kuò)散效應(yīng),此時(shí)可通過(guò)拉氏算子解決因擴(kuò)散效應(yīng)造成的圖像問(wèn)題。通過(guò)擴(kuò)散方程表示擴(kuò)散效應(yīng):

(23)

其中,f(x,y,t)表示t時(shí)刻圖像,k表示大于0的常數(shù),當(dāng)t=τ>0時(shí)圖像受影響會(huì)變模糊,此時(shí)可對(duì)其進(jìn)行泰勒級(jí)數(shù)展開(kāi):

(24)

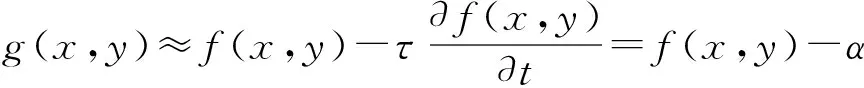

其中,t=0,g(x,y)≈f(x,y,τ),f(x,y)≈f(x,y,τ)。在此基礎(chǔ)上省略高階項(xiàng),得到:

(25)

當(dāng)圖像因?yàn)樯⑸涠斐蓤D像模糊時(shí),模糊圖像在其基礎(chǔ)上減去拉氏運(yùn)算結(jié)果的α倍便可得到清晰圖像,α表示控制銳化程度的影子。實(shí)際檢測(cè)過(guò)程中,散射并非導(dǎo)致圖像模糊的唯一因素,對(duì)其他因素造成圖像模糊的情況,利用圖像與其拉氏運(yùn)算結(jié)果之差也可加強(qiáng)邊界銳化程度。進(jìn)行數(shù)字圖像處理時(shí)選取α為常數(shù),拉氏算子四鄰域、對(duì)角鄰域、八鄰域矩陣圖見(jiàn)圖7。

(a)四領(lǐng)域 (b)對(duì)角領(lǐng)域 (c)八領(lǐng)域矩陣圖

將收集到的手勢(shì)視頻圖像進(jìn)行深入處理,消除圖片中的噪聲,將其轉(zhuǎn)變?yōu)橄到y(tǒng)可識(shí)別的量化數(shù)據(jù),并與標(biāo)準(zhǔn)數(shù)據(jù)庫(kù)進(jìn)行對(duì)比,從而對(duì)手勢(shì)進(jìn)行翻譯,得出其具體含義,并以人性化方式將其展示在終端界面。

3 系統(tǒng)構(gòu)建

基于BP神經(jīng)網(wǎng)絡(luò)以及虛擬現(xiàn)實(shí)基礎(chǔ)構(gòu)建智能手勢(shì)識(shí)別系統(tǒng),通過(guò)智能捕捉硬件設(shè)備捕捉手勢(shì)動(dòng)作,并將收集到的視頻文件輸入到系統(tǒng)中進(jìn)行處理得出相應(yīng)結(jié)果。

3.1 系統(tǒng)構(gòu)建

圖8 手勢(shì)智能識(shí)別系統(tǒng)框架圖

構(gòu)建智能手勢(shì)識(shí)別系統(tǒng),根據(jù)虛擬現(xiàn)實(shí)技術(shù)構(gòu)建其數(shù)據(jù)庫(kù)標(biāo)準(zhǔn)對(duì)比樣本系統(tǒng),并結(jié)合BP神經(jīng)網(wǎng)絡(luò)進(jìn)行數(shù)據(jù)處理,將收集到的視頻文件進(jìn)行二值化處理,與所建立的標(biāo)準(zhǔn)數(shù)據(jù)庫(kù)系統(tǒng)進(jìn)行對(duì)比。本研究構(gòu)建的系統(tǒng)結(jié)構(gòu)如圖8所示。

本研究構(gòu)建的手勢(shì)智能識(shí)別系統(tǒng)主要包括登入系統(tǒng)、數(shù)據(jù)傳入系統(tǒng)、數(shù)據(jù)處理系統(tǒng)、數(shù)據(jù)庫(kù)系統(tǒng)、數(shù)據(jù)傳出系統(tǒng)、終端顯示系統(tǒng)。其中,登入系統(tǒng):用戶(hù)注冊(cè)身份,進(jìn)入系統(tǒng)的入口,設(shè)定器用戶(hù)名及密碼;數(shù)據(jù)傳入系統(tǒng):通過(guò)客戶(hù)端系統(tǒng)進(jìn)行手勢(shì)的錄入,并將視頻文件傳輸至系統(tǒng);數(shù)據(jù)處理系統(tǒng):主要采用神經(jīng)網(wǎng)絡(luò)算法構(gòu)建出系統(tǒng)數(shù)據(jù)處理系統(tǒng),將視頻文件處理為系統(tǒng)可識(shí)別的量化數(shù)據(jù),對(duì)數(shù)據(jù)進(jìn)行有效分析,將系統(tǒng)處理得到的數(shù)據(jù)與標(biāo)準(zhǔn)數(shù)據(jù)庫(kù)進(jìn)行對(duì)比,判斷出手勢(shì)代表的意思。之后便可通過(guò)數(shù)據(jù)傳輸系統(tǒng)將結(jié)果傳輸至顯示終端。

3.2 數(shù)據(jù)庫(kù)系統(tǒng)

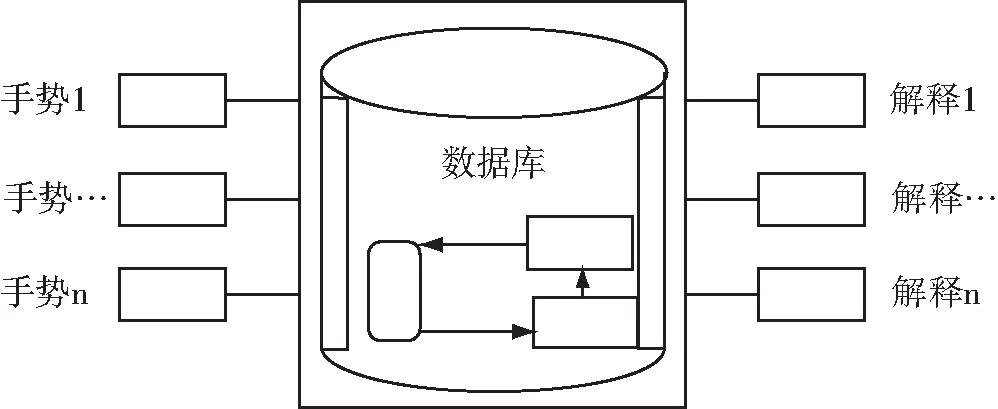

圖9 智能手勢(shì)識(shí)別系統(tǒng)數(shù)據(jù)庫(kù)

本系統(tǒng)數(shù)據(jù)庫(kù)系統(tǒng)需要將收集到的手勢(shì)含義進(jìn)行解釋?zhuān)瑯?gòu)建大量的標(biāo)準(zhǔn)手勢(shì)數(shù)據(jù)庫(kù),建立專(zhuān)屬數(shù)據(jù)庫(kù)結(jié)構(gòu)。建立分布式數(shù)據(jù)庫(kù)結(jié)構(gòu),輸入全套手語(yǔ)。圖9為智能手勢(shì)識(shí)別系統(tǒng)數(shù)據(jù)庫(kù),存儲(chǔ)大量手語(yǔ)標(biāo)準(zhǔn)解釋。在實(shí)際應(yīng)用中只要輸入相應(yīng)的手勢(shì)便可將其翻譯成相應(yīng)的語(yǔ)言,從實(shí)質(zhì)上說(shuō),該系統(tǒng)屬于一種一對(duì)多的系統(tǒng)結(jié)構(gòu)。

對(duì)于重復(fù)率比較高的待識(shí)別手勢(shì),在處理過(guò)程中可先使用預(yù)翻譯功能進(jìn)行預(yù)翻譯,運(yùn)用翻譯記憶體和數(shù)據(jù)庫(kù)中儲(chǔ)存的標(biāo)準(zhǔn)解釋?zhuān)詣?dòng)替換待處理手勢(shì),進(jìn)行自動(dòng)匹配。對(duì)于非完全匹配的部分,會(huì)以最相似的注釋方式進(jìn)行匹配,再使用精細(xì)化方式進(jìn)行調(diào)整。

3.3 系統(tǒng)測(cè)試

為研究系統(tǒng)對(duì)手勢(shì)的識(shí)別效果,構(gòu)建如表1所示的配置構(gòu)建系統(tǒng)進(jìn)行測(cè)試。

表1 系統(tǒng)配置

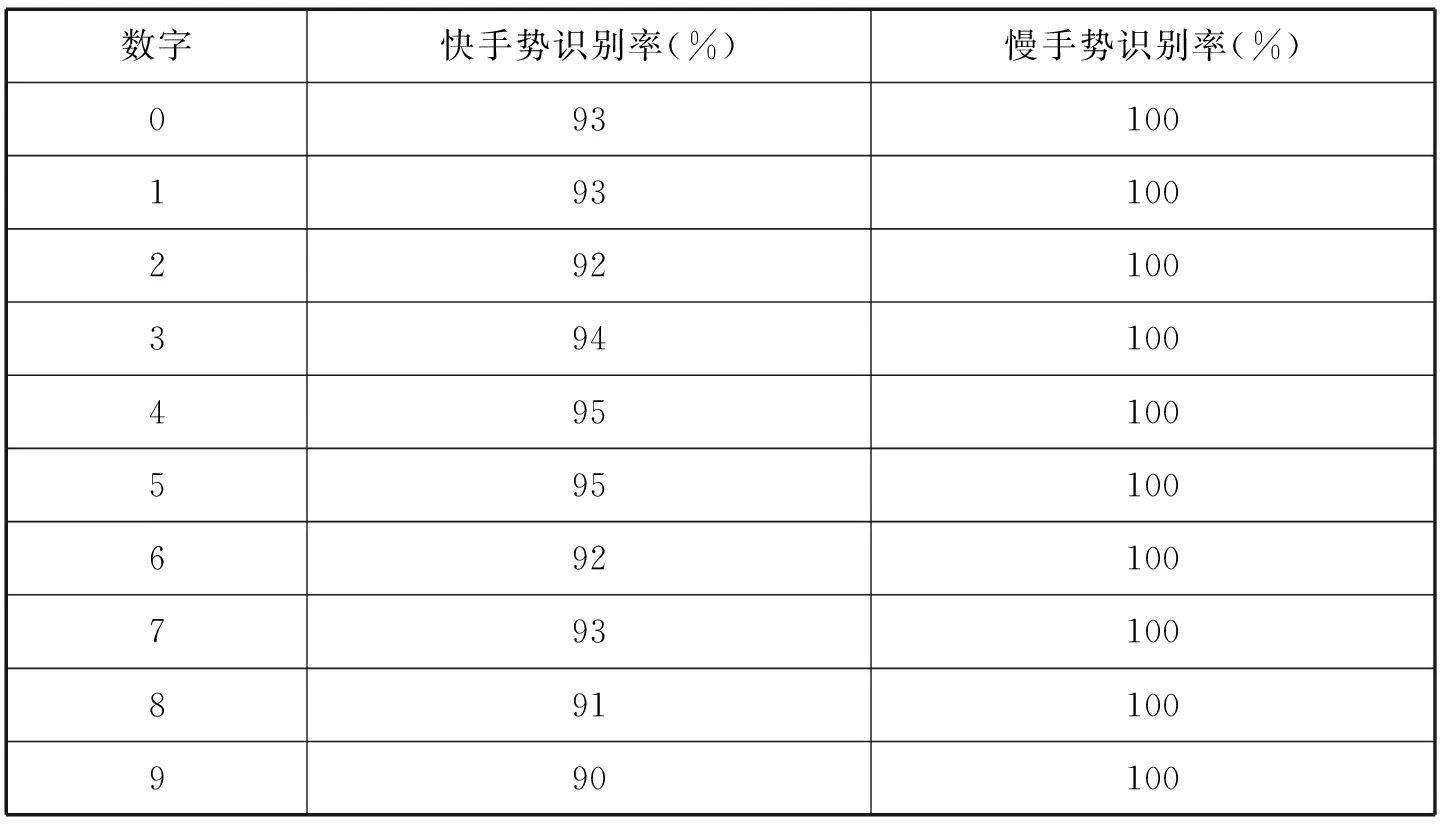

基于表1數(shù)據(jù)構(gòu)建系統(tǒng)結(jié)構(gòu),通過(guò)神經(jīng)網(wǎng)絡(luò)以及虛擬現(xiàn)實(shí)技術(shù)構(gòu)建系統(tǒng)軟件結(jié)構(gòu),將標(biāo)準(zhǔn)手勢(shì)庫(kù)存儲(chǔ)于其硬盤(pán)中。通過(guò)Kinect 2.0進(jìn)行手勢(shì)視頻收集。在測(cè)試中,通過(guò)手勢(shì)表現(xiàn)出0~9的數(shù)字,并由系統(tǒng)進(jìn)行測(cè)試。為保證測(cè)試的準(zhǔn)確性,將0~9數(shù)字添加在對(duì)話(huà)中,并設(shè)置每個(gè)數(shù)字測(cè)試100次,在測(cè)試過(guò)程中運(yùn)用數(shù)字混亂出現(xiàn)的方式,通過(guò)快速手勢(shì)和慢速手勢(shì)將測(cè)試結(jié)果表示出來(lái)(表2)。

表2 數(shù)字手勢(shì)測(cè)試結(jié)果

如表2所示,在慢速手勢(shì)測(cè)試中,系統(tǒng)可實(shí)現(xiàn)100%的數(shù)字手勢(shì)識(shí)別,快速手勢(shì)識(shí)別率超過(guò)90%。造成誤差的原因主要是CPU版本較低,以及CPU影響到系統(tǒng)實(shí)時(shí)處理數(shù)據(jù)的效率低,導(dǎo)致一些數(shù)據(jù)在處理過(guò)程中出現(xiàn)誤差,從而影響到其識(shí)別效果。從以上測(cè)試來(lái)看,本研究構(gòu)建的系統(tǒng)具有一定實(shí)用效果。

4 結(jié)語(yǔ)

綜上所述,將神經(jīng)網(wǎng)絡(luò)以及虛擬現(xiàn)實(shí)技術(shù)作為系統(tǒng)運(yùn)行的基礎(chǔ),構(gòu)建智能手勢(shì)識(shí)別系統(tǒng)。該系統(tǒng)將Kinect 2.0作為視頻收集裝備進(jìn)行手勢(shì)圖像收集,經(jīng)過(guò)圖像過(guò)濾處理以及圖像量化處理使識(shí)別對(duì)象成為系統(tǒng)可識(shí)別的數(shù)據(jù)類(lèi)型,構(gòu)建出對(duì)應(yīng)系統(tǒng),并對(duì)系統(tǒng)進(jìn)行測(cè)試。研究表明,該系統(tǒng)具備一定實(shí)用性,在進(jìn)行配置優(yōu)化后可推廣應(yīng)用。

[參考文獻(xiàn)]

[1]賈維闖,宮進(jìn),吳雄華.基于加速度的BP神經(jīng)網(wǎng)絡(luò)手勢(shì)識(shí)別設(shè)計(jì)[J].電子技術(shù)與軟件工程,2016(21):94.

[2]金小湘.虛擬現(xiàn)實(shí)結(jié)合互聯(lián)網(wǎng)的應(yīng)用研究[J].科學(xué)家,2016(15):109-110.

[3]操小文,薄華.基于卷積神經(jīng)網(wǎng)絡(luò)的手勢(shì)識(shí)別研究[J].微型機(jī)與應(yīng)用,2016(9):55-57.

[4]卓少偉,柳培忠,黃德天,等.基于CW-RNNs網(wǎng)絡(luò)的手勢(shì)識(shí)別算法[J].海峽科學(xué),2016(7):51-56.

[5]蔡娟,蔡堅(jiān)勇,廖曉東,等.基于卷積神經(jīng)網(wǎng)絡(luò)的手勢(shì)識(shí)別初探[J].計(jì)算機(jī)系統(tǒng)應(yīng)用,2015(4):113-117.

[6]馬巖.基于BP神經(jīng)網(wǎng)絡(luò)的Kinect手勢(shì)識(shí)別方法[J].軟件導(dǎo)刊,2016(3):6-8.