面向內容網絡環境的視頻內容標識方案

陳勛,韓帥,2,劉姍姍,陽小龍

?

面向內容網絡環境的視頻內容標識方案

陳勛1,韓帥1,2,劉姍姍1,陽小龍1

(1. 北京科技大學,北京 100083;2. 中國洛陽電子裝備試驗中心,河南 洛陽 471000)

視頻指紋技術是當前解決海量視頻數據標識問題的一種有效方案。首先闡述了內容網絡的研究現狀以及存在的主要問題,尤其在內容標識方面的問題;然后從內容網絡中的視頻內容標識需求出發,提出視頻內容標識方案的設計原則,并深入分析已有方案的原理和缺點;最后在解析視頻指紋技術概念與原理之后,設計并實現一種基于視頻指紋技術的視頻內容標識方案,其特點為:將時域和頻域兩種類型的視頻指紋技術進行融合,在縮短了視頻標識生成時間的同時,提高了整體系統的頑健性。

內容網絡;內容標識;視頻處理;視頻指紋

1 引言

隨著互聯網技術的進步和終端處理能力的增強,相對于傳統的文字、語音和圖像等內容形式,視頻業務已然從多樣的網絡內容中脫穎而出,并成為內容網絡中數據流量的主要貢獻者。根據思科(Cisco)公司預計,到2019年,全球互聯網視頻的數據流量將達到105EB/月,相比2014年的25 EB/月有相當顯著的增長。與此同時,4G、Wi-Fi、小型基站的普及和5G等新技術的出現,使得移動互聯網呈現高速發展態勢,其業務由傳統的單一化形式向多元化方向發展,如移動視頻、即時通信、移動社交網絡等。華為在2017年世界移動通信大會(MWC)上的報告顯示,預計到2021年,移動網絡中的視頻流量占比將達到58%。但是爆發式的增長也帶來了種種問題,例如:視頻種類繁多,不易于管理,視頻格式與用戶終端設備不匹配,無線帶寬波動影響用戶體驗等,這些問題都給視頻內容的高效分發和高體驗質量共享帶來了一定的挑戰。

目前,用戶仍然是通過傳統網頁或者相關視頻軟件來獲取所需要的視頻資源。這種獲取視頻內容的方式,在當前僵化的網絡傳輸協議下,容易受到一定的限制。比如:瀏覽器通過URL(uniform resource locator)來獲取相關網頁視頻信息時,視頻資源將會被特定的協議、主機號以及相關文件名所綁定,導致資源不能夠被靈活地分享和調度。同時,由于硬件設備技術的不斷發展,用戶終端的種類日益繁多,使視頻資源在這種異構網絡形態下的傳播變得困難,從而出現用戶獲取的視頻內容在編碼格式、呈現方式等方面與其終端設備能力不匹配的情況,這將影響用戶的觀看體驗。雖然當前網絡中同一內容視頻內容普遍存在多個不同的版本(如格式、分辨率等),由此以不同版本為不同用戶提供視頻內容服務,但是這極大地提高了視頻內容管理和分發難度。

當前有一種以內容為中心的新型網絡架構,在解決以連接為中心的傳統互聯網架構與當前以信息或內容共享為中心的網絡服務模式沖突的同時,也解決了視頻數據分發與服務的問題。其中CNN(content-centric networking,內容中心網絡)和NDN(named data networking,命名數據網絡)是兩個著名的內容網絡體系結構[1-2]。它們的共同點在于:都試圖將內容和地址分離,其中內容可以是任意形式的數據(包括視頻、文本和音樂等)。這些內容都需要被標識,才能被用戶所使用。但在CCN/NDN新型網絡架構中,所有的內容都被同樣處理,而沒有將視頻資源進行特殊對待,提取的標識特征都是基于底層字節信息。因此,這導致同一內容的視頻資源由于編碼的不同方式從而產生不同標識特征,不利于最終的分發與管理。所以,需要一個實質內容感知的視頻特征提取方案,能夠給同一內容的視頻資源提供相同的特征標識。對此,視頻指紋技術很好地解決了上述問題,并在海量視頻數據分類與管理中取得了一定的成果。視頻指紋作為視頻資源管理保護的新手段,就像人類指紋一樣可以唯一標識身份。同時視頻指紋也是數字視頻內容的精簡數字化表示形式,通過對視頻進行分析、提取、計算處理而形成的一個唯一標識符。視頻指紋應用廣泛,可用于視頻檢索、視頻認證、監視視頻廣播以及視頻過濾,當然也能夠應用于視頻標識管理方面。本文設計并實現了一種基于時—頻域視頻指紋技術的視頻標識方案,利用視頻指紋技術在解決視頻標識管理問題的同時,也為視頻分發與分類提供一定的便利。

2 內容網絡

2.1 技術特點

隨著互聯網應用的不斷發展變化,網絡中的資源內容日漸繁多,基于TCP/IP的現有互聯網也逐漸暴露出許多不適應。當前,互聯網上主要暴露的問題有:不安全、移動性差、可靠性差和靈活性差。為了解決這些問題,國內外很多研究機構都進行了相關研究,并提出了對應的解決方案。內容中心網絡作為一種新型的網絡體系架構,其中CCN/NDN是最典型的解決方案之一。因此本文以CCN/NDN為代表闡述內容網絡的技術特點。

CCN是Van Jacobson在2009年提出的,在CCN的基礎上,對CCN及其涉及的關鍵技術展開研究[3]。因此,CCN與NDN本質上是同一種網絡架構。CCN/NDN的主要思想是將信息對象作為構建網絡的基礎,分離信息的位置信息與內容識別,通過內容名字而不是主機IP地址獲取數據,從而實現高效、可靠的信息分發。其目的是開發一個可以適應當前通信模式的新型互聯網架構,從以“where”為中心的架構轉化為以用戶和應用所關心的“what”為中心的架構[4]。綜合參考文獻[5-8],CCN/NDN與當前互聯網架構相比有如下特點。

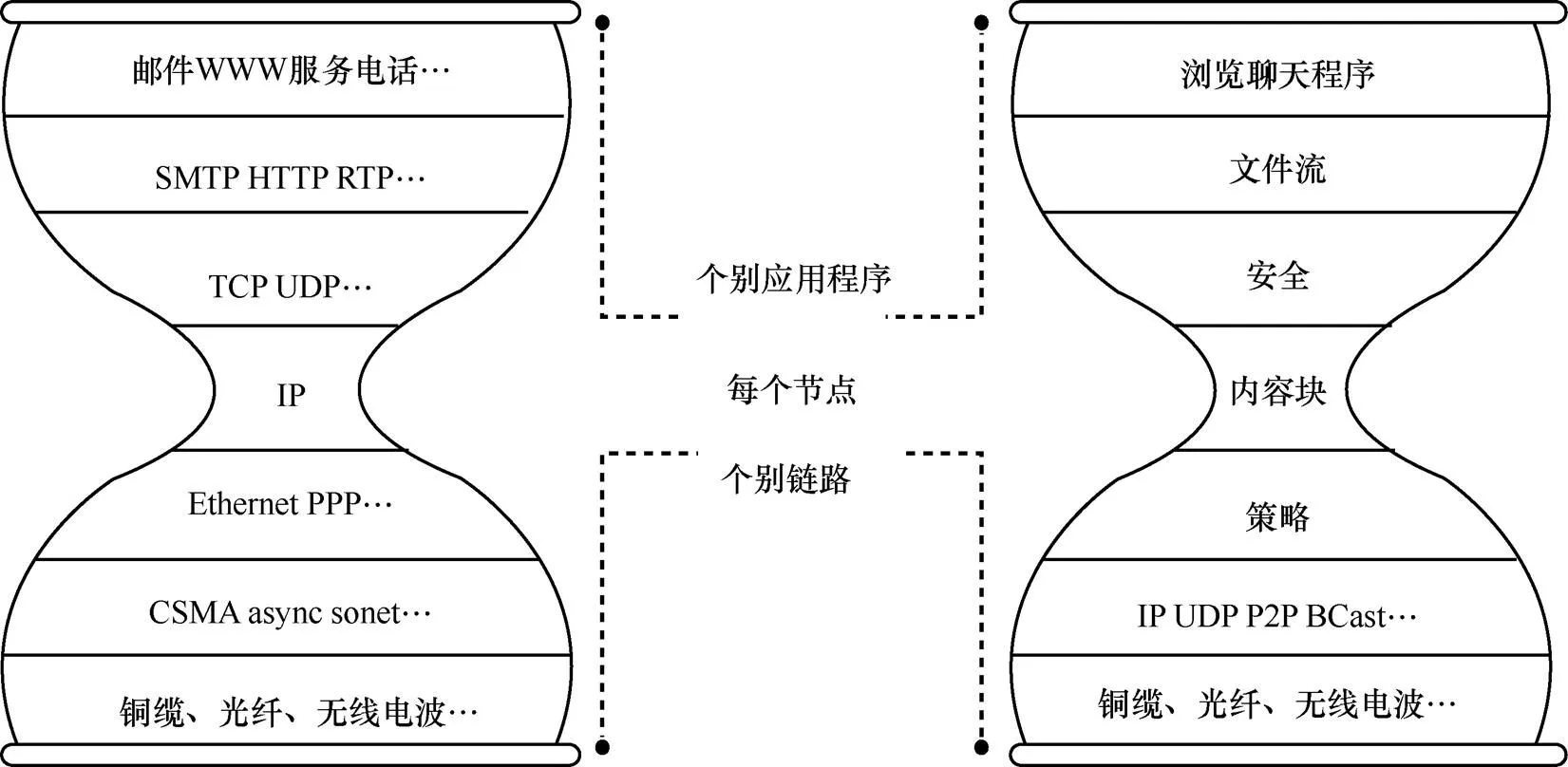

(1)體系結構

雖然CCN/NDN體系結構的外形和當今TCP/IP 網絡很相似,都是沙漏模型,如圖1所示[5],但其不同是在“瘦腰”處用內容塊(content chunk)代替了IP地址。從網絡的角度看,就是用對數據命名代替了對實體接口地址的命名。另外,網絡中內建存儲功能,用來緩存經過的數據,用以縮短其他用戶訪問同樣數據的響應時間,同時可大大減少網絡中的流量。

(2)緩存策略

CCN/NDN與傳統網絡的另一個不同點是,它充分利用了網絡設備存儲容量大、存儲代價小的優勢,而適當地運用緩存機制,從而使網絡性能得到進一步的提升。CCN/NDN目前有很多研究集中在緩存策略的設計上,包括緩存替換策略、放置決定策略、管理技術等。現有大部分研究主要分成兩類:通過建立數學模型或仿真實驗的方法,評估CCN/NDN現有緩存策略性能;提出新型緩存策略來提升網絡性能。根據參考文獻[9],CCN/NDN緩存具有透明性、普遍性以及細顆粒度等特點。

圖1 IP和CCN的比較[5]

(3)安全性

傳統網絡是通過主機到主機的鏈接進行數據傳輸的,因此在安全方面存在很大的缺陷。在CCN/NDN中,安全機制是針對信息內容本身的,對于每個信息對象,由發布者進行簽名或加密,然后接受者對簽名進行認證或者解密,從而判斷信息的有效性。

(4)命名機制

在CCN/NDN體系中,整個網絡的需求是內容,而不是主機,因此網絡不再關心內容存儲在哪里,而僅關心內容本身。它從根本上改變了IP分組的封裝結構和尋址方式,IP報文的分組頭不再以IP地址作為標識,而是以內容名稱作為標識。內容的標識名其實就是CCN的地址,這種標識名是層次化的,通常由幾個部分組成,通過這種層次化的地址,可以利用類似于URL前綴機制來迅速定位所需要的信息。如“/cctv.cn/videos/WidgetA. mpg/_v(timestamp)/_s1”,其中“cctv.cn”是全網可識別名稱,“videos”是內容類型,“WidgetA.mpg”是內容名稱,“_v(timestamp)”是版本時間等信息,“_s1”是分段等信息[10-11]。可以看出,內容名可以分為內容名稱和分片名稱兩個部分。

2.2 存在的主要問題

通過對CCN/NDN技術特點的描述,內容網絡主要是將內容和地址分離,其中內容可以是任何數據形式,這些內容都需要被標識后,才能夠被用戶使用。因此,如何對內容網絡中的內容信息進行標識是首要解決的問題。從上文中可以看出,CCN/NDN中主要采用的是分層結構化的內容標識方法。這種層次性標識方式雖然借用現有網絡中的URL格式直接對其命名,大大降低了規范命名的工作量,但是仍然存在一些問題。具體問題如下:由于采用分層結構化的方式,在訪問時仍與DNS一樣呈樹狀的模式,這種中心化的結構和分布式管理模式有一定沖突;內容名字不是固定長度的,而且字符串長度也沒有上限,導致查找時比IP地址復雜得多;由于數據量的不斷增長,當發布或刪除內容時將引起路由更新,快速實時路由更新是CCN/NDN路由查找所要解決的難題;每種內容資源都有一定的內容信息特征,分層結構化的標識方式沒有考慮到不同類型內容的差異性;視頻內容資源作為一種數據量較大、種類多樣和信息冗余度高的內容資源,這種特殊性并沒有被利用到標識實現過程中。綜上,需要一種分布式的標識方法來對內容資源進行命名,從而改進內容分發的靈活性。因此,視頻內容標識是內容網絡中需要解決的問題。

3 視頻內容標識

3.1 設計原則

與CCN/NDN的設計原則相似,在視頻內容標識設計時,需要根據視頻內容的特點來提出一套基本的設計原則。具體的原則如下[12]。

(1)感知性

根據人類視覺系統對視頻數據的認知,內容相同的視頻資源所表達和傳遞的信息是一致的,即使視頻像素有大有小、色彩有亮有暗、旋轉角度各不一致等情況發生,由于它們所表達的內容是一樣的,因此人類的感知信息也是一樣的,從而最終生成的視頻內容標識也是一樣的。

(2)簡潔性

即產生的指紋數據量應盡量較少,這樣可以利用視頻內容的標識進行視頻分類以及管理,減少處理時所產生的計算量。

(3)唯一性

視頻指紋應能唯一標識視頻內容,即兩個感知不同的視頻,它們的指紋序列應該是不同的,感知相同的視頻內容應該具有相同的視頻指紋。

(4)頑健性

視頻指紋能夠抵抗使得內容信息不變的攻擊操作,如噪聲、縮放、幀率變換和轉碼等,這種攻擊操作,使得底層的字節數據發生一定的變換,但其表現的視覺內容仍是一樣的。因此,需要抵抗這類攻擊導致的視頻指紋變化的情況,保證系統的頑健性。

(5)高效性

生成指紋的算法復雜度要較低,降低視頻指紋生成的成本,從而加快視頻內容資源的分發速率。

(6)便于匹配和查找

為后續的指紋匹配工作做準備,生成的視頻指紋應具有較好的數據結構模式,這樣便于使用資源時的匹配和查找工作。

3.2 主要方案

在視頻內容標識的研究中,已有許多典型的方案,這些方案大體上可以分為兩大類:一類是將視頻看作一個整體的數據流,通過hash算法將數據流映射成相應的hash值,hash值即視頻內容的標識;另一類是考慮了視頻內容信息特征,通過一系列方法提取出視頻的內容信息特征,基于內容信息特征得到相應的視頻內容標識。下面將描述兩種不同類型中的典型方案之一。

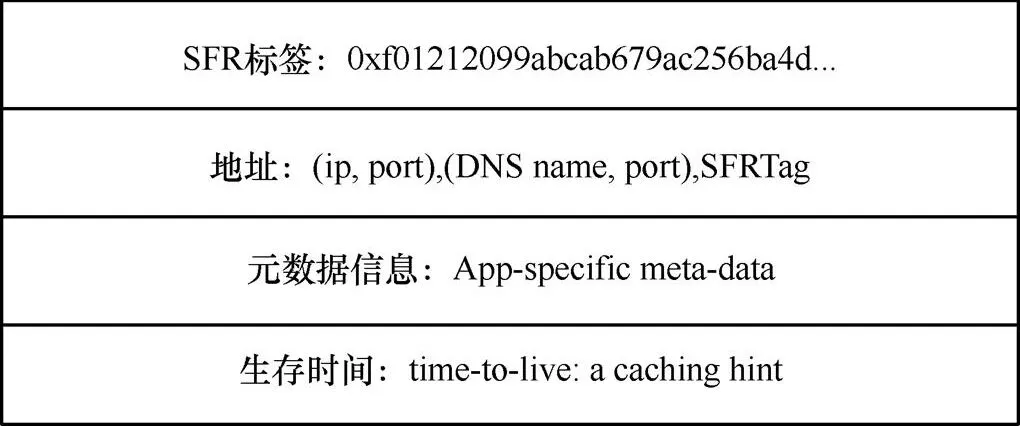

Walfish等人[13]闡述了雖然DNS(domain name system)是互聯網上最成功的技術之一,但是由于DNS結構僵化,瀏覽器通過URL(uniform resource locator)來獲取相關網頁視頻信息時,視頻資源將會被特定的協議、主機號以及相關文件名所綁定,這樣會導致資源不能夠被靈活地分享和調度。因此,Walfish等人[3]以分布式散列表(distributed hash table,DHT)為基礎,提出了一種無語義的內容標識技術SFR(semantic free referencing)。這種方案用DHT將不同內容資源映射成一個160 bit的字符串,即SFR標簽,并嵌入該內容標簽記錄o-records(object records)中,o-records中也包含了該內容數據的地址信息以及其他元信息,如圖2所示。該方案主要是利用hash表的特性,將內容數據通過hash算法生成相應的hash值,從而形成精簡的內容標識。但該方案存在的缺點是:沒有考慮視頻內容數據的特征性,如同一內容不同格式的視頻數據,在底層的字節信息可能會不大一樣,這樣由hash算法所產生的內容標識將會不同,從而同一視頻內容將會擁有不同內容標識值,影響視頻的分類與分發;由于視頻數據量巨大,通過hash算法產生的hash值碰撞的概率也將提高。

圖2 內容標簽記錄o-records

圖3 基于關鍵幀IBR的視頻標識生成過程

通過對上述方案的延伸,Anand等人[14]從內容信息的角度出發提出一種基于內容信息特征的視頻內容標識方案IBR(information-bound reference)。由于視頻可以看成一幀幀圖像所組成的連續有序的集合,因此該方案受到圖像特征提取的啟發,將圖像上的特征提取研究方案應用于視頻標識上,為視頻內容資源的標識提供了一種有效的方案。該方案的具體過程如圖3所示。

該方案的具體過程如下。

步驟1 通過視頻鏡頭分割技術尋找出鏡頭切換點,該切換點即關鍵幀,以關鍵幀為邊界點,將原視頻分成一段段的視頻片段。

步驟2 在視頻片段中選取該段的首幀和尾幀圖像,利用圖像特征提取技術生成其IBR值(如圖3中的IBR(1)和IBR(3)),將首幀和尾幀圖像的IBR值再加上該段音頻信息的hash值合成一個IBR文件塊作為該段的IBR標識。

步驟3 將各個段的IBR文件塊合在一起即形成原視頻文件的最終IBR標識。其中圖像的IBR值生成過程如圖4所示。

圖像IBR大致的生成思路就是利用離散余弦變換(discrete cosine transform,DCT)提取出圖像中Y、Cb和Cr成分的頻率分量,通過一系列整合得到最終的IBR值。因此,可以看出IBR方案存在的問題是:在提取特征時加入了色彩分量,雖然提高了IBR值的有效性,但也隨之提高了運算成本,使得生成時間變長;由于在視頻關鍵幀提取的過程中,不同的視頻鏡頭分割技術將會導致不同的結果,而且也沒對其所使用的技術進行詳細闡述,因此在該過程的處理上存在著一定的爭議。

根據IBR的方案,主要思路就是通過現有的圖像或者視頻處理方法提取視頻的特征點來實現相應的內容標識。在圖像和視頻的研究領域中,存在許多基于視頻特征點的處理技術,如視頻指紋技術。在第1節中,提到了對于同一內容視頻的不同版本數據,需要唯一的特征點為其標識,生成同一個標識為視頻的分類與管理提供方便。因此,在提取視頻特征點的過程中,需要主要考慮的是視頻的內容特征而不是結構特征[15-16]。而視頻指紋技術就考慮了這點,不僅能解決IBR中存在的問題,而且能為視頻提供精簡的標識值。因此,本文將從視頻指紋出發,解析視頻指紋的原理以及一種視頻指紋的實現過程,從而展現出視頻指紋技術在內容網絡中視頻內容標識中的應用價值。

圖4 關鍵幀圖像IBR生成過程

4 基于視頻指紋技術的視頻內容標識方案

視頻指紋技術是通過提取視頻內容特征信息作為視頻標識,基于此標識建立視頻指紋數據庫,然后通過相似性匹配算法進行查詢、分類與管理[17]。因此,視頻指紋技術主要由兩個方面構成:視頻指紋的提取和視頻指紋的匹配。下文描述了視頻指紋技術的概念以及技術原理,然后設計了一種基于時—頻域視頻指紋的視頻內容標識方案。

4.1 視頻指紋技術概述

早在1999年,斯坦福大學的Shivakumar N和Indyk P[18]在博士論文中就如何在互聯網中找出盜版視頻數據為目標,提出一套盜版視頻數據檢測技術。隨著互聯網的發展,相關研究者希望用較少的數據成本來對視頻元數據進行標識,利用視頻的標識進行基于內容的分類,從而便于視頻數據庫的管理。由此,以Shivakumar N和Indyk P的研究成果為基礎,不斷發展形成了現在的視頻指紋技術,并且以關鍵技術寫入了MPEG-21標準中。視頻指紋是一個視頻對象感知特征的簡短摘要,因此它有時又被稱為視頻摘要、視頻散列、視頻身份。它是通過一定的科學算法來提取視頻內容本身所具有的某些特征信息(如亮度、顏色、頻譜等),對這些特征信息進行統計、組合等方法后形成唯一的指紋序列,通過與數據庫中指紋間的相似性匹配計算,能將視頻本身與其他不同視頻區分開來的數據。視頻指紋提取主要分為視頻預處理、特征提取、指紋建模和數據庫構建[19]4個步驟。在這4個步驟中,細節點較多但在大多數研究中并沒有詳細解釋的是視頻預處理過程。因此,接下來主要對此過程進行闡述。

在視頻預處理過程中,首先進行的就是視頻解碼處理,將數字視頻信號流轉換成一幀幀視頻圖像,然后再對幀圖像進行后續的處理。視頻解碼的研究已經十分成熟,所以這里將不再重述。這里重點講述下后續的處理過程,為了更好地解釋該過程,先將視頻組織結構進行分析。一段連續的視頻,可劃分為以下結構:視頻鏡頭、視頻關鍵幀、視頻組以及視頻場景[20],如圖5所示。可以看出,視頻數據有很大的冗余量存在。因此,視頻預處理一方面是為了消除這些冗余量,保留關鍵信息;另一方面是為后面的特征提取做格式上的準備,從而能生成標準化指紋格式。圖5中,可見一個常用的預處理方法:視頻鏡頭邊緣檢測。這種方法的原理是通過統計計算(幀差法或光流法等)來尋找鏡頭突變或者漸變的時間點,然后將整段視頻分成一個個視頻鏡頭片段,最后在一個鏡頭中選取或合成一個關鍵幀對該鏡頭進行表示。

關于特征的提取部分,基于不同的提取方法的特性信息,其相似性計算方法也不盡相同。目前已提出的視頻指紋提取技術可分為三大類:基于時域、基于空域以及基于變換頻域的視頻指紋[21]。指紋建模,是將提取的特征進行分析,用適合的數學工具建立起模型,以便進行指紋匹配。

視頻指紋匹配,即在上述基于視頻指紋特征構建的數據庫中,查詢出所需視頻的指紋數據,并獲取該視頻數據資源。該問題屬于典型的查找型問題,最簡單的算法即窮舉法,但是由于現在視頻數據量繁多,因此運用窮舉法來解決該問題并不可取。雖然對于視頻指紋的匹配算法研究甚少,但是對于海量文本數據或者其他類型數據的快速查找算法研究較多。因此,對于視頻指紋的匹配算法的研究,一般把視頻指紋數據看成比特串或者其他數據格式,根據已有的快速查找算法來解決問題。

圖5 視頻結構特征

最常見的快速最近鄰查找算法是局部敏感散列(locality sensitive hashing,LSH)算法,該算法最早由Indyk等人[22]提出,后續Gionis又進行了總結。Hu[23]根據LSH算法實現了一個高效的視頻檢索系統,并證明了LSH算法在視頻指紋應用的實效性。LSH算法初衷是為解決海量高維度數據的快速最近鄰查找問題,其主要原理是:將高維度數據通過特殊的hash函數降維到低維數據,同時在一定程度上,保證原始數據的相似性不變。這樣高維數據映射到低維不同的桶位中,在桶內進行線性查找,從而加速了查找的效率。

對這個特殊的hash函數有以下兩個要求[23]:

? 如果(,) ≤1,則() =()的概率至少為1;

? 如果(,) ≥2,則() =()的概率至多為2。

其中(,)表示和之間的距離,1<2,()和()分別表示對和進行hash變換。

雖然LSH提高了查找的速率,但是也降低了查找的準確率。為了提高查找的準確率,部分研究者進行了研究,提出了一系列算法。最具代表的是以聚類為基礎的匹配算法。

4.2 視頻內容標識方案設計與實現

根據前文視頻指紋技術原理介紹,本節對時域和頻域的視頻指紋技術進行了融合,并提出了一種基于時—頻域視頻指紋的視頻內容標識方案。該方案的基本原理是:先在視頻的時間域中進行處理,利用視頻鏡頭分割和圖像合成技術得到一段視頻的關鍵幀,然后對于每一關鍵幀進行DCT得到頻域圖像,從頻域圖像中提取出頻域信息經過統計處理得到相應的視頻指紋,對視頻指紋進行整合后得到最終的視頻標識。因此該方案分為3個過程:時域處理過程,又稱視頻預處理過程;頻域處理過程;標識生成過程。具體過程如圖6所示。

圖6 基于時—頻域視頻指紋的標識生成總過程

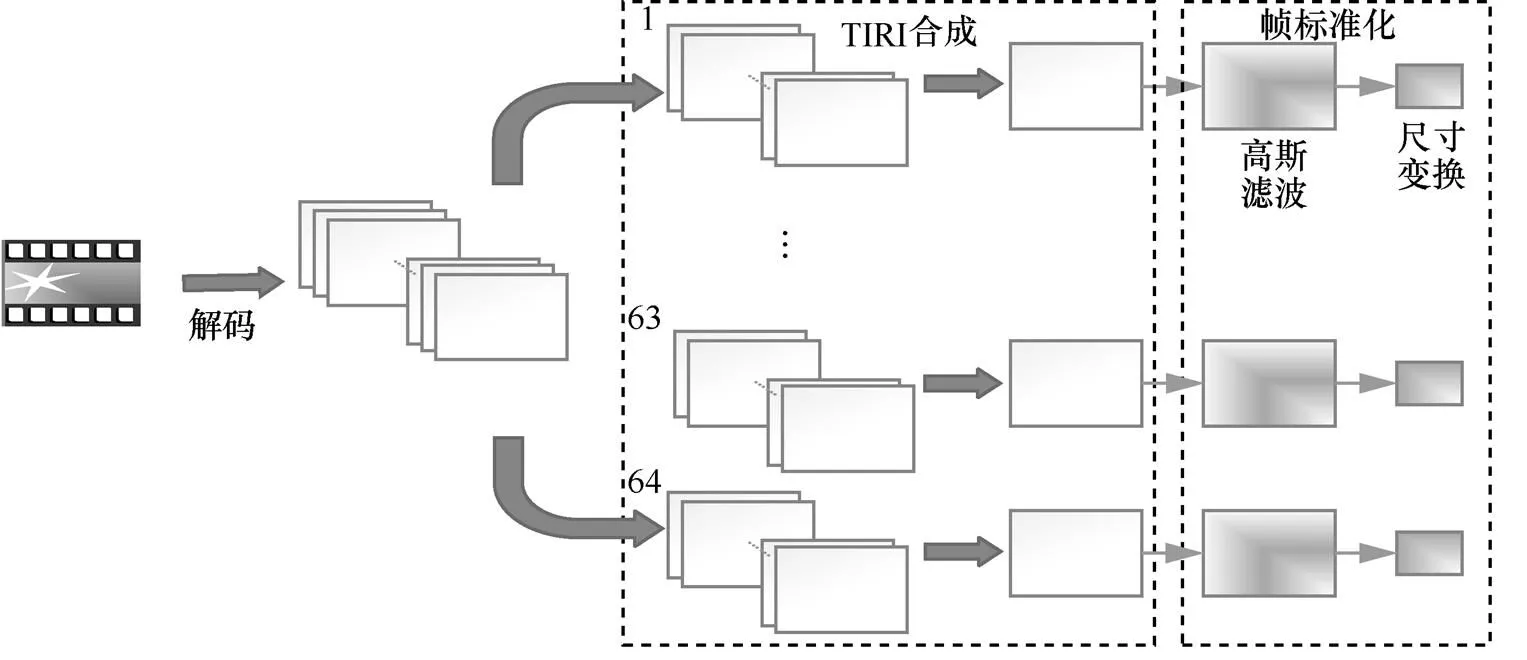

針對時域處理過程,下面將對每一個步驟進行詳盡說明,具體過程如圖7所示。

步驟1 視頻解碼。目前存在大量的編解碼標準,為了適配不同的應用環境和終端設備,視頻經常需要被轉碼成相應能處理的數據格式。造成同一內容的視頻會以多種不同的編碼形式存在。不同編碼的數據具有不同的字節特征,這樣想要直接從編碼數據中提取唯一特性的指紋將變得很困難。因此,數字視頻首先需要被解碼,得到壓縮前的視頻幀序列。

圖7 視頻標識方案時域處理過程

步驟2 幀序列分組和幀合成。這部分是大多數參考文獻中提到的視頻預處理過程,其目的是:剔除視頻數據中的冗余量;為后續的處理做準備而進行幀圖像標準化。本文的方案中,將步驟1得到的視頻幀序列進行均等分組,先均等分成63組幀序列,最后的剩余作為第64組。這樣得到64組幀序列后,需要利用圖像合成技術,將組內幀序列合成一幀圖像作為關鍵幀為后續處理做準備。這里所用的圖像合成技術是TIRI(temporally informative representative image)[24]技術。這種方法的原理是:將一組圖像進行權重相加,得到一個新的圖像作為表示圖像,計算式如下:

步驟3 關鍵幀的標準化。對關鍵幀標準化是為了最終生成標準形式的視頻指紋格式。在這個標準化過程中包含兩個方面:圖像濾波和圖像尺寸縮減。圖像濾波,即在盡量保留圖像細節特征的條件下對目標圖像的噪聲進行抑制,是圖像預處理中不可缺少的操作,其處理效果的好壞將直接影響到后續圖像處理和分析的有效性和可靠性。本文所用的濾波器是高斯濾波器,是一種線性平滑濾波。因為其能在不破壞圖像原始信息的情況下抑制噪聲,所以廣泛應用于圖像處理的降噪過程。將關鍵幀圖像降噪后,再進行圖像的尺寸變化,生成標準化的圖像大小,本文選擇的是144 dpi ×176 dpi,這是H.323協議簇中規定的最小能表征圖像信息的圖像格式(QCIF)。

通過上述時域處理,任何視頻都將得到一個(144,176,64)的關鍵幀集合,其中144 dpi ×176 dpi是關鍵幀圖像尺寸大小,64是關鍵幀的總數。在這個關鍵幀集合的基礎上,這里將對其進行頻域處理,提取出關鍵幀的頻域信息。在進行頻域處理過程中,有3個問題需要考慮:用何種變換工具來進行頻域轉換;提取多少頻域分量信息;如何對提取出的分量信息進行量化。針對這3個問題,下文將一一闡述解決辦法。

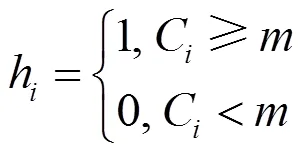

目前,在圖像和視頻的頻域處理的研究中,應用最廣泛的是DCT[25-26]。DCT是對實信號定義的一種變換,它是從離散傅里葉變換(discrete fourier transform,DFT)推導出來的一種變換。相比DFT而言,DCT可以減少一半以上的計算。因為DCT具有能量集中特性,即聲音或圖像信號通過離散余弦變換后大多數信號能量集中在其低頻區域,所以DCT在聲音和圖像數據處理中得到了廣泛的使用。因此,本文也是利用DCT對關鍵幀集合進行頻域轉換。在DCT過后的頻域矩陣中,需要選取合適大小的子矩陣作為該關鍵幀標識信息。為了確保最終視頻指紋的簡潔性和高效性,選取的子矩陣大小不能過大或過小,過大將導致視頻指紋信息量過多,從而影響簡潔性,過小會導致提取的信息量較少,從而使得部分重要信息丟失,影響其高效性。在本文中所選取的子矩陣大小是16行× 16列,每一關鍵幀將由256位頻域分量標識。為了得到最終的視頻指紋,最后就是將每關鍵幀的256位分量進行量化處理得到相應的比特串。與其他研究中的量化過程不同,本文將每一頻率分量通道看成一組序列,在每一通道中計算出每組序列的中位數,根據以下計算式進行量化:

其中,m為通道中的中位值,Ci為第i處的頻率分量,hi為量化后的值。這樣每一個視頻數據將得到一個64行×256位的比特指紋序列,圖8形象地描述了上述過程。

最后,通過hash函數對得到的視頻指紋數據進行處理,生成最終的視頻標識值。這種視頻標識不僅滿足視頻內容標識設計原則,也解決了內容網絡中視頻內容標識的問題。

5 結束語

內容標識一直都是內容網絡中需要解決的問題,其中對于視頻這一類型內容來說,它的內容標識與其他內容相比更為復雜。視頻指紋技術是一種新型的視頻內容標識技術。它通過一定的科學算法來提取視頻內容本身所具有的某些特征信息(如亮度、顏色、頻譜等),對這些特征量進行統計、組合等方法處理后形成唯一的指紋序列,通過與數據庫中指紋間的相似性匹配計算,能將視頻本身與其他不同視頻區分開來的數據。本文研究了將視頻指紋技術應用于解決內容網絡中視頻內容資源的標識問題,提出了一種基于時—頻域視頻指紋的標識方案,有效解決了視頻內容在內容網絡中的分類與管理問題。但隨著科技的發展,現有的視頻標識方案將會在日益豐富的視頻數據中顯現不足。因此,在后續的工作中,還需要進一步分析與研究。

[1] 尹浩, 袁小群, 林闖, 等. 內容網絡服務節點部署理論綜述[J]. 計算機學報, 2010, 33(9): 1611-1620.

YIN H, YUAN X Q, LIN C, et al. The survey of service nodes placement theories for content networks[J]. Chinese Journal of Computers, 2010, 33(9): 1611-1620.

[2] 唐霏. 內容網絡中的緩存設計[D]. 成都: 電子科技大學, 2013.

TANG F. Caching design in content network[D]. Chengdu: University of Electronic Science and Technology, 2013.

[3] 胡騫. 以內容為中心的網絡中緩存技術的若干問題研究[D]. 北京: 北京郵電大學, 2015.

HU Q. Research on caching technology in content centric network[D]. Beijing: Beijing University of Posts and Telecommunications, 2015.

[4] 崔現東. 內容中心網絡網內緩存策略研究[D]. 北京: 北京郵電大學, 2014.

CUI X D. Research on caching strategy in content center network[D]. Beijing: Beijing University of Posts and Telecommunications, 2014.

[5] 黃韜, 劉江, 霍如, 等. 未來網絡體系架構研究綜述[J]. 通信學報, 2017, 35(8): 184-197.

HUANG T, LIU J, HUO R, et al. Survey of research on future network architectures[J]. Journal on Communications, 2017, 35(8): 184-197.

[6] 劉斌, 汪漪. 內容中心網絡中名字查找技術的研究[J]. 電信科學, 2017, 30(9): 10-17.

LIU B, WANG Y. Research on name lookup in named data networking[J]. Telecommunications Science, 2017, 30(9): 10-17.

[7] 張行功, 牛童, 郭宗明. 未來網絡之內容中心網絡的挑戰和應用[J]. 電信科學, 2017, 29(8): 24-31.

ZHANG X G, NIU T, GUO Z M. Challenge and implementation of content-centric networking[J]. Telecommunications Science, 2017, 29(8): 24-31.

[8] JACOBSON V, SMETTERS D K, THORNTON J D, et al. Networking named content[C]//The 5th International Conference on Emerging Networking Experiments and Technologies, December 1-4, 2009, Rome, Italy. New York: ACM Press, 2009: 1-12.

[9] ZHANG G, LI Y, LIN T. Caching in information centric networking: a survey[J]. Computer Networks, 2013, 57(16): 3128-3141.

[10] 胡騫, 武穆清, 郭嵩. 以內容為中心的未來通信網絡研究綜述[J]. 電信科學, 2012, 28(9): 74-80.

HU Q, WU M Q, GUO S. A survey of content-oriented future communication network[J]. Telecommunications Science, 2012, 28(9): 74-80.

[11] 雷凱. 信息中心網絡與命名數據網絡[M]. 北京: 北京大學出版社, 2015.

LEI K. Information-centric networking (ICN) and named-data networking (NDN)[M]. Beijing: Peking University Press, 2015.

[12] 王大永. 感知視頻指紋算法研究[D]. 上海: 上海交通大學, 2012.

WANG D Y. Research on perceptual video fingerprint algorithm[D]. Shanghai: Shanghai Jiao Tong University, 2012.

[13] WALFISH M, BALAKRISHNAN H, SHENKER S. Untangling the Web from DNS[C]//NSDI 2004, March 29-31, 2004, San Francisco, CA, USA. New York: ACM Press, 2004: 17.

[14] ANAND A, BALACHANDRAN A, AKELLA A, et al. Enhancing video accessibility and availability using information-bound references[J]. IEEE/ACM Transactions on Networking (TON), 2016, 24(2): 1223-1236.

[15] KIM M J, YOO C, KO Y W. Multimedia file forensics system exploiting file similarity search[J]. Multimedia Tools and Applications, 2017: 1-22.

[16] NIE X, YIN Y, SUN J, et al. Comprehensive feature-based robust video fingerprinting using tensor model[J]. IEEE Transactions on Multimedia, 2017, 19(4): 785-796.

[17] 許濤. 面向視頻管理的指紋特征提取技術研究[D]. 成都: 電子科技大學, 2015.

XU T. Research on fingerprint feature extraction technology for video management[D]. Chengdu: University of Electronic Science and Technology, 2015.

[18] INDYK P, IYENGAR G, SHIVAKUMAR N. Finding pirated video sequences on the internet[R]. 1999.

[19] OUALI C, DUMOUCHEL P, GUPTA V. Robust video fingerprints using positions of salient regions[C]//2017 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP), March 5-9, 2017, New Orleans, USA. Piscataway: IEEE Press, 2017: 3041-3045.

[20] 莊捷. 流媒體原理與應用[M]. 北京: 中國廣播電視出版社, 2012.

ZHUANG J. Principle and application of streaming media[M]. Beijing: China Radio and Television Publishing House, 2012.

[21] LU J. Video fingerprinting for copy identification: from research to industry applications[C]// Media Forensics and Security. International Society for Optics and Photonics, January 19, 2009, San Jose, CA, USA. [S.l.:s.n.], 2009: 725402.

[22] INDYK P, MOTWANI R. Approximate nearest neighbors: towards removing the curse of dimensionality[C]//The 30th Annual ACM Symposium on Theory of Computing, May 24-26, 1998, New York, USA. New York: ACM Press, 1998: 604-613.

[23] HU S. Efficient video retrieval by locality sensitive hashing[C]// IEEE 2005 International Conference on Acoustics, Speech, and Signal Processing (ICASSP’05), March 18-23, 2005, Philadelphia, Pennsylvania, USA. Piscataway: IEEE Press, 2005: 449-452.

[24] ESMAEILI M M, FATOURECHI M, WARD R K. A robust and fast video copy detection system using content-based fingerprinting[J]. IEEE Transactions on Information Forensics and Security, 2011, 6(1): 213-226.

[25] OOSTVEEN J, KALKER T, HAITSMA J. Feature extraction and a database strategy for video fingerprinting[M]. Berlin: Springer, 2002: 117-128.

[26] COSKUN B, SANKUR B. Robust video hash extraction[C]// 2004 12th European Signal Processing Conference, Sept 6, 2004, Vienna, Austria. Piscataway: IEEE Press, 2004: 2295-2298.

Video content identification scheme in content oriented network environment

CHEN Xun1, HAN Shuai1,2, LIU Shanshan1, YANG Xiaolong1

1. University of Science and Technology Beijing, Beijing 100083, China 2. Luoyang Electronic Equipment Test Center of China, Luoyang 471000, China

Video fingerprinting technology is a video identification technology proposed for the identification of massive video data. Firstly, the research status of the content network and the main problems that exist were elaborated, especially the problems of content identification. Then design principles of the video content identification scheme were proposed from the video content identification requirements in the content network, and the principles and disadvantages of the existing solutions were analyzed in depth. Finally, a video content identification scheme based on video fingerprinting technology was designed and implemented after analyzing the concept and principle of video fingerprinting technology. The feature was: the two types of video fingerprinting technology in the time domain and frequency domain were integrated. While shortening the time for generating video tags, it also improved the robustness of the overall system.

content network, content identification, video processing, video fingerprint

TN919.85

A

10.11959/j.issn.1000?0801.2018182

陳勛(1994?),男,北京科技大學計算機與通信工程學院碩士生,主要研究方向為內容中心網絡、視頻分發網絡。

韓帥(1988?),男,北京科技大學計算機與通信工程學院碩士生、中國洛陽電子裝備試驗中心助理工程師,主要研究方向為視頻編碼與傳輸、視頻分發網絡。

劉姍姍(1994?),女,北京科技大學計算機與通信工程學院碩士生,主要研究方向為流媒體技術、視頻分發網絡。

陽小龍(1970?),男,北京科技大學計算機與通信工程學院教授、博士生導師,主要研究方向為網絡安全、內容中心網絡、視頻分發網絡和新一代互聯網理論與技術。

2018?04?08;

2018?05?06

陽小龍,yangxl@ustb.edu.cn