多尺度殘差深度神經網絡的衛星圖像超分辨率算法

汪家明,盧 濤

武漢工程大學計算機科學與工程學院,湖北 武漢 430205

遙感衛星是一種重要的對地觀測手段,能夠對地面進行大面積的同步觀測以獲得地面目標的信息。遙感衛星圖像在災害監測預警、資源勘探、和環境檢測等領域有著廣泛的應用前景。然而,由于硬件設備與成本的限制,遙感圖像的分辨率固定。此外,大氣湍流、成像過程噪聲、設備與景物之間的運動模糊、光學傳感器的欠采樣,降低了衛星圖像的分辨率和質量。為了提高遙感影像的空間分辨率,克服噪聲和成像模糊的影響,對遙感圖像的超分辨率重建顯得尤為迫切。

現有的圖像超分辨率重建算法(super-resolu?tion,SR)主要分為2類:基于重建的算法和基于學習的算法。基于重建的算法通過多個低分辨率圖像來融合亞像素精度的多幀信息[1],重建出更高分辨率的圖像。但基于重建的方法僅能利用低分辨率圖像之間的互補信息,不能增加新的高頻信息,因此這類重建方法的放大倍數有限。然而后續的識別任務更加關注高頻信息中包含的特征[2]。近年來,受到機器學習理論發展的影響,基于學習的方法受到高度的重視日益成為超分辨率算法研究的主流方向。基于學習的算法通過訓練樣本提供的先驗信息,學習低分辨率圖像塊與高分辨率圖像塊之間的映射模型。從訓練樣本的使用角度來看,基于學習的算法可以分為3類:基于表達的超分辨率算法,基于回歸的超分辨率算法和基于深度學習的超分辨率算法。

基于表達的算法根據高分辨圖像在不同分辨率空間表達系數不變這一性質,使用低分辨字典表示輸入圖像塊,并找尋低分辨率字典對應的高分辨率字典進行重建[3-4]。基于回歸的算法通過回歸模型對超分重建進行求解[5-6]。考慮到卷積神經網絡(convolutional neural network,CNN)的優秀學習能力,通過卷積神經網絡[7-8]來學習低分辨率和高分辨圖像之間的復雜非線性映射關系,通過多個隱藏層來擴展傳統網絡的深度。Shi等[9]構建了亞像素空間的卷積神經網絡,直接而高效地學習了從低分辨率圖像到高分辨率圖像的映射函數。Kim等[10]通過深度殘差網絡證明了深度殘差網絡層數對于超分辨率性能有提升。生成對抗網絡[11]由生成網絡和判別網絡組成,通過生成網絡生成細節,取得了良好的視覺效果,但是客觀指標較低。Luo等[12]在 Kim[10]的基礎上根據自相似性填充圖像取代零填充,避免增加無用的信息,在衛星圖像超分辨率任務中表現出了優異的重建效果。

衛星圖像超分辨率是特定領域的超分辨率重建問題,準確的邊緣和紋理等高頻信息對于衛星圖像檢測和識別任務是至關重要的[13]。待識別目標的全局高頻信息在檢測任務中占據主導地位,而局部的高頻信息在識別任務中不可或缺。但是遙感衛星圖像成像范圍廣,目標的尺度差異較大,直接使用同構同質的網絡預測重建不同尺度的目標,導致重建精度不滿足要求或者效率低下。而現有的基于多尺度的超分辨率算法中,多尺度信息融合是在像素域或特征域進行,重建結果注重的是圖像的內容和局部高頻信息,卻忽略了全局的高頻信息。因此需要一個網絡結構,可以靈活處理不同尺度的目標和不同精度的超分辨率任務,預測出不同尺度目標的邊緣和紋理等高頻信息,并在更加快速和有效的殘差空間融合多尺度信息。綜合考慮上述問題,本文提出了一個多尺度殘差深度神經網絡的衛星圖像超分辨率算法。

1 基于多尺度殘差深度神經網絡的衛星圖像超分辨率

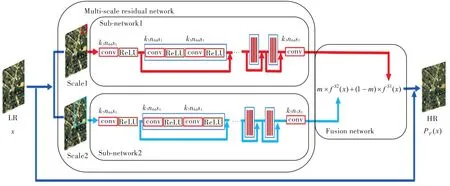

結合多尺度圖像分析和深度殘差網絡,將同一衛星圖像以多尺度的形式放入不同的深度殘差神經網絡中,建立不同尺度特征的自適應深度神經網絡,學習從底層到高層的特征,預測不同尺度空間的高頻殘差信息。然后通過殘差融合網絡將預測所得的不同尺度空間的殘差圖像在殘差空間進行加權,進行殘差信息之間的互補和融合,使得不同目標能夠在最合適的空間進行表達。本文中的多尺度殘差網絡以兩個不同尺度空間子網絡為例,分別為尺度空間1和尺度空間2,網絡結構圖如圖1所示。

1.1 殘差學習

Kim[10]證明了隨著網絡層數的增加,大量的超參數促進了網絡的非線性表達能力。然而,網絡層數的單一級聯帶了一個不可避免的問題:梯度消失/梯度爆炸導致在反向傳播中網絡的參數無法優化[14]。由于輸入的低分辨率圖像和原始高分辨率圖像非常相似,本文定義殘差圖像為ri=yi-xi。殘差圖像的像素值大多數為零或者較小值。低分辨率圖像的插值結果xi屬于原始圖像yi的低頻分量,因此殘差圖像ri為yi的高頻分量。相比直接預測像素域的圖像,使用殘差學習不僅會大量減少網絡攜帶的信息,可加快網絡收斂速度,還可以避免深度網絡的不收斂問題[10]。

圖1 多尺度殘差網絡的網絡結構。網絡包括多尺度殘差學習網絡和殘差融合網絡兩部分(k表示卷積核大小,n表示卷積核個數,s表示步長)Fig.1 Network architecture of multi-scale residual deep neural network.The network includes two subnetworks:multi-scale residual network and residual fusion network.(k is the convolution kernel size,n is the number of convolution kernel and s is stride size)

1.2 多尺度特征提取

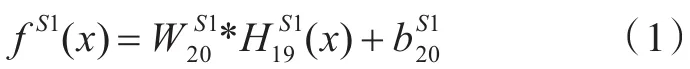

在尺度空間1殘差學習網絡中,本文使用大小為41×41像素的重疊圖像塊進行訓練。本文定義卷積核大小為3×3。網絡輸出的殘差為:

其中fS1(x)為尺度空間1殘差學習網絡預測所得的殘差。為尺度空間1殘差學習網絡第19層輸出的特征圖。卷積的權值大小為64×3×3×1,偏置項大小為1×1。

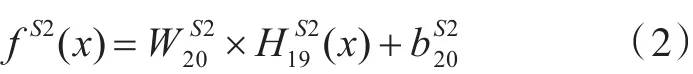

在尺度空間2殘差學習網絡中使用100×100的非重疊圖像塊。由于輸入圖像塊大小的增加,所以需要更大的感受野。本文定義卷積核大小為7×7,尺度空間1和尺度空間2殘差空間增強網絡相似。網絡輸出的殘差為:

其中fS2(x)為尺度空間2殘差學習網絡預測所得的殘差。為殘差學習網絡第19層輸出的特征圖。卷積的權值大小為64×7×7×1,偏置項大小為1×1。

1.3 殘差融合網絡

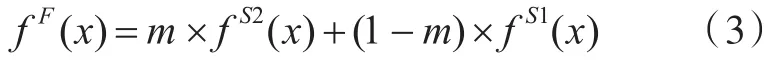

相同尺度的目標在不同的尺度空間具有不同的表達形式[15],本文通過不同尺度空間找尋不同尺度的目標的最適合的表達形式,并通過多尺度的表達形式進行信息互補,保證了目標表達的準確性。本文試圖通過融合模型組合尺度空間1的殘差信息和尺度空間2的殘差信息。融合后的殘差為:

其中m表示尺度空間2預測殘差的權重,在本文中m=0.9。最終的重建圖像為:

1 .4 損失函數

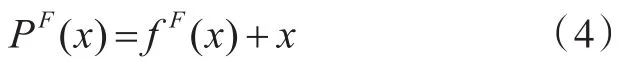

使用均方誤差(mean squared error,MSE)作為網絡的損失函數,整體的損失函數為:

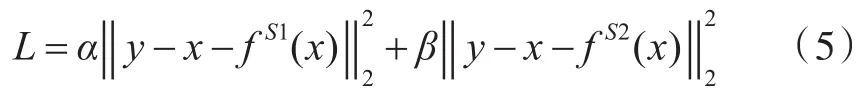

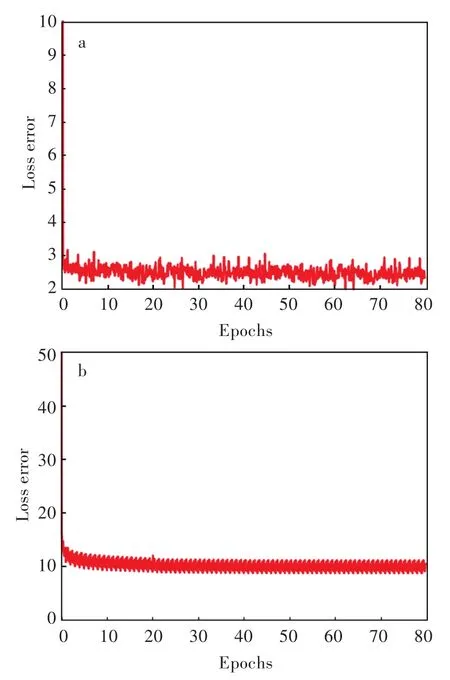

其中α,β控制不同尺度殘差學習網絡之間的平衡,在本文中α=β=1。網絡優化過程中使用梯度下降法來進行反向傳播。每次卷積操作都會縮小特征圖的大小,通過填充零來保留更多的邊緣像素,以更準確地推斷中心像素,同時也確保了所有的特征圖大小相同。網絡損失如圖2所示,由于2個子網絡訓練使用的圖像塊大小差異,所以對應的網絡訓練時的損失在量級有差異,但收斂趨勢相同,證明了使用不同尺度的殘差網絡恢復殘差的合理性。

圖2 不同尺度殘差網絡的訓練損失圖:(a)尺度1,(b)尺度2Fig.2 Training loss of multi-scale residual networks:(a)scale 1,(b)scale 2

2 結果與討論

2.1 實驗數據與參數

本文在Space Net衛星圖像數據集中進行實驗,并通過峰值信噪比(peak signal to noise ratio,PSNR)本文中定義為RPSNR、結構相似性(structural similarity,SSIM)和互信息(mutual information,MI)作為重建圖片質量的客觀評估標準。PSNR和SSIM從圖像的角度刻畫了重建圖像與原始圖像之間的相似性,而互信息可從信息的角度表示兩幅圖像之間的信息的依賴程度,互信息評分越高,圖像之間的依賴越高,圖像之間的相似性也越高。圖像x與y之間的互信息定義為:

式(6)中,m和n表示灰度值,P(m)表示灰度值為m的像素數量占整幅圖像的比例。

Space Net衛星圖像數據集中包括里約熱內盧、巴黎、拉斯維加斯、上海和喀土穆5個可用的區域,每個地圖圖像都由完整的高分辨率衛星圖像分割為438×406像素的RGB圖像,圖像的興趣內容主要為建筑和道路等。從里約熱內盧地圖中隨機選取240張建筑群圖像,其中的160張作為訓練集,40張作為驗證集,余下40張作為測試樣本。

本文算法網絡為并行網絡結構,每個子網絡都需要訓練80個時期。由于網絡層數較深,因此本文算法使用學習率衰減,學習率初始化為0.1,每隔20個時期學習率便會下降至原來的1/10,而網絡的動量為0.9。為了避免過擬合,本文使用?2正則化,其權值衰減為0.0001。在尺度空間1殘差學習網絡中,本文設置步長為1,填充為1,而尺度空間2殘差學習網絡中,設置步長為1,填充為3。本文使用msra來初始化權重,即滿足均值為0方差為的高斯分布(n輸入訓練樣本的個數),使用constant來初始化偏置項,即初始值為0。實驗先將RGB圖像轉換到YCbCr顏色空間,在Y通道中進行重建,重建完成后再將Y通道的圖像還原到RGB顏色空間。

2.2 實驗結果與分析

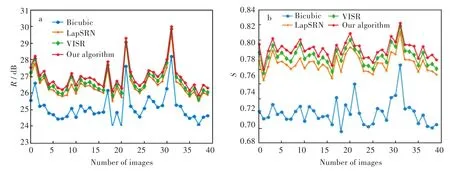

對結果進行定量和定性的分析,并使用PSNR、SSIM和MI用于評估重建的結果進行定量分析。此外為了驗證本文算法網絡結構的有效性,比較了CNN中前沿的算法:加速的基于卷積網絡的圖像超分辨率算法(auelerating the super_reso?lution convolutional neural network,FSRCNN)[16],經典深度學習算法基于深度卷積網絡的圖像超分辨率算法(image super-resolution using deep convo?lutional networks,SRCNN)[7]的加速優化版本,拉普拉斯金字塔超分辨率網絡(laplacian pyramid su?per-resolution networks,LapSRN)[17],視頻衛星圖像超分辨率算法(video satellite imayery super resolu?tion,VISR)[12]。本文中使用的對比算法 FSRCNN的源代碼由論文作者Chao Dong提供,LapSRN的源代碼由論文作者Wei-Sheng Lai提供,VISR的源代碼由論文作者Yimin Luo提供。所有測試圖像的PSNR和SSIM如圖3所示(由于FSRCNN的客觀評分過低,并未在圖3中展示),本文算法重建圖像的PSNR和SSIM都是最優的,如表1所示,本文算法無論是PSNR、SSIM還是MI都獲得了最高的客觀評分。與性能排名第二的算法VISR相比,分別提升了0.25 dB,0.01和0.03,表明了多尺度的殘差網絡通過不同尺度空間更有效地學習圖像內容和結構,以及通過更深網絡恢復圖像的信息的有效性。

圖3 Space Net衛星圖像超分辨率結果的客觀對比:(a)PSNR,(b)SSIMFig.3 Objective results of super-resolution algorithms over Space Net satellite images:(a)PSNR,(b)SSIM

表1 Space Net數據集上PSNR,SSIM和MI的平均結果Tab.1 Average results of PSNR,SSIM and MI on SpaceNet dataset

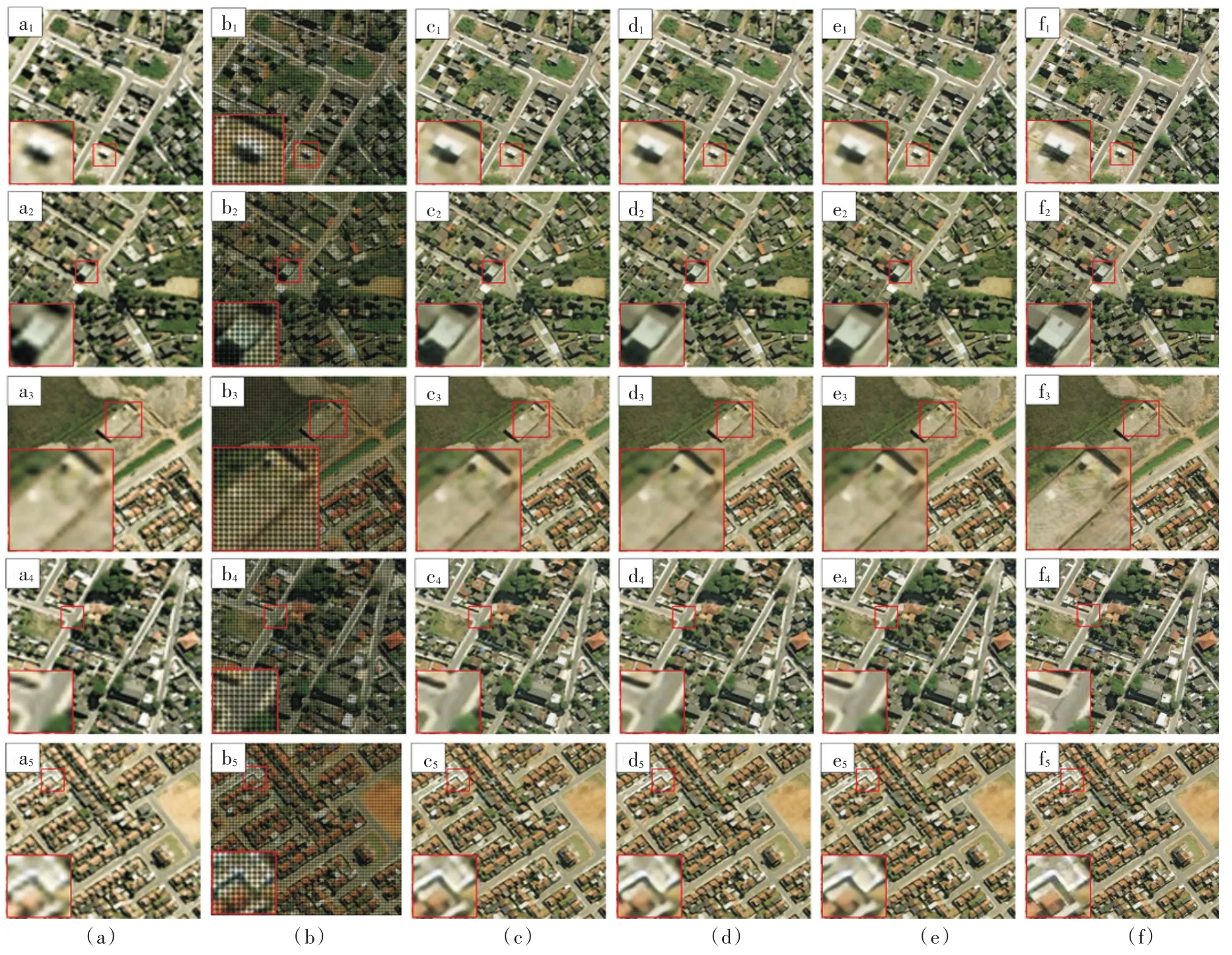

2.2.1 本文算法與FSRCNN對比 FSRCNN使用亞像素空間來取代SRCNN在像素域的計算,但是FSRCNN中輸入的低分辨率圖像塊大小為11×11像素,對應的高分辨率圖像塊大小為19×19像素,因此并不適用于尺度差異較大的衛星圖像,如圖4所示,FSRCNN有較好的重建效果,但是由于尺度問題,導致重建圖4(b)中圖像塊拼接處不平滑,客觀評分較低。

圖4 SpaceNet衛星圖像超分辨率結果的主觀對比:(a)雙三次插值,(b)FSRCNN,(c)LapSRN,(d)VISR,(e)本文算法,(f)高分辨圖像Fig.4 Subjective results of different super-resolution algorithms over SpaceNet satellite images:(a)bicubic,(b)FSRCNN,(c)LapSRN,(d)VISR,(e)our algorithm,(f)high resolution image

2.2.2 本文算法與LapSRN對比 LapSRN為多尺度的深度學習算法,但是LapSRN的多尺度信息融合主要是在訓練網絡中的特征域進行。而本文算法則是通過構建并行網絡,在殘差域中進行融合。殘差空間與圖像的高頻信息之間聯系更為緊密,且殘差域中數值較小,攜帶的信息量較小,能夠有更高的計算效率。

2.2.3 本文算法與VISR對比 VISR通過對低分辨圖像進行自相似填充,來避免網絡中的零填充帶來無用的信息,但是也因此將網絡改變為像素域。像素域中的重建會更多的關注于圖像中的低頻信息內容,而衛星圖像超分辨率任務中更希望恢復的是高頻信息,且在殘差域網絡中更為高效。

由圖4圖像重建客觀結果來看,該算法的重建圖像比其他算法的結果包含更多的細節信息。使用本文的算法重建的高分辨率圖像擁有更多的高頻信息。例如,對于小目標建筑,本文的算法使房屋的輪廓更清晰;對于大目標建筑,本文的算法在屋頂的紋理方面有更好的表現;對于建筑間的道路,本文的方法更清晰的重建出了道路中的細紋。總之,由本文的結果證明,使用多尺度的殘差網絡有助于衛星圖像的超分辨復原。

3 結 語

考慮到衛星圖像的特殊性,使用多尺度學習來提高卷積神經網絡對遙感衛星圖像不同尺度先驗信息的適應能力,通過融合多尺度殘差得到更準確的邊緣和紋理等高頻信息。在Space Net數據集上的實驗結果表明:提出的多尺度殘差深度神經網絡能有效地增強重建圖像中的高頻信息,相比前沿的衛星圖像而言具有更好的主客觀重建質量。