智能源于人、拓于工

——人工智能發展的一點思考

蔣昌俊,王俊麗

(同濟大學嵌入式系統與服務計算教育部重點實驗室,上海 201804)

一、前言

人工智能(AI)是與計算機和控制學科密切相關的一個研究領域,20世紀70年代以來被稱為世界三大尖端技術之一(空間技術、能源技術、AI),也被認為是21世紀三大尖端技術(基因工程、納米科學、AI)之一。隨著信息技術的不斷發展與向生產生活、經濟社會發展各方面的滲透,特別是在互聯網、大數據和云計算等新一代信息技術的飛速發展基礎上,AI以模擬人腦中信息存儲和處理機制等智能行為,使機器具有一定程度上的智能水平。目前AI領域的研究已經取得重要進展,特別是由于擅長發現高維數據中的復雜結構,深度學習正被應用于科學、商業和政府等領域,對信息科學領域的發展起到了很重要的推動作用。

本文將從兩個維度深入剖析和解讀AI發展過程,第一個維度是橫向視角,從來自于神經科學、人腦智能等智能啟發的源頭追溯,探討了AI各個分支重要的發展歷程,綜合分析AI的發展和演進過程;第二個維度是縱向視角,從與AI密切相關的幾個學科,包括計算機科學、控制科學、人腦智能、類腦智能等一些相關的科學的發展,通過它們在不同歷史時期與AI之間的相互作用,分析這些學科或領域之間的交融與歷史演進,更清晰地對AI的本質進行認知。

二、智能的定義與歷史演進

(一)智能的定義

在心理學領域,將智能定義為智力和能力的總稱。其中,“智”指進行認識活動的某些心理特點,“能”則指進行實際活動的某些心理特點[1]。下面將從與智能密切相關的人腦智能、AI、類腦智能三個方面探討智能的定義。

人腦是由一千多億個高度互聯的神經元組成的復雜生物網絡,是人類分析、聯想、記憶和邏輯推理等能力的來源。人腦智能正是反應人類大腦具有的感知世界、理解世界和管理世界的智慧和能力,其研究主要圍繞人類智能活動的規律,揭示大腦信息表征、轉換機理和學習規則,以期建立大腦信息處理過程的智能計算模型。伴隨著神經解剖學的發展,人腦信息處理的奧秘也正在被逐步揭示。在此基礎上,AI是模擬人類大腦信息處理、記憶、邏輯推理等智能行為的基本理論、方法和技術,通過應用計算機的軟硬件技術,構造具有一定智能的人工系統,讓計算機去完成以往需要人的智力才能勝任的工作。而類腦計算則渴求通過模仿人類神經系統的工作原理,開發出快速、可靠、低耗的運算技術。借助神經科學、腦科學與認知科學的研究成果,建立智能計算模型,使機器掌握人類的認知規律,是“類腦智能”的研究目標。

(二)智能的歷史演進

1950年,“AI之父”——英國人圖靈(A. M.Turing)的一篇里程碑式論文《機器能思考嗎?》為人類帶來了一個新學科——AI [2]。在1956年夏季的“達特茅斯會議”中,以麥卡錫(J. R. McCarthy)、明斯基(M. Minsky)、羅切斯特(N. Rochester)和香農(C. Shannon)等為首的一批有遠見卓識的年輕科學家,共同研究和探討用機器模擬智能的一系列問題,首次提出了AI這一術語,標志著AI的正式誕生。

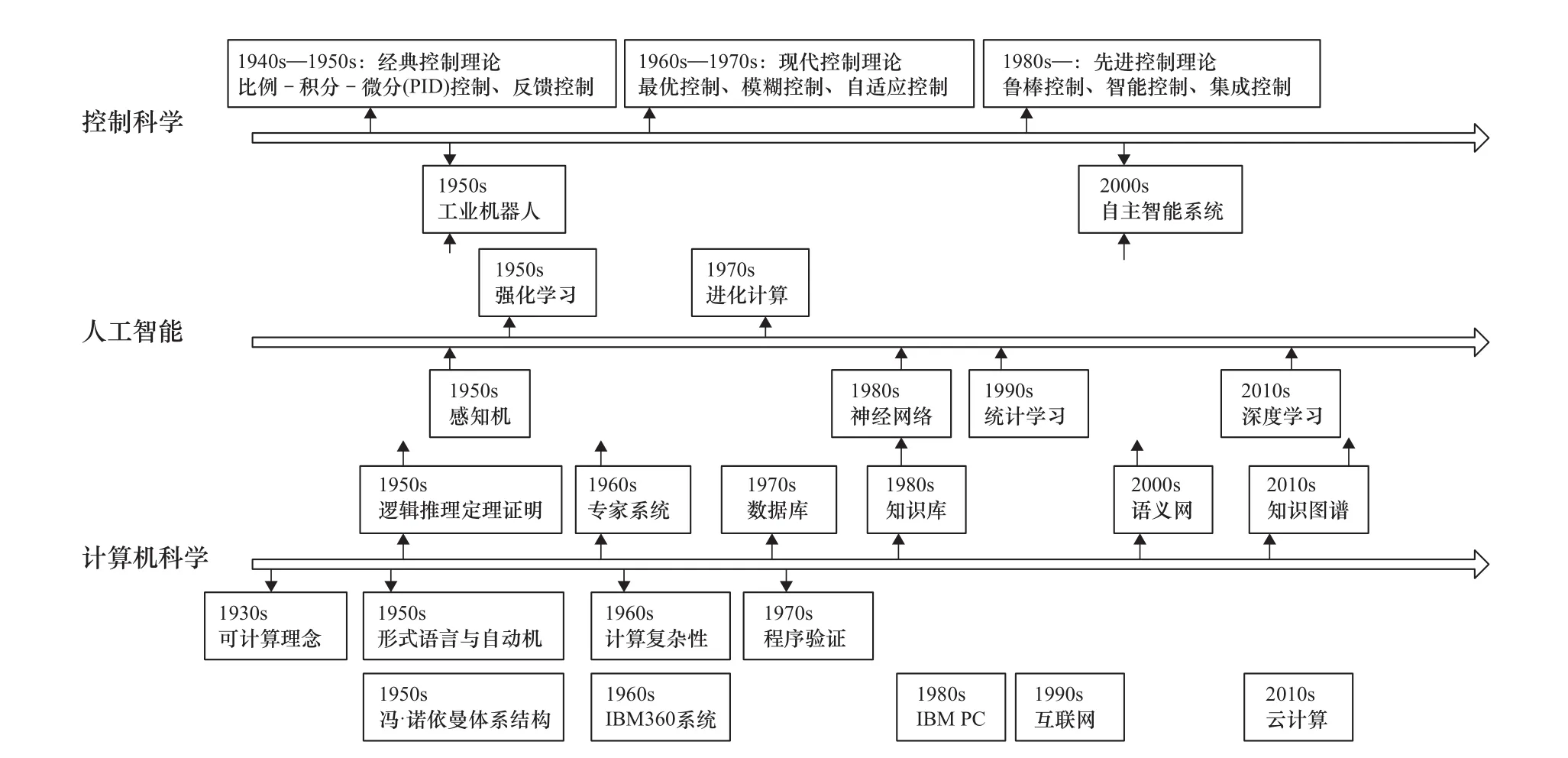

AI作為一門新興的科學技術,其發展演進過程與信息科學領域的演進過程密切相關,特別是計算機科學、控制科學這兩大學科。在AI的發展中,不同學科背景的學者對AI做出了各自的理解,提出了不同的觀點。為此,本文將首先綜合分析計算機科學、AI、控制科學發展過程中的主要演變環節和相互作用,如圖1所示。

首先在計算機科學發展過程中,從基礎理論來說,形成了一套堅實的計算機科學理論。20世紀30年代,可計算理論取得突破性進展,當時提出四個重要的計算模型:λ演算、圖靈機、哥德爾遞歸函數、Post系統。在理論意義上,這些模型之間在能力上是等價的,其中以圖靈機更接近常人計算,成為計算機的計算理論基礎。在此基礎上,20世紀50年代喬姆斯基(N. Chomsky)建立了形式語言的理論體系[3],從語言、文法到機器模型,給出了計算機科學的能級空間的層次劃分,對計算機科學有著深刻的影響,特別是對程序設計語言和編譯方法等有重要的作用。同時,20世紀60年代的計算復雜性和20世紀70年代的程序驗證理論都為整個計算機科學的發展奠定了堅實的理論基礎。另一方面是計算機技術的發展。20世紀50年代馮·諾依曼提出計算機體系結構,以程序存儲為基礎,程序指令和數據公用一個存儲空間。1945年,第一代計算機ENIAC誕生。1964年IBM宣布推出的一款計算機系統IBM360,在業界引起了轟動。到20世紀80年代,IBM一直在PC領域保持領先優勢。當時討論的是單個電腦的計算組成、原理和相應的機器,即單機系統。在這個范疇內,無論是理論還是技術都比較完備。后來,隨著時間的推進,20世紀90年代出現的互聯網,不同于單機系統的確定和完備,是一個非確定、開放共享、動態的系統。近些年,出現了物聯網、云計算、大數據等新一代信息技術,以及現在的云平臺。可以看出,計算機系統經歷了從單機時代進化到能夠共享資源的專用局域網系統,然后發展到資源可整合、共享的互聯網時代,逐步演進到目前資源動態分配、服務高度發達共享的網絡信息服務時代。

圖1 計算機科學、AI、控制科學的演進過程

基于這樣的計算機科學理論與系統的發展,AI發展最早可以追溯到20世紀50年代以符號主義為代表的邏輯推理和定理證明研究。之后,20世紀60年代其模擬人類專家的行為,概括成經驗性的規則形成規則系統,推演應用領域知識的生成。專家系統在醫療診斷、化學邏輯關系推演等方面發揮了很好的作用。但因為人工制定的規則一旦抽取出來就是固定的,不便于系統的成長和拓展,而且規則是確定的,專家系統難以處理一些新的問題,后來又出現了數據庫和知識庫,建立了知識單元支持規則的推演;語義網絡,將概念與概念間的關系組織起來形成網絡,后來又結合大數據出現了知識圖譜。可以看出這一層面是模擬和學習人的邏輯思維推演過程,這也正是受到底層計算機科學理論和系統結構的影響而發展起來的。

AI的另外一條主線是以連接主義為代表,模擬發生在人類神經系統中的認知過程。20世紀50年代提出的感知機是最早的模擬神經元細胞和突觸機制的計算模型。之后模擬人的神經系統,建立了多層感知機等人工神經網絡,一直到現在的深度學習都是沿著這層發展起來的。

與此同時,在AI發展過程中另外一個重要學派行為主義認為智能是系統與環境的交互行為。因此,形成了強化學習、進化計算等智能方法,可以看作是控制學科對AI的啟發。控制科學的發展經歷了三個重要時期:20世紀40至50年代:經典控制理論(PID控制、反饋控制),這一時期是單變量專一事務的控制,而且是試錯性的;20世紀60至70年代:現代控制理論(最優控制、模糊控制、自適應控制),在線性系統的狀態空間表示基礎上建立狀態方程,卡爾曼濾波最具代表性。20世紀80年代以后:先進控制理論(魯棒控制、智能控制、集成控制)具有代表性的有離散事件動態系統和混雜系統。此外,20世紀50年代開始的機器人也比較有代表性,后來出現了服務機器人,特別是最近的自主智能系統,如無人機、無人駕駛等。

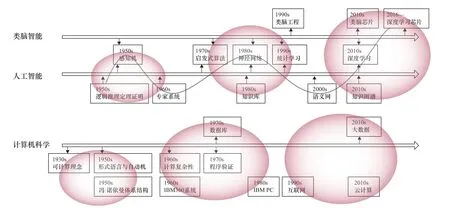

以上從三條主線縱觀了智能的情況和背景,另一方面,換個角度,從計算機科學和類腦智能的發展角度來看AI,如圖2所示。

AI從20世紀50年代開始經歷了三次浪潮。第一次浪潮是從1956年開始,其核心是符號主義,用機器證明的辦法去證明和推理一些知識,建立了邏輯定理證明、專家系統、知識庫等。但專家的經驗規則是有限的、確定的,難以進行知識的更新。所以在這個階段,人們原來期望的借助AI可以解決很多問題,實際上沒有得到解決,AI走向低潮。第二次浪潮是20世紀80年代,受到算法復雜性理論、硬件支撐系統、數據庫管理系統等方面的推動,以神經網絡為代表的連接主義再次受到學者們的廣泛關注,提出了多層感知機、反向傳播(BP)網絡等,成功解決復雜的非線性分類和回歸問題,再次引起了AI的熱潮。但當時機器的計算能力還是很有限,缺乏強力計算設備,同時缺少類似于人類社會這樣開放式的學習環境,無法提供神經網絡訓練所需的大量數據樣本,導致20世紀90年代神經網絡再次走向低潮,AI研究者將目光轉向統計學習。20世紀90年代互聯網興起,互聯網是一個不確定的、不斷成長的系統,包括云計算和大數據的出現,提供了一套更加有效地對數據獲取、處理的機制和平臺。這樣一來,再次刺激了神經網絡的復蘇,出現了以深度學習為代表的第三次浪潮。2006年,辛頓(G. Hinton)提出神經網絡深度學習算法,使得至少具有7層的神經網絡的訓練成為可能[4],由于能夠比較好地模擬人腦神經元多層深度傳遞的過程,在解決一些復雜問題時有著突破性的表現。與此同時,類腦智能研究也逐步引起學術界和工業界的關注,其核心是受腦啟發構建神經擬態架構和處理器,包括IBM TrueNorth等硬件方面模擬人的神經元芯片和深度學習芯片,如Google TPU、中國科學院的寒武紀系列等。

圖2 計算機科學、AI、類腦智能的演進過程

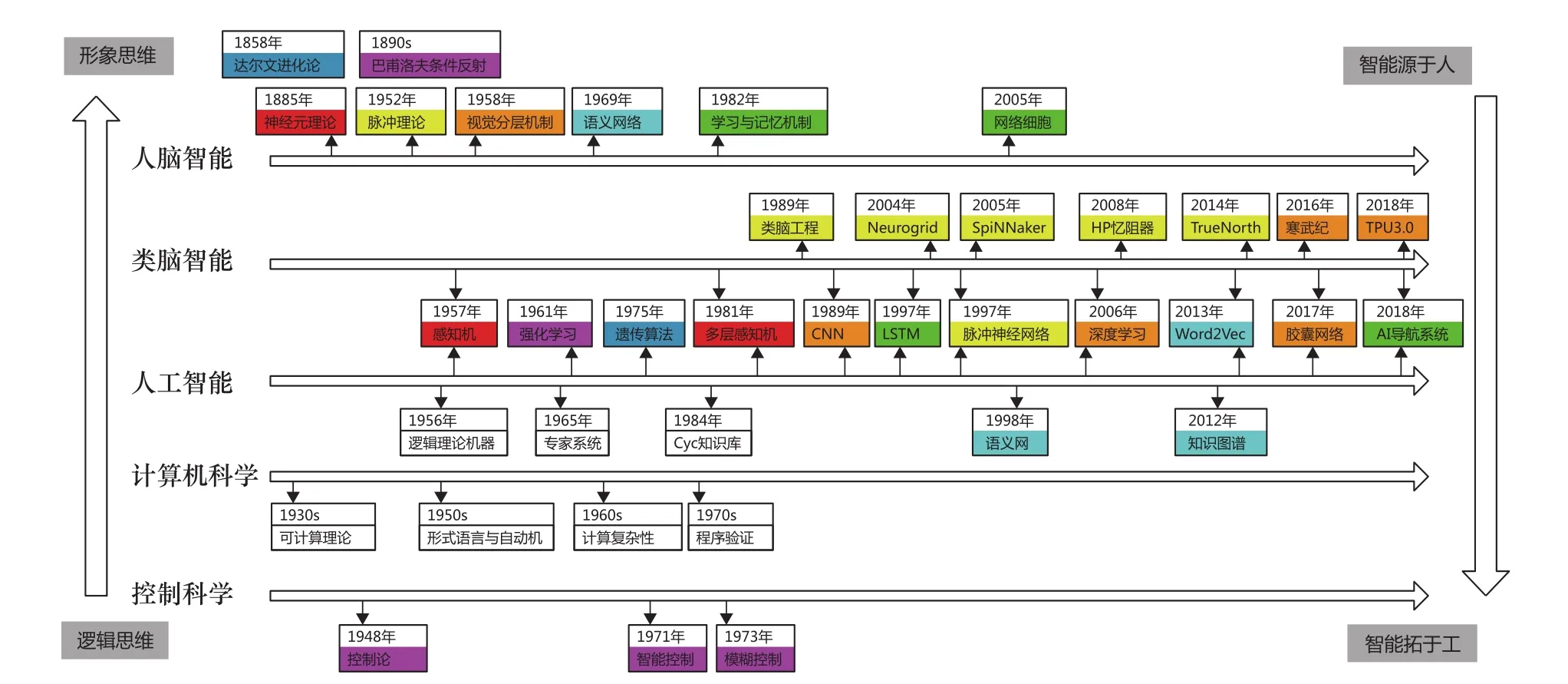

三、智能的驅動與發展關系

神經科學、腦科學與認知科學所揭示的有關腦結構與功能機制為構建智能計算模型提供了重要的啟發。本節將在上述發展脈絡分析的基礎上,從智能的起源開始追溯,分別從智能驅動的專題版塊進行闡述,包括:邏輯模型及系統、神經元及網絡模型、視覺神經分層機制、脈沖神經網絡模型、學習與記憶機制、語言模型、進化與強化,綜合分析AI的發展和演進過程,設計了智能版塊“五線譜”,其中5條線分別為5個不同的領域,7種不同顏色分別表示7個智能專題,如圖3所示。以下將從7個基本智能領域探討AI的重要發展歷程。

(一)邏輯模型及系統

人類神經系統具有邏輯思維的潛力,可以通過學習和訓練,逐漸形成具體的邏輯思考能力。以人的邏輯思維和推演過程為智能驅動,經歷了20世紀50至70年代初的邏輯推理與定理證明、之后發展到20世紀80年代出現大量的專家庫和知識庫、到1998年出現語義網、2012年谷歌提出知識圖譜等。可以看出,在這一層面AI領域通過模擬和學習人類的邏輯推理能力,經歷了邏輯推理與定理證明、專家庫、知識庫、語義網、知識圖譜等一些重要的歷程。

(二)神經元及網絡模型

人的大腦通過神經元傳輸信息,數量巨大的神經元構成了神經網絡。以神經元及網絡模型[5]為智能驅動,20世紀50年代出現模仿人類神經元模型的感知機[6~8];之后發展了模擬人腦信息傳遞與處理過程的多層感知機[9]、Hop field網絡[10]、波爾茲曼機[11],這些模型在當時都引起了較大轟動;在此基礎上,發展了可以通過學習獲得所需要的信息處理能力的BP算法[12],用于訓練多層神經網絡,以解決復雜學習問題。可以看出,在這一層面AI領域基于模仿生物大腦的結構和功能構建信息處理系統,發展了感知機、多層感知機、Hopifeld網絡、BP算法等一系列重要的人工神經網絡理論與方法。

圖3 智能版塊“五線譜”

(三)神經分層機制

以神經分層機制[13]為智能驅動,探索新型的神經網絡架構,具有代表性的成果有:1989年提出的模擬人腦可視皮層信息分層處理機制的卷積神經網絡[14]、2012年在百萬量級的ImageNet數據集合上奪冠的受限波爾茲曼機[15]、2017年提出一種新型神經網絡架構——膠囊網絡等,在計算和智能模擬能力上取得重要突破。在深度學習算法芯片方面,有代表性的包括寒武紀系列芯片[16]和谷歌的張量處理器(TPU)。可以看出,在這一層面AI領域基于人腦在腦區尺度進行層次化信息處理的機制,發展了卷積神經網絡、受限玻爾茲曼機、膠囊網絡等一系列重要的深度學習模型和架構。

(四)脈沖神經網絡模型

以脈沖神經網絡模型為智能驅動,基于人腦神經元之間突觸的信號傳遞機制與突觸可塑性法則,探索新型的脈沖神經網絡模型[17,18]和神經擬態架構,代表性成果有IBM TrueNorth [19]計算機架構,在并行計算中實現更高效的通信;憶阻器[20]作為一種特殊的電子元器件,具有與神經系統突觸十分相似的傳輸特性[21],同時具有布爾邏輯運算的功能[22],已被應用于脈沖神經網絡中構建多記憶突觸結構[23]。可以看出,在這一層面AI領域基于更高級的生物神經傳遞機制的模擬,發展了脈沖神經網絡和以IBM TrueNorth、憶阻器為代表的一系列神經擬態架構。

(五)學習與記憶機制

1997年提出的長短時程記憶網絡(LSTMs)是模擬人腦神經系統短期記憶與長期記憶機制,以學習與記憶機制為智能驅動,探索新型的神經網絡模型[24]。另一方面,神經科學家發現大腦神經系統中存在著神經元位置細胞和網格細胞,參與大腦記憶活動。受此啟發,2018年提出的基于網格細胞的定位模擬系統[25] 能自動生成與大腦細胞活動非常相似的網格模式,并幫助小鼠自動找到捷徑。可以看出,在這一層面AI領域基于模擬人類大腦通過學習來獲取和存儲知識的能力,取得了LSTMs和網格細胞定位系統等重要的成果。

(六)語言模型

以語言模型為智能驅動,探索機器的語義信息加工編碼機制[26],發展了語義Web和知識圖譜,將概念和實體組成具有層次的網絡系統;另一方面,在大腦神經系統視覺字母識別[27]的基礎上,探索基于神經網絡的統計語言模型,發展了神經網絡語言模型(NNLM)[28]、詞嵌入[29]、基于深度神經網絡的字母識別計算模型[30]等,廣泛應用于各種自然語言處理問題。可以看出,在這一層面AI領域基于模擬人類大腦對語言的學習和組織能力,分別發展了語義Web、知識圖譜和NNLM、詞嵌入等重要成果。

(七)進化與強化

以進化與強化為智能驅動,基于模擬生物進化過程中“優勝劣汰”的自然選擇機制和遺傳信息的傳遞規律等,發展了一系列的遺傳算法、進化策略、蟻群算法等進化方法,通過自然演化尋求最優解;另一方面,受控制理論[31]發展的影響,形成了動態規劃和馬爾科夫決策過程等最優控制方法,之后發展了Q學習、狀態-動作-獎勵-狀態-動作(SARSA)算法、深度強化學習網絡(DQN)等強化學習方法[32],通過與環境進行交互獲得的獎賞以指導行為。可以看出,一方面借鑒生物進化和遺傳學理論,發展了遺傳算法、進化策略、蟻群算法等進化方法;另一方面,基于模擬人類與外界環境交互式學習過程,發展了動態規劃、Q學習、SARSA算法、DQN等一系列重要的強化學習方法。

四、人工智能的現狀與趨勢

(一)人工智能的現狀

AI受到各國政府的高度重視。2016年10月,美國白宮發布報告《國家人工智能研究和發展戰略計劃》,提出了美國優先發展AI的七大戰略方向:投資研發戰略、人機交互戰略、社會影響戰略、安全戰略、開放戰略、標準戰略、人力資源戰略,將AI上升到國家戰略層面。2017年7月,我國國務院印發《新一代人工智能發展規劃》,提出了面向2030年我國新一代AI發展的指導思想、戰略目標、重點任務和保障措施,部署構筑我國AI發展的先發優勢,加快建設創新型國家和世界科技強國。2017年2月,中國工程院院刊《信息與電子工程前沿(英文)》出版了“AI 2.0”專題,對“AI 2.0”中所涉及的大數據智能、群體智能、跨媒體智能、混合增強智能和自主智能等進行了深度闡述[33~39]。

圖4 AI發展的特點

(二)人工智能的發展趨勢

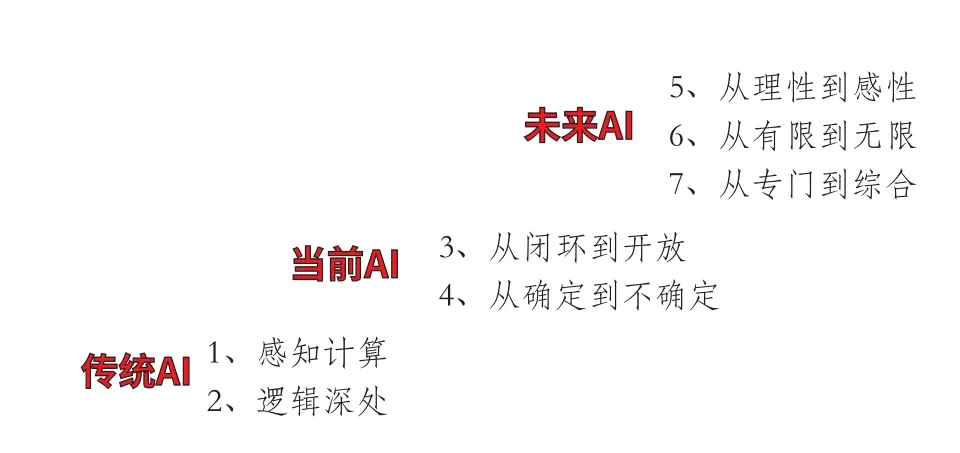

首先是對AI發展特點的認知,如圖4所示。傳統的AI注重從感知到認知的過程,實現從邏輯到計算的不斷提升。當前的AI由弱到強的智能,是從閉環到開環、從確定到不確定的系統。未來的AI將是從理性到感性,從有限到無限,從專門到綜合。這樣的過程更具有挑戰性,所以AI發展之路還很漫長,現在只是始于足下,深入探索傳統AI,并為向當前AI和未來AI邁進奠定基礎。

目前,AI的基礎理論和技術已取得了一系列重要的研究成果。未來計算機科學、AI、類腦智能、人腦智能的研究還有許多亟待解決的問題與挑戰。

1. 互聯網的計算理論

當前互聯網基礎設施的不斷完善和提升,應用創新和商業模式創新層出不窮,在智能交通、互聯網金融、智慧醫療等領域已經取得了一些初步應用成果。但是互聯網計算理論的研究有待加強。早期的單機系統具有堅實的理論基礎,但互聯網是一個開放的不確定系統,以智能應用為垂直場景,在確定有效前提或邊界的條件下,建立互聯網的計算理論將具有挑戰性。

2. AI的演算和計算的融合

盡管深度神經網絡在語音識別和圖像識別等任務中顯示出很大的成功,現有的深度學習結構還遠遠不及生物神經網絡結構復雜,目前的神經網絡模型大都側重于數據的計算層面,而事實上一個高級的智能機器應該具有環境感知與邏輯推理的能力。將AI的演算和計算進行融合,反映人腦的交互迭代過程,這樣的交互和融合將是下一步的主要研究方向。

3. 類腦智能的模型和機理

在構建類腦認知模型中,目前脈沖神經網絡的神經元以電脈沖的形式對信息進行編碼,更接近真實神經元對信息的編碼方式,能夠很好地編碼時間信息。但由于脈沖訓練缺乏高效的學習方法而且需要耗費大量算力,在性能上與深度網絡等模型還存在一定差距。未來,兩類模型仍需要不斷從腦科學中吸取營養并不斷融合,發展性能更好、效能更高的新一代神經網絡模型。

4. AI對神經科學的推動作用

正如上文所述,目前AI得以在許多方面達到人類水平,與來自神經科學的啟發是密不可分的。心理學家和神經科學家發現與揭示的關于大腦智力的相關機制,激發了AI研究人員的興趣,并提供了初步線索。另一方面,通過AI領域定量地形式化研究,對神經科學智能行為研究的必要性和充分性提供洞察,例如,依據機器學習的重要進展提出假說:人類大腦可能是由一系列互相影響的成本函數支撐的混雜優化系統[40],將為神經科學的實證研究提供新的線索。因此,未來神經科學與AI之間將有更好的合作并帶來良性循環。

5. 反饋計算的算法設計與控制系統的能級

計算機科學基礎的理論有:可計算性理論、計算復雜性理論和算法等,定義了機器不能算和能算、計算的時(空)開銷層次、算法的設計優化,建立了計算能行和度量開銷的計算理論。還有形式語言自動機理論,定義了有限自動機、上下文無關自動機、上下文有關自動機、圖靈機四個能級,建立了機器、語言和文法的能級等價及層次關系,對計算機科學有著深刻的影響,特別是對程序設計語言的設計和編譯方法等方面具有重要的作用。而控制科學的優勢是反饋機制,在迭代過程中不斷修正迭代梯度等,快速接近目標。但在做控制器設計時缺少相應的能級理論,反過來,在計算機的迭代計算過程中,從起點到終點,給定迭代梯度,沒有中間過程的反饋修正。因此,計算機科學和控制科學之間不斷地互相借鑒,創造出更智能、更有效的理論方法,值得下一步探索研究。

五、結語

本文圍繞AI的發展和主要研究進展,深入探討了與AI密切相關的計算機科學、控制科學、類腦智能、人腦智能等學科之間的交融與歷史演進;結合腦神經科學對AI的潛在啟發,從邏輯模型及系統、神經元網絡及模型、視覺神經分層機制等角度闡述AI的歷史演進;最后,分析了AI的發展現狀,并指出其特點和未來發展趨勢。可以說,以神經科學、腦科學與認知科學所揭示的有關腦結構與功能機制的研究成果為構建智能計算模型提供了重要的啟發,為智能之源;而以計算和控制的數學物理等形式化、模型化開展分析與優化,為智能之工,概括起來即為AI。