基于生成式對抗神經網絡的手寫文字圖像補全

李農勤,楊維信

基于生成式對抗神經網絡的手寫文字圖像補全

李農勤1,楊維信2,3

(1. 東華理工大學經濟與管理學院,江西 南昌 330013;2.華南理工大學電子與信息學院,廣東 廣州 510641;3. 牛津大學數學研究所,牛津 OX26GG)

手寫文字圖像補全是圖像補全問題中一個重要研究分支,其難點在于圖片中具有無約束書寫風格的文字的結構關系補全。為了模擬實際中復雜和困難的應用情景,在圖像補全研究工作的啟發下,針對大類別、小樣本、多風格、未知語種等復雜情況下進行手寫象形文字圖像補全。采用全局和局部一致性保持的生成式對抗神經網絡(GLC-GAN)。在大類別多風格的手寫文字圖像補全中,補全圖片往往因可能的補全候選很豐富而導致補全區域模糊不清。為此,提出兩級補全系統:第一級粗補全模塊考慮文字結構的完整性,第二級細補全模塊實現文字的清晰化、細致化。通過在大類別手寫漢字數據庫CASIA-HWDB1.1上的實驗,驗證了該兩級系統的有效性,同時分析系統在不同書寫風格和不同缺失區域情況下的補全效果。

生成式對抗網絡;手寫文字;圖像補全;結構補全;自監督學習

圖像補全(image completion)是對圖片中缺失或受污染的部分進行填充,使得填充后的圖片盡可能完整和逼真。圖像補全是近年來在機器學習領域中非常熱門的研究課題,在圖片修復、編輯或重構等應用中起到重要作用[1-3]。圖像補全需要注重圖片中內容的紋理和語義結構關系。目前較多研究針對自然場景圖片中的紋理信息的補全,補全后圖片比較逼真[1-2,4]。在對圖片內容的結構補全上,目前較多的研究工作在人臉圖片上展開[2,4]。通過對大量歸整后的人臉圖片進行訓練,人臉上缺失(故意挖空)部分能夠被補全,保持了人臉的結構的完整性。然而,目前的大部分方法在面對具有強語義結構關系同時又復雜多變的物體時,補全結果不佳[5]。例如文獻[2]最后展示了人體圖像補全時出現的錯誤,其中頭部像素難以合理補全。文字補全問題是圖像補全的一個分支,與自然場景中紋理信息的補全不同,文字補全重點需要解決的是結構關系信息的補全,可以作為研究結構信息補全的重要研究對象。文字補全除了具有重要科研意義外,還具有很高的社會應用價值。諸如埃及象形文字、蘇美爾文、古印度文和中國甲骨文、中國古體字等象形文字,其書寫載體一般是石頭、石壁、龜甲、竹簡等。受到長期自然因素和人為因素的影響,書寫載體會有不同程度的侵蝕和破損,載體上的文字也隨之出現部分缺失情況,此時,文字圖像補全的工作能在一定程度上緩解這種不利影響。進一步地,對于未破譯的象形文字,由于文本內容無法獲取,人工的文字補全將因為不能運用文本間的語言模型而變得更加困難,此時更能體現無類別標記的文字圖片自動補全研究的意義。為了研究圖片中的結構關系的自動補全問題,輔助歷史考古應用場景中的文字圖片分析,本文著重研究手寫文字圖像補全,簡稱手寫文字補全或文字補全。

現有的針對文字補全的研究[6-7]主要是在0到9的10類數字圖片上進行的,主要利用MNIST數據集[8]或SVHN街景房屋號碼數據集[9],其每類數字均有大量的訓練樣本,例如MNIST中每類數字有6 000個手寫數字樣本;SVHN數據集共有 73 257張訓練圖片,其中每張圖片展示了一個或多個印刷體數字。大量的訓練數據給深度學習模型的優化帶來便利,使得最后數字圖像補全效果很好。然而,實際應用中的文字圖片情況非常復雜:①常用文字的類別數遠遠大于10類,大類別數使得類與類之間的相似程度也大幅提升;②大類別數的數據集在采集過程中不能保證每類文字都有大量的訓練樣本;③手寫文字與較為規整的印刷體文字相比,擁有各式各樣的書寫風格,大大增加了補全的復雜程度。

鑒于目前針對上述復雜文字情況下的圖像補全研究的缺乏,本文的研究問題限定為大類別、小樣本、多風格、未知語種的手寫象形文字補全。又鑒于漢字是上古時期各大文字體系中唯一傳承至今的文字,本文采用漢字作為研究對象。相比于目前其他語言的文字而言,漢字的類別數特別大,例如GB18030-2005收入的漢字個數達到七萬多個,其中最常用的漢字也有3 755個;而且,漢字是目前世界上使用人數最多的文字,不同人書寫風格各異,造成手寫漢字數據的多樣性,因此也提高了文字補全的復雜性。實際歷史文檔的應用場景中,往往會出現未知語種的象形文字;為了模擬這種情況,本文研究文字補全只使用每個漢字樣本的圖片像素信息,并不使用漢字的類別標簽信息。最后,大部分歷史文檔在收集和整理中存在困難,這也往往造成可供研究的文字樣本較為缺乏,因此,本文研究采用小樣本的文字數據進行實驗。

在自然圖片的補全中,目前很多研究方法采用了生成式對抗網絡[10]。其中,文獻[2]中基于全局和局部一致性保持的生成式對抗網絡(global and local consistent generative adversarial networks,GLC-GAN)在圖片的判別網絡中設計了2條支路,分別從全局和局部的角度來衡量待填充部分的完整性和逼真程度,促使生成網絡得到的填充部分能兼顧全局完整和局部逼真。受到該工作的啟發,考慮到在文字補全中全局結構信息的重要性,本文采用GLC-GAN模型來實現無約束手寫文字的補全。針對大類別無類別標簽手寫文字補全中遇到的補全區域圖片的模糊問題,提出兩級補全方案:第一級補全模塊結合全局和局部考慮各種可能的補全情況得到模糊的粗補全;第二級補全模塊則進一步將圖片做細致化、清晰化處理。通過在手寫數據集CASIA-HWDB1.1[11]上進行實驗,驗證了本文方法的有效性,同時探究和分析了GLC- GAN模型在不同的書寫風格和不同的缺失區域情況下的填充補全效果。

1 兩級生成式對抗網絡的文字補全

1.1 基于全局和局部一致性的生成式對抗網絡

生成式對抗網絡(generative adversarial network, GAN)最初是為了訓練基于卷積神經網絡的生成網絡而設計的一種自監督學習方法[10]。其中自監督是指該網絡的訓練無需額外數據標簽信息作為監督信號,僅通過判斷生成產物的真實程度來優化模型。一般來說,GAN由網絡和網絡2部分組成,即生成網絡(generative network)和判別網絡(discriminative network)。圖像補全中,生成網絡通過將給定的圖片作為輸入,輸出一張補全圖片。判別網絡則負責判別由補全的圖片是否“真實”。GAN的訓練過程是和兩者的相互迭代博弈和促進的過程,最終理想狀態是判別網絡難以判定生成圖片的真偽,即認為此時的能生成能以假亂真的圖片。

對于圖像補全任務,不僅需要令填補的部分圖片內部更加逼真,而且還需要使填補后的全圖也更加連貫和逼真。為此,文獻[2]設計了全局和局部一致性保持的GAN框架。該框架下,判別網絡由2個分支組成:全局分支1和局部分支2。2個分支網絡的最后一層瓶頸特征經過拼接后,再通過一個全連接層,得到一個數值范圍在0到1之間的置信度輸出。在GLC-GAN的訓練中,網絡的優化包含了2種損失函數:加權均方誤差損失函數L[12]和GAN損失函數[10]。其中,L的計算公式為

其中,為完整的無缺失的圖片;M為缺失區域位置的掩膜;(,M)為生成網絡的輸出圖片;⊙為對應位置元素相乘。由此可見,L是衡量真實圖片和偽造的圖片之間的差異。對于另一部分,GAN的訓練是min-max優化過程,目標函數為

其中,為判別網絡;M為隨機缺失區域位置的掩膜。結合2種損失函數,GLC-GAN模型最終的目標函數為

1.2 兩級文字補全系統

文字補全的關鍵要素是結構合理和圖片清晰,盡管通過GLC-GAN能夠使得結構更加合理,但補全圖片的模糊現象仍然顯著。對于一般圖片的紋理補全任務中,缺失區域四周的鄰近紋理信息給補全圖片帶來很多紋理約束,因此較容易補全得到清晰逼真圖片;然而對于注重結構關系的文字而言,圖片中缺失區域之外的剩余部分僅能夠提供有限的結構約束,換句話說,缺失區域可供選擇的補全圖片的搜索范圍很大。進一步地,對于手寫體文字,就算是一般被視為具有相同結構的同類別文字,也會因為多樣的書寫風格的存在,在缺失區域呈現多樣的補全圖片候選。

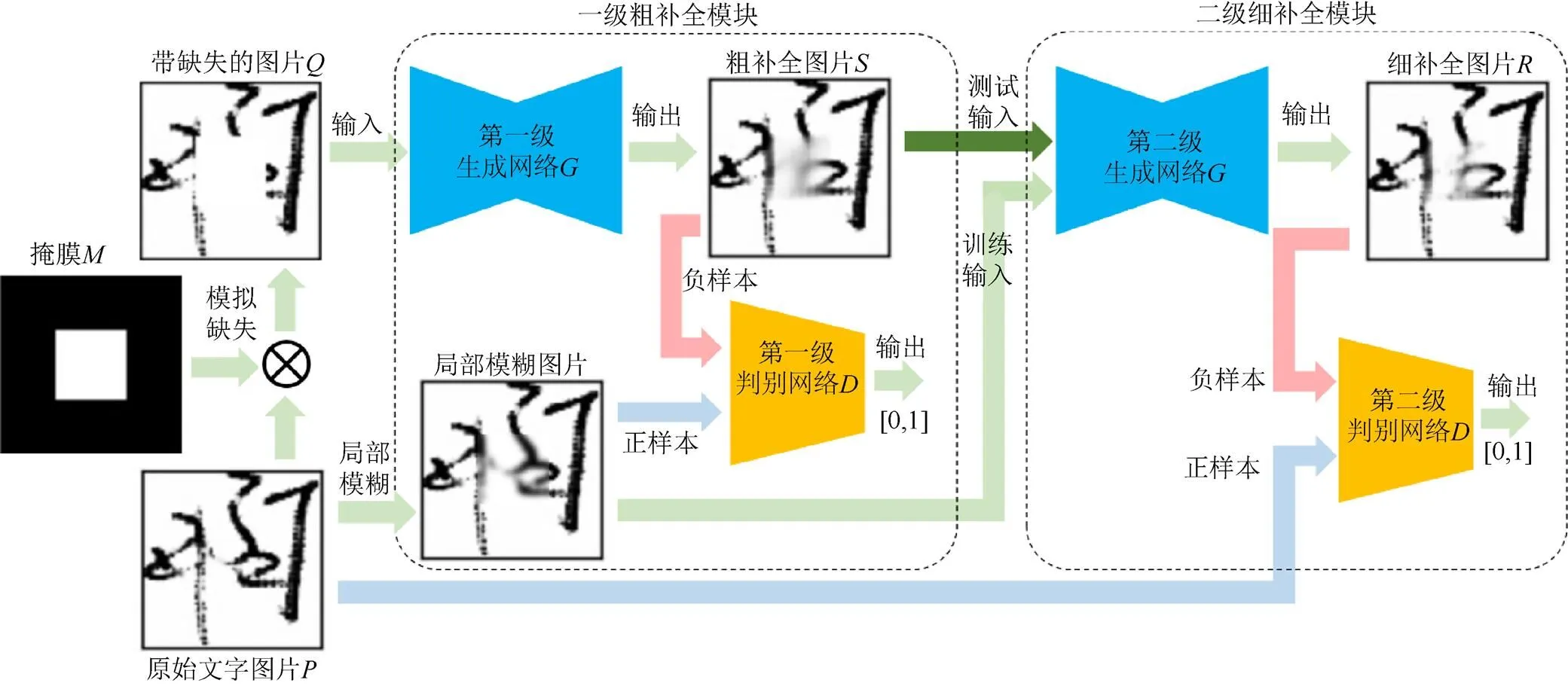

為了使補全區域清晰化,引入基于GLC-GAN的兩級補全模塊:第一級GAN注重結構的合理,第二級GAN注重圖片的清晰。圖1展示兩級手寫文字補全網絡的總框圖。

第一級GLC-GAN網絡基本上采用1.1小節的架構,但對于網絡中標記為1的樣本不再是數據庫中真實樣本,而是在真實樣本基礎上,對局部區域進行高斯模糊,得到局部模糊樣本。局部模糊區域的抽取規則和缺失區域一致,高斯模糊的窗長參數是在預設定的范圍內的隨機值(本文在一半的訓練迭代中選取[3,15]內的隨機奇數值作為高斯模糊的窗長,另一半的迭代中采用原始圖片,即不進行高斯模糊操作)。局部模糊樣本相對于真實樣本而言,在第一級的判別網絡中,為生成網絡輸出圖片的清晰程度提供了容忍度,從側面增大了網絡做出判決的難度,使第一級的不再只關注圖片的清晰,而更多是去考慮補全后圖片在結構上是否合理,進而促進第一級生成網絡給出結構合理的補全結果。

圖1 兩級手寫文字補全系統的總框圖

第二級GLC-GAN網絡是清晰化補全模塊。在訓練中,的輸入是隨機生成的局部模糊樣本(高斯模糊窗長取[11,51]范圍內隨機奇數),監督信號則是數據庫中的真實樣本。在實際應用中,的輸入是第一級生成網絡輸出的較模糊的粗補全圖片,輸出則作為最終的補全結果。值得一提的是,訓練階段采用隨機生成的局部模糊樣本是因為該模塊只需專注于在不改變圖片文字內容的前提下,使圖片清晰化,而不需要考慮如何改變文字結構。

圖1中,給定一個完整書寫的大小的原始文字圖片,隨機生成一張大小的二值掩膜,掩膜中數值為1的正方形區域代表被污染后文字的缺失區域,區域的位置和大小是隨機的。此時,帶缺失區域的文字圖片便可通過文字圖片和掩膜計算得到

帶缺失區域的文字圖片經過第一級GAN的生成網絡后得到粗補全圖片。圖片經過第二級GAN的生成網絡后得到細補全圖片,即最終補全結果。本文所有GAN都采用上一小節介紹的GLC-GAN,即判決網絡包括全局分支和局部分支:前者的輸入是粗補全圖片(對于第二級GAN則是圖片),后者的輸入則是由預定義二值掩膜從對應的全局圖中抽取出的局部區域圖。本文中的GLC-GAN模型的相關超參數與文獻[2]中的大體一致,不同之處在于:①由于文字圖片比自然場景圖片未見太多紋理細節,因此圖片被統一歸一化成128×128的大小;②在訓練階段,隨機缺失區域的邊長大小是32到64之間的隨機值,即缺失區域最大占原圖的四分之一,最小占原圖的十六分之一。

2 實驗結果與分析

2.1 實驗數據庫

CASIA-HMDB1.1[11]是經典的脫機手寫漢字數據庫。脫機表示手寫漢字數據是以圖片形式呈現。該數據庫包含了3 755類的常用漢字,每類漢字大約由300位書寫者提供樣本。本文實驗模擬特殊且困難情況下的文字補全,主要針對大類別、小樣本、多風格、未知語種的象形。為了體現大類別,實驗考慮了數據庫中所有類別(即3 755類)的漢字。為了模擬小樣本、多風格應用場景,在模擬訓練階段只使用前20位書寫者的樣本,其余書寫者的手寫樣本都用于效果的檢驗。為了突出未知語種的情況,所有樣本的類別標簽信息均未用于本文的實驗中,本文模型都是通過自監督學習得到。

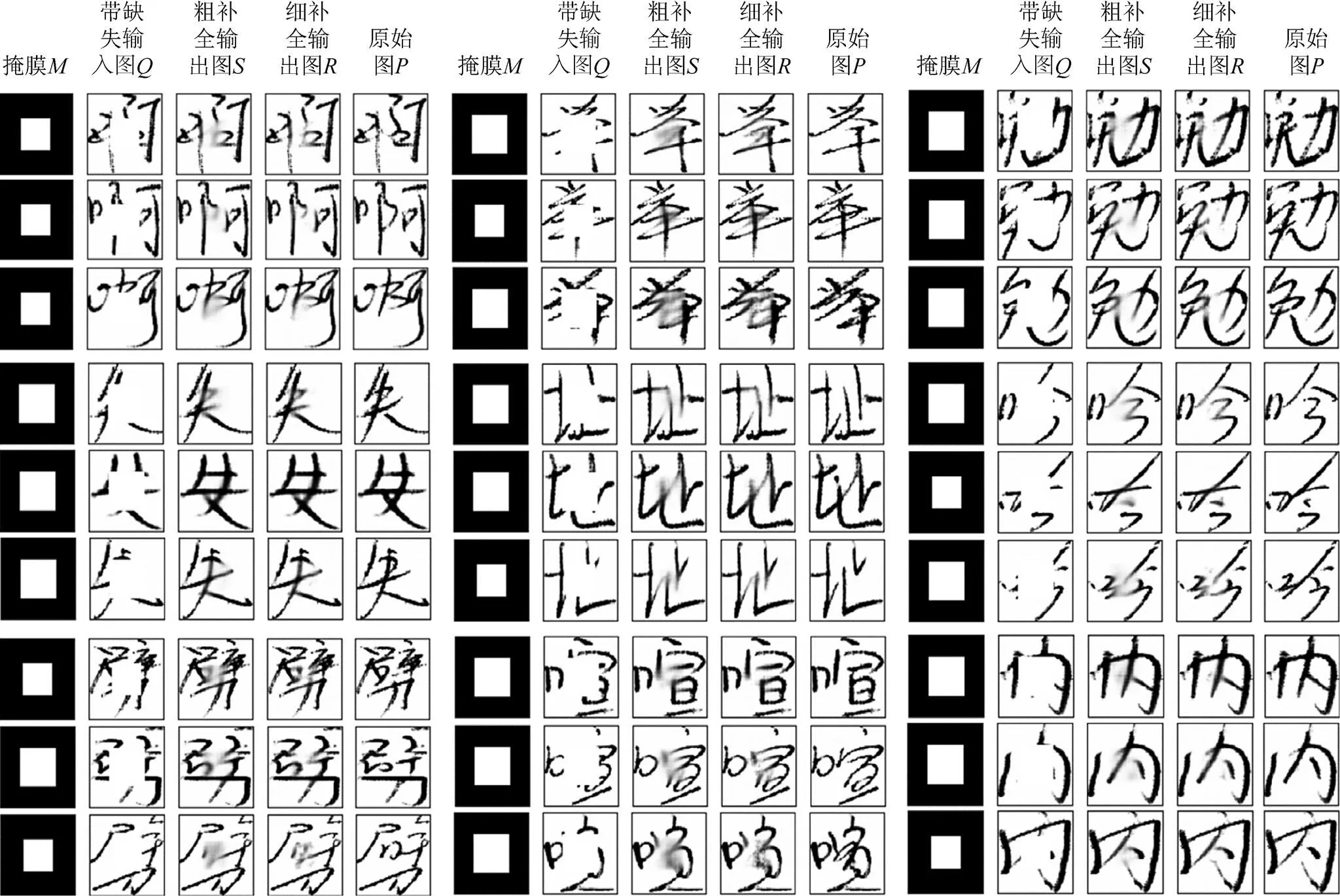

2.2 不同書寫風格的文字補全效果

由于不同個性風格的存在,相同類別(即相同結構)的文字在書寫中也會呈現多樣化,此時文字補全的難度也有差異。如圖2所示9組補全結果,每組結果來自同類別且由不同書寫者提供的漢字。本文掩膜中的缺失區域固定在中心位置,且區域大小為40×40或50×50,粗補全輸出圖是在只采用一級GLC-GAN下得到最終補全效果,即在該GLC-GAN的訓練中只利用原始真實樣本作為判決網絡的正樣本。

圖2 不同書寫風格的漢字樣本的兩級補全效果

由圖2每組結果可見,大部分情況下,雖然帶缺失區域的圖會在一定程度上影響人們對文字的辨別,但經過輸入生成網絡后得到補全圖都能較好地恢復文字的缺失信息。雖然圖相比于原圖常呈現細節差異,但大部分情況下結構信息的補全較為合理。圖3(a)展示了在某些筆畫整體缺失的情況下,仍能夠補全缺失筆畫。再者,通過對比圖和圖,可見本文提出的兩級補全方法能明顯抑制補全區域的模糊情況,改善補全圖片的清晰度。圖3(b)放大顯示3個模糊像素被抑制的例子。手寫文字補全問題非常具有挑戰,圖3(c)展示了一些補全效果不佳的例子,由其中前2個的例子可見,“寞”字在缺失中間的“艸”和“曰”后,可供候選的補全文字較多,如“賓”或“實”字,此時補全結果可能和原始文字具有不同的類別。第3,4個例子展示了補全區域出現冗余筆畫的情況。最后一個例子則展示了在粗補全模塊結果非常模糊的情況下,本文的細補全模塊無法使圖片清晰化。這些問題值得進一步研究和解決。

(a) 筆畫整體缺失情況下的文字補全效果(b) 細補全模塊抑制 模糊像素例子(c) 補全效果不佳的例子

2.3 不同缺失區域的位置和大小對文字補全的影響

除了文字的多樣書寫風格外,缺失區域的位置和大小對文字補全的影響也很大。圖4中,第1行展示不同缺失區域位置和大小的掩膜,接下來4行則展示了4個漢字樣本在不同的掩膜作用下的缺失區域的補全效果。缺失區域從小到大依次設定為30,40和50。如圖所示,當缺失區域為30×30時,生成網絡能夠較好地補全文字,但隨著缺失區域擴大至50×50,補全變得困難,例如“藹”字的“艸”字頭缺失筆畫段或是“啊”字在缺失“口”部件時均難以填補。其中的原因可能是,“藹”去掉“艸”字頭后是“謁”字,“啊”字去掉“口”字旁后是“阿”字,即這類漢字缺失某些區域后并不是無意義的筆畫集合,而是變成了另一個類別的漢字,此時帶缺失區域的漢字在模型看來仍然是逼真且合理的漢字,因此模型難以對其進行補全。與之相反,如圖4中的“愛”字,由于在數據集的3 755類中具有較少的相似類別,因此就算缺失區域達到50×50大小,補全效果仍然較好。另外,當缺失區域是在文字中風格特殊的部件或筆段的位置時,雖然補全后漢字的類別能夠大致保持不變,但特殊風格被恢復的難度較大,例如圖中“按”字中“扌”的連筆風格在缺失補全后丟失。

圖4 不同缺失區域位置和大小下的文字補全效果

3 結束語

本文針對大類別、小樣本、多風格、未知語種的手寫象形文字,采用全局和局部一致性保持的生成式對抗網絡實現了帶缺失區域的文字圖像補全。針對結構圖片的補全中遇到的模糊問題,本文提出兩級補全模塊,第一級模塊偏重文字的結構補全,第二級模塊專注文字補全的清晰化。通過大量的實驗,驗證了本文解決方案的有效性;同時,對不同大小和位置的缺失區域的實驗分析可知,書寫風格趨于大眾化的、相似字較少的漢字在缺失補全后的效果更佳。

之后的研究工作可從以下3個方向展開:①在類別標簽輔助下的文字補全研究。文字類別標簽的輔助下,可以考慮使用類似InfoGAN[13]加入分類器,通過分類器的類別監督信息,使生成網絡趨向于輸出更容易識別的補全文字圖片,甚至將補全后文字的易識別性(即識別輸出的置信度大小)作為衡量結構信息補全效果的評價指標。②在語料輔助下的文字補全研究。通過對某語種的大量語料進行統計分析,可以得到該語種的語義模型,一元語義模型就可以在單字補全中引入文字在日常使用的頻繁程度;多元語義模型能夠在篇幅級別的文字補全中考慮上下文信息,從而減少補全時模棱兩可的情況,改善補全模糊問題。③書寫風格保持的手寫文字補全。一般的生成網絡會盡可能給出大眾化的補全結果,但實際應用中有時會期望補全后文字能夠保持風格不變;解決方案可以考慮在判別網絡中加入書寫風格一致性的監督信號。

[1] YANG C, LU X, LIN Z, et al. High-resolution image inpainting using multi-scale neural patch synthesis [C]// 2016 The IEEE Conference on Computer Vision and Pattern Recognition. New York: IEEE Press, 2016: 3.

[2] IIZUKA S, SIMO-SERRA E, ISHIKAWA H. Globally and locally consistent image completion [J]. ACM Transactions on Graphics, 2017, 36(4): 1-4.

[3] 王坤峰, 茍超, 段艷杰, 等. 生成式對抗網絡GAN的研究進展與展望[J]. 自動化學報, 2017, 43(3): 321-332.

[4] YU J, LIN Z, YANG J, et al. Generative image inpainting with contextual attention [EB/OL]. (2018-03-21). [2019-09-17]. https://arxiv.org/abs/1801. 07892.

[5] HUY V V, DUONG N Q K, PEREZ P. Structural inpainting [EB/OL]. (2018-03-27). [2019-09-17]. https://arxiv.org/abs/1803.10348.

[6] PATRICIA V, JOAN S, COLOMA B. Semantic image inpainting through improved wasserstein generative adversarial networks [EB/OL]. (2018-12-03). [2019-09-17]. https://arxiv.org/abs/1812.01071.

[7] KALTWANG S, SAMANGOOEI S, REDFORD J, et al. Imagining the unseen: Learning a distribution over incomplete images with dense latent trees [EB/OL]. (2018-08-14). [2019-09-17]. https://arxiv.org/abs/1808. 04745.

[8] LECUN Y. The MNIST database of handwritten digits [EB/OL]. (1998-11-01). [2019-09-17]. http://yann. lecun. com/exdb/mnist.

[9] NETZER Y, WANG T, COATES A, et al. Reading digits in natural images with unsupervised feature learning [C]//In Neural Information Processing Systems Workshop on Deep Learning and Unsupervised Feature Learning. New York: Curran Associates, 2011: 5.

[10] GOODFELLOW I, POUGET-ABADIE J, MIRZA M, et al. Generative adversarial nets [C]//Proceedings of the 27th International Conference on Neural Information Processing Systems. New York: Curran Associates, 2014: 2672-2680.

[11] LIU C L, YIN F, WANG D H, et al. CASIA online and offline Chinese handwriting databases [C]//2011 IEEE International Conference on Document Analysis and Recognition. New York: IEEE Press, 2011: 37-41.

[12] PATHAK D, KR?HENBüHL P, DONAHUE J, et al. Context encoders: Feature learning by inpainting [C]// 2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). New York: IEEE Press, 2016: 2536-2544.

[13] CHEN X, DUAN Y, HOUTHOOFT R, et al. Infogan: Interpretable representation learning by information maximizing generative adversarial nets [C]//In Advances in Neural Information Processing Systems. New York: Curran Associates, 2016, 2172-2180.

Handwritten Character Completion Based on Generative Adversarial Networks

LI Nong-qin1, YANG Wei-xin2,3

(1. School of Economics and Management, East China University of Technology, Nanchang Jiangxi 330013, China; 2. School of Electronic and Information Engineering, South China University of Technology, Guangzhou Guangdong 510641, China; 3. Mathematical Institute, University of Oxford, Oxford OX26GG)

Handwritten character completion is an important research topic in image completion. Its challenge comes from the completion of the structural relationships in handwritten characters with unconstrained handwritten styles. To simulate the complicated and difficult situations in the real-world applications, the paper focuses on handwritten pictographic characters with large category, small sample size, multiple unconstrained handwritten styles, and unknown language (i.e., with no access to the class label of each character). Inspired by the progress in natural image completion, the generative adversarial network with global and local consistency was leveraged to achieve handwritten character completion. Under the circumstances of large category and various writing styles, the completion areas of character completion suffer from low-fidelity because of the large number of potential completion candidates. To solve this problem, a two-stage character completion system was proposed: the first stage is coarse-grained completion module ensuring the completeness of the character; the second stage is fine-grained completion module improving the sharpness and details of characters. Extensive experiments were conducted on CASIA-HWDB1.1 to validate the effectiveness of the two-stage system and analyze the completion performance under different writing styles and different conditions of missing area.

generative adversarial network; handwritten character; image completion; structure completion; unsupervised learning

TP 391

10.11996/JG.j.2095-302X.2019050878

A

2095-302X(2019)05-0878-07

2019-04-22;

2019-06-09

李農勤(1960-),男,江西廣昌人,副教授,碩士。主要研究方向為運作管理等。E-mail:nqli@ecit.en

楊維信(1990-),男,廣東廣州人,研究員,博士后。主要研究方向為機器學習、計算機視覺等。E-mail:wxy1290@163.com