一種用于人體行為識(shí)別的CNN-BLSTM模型

鄒小武,盛蒙蒙,毛家發(fā),盛偉國(guó)

1(浙江工業(yè)大學(xué) 計(jì)算機(jī)科學(xué)與技術(shù)學(xué)院,杭州 310023)2(杭州師范大學(xué) 信息科學(xué)與工程學(xué)院,杭州 311121)

1 引 言

人體行為識(shí)別技術(shù)被應(yīng)用于生產(chǎn)生活中各個(gè)領(lǐng)域,如在老人監(jiān)護(hù)方面,監(jiān)測(cè)摔跤等險(xiǎn)情;在健身方面,記錄運(yùn)動(dòng)軌跡和步數(shù);在生產(chǎn)方面,識(shí)別工人行為動(dòng)作,防止不當(dāng)行為等[1-4].行為識(shí)別研究主要有兩種方法,一種方法是利用攝像頭采集視頻數(shù)據(jù),然后提取視頻中的人體特征完成行為識(shí)別,該方法需要處理大量的視頻數(shù)據(jù),且由于環(huán)境干擾,導(dǎo)致識(shí)別率較低[5].另一種方法是利用加速度計(jì)、慣導(dǎo)、氣壓計(jì)等傳感器穿戴在識(shí)別對(duì)象身體上,通過(guò)提取數(shù)據(jù)特征并結(jié)合分類(lèi)器實(shí)現(xiàn)行為動(dòng)作的分類(lèi)[6,7].該方法提取的特征一般為傳感器數(shù)據(jù)的均值、方差、標(biāo)準(zhǔn)差、熵、波形相關(guān)性等,由于在這些傳統(tǒng)的特征值提取過(guò)程中會(huì)丟失大量關(guān)鍵信息,因此會(huì)影響行為識(shí)別率.

目前基于可穿戴設(shè)備的行為識(shí)別研究已取得豐厚成果,如文獻(xiàn)[8]采用了隱馬爾科夫模型進(jìn)行分類(lèi),并且與樸素貝葉斯分類(lèi)器、判決樹(shù)(J48)、NB Tree(Naive Bayes tree)等分類(lèi)器進(jìn)行對(duì)比,驗(yàn)證了方法的識(shí)別率.文獻(xiàn)[9]采用支持向量機(jī)(SVM)分類(lèi)器,實(shí)現(xiàn)動(dòng)態(tài)行為和靜態(tài)行為的分類(lèi)識(shí)別.文獻(xiàn)[10]采用Kalman濾波器與貝葉斯分類(lèi)器相結(jié)合的方式對(duì)老人和青年人走路、上樓、下樓三種行為進(jìn)行分類(lèi)識(shí)別,實(shí)驗(yàn)證明該算法對(duì)老人和青年人都具有較高的識(shí)別率.文獻(xiàn)[11]基于加速度計(jì)、陀螺儀和氣壓計(jì)多維數(shù)據(jù)融合并提取時(shí)域特征,實(shí)現(xiàn)行為識(shí)別,但平均識(shí)別率僅為94%.另外,為提高算法的自適應(yīng)性和識(shí)別率,滑動(dòng)窗口和增量學(xué)習(xí)等方法被重點(diǎn)研究,如文獻(xiàn)[12,13]研究了滑動(dòng)窗口大小對(duì)行為識(shí)別率的影響,并通過(guò)實(shí)驗(yàn)確定了最合適的滑動(dòng)窗口大小.文獻(xiàn)[14]提出了一種人機(jī)結(jié)合的增量學(xué)習(xí)方法,當(dāng)分類(lèi)器不能判斷模糊行為時(shí),可人工確認(rèn)模糊行為,并告知算法進(jìn)行增量學(xué)習(xí),當(dāng)分類(lèi)器判斷該行為具有較大概率屬于某一種特定行為時(shí),算法可主動(dòng)進(jìn)行增量學(xué)習(xí).上述介紹的方法雖然能夠達(dá)到一定的識(shí)別精度, 但未充分考慮行為動(dòng)作前后的關(guān)聯(lián)性和特征提取的有效性.

隨著深度學(xué)習(xí)的發(fā)展,神經(jīng)網(wǎng)絡(luò)技術(shù)在各個(gè)領(lǐng)域突顯優(yōu)勢(shì).本文基于CNN[15]模型在特征提取方面的優(yōu)勢(shì)和BLSTM[16]在時(shí)間連續(xù)上識(shí)別的優(yōu)勢(shì),將CNN和BLSTM融合,得到CNN-BLSTM模型用于行為識(shí)別,該模型能夠提取豐富的特征,并對(duì)時(shí)間連續(xù)的行為動(dòng)作具有較強(qiáng)的識(shí)別性,因此具有較高的識(shí)別率.

2 數(shù)據(jù)處理

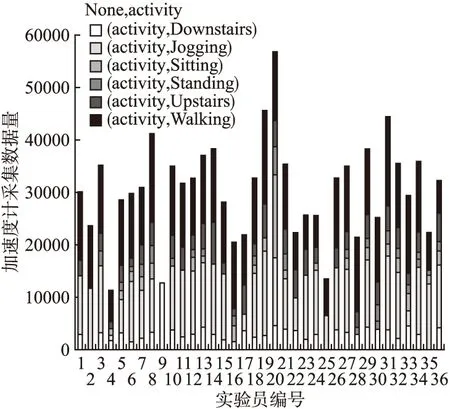

本文以L(fǎng)ab 實(shí)驗(yàn)室公開(kāi)的 Actitracker 數(shù)據(jù)集WISDM1http://www.cis.fordham.edu/wisdm/dataset.php為實(shí)驗(yàn)對(duì)象,該數(shù)據(jù)集包含走路、慢跑、上樓梯、下樓梯、坐著和站立6種行為動(dòng)作,采樣頻率為20Hz,總共采集了36位實(shí)驗(yàn)員的1098207條加速度數(shù)據(jù)(加速度計(jì)x、y、z三軸數(shù)據(jù)),采集裝置放置在口袋中,其中走路(Walking)占38.6%,慢跑(Jogging)占31.2%,上樓梯(Upstairs)占11.2%,下樓梯(Downstairs)占9.1%,坐著(Sitting)占5.5%,站立(Sitting)占4.4%,如圖1所示.

圖1 WISDM數(shù)據(jù)集分布圖Fig.1 Distribution of WISDM data set

該數(shù)據(jù)集提供的加速度計(jì)三軸數(shù)據(jù),在時(shí)間上連續(xù),但提取加速度數(shù)據(jù)的波形特征會(huì)導(dǎo)致失真嚴(yán)重,從而影響行為識(shí)別率.本文利用CNN進(jìn)行數(shù)據(jù)特征的提取,而CNN更擅長(zhǎng)空間數(shù)據(jù)的特征提取,因此需要將時(shí)間序列上的加速度數(shù)據(jù)轉(zhuǎn)換為空間數(shù)據(jù)(即將加速度波形數(shù)據(jù)轉(zhuǎn)換為二維張量).數(shù)據(jù)轉(zhuǎn)換過(guò)程如圖2所示,其轉(zhuǎn)換函數(shù)如公式(1)所示.

(1)

公式(1)中axi、ayi、azi為加速度計(jì)采集的x、y、z三軸數(shù)據(jù),1≤i≤n,n為需要轉(zhuǎn)換的加速度數(shù)據(jù)數(shù)量,f表示映射函數(shù),其功能是將數(shù)值與二維張量的橫縱坐標(biāo)做映射,Xi表示張量橫坐標(biāo),Yi表示張量縱坐標(biāo),datai表示張量(Xi,Yi)位置對(duì)應(yīng)的值.

根據(jù)上述方法將加速度計(jì)x、y、z三軸的時(shí)間序列數(shù)據(jù)轉(zhuǎn)換為空間屬性的張量,在張量中用數(shù)據(jù)點(diǎn)的位置和該位置的值替代原來(lái)加速度序列數(shù)據(jù),具有更強(qiáng)的表達(dá)性,且不會(huì)導(dǎo)致數(shù)據(jù)的失真.在轉(zhuǎn)換結(jié)束后,張量中空白位置用0填充.

3 CNN-BLSTM模型

本章節(jié)介紹CNN和BLSTM模型融合進(jìn)行行為識(shí)別的方法,首先我們介紹利用CNN模型進(jìn)行加速度張量特征提取方法,然后介紹長(zhǎng)短期記憶模型(LSTM)的結(jié)構(gòu)以及利用該模型進(jìn)行分類(lèi)的優(yōu)勢(shì),最后提出了CNN模型與雙向長(zhǎng)短期記憶模型(BLSTM)模型的融合方法.

3.1 CNN特征提取

卷積神經(jīng)網(wǎng)絡(luò)(CNN)在提取張量特征方面具有優(yōu)秀的性能,如在圖像處理領(lǐng)域,不同卷積層能夠提取出不同層面的特征,如在CNN網(wǎng)絡(luò)中,越靠前的卷積層,提取的一般是張量的邊緣信息,越靠后的卷積層,提取的信息越抽象,更具有代表性,因此利用更深層次的卷積層的特征有利于行為識(shí)別率的提高.本文采用tensorflow平臺(tái)構(gòu)建卷積神經(jīng)網(wǎng)絡(luò)(CNN),每層的輸入輸出通道都為16,網(wǎng)絡(luò)結(jié)構(gòu)共5層,其中前4層為卷積層和池化層,第5層為全連接層FC,最后利用Softmax函數(shù)實(shí)現(xiàn)行為的分類(lèi),CNN網(wǎng)絡(luò)結(jié)構(gòu)如圖3所示.

CNN在本文中的作用并非直接用于行為分類(lèi),而是進(jìn)行加速度數(shù)據(jù)張量的特征提取.特征提取過(guò)程如下步驟所示:

1)利用WISDM數(shù)據(jù)集轉(zhuǎn)換得到加速度數(shù)據(jù)張量,張量大小根據(jù)加速度計(jì)采樣頻率和行為動(dòng)作周期來(lái)確定;

2)利用加速度數(shù)據(jù)張量訓(xùn)練圖3所示的CNN網(wǎng)絡(luò),當(dāng)該模型對(duì)六種行為動(dòng)作的識(shí)別率大于閾值δ時(shí),結(jié)束訓(xùn)練.訓(xùn)練結(jié)束后,得到了最適宜的卷積核和池化核,利用該卷積核能夠有效的提取本研究中的加速度數(shù)據(jù)特征,提取后的所有特征映射到固定大小的數(shù)組,即保存在全連接層內(nèi);

3)將卷積核和池化核保存,后續(xù)模型利用該卷積核進(jìn)行特征的提取.

3.2 LSTM結(jié)構(gòu)

人的一系列行為動(dòng)作前后是連貫的,具有較高的關(guān)聯(lián)性,如當(dāng)前動(dòng)作為上樓梯,那么上一個(gè)動(dòng)作和接下來(lái)的動(dòng)作都具有極大概率是上樓梯.因此在進(jìn)行人體行為動(dòng)作識(shí)別過(guò)程中,單純利用加速度數(shù)據(jù)特征進(jìn)行分類(lèi)是不充分的,應(yīng)該充分考慮當(dāng)前行為動(dòng)作之前的動(dòng)作.在深度學(xué)習(xí)中循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)能夠較好的處理時(shí)間序列上的問(wèn)題,RNN的輸出由當(dāng)前的特征輸入和前一時(shí)刻的狀態(tài)決定.假設(shè)一系列時(shí)間連續(xù)的行為動(dòng)作可表示為x={x1,x2,…,xt,…,xT},xt表示第t個(gè)行為動(dòng)作,T表示行為動(dòng)作的數(shù)量.則RNN隱藏層的輸出ht如公式(2)所示.

ht=σh(wxhxt+whhht-1+bh)

(2)

公式(2)中σh為激活函數(shù),wxh為輸入層與隱藏層之間的權(quán)重矩陣,whh為隱藏層與隱藏層之間的權(quán)重矩陣,ht-1表示RNN上一時(shí)刻的狀態(tài),bh表示偏置.RNN的輸入層輸出結(jié)果如公式(3)所示.

yt=σy(whoht+bo)

(3)

公式(3)中σy為激活函數(shù),who為隱藏層與輸出層的權(quán)重矩陣,ht為隱藏層輸出,bo為輸出層偏置.

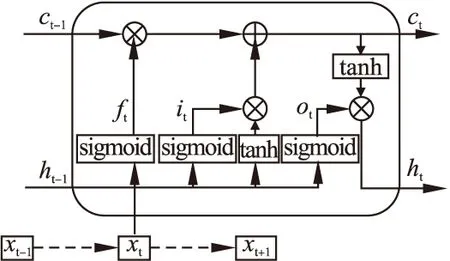

由于RNN模型隨著時(shí)間序列的加長(zhǎng),模型變深以后會(huì)存在梯度消失的情況,為解決該問(wèn)題,引入LSTM模型,該模型是一種RNN的變種,能夠長(zhǎng)期存儲(chǔ)記憶.其基本單元相同,如圖4所示,該結(jié)構(gòu)中包含輸入門(mén)it,遺忘門(mén)ft和輸出門(mén)ot,其中輸入門(mén)和輸出門(mén)用于控制信息流的輸入和輸出,遺忘門(mén)用于控制前一時(shí)刻的狀態(tài),該結(jié)構(gòu)通過(guò)這三種門(mén)實(shí)現(xiàn)長(zhǎng)期的記憶,LSTM結(jié)構(gòu)中的參數(shù)如公式(4)所示.

圖4 LSTM單元結(jié)構(gòu)圖Fig.4 Cell structure of LSTM

(4)

公式(4)中ct表示t時(shí)刻的記憶單元狀態(tài),ht表示隱藏層的輸出,bf、bi、bo、bc表示偏置.wxf、whf、wcf、wxi、whi、wci、wxo、who、wco、wxc、whc表示權(quán)重值,通過(guò)訓(xùn)練得到.

通過(guò)構(gòu)建LSTM模型,能夠?qū)σ幌盗行袨閯?dòng)作產(chǎn)生長(zhǎng)期的影響,有利于模型根據(jù)當(dāng)前輸入和前一時(shí)刻的狀態(tài)判斷行為結(jié)果,因此理論上具有更高的識(shí)別率.

3.3 模型融合

雖然3.2小節(jié)介紹的LSTM模型能夠長(zhǎng)期的記憶行為動(dòng)作,但當(dāng)前行為不僅和輸入特征、前一時(shí)刻狀態(tài)有關(guān),還與后一時(shí)刻的狀態(tài)有關(guān),因此本文構(gòu)建一個(gè)雙向的長(zhǎng)短期記憶模型(BLSTM),通過(guò)前一時(shí)刻狀態(tài)、后一時(shí)刻狀態(tài)、當(dāng)前輸入特征三個(gè)方面綜合判斷當(dāng)前的行為動(dòng)作類(lèi)別.CNN-BLSTM融合模型如圖5所示.

BLSTM模型是一種雙向的LSTM,任何一個(gè)方向都是一個(gè)單獨(dú)的LSTM模型,因此其隱藏層輸出ht可用公式(5)表示,該模型的預(yù)測(cè)結(jié)果輸出如公式(6)所示.

(5)

yt=σ(ht)

(6)

公式(5)和公式(6)中htf表示t時(shí)刻正向LSTM模型的隱藏層輸出,htb表示t時(shí)刻反向LSTM模型的隱藏層輸出,α、β為常數(shù),其值根據(jù)實(shí)驗(yàn)驗(yàn)證設(shè)置,α+β=1,σ為Softmax函數(shù).

圖5 CNN-BLSTM模型結(jié)構(gòu)圖Fig.5 Structure of CNN-BLSTM

CNN-BLSTM模型首先利用3.1小節(jié)保存下來(lái)的卷積核和池化核參數(shù)對(duì)行為動(dòng)作張量進(jìn)行特征提取,然后將提取的特征輸入BLSTM中進(jìn)行行為訓(xùn)練或識(shí)別.在進(jìn)行識(shí)別前需要訓(xùn)練CNN-BLSTM模型,因?yàn)殡m然3.1小節(jié)訓(xùn)練CNN得到了合適的卷積核與池化核等參數(shù),但單獨(dú)的BLSTM結(jié)構(gòu)并沒(méi)有進(jìn)行訓(xùn)練,因此利用WISDM數(shù)據(jù)集轉(zhuǎn)換得到的張量進(jìn)行融合模型的訓(xùn)練,訓(xùn)練結(jié)束后才能使用該融合模型.

4 增量學(xué)習(xí)

本文識(shí)別的人體行為動(dòng)作包括走路(Walking)、慢跑(Jogging)、上樓梯(Upstairs)、下樓梯(Downstairs)、坐著(Sitting)、站立(Sitting)六種,其中走路多種行為動(dòng)作的相似性較高(如走路和上樓梯),區(qū)分相似行為動(dòng)作的難度較高,算法很可能會(huì)混淆.我們知道在模型最后一層使用Softmax函數(shù)進(jìn)行分類(lèi),該函數(shù)的作用實(shí)際是計(jì)算六種行為對(duì)應(yīng)的概率是多少,如公式(7)所示.

(7)

公式(7)中a1~as表示輸入Softmax的數(shù)據(jù),本文識(shí)別六種行為動(dòng)作,因此S=6.

假設(shè)Softmax計(jì)算出屬于某種行為動(dòng)作的概率P最高,如屬于走路行為的概率最高,但P<γ,則認(rèn)為該次判斷的可信度不高,在這種情況下需要進(jìn)行增量學(xué)習(xí),γ為需要進(jìn)行增量學(xué)習(xí)的閾值,根據(jù)經(jīng)驗(yàn)確定.方法如下步驟所示:

1)算法自動(dòng)保存該情況的原始張量;

2)人工方式為該張量打上實(shí)際行為動(dòng)作的標(biāo)簽;

3)算法經(jīng)過(guò)長(zhǎng)期運(yùn)行后積累可信度低的數(shù)據(jù)集,并重新訓(xùn)練BLSTM模型.

5 實(shí)驗(yàn)分析

本章基于WISDM數(shù)據(jù)集驗(yàn)證CNN-BLSTM模型在行為識(shí)別方面的性能,實(shí)驗(yàn)的硬件環(huán)境為GTX1080的GPU、8G內(nèi)存的PC機(jī),軟件平臺(tái)為tensorflow深度學(xué)習(xí)框架.實(shí)驗(yàn)過(guò)程中將數(shù)據(jù)集分為兩部分:訓(xùn)練集和測(cè)試集,其中訓(xùn)練集包括70000條加速度數(shù)據(jù),測(cè)試集包括30000條加速度數(shù)據(jù).訓(xùn)練集和測(cè)試集中的數(shù)據(jù)都完整的包含走路(Walking)、慢跑(Jogging)、上樓梯(Upstairs)、下樓梯(Downstairs)、坐著(Sitting)和站立(Sitting)六種行為動(dòng)作.

5.1 數(shù)據(jù)塊劃分

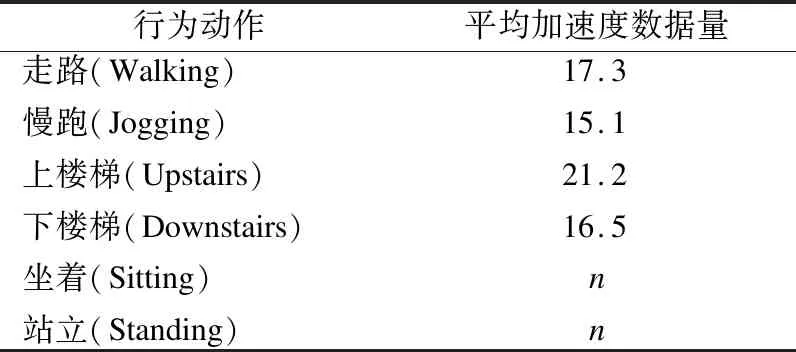

WISDM數(shù)據(jù)集的采樣頻率固定為20Hz,因此在單位時(shí)間內(nèi)加速度計(jì)采集的數(shù)據(jù)量相同,而不同行為動(dòng)作的一個(gè)完整行為周期的時(shí)間是不同的,因此對(duì)應(yīng)的加速度數(shù)據(jù)數(shù)量是不同的.在進(jìn)行行為識(shí)別前需要確定一個(gè)固定大小的數(shù)據(jù)塊,該數(shù)據(jù)塊大小不能小于六種行為動(dòng)作對(duì)應(yīng)的數(shù)據(jù)量的最大值.通過(guò)統(tǒng)計(jì)數(shù)據(jù)集中六種行為動(dòng)作,發(fā)現(xiàn)每種行為動(dòng)作的一個(gè)完整周期對(duì)應(yīng)的加速度數(shù)據(jù)量如表1所示.

表1 完整行為周期加速度數(shù)據(jù)量表

Table 1 Acceleration data of full cycle behavior

行為動(dòng)作平均加速度數(shù)據(jù)量走路(Walking)慢跑(Jogging)上樓梯(Upstairs)下樓梯(Downstairs)坐著(Sitting)站立(Standing)17.315.121.216.5nn

從數(shù)據(jù)統(tǒng)計(jì)結(jié)果表明,走路行為完成一個(gè)行為周期,加速度計(jì)采集了17.3個(gè)數(shù)據(jù).慢跑行為完成一個(gè)周期,加速度計(jì)采集了15.1個(gè)數(shù)據(jù).上樓梯行為對(duì)應(yīng)21.2個(gè)數(shù)據(jù),下樓梯行為對(duì)應(yīng)16.5個(gè)數(shù)據(jù).如果在加速度數(shù)據(jù)流中取數(shù)據(jù)的個(gè)數(shù)小于21.2個(gè)時(shí),則上樓梯行為的數(shù)據(jù)會(huì)部分丟失,這會(huì)嚴(yán)重影響上樓梯行為的動(dòng)作識(shí)別,因此在取數(shù)據(jù)時(shí),必須大于21.2個(gè)數(shù)據(jù).這里并不需要考慮坐著和站立行為,因?yàn)檫@類(lèi)靜止行為無(wú)論數(shù)據(jù)塊的值取多,都不會(huì)影響其識(shí)別,所以n為任意值.本文針對(duì)WISDM數(shù)據(jù)集,將數(shù)據(jù)塊的大小設(shè)定為23,并轉(zhuǎn)換為20×20的張量.如果數(shù)據(jù)集改變,則需要重新統(tǒng)計(jì)數(shù)據(jù)塊的大小.

5.2 特征提取對(duì)識(shí)別率影響

在CNN-BLSTM模型中,利用卷積方法提取加速度數(shù)據(jù)張量的特征.不同層次的卷積層提取的特征具有不同的特性,淺層的卷積層一般是提取張量的邊緣信息,該特征不具備代表性,更深層次的卷積層提取的張量特征更抽象,更具有代表性.實(shí)驗(yàn)中提取不同的數(shù)據(jù)特征(包括不同深度的卷積層特征、傳統(tǒng)特征)輸入到BLSTM模型中,分析不同特征對(duì)應(yīng)WISDM數(shù)據(jù)集中六種行為動(dòng)作的平均識(shí)別率,其中卷積核大小為3×3,卷積步長(zhǎng)為1.實(shí)驗(yàn)結(jié)果如表2所示,提取的傳統(tǒng)特征包括加速度數(shù)據(jù)的均值、方差、離散系數(shù)、加速度x、y、z三軸相關(guān)性、熵,原始數(shù)據(jù)是沒(méi)經(jīng)過(guò)任何處理的數(shù)據(jù),即加速度數(shù)據(jù).

實(shí)驗(yàn)結(jié)果表明直接向BLSTM模型中輸入原始數(shù)據(jù),其識(shí)別率為71.72%.卷積層Conv1~Conv3的平均識(shí)別率快速提高,其中卷積層Conv3提取的特征可使識(shí)別率達(dá)到96.95%,卷積層Conv4提取的特征對(duì)應(yīng)的識(shí)別率略微降低,而傳統(tǒng)特征提取方法獲得的識(shí)別率僅為78.16%.由于原始數(shù)據(jù)未經(jīng)特征提取,數(shù)據(jù)中包含大量的無(wú)效信息(即識(shí)別干擾項(xiàng)),導(dǎo)致識(shí)別率較低.隨著卷積層次加深,提取的特征更加的抽象,特征更具有代表性,能夠較好的摒棄干擾信息,從而提高了平均識(shí)別率,而當(dāng)卷積層太深以后(如Conv4),提取特征過(guò)程中丟棄的信息越來(lái)越多,不利于算法識(shí)別,因此平均識(shí)別率會(huì)逐漸略微下降.綜上所述,針對(duì)數(shù)據(jù)量不大的行為識(shí)別問(wèn)題,選擇卷積層Conv3提取的特征作為BLSTM模型的輸入是最合適的.

表2 不同特征對(duì)應(yīng)的平均識(shí)別率

Table 2 Average recognition rate of different features

不同特征平均識(shí)別率(%)原始數(shù)據(jù)Conv1Conv2Conv3Conv4傳統(tǒng)特征71.7254.7673.1396.9591.4878.16

5.3 CNN-BLSTM模型識(shí)別率分析

根據(jù)5.2小節(jié)的實(shí)驗(yàn),利用卷積層Conv3提取的特征作為BLSTM模型輸入,對(duì)測(cè)試數(shù)據(jù)集進(jìn)行實(shí)驗(yàn),分析模型對(duì)六種行為的識(shí)別率情況,實(shí)驗(yàn)結(jié)果如圖6所示,縱坐標(biāo)為實(shí)際行為動(dòng)作,橫坐標(biāo)為被識(shí)別的行為動(dòng)作.

圖6 CNN-BLSTM識(shí)別率圖Fig.6 Recognition rate of CNN-BLSTM

實(shí)驗(yàn)結(jié)果表明對(duì)坐著行為的識(shí)別率最高,達(dá)到了98.3%,對(duì)下樓梯行為的識(shí)別率最低,為95.1%.因?yàn)樽驼玖⑦@類(lèi)行為是靜止?fàn)顟B(tài),采集的加速度數(shù)據(jù)與其他行為動(dòng)作具有較大區(qū)別,因此神經(jīng)網(wǎng)絡(luò)能較好的區(qū)分,而下樓梯行為與走路和上樓梯行為的相似度較高,而每個(gè)實(shí)驗(yàn)者完成這些行為動(dòng)作習(xí)慣不同,因此下樓梯行為很容易被識(shí)別為走路或上樓梯行為,因此其識(shí)別率相對(duì)較低,但最低的識(shí)別率也達(dá)到了95.1%,因此本文提出的CNN-BLSTM模型具有較高的行為識(shí)別率.同時(shí)對(duì)相似行為動(dòng)作的區(qū)分效果也較好,如上樓梯行為和走路行為比較相似,但僅有2.1%的上樓梯行為被識(shí)別為走路行為.

5.4 對(duì)比實(shí)驗(yàn)

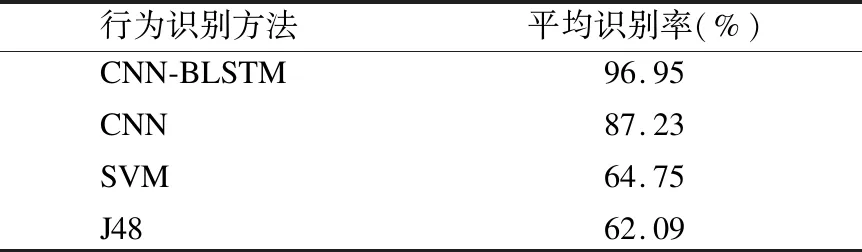

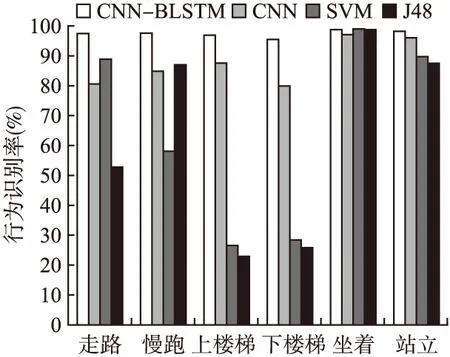

目前可穿戴設(shè)備行為識(shí)別方面的研究一般是特征提取和分類(lèi)器相結(jié)合的方法,傳統(tǒng)的特征包括傳感器數(shù)據(jù)的均值、方差、離散系數(shù)、加速度x、y、z三軸相關(guān)性、熵,主流的分類(lèi)器包括決策樹(shù)、SVM等.實(shí)驗(yàn)將本文提出的CNN-BLSTM方法與CNN、SVM、J48決策樹(shù)進(jìn)行對(duì)比,其中CNN模型結(jié)構(gòu)如3.1小節(jié)的圖3所示,SVM和J48都采用傳統(tǒng)特征值作為分類(lèi)依據(jù),實(shí)驗(yàn)結(jié)果如圖7所示,橫坐標(biāo)為行為動(dòng)作,縱坐標(biāo)為每種行為動(dòng)作的識(shí)別率.不同方法的平均識(shí)別率如表3所示.

表3 不同方法平均行為識(shí)別率表

Table 3 Average recognition rate of different methods

行為識(shí)別方法平均識(shí)別率(%)CNN-BLSTMCNNSVMJ4896.9587.2364.7562.09

實(shí)驗(yàn)結(jié)果表明本文提出的CNN-BLSTM模型對(duì)六種行為的識(shí)別率都比較高,其次是CNN模型的識(shí)別率也比較均衡,但低于CNN-BLSTM模型,因?yàn)镃NN-BLSTM不僅考慮了特征提取方法,而且考慮了行為動(dòng)作在時(shí)間前后的相關(guān)性,而CNN模型僅依靠特征進(jìn)行分類(lèi).接著SVM行為識(shí)別方法在上下樓梯方面的識(shí)別率較低,因?yàn)樯舷聵翘輰儆谙嗨苿?dòng)作,性能不強(qiáng)的分類(lèi)器很難區(qū)分.J48決策樹(shù)在行為識(shí)別方面的效果最差.同時(shí)實(shí)驗(yàn)結(jié)果也表明了深度學(xué)習(xí)模型在行為識(shí)別方面的性能要高于傳統(tǒng)的分類(lèi)器.

圖7 行為識(shí)別率對(duì)比圖Fig.7 Comparison of activity recognition rate

6 總 結(jié)

針對(duì)傳統(tǒng)基于可穿戴設(shè)備行為識(shí)別研究中特征提取不完善、傳統(tǒng)分類(lèi)器準(zhǔn)確率差等問(wèn)題,本文提出一種基于CNN-BLSTM模型的人體行為識(shí)別方法.該方法首先將時(shí)間序列的加速度數(shù)據(jù)轉(zhuǎn)換為二維張量,然后提出CNN模型和BLSTM模型融合的CNN-BLSTM模型來(lái)提高行為識(shí)別率,該方法既能繼承CNN模型對(duì)張量特征提取的性能,又能在模型預(yù)測(cè)階段充分考慮前期和后期行為動(dòng)作,使得行為分類(lèi)不再單純依靠數(shù)據(jù)特征.實(shí)驗(yàn)結(jié)果表明所提方法能夠有效提高行為識(shí)別率.