結(jié)合Delaunay三角網(wǎng)的自適應(yīng)多尺度圖像重疊域配準(zhǔn)方法

陳永勝 許建龍 汪亞明

摘 要:為改進(jìn)隨機(jī)采樣一致性算法模型參數(shù)估計(jì)可能不是最優(yōu)導(dǎo)致圖像特征點(diǎn)配準(zhǔn)率不高的問(wèn)題,縮短特征點(diǎn)提取時(shí)間,提出一種結(jié)合Delaunay三角網(wǎng)格約束的自適應(yīng)多尺度圖像重疊域配準(zhǔn)方法。采用自適應(yīng)通用加速分割檢測(cè)算法,快速檢測(cè)出均勻穩(wěn)定的特征點(diǎn),并且用二進(jìn)制特征描述子解決尺度不變性和旋轉(zhuǎn)不變性問(wèn)題。因傳統(tǒng)隨機(jī)采樣一致性算法閾值選取和迭代次數(shù)的局限性,會(huì)摻雜部分難篩的誤配點(diǎn),在此前提下借助Delaunay算法剖分粗匹配點(diǎn)集,遍歷計(jì)算網(wǎng)格間對(duì)應(yīng)三角形相似度并儲(chǔ)存在相似性度量矩陣中。依據(jù)Delaunay三角網(wǎng)特性,剔除相似度差異大的三角形,重構(gòu)網(wǎng)格保存余下的匹配點(diǎn)集。實(shí)驗(yàn)結(jié)果表明,該方法特征點(diǎn)提取速率比FAST快15%~20%,特征點(diǎn)正確配準(zhǔn)率比隨機(jī)采樣一致性算法提高約4.9%,不僅可自適應(yīng)多尺度快速提取特征點(diǎn),而且在保證特征點(diǎn)正確配準(zhǔn)率基礎(chǔ)上盡量多地保留有效特征點(diǎn)數(shù)量。

關(guān)鍵詞:重疊域;自適應(yīng);圖像配準(zhǔn);Delaunay 三角網(wǎng);相似性度量;計(jì)算機(jī)視覺

DOI:10. 11907/rjdk. 201398????????????????????????????????????????????????????????????????? 開放科學(xué)(資源服務(wù))標(biāo)識(shí)碼(OSID):

中圖分類號(hào):TP317.4?? 文獻(xiàn)標(biāo)識(shí)碼:A??????????????? 文章編號(hào):1672-7800(2020)011-0206-06

Adaptive Multi-scale Image Overlap Region Registration Method Combining with Delaunay Triangulation

CHEN Yong-sheng, XU Jian-long, WANG Ya-ming

(School of Information, Zhejiang Sci-Tech University, Hangzhou 310018, China)

Abstract: The estimation of model parameters of random sampling consistency algorithm may not be optimal, which leads to the low rate of correct registration of image feature points. In order to solve this problem, an adaptive multi-scale image overlap registration method combined with Delaunay triangular mesh constraint is proposed. The adaptive universal accelerated segmentation detection algorithm is used to quickly detect the uniformity. Moreover, the binary feature descriptor is used to solve the scale invariance and rotation invariance. Due to the limitation of threshold selection and iteration times of traditional random sampling consistency algorithm, some mismatching points which are difficult to screen will be mixed. On this premise, Delaunay algorithm is used to divide the coarse matching point set, traverse and calculate the similarity of corresponding triangles between grids, and store them in the similarity measurement matrix. According to the characteristics of Delaunay triangulation, triangles with large similarity difference are eliminated, and the mesh protection is reconstructed to save the remaining set of matching points. The experimental results show that the extraction rate of feature points is 15% - 20% faster, and the correct registration rate of feature points is about 4.9% higher than that of random sampling consistency algorithm. The proposed method can not only adaptively extract feature points from multi-scale images, but also keep the number of effective feature points as much as possible while ensuring the correct registration rate of feature points.

Key Words: overlap region; adaptive; image registration; Delaunay triangulation; similarity measurement; computer vision

0 引言

圖像配準(zhǔn)是圖像處理領(lǐng)域不可或缺的一環(huán),是圖像處理應(yīng)用研究的基礎(chǔ),在目標(biāo)識(shí)別、圖像拼接[1]、可視化三維重建[2]和基于內(nèi)容的圖像檢索[3]領(lǐng)域有著廣泛應(yīng)用。圖像配準(zhǔn)方法總體上歸納為基于灰度的圖像配準(zhǔn)[4-5]和基于圖像特征的配準(zhǔn)兩類方法[6-8] 。前一類基于像素的算法,顧名思義是利用圖像的灰度信息完成圖像內(nèi)容的匹配運(yùn)算。正是得益于此類算法無(wú)需考慮圖像內(nèi)容的結(jié)構(gòu)特征而極其依賴點(diǎn)像素信息特性,可最大程度降低預(yù)處理圖像造成的精度損失,但對(duì)于圖像中出現(xiàn)的旋轉(zhuǎn)、視差、灰度和尺寸變化魯棒性較差,且此類方法運(yùn)算繁復(fù),很大程度上限制了適用性。而后一類基于特征的算法依賴特征檢測(cè)算子優(yōu)化,如經(jīng)典的SIFT、SURF 和 FAST 算子等,雖然算子對(duì)特征點(diǎn)提取有不同程度改進(jìn),但后續(xù)匹配點(diǎn)對(duì)進(jìn)一步篩選搭配的幾乎都是傳統(tǒng)的隨機(jī)采樣一致性(Random Sample Consensus,RANSAC)算法[9]。關(guān)鍵點(diǎn)對(duì)篩選依賴閾值選取,對(duì)于低紋理特征少的圖像可能導(dǎo)致保留的有效特征點(diǎn)數(shù)量較少,反而大幅降低特征點(diǎn)的正確配準(zhǔn)率。

圖像配準(zhǔn)主旨是將在有一定時(shí)段間隔、硬件設(shè)備差異或參數(shù)變化時(shí)完成空間上的內(nèi)容匹配操作,研討在不同場(chǎng)景或不同視角下的圖像內(nèi)容存在深度變化情況下提高正確匹配率。當(dāng)前配準(zhǔn)算法研究思路向特征提取算子結(jié)合約束條件控制匹配并行的方向突破,文獻(xiàn)[10]提出一種結(jié)合海森仿射區(qū)域檢測(cè)器、局部 Delaunay 三角剖分和仿射不變幾何約束的健壯性圖像匹配方法,得到一定優(yōu)化。但提取的是SIFT特征點(diǎn),導(dǎo)致算法整體耗時(shí)過(guò)長(zhǎng)且計(jì)算繁復(fù);文獻(xiàn)[11]提出一種基于三維Delaunay 三角剖分的立體視覺跟蹤算法,充分利用空間幾何約束特征點(diǎn)建立目標(biāo)跟蹤判別模型。本文以高速率、廣覆蓋提取多尺度特征點(diǎn)為前提,以追求更高配準(zhǔn)率為目標(biāo),提出結(jié)合Delaunay剖分的圖像重疊域配準(zhǔn)方法,提高在重疊域過(guò)渡部分特征點(diǎn)匹配的正確率。

1 相關(guān)工作

關(guān)于尺度變化圖像的配準(zhǔn),Xu[12]提出基于Harris角點(diǎn)檢測(cè)結(jié)合魯棒性較強(qiáng)的SIFT算法,可以提取具有尺度、光照和旋轉(zhuǎn)不變性的特征點(diǎn),但存在算法耗時(shí)長(zhǎng)、實(shí)時(shí)性差和有效特征點(diǎn)少等問(wèn)題;文獻(xiàn)[13]提出融合特征的SURF算法,相比之前被認(rèn)為效果最好的SIFT 算法,運(yùn)算速度得到大幅度提高,但該算法在匹配時(shí)沒(méi)有利用特征點(diǎn)云包含的任何有關(guān)結(jié)構(gòu)特征信息,在處理差異較大的對(duì)象時(shí)誤配情況尤為突出;Zhao等[14]提出一種新的雙圖匹配法,對(duì)基于尺度不變特征變換的匹配進(jìn)行改進(jìn),使梯度方向標(biāo)準(zhǔn)化,使所有對(duì)應(yīng)點(diǎn)的相似度比例最大化,生成Delaunay圖去除離群點(diǎn),特別適用于區(qū)域低重疊、內(nèi)容轉(zhuǎn)變大的多光譜、多時(shí)相圖像。基于SIFT的改進(jìn)對(duì)特征點(diǎn)分布考慮不夠合理,有效特征點(diǎn)較為集中,影響最終配準(zhǔn)效果。

隨著基于特征的匹配算法向著添加約束控制條件的方向改進(jìn),Yan等[15]引入Delaunay剖分圖像提取SURF特征點(diǎn)集,通過(guò)票決算法解決未運(yùn)用結(jié)構(gòu)特征信息及搜索效率較低的問(wèn)題,但是SURF處理圖像內(nèi)容變化大的弊端依然存在。因此,在具有尺度變化和深度變化的重疊域圖像對(duì)中快速提取分布均勻、定位準(zhǔn)確的有效特征點(diǎn),同時(shí)保證較高的特征點(diǎn)配準(zhǔn)率是本文內(nèi)容研究的主要。在特征提取速度方面,Biadgie 等[16]使用自適應(yīng)加速分割檢測(cè)法,雖然大幅加快了特征檢測(cè)的計(jì)算速度,但FAST只單純考慮特征點(diǎn)檢測(cè),未涉及有關(guān)點(diǎn)的特征描述;Kybic等[17]描述一種計(jì)算超像素特征向量快速配準(zhǔn)方法,用空間正則化構(gòu)造三角劃分找到全局最優(yōu)轉(zhuǎn)換。在特征點(diǎn)的最終匹配階段,傳統(tǒng)的RANSAC閾值選取缺陷是在過(guò)濾誤匹配的同時(shí)可能會(huì)剔除正確匹配點(diǎn),這在有效特征點(diǎn)本就不多的圖像中效果表現(xiàn)差強(qiáng)人意。

綜上所述,各種方法的配準(zhǔn)效果參差不齊,主要原因在兩個(gè)方面:①在特征點(diǎn)檢測(cè)環(huán)節(jié)選用的提取算法相對(duì)老舊,導(dǎo)致提取的特征點(diǎn)數(shù)量和質(zhì)量不理想;②在特征匹配環(huán)節(jié)搭配使用的都是RANSAC算法濾除錯(cuò)誤匹配點(diǎn),但RANSAC弊端沒(méi)有去除,導(dǎo)致最終正確配準(zhǔn)率不高。本文選用改進(jìn)的自適應(yīng)通用加速分割檢測(cè)(Adaptive and Generic Accelerated Segment Test,AGAST)特征提取算法,可以更快、更多、更好地提取特征點(diǎn)。在特征點(diǎn)匹配環(huán)節(jié)沿用傳統(tǒng)RANSAC算法基礎(chǔ)上,靈活運(yùn)用Delaunay三角剖分控制特征匹配,彌補(bǔ)RABSAC算法不足。將計(jì)算機(jī)視覺與圖形學(xué)結(jié)合是本文創(chuàng)新之處。

2 本文方法模型

2.1 AGAST特征檢測(cè)與生成描述子

AGAST算法[18]改進(jìn)了加速分割檢測(cè)算法(Accelerated Segment Test,AST)的決策樹,通過(guò)構(gòu)造高效的二叉決策樹替代原貪心算法(Iterative Dichotomiser3,ID3)構(gòu)造的三叉樹[19],因?yàn)楸容^而言二叉樹可以更高效地應(yīng)用于二元目標(biāo)。通過(guò)尋找特定決策樹完成最佳搭配組合,即針對(duì)選定區(qū)域分配最適應(yīng)的決策樹,在不同尺寸掩膜下獲得自適應(yīng),同時(shí)還能根據(jù)處理圖像特征的情況動(dòng)態(tài)且高效率地求解當(dāng)前方案的通用解,進(jìn)一步加快特征點(diǎn)檢測(cè)速度。該方法不僅彌補(bǔ)了FAST角點(diǎn)在訓(xùn)練集檢測(cè)步驟中可能消失的缺陷,而且具備FAST算法的可重復(fù)性。不同尺寸的AST如圖1所示(彩圖掃描OSID碼可見),紅色為8像素,綠色為16像素,藍(lán)色的正方形和菱形為12像素,中間的黑色方塊為掩膜中心像素點(diǎn)。

(1)構(gòu)建更為精細(xì)的尺度空間金字塔,由n個(gè)octave層ci和n個(gè)中間層di組成(i=0,1,?,n-1)。ci是對(duì)基準(zhǔn)圖像c0的一次半采樣得到,中間層d0是對(duì)c0的1.5倍采樣得到,其余內(nèi)層依次對(duì)d0半采樣得到,如圖2所示。

(2)在尺度空間金字塔的每一層和內(nèi)插層分別使用閾值大小為εd的FAST-9-16(opencv庫(kù)默認(rèn)值)算子檢測(cè)關(guān)鍵點(diǎn),在固定半徑的圓周上選取16個(gè)像素點(diǎn)標(biāo)記為xi,i=1,2,?,16,如圖3所示。分別與圓中心像素點(diǎn)p的像素值Ip做差,統(tǒng)計(jì)比點(diǎn)p亮或暗的圓周上點(diǎn)的個(gè)數(shù),記為N,公式如下:

N=countIxi-Ip>εd (1)

若N≥9(圖3中為FAST-12,則N≥12),則此關(guān)鍵點(diǎn)可作為一個(gè)焦點(diǎn)候選,這樣把一個(gè)圓形區(qū)域劃分成比中心像素亮、比中心像素暗以及與中心像素值近似的3類像素點(diǎn),稱為分割測(cè)試法。然后構(gòu)建二叉樹尋找最優(yōu)決策樹組合,確定候選角點(diǎn),最后用非極大值抑制排除不穩(wěn)定角點(diǎn)。由于非極大值抑制不能直接影響提取的特征點(diǎn),考慮上述分割測(cè)試法特性及對(duì)計(jì)算速度要求,定義一個(gè)角點(diǎn)響應(yīng)函數(shù)Λ:

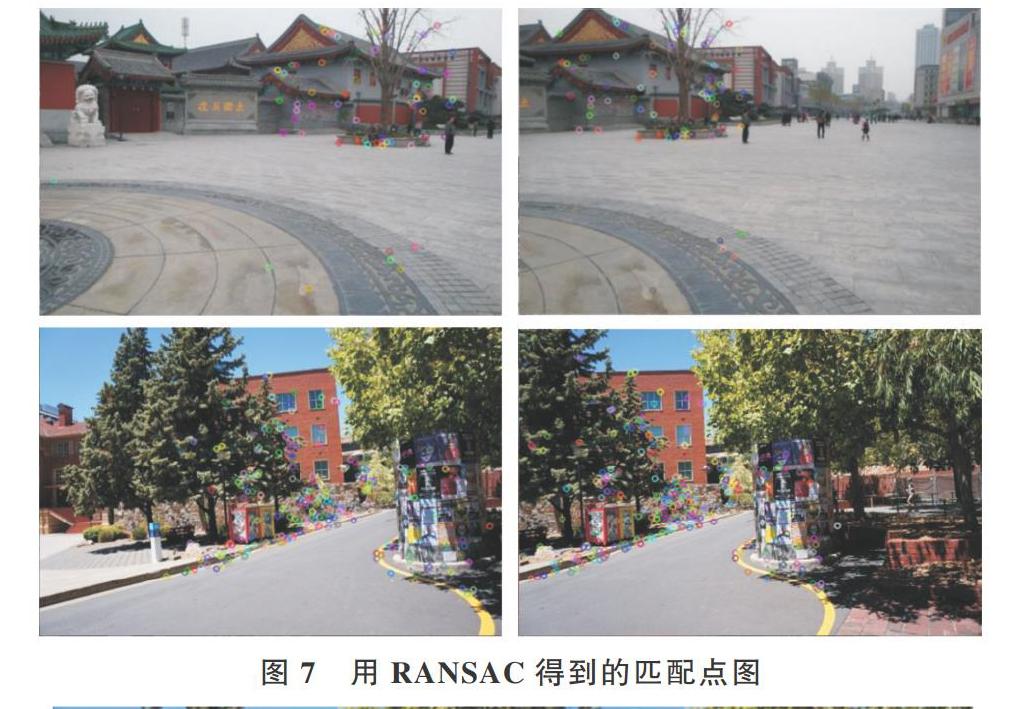

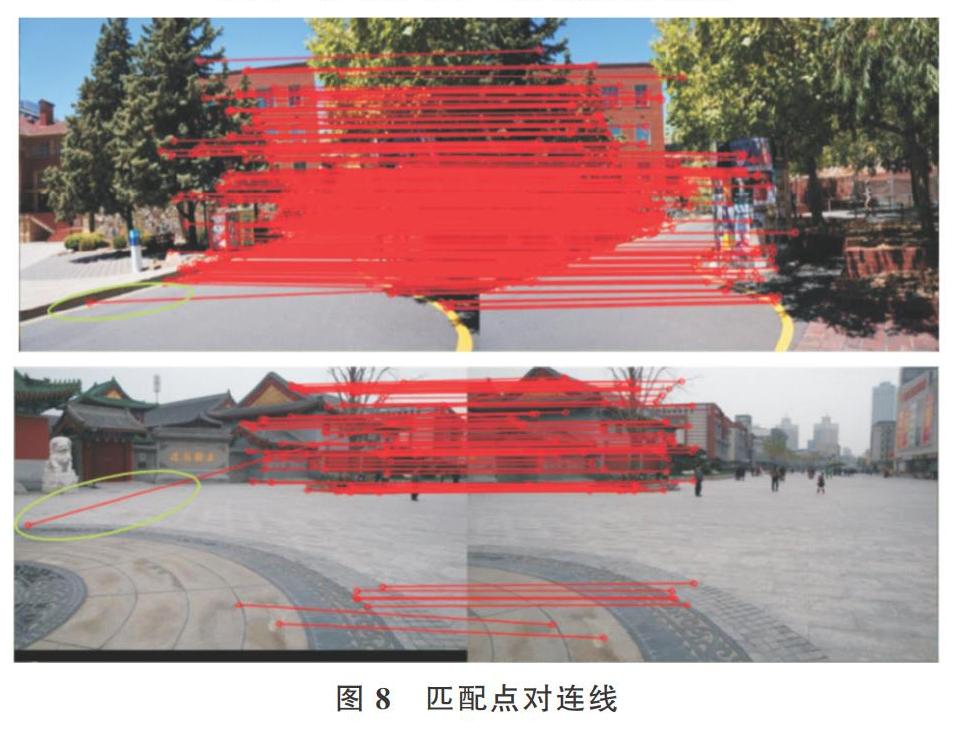

Λ=maxA,BA=∑(Ixi-Ip),Ixi>Ip+εdB=∑(Ip-Ixi),Ixi 即定義角點(diǎn)強(qiáng)度值為圓周上像素點(diǎn)與中心像素點(diǎn)像素差值的累加和。先檢測(cè)可能存在的感興趣域,然后用非極大值抑制剔除尺度空間內(nèi)不穩(wěn)定的特征點(diǎn),保留強(qiáng)度值最大的角點(diǎn),抑制其余點(diǎn)。AGAST算法對(duì)尺度空間內(nèi)檢測(cè)出的所有極大值均進(jìn)行連續(xù)尺度優(yōu)化和亞像素校正[20],以此盡可能精確定位特征點(diǎn)。 通過(guò)上述步驟記錄特征點(diǎn)定位和尺度。AGAST雖然比FAST速度快,但同樣缺乏特征點(diǎn)的其它描述信息,尚不具備旋轉(zhuǎn)不變性,因此需要根據(jù)提取的角點(diǎn)位置計(jì)算特征向量矩陣,賦予特征點(diǎn)描述符。本文選擇二進(jìn)制健壯的尺度不變關(guān)鍵點(diǎn)(Binary Robust Invariant Scalable Keypoints,BRISK)作為特征描述算子。BRISK是一種特征提取算法,還是一種二進(jìn)制的特征描述算子,具有較好的旋轉(zhuǎn)不變性和尺度不變性,魯棒性較強(qiáng)[21]。 2.2 Delaunay控制約束細(xì)匹配 在生成具有尺度不變性的特征點(diǎn)描述符之后,通過(guò)估量二進(jìn)制特征描述符的相似性實(shí)現(xiàn)初步匹配,然后采用 RANSAC 法濾除大量不正確匹配點(diǎn)。傳統(tǒng)的 RANSAC 雖然在多數(shù)情況下能夠通過(guò)迭代估計(jì)出一個(gè)最優(yōu)模型濾除大量錯(cuò)誤匹配點(diǎn),但如果迭代次數(shù)受限或閾值選取不當(dāng)則會(huì)影響匹配點(diǎn)質(zhì)量。如果閾值選取偏小,會(huì)導(dǎo)致好的匹配點(diǎn)被濾除;反之,則導(dǎo)致錯(cuò)誤匹配點(diǎn)被保留,以上情況都是不能忽視的匹配效果干擾因素。針對(duì)此情況,本文借助Delaunay三角剖分控制網(wǎng)格變形策略,進(jìn)一步提高特征點(diǎn)匹配正確率。提取細(xì)匹配點(diǎn)關(guān)鍵步驟如下: (1)Delaunay 三角剖分。創(chuàng)建兩個(gè)迭代器分別存儲(chǔ)兩幅待匹配圖像,采用 RANSAC 篩選出的粗匹配關(guān)鍵點(diǎn)集,用點(diǎn)插法構(gòu)建兩幅待匹配圖像的 Delaunay 三角網(wǎng)格。 (2) 計(jì)算 Delaunay 三角網(wǎng)格相似度。由于圖像的特征點(diǎn)集被剖分成單個(gè)三角形構(gòu)成的網(wǎng)格,遍歷計(jì)算每個(gè)三角形對(duì)的相似度,篩選出匹配度更高的特征點(diǎn)。首先,設(shè)遍歷的第一個(gè)三角形對(duì)記為ΔABC和ΔA'B'C',其頂點(diǎn)A(x1,y1)、B(x2,y2)、C(x3,y3)和A'(x1',y1')、B'(x2',y2')、C'(x3',y3')對(duì)應(yīng)的頂角度數(shù)分別記為θa和θa'?,以此類推,由兩點(diǎn)距離公式計(jì)算三角形邊長(zhǎng): l1=x1-x22+y1-y22 (3) 依次計(jì)算出其余邊的長(zhǎng)度l2、l3和l1'、l2'、l3',則有 cos(θa)=l21+l22+l232l1l2 (4) 則 θa=arccos(cos(θa)) (5) 同理求出所有三角形內(nèi)角度數(shù)。第一對(duì)三角形之間的相似度記為U1,三角形對(duì)應(yīng)內(nèi)角的相似度記為Ua、Ub和Uc,則角的相似度公式為 Ua=cos3(π2(1-ed(θa'))) (6) d(θa')=-12q2(θa'-θa)?????????? (7) 同理,計(jì)算出Ub和Uc,則兩個(gè)三角形之間的相似度取3對(duì)內(nèi)角相似度的平均值 U1=(Ua+Ub+Uc)3 (8) 即所求三角形之間的相似度U1不小于一個(gè)先驗(yàn)值,則判定其為相似三角形,反之則不是。 (3)確定精確匹配點(diǎn)對(duì)。遍歷 Delaunay 三角剖分網(wǎng)格中的所有三角形,依次求出對(duì)應(yīng)的相似值U1并構(gòu)造一個(gè)相似矩陣,用來(lái)存儲(chǔ)所有相似三角形的索引。該索引指向的三角形對(duì)是相互匹配的三角形,每個(gè)索引都具有唯一性,保證不會(huì)有重疊狀況發(fā)生,進(jìn)而確定精確點(diǎn)。 本文方法步驟如下:①讀入一組圖像,利用式(1)檢測(cè)所有候選角點(diǎn)G;②對(duì)候選角點(diǎn)G利用式(2)角點(diǎn)響應(yīng)函數(shù),保留強(qiáng)度值最大的角點(diǎn)K;③完成特征點(diǎn)初步匹配,采用RANSAC估計(jì)模型挑選得到粗匹配點(diǎn)集 Q;④以讀取圖像的左上角為坐標(biāo)原點(diǎn)、圖像長(zhǎng)度為橫軸、高度為縱軸建立坐標(biāo)系,逐點(diǎn)插入剖分點(diǎn)集 Q構(gòu)建 Delaunay 三角網(wǎng)格;⑤利用式(3)-式 (8)遍歷計(jì)算網(wǎng)格中對(duì)應(yīng)三角形的相似度,判定為相似的儲(chǔ)存到相似性度量矩陣S中;⑥重復(fù)步驟④重構(gòu)Delaunay 網(wǎng)格,剩余頂點(diǎn)即為精細(xì)匹配點(diǎn)集。 3 實(shí)驗(yàn)結(jié)果與分析 依據(jù)上述算法步驟設(shè)計(jì)實(shí)驗(yàn)進(jìn)行圖像精細(xì)匹配實(shí)驗(yàn)結(jié)果對(duì)比。 3.1 實(shí)驗(yàn)數(shù)據(jù)與實(shí)驗(yàn)環(huán)境 圖像配準(zhǔn)是研究圖像拼接的重要環(huán)節(jié),改進(jìn)圖像配準(zhǔn)算法可間接優(yōu)化圖像拼接算法。實(shí)驗(yàn)數(shù)據(jù)取自Chang等[22]提出的保持半投影變形方法實(shí)驗(yàn),如圖4所示。取包含遠(yuǎn)深背景和近景平面圖像,圖像重疊區(qū)域具有一定視差變化,即場(chǎng)景過(guò)渡具有視角轉(zhuǎn)移的情形(拍攝鏡頭角度旋轉(zhuǎn)導(dǎo)致),圖像重疊域不在相同的二維平面,如圖5所示。從這個(gè)角度切入,考慮提高圖像重疊區(qū)域的配準(zhǔn)率,則圖像拼接效果必能得到改善。 本文實(shí)驗(yàn)基于Windows 10操作系統(tǒng),聯(lián)合虛擬機(jī)VMware 搭載Ubuntu 16.04LTS系統(tǒng)跨平臺(tái)運(yùn)行完成,計(jì)算機(jī)配置為Intel(R) Core(TM) i7-6700HQ 2.60 GHzCPU,內(nèi)存16GB,使用Microsoft VS2017實(shí)現(xiàn)編程運(yùn)行。 3.2 實(shí)驗(yàn)結(jié)果與對(duì)比 3.2.1 特征點(diǎn)提取速率對(duì)比 本文對(duì)兩組圖像進(jìn)行基準(zhǔn)圖像及待匹配圖像特征點(diǎn)提取,如圖6所示。由圖中可以看出,同一幅圖像中,與經(jīng)典的SIFT、SURF 和快速的 FAST 算法相比,改進(jìn)的 AGAST算法提取的有效特征點(diǎn)個(gè)數(shù)最多,而且提取特征點(diǎn)用時(shí)最短。 3.2.2 特征點(diǎn)匹配方法改進(jìn) 本文采用構(gòu)建 Delaunay三角網(wǎng)方法,利用三角形相似性度量法與傳統(tǒng)的RANSAC算法對(duì)兩組圖像實(shí)驗(yàn)效果進(jìn)行對(duì)比。圖7為采用傳統(tǒng)的RANSAC 算法對(duì)基準(zhǔn)圖像和待匹配圖像篩選出的匹配點(diǎn)集,圖8(彩圖掃描OSID碼可見)為匹配連線圖, 圖中綠框圈出的是明顯錯(cuò)誤的匹配點(diǎn),圖9為采用RANSAC篩選的匹配點(diǎn)集對(duì)基準(zhǔn)圖像和待匹配圖像進(jìn)行Delaunay剖分構(gòu)建的三角網(wǎng)格圖像,圖10是對(duì)上一步構(gòu)建的Delaunay三角剖分網(wǎng)格采用三角形相似性度量法進(jìn)行校正后的三角網(wǎng)格圖像,剔除了差異明顯的三角形,圖11是經(jīng)過(guò)三角形相似性度量后保留的精確匹配點(diǎn)集。 圖7-圖11詳細(xì)展示了兩組圖像特征匹配點(diǎn)的精細(xì)篩選過(guò)程。可以看到在傳統(tǒng)的RANSAC算法初步濾除誤配點(diǎn)后,還有少數(shù)明顯錯(cuò)誤的匹配點(diǎn)被保留,RANSAC可以濾除模型外的點(diǎn),但不能濾除模型內(nèi)的壞點(diǎn)。本文結(jié)合 Delaunay 三角剖分法從圖形學(xué)角度剔除不合理特征點(diǎn),最終得到精確匹配點(diǎn)集,精確剔除了更多的錯(cuò)誤匹配點(diǎn),特征點(diǎn)正確匹配率高于RANSAC算法,具體數(shù)據(jù)如表1所示。 從表1可看出,本文借助Delaunay三角剖分約束特征點(diǎn)匹配后,在不減少RANSAC初步濾除后保留的正確匹配點(diǎn)個(gè)數(shù)情況下,減少了參與匹配的錯(cuò)誤匹配點(diǎn)對(duì)數(shù),提高了特征點(diǎn)對(duì)的正確匹配率。 4 結(jié)語(yǔ) 針對(duì)具有一定視差的重疊域且內(nèi)容具有深度變化的圖像配準(zhǔn),采用一般基于特征的配準(zhǔn)算法特征提取速率較低、正確配準(zhǔn)率不高問(wèn)題,本文提出一種結(jié)合Delaunay三角剖分的自適應(yīng)多尺度快速圖像配準(zhǔn)方法,分特征提取、粗匹配和精細(xì)匹配3個(gè)階段完成。首先運(yùn)用比FAST更快的自適應(yīng)尋找最優(yōu)決策樹的AGAST算法,降低特征點(diǎn)提取方法的時(shí)間成本,然后在 RANSAC 控制的特征點(diǎn)粗匹配后引入Delaunay三角剖分法,在篩選圖像重疊區(qū)域粗匹配點(diǎn)集基礎(chǔ)上構(gòu)建Delaunay三角網(wǎng)格,利用三角形相似性度量進(jìn)一步篩選匹配點(diǎn)對(duì),保留精細(xì)匹配特征點(diǎn)。 多組實(shí)驗(yàn)數(shù)據(jù)表明,在特征提取階段,該方法提升了有效特征點(diǎn)提取數(shù)量,明顯減少了特征點(diǎn)提取時(shí)間。在特征匹配階段,在保證正確匹配點(diǎn)個(gè)數(shù)不減的同時(shí)減少了錯(cuò)誤匹配點(diǎn)數(shù)量,提高了特征點(diǎn)對(duì)正確匹配率。本文方法主要針對(duì)有視差、內(nèi)容有深度變化的圖像,在圖像拼接領(lǐng)域運(yùn)用效果較好,但對(duì)于處理遙感拍攝等內(nèi)容特征變化不明顯的圖像,算法配準(zhǔn)效果還有待進(jìn)一步提升。 參考文獻(xiàn): [1] 許天成,李兆飛. 智能手機(jī)全景圖像拼接算法研究[J]. 軟件導(dǎo)刊,2016,15(2):55-57. [2] 鐘軍,巫海峰,李建宏,等. 新生雄性小鼠泌尿生殖系統(tǒng)的顯微組織三維重建研究[J].? 華小兒外科雜志,2018,39(11):857-861. [3] 何佳蓉,蘇賦. 基于內(nèi)容的圖像檢索發(fā)展方向的探索[J]. 信息通信,2015,14(1):85-86. [4] APTE A,WANG Y,DEASY J. SU-E-I-66:radiomics and image registration updates for the computational environment for radiotherapy research (CERR)[J]. Medical Physics,2014,41(6Part5):145-151. [5] ZHOU Z,YAN M,CHEN S,et al. Image registration and stitching algorithm of rice low-altitude remote sensing based on Harris corner self-adaptive detection[J].? Nongye Gongcheng Xuebao/Transactions of the Chinese Society of Agricultural Engineering,2015,31(14):186-193. [6] PATEL M I,THAKAR V K,SHAH S K. Image registration of satellite images with varying illumination level using HOG descriptor based SURF[J].? Procedia Computer Science,2016,93(5):382-388. [7] 鄒北驥,戴玉蘭,朱承璋,等. 具有仿射不變性的視網(wǎng)膜圖像配準(zhǔn)方法[J]. 計(jì)算機(jī)輔助設(shè)計(jì)與圖形學(xué)學(xué)報(bào),2019,31(6):943-950. [8] MA J,JIANG J J,ZHOU H B,et al. Guided locality preserving feature matching for remote sensing image registration[J]. IEEE Transactions on Geoscience & Remote Sensing,2018,45(99):1-13. [9] WANG Y,ZHENG J,XU Q Z,et al. An improved RANSAC based on the scale variation homogeneity [J].? Allis Well WP,2016,40(PB):751-764. [10] DOU J F,LI J X. Image matching based local delaunay triangulation and affine invariant geometric constraint[J].? Optik? International Journal for Light and Electron Optics,2014,125(1):526-531. [11] LIUG D,LIU S,LI J X. A stereo vision tracking algorithm based on 3-dimensional delaunay triangulation[C].? Proceedings of Control & Decision Conference,2016:3779-3784. [12] XU J J. Fast image registration method based on harris and sift algorithm[J].? Chinese Optics,2015,8(4):574-581. [13] 羅天健,劉秉瀚. 融合特征的快速SURF配準(zhǔn)算法[J]. 中國(guó)圖像圖形學(xué)報(bào),2019,20(1):95-103. [14] ZHAO M,AN B,WU Y,et al. A robust delaunay triangulation matching for multispectral/multidate remote sensing image registration[J].? IEEE Geoscience and Remote Sensing Letters,2015,12(4):711-715. [15] YAN Z G,JIANG J G,GUO D. Image matching based on surf feature and delaunay triangular meshes[J].? Acta Automatica Sinica,2014,40(6):1216-1222. [16] BIADGIE Y,SOHN K A. Speed-up feature detector using adaptive accelerated segment test[J].? IETE Technical Review,2016,33(5):492-504. [17] KYBIC J,JI?íB. Automatic simultaneous segmentation and fast registration of histological images[C].? Proceedings of International Symposium on Biomedical Imaging,2014:974-977. [18] ELMAR M, GREGORY D H, DARIUS B, et al. Adaptive and generic corner detection based on the accelerated segment test[C].?? Proceedings of ECCV,2010:183-196. [19] BALDWINJ F,LAWRY J,MARTIN T P. A mass assignment based id3 algorithm for decision tree induction[J].? International Journal of Intelligent Systems,2015,12(7):523-552. [20] WANG H,LI L,YANG J. A modified self-correction subpixel registration algorithm for passive millimeter wave images[C]. Proceedings of International Conference on Computational Problem-solving (ICCP),IEEE,2013:151-154. [21] MANEL L,GAO Q,TAREK B. Making bayesian tracking and matching by the brisk interest points detector/descriptor cooperate for robust object tracking[C]. Proceedings of International Conference on Signal and Image Processing,2016:731-735. [22] CHANG C H,SATO Y,CHUANG Y Y. Shape-preserving half-projective warps for image stitching[C].? Proceedings of Conference on Computer Vision and Pattern Recognition,2014:3254-3261. (責(zé)任編輯:杜能鋼)