基于Inception-ResNet-v2的乳腺癌輔助診斷方法*

何欣穎 吳黎明 鄭耿哲 吳佳毅

(1.廣東工業大學機電工程學院,廣東 廣州 510006 2.佛山滄科智能科技有限公司,廣東 佛山 528200)

0 引言

癌癥是當前嚴重威脅人類健康的主要疾病,其中乳腺癌是影響女性健康最主要的惡性腫瘤之一。乳腺癌的診斷主要有影像學檢查和病理學檢查2種方法,其中病理學檢查是乳腺病變良惡性的最終診斷依據[1]。因此,病理圖像的分析診斷對判斷是否存在癌癥極其重要。但病理圖像存在細胞重疊、病變細胞形態差異細微、染色不均等特點,導致病理醫生依據經驗耗費大量時間仔細觀察和鑒別做出的診斷,存在受主觀人為因素影響且可能出現漏診誤診的可能[2]。高效準確地自動分類病理圖像,對緩解病理醫生的壓力和給出更加客觀、準確的結果尤為重要[3]。

學者們針對乳腺癌病理圖像自動分類開展了相關研究。在傳統機器學習算法方面,Kowal等[4]基于自適應閾值和聚類分割方法,采用K-means、模糊C均值、競爭學習神經網絡和高斯混合模型4種聚類算法對細胞核進行分割,實驗結果表明準確率達96%~100%;Spanhol等[5]公布了由7909幅乳腺癌病理圖像構成的BreaKHis數據集,并在此數據集上采用基于紋理表示的全局方法,利用局部二值模式(local binary patterns, LBP)、局部相位量化(local phase quantization, LPQ)等6種紋理描述符提取特征并用支持向量機(support vector machine, SVM)、隨機森林(random forest, RF)、二次判別分析(quadratic discriminant analysis, QDA)和K近鄰4種分類器進行分類,準確率達80%~85%。上述方法都是基于傳統機器學習進行病理圖像分類,需要人工設計特征,存在專業知識要求高、提取特征耗時及難以提取高層次特征的問題。

近年來,將深度學習運用到醫療圖像分析領域成為研究熱點之一[6]。深度學習與傳統機器學習最大的不同在于其特征表示是從大量數據中自動學習得到,能從大量的數據集中逐步提取更高層次的抽象語義特征,避免了人工設計及提取特征的局限性[7]。Spanhol等[8]將BreaKHis數據集以隨機和固定滑動窗口的方式,在不同放大倍數的圖像中采樣塊訓練AlexNet網絡,識別率最高達89.6%,無法滿足臨床需要。Deniz等[9]提出先用遷移學習預訓練AlexNet,VGG16網絡,再對網絡進行微調,實現乳腺癌病理圖像的自動分類,最佳精度值達93.78%,證明了使用遷移學習進行預訓練比直接使用深度卷積網絡或 SVM的效果更好。

由于目前缺乏大量公開、已標注的數據集,本文基于深度卷積神經網絡實現乳腺癌病理圖像的自動分類,采用遷移學習解決數據稀少、易過擬合的問題;用數據增強,增加訓練的數據量,提高模型的泛化能力,滿足更加精準地判斷乳腺病理圖像的需求。

1 模型與方法

1.1 Inception-ResNet-v2網絡

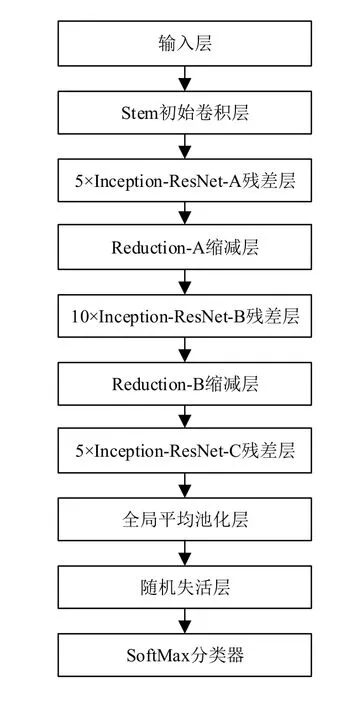

對比目前常用的深度卷積神經網絡模型AlexNet,VGG,Inception、ResNet等,本文選用在ILSVRC圖像分類基準測試中實現當下較好成績的 Inception-ResNet-v2網絡作為基本結構,實現乳腺癌病理圖像分類。Inception-ResNet-v2網絡在Inception V3基礎上引入了殘差網絡跳躍連接的方法,加深網絡深度的同時,避免了梯度消失、梯度爆炸的問題,提高了網絡性能;將卷積核進行分解,提升了計算能力,使得網絡深度進一步增加,并增加了網絡的非線性,整體結構如圖1所示。

圖1 Inception-ResNet-v2網絡總體結構

Inception-ResNet-v2要求輸入層為299×299×3的RGB圖片;中間各層得到的結果稱為特征圖(Feature Map),主要包括組合卷積、池化、殘差、張量連接等運算,其中組合卷積以“多通道卷積—批歸一化—激活運算”的方式進行;輸出層以SoftMax分類器為基礎,利用特征圖中的各個特征分量預測圖片屬于某類別的概率。

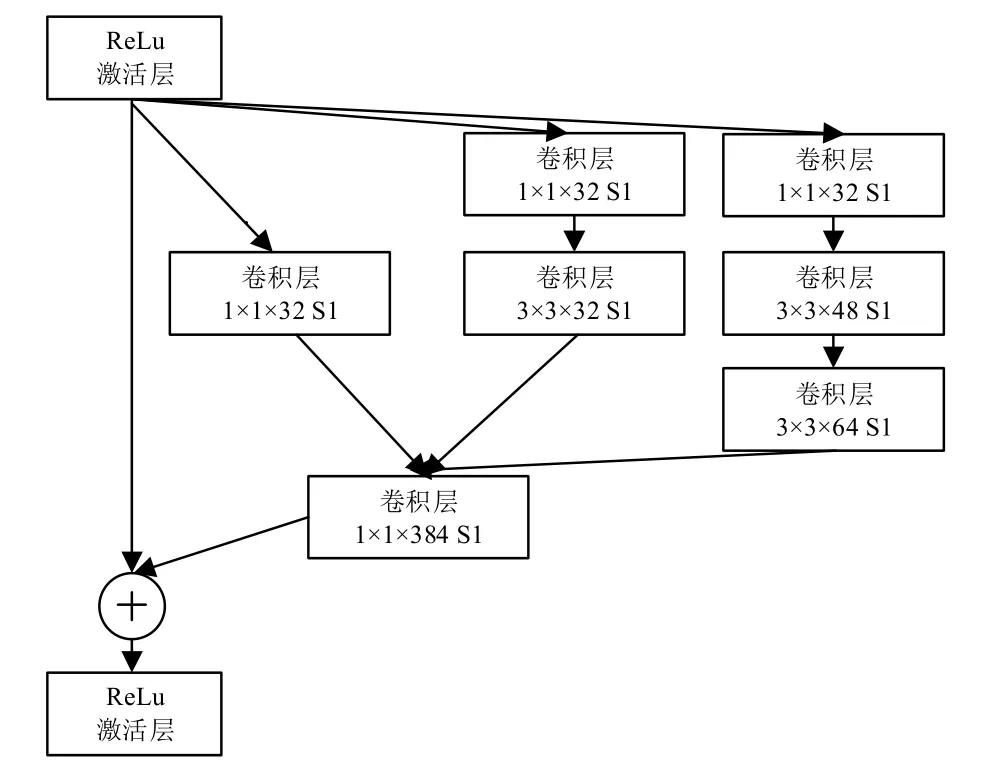

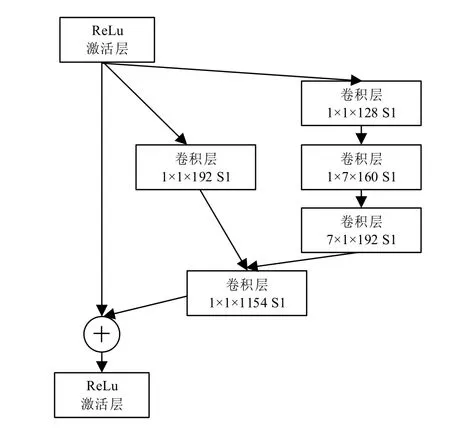

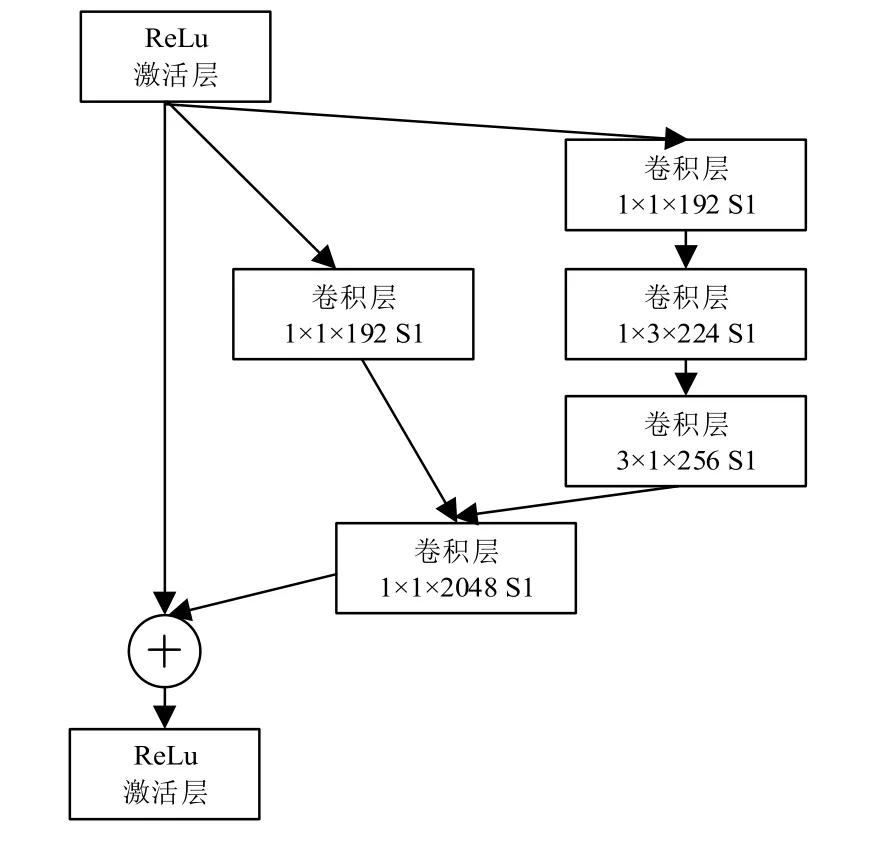

該網絡的特征提取模塊為 Inception-ResNet-A、Inception-ResNet-B、Inception-ResNet-C多路卷積殘差模塊,結構分別如圖2、圖3、圖4所示。Feature Map經ReLu激活函數后進入右路通道進行組合卷積運算;通過張量連接、殘差結構后,再進入ReLu中進行激活處理,其中 S1代表卷積步長為 1。在 Inception-Resnet-B、Inception-Resnet-C結構中,右路卷積將7×7和 3×3 的卷積核分解成 1×7、7×1 和 1×3、3×1 的不對稱卷積核,在提高運算性能的同時加深了網絡深度及非線性。

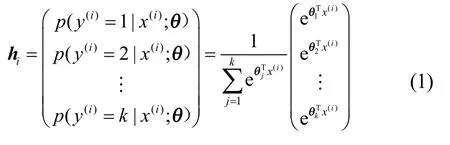

Inception-ResNet-v2網絡結構最終得到的Feature Map是一個1×1792維的特征向量。SoftMax分類器以1792維向量作為輸入,輸出向量的維度與類別數相同。對于每張輸入圖像x(i),其標記為y(i)∈ { 1 , 2,…,k} ,共k類,本文僅對乳腺癌病理圖像做良惡性分類,即k= 2。用假設函數估計其屬于每個類別j的概率p(y(i)=j|x(i)),則假設函數hi為

矩陣θ中,每一列參數負責每一類的預測。在訓練過程中通過式(2)、式(3)優化θ矩陣以及前面所有層的卷積核參數,使損失函數LossFunc(θ) 最小,得到最終的權重值。

式中,m為輸入的病理圖像數;1 (y(i)=j)為指示性函數。

圖2 Inception-ResNet-A

圖3 Inception-ResNet-B

圖4 Inception-ResNet-C

1.2 數據增強與遷移學習

卷積神經網絡需要學習的參數眾多,因此需要大規模的數據集才能防止過擬合。但現階段獲得由專業病理醫生標注的大規模數據集極其困難且代價昂貴,導致缺乏大規模、已標注的醫療圖像訓練數據。本文采取遷移學習、數據增強的方法來解決此問題[10-11]。

遷移學習通過在大規模數據集上進行預訓練,得到模型初始化參數;再遷移到目標數據集上進行微調和訓練,從而加快并優化模型的學習效率[12]。本文在ImageNet數據集(包含1400余萬幅圖像和2萬多個類別)上對Inception-ResNet-v2進行預訓練,得到的模型參數作為網絡初始化參數;然后遷移到目標數據集BreaKHis上進行微調訓練。同時采用仿射變換方法對原始圖像進行數據增強,主要通過將圖像旋轉、平移、翻轉、顏色變換等,將數據集擴充5倍。

2 實驗

2.1 數據集

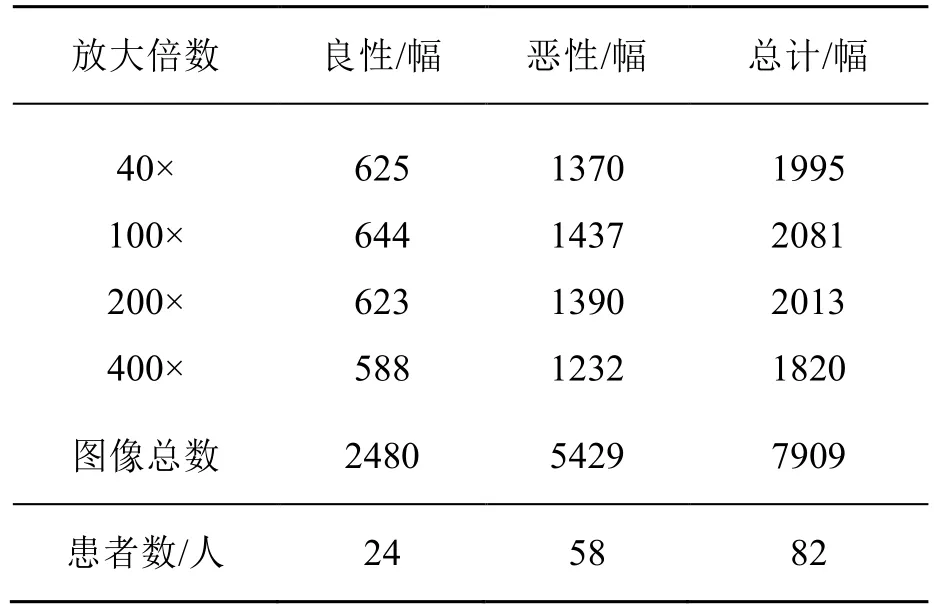

本文使用BreaKHis數據集[6],其數據來自于82位患者的病理切片,每張病理切片均采用4種放大倍數,共7909幅。其中2480幅良性樣本和5429幅惡性腫瘤樣本,數據集分布情況如表1所示。

表1 BreaKHis數據集具體分布情況

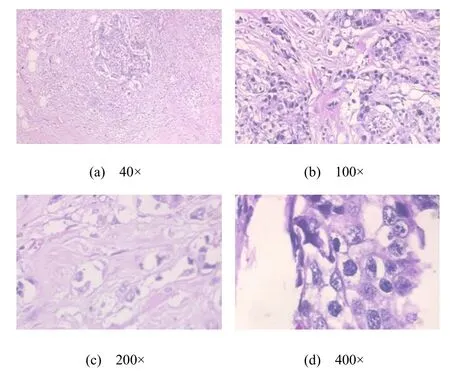

每張圖像的固定像素為700×460,模式為三通道RGB、PNG格式。數據集的每幅樣本都已做好標注,如SOB_B_TA-14-4659-40-001.png是通過外科開放活組織檢查(SOB)收集、放大倍數為40×的管狀滑動腺瘤(TA)類型的良性腫瘤(Benign)的圖像1,其圖像來自幻燈片14-4659。圖5為數據集惡性腫瘤中的小葉癌(LC)放大不同倍數的圖片。

圖5 不同放大倍數下的惡性腫瘤病理圖像

將上述數據集按照6:2:2的比例隨機劃分成訓練集、驗證集、測試集;將圖片大小 700×460裁剪成299×299送到網絡中進行微調訓練,實驗結果為5次隨機分配數據集實驗的平均值。

2.2 實驗平臺與超參數

本文實驗平臺配置包括:處理器 Intel i7-7700k;內存 32 G DDR4 2400 MHz;2個 Nvidia GeForce GTX1080Ti顯卡;固態硬盤 850EVOSATA3(120 G);操作系統為 64位 Ubuntu14.04 LTS;實驗框架為TensorFlow開源框架。

在微調階段將訓練集、驗證集中的圖像送入預訓練好的Inception-ResNet-v2網絡進行訓練,使用自適應矩估計(Adam)梯度優化算法對權重、偏置進行更新;初始學習率設置為0.001;動量因子取0.9和0.999;每次訓練的批量數為64;當訓練迭代次數達20000次時,將學習率調為0.0001,便于收斂網絡。

2.3 實驗結果與分析

對于二分類問題,本文使用圖片識別率即準確率(ACC)作為模型的評價指標

式中,Nall為測試集中所有的圖像數目;Nr為測試集中正確分類的圖像數目。

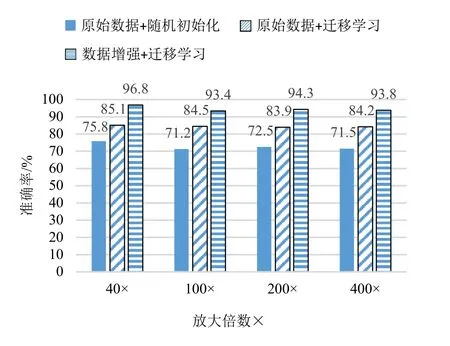

為驗證數據增強、遷移學習的有效性,本實驗對是否采用數據增強及遷移學習前后3種分類結果進行對比,如圖6所示。

圖6 數據增強及遷移學習前后的分類結果

圖6結果顯示數據增強、遷移學習后,準確率都有大幅度提高,證實了模型在預訓練時學到了一些淺層特征,有助于模型在目標數據集上更好地學習;證實了數據增強,擴充數據集后,能有效提高模型的分類性能。在 40×放大倍數下,得到的準確率最高達96.8%,反映了 40×放大倍數的病理圖像包含了更多區別良惡性腫瘤的特征,包括組織結構及細胞核特征。

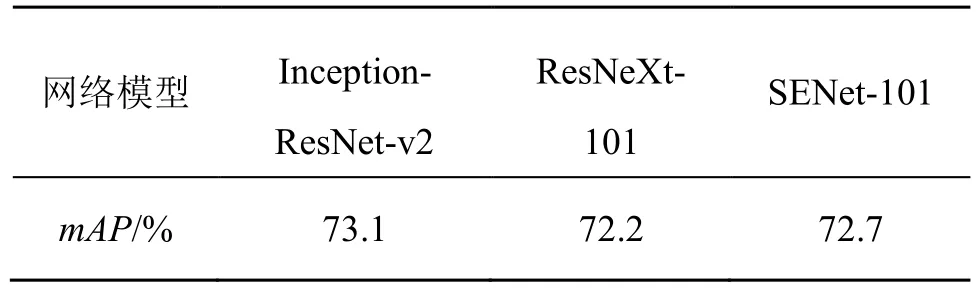

為驗證Inception-ResNet-v2網絡性能,在相同的實驗環境和訓練策略下,對比與 Inception-ResNet-v2卷積層數相近的ResNeXt-101和SENet-101網絡的訓練性能。以均值平均精度(mAP)作為指標進行比較,分別計算3條P-R曲線(即精確率—召回率曲線)的積分得到mAP值,如表2所示。

表2 mAP對比結果

由表2可知,Inception-ResNet-v2的mAP值高于ResNeXt-101和SENet-101網絡模型,該網絡模型在總體分類性能上略優于其他二者。

3 結論

本文利用深度學習方法實現了乳腺癌病理圖像的自動分類,比傳統機器學習方法能提取到更高層的抽象語義特征。通過實驗,驗證了遷移學習和數據增強的有效性,及基于Inception-ResNet-v2網絡模型的分類性能略優于其他相近的網絡模型。實驗在40×放大倍數下,準確率達96.8%,在一定程度上可應用于實際醫學輔助診斷場景。